【入门教程】TensorFlow 2.0 模型:模型类的建立

文 / 李锡涵,Google Developers Expert

本文节选自《简单粗暴 TensorFlow 2.0》

![]()

在《【入门教程】TensorFlow 2.0 基础:张量、自动求导与优化器》中,我们手工实现了一个简单的线性回归模型。不过,当模型变得日益复杂时,直接将模型代码写在主程序中就显得臃肿且难以重用了。于是,我们希望有一个高层的模型类,能够帮助我们将模型进行封装。本篇文章即介绍模型类的建立方法。

在 TensorFlow 中,推荐使用 Keras ( tf.keras ) 构建模型。Keras 是一个广为流行的高级神经网络 API,简单、快速而不失灵活性,现已得到 TensorFlow 的官方内置和全面支持。

Keras 有两个重要的概念: 模型(Model) 和 层(Layer) 。层将各种计算流程和变量进行了封装(例如基本的全连接层,CNN 的卷积层、池化层等),而模型则将各种层进行组织和连接,并封装成一个整体,描述了如何将输入数据通过各种层以及运算而得到输出。在需要模型调用的时候,使用 y_pred = model(X) 的形式即可。Keras 在 tf.keras.layers 下内置了深度学习中大量常用的的预定义层,同时也允许我们自定义层。

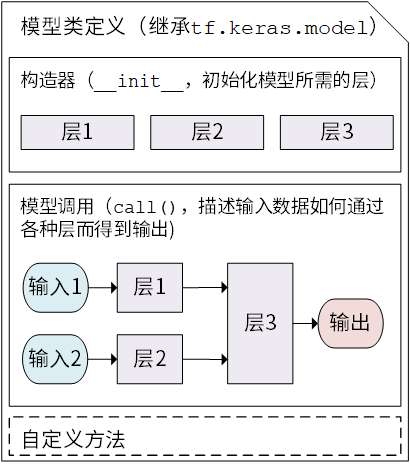

Keras 模型以类的形式呈现,我们可以通过继承 tf.keras.Model 这个 Python 类来定义自己的模型。在继承类中,我们需要重写 __init__() (构造函数,初始化)和 call(input) (模型调用)两个方法,同时也可以根据需要增加自定义的方法。

1class MyModel(tf.keras.Model):

2 def __init__(self):

3 super().__init__()

4 # 此处添加初始化代码(包含call方法中会用到的层),例如

5 # layer1 = tf.keras.layers.BuiltInLayer(...)

6 # layer2 = MyCustomLayer(...)

7

8 def call(self, input):

9 # 此处添加模型调用的代码(处理输入并返回输出),例如

10 # x = layer1(input)

11 # output = layer2(x)

12 return output

13

14 # 还可以添加自定义的方法Keras 模型类定义示意图

继承 tf.keras.Model 后,我们同时可以使用父类的若干方法和属性,例如在实例化类 model = Model() 后,可以通过 model.variables 这一属性直接获得模型中的所有变量,免去我们一个个显式指定变量的麻烦。

上一篇文章 中简单的线性模型 y_pred = a * X + b ,我们可以通过模型类的方式编写如下:

1import tensorflow as tf

2

3X = tf.constant([[1.0, 2.0, 3.0], [4.0, 5.0, 6.0]])

4y = tf.constant([[10.0], [20.0]])

5

6

7class Linear(tf.keras.Model):

8 def __init__(self):

9 super().__init__()

10 self.dense = tf.keras.layers.Dense(

11 units=1,

12 activation=None,

13 kernel_initializer=tf.zeros_initializer(),

14 bias_initializer=tf.zeros_initializer()

15 )

16

17 def call(self, input):

18 output = self.dense(input)

19 return output

20

21

22# 以下代码结构与前节类似

23model = Linear()

24optimizer = tf.keras.optimizers.SGD(learning_rate=0.01)

25for i in range(100):

26 with tf.GradientTape() as tape:

27 y_pred = model(X) # 调用模型 y_pred = model(X) 而不是显式写出 y_pred = a * X + b

28 loss = tf.reduce_mean(tf.square(y_pred - y))

29 grads = tape.gradient(loss, model.variables) # 使用 model.variables 这一属性直接获得模型中的所有变量

30 optimizer.apply_gradients(grads_and_vars=zip(grads, model.variables))

31print(model.variables)这里,我们没有显式地声明 a 和 b 两个变量并写出 y_pred = a * X + b 这一线性变换,而是建立了一个继承了 tf.keras.Model 的模型类 Linear 。这个类在初始化部分实例化了一个 全连接层 (tf.keras.layers.Dense ),并在 call 方法中对这个层进行调用,实现了线性变换的计算。

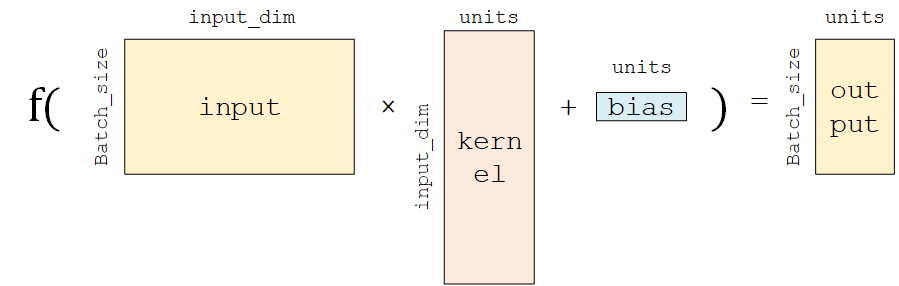

Keras 的全连接层:线性变换 + 激活函数

全连接层 (Fully-connected Layer,tf.keras.layers.Dense ) 是 Keras 中最基础和常用的层之一,对输入矩阵 ![]() 进行

进行 ![]() 的线性变换 + 激活函数操作。如果不指定激活函数,即是纯粹的线性变换

的线性变换 + 激活函数操作。如果不指定激活函数,即是纯粹的线性变换 ![]() 。具体而言,给定输入张量

。具体而言,给定输入张量 input = [batch_size, input_dim] ,该层对输入张量首先进行 tf.matmul(input, kernel) + bias 的线性变换 ( kernel和 bias 是层中可训练的变量),然后对线性变换后张量的每个元素通过激活函数 activation ,从而输出形状为 [batch_size, units] 的二维张量。

其包含的主要参数如下:

-

units:输出张量的维度; -

activation:激活函数,对应于 中的

中的  ,默认为无激活函数(

,默认为无激活函数( a(x) = x)。常用的激活函数包括tf.nn.relu,tf.nn.tanh和tf.nn.sigmoid; -

use_bias:是否加入偏置向量bias,即 中的

中的  。默认为

。默认为 True; -

kernel_initializer、bias_initializer:权重矩阵kernel和偏置向量bias两个变量的初始化器。默认为tf.glorot_uniform_initializer[1] 。设置为tf.zeros_initializer表示将两个变量均初始化为全 0;

该层包含权重矩阵kernel = [input_dim, units]和偏置向量bias = [units][2] 两个可训练变量,对应于 ![]() 中的

中的 ![]() 和

和 ![]() 。

。

[1] Keras 中的很多层都默认使用 tf.glorot_uniform_initializer 初始化变量,点击 此处 可参考该初始化器。

[2] 你可能会注意到, tf.matmul(input, kernel) 的结果是一个形状为 [batch_size, units] 的二维矩阵,这个二维矩阵要如何与形状为 [units] 的一维偏置向量 [bias] 相加呢?事实上,这里是 TensorFlow 的 Broadcasting 机制在起作用,该加法运算相当于将二维矩阵的每一行加上了 [bias]。点击详见 Broadcasting 机制的具体介绍。

为什么模型类是重载 call() 方法而不是 __call__() 方法?

在 Python 中,对类的实例 myClass 进行形如 myClass() 的调用等价于 myClass.__call__() 。那么看起来,为了使用 y_pred = model(X) 的形式调用模型类,应该重写 __call__() 方法才对呀?原因是 Keras 在模型调用的前后还需要有一些自己的内部操作,所以暴露出一个专门用于重载的 call() 方法。tf.keras.Model 这一父类已经包含 __call__() 的定义。 __call__() 中主要调用了 call() 方法,同时还需要在进行一些 keras 的内部操作。这里,我们通过继承 tf.keras.Model 并重载 call() 方法,即可在保持 keras 结构的同时加入模型调用的代码。

福利 | 问答环节

在上一篇文章《【入门教程】TensorFlow 2.0 基础:张量、自动求导与优化器》中,我们对于部分具有代表性的问题回答如下:

Q1:为什么我感觉反而变麻烦了,如果我有一个很大的网络,难道要把整个网络都包在 tape 上下文里吗?感觉很别扭。

A:当模型变得日益复杂时,我们可以使用本文所介绍的方法,将较大的网络结构封装在 tf.keras.Model 的模型类中。这样,只需实例化所建立的模型,并在 tf.GradientTape 的上下文中使用形如 y_pred = model(X) 的方式调用模型,即可清晰明了地调用模型,而无需将整个网络的代码都显式地放在 tape 的上下文中。后续的文章将会对此给出具体的示例。

Q2:可以总结下 1.X 中有哪些常用功能被废弃了嘛。

A:主要包括以下几点:

-

鼓励大家使用即时运行机制(Eager Execution)来更直观地编写、调试模型,而非 TensorFlow 1.X 中基于显式建立图模型的编写方式。这也是本系列文章所希望介绍的主要内容。也就是说,在 1.X 中熟悉的 tf.Session, tf.placeholder 等都将不再鼓励使用。如果确实需要使用图模式,可以使用 @tf.function。

-

对大量 API 进行了清理,尤其是减少了重复的 API 数量(比如取消了 tf.layers)。大部分 API 统一到了 tf.keras 内,鼓励大家使用 tf.keras 构建和训练模型。

-

变量的声明方式也有了很大的改变。tf.get_variable(),tf.variable_scope(), tf.global_variables_initializer() 等全局的,基于变量名称的 API 都不再使用,转而使用和原生 Python 更加接近的 tf.Variable。和普通的 Python 程序一样,你需要自己管理程序中的变量。

-

tf.contrib 退出历史舞台。

-

更多内容可参考:

-

高效的 TensorFlow

-

从TF1 迁移到 TF2

-

Q3:TensorFlow Lite 和 TensorFlow 2.0 是一样的使用方法吗?

A:TensorFlow Lite 是一个帮助你在移动端或嵌入式平台高效运行 TensorFlow 模型的库。和我们在本系列文章中介绍的 TensorFlow 2.0 是很有区别的。简单而言,我们一般用 TensorFlow 2.0 训练模型,而当我们需要在移动端或者嵌入式平台运行模型时,则将训练好的模型进行导出,使用 TensorFlow Lite 的转换器(Converter)转换为特定的格式,并使用 TensorFlow Lite 的解释器(Interpreter)在特定平台上高效运行模型。目前在 TensorFlow Lite 下并无法编写和训练模型。

Q4:STN 空间变换网络是预训练好的模型吗,还是需要自己训练?

A:大部分情况下,网络的类型和模型是否有预训练过没有直接关系。如果有人用这个网络训练过并且将模型和训练好的权值公开出来,那就可以直接使用这个其他人预训练好的模型。如果没人公开,也可以自己训练。一些较为常用的网络结构(例如 Universal Sentence Encoder)往往有预训练好的模型供下载,可以访问 TensorFlow Hub(中文网站、英文网站)作进一步了解。目前我们还没有在网络上发现空间变换网络(Spatial Transformer Networks)的预训练模型,不过有一些基于 TensorFlow 的 开源实现 可以参考。

如果也想像大神一样快速进步,别错过 TensorFlow 官方团队在中国大学慕课平台推出的《TensorFlow 入门实操课程》,帮助你了解更多机器学习设计思路和实践模式。立即点击此处学习吧!

有任何学习疑问,欢迎移步“问答”版块发帖提问。你的问题有机会得到 CSDN 百大热门技术博主、资深社区作者或者 TensorFlow 资深开发者的解答哦!同时,我们也欢迎你积极地在这个版块里,回答其他小伙伴提出的问题,成为 CSDN 社区贡献者,迈出出道第一步!马上开始讨论吧!

还想获取更多入门课程和产品信息?记得扫码关注 TensorFlow 官方微信公众号( TensorFlow_official )!

![]()