决策树算法梳理

目录

1. 信息论基础(熵 联合熵 条件熵 信息增益 基尼不纯度)

2.决策树的不同分类算法(ID3算法、C4.5、CART分类树)的原理及应用场景

3. 回归树原理

4. 决策树防止过拟合手段

5. 模型评估

6. sklearn参数详解,Python绘制决策树

7.参考

1. 信息论基础(熵 联合熵 条件熵 信息增益 基尼不纯度)

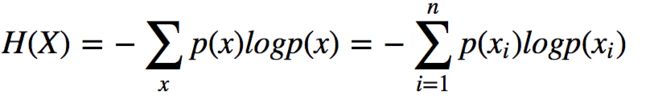

1.熵:本是热力学中表征物质状态的参量之一,用符号S表示,其物理意义是体系混乱程度的度量。对于机器学习算法来说,熵指代香农熵,是一种不确定性度量。它是表示随机变量不确定的度量,是对所有可能发生的事件产生的信息量的期望。对于事件X,有n种可能结果,且概率分别为p1,p2,...,pn,则熵H(X)为:

基本性质:

- 均匀分布具有最大的熵。一个好的不确定性度量会在均匀分布时达到最大的值。给定n个可能的结果,在所有结果的概率相同时得到最大的熵。

- 对于独立事件,熵是可加的。两个独立事件的联合熵等于各个独立事件的熵的和。

- 具有非零概率的结果数量增加,熵也会增加。加入发生概率为0的结果并不会有影响。

- 连续性。不确定性度量应该是连续的,熵函数是连续的。

- 具有更多可能结果的均匀分布有更大的不确定性。

- 非负性。事件拥有非负的不确定性。

- 确定事件的熵为0。有确定结果的事件具有0不确定性。

- 参数排列不变性。调转参数顺序没有影响。

2.联合熵:一维随机变量分布推广到多维随机变量分布,则其联合熵 (Joint entropy) 为:

![]()

注:熵只依赖于随机变量的分布,与随机变量取值无关。

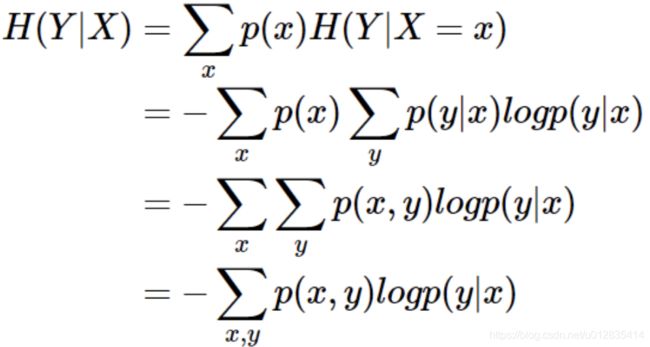

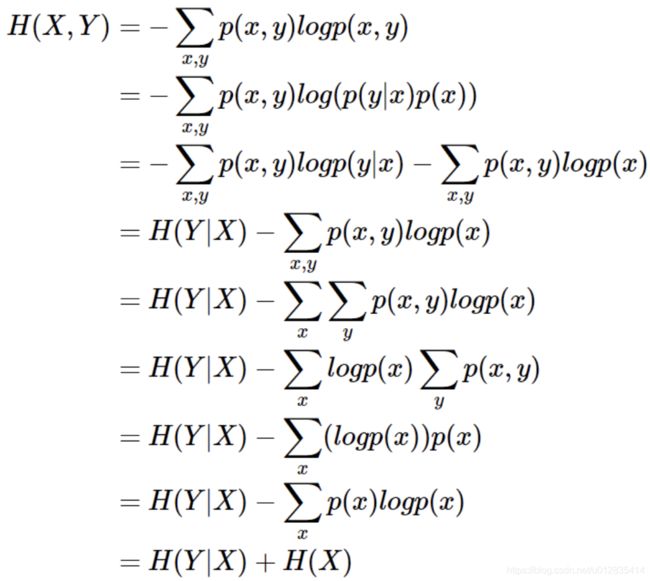

3.条件熵: H(Y|X) 表示在已知随机变量 X 的条件下随机变量 Y 的不确定性。条件熵 H(Y|X) 定义为 X 给定条件下 Y 的条件概率分布的熵对 X 的数学期望。

条件熵 H(Y|X) 相当于联合熵 H(X,Y) 减去单独的熵 H(X),即H(Y|X)=H(X,Y)−H(X)。证明:

当已知 H(X) 这个信息量的时候,H(X,Y) 剩下的信息量就是条件熵,描述 X 和 Y 所需的信息是描述 X 自己所需的信息,加上给定 X 的条件下具体化 Y 所需的额外信息。

4.信息增益:以某特征划分数据集前后的熵的差值。即待分类集合的熵和选定某个特征的条件熵之差(这里只的是经验熵或经验条件熵,由于真正的熵并不知道,是根据样本计算出来的),公式如下:

![]()

注:这里不要理解偏差,因为上边说了熵是类别的,但是在这里又说是集合的熵,没区别,因为在计算熵的时候是根据各个类别对应的值求期望来等到熵

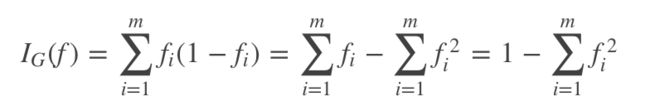

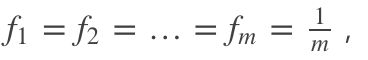

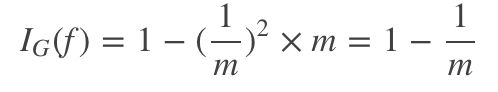

5.基尼不纯度:将来自集合中的某种结果随机应用于集合中某一数据项的预期误差率。即从一个数据集中随机选取子项,度量其被错误的划分到其他组里的概率。

(1)显然基尼不纯度越小,纯度越高,集合的有序程度越高,分类的效果越好;

(2)基尼不纯度为 0 时,表示集合类别一致;

例,如果集合中的每个数据项都属于同一分类,此时误差率为 0。如果有四种可能的结果均匀地分布在集合中,此时的误差率为 1−0.25=0.75;

2.决策树的不同分类算法(ID3算法、C4.5、CART分类树)的原理及应用场景

- 决策数算法3步:特征选择、决策树生成、决策树剪枝

- 决策树的生成过程就是:使用满足划分准则的特征不断的将数据集划分为纯度更高,不确定性更小的子集的过程。对于当前数据集D的每一次的划分,都希望根据某特征划分之后的各个子集的纯度更高,不确定性更小。

- 度量划分数据集前后的数据集的纯度以及不确定性:特征选择准则,如:信息增益,信息增益率,基尼指数

-

特征选择准则:度量样本集合不确定性以及纯度的方法。

目的:使用某特征对数据集划分之后,各数据子集的纯度要比划分前的数据集D的纯度高(不确定性要比划分前数据集D的不确定性低。)

注意:

1. 划分后的纯度为各数据子集的纯度的加和。

2. 度量划分前后的纯度变化 用子集的纯度之和与划分前的数据集D的纯度 进行对比。

1. ID3:采用信息增益划分数据

熵可以表示样本集合的不确定性,熵越大,样本的不确定性就越大。因此可以使用划分前后集合熵的差值来衡量使用当前特征对于样本集合D划分效果的好坏。

划分前样本集合D的熵是一定的 ,entroy(前),

使用某个特征A划分数据集D,计算划分后的数据子集的熵 entroy(后)

信息增益 = entroy(前) - entroy(后)

书中公式:

![]()

做法:计算使用所有特征划分数据集D,得到多个特征划分数据集D的信息增益,从这些信息增益中选择最大的,因而当前结点的划分特征便是使信息增益最大的划分所使用的特征。

信息增益的理解:对于待划分的数据集D,其 entroy(前)是一定的,但是划分之后的熵 entroy(后)是不定的,entroy(后)越小说明使用此特征划分得到的子集的不确定性越小(也就是纯度越高),因此 entroy(前) - entroy(后)差异越大,说明使用当前特征划分数据集D的话,其纯度上升的更快。而我们在构建最优的决策树的时候总希望能更快速到达纯度更高的集合,这一点可以参考优化算法中的梯度下降算法,每一步沿着负梯度方法最小化损失函数的原因就是负梯度方向是函数值减小最快的方向。同理:在决策树构建的过程中我们总是希望集合往最快到达纯度更高的子集合方向发展,因此我们总是选择使得信息增益最大的特征来划分当前数据集D。

缺点:信息增益偏向取值较多的特征

原因:当特征的取值较多时,根据此特征划分更容易得到纯度更高的子集,因此划分之后的熵更低,由于划分前的熵是一定的,因此信息增益更大,因此信息增益比较 偏向取值较多的特征。

2. C4.5:采用信息增益比划分数据,解决ID3问题

信息增益比 = 惩罚参数 * 信息增益

书中公式:

![]()

注意:其中的HA(D),对于样本集合D,将当前特征A作为随机变量(取值是特征A的各个特征值),求得的经验熵。

(之前是把集合类别作为随机变量,现在把某个特征作为随机变量,按照此特征的特征取值对集合D进行划分,计算熵HA(D))

![]()

信息增益比本质: 是在信息增益的基础之上乘上一个惩罚参数。特征个数较多时,惩罚参数较小;特征个数较少时,惩罚参数较大。

惩罚参数:数据集D以特征A作为随机变量的熵的倒数,即:将特征A取值相同的样本划分到同一个子集中(之前所说数据集的熵是依据类别进行划分的)

![]()

缺点:信息增益比偏向取值较少的特征

原因: 当特征取值较少时HA(D)的值较小,因此其倒数较大,因而信息增益比较大。因而偏向取值较少的特征。

使用信息增益比:基于以上缺点,并不是直接选择信息增益率最大的特征,而是现在候选特征中找出信息增益高于平均水平的特征,然后在这些特征中再选择信息增益率最高的特征。

3. CART:采用基尼系数划分数据

定义:基尼指数(基尼不纯度):表示在样本集合中一个随机选中的样本被分错的概率。

注意: Gini指数越小表示集合中被选中的样本被分错的概率越小,也就是说集合的纯度越高,反之,集合越不纯。

即 基尼指数(基尼不纯度)= 样本被选中的概率 * 样本被分错的概率

书中公式:

![]()

说明:

1. pk表示选中的样本属于k类别的概率,则这个样本被分错的概率是(1-pk)

2. 样本集合中有K个类别,一个随机选中的样本可以属于这k个类别中的任意一个,因而对类别就加和

3. 当为二分类是,Gini(P) = 2p(1-p)

样本集合D的Gini指数 : 假设集合中有K个类别,则:

![]()

基于特征A划分样本集合D之后的基尼指数:

需要说明的是CART是个二叉树,也就是当使用某个特征划分样本集合只有两个集合:1. 等于给定的特征值 的样本集合D1 , 2 不等于给定的特征值 的样本集合D2

实际上是对拥有多个取值的特征的二值处理。

举个例子:

假设现在有特征 “学历”,此特征有三个特征取值: “本科”,“硕士”, “博士”,

当使用“学历”这个特征对样本集合D进行划分时,划分值分别有三个,因而有三种划分的可能集合,划分后的子集如下:

- 划分点: “本科”,划分后的子集合 : {本科},{硕士,博士}

- 划分点: “硕士”,划分后的子集合 : {硕士},{本科,博士}

- 划分点: “硕士”,划分后的子集合 : {博士},{本科,硕士}

对于上述的每一种划分,都可以计算出基于 划分特征= 某个特征值 将样本集合D划分为两个子集的纯度:

![]()

因而对于一个具有多个取值(超过2个)的特征,需要计算以每一个取值作为划分点,对样本D划分之后子集的纯度Gini(D,Ai),(其中Ai 表示特征A的可能取值)

然后从所有的可能划分的Gini(D,Ai)中找出Gini指数最小的划分,这个划分的划分点,便是使用特征A对样本集合D进行划分的最佳划分点。

3. 回归树原理

回归是为了处理预测值是连续分布的情景,其返回值应该是一个具体预测值。回归树的叶子是一个个具体的值,从预测值连续这个意义上严格来说,回归树不能称之为“回归算法”。因为回归树返回的是“一团”数据的均值,而不是具体的、连续的预测值(即训练数据的标签值虽然是连续的,但回归树的预测值却只能是离散的)。所以回归树其实也可以算为“分类”算法,其适用场景要具备“物以类聚”的特点,即特征值的组合会使标签属于某一个“群落”,群落之间会有相对鲜明的“鸿沟”。利用回归树可以将复杂的训练数据划分成一个个相对简单的群落,群落上可以再利用别的机器学习模型再学习。

模型树的叶子是一个个机器学习模型,如线性回归模型,所以更称的上是“回归”算法。利用模型树就可以度量一个人的文艺值了。

回归树和模型树也需要剪枝,剪枝理论和分类树相同。为了获得最佳模型,树剪枝常采用预剪枝和后剪枝结合的方法进行。

1回归树-利用差值选择分支特征

树回归中,为成功构建以分段常数为叶节点的树,需要度量出数据的一致性。分类决策树创建时会在给定节点时计算分类数据的混乱度。那么如何计算连续型数值的混乱度呢? 事实上, 在连续数据集上计算混乱度是非常简单的–度量按某一特征划分前后标签数据总差值,每次选取使数据总差值最小的那个特征做最佳分支特征为了对正负差值同等看待,一般使用绝对值或平方值来代替上述差值)。为什么选择计算差值呢》差值越小,相似度越高,越可能属于一个群落咯。那么如果选取方差做差值,总方差的计算方法有两种:

(1)计算数据集均值std,计算每个数据点与std的方差,然后n个点求和。

(2)计算数据集方差var,然后var_sum = var*n,n为数据集数据数目。Python Matrix中可以利用var方法求得数据集方差,因此该方法简单、方便。

与Gini Gain对离散特征和连续特征的处理方法类似,多值离散特征需要选择最优二分序列,连续特征则要找出最优分裂点。

那么,每次最佳分支特征的选取过程为:

function chooseBestSplitFeature()

(1)先令最佳方差为无限大bestVar=inf。

(2)依次计算根据某特征(FeatureCount次迭代)划分数据后的总方差currentVar(,计算方法为:划分后左右子数据集的总方差之和),如果currentVar

2采取线性回归预测偏差构建模型树

用树来对数据建模,除了把叶节点简单地设定为常数值之外,还有一种方法是把叶节点设定为分段线性函数,这里所谓的分段线性(piecewise linear)是指模型由多个线性片段组成,这就是模型树。模型树的可解释性是它优于回归树的特点之一。另外,模型树也具有更髙的预测准确度。

模型树的创建过程大体上与回归树是一样的,区别就在于递归过程中最佳分支特征选取时差值的计算。对于模型树:给定的数据集先用线性的模型来对它进行拟合,然后计算真实的目标值与模型预测值间的差值,将这些差值的平方求和就得到了所需的总差值,最后依然选取总差值最小的特征做分支特征。至于线性回归采用哪种解法,就要参看线性回归模型的求解了。

4. 决策树防止过拟合手段

预剪枝:是在决策树的生成过程中,对每个结点在划分前先进行估计,若当前结点的划分不能带来决策树泛化性能提升,则停止划分即结束树的构建并将当前节点标记为叶结点;

后剪枝:是先从训练集生成一棵完整的决策树,然后自底向上地对叶结点进行考察,若将该结点对应的子树替换为叶结点能带来决策树泛化为性能提升,则将该子树替换为叶结点。泛化性能的提升可以使用交叉验证数据来检查修剪的效果,通过使用交叉验证数据,测试扩展节点是否会带来改进。如果显示会带来改进,那么我们可以继续扩展该节点。但是,如果精度降低,则不应该扩展,节点应该转换为叶节点。

5. 模型评估

分类树:

- Accuracy

- Precision

- Recall

- F1 score

- ROC曲线和AUC

- PR曲线

回归树:

- 平均绝对误差 Mean Absolute Error, MAE

- 均方误差 Mean Squared Error, MSE

- R-squared:拟合度检验是对已制作好的预测模型进行检验,比较它们的预测结果与实际发生情况的吻合程度。

6. sklearn参数详解,Python绘制决策树

分类决策树的类对应的是DecisionTreeClassifier,而回归决策树的类对应的是DecisionTreeRegressor

分类树:

from sklearn.tree import DecisionTreeClassifier

DecisionTreeClassifier(criterion="gini",

splitter="best",

max_depth=None,

min_samples_split=2,

min_samples_leaf=1,

min_weight_fraction_leaf=0.,

max_features=None,

random_state=None,

max_leaf_nodes=None,

min_impurity_decrease=0.,

min_impurity_split=None,

class_weight=None,

presort=False)

criterion:特征选择的标准,有信息增益和基尼系数两种,使用信息增益的是ID3和C4.5算法(使用信息增益比),使用基尼系数的CART算法,默认是gini系数。splitter:特征切分点选择标准,决策树是递归地选择最优切分点,spliter是用来指明在哪个集合上来递归,有“best”和“random”两种参数可以选择,best表示在所有特征上递归,适用于数据集较小的时候,random表示随机选择一部分特征进行递归,适用于数据集较大的时候。max_depth:决策树最大深度,决策树模型先对所有数据集进行切分,再在子数据集上继续循环这个切分过程,max_depth可以理解成用来限制这个循环次数。min_samples_split:子数据集再切分需要的最小样本量,默认是2,如果子数据样本量小于2时,则不再进行下一步切分。如果数据量较小,使用默认值就可,如果数据量较大,为降低计算量,应该把这个值增大,即限制子数据集的切分次数。min_samples_leaf:叶节点(子数据集)最小样本数,如果子数据集中的样本数小于这个值,那么该叶节点和其兄弟节点都会被剪枝(去掉),该值默认为1。min_weight_fraction_leaf:在叶节点处的所有输入样本权重总和的最小加权分数,如果不输入则表示所有的叶节点的权重是一致的。max_features:特征切分时考虑的最大特征数量,默认是对所有特征进行切分,也可以传入int类型的值,表示具体的特征个数;也可以是浮点数,则表示特征个数的百分比;还可以是sqrt,表示总特征数的平方根;也可以是log2,表示总特征数的log个特征。random_state:随机种子的设置,与LR中参数一致。max_leaf_nodes:最大叶节点个数,即数据集切分成子数据集的最大个数。min_impurity_decrease:切分点不纯度最小减少程度,如果某个结点的不纯度减少小于这个值,那么该切分点就会被移除。min_impurity_split:切分点最小不纯度,用来限制数据集的继续切分(决策树的生成),如果某个节点的不纯度(可以理解为分类错误率)小于这个阈值,那么该点的数据将不再进行切分。class_weight:权重设置,主要是用于处理不平衡样本,与LR模型中的参数一致,可以自定义类别权重,也可以直接使用balanced参数值进行不平衡样本处理。presort:是否进行预排序,默认是False,所谓预排序就是提前对特征进行排序,我们知道,决策树分割数据集的依据是,优先按照信息增益/基尼系数大的特征来进行分割的,涉及的大小就需要比较,如果不进行预排序,则会在每次分割的时候需要重新把所有特征进行计算比较一次,如果进行了预排序以后,则每次分割的时候,只需要拿排名靠前的特征就可以了。

对象/属性:

classes_:分类模型的类别,以字典的形式输出

clf.classes_ --------------- array([0, 1, 2])#表示0,1,2类别

feature_importances_:特征重要性,以列表的形式输出每个特征的重要性max_features_:最大特征数n_classes_:类别数,与classes_对应,classes_输出具体的类别n_features_:特征数,当数据量小时,一般max_features和n_features_相等n_outputs_:输出结果数tree_:输出整个决策树,用于生成决策树的可视化

clf.tree_ ---------

方法:

decision_path(X):返回X的决策路径fit(X, y):在数据集(X,y)上使用决策树模型get_params([deep]):获取模型的参数predict(X):预测数据值X的标签predict_log_proba(X):返回每个类别的概率值的对数predict_proba(X):返回每个类别的概率值(有几类就返回几列值)score(X,y):返回给定测试集和对应标签的平均准确率

回归树:

DecisionTreeRegressor(criterion="mse",

splitter="best",

max_depth=None,

min_samples_split=2,

min_samples_leaf=1,

min_weight_fraction_leaf=0.,

max_features=None,

random_state=None,

max_leaf_nodes=None,

min_impurity_decrease=0.,

min_impurity_split=None,

presort=False)

参数含义:

1.criterion:string, optional (default="mse")

它指定了切分质量的评价准则。默认为'mse'(mean squared error)。

2.splitter:string, optional (default="best")

它指定了在每个节点切分的策略。有两种切分策咯:

(1).splitter='best':表示选择最优的切分特征和切分点。

(2).splitter='random':表示随机切分。

3.max_depth:int or None, optional (default=None)

指定树的最大深度。如果为None,则表示树的深度不限,直到

每个叶子都是纯净的,即叶节点中所有样本都属于同一个类别,

或者叶子节点中包含小于min_samples_split个样本。

4.min_samples_split:int, float, optional (default=2)

整数或者浮点数,默认为2。它指定了分裂一个内部节点(非叶子节点)

需要的最小样本数。如果为浮点数(0到1之间),最少样本分割数为ceil(min_samples_split * n_samples)

5.min_samples_leaf:int, float, optional (default=1)

整数或者浮点数,默认为1。它指定了每个叶子节点包含的最少样本数。

如果为浮点数(0到1之间),每个叶子节点包含的最少样本数为ceil(min_samples_leaf * n_samples)

6.min_weight_fraction_leaf:float, optional (default=0.)

它指定了叶子节点中样本的最小权重系数。默认情况下样本有相同的权重。

7.max_feature:int, float, string or None, optional (default=None)

可以是整数,浮点数,字符串或者None。默认为None。

(1).如果是整数,则每次节点分裂只考虑max_feature个特征。

(2).如果是浮点数(0到1之间),则每次分裂节点的时候只考虑int(max_features * n_features)个特征。

(3).如果是字符串'auto',max_features=n_features。

(4).如果是字符串'sqrt',max_features=sqrt(n_features)。

(5).如果是字符串'log2',max_features=log2(n_features)。

(6).如果是None,max_feature=n_feature。

8.random_state:int, RandomState instance or None, optional (default=None)

(1).如果为整数,则它指定了随机数生成器的种子。

(2).如果为RandomState实例,则指定了随机数生成器。

(3).如果为None,则使用默认的随机数生成器。

9.max_leaf_nodes:int or None, optional (default=None)

(1).如果为None,则叶子节点数量不限。

(2).如果不为None,则max_depth被忽略。

10.min_impurity_decrease:float, optional (default=0.)

如果节点的分裂导致不纯度的减少(分裂后样本比分裂前更加纯净)大于或等于min_impurity_decrease,则分裂该节点。

个人理解这个参数应该是针对分类问题时才有意义。这里的不纯度应该是指基尼指数。

回归生成树采用的是平方误差最小化策略。分类生成树采用的是基尼指数最小化策略。

加权不纯度的减少量计算公式为:

min_impurity_decrease=N_t / N * (impurity - N_t_R / N_t * right_impurity

- N_t_L / N_t * left_impurity)

其中N是样本的总数,N_t是当前节点的样本数,N_t_L是分裂后左子节点的样本数,

N_t_R是分裂后右子节点的样本数。impurity指当前节点的基尼指数,right_impurity指

分裂后右子节点的基尼指数。left_impurity指分裂后左子节点的基尼指数。

11.min_impurity_split:float

树生长过程中早停止的阈值。如果当前节点的不纯度高于阈值,节点将分裂,否则它是叶子节点。

这个参数已经被弃用。用min_impurity_decrease代替了min_impurity_split。

12.presort: bool, optional (default=False)

指定是否需要提前排序数据从而加速寻找最优切分的过程。设置为True时,对于大数据集

会减慢总体的训练过程;但是对于一个小数据集或者设定了最大深度的情况下,会加速训练过程。

属性:

1.feature_importances_ : array of shape = [n_features]

特征重要性。该值越高,该特征越重要。

特征的重要性为该特征导致的评价准则的(标准化的)总减少量。它也被称为基尼的重要性

2.max_feature_:int

max_features推断值。

3.n_features_:int

执行fit的时候,特征的数量。

4.n_outputs_ : int

执行fit的时候,输出的数量。

5.tree_ : 底层的Tree对象。

Notes:

控制树大小的参数的默认值(例如``max_depth``,``min_samples_leaf``等)导致完全成长和未剪枝的树,

这些树在某些数据集上可能表现很好。为减少内存消耗,应通过设置这些参数值来控制树的复杂度和大小。

方法:

1.fit(X,y):训练模型。

2.predict(X):预测。

7.参考

- https://baijiahao.baidu.com/s?id=1615832462981347284&wfr=spider&for=pc

- http://www.cnblogs.com/kyrieng/p/8694705.html

- https://www.cnblogs.com/fantasy01/p/4581803.html

- https://blog.csdn.net/lanchunhui/article/details/51140053

- https://www.cnblogs.com/muzixi/p/6566803.html

- https://www.cnblogs.com/qwj-sysu/p/5974421.html

- https://blog.csdn.net/yangjingjing9/article/details/79898157

- https://blog.csdn.net/qq_16000815/article/details/80954039