- sqoop导出orc数据至mysql,将Sqoop导入为OrC文件

终有尽头

IsthereanyoptioninsqooptoimportdatafromRDMSandstoreitasORCfileformatinHDFS?Alternativestried:importedastextformatandusedatemptabletoreadinputastextfileandwritetohdfsasorcinhive解决方案AtleastinSqoop1.4.5t

- sqoop从orc文件到oracle,Sqoop import as OrC file

余革革

问题IsthereanyoptioninsqooptoimportdatafromRDMSandstoreitasORCfileformatinHDFS?Alternativestried:importedastextformatandusedatemptabletoreadinputastextfileandwritetohdfsasorcinhive回答1:AtleastinSqoop1.4.

- Hadoop---(6)Sqoop(数据传输)

Mr Cao

sqoop大数据

6.SqoopSqoop是一个用于hadoop数据和结构化数据之间转换的工具。全称SQL-TO-HADOOP.它可以把hadoop数据,包括hive和hbase存储的数据转化为结构化数据也就是数据库的数据,也可以把关系型数据库数据转化为hadoop数据这些转换操作全是通过Hadoop的MapTask来完成的,并不会涉及到Reduce操作。这是因为我们只是进行数据的拷贝,并不会对数据进行处理或者计算

- Sqoop 支持 ORC 文件格式

吃鱼的羊

sqoop

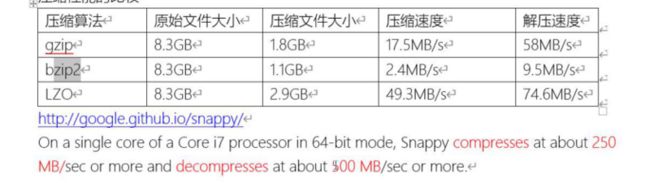

ORC介绍ORC文件格式是Hive0.11.0版本引入的一种文件格式。ORC的引入是为了解决其他Hive文件格式的局限性。使用ORC文件格式提升Hive读取、写入及处理数据的性能。与RCFile对比,ORC文件格式有很多优点:每个Task只输出一个文件,降低NameNode的负载。Hive数据类型支持,包括:datetime、decimal以及复杂数据类型(struct、list、map、unio

- 【漏洞复现】广联达 Linkworks OA ArchiveWebService XML实体注入漏洞

0x0000001

漏洞复现xml网络安全web安全渗透测试网络安全

免责声明:本文旨在提供有关特定漏洞的信息,以帮助用户了解潜在风险。发布此信息旨在促进网络安全意识和技术进步,并非出于恶意。读者应理解,利用本文提到的漏洞或进行相关测试可能违反法律或服务协议。未经授权访问系统、网络或应用程序可能导致法律责任或严重后果。作者对读者基于本文内容的行为不承担责任。读者在使用信息时必须遵守适用法律法规和服务协议,独自承担所有风险和责任。如有侵权,请联系删除。漏洞描述广联达L

- 大数据新视界 -- Hive 事务管理的应用与限制(2 - 16 - 8)

青云交

大数据新视界#Hive之道Hive事务管理应用场景优化策略数据一致性并发处理大数据爱好者们大数据

亲爱的朋友们,热烈欢迎你们来到青云交的博客!能与你们在此邂逅,我满心欢喜,深感无比荣幸。在这个瞬息万变的时代,我们每个人都在苦苦追寻一处能让心灵安然栖息的港湾。而我的博客,正是这样一个温暖美好的所在。在这里,你们不仅能够收获既富有趣味又极为实用的内容知识,还可以毫无拘束地畅所欲言,尽情分享自己独特的见解。我真诚地期待着你们的到来,愿我们能在这片小小的天地里共同成长,共同进步。本博客的精华专栏:大数

- Hive 整合 Spark 全教程 (Hive on Spark)

字节全栈_rJF

hivesparkhadoop

hadoop.proxyuser.luanhao.groups*hadoop.proxyuser.luanhao.groups*2)HDFS配置文件配置hdfs-site.xmldfs.namenode.http-addressBigdata00:9870dfs.namenode.secondary.http-addressBigdata00:9868dfs.replication13)YARN配

- 开发者交流平台项目部署到阿里云服务器教程

独自破碎E

阿里云服务器云计算java后端开发语言

本文使用PuTTY软件在本地Windows系统远程控制Linux服务器;其中,Windows系统为Windows10专业版,Linux系统为CentOS7.664位。1.工具软件的准备maven:https://archive.apache.org/dist/maven/maven-3/3.6.1/binaries/apache-maven-3.6.1-bin.tar.gztomcat:https

- hive表指定分区字段搜索_Hive学习-Hive基本操作(建库、建表、分区表、写数据)...

weixin_39710660

hive表指定分区字段搜索

hive简单认识Hive是建立在HDFS之上的数据仓库,所以Hive的数据全部存储在HDFS上。Hive的数据分为两部分,一部分是存在HDFS上的具体数据,一部分是描述这些具体数据的元数据信息,一般Hive的元数据存在MySQL上。Hive是类SQL语法的数据查询、计算、分析工具,执行引擎默认的是MapReduce,可以设置为Spark、Tez。Hive分内部表和外部表,外部表在建表的同时指定一个

- hive 分区表select全部数据_【Hive教程】(六)HIVE分区表 (静态分区+动态分区)

weixin_39658318

hive分区表select全部数据

分区表分区表在实际企业中用途非常广,首先一个案例体验一下分区表的作用:假设我每天都要往HIVE表中插入一万条数据。经过一年的时间,我里面已经有365万条数据。现在我需要查询某个日期的数据,我select*fromtablenamewheredata=”20180101″,那么hive一般会扫描整个表内容,会消耗很多时间。如果引入partition概念。以日期作为分区字段,相同日期的数据在同一个分区

- 【hadoop学习之路】Hive HQL 语句实现查询

新世纪debug战士

hadoop学习之路hive

目录表数据表1students_data.txt表2course.txt实验步骤结论表数据表1students_data.txt21434,Sara,F,21,20,73,classC41443,Mary,M,19,30,90,classA43333,Dery,F,20,40,85,classB45454,Mary,F,22,10,91,classA14634,Henry,M,18,50,56,c

- 【大数据入门核心技术-Hive】(十一)HiveSQL数据分区

forest_long

大数据技术入门到21天通关大数据hivehadoop数据仓库hdfs

目录一、分区的概念二、创建分区1)静态分区1、单分区测试2、多分区测试2)动态分区3、动态分区和静态分区混合使用三、分区的其它操作1、恢复分区2、归档分区3、交换分区四、分区数据查询1、单分区数据查询2、多分区数据查询方法1:通过union方法2:通过or一、分区的概念数据分区的概念以及存在很久了,通常使用分区来水平分散压力,将数据从物理上移到和使用最频繁的用户更近的地方,以及实现其目的。hive

- 本地Apache Hive的Linux服务器集群复制数据到SQL Server数据库的分步流程

weixin_30777913

数据库数据仓库hivesqlserver

我们已经有安装ApacheHive的Linux服务器集群,它可以连接到一个SQLServerRDS数据库,需要在该Linux服务器上安装配置sqoop,然后将Hive中所有的表数据复制到SQLServerRDS数据库。以下是分步指南,用于在Linux服务器上安装配置Sqoop并将Hive表数据迁移至SQLServerRDS:1.安装Sqoop步骤:下载Sqoop前往ApacheSqoop下载页面,

- 设计转换Apache Hive的HQL语句为Snowflake SQL语句的Python程序方法

weixin_30777913

python数据仓库hivesql

首先,根据以下各类HQL语句的基本实例和官方文档记录的这些命令语句各种参数设置,得到各种HQL语句的完整实例,然后在Snowflake的官方文档找到它们对应的SnowflakeSQL语句,建立起对应的关系表。在这个过程中要注意HQL语句和SnowflakeSQL语句的区别,比如Hive可以给单个用户加权限,但是Snowflake数据仓库是RBAC,也就是基于角色的权限控制,所以HQL语句中给用户加

- windows注册表详解

ywwow

计算机科学与技术windowsmicrosoftsystem磁盘dos网络

偶尔得转点文章。空格键坏了,想用修改键盘映射的方法来代替一下,于是就找到了注册表。然后在不断的搜索中,发现了这篇有点收藏价值的文章,转过来保存下。windows注册表详解http://blog.donews.com/converter/archive/2004/09/16/100404.aspx注册表对有的人还是比较陌生的,因为现在第三方软件太多了,如优化大师、魔法兔子等等,但个人觉得改善系统的第

- Python正则表达式指南

weixin_33755554

python

http://www.cnblogs.com/huxi/archive/2010/07/04/1771073.html1.正则表达式基础1.1.简单介绍正则表达式并不是Python的一部分。正则表达式是用于处理字符串的强大工具,拥有自己独特的语法以及一个独立的处理引擎,效率上可能不如str自带的方法,但功能十分强大。得益于这一点,在提供了正则表达式的语言里,正则表达式的语法都是一样的,区别只在于不

- Ubuntu20.4编译vlc、vlc-qt

小逍遥雪

Ubuntuvlcqt

1.安装Qt软件,文章中安装的Qt版本:5.11.3Qt官方下载链接:Indexof/new_archive/qt2.下载vlc源码,文章中vlc源码版本:vlc-3.0.8因为系统是linxu系统,所以下载时选择:vlc-3.0.8.tar.xzvlc官方源码下载链接:Indexof/vlc/3.下载vlc_qt源码vlc_qt官方源码下载链接:https://vlc-qt.tano.si/

- 【详细讲解】hive优化

songqq27

大数据hive

1、开启本地模式大多数的HadoopJob是需要Hadoop提供的完整的可扩展性来处理大数据集的。不过,有时Hive的输入数据量是非常小的。在这种情况下,为查询触发执行任务消耗的时间可能会比实际job的执行时间要多的多。对于大多数这种情况,Hive可以通过本地模式在单台机器上处理所有的任务。对于小数据集,执行时间可以明显被缩短。用户可以通过设置hive.exec.mode.local.auto的值

- 大数据毕业设计hadoop+spark+hive豆瓣图书数据分析可视化大屏 豆瓣图书爬虫 图书推荐系统

qq_79856539

javawebjava大数据hadoop课程设计

系统总体目标基于Spark的个性化书籍推荐系统是一种基于大数据技术的智能推荐系统,它可以根据用户的历史行为和偏好,为用户提供个性化的书籍推荐。该系统采用Spark技术,可以实现大数据的实时处理,从而提高推荐系统的准确性和可靠性。此外,该系统还可以根据用户的习惯和偏好,提供更加个性化的书籍推荐,从而满足用户的需求。系统的使用者包含普通用户和管理员两类,普通用户是系统的主要服务对象,主流人群是经常查看

- ubuntu22.04 + isaac gym环境配置流程

Yakusha

linuxbashc++

1.CUDA安装1.看系统架构:uname-m2.去官网下载适配你显卡驱动的最新cuda,可以通过nvidia-smi查看https://developer.nvidia.com/cuda-toolkit-archive3.然后执行,全选continue和yessudo./cuda_12.4.1_550.54.15_linux.run在bashrc中添加:exportPATH=/usr/local

- Hive(3):Hive客户端使用

不死鸟.亚历山大.狼崽子

hivehive大数据hadoop

1HiveClient、HiveBeelineClientHive发展至今,总共历经了两代客户端工具。第一代客户端(deprecated不推荐使用):$HIVE_HOME/bin/hive,是一个shellUtil。主要功能:一是可用于以交互或批处理模式运行Hive查询;二是用于Hive相关服务的启动,比如metastore服务。第二代客户端(recommended推荐使用):$HIVE_HOME

- Shell变量获取Hive返回值

for your wish

HiveShell

while循环的使用,if循环的使用,执行hive语句并赋值给shell变量grep过滤无效字符的使用hive.cli.print.header可以控制在cli中是否显示表的列名counts0=`hive-e"sethive.cli.print.header=false;selectcasewhencount(1)>0then1else0endcountfromdwb.mid_organizati

- hive部署

关关呀

hivehadoophdfs

1.在/opt/softwares上传hive的安装包,并解压到/opt/module中2.将apache-hive-3.1.2-bin改名为hive3.修改/etc/profile.d/my_env.sh4.source/etc/profile.d/my_env.sh让它生效5.在lib解决日志jar包冲突

- Hive全面解析精讲

绿萝蔓蔓绕枝生

hive数据库大数据Hive精讲

目录一、Hive概述1、定义2、起源3、Hive的优势和特点4、Hive下载安装二、Hive的命令行模式1、Hive命令行模式2、Beenline命令行模式三、Hive的交互模式1、Hive元数据管理1、Hive交互模式2、Beeline交互模式3、交互模式操作四、Hive数据1、数据库(Database)2、数据表3、Hive数据类型4、Hive数据结构5、HQL五、Hive建表语句1、默认分隔

- GitHub 仓库的 Archived 功能详解:中英双语

阿正的梦工坊

Debugginggithub

GitHub仓库的Archived功能详解一、什么是GitHub仓库的“Archived”功能?在GitHub上,“Archived”是一个专门用于标记仓库状态的功能。当仓库被归档后,它变为只读模式,所有的功能如提交代码、创建issue和pullrequest等将被禁用。被归档的仓库仍然可以被查看、克隆,但无法直接在其基础上进行进一步的开发。二、为什么需要Archived功能?标记停止维护对于项目

- Hive存储系统全面测试报告

蚂蚁质量

软件测试测试用例功能测试

引言在大数据时代,数据存储和处理技术的重要性日益凸显。ApacheHive作为一个基于Hadoop的数据仓库工具,因其能够提供类SQL查询功能(HiveQL)而广受欢迎。Hive的设计初衷是为了简化大数据集的查询和管理,它允许用户通过简单的SQL语句来操作存储在Hadoop分布式文件系统(HDFS)上的大规模数据集。然而,随着数据量的激增和业务需求的多样化,Hive存储系统的功能、性能和安全性面临

- 从建表语句带你学习doris_数据类型

圣·杰克船长

doris数据类型

1、前言概述1.1、doris建表模板CREATE[EXTERNAL]TABLE[IFNOTEXISTS][DATABASE.]table_name(column_definition1[,column_deinition2,......][,index_definition1,[,index_definition2,]])[ENGINE=[olap|mysql|broker|hive]][key

- 搭建Hadoop与Hive环境

达达玲玲

hadoophive大数据

当搭建Hadoop与Hive环境时,以下是每个步骤的详细操作说明:1.安装并配置CentOS7操作系统:-下载CentOS7ISO镜像文件,并通过虚拟机或物理机安装CentOS7操作系统。-在安装过程中,为系统分配必要的网络、用户和权限。2.安装Java开发环境:-下载适合您的系统的JavaJDK版本。-使用命令或GUI工具安装JavaJDK。-配置JAVA_HOME环境变量:-打开终端,输入以下

- hive视图与物化视图使用详解

达达玲玲

hivehadoop数据仓库大数据

Hive视图和物化视图都是在数据仓库中处理数据的概念。下面对Hive视图和物化视图进行详细解释:Hive视图:1.Hive视图是一个逻辑表,它是对基础表的查询结果的引用,被视为一个新表。2.视图可以简化复杂查询,隐藏复杂的逻辑,并将查询重用。3.视图不存储数据,而是在查询时动态地返回结果。4.视图可以基于单个表或多个表创建,也可以对其他视图创建。Hive视图的使用方式:1.创建视图:```sqlC

- spark2如何集成到cdh里

蘑菇丁

经验hadoop大数据+机器学习+oracle

最近做性能测试需要spark2测试下和spark1.6性能有多大差别,官方文档里写着可以集成,但是自己怎么搞都不行,折磨了3天的时间,目前终于把spark2集成到集群里了我安装的是最新版本的下载spark2安装包wgethttp://archive.cloudera.com/beta/spark2/parcels/latest/SPARK2-2.0.0.cloudera.beta2-1.cdh5.

- Maven

Array_06

eclipsejdkmaven

Maven

Maven是基于项目对象模型(POM), 信息来管理项目的构建,报告和文档的软件项目管理工具。

Maven 除了以程序构建能力为特色之外,还提供高级项目管理工具。由于 Maven 的缺省构建规则有较高的可重用性,所以常常用两三行 Maven 构建脚本就可以构建简单的项目。由于 Maven 的面向项目的方法,许多 Apache Jakarta 项目发文时使用 Maven,而且公司

- ibatis的queyrForList和queryForMap区别

bijian1013

javaibatis

一.说明

iBatis的返回值参数类型也有种:resultMap与resultClass,这两种类型的选择可以用两句话说明之:

1.当结果集列名和类的属性名完全相对应的时候,则可直接用resultClass直接指定查询结果类

- LeetCode[位运算] - #191 计算汉明权重

Cwind

java位运算LeetCodeAlgorithm题解

原题链接:#191 Number of 1 Bits

要求:

写一个函数,以一个无符号整数为参数,返回其汉明权重。例如,‘11’的二进制表示为'00000000000000000000000000001011', 故函数应当返回3。

汉明权重:指一个字符串中非零字符的个数;对于二进制串,即其中‘1’的个数。

难度:简单

分析:

将十进制参数转换为二进制,然后计算其中1的个数即可。

“

- 浅谈java类与对象

15700786134

java

java是一门面向对象的编程语言,类与对象是其最基本的概念。所谓对象,就是一个个具体的物体,一个人,一台电脑,都是对象。而类,就是对象的一种抽象,是多个对象具有的共性的一种集合,其中包含了属性与方法,就是属于该类的对象所具有的共性。当一个类创建了对象,这个对象就拥有了该类全部的属性,方法。相比于结构化的编程思路,面向对象更适用于人的思维

- linux下双网卡同一个IP

被触发

linux

转自:

http://q2482696735.blog.163.com/blog/static/250606077201569029441/

由于需要一台机器有两个网卡,开始时设置在同一个网段的IP,发现数据总是从一个网卡发出,而另一个网卡上没有数据流动。网上找了下,发现相同的问题不少:

一、

关于双网卡设置同一网段IP然后连接交换机的时候出现的奇怪现象。当时没有怎么思考、以为是生成树

- 安卓按主页键隐藏程序之后无法再次打开

肆无忌惮_

安卓

遇到一个奇怪的问题,当SplashActivity跳转到MainActivity之后,按主页键,再去打开程序,程序没法再打开(闪一下),结束任务再开也是这样,只能卸载了再重装。而且每次在Log里都打印了这句话"进入主程序"。后来发现是必须跳转之后再finish掉SplashActivity

本来代码:

// 销毁这个Activity

fin

- 通过cookie保存并读取用户登录信息实例

知了ing

JavaScripthtml

通过cookie的getCookies()方法可获取所有cookie对象的集合;通过getName()方法可以获取指定的名称的cookie;通过getValue()方法获取到cookie对象的值。另外,将一个cookie对象发送到客户端,使用response对象的addCookie()方法。

下面通过cookie保存并读取用户登录信息的例子加深一下理解。

(1)创建index.jsp文件。在改

- JAVA 对象池

矮蛋蛋

javaObjectPool

原文地址:

http://www.blogjava.net/baoyaer/articles/218460.html

Jakarta对象池

☆为什么使用对象池

恰当地使用对象池化技术,可以有效地减少对象生成和初始化时的消耗,提高系统的运行效率。Jakarta Commons Pool组件提供了一整套用于实现对象池化

- ArrayList根据条件+for循环批量删除的方法

alleni123

java

场景如下:

ArrayList<Obj> list

Obj-> createTime, sid.

现在要根据obj的createTime来进行定期清理。(释放内存)

-------------------------

首先想到的方法就是

for(Obj o:list){

if(o.createTime-currentT>xxx){

- 阿里巴巴“耕地宝”大战各种宝

百合不是茶

平台战略

“耕地保”平台是阿里巴巴和安徽农民共同推出的一个 “首个互联网定制私人农场”,“耕地宝”由阿里巴巴投入一亿 ,主要是用来进行农业方面,将农民手中的散地集中起来 不仅加大农民集体在土地上面的话语权,还增加了土地的流通与 利用率,提高了土地的产量,有利于大规模的产业化的高科技农业的 发展,阿里在农业上的探索将会引起新一轮的产业调整,但是集体化之后农民的个体的话语权 将更少,国家应出台相应的法律法规保护

- Spring注入有继承关系的类(1)

bijian1013

javaspring

一个类一个类的注入

1.AClass类

package com.bijian.spring.test2;

public class AClass {

String a;

String b;

public String getA() {

return a;

}

public void setA(Strin

- 30岁转型期你能否成为成功人士

bijian1013

成功

很多人由于年轻时走了弯路,到了30岁一事无成,这样的例子大有人在。但同样也有一些人,整个职业生涯都发展得很优秀,到了30岁已经成为职场的精英阶层。由于做猎头的原因,我们接触很多30岁左右的经理人,发现他们在职业发展道路上往往有很多致命的问题。在30岁之前,他们的职业生涯表现很优秀,但从30岁到40岁这一段,很多人

- [Velocity三]基于Servlet+Velocity的web应用

bit1129

velocity

什么是VelocityViewServlet

使用org.apache.velocity.tools.view.VelocityViewServlet可以将Velocity集成到基于Servlet的web应用中,以Servlet+Velocity的方式实现web应用

Servlet + Velocity的一般步骤

1.自定义Servlet,实现VelocityViewServl

- 【Kafka十二】关于Kafka是一个Commit Log Service

bit1129

service

Kafka is a distributed, partitioned, replicated commit log service.这里的commit log如何理解?

A message is considered "committed" when all in sync replicas for that partition have applied i

- NGINX + LUA实现复杂的控制

ronin47

lua nginx 控制

安装lua_nginx_module 模块

lua_nginx_module 可以一步步的安装,也可以直接用淘宝的OpenResty

Centos和debian的安装就简单了。。

这里说下freebsd的安装:

fetch http://www.lua.org/ftp/lua-5.1.4.tar.gz

tar zxvf lua-5.1.4.tar.gz

cd lua-5.1.4

ma

- java-14.输入一个已经按升序排序过的数组和一个数字, 在数组中查找两个数,使得它们的和正好是输入的那个数字

bylijinnan

java

public class TwoElementEqualSum {

/**

* 第 14 题:

题目:输入一个已经按升序排序过的数组和一个数字,

在数组中查找两个数,使得它们的和正好是输入的那个数字。

要求时间复杂度是 O(n) 。如果有多对数字的和等于输入的数字,输出任意一对即可。

例如输入数组 1 、 2 、 4 、 7 、 11 、 15 和数字 15 。由于

- Netty源码学习-HttpChunkAggregator-HttpRequestEncoder-HttpResponseDecoder

bylijinnan

javanetty

今天看Netty如何实现一个Http Server

org.jboss.netty.example.http.file.HttpStaticFileServerPipelineFactory:

pipeline.addLast("decoder", new HttpRequestDecoder());

pipeline.addLast(&quo

- java敏感词过虑-基于多叉树原理

cngolon

违禁词过虑替换违禁词敏感词过虑多叉树

基于多叉树的敏感词、关键词过滤的工具包,用于java中的敏感词过滤

1、工具包自带敏感词词库,第一次调用时读入词库,故第一次调用时间可能较长,在类加载后普通pc机上html过滤5000字在80毫秒左右,纯文本35毫秒左右。

2、如需自定义词库,将jar包考入WEB-INF工程的lib目录,在WEB-INF/classes目录下建一个

utf-8的words.dict文本文件,

- 多线程知识

cuishikuan

多线程

T1,T2,T3三个线程工作顺序,按照T1,T2,T3依次进行

public class T1 implements Runnable{

@Override

- spring整合activemq

dalan_123

java spring jms

整合spring和activemq需要搞清楚如下的东东1、ConnectionFactory分: a、spring管理连接到activemq服务器的管理ConnectionFactory也即是所谓产生到jms服务器的链接 b、真正产生到JMS服务器链接的ConnectionFactory还得

- MySQL时间字段究竟使用INT还是DateTime?

dcj3sjt126com

mysql

环境:Windows XPPHP Version 5.2.9MySQL Server 5.1

第一步、创建一个表date_test(非定长、int时间)

CREATE TABLE `test`.`date_test` (`id` INT NOT NULL AUTO_INCREMENT ,`start_time` INT NOT NULL ,`some_content`

- Parcel: unable to marshal value

dcj3sjt126com

marshal

在两个activity直接传递List<xxInfo>时,出现Parcel: unable to marshal value异常。 在MainActivity页面(MainActivity页面向NextActivity页面传递一个List<xxInfo>): Intent intent = new Intent(this, Next

- linux进程的查看上(ps)

eksliang

linux pslinux ps -llinux ps aux

ps:将某个时间点的进程运行情况选取下来

转载请出自出处:http://eksliang.iteye.com/admin/blogs/2119469

http://eksliang.iteye.com

ps 这个命令的man page 不是很好查阅,因为很多不同的Unix都使用这儿ps来查阅进程的状态,为了要符合不同版本的需求,所以这个

- 为什么第三方应用能早于System的app启动

gqdy365

System

Android应用的启动顺序网上有一大堆资料可以查阅了,这里就不细述了,这里不阐述ROM启动还有bootloader,软件启动的大致流程应该是启动kernel -> 运行servicemanager 把一些native的服务用命令启动起来(包括wifi, power, rild, surfaceflinger, mediaserver等等)-> 启动Dalivk中的第一个进程Zygot

- App Framework发送JSONP请求(3)

hw1287789687

jsonp跨域请求发送jsonpajax请求越狱请求

App Framework 中如何发送JSONP请求呢?

使用jsonp,详情请参考:http://json-p.org/

如何发送Ajax请求呢?

(1)登录

/***

* 会员登录

* @param username

* @param password

*/

var user_login=function(username,password){

// aler

- 发福利,整理了一份关于“资源汇总”的汇总

justjavac

资源

觉得有用的话,可以去github关注:https://github.com/justjavac/awesome-awesomeness-zh_CN 通用

free-programming-books-zh_CN 免费的计算机编程类中文书籍

精彩博客集合 hacke2/hacke2.github.io#2

ResumeSample 程序员简历

- 用 Java 技术创建 RESTful Web 服务

macroli

java编程WebREST

转载:http://www.ibm.com/developerworks/cn/web/wa-jaxrs/

JAX-RS (JSR-311) 【 Java API for RESTful Web Services 】是一种 Java™ API,可使 Java Restful 服务的开发变得迅速而轻松。这个 API 提供了一种基于注释的模型来描述分布式资源。注释被用来提供资源的位

- CentOS6.5-x86_64位下oracle11g的安装详细步骤及注意事项

超声波

oraclelinux

前言:

这两天项目要上线了,由我负责往服务器部署整个项目,因此首先要往服务器安装oracle,服务器本身是CentOS6.5的64位系统,安装的数据库版本是11g,在整个的安装过程中碰到很多的坑,不过最后还是通过各种途径解决并成功装上了。转别写篇博客来记录完整的安装过程以及在整个过程中的注意事项。希望对以后那些刚刚接触的菜鸟们能起到一定的帮助作用。

安装过程中可能遇到的问题(注

- HttpClient 4.3 设置keeplive 和 timeout 的方法

supben

httpclient

ConnectionKeepAliveStrategy kaStrategy = new DefaultConnectionKeepAliveStrategy() {

@Override

public long getKeepAliveDuration(HttpResponse response, HttpContext context) {

long keepAlive

- Spring 4.2新特性-@Import注解的升级

wiselyman

spring 4

3.1 @Import

@Import注解在4.2之前只支持导入配置类

在4.2,@Import注解支持导入普通的java类,并将其声明成一个bean

3.2 示例

演示java类

package com.wisely.spring4_2.imp;

public class DemoService {

public void doSomethin