机器学习-数据预处理

机器学习-数据预处理

1.概述

1.1数据挖掘的五大流程

- 获取数据

- 数据预处理:从数据中检测,纠正或删除损坏,不准确或不适用于模型的记录的过程 可能面对的问题有:数据类型不同,比如有的是文字,有的是数字,有的含时间序列,有的连续,有的间断。也可能,数据的质量不行,有噪声,有异常,有缺失,数据出错,量纲不一,有重复,数据是偏态,数据量太大或太小

数据预处理的目的:让数据适应模型,匹配模型的需求 - 特征工程 特征工程是将原始数据转换为更能代表预测模型的潜在问题的特征的过程,可以通过挑选最相关的特征,提取特征以及创造特征来实现。其中创造特征又经常以降维算法的方式实现。可能面对的问题有:特征之间有相关性,特征和标签无关,特征太多或太小,或者干脆就无法表现出应有的数据现象或无法展示数据的真实面貌

特征工程的目的:1) 降低计算成本,2) 提升模型上限 - 建模,测试模型并预测出结果

- 上线,验证模型效果

1.2 sklearn中的数据预处理和特征工程

sklearn中包含众多数据预处理和特征工程相关的模块

- 模块preprocessing:几乎包含数据预处理的所有内容模块

- Impute:填补缺失值专用模块

- featureselection:包含特征选择的各种方法的实践

- 模块decomposition:包含降维算法

2 数据预处理 Preprocessing & Impute

2.1 数据无量纲化

在机器学习算法实践中,我们往往有着将不同规格的数据转换到同一规格,或不同分布的数据转换到某个特定分布的需求,这种需求统称为将数据“无量纲化”。

譬如梯度和矩阵为核心的算法中,譬如逻辑回归,支持向量机,神经网络,无量纲化可以加快求解速度;而在距离类模型,譬如K近邻,K-Means聚类中,无量纲化可以帮我们提升模型精度,避免某一个取值范围特别大的特征对距离计算造成影响。(一个特例是决策树和树的集成算法们,对决策树我们不需要无量纲化,决策树可以把任意数据都处理得很好。)

数据的无量纲化可以是线性的,也可以是非线性的。线性的无量纲化包括中心化(Zero-centered或者Mean-subtraction)处理和缩放处理(Scale)。中心化的本质是让所有记录减去一个固定值,即让数据样本数据平移到某个位置。缩放的本质是通过除以一个固定值,将数据固定在某个范围之中,取对数也算是一种缩放处理。

- preprocessing.MinMaxScaler

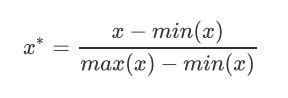

当数据(x)按照最小值中心化后,再按极差(最大值 - 最小值)缩放,数据移动了最小值个单位,并且会被收敛到[0,1]之间,而这个过程,就叫做数据归一化(Normalization,又称Min-Max Scaling)。

注意,Normalization是归一化,不是正则化,真正的正则化regularization,不是数据预处理的一种手段。归一化之后的数据服从正态分布,公式如下:

在sklearn当中,我们使用preprocessing.MinMaxScaler来实现这个功能。MinMaxScaler有一个重要参数,feature_range,控制我们希望把数据压缩到的范围,默认是[0,1],也可以自己设置。

代码实现:

# _*_ coding:utf-8 _*_

# 开发团队:皮卡丘

# 开发人员:********

# 开发时间:2021/2/4 23:46

# 文件名称:1归一化.py

# 开发工具:PyCharm

from sklearn.preprocessing import MinMaxScaler

import pandas as pd

data=[[-1,2],[-0.5,6],[0,10],[1,18]]

frame=pd.DataFrame(data)

print(frame)

#实现归一化

scaler=MinMaxScaler()#实例化

scaler=scaler.fit(data)#fit 在这里本质是生成min(x)和max(x)

result=scaler.transform(data)#通过接口导出结果

print(result)

#第二种一步出结果

result1=scaler.fit_transform(data)

print(result1)

#把归一化的数据逆转为原始数据

data=scaler.inverse_transform(result1)

print(data)

#数据归一化到指定范围[5,10]

scaler=MinMaxScaler(feature_range=[5,10])#实例化

scaler=scaler.fit(data)#fit 在这里本质是生成min(x)和max(x)

result=scaler.transform(data)#通过接口导出结果

print(result)BONUS:使用numpy实现归一化

import numpy as np

X=np.array([[-1,2],[-0.5,6],[0,10],[1,18]])

#归一化

X_nor=(X-X.min(axis=0))/(X.max(axis=0)-X.min(axis=0))

print(X_nor)

#逆转归一化

X_returned=X_nor*(X.max(axis=0)-X.min(axis=0))+X.min(axis=0)

print(X_returned)

- preprocessing.StandardScaler

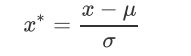

当数据(x)按均值(μ)中心化后,再按标准差(σ)缩放,数据就会服从为均值为0,方差为1的正态分布(即标准正态分布),而这个过程,就叫做数据标准化(Standardization,又称Z-score normalization),公式如下:

代码实现:

from sklearn.preprocessing import StandardScaler

import pandas as pd

data=[[-1,2],[-0.5,6],[0,10],[1,18]]

frame=pd.DataFrame(data)

print(frame)

#实现标准化

scaler=StandardScaler()#实例化

scaler.fit(data)#生成均值和方差

print(scaler.mean_)#查看每列均值的属性mean

print(scaler.var_)#查看每列方差属性var_

X_std=scaler.transform(data)#通过接口导出结果

print(X_std)

#查看标准化数据是否为均值为0,方差为1

print(X_std.mean())#均值为0.0

print(X_std.std())#方差为1

#方法二一度达成结果

print(scaler.fit_transform(data))

#标准化后的矩阵逆转为原始数据

data=scaler.inverse_transform(X_std)

print(data)对于StandardScaler和MinMaxScaler来说,空值NaN会被当做是缺失值,在fit的时候忽略,在transform的时候保持缺失NaN的状态显示。并且,尽管去量纲化过程不是具体的算法,但在fit接口中,依然只允许导入至少二维数组,一维数组导入会报错。通常来说,我们输入的X会是我们的特征矩阵,现实案例中特征矩阵不太可能是一维所以不会存在这个问题。

- StandardScaler和MinMaxScaler选择

大多数机器学习算法中,会选择StandardScaler来进行特征缩放,因为MinMaxScaler对异常值非常敏感。在PCA,聚类,逻辑回归,支持向量机,神经网络这些算法中,StandardScaler往往是最好的选择

MinMaxScaler在不涉及距离度量、梯度、协方差计算以及数据需要被压缩到特定区间时使用广泛,比如数字图像处理中量化像素强度时,都会使用MinMaxScaler将数据压缩于[0,1]区间之中

2.2 缺失值

机器学习和数据挖掘中所使用的数据,永远不可能是完美的。很多特征,对于分析和建模来说意义非凡,但对于实际收集数据的人却不是如此,因此数据挖掘之中,常常会有重要的字段缺失值很多,但又不能舍弃字段的情况。因此,数据预处理中非常重要的一项就是处理缺失值。

- impute.SimpleImputer

class sklearn.impute.SimpleImputer (missing_values=nan, strategy=’mean’, fill_value=None, verbose=0,copy=True)

| 参数 | 含义&输入 |

| missing_values | 告诉SimpleImputer,数据中的缺失值长什么样,默认空值np.nan |

| strategy | 我们填补缺失值的策略,默认均值。 输入“mean”使用均值填补(仅对数值型特征可用) 输入“median"用中值填补(仅对数值型特征可用) 输入"most_frequent”用众数填补(对数值型和字符型特征都可用) 输入“constant"表示请参考参数“fill_value"中的值(对数值型和字符型特征都可用) |

| fill_value | 随机森林分类 |

| copy | 默认为True,将创建特征矩阵的副本,反之则会将缺失值填补到原本的特征矩阵中去。 |

案例数据地址 提取码:2021 ,利用泰坦尼克号的信息预测乘客能否存活。代码实现:

import pandas as pd

from sklearn.impute import SimpleImputer

data=pd.read_csv('datasets/Narrativedata.csv',index_col=0)#数据已有索引,所有加上index_col=0

print(data.head())#查看数据前5行信息

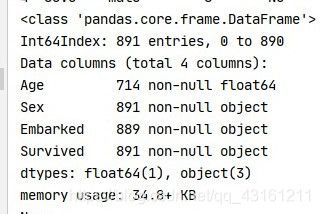

print(data.info())可以看见Age和Embarked两列有缺失值,并且Age这一列缺失值比较严重,接着对缺失值进行处理:

#填补年龄

Age=data.loc[:,"Age"].values.reshape(-1,1)

imp_mean=SimpleImputer()#实例化默认均值填补

imp_median=SimpleImputer(strategy="median")#中位数填补

imp_0=SimpleImputer(strategy="constant",fill_value=0)#用0填补

imp_mean=imp_mean.fit_transform(Age)#一步完成调取结果

imp_median=imp_median.fit_transform(Age)

imp_0=imp_0.fit_transform(Age)

#打印查看用不同值填充前20行的效果

print(imp_mean[:20])

print(imp_median[:20])

print(imp_0[:20])再来处理舱门Embarked的缺失值:

#使用众数填补Embarked

Embarked=data.loc[:,"Embarked"].values.reshape(-1,1)#铁子矩阵必须二维,二维,二维

imp_mode=SimpleImputer(strategy="most_frequent")

data.loc[:,"Embarked"]=imp_mode.fit_transform(Embarked)

print(data[:20])

print(data.info())缺失值处理end...................

Bonus:用Pandas和Numpy进行其实更加简单哈哈,下面上代码:

import pandas as pd

data=pd.read_csv("datasets/Narrativedata.csv",index_col=0)

print(data.info())

data.loc[:,"Age"]=data.loc[:,"Age"].fillna(data.loc[:,"Age"].median())#Age添加中位数

data.dropna(axis=0,inplace=True)#删除有缺失值的哪一行(axis=0),列(axis=1),inplace=True在原数据进行修改,False生成复制对象,不修改原数据

print(data.info())年龄Age列添加了中位数,然后对于舱门Embarked处理,哪行有缺失值就删除所在行。

2.3 处理分类型特征:编码与哑变量

再ML中,大多数算法,譬如逻辑回归,SVM,K近邻都只能处理数值型数据,不能处理文字,在sklearn中,除了专用来处理文字的算法,其他算法在fit的时候全部要求输入数组或矩阵,并且是数字。但现实中,许多标签和特征在数据收集完毕的时候,都不是数字来表现的。比如学历:大学,高中,小学,付费方式:花呗,现金,微信等等。这种情况下为了让数据适应算法和库,必须给数据进行编码,简单的说就是把文字型数据转换为数值型数据。

- preprocessing.LabelEncoder:标签专用,将分类转换为分类数值

############转换成数值型数据----标签分类专用

from sklearn.preprocessing import LabelEncoder

data=pd.read_csv('datasets/Narrativedata.csv',index_col=0)#数据已有索引,所有加上index_col=0

data.iloc[:,-1]=LabelEncoder().fit_transform(data.iloc[:,-1])

print(data.head())#Survived里面的['No' 'Unknown' 'Yes']-->[,0,1,2]- preprocessing.OrdinalEncoder:特征专用,能够将分类特征转换为分类数值

#######################转换成数值型数据----特征专用

from sklearn.preprocessing import OrdinalEncoder

data_=data.copy()#上面操作的数据

print(data_.head())

print(OrdinalEncoder().fit(data_.iloc[:,1:-1]).categories_)#第二列Sex,最后一列Embarked特征处理

#查看特征的类别 [array(['female', 'male'], dtype=object), array(['C', 'Q', 'S'], dtype=object)]

data_.iloc[:,1:-1]=OrdinalEncoder().fit_transform(data_.iloc[:,1:-1])

print(data_.head())

- preprocessing.OneHotEncoder:独热编码,创建哑变量

刚刚已经把分类变量Sex和Embarked都转换为数字对应的类别了。但把用[0,1,2]代表舱门,这种转换是正确的吗?

1) 舱门(S,Q, C)三种取值,S,Q,C相互独立,彼此之间安全没有联系。这是名义变量。

2)学历 (小学,初中,高中)三种取值不是完全独立的,我们知道学历上高中>初中>小学,学历有高低,但是又不能说小学+某个取值=初中。这是有序变量。

3)体重(>45kg,>90kg,>135kg)这三个取值是有关系的,我们可以知道135kg-90kg=45kg,他们之间可以相互转换。这是有距变量。

在对这些特征进行编码的时候,三种分类数据会被我们转换为[0 1 2],这三个数字在算法看来,且连续可以计算的。也就是说舱门,学历这样的分类特征会被误会成体重这样的分类特征,但这其实会忽略自带的数学性质,给算法传达不准确的信息,影响建模。对于名义变量,我们只有使用哑变量的方式来处理,才能够尽量向算法传达最准确的信息。

代码实现:

####################名义变量 独热编码,创建哑变量

from sklearn.preprocessing import OneHotEncoder

X=data.iloc[:,1:-1]#Sex性别列,舱门Embarked列

result=OneHotEncoder(categories='auto').fit_transform(X).toarray()

print(result)

#[[0. 1. 0. 0. 1.]

[1. 0. 1. 0. 0.]

[1. 0. 0. 0. 1.]

...

[1. 0. 0. 0. 1.]

[0. 1. 1. 0. 0.]

[0. 1. 0. 1. 0.]]

...

#查看哑变量列特征标题

print(enc.get_feature_names())#['x0_female' 'x0_male' 'x1_C' 'x1_Q' 'x1_S']

#查看哑变量形状

print(result.shape)#(891, 5)

#哑变量加入数据表

newdata=pd.concat([data,pd.DataFrame(result)],axis=1)#concat将两个表左右相连,axis=0表示垂直相连

print(newdata.head())

#删除多出的名义变量

newdata.drop(["Sex","Embarked"],axis=1,inplace=True)

#给哑变量添加列特征标题

newdata.columns=["Age","Survived","Female","Male","Embarked_C","Embarked_Q","Embarked_S"]

print(newdata.head())到这的话数据已经处理的够好了,已经可以拿去训练了。但有时候会有一些特殊需求,比如下面,,,,,,,,,,,

2.4 处理连续型特征:二值化与分段

- sklearn.preprocessing.Binarizer

根据阈值将数据二值化(将特征值设置为0或1),用于处理连续型变量。大于阈值的值映射为1,而小于或等于阈值的值映射为0。默认阈值为0时,特征中所有的正值都映射到1。二值化是对文本计数数据的常见操作,分析人员可以决定仅考虑某种现象的存在与否。它还可以用作考虑布尔随机变量的估计器的预处理步骤(例如,使用贝叶斯设置中的伯努利分布建模)。代码实现:

#####################处理连续型特征---二值化##################

from sklearn.preprocessing import Binarizer

data_2=data.copy()

X=data_2.iloc[:,0].values.reshape(-1,1)#类为特征专用,必须使用二维数组

transformer=Binarizer(threshold=30).fit_transform(X)#30为界限

print(transformer)#Age就变成0 or 1了

print('+++++++++++++++++++++++++')

- preprocessing.KBinsDiscretizer

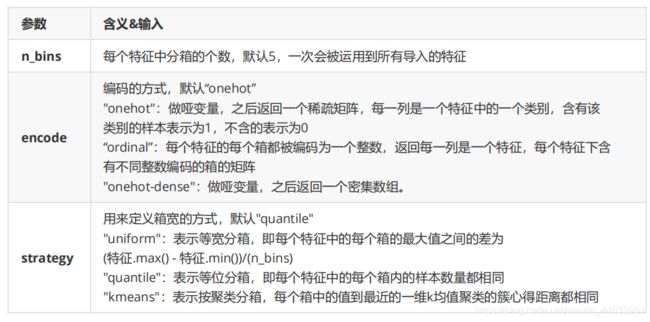

这是将连续型变量划分为分类变量的类,能够将连续型变量排序后按顺序分箱后编码。总共包含三个重要参数:

from sklearn.preprocessing import KBinsDiscretizer

data=pd.read_csv('datasets/Narrativedata.csv',index_col=0)#数据已有索引,所有加上index_col=0

X=data.iloc[:,0].values.reshape(-1,1)

est=KBinsDiscretizer(n_bins=3,encode='ordinal',strategy='uniform')#分3箱,编码方式有序,策略.

transformer=est.fit_transform(X)[:20]

print(transformer)

#查看转换后分的箱,变成一列中的三箱

set(est.fit_transform(X).ravel())#{0,1,2}

#创建哑变量

est=KBinsDiscretizer(n_bins=3,encode='onehot',strategy='uniform')

print(est.fit_transform(X).toarray())

#然后处理方式就和前面的哑变量处理一模一样了..........

原版视频请参看 【技术干货】菜菜的机器学习sklearn【全85集】Python进阶,个人为学习过后的分享者。