PyTorch损失函数 torch.nn.CrossEntropyLoss()

-

交叉熵损失函数,主要是用来判定实际的输出与期望的输出的接近程度。

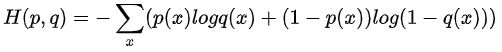

一般的交叉熵损失函数的公式为: -

PyTorch中的torch.nn.CrossEntropyLoss()计算时,主要分为三个步骤:

1> 对预测变量按行进行softmax操作

2> 对上述结果进行log(相当于数学里的ln)

3> 对上述结果进行NLLLoss -

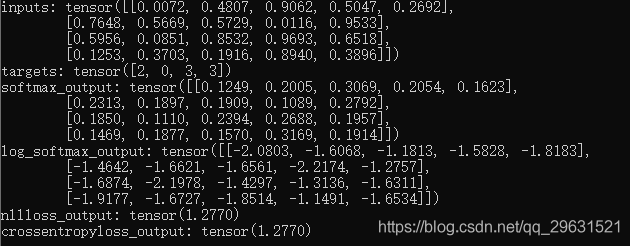

验证代码

import torch

import torch.nn as nn

import numpy as np

inputs = torch.rand(4, 5)

targets = torch.LongTensor(4).random_(5)

print("inputs:", inputs)

print("targets:", targets)

softmax_func=nn.Softmax(dim=1) # 按行进行softmax

softmax_output = softmax_func(inputs)

print("softmax_output:", softmax_output)

log_softmax_output = torch.log(softmax_output)

print("log_softmax_output:", log_softmax_output)

nllloss_func=nn.NLLLoss() # NLLLoss就是将log_softmax_output的结果与对应label的那个值拿出来,去掉负号,再取均值。

nlloss_output=nllloss_func(log_softmax_output, targets)

print("nllloss_output:", nlloss_output) # (1.1813 + 1.4642 + 1.3136 + 1.1491)/ 4 = 1.27705

crossentropyloss=nn.CrossEntropyLoss()

crossentropyloss_output=crossentropyloss(inputs, targets)

print('crossentropyloss_output:',crossentropyloss_output)