Locust + python + influxdb + grafana 展示性能压测QPS图表

需求

在使用locust压测的时候,如果使用web则可以查看到QPS压测过程的曲线图。而如果使用no web模式启动,则只有一些打印的日志可以查看。

那么能否将no web模式启动的locust执行过程日志转化为曲线图表呢?

如果需要将日志转化为曲线图表,那么则以下步骤:

1、将locust执行任务日志序列化,方便程序读取

2、需要定时刷新获取执行日志文件,将日志信息写入数据库

3、读取数据库数据,将其进行图表化呈现。

并且还要求这个日志采集处理要足够轻量级、资源消耗小,只有在执行locust的时候才启动即可。所以,我也放弃了filebeat + logstash + Elasticsearch 或者 kafka 、redis等大型采集日志的方案。

自己定制化写一个即可。

将locust执行任务日志序列化

方式一,直接在locust源码中挂上钩子,将日志格式化写入文件

对于locust执行任务的日志序列化我尝试过直接在locust源码中挂上钩子,然后将日志进行格式化之后,再写入一个文件中。

功能上是可以实现的,但是压测性能上就会大打折扣,由于locust在压测过程需要对每个压测请求都进行格式化以及写入文件,这样就很影响压测机的并发效率。

所以这种方式已经被我抛弃。

有兴趣可以参考:Matplotlib可视化查看Locust测试结果(一)

方式二,过滤locust使用no web模式下打印出来的日志

在经过多测压测测试之后,我决定直接使用locust执行过程打印的日志来生成图表。

1、首先将locust执行过程的日志写入文件中

2、通过读取执行文件的日志信息,再将其转化存储到influxdb数据库

3、最后根据influxdb数据库的数据,展示图表

在这个过程,对于locust自身的压测过程,我并没有嵌入代码去影响执行效率。而是将locust执行过程自动打印出来的信息进行二次处理而已。

这样做的好处就是不会对locust压测造成较大的性能损耗,因为大概是5秒打印一次执行日志,相信这个损耗是比较低的了。

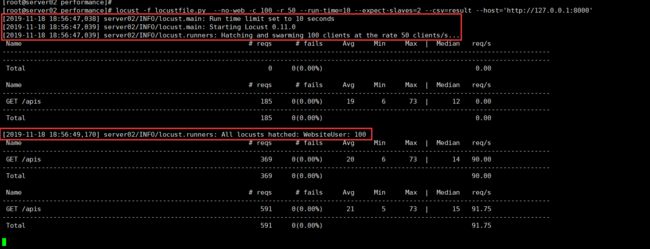

原生的locust执行日志:

可以从图中看到,在执行locust脚本使用no web模式的时候,执行的日志默认是INFO级别的,一般我们都是这样去使用。

此时,INFO的日志信息和locust压测执行结果混合在一起打印,这就让人很不开心了。所以必须将其分开。

首先确定我只需要的信息,如下:

如果压测的接口有多个,那么就会有对应的多条信息。示例如下:

Name # reqs # fails Avg Min Max | Median req/s

--------------------------------------------------------------------------------------------------------------------------------------------

GET /apis1 988 0(0.00%) 20 5 73 | 16 97.12

--------------------------------------------------------------------------------------------------------------------------------------------

GET /apis2 988 0(0.00%) 20 5 73 | 16 97.12

--------------------------------------------------------------------------------------------------------------------------------------------

Total 988 0(0.00%) 97.12

确定好了需要的数据日志信息之后,下面第一步就是可以将INFO信息和执行结果信息拆分写入不同的日志文件中。

拆分日志中的INFO信息与执行结果信息

--logfile=locust.log --loglevel=INFO将INFO信息写到locust.log日志中1>run.log 2>&1将压测执行的结果信息写到run.log日志中

命令执行如下:

locust -f locustfile.py --no-web -c 100 -r 50 --run-time=30 --expect-slaves=2 --csv=result --host='http://127.0.0.1:8000' --logfile=locust.log --loglevel=INFO 1>run.log 2>&1

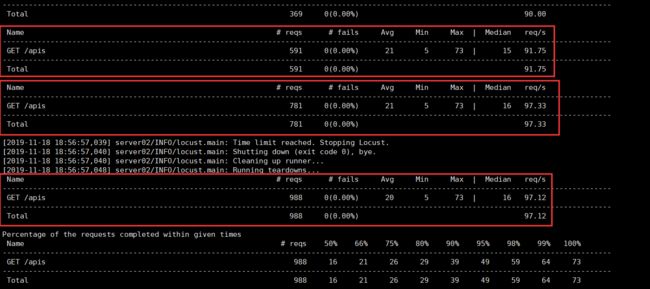

查看执行INFO信息日志locust.log如下:

可以看到INFO信息和locust执行的压测结果已经分开日志文件存储好了。那么下面就需要想办法将执行压测结果的数据进行序列化读取,存储到influxdb中。

使用python实时读取run.log日志信息

在这里可以写一个简单的功能,如下:

- 在开启执行locust脚本的同时,也启动这个python脚本或者一直长时间执行。

- 在python脚本执行的过程期间,需要执行两个动作即可:读取日志信息,然后写入influxdb

下面直接将实现好的python代码show出来,如下:

import subprocess

import re

import os

def main():

# 实时读取日志信息

shell = 'tail -F run.log'

p = subprocess.Popen(shell, shell=True, stdout=subprocess.PIPE, stderr=subprocess.STDOUT)

for line in iter(p.stdout.readline, b''):

line = line.rstrip().decode('utf8')

# print(line)

# 正则匹配获取所有的需要参数

res = re.match(

r'^\s+(?PGET|POST)\s+(?P[\/\w\?\=\&]+)\s+(?P\d+)\s+(?P[\d\(\.\)\%]+)\s+(?P\d+)\s+(?P\d+)\s+(?P\d+)\s+(\|)\s+(?P\d+)\s+(?P[\w\.]+)$',

line)

if res:

print("method: %s, api: %s, reqs: %s, fails: %s, Avg: %s, Min: %s, Max: %s, Median: %s, QPS: %s " % (

res.group('method'), res.group('api'), res.group('reqs'), res.group('fails').split('(')[0], res.group('Avg'),

res.group('Min'), res.group('Max'), res.group('Median'), res.group('QPS')

))

# 设置需要写入influxdb的参数

method = res.group('method')

api = res.group('api')

reqs = res.group('reqs')

fails = res.group('fails').split('(')[0]

avg = res.group('Avg')

min = res.group('Min')

max = res.group('Max')

median = res.group('Median')

qps = res.group('QPS')

# 往influxdb写入数据

# 创建数据库 curl -i -XPOST http://localhost:8086/query --data-urlencode "q=CREATE DATABASE testdb"

# 插入数据

# 表名 索引 tag 字段 fields

# curl -i -XPOST 'http://localhost:8086/write?db=testdb' --data-binary 'locust,method=GET,api=/apis reqs=2099,fails=10,avg=20,min=5,max=83,median=16,qps=95.10'

database = 'testdb'

table_name = 'locust'

insert_data = "curl -i -XPOST 'http://localhost:8086/write?db=%s' --data-binary '%s,method=%s,api=%s reqs=%s,fails=%s,avg=%s,min=%s,max=%s,median=%s,qps=%s'" % (database,table_name,method,api,reqs,fails,avg,min,max,median,qps)

os.system(insert_data)

if __name__ == '__main__':

main()

此时执行的参数已经可以实时写入influxdb中了,如下:

> precision rfc3339

>

> select * from locust limit 10 tz('Asia/Shanghai')

name: locust

time api avg fails max median method min qps reqs

---- --- --- ----- --- ------ ------ --- --- ----

2019-11-21T14:59:19.040228993+08:00 /apis 16 0 43 14 GET 6 0 191

2019-11-21T14:59:21.039195477+08:00 /apis 62 0 206 55 GET 6 36 481

2019-11-21T14:59:23.059811043+08:00 /apis 151 0 1305 110 GET 6 96.2 765

2019-11-21T14:59:25.077216006+08:00 /apis 211 0 2098 160 GET 6 103.5 990

2019-11-21T14:59:27.066784427+08:00 /apis 272 0 4700 180 GET 6 110 1262

2019-11-21T14:59:29.061261969+08:00 /apis 384 0 6386 190 GET 6 126.1 1532

2019-11-21T14:59:31.079897673+08:00 /apis 395 0 9465 190 GET 6 133.4 1804

2019-11-21T14:59:33.076470655+08:00 /apis 422 0 9707 200 GET 6 132 2034

2019-11-21T14:59:35.084000478+08:00 /apis 526 0 13796 200 GET 6 127.1 2270

2019-11-21T14:59:37.102809695+08:00 /apis 574 0 15456 200 GET 6 127.5 2553

>

那么下一步只要在grafana展示图表就可以了。

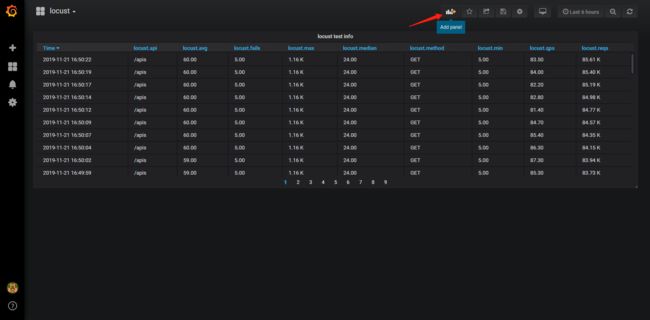

Grafana设置图表

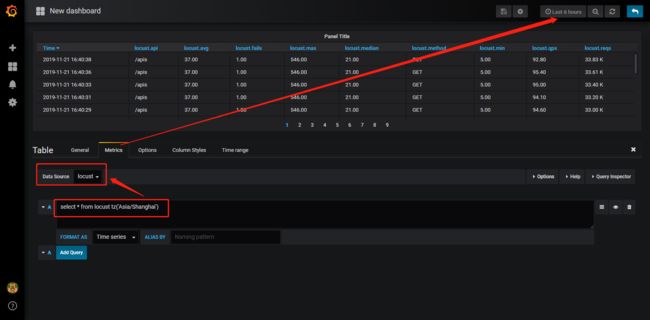

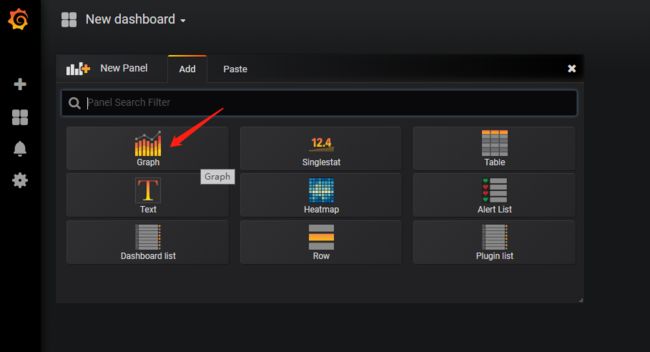

创建table图表

先创建一个table表格,如下:

将查询语句直接写入查询框中,然后选择数据库(我前面已经设置好,这里就不展示了),最后设置查询的时间,就可以看到数据展示了。

最后修改标题,保存起来就可以了,下面再来做一个折线图。

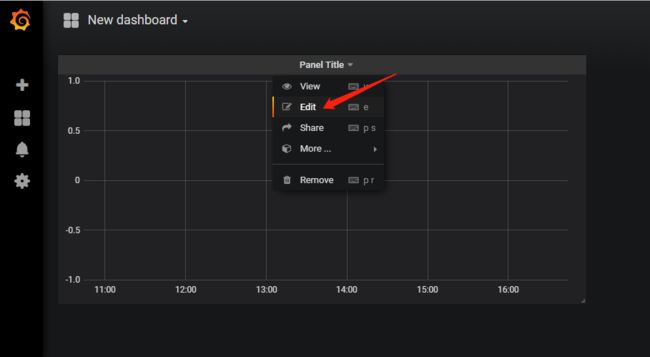

创建折线图

同样的操作,如何需要在折线图上显示什么曲线,那就增加字段即可。在复制到grafana之前,最好在influx查询执行一下,看看能否执行成功。

我的测试执行如下:

> select "qps","avg" from locust limit 5 tz('Asia/Shanghai')

name: locust

time qps avg

---- --- ---

2019-11-21T14:59:19.040228993+08:00 0 16

2019-11-21T14:59:21.039195477+08:00 36 62

2019-11-21T14:59:23.059811043+08:00 96.2 151

2019-11-21T14:59:25.077216006+08:00 103.5 211

2019-11-21T14:59:27.066784427+08:00 110 272

>

到这里就已经实现locust执行日志的实时查看了。

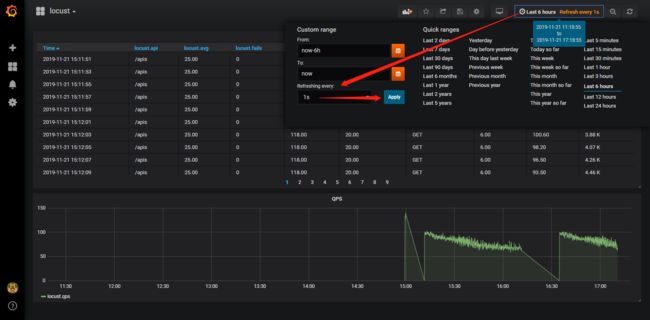

效果图

最后设置一下页面自动刷新,如下:

另外,如果有不清楚influxdb和grafana安装和基本操作的,可以看看我之前写关于这两个工具的篇章:

Grafana系列

InfluxDB系列

![]()