Hadoop离线_Apache Hadoop的三种运行环境介绍及环境搭建

文章目录

- 1 三种运行环境介绍

- 2 standAlone环境搭建

-

- 2.1 下载apache hadoop并上传到服务器

- 2.2 修改配置文件

-

-

-

-

- 2.2.1 修改core-site.xml文件

- 2.2.2 修改hdfs-site.xml文件

- 2.2.3 修改hadoop-env.sh文件

- 2.2.4 mapred-site.xml文件

- 2.2.5 yarn-site.xml文件

- 2.2.6 修改slaves文件

-

-

-

- 2.3 创建数据存放目录

- 2.4 启动集群

- 2.5 登陆

- 3 搭建伪分布式环境

-

-

- 3.1 关闭单节点集群,删除/export/servers/hadoop-2.7.5/hadoopDatas,重新创建文件夹

- 3.2 修改配置文件slaves,将安装包分发到第二台和第三台机器上,启动集群

- 3.3 启动集群

- 3.4 浏览器上登陆

-

- 4 搭建完全分布式环境

-

-

- 4.1 解压安装包

- 4.2 修改配置文件

-

- 4.2.1 修改core-site.xml

- 4.2.2 修改hdfs-site.xml

- 4.2.3 修改hadoop-env.sh

- 4.2.4 修改mapred-site.xml

- 4.2.5 修改yarn-site.xml

- 4.2.6 修改slaves

- 4.3 创建文件夹和安装包分发

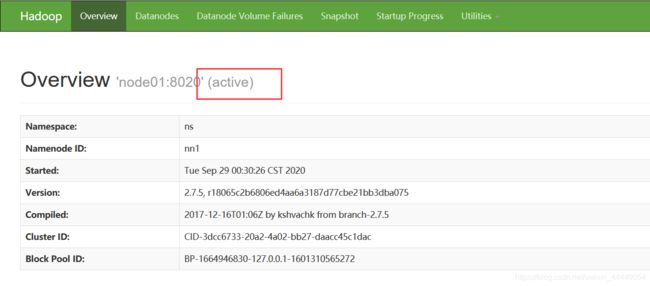

- 4.4 启动集群

- 4.5 登陆

-

1 三种运行环境介绍

- standAlone环境

单机版的hadoop运行环境,主节点从节点运行在同一台机器上 - 伪分布式环境

主节点都在一台机器上,从节点分开到其他机器上(可以借助三台机器来实现) - 完全分布式环境

主节点全部分散到不同机器上(NameNode Active,NameNode StandBy,ResourceManager 主节点,ResourceManager 备份节点

2 standAlone环境搭建

2.1 下载apache hadoop并上传到服务器

官方网址:hadoop下载地址

上传到/export/softwares/,并解压到/export/servers/

tar -zxvf hadoop-2.7.5.tar.gz -C /export/servers/

hadoop的本地库:/hadoop-2.7.5/lib/native(里面集成了一些C程序,包括了一些压缩的支持)

检测本地库的支持:bin/hadoop checknative

snappy是谷歌提供的一种解压缩算法

2.2 修改配置文件

在hadoop的etc/hadoop目录下,修改以下文件:cd /export/servers/hadoop-2.7.5/etc/hadoop

2.2.1 修改core-site.xml文件

核心配置文件,主要定义了我们的集群是分布式,还是本机运行

fs.default.name</name>

<!-- hdfs://表示我们使用分布式的文件系统的实现

决定了我们namenode在哪台机器上实现 -->

hdfs://192.168.52.100:8020</value>

</property>

hadoop.tmp.dir</name>

<!-- 临时文件的存放目录 -->

/export/servers/hadoop-2.7.5/hadoopDatas/tempDatas</value>

</property>

io.file.buffer.size</name>

<!-- 缓冲区大小,实际工作中根据服务器性能动态调整 -->

4096</value>

</property>

fs.trash.interval</name>

<!-- 开启hdfs的垃圾桶机制,

删除掉的数据可以从垃圾桶中回收,单位分钟 -->

10080</value>

</property>

</configuration>

2.2.2 修改hdfs-site.xml文件

分布式文件系统的核心配置,决定了我们数据存放在哪个路径,数据的副本,数据的block块大小

<!--定义我们secondaryNamenode的通信地址,

辅助namenode管理元数据信息的-->

dfs.namenode.secondary.http-address</name>

node01:50090</value>

</property>

<!--50070这个端口定义的是我们通过浏览器访问我们hdsf的端口-->

dfs.namenode.http-address</name>

node01:50070</value>

</property>

<!--定义了我们元数据fsimage的存储路径,fsimage就是我们的元数据信息

两个路径用逗号,隔开-->

dfs.namenode.name.dir</name>

file:///export/servers/hadoop-2.7.5/hadoopDatas/namenodeDatas,file:///export/servers/hadoop-2.7.5/hadoopDatas/namenodeDatas2</value>

</property>

<!-- 定义dataNode数据存储的节点位置,实际工作中,一般先确定磁盘的挂载目录,然后多个目录用,进行分割 -->

dfs.datanode.data.dir</name>

file:///export/servers/hadoop-2.7.5/hadoopDatas/datanodeDatas,file:///export/servers/hadoop-2.7.5/hadoopDatas/datanodeDatas2</value>

</property>

<!--一个edits文件的存放位置,一部分元数据信息-->

dfs.namenode.edits.dir</name>

file:///export/servers/hadoop-2.7.5/hadoopDatas/nn/edits</value>

</property>

<!--元数据保存点存放的位置-->

dfs.namenode.checkpoint.dir</name>

file:///export/servers/hadoop-2.7.5/hadoopDatas/snn/name</value>

</property>

<!--edits元数据存放的位置-->

dfs.namenode.checkpoint.edits.dir</name>

file:///export/servers/hadoop-2.7.5/hadoopDatas/dfs/snn/edits</value>

</property>

<!--文件的副本数,安全机制-->

dfs.replication</name>

1</value>

</property>

<!--文件系统的权限机制是否要打开,权限比较弱,先关掉-->

dfs.permissions</name>

false</value>

</property>

<!--文件block块的大小,默认180M-->

dfs.blocksize</name>

134217728</value>

</property>

</configuration>

2.2.3 修改hadoop-env.sh文件

配置我们jdk的home路径

export JAVA_HOME=/export/servers/jdk1.8.0_141

2.2.4 mapred-site.xml文件

定义了我们关于mapreduce运行的一些参数

<!--指定我们mapreduce运行的框架是yarn-->

mapreduce.framework.name</name>

yarn</value>

</property>

<!--mapreduce的小任务模式开启-->

mapreduce.job.ubertask.enable</name>

true</value>

</property>

<!--定义了我们jobhistory的通信地址

jobhistory是我们查看历史完成的任务信息-->

mapreduce.jobhistory.address</name>

node01:10020</value>

</property>

<!--浏览器界面查看我们的jobhistory地址-->

mapreduce.jobhistory.webapp.address</name>

node01:19888</value>

</property>

</configuration>

2.2.5 yarn-site.xml文件

定义我们的yarn集群

<!--定义我们resourceManager所在的机器-->

yarn.resourcemanager.hostname</name>

node01</value>

</property>

<!--定义mapreduce的框架-->

yarn.nodemanager.aux-services</name>

mapreduce_shuffle</value>

</property>

<!--开启日志的聚集功能,可以让我们在19888端口上,

jobhistory界面上查看我们运行的日志-->

yarn.log-aggregation-enable</name>

true</value>

</property>

<!--保存时长604800秒-->

yarn.log-aggregation.retain-seconds</name>

604800</value>

</property>

</configuration>

2.2.6 修改slaves文件

定义了我们的从节点是哪些机器,也就是DataNode和NodeManager运行在哪些机器上

node01

2.3 创建数据存放目录

单机版只在一台机器上

cd /export/servers/hadoop-2.7.5/

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/tempDatas

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/namenodeDatas

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/namenodeDatas2

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/datanodeDatas

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/datanodeDatas2

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/nn/edits

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/snn/name

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/dfs/snn/edits

2.4 启动集群

要启动Hadoop集群,需要启动HDFS和YARN两个模块

注意:首次启动HDFS时,必须对其进行格式化操作,本质上是一些清理和准备工作,因为此时的HDFS在物理上还是不存在的

在bin目录下执行:

hdfs namenode -format或者hadoop namenode -format

在sbin目录下执行:

启动HDFS模块:sbin/start-dfs.sh

关闭HDFS:stop-all.sh

jps # 查看已启动

启动YARN模块:sbin/start-yarn.sh

关闭YARN:stop-yarn.sh

历史完成任务模块:sbin/mr-jobhistory-daemon.sh start historyserver

关闭:mr-jobhistory-daemon.sh stop historyserver

2.5 登陆

3 搭建伪分布式环境

3.1 关闭单节点集群,删除/export/servers/hadoop-2.7.5/hadoopDatas,重新创建文件夹

# 关闭单节点集群

stop-dfs.sh

stop-yarn.sh

mr-jobhistory-daemon.sh stop historyserver

# 删除文件夹

rm -rf hadoopDatas/

# 重新创建文件夹

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/tempDatas

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/namenodeDatas

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/namenodeDatas2

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/datanodeDatas

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/datanodeDatas2

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/nn/edits

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/snn/name

mkdir -p /export/servers/hadoop-2.7.5/hadoopDatas/dfs/snn/edits

3.2 修改配置文件slaves,将安装包分发到第二台和第三台机器上,启动集群

将slaves内容改为:

node01

node02

node03

安装包分发:

cd /export/servers/

scp -r hadoop-2.7.5 node02:$PWD

scp -r hadoop-2.7.5 node03:$PWD

3.3 启动集群

第一台机器:

cd /export/servers/hadoop-2.7.5/

bin/hdfs namenode -format

sbin/start-dfs.sh

sbin/start-yarn.sh

sbin/mr-jobhistory-daemon.sh start historyserver

第二台机器:

sbin/hadoop-daemon.sh start datanode

sbin/yarn-daemon.sh start nodemanager

第三台机器:

sbin/hadoop-daemon.sh start datanode

sbin/yarn-daemon.sh start nodemanager

3.4 浏览器上登陆

4 搭建完全分布式环境

4.1 解压安装包

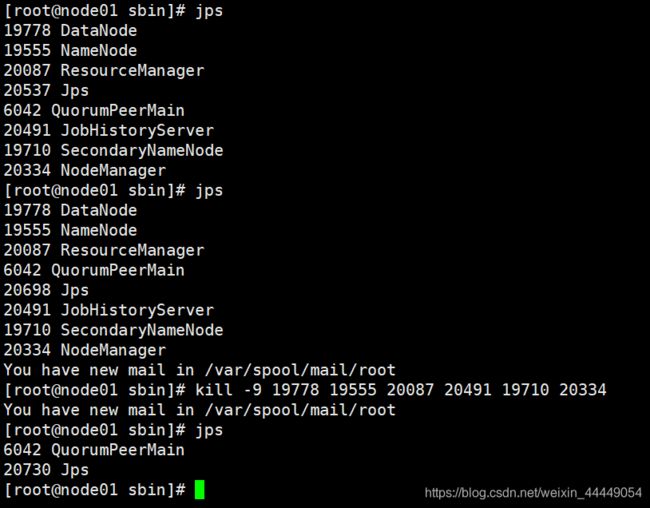

- 删除所有机器上的所有服务

三台机器上执行

rm -rf /export/servers/hadoop-2.7.5/

- 解压安装包到node01机器上

cd /export/softwares

tar -zxvf hadoop-2.7.5.tar.gz -C ../servers/

4.2 修改配置文件

进入hadoop文件

cd /export/servers/hadoop-2.7.5/etc/hadoop

4.2.1 修改core-site.xml

<!-- 指定NameNode的HA高可用的zk地址 -->

ha.zookeeper.quorum</name>

node01:2181,node02:2181,node03:2181</value>

</property>

<!-- 指定HDFS访问的域名地址 -->

fs.defaultFS</name>

hdfs://ns</value>

</property>

<!-- 临时文件存储目录 -->

hadoop.tmp.dir</name>

/export/servers/hadoop-2.7.5/data/tmp</value>

</property>

<!-- 开启hdfs垃圾箱机制,指定垃圾箱中的文件七天之后就彻底删掉

单位为分钟

-->

fs.trash.interval</name>

10080</value>

</property>

</configuration>

4.2.2 修改hdfs-site.xml

<!-- 指定命名空间 -->

dfs.nameservices</name>

ns</value>

</property>

<!-- 指定该命名空间下的两个机器作为我们的NameNode -->

dfs.ha.namenodes.ns</name>

nn1,nn2</value>

</property>

<!-- 配置第一台服务器的namenode通信地址 -->

dfs.namenode.rpc-address.ns.nn1</name>

node01:8020</value>

</property>

<!-- 配置第二台服务器的namenode通信地址 -->

dfs.namenode.rpc-address.ns.nn2</name>

node02:8020</value>

</property>

<!-- 所有从节点之间相互通信端口地址 -->

dfs.namenode.servicerpc-address.ns.nn1</name>

node01:8022</value>

</property>

<!-- 所有从节点之间相互通信端口地址 -->

dfs.namenode.servicerpc-address.ns.nn2</name>

node02:8022</value>

</property>

<!-- 第一台服务器namenode的web访问地址 -->

dfs.namenode.http-address.ns.nn1</name>

node01:50070</value>

</property>

<!-- 第二台服务器namenode的web访问地址 -->

dfs.namenode.http-address.ns.nn2</name>

node02:50070</value>

</property>

<!-- journalNode的访问地址,注意这个地址一定要配置 -->

dfs.namenode.shared.edits.dir</name>

qjournal://node01:8485;node02:8485;node03:8485/ns1</value>

</property>

<!-- 指定故障自动恢复使用的哪个java类 -->

dfs.client.failover.proxy.provider.ns</name>

org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 故障转移使用的哪种通信机制 -->

dfs.ha.fencing.methods</name>

sshfence</value>

</property>

<!-- 指定通信使用的公钥 -->

dfs.ha.fencing.ssh.private-key-files</name>

/root/.ssh/id_rsa</value>

</property>

<!-- journalNode数据存放地址 -->

dfs.journalnode.edits.dir</name>

/export/servers/hadoop-2.7.5/data/dfs/jn</value>

</property>

<!-- 启用自动故障恢复功能 -->

dfs.ha.automatic-failover.enabled</name>

true</value>

</property>

<!-- namenode产生的文件存放路径 -->

dfs.namenode.name.dir</name>

file:///export/servers/hadoop-2.7.5/data/dfs/nn/name</value>

</property>

<!-- edits产生的文件存放路径 -->

dfs.namenode.edits.dir</name>

file:///export/servers/hadoop-2.7.5/data/dfs/nn/edits</value>

</property>

<!-- dataNode文件存放路径 -->

dfs.datanode.data.dir</name>

file:///export/servers/hadoop-2.7.5/data/dfs/dn</value>

</property>

<!-- 关闭hdfs的文件权限 -->

dfs.permissions</name>

false</value>

</property>

<!-- 指定block文件块的大小 -->

dfs.blocksize</name>

134217728</value>

</property>

</configuration>

4.2.3 修改hadoop-env.sh

export JAVA_HOME=/export/servers/jdk1.8.0_141

4.2.4 修改mapred-site.xml

<!--指定运行mapreduce的环境是yarn -->

mapreduce.framework.name</name>

yarn</value>

</property>

<!-- MapReduce JobHistory Server IPC host:port -->

mapreduce.jobhistory.address</name>

node03:10020</value>

</property>

<!-- MapReduce JobHistory Server Web UI host:port -->

mapreduce.jobhistory.webapp.address</name>

node03:19888</value>

</property>

<!-- The directory where MapReduce stores control files.默认 ${

hadoop.tmp.dir}/mapred/system -->

mapreduce.jobtracker.system.dir</name>

/export/servers/hadoop-2.7.5/data/system/jobtracker</value>

</property>

<!-- The amount of memory to request from the scheduler for each map task. 默认 1024-->

mapreduce.map.memory.mb</name>

1024</value>

</property>

<!--

mapreduce.map.java.opts</name>

-Xmx1024m</value>

</property> -->

<!-- The amount of memory to request from the scheduler for each reduce task. 默认 1024-->

mapreduce.reduce.memory.mb</name>

1024</value>

</property>

<!--

mapreduce.reduce.java.opts</name>

-Xmx2048m</value>

</property> -->

<!-- 用于存储文件的缓存内存的总数量,以兆字节为单位。默认情况下,分配给每个合并流1MB,给个合并流应该寻求最小化。默认值100-->

mapreduce.task.io.sort.mb</name>

100</value>

</property>

<!--

mapreduce.jobtracker.handler.count</name>

25</value>

</property>-->

<!-- 整理文件时用于合并的流的数量。这决定了打开的文件句柄的数量。默认值10-->

mapreduce.task.io.sort.factor</name>

10</value>

</property>

<!-- 默认的并行传输量由reduce在copy(shuffle)阶段。默认值5-->

mapreduce.reduce.shuffle.parallelcopies</name>

25</value>

</property>

yarn.app.mapreduce.am.command-opts</name>

-Xmx1024m</value>

</property>

<!-- MR AppMaster所需的内存总量。默认值1536-->

yarn.app.mapreduce.am.resource.mb</name>

1536</value>

</property>

<!-- MapReduce存储中间数据文件的本地目录。目录不存在则被忽略。默认值${

hadoop.tmp.dir}/mapred/local-->

mapreduce.cluster.local.dir</name>

/export/servers/hadoop-2.7.5/data/system/local</value>

</property>

</configuration>

4.2.5 修改yarn-site.xml

<!-- Site specific YARN configuration properties -->

<!-- 是否启用日志聚合.应用程序完成后,日志汇总收集每个容器的日志,这些日志移动到文件系统,例如HDFS. -->

<!-- 用户可以通过配置"yarn.nodemanager.remote-app-log-dir"、"yarn.nodemanager.remote-app-log-dir-suffix"来确定日志移动到的位置 -->

<!-- 用户可以通过应用程序时间服务器访问日志 -->

<!-- 启用日志聚合功能,应用程序完成后,收集各个节点的日志到一起便于查看 -->

yarn.log-aggregation-enable</name>

true</value>

</property>

<!--开启resource manager HA,默认为false-->

yarn.resourcemanager.ha.enabled</name>

true</value>

</property>

<!-- 集群的Id,使用该值确保RM不会做为其它集群的active -->

yarn.resourcemanager.cluster-id</name>

mycluster</value>

</property>

<!--配置resource manager 命名-->

yarn.resourcemanager.ha.rm-ids</name>

rm1,rm2</value>

</property>

<!-- 配置第一台机器的resourceManager -->

yarn.resourcemanager.hostname.rm1</name>

node03</value>

</property>

<!-- 配置第二台机器的resourceManager -->

yarn.resourcemanager.hostname.rm2</name>

node02</value>

</property>

<!-- 配置第一台机器的resourceManager通信地址 -->

yarn.resourcemanager.address.rm1</name>

node03:8032</value>

</property>

yarn.resourcemanager.scheduler.address.rm1</name>

node03:8030</value>

</property>

yarn.resourcemanager.resource-tracker.address.rm1</name>

node03:8031</value>

</property>

yarn.resourcemanager.admin.address.rm1</name>

node03:8033</value>

</property>

yarn.resourcemanager.webapp.address.rm1</name>

node03:8088</value>

</property>

<!-- 配置第二台机器的resourceManager通信地址 -->

yarn.resourcemanager.address.rm2</name>

node02:8032</value>

</property>

yarn.resourcemanager.scheduler.address.rm2</name>

node02:8030</value>

</property>

yarn.resourcemanager.resource-tracker.address.rm2</name>

node02:8031</value>

</property>

yarn.resourcemanager.admin.address.rm2</name>

node02:8033</value>

</property>

yarn.resourcemanager.webapp.address.rm2</name>

node02:8088</value>

</property>

<!--开启resourcemanager自动恢复功能-->

yarn.resourcemanager.recovery.enabled</name>

true</value>

</property>

<!--在node1上配置rm1,在node2上配置rm2,注意:一般都喜欢把配置好的文件远程复制到其它机器上,但这个在YARN的另一个机器上一定要修改,其他机器上不配置此项-->

yarn.resourcemanager.ha.id</name>

rm1</value>

If we want to launch more than one RM in single node, we need this configuration</description>

</property>

<!--用于持久存储的类。尝试开启-->

yarn.resourcemanager.store.class</name>

org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value>

</property>

yarn.resourcemanager.zk-address</name>

node02:2181,node03:2181,node01:2181</value>

For multiple zk services, separate them with comma</description>

</property>

<!--开启resourcemanager故障自动切换,指定机器-->

yarn.resourcemanager.ha.automatic-failover.enabled</name>

true</value>

Enable automatic failover; By default, it is enabled only when HA is enabled.</description>

</property>

yarn.client.failover-proxy-provider</name>

org.apache.hadoop.yarn.client.ConfiguredRMFailoverProxyProvider</value>

</property>

<!-- 允许分配给一个任务最大的CPU核数,默认是8 -->

yarn.nodemanager.resource.cpu-vcores</name>

4</value>

</property>

<!-- 每个节点可用内存,单位MB -->

yarn.nodemanager.resource.memory-mb</name>

512</value>

</property>

<!-- 单个任务可申请最少内存,默认1024MB -->

yarn.scheduler.minimum-allocation-mb</name>

512</value>

</property>

<!-- 单个任务可申请最大内存,默认8192MB -->

yarn.scheduler.maximum-allocation-mb</name>

512</value>

</property>

<!--多长时间聚合删除一次日志 此处-->

yarn.log-aggregation.retain-seconds</name>

2592000</value><!--30 day-->

</property>

<!--时间在几秒钟内保留用户日志。只适用于如果日志聚合是禁用的-->

yarn.nodemanager.log.retain-seconds</name>

604800</value><!--7 day-->

</property>

<!--指定文件压缩类型用于压缩汇总日志-->

yarn.nodemanager.log-aggregation.compression-type</name>

gz</value>

</property>

<!-- nodemanager本地文件存储目录-->

yarn.nodemanager.local-dirs</name>

/export/servers/hadoop-2.7.5/yarn/local</value>

</property>

<!-- resourceManager 保存最大的任务完成个数 -->

yarn.resourcemanager.max-completed-applications</name>

1000</value>

</property>

<!-- 逗号隔开的服务列表,列表名称应该只包含a-zA-Z0-9_,不能以数字开始-->

yarn.nodemanager.aux-services</name>

mapreduce_shuffle</value>

</property>

<!--rm失联后重新链接的时间-->

yarn.resourcemanager.connect.retry-interval.ms</name>

2000</value>

</property>

</configuration>

4.2.6 修改slaves

node01

node02

node03

4.3 创建文件夹和安装包分发

创建文件夹

mkdir -p /export/servers/hadoop-2.7.5/data/dfs/nn/name

mkdir -p /export/servers/hadoop-2.7.5/data/dfs/nn/edits

mkdir -p /export/servers/hadoop-2.7.5/data/dfs/nn/name

mkdir -p /export/servers/hadoop-2.7.5/data/dfs/nn/edits

安装包分发:

cd /export/servers

scp -r hadoop-2.7.5/ node02:$PWD

scp -r hadoop-2.7.5/ node03:$PWD

更改node的rm2

在第二台机器执行

cd /export/servers/hadoop-2.7.5/etc/hadoop

vim yarn-site.xml

<!--在node3上配置rm1,在node2上配置rm2,注意:一般都喜欢把配置好的文件远程复制到其它机器上,

但这个在YARN的另一个机器上一定要修改,其他机器上不配置此项

注意我们现在有两个resourceManager 第三台是rm1 第二台是rm2

这个配置一定要记得去node02上面改好

-->

yarn.resourcemanager.ha.id</name>

rm2</value>

If we want to launch more than one RM in single node, we need this configuration</description>

</property>

4.4 启动集群

启动HDFS

在第一台机器执行cd /export/servers/hadoop-2.7.5

bin/hdfs zkfc -formatZK #格式化zk

sbin/hadoop-daemons.sh start journalnode #启动journalnode

bin/hdfs namenode -format #格式化NameNode上面所有的数据

bin/hdfs namenode -initializeSharedEdits -force #强制初始化元数据信息

sbin/start-dfs.sh #启动HDFS

在第二台机器执行:cd /export/servers/hadoop-2.7.5

bin/hdfs namenode -bootstrapStandby #设置NameNode为StandBy状态

sbin/hadoop-daemon.sh start namenode

sbin/hadoop-daemon.sh start datanode

启动YARN

在第二台机器上执行

cd /export/servers/hadoop-2.7.5

sbin/start-yarn.sh

在第三台机器上执行

cd /export/servers/hadoop-2.7.5

sbin/start-yarn.sh

启动Jobhistory

在第三台机器上

cd /export/servers/hadoop-2.7.5

sbin/mr-jobhistory-daemon.sh start historyserver