在上一篇scrapy(low-level~python scrapy自动爬取网页的爬虫)[https://www.jianshu.com/p/9b07e556216e]中我们实现了翻页操作,但是这种操作不利于改动。这次改进为分模块编程的思想。

思路:

第一步:提取每页的链接

第二步:提取每页商品的链接

第三步:提取每页商品的具体信息

这里的难点在于

for i in range(1,3):

url ="http://category.dangdang.com/pg"+str(i)+"-cp01.05.16.00.00.00.html

#通过yield返回Reques,并指定要爬取的网址和回调函数

yield Request(url,callback=self.parse)

Request函数的参数callback,这个参数决定着接下来执行什么操作。

首先我们知道spider中初始的request是通过调用start_requests()来获取,start_requests()读取start_urls中的URL,所以我们每页链接的提取放在start_requests()中处理

def start_requests(self):

start_urls = ['http://category.dangdang.com/pg1-cp01.05.16.00.00.00.html',]

start,end=1,3

for i in range(start,end):

print(str(i))

url="http://category.dangdang.com/pg"+str(i)+"-cp01.05.16.00.00.00.html"

print(url)

yield scrapy.http.Request(url,self.parse)

yield scrapy.http.Request(url,self.parse)含义:

Request请求url链接,回调parse()函数

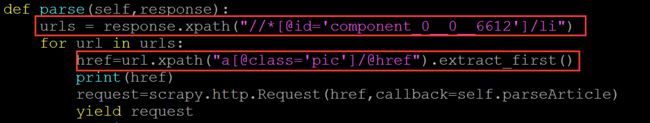

接下来我们定义函数parse(),这个函数负责提取每个页面商品的链接。分析页面代码

如图所示,所有的商品信息都在

- 下面。所以当我们得到页面的url之后,先提取ul class....这个大标签,然后循环提取每一个商品的链接标签,代码如下:

def parse(self,response):

urls = response.xpath("//*[@id='component_0__0__6612']/li")

for url in urls:

href=url.xpath("a[@class='pic']/@href").extract_first()

print(href)

request=scrapy.http.Request(href,callback=self.parseArticle)

yield request

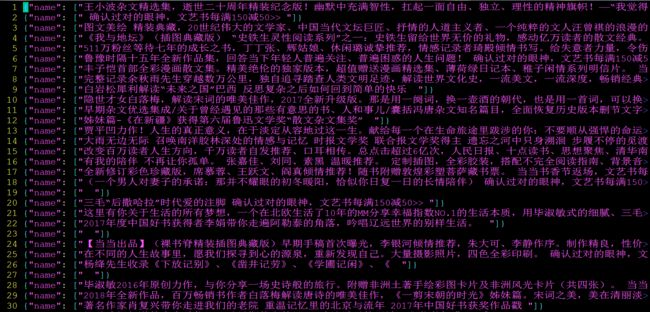

最后一步,进入商品详细链接中提取title属性

首先定义一个item,存储爬取的数据信息,然后用xpath提取我们需要的标签

def parseArticle(self,response):

item =AutopjtItem()

item['name']=response.xpath('//

[@id="product_info"]/div[1]/h2/span[1]/@title').extract()

print(item['name'])

yield item

完成,中间遇到很多的坑,一一列举,避免再次发生

1,class类中的name值必须是我们的文件名,否则会报错:

KeyError: 'Spider not found: autospd

2,当我们提取

- 大标签时,不能用extract()函数。否则什么都得不到(不要问我怎么知道的,都是泪,,,,,,,)

完整代码如下

# -*- coding: utf-8 -*-

2 import scrapy

3 from autopjt.items import AutopjtItem

4 from scrapy.http import Request

5 from scrapy.selector import Selector

6 #创建一个爬虫类AutospdSpider,该类继承了scrapy.Spider基类

7 class AutospdSpider(scrapy.Spider):

8 name = "autospd"

9 # urlList = []

10 #name属性代表的是爬虫名称

11 #allowed_domains属性代表的是允许爬行的域名

12 allowed_domains = ["dangdang.com"]

13 #爬行的起始网址

14 # start_urls = ['http://category.dangdang.com/pg1-cp01.05.16.00.00.00.html',]

15 def start_requests(self):

16 start_urls = ['http://category.dangdang.com/pg1-cp01.05.16.00.00.00.html',]

17 start,end=1,3

18 for i in range(start,end):

19 print(str(i))

20 url="http://category.dangdang.com/pg"+str(i)+"-cp01.05.16.00.00.00.html"

21 print(url)

22 yield scrapy.http.Request(url,self.parse)

23 #得到页链接,对每个页链接找到每一个商品链接

24 def parse(self,response):

25 urls = response.xpath("//*[@id='component_0__0__6612']/li")

26 for url in urls:

27 href=url.xpath("a[@class='pic']/@href").extract_first()

28 print(href)

29 request=scrapy.http.Request(href,callback=self.parseArticle)

30 yield request

31 def parseArticle(self,response):

32 item =AutopjtItem()

33 item['name']=response.xpath('//*[@id="product_info"]/div[1]/h2/span[1]/@title').extract()

34 yield item

当item在Spider中被收集之后,将会被传递到item Pipeline,Item Pipeline,在pipeline.py文件中对提取到的数据进行进一步的处理。

class AutopjtPipeline(object):

def __init__(self):

self.file = codecs.open("mydata.json","wb",encoding="utf-8")

#这个方法必须返回一个Item对象,参数item:被爬取的item,spider爬取该item的spider

def process_item(self, item, spider):

#打开JSON文件,向里面以dumps的方式吸入数据,其中ensure_ascii=False, 不然数据会直接为utf编码的方式存入

i = json.dumps(dict(item),ensure_ascii=False)

#每条数据后加上换行

line = i +'\n'

#数据写到mydata.json文件中

self.file.write(line)

return item

def close_spider(self,spider):

self.file.close()

保存的文件的打开路径直接写想保存的XXX.json即可

再有一步就可以完成了,在pipelines.py处理成为json格式时,还需要在settings.py文件告诉系统pipelines文件在哪里以及pipeline文件里面对应的类是什么,找到settings.py文件中关于pipelines的设置部分,

ITEM_PIPELINES={

'autopjt.pipelines.AutopjtPipeline':300,

#分配给每个类的整型值,确定他们的运行顺序,item按数字从低到高的顺序通过pipeline

}

在上面代码中,'autopjt.pipelines.AutopjtPipeline'中的autopjt为项目名(即Scrapy项目的核心目录名),pipelines代表autopjt目录下的pipelines.py文件的文件名,AutopjtPipeline代表对应的pipelines文件里的类。

再次运行spider文件,vim XXXX.json就可以打开json格式的文件

参考来源

狸狸深深的【补充更新Report B2】Scrapy分页爬取四川大学公共管理学院全职教师信息及学院新闻

Requests and Responses