- ARTS-第七周

梧上擎天

Algorithm一、用链表和二叉树实现Set集合GitHub地址二、散列表散列表就是使用数组下标随机访问时候复杂度为O(1)的特性,当我们按照键值查找元素时,通过散列函数将key转化为下标然后进行访问,当有大量散列冲突时会退化为O(n)的时间复杂度。解决散列冲突的方法:开放寻址法和链表法ReviewFlink动态表概念原文地址流和表为什么可以相互转换呢?我们都知道传统Mysql的主从复制是通过b

- 如何解决一个flink on yarn集群上已经跑了一个job,再提交第二个job的时候,task报java heap size oom的问题

fzip

Flinkflinkjava大数据

在FlinkonYARN集群中提交第二个Job时出现Task的JavaHeapSizeOOM(内存溢出),核心原因是集群资源不足(第一个Job已占用大量资源,第二个Job分配的内存不够)或Job资源配置不合理(单个Job申请资源过多,或内存参数设置与实际需求不匹配)。解决需从“资源排查”“Job配置优化”“集群资源扩容”三个维度入手,具体步骤如下:一、先排查核心原因:确认资源占用与配置是否匹配1.

- flink sql读hive catalog数据,将string类型的时间戳数据排序后写入kafka,如何保障写入kafka的数据是有序的

fzip

Flinkflinksqlhive

在FlinkSQL中,要确保从Hive读取的STRING类型时间戳数据排序后有序写入Kafka,需要结合批处理模式、时间类型转换、单分区写入和Kafka生产者配置。以下是完整解决方案:一、核心解决方案1.批处理模式+全局排序将作业设置为批处理模式,并对字符串时间戳进行类型转换后排序:--设置为批处理模式(关键!)SET'execution.runtime-mode'='batch';--从Hive

- flink-sql读写hive-1.13

第一片心意

flinkflinksqlhive

1.版本说明本文档内容基于flink-1.13.x,其他版本的整理,请查看本人博客的flink专栏其他文章。1.1.概述ApacheHive已经成为了数据仓库生态系统中的核心。它不仅仅是一个用于大数据分析和ETL场景的SQL引擎,同样也是一个数据管理平台,可用于发现,定义,和演化数据。Flink与Hive的集成包含两个层面。一是利用了Hive的MetaStore作为持久化的Catalog,用户可通

- flink sql如何对hive string类型的时间戳进行排序

在FlinkSQL中对Hive表的STRING类型时间戳进行排序,需要先将字符串转换为时间类型,再基于时间类型排序。以下是具体方法和示例:一、核心解决方案1.字符串转TIMESTAMP后排序若Hive中的时间戳格式为'yyyy-MM-ddHH:mm:ss'(如'2024-01-0112:00:00'),可直接转为TIMESTAMP排序:SELECT*FROMhive_tableORDERBYTO_

- 基于Socket来构建无界数据流并通过Flink框架进行处理

每天五分钟玩转人工智能

Flink技术实战flink大数据Flink分布式无界数据

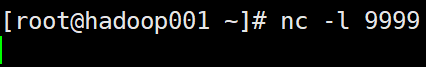

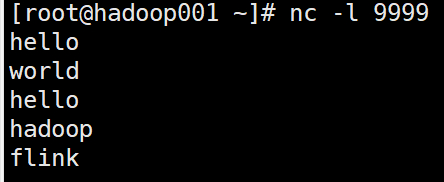

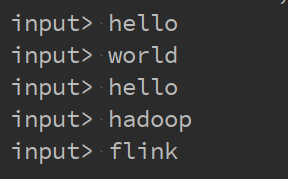

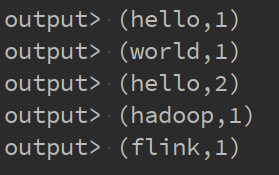

本文重点随着大数据技术的不断发展,实时数据流处理已成为企业应对海量数据、实现快速决策的关键技术。ApacheFlink是一个开源的流处理框架,它能够对无界数据流进行高效的、精确的处理。本文将介绍如何通过Socket构建无界数据流,并利用Flink框架进行无界流处理。基于Socket构建无界数据无界数据指的是源源不断产生的数据,这些数据通常来自各种实时数据源,如用户行为日志、传感器数据等。Socke

- Flink cdc同步增量数据timestamp字段相差八小时(分析|解决)不是粘贴复制的!

BUG FIXER

大数据flinkandroid大数据

问题我使用flinkcdc同步mysql到mysql遇到了timestamp字段缺少八小时的问题。很少无语,flink,cdc,debezium时区都设置了,没有任何效果!分析问题出现在mysqlbinlog身上!!!因为默认mysql会使用UTC来存储binlog,你可以使用下方的sql验证:mysqlbinlog--base64-output=DECODE-ROWS-v--start-date

- 如何解决Flink CDC同步时间类型字段8小时时间差的问题,以MySQL为例

智海观潮

Flinkflinkflinkcdc大数据实时数据同步

在使用FlinkCDC进行数据同步时,默认情况下经常会遇到时间类型的字段与实际值相差8个小时的问题。本文以MySQL为例提供解决方案,其他数据源也可以参考这类实现。原文链接:https://mp.weixin.qq.com/s/_f41ES8UquM-kj3Ie8JU_g1.设置server时区比如MySQL服务的时区为UTC时间,可以参考以下code设置时区。MySqlSourcemySqlSo

- Paimon对比基于消息队列(如Kafka)的传统实时数仓方案的优势

lifallen

Paimon大数据数据库数据结构java分布式apache数据仓库

弊端:数据重复->优势:Paimon主键表原生去重原方案弊端(Kafka)问题:消息队列(Kafka)是仅支持追加(Append-Only)的日志流。当Flink作业发生故障恢复(Failover)或业务逻辑迭代重跑数据时,同样的数据会被再次写入消息队列,形成重复数据。影响:下游应用(如DWS层、ADS层或直接对接的BI报表)必须自己实现复杂的去重逻辑,这不仅消耗大量计算资源(“资源消耗至少增加一

- Flink 流处理的核心基石【时间语义、水位线、状态、检查点、反压 】

csdn_tom_168

大数据flink核心时间语义水位线状态检查点反压

Flink流处理的核心基石【时间语义、水位线、状态、检查点、反压】,这些概念相互协作,构建了Flink高吞吐、低延迟、高容错的实时计算能力。以下是这些核心技术的深度解析及其内在联系:一、五大基石的内在联系驱动触发计算持久化保护恢复时间语义水位线状态管理检查点反压二、核心组件深度解析1.时间语义(TimeSemantics)核心作用:定义事件的时间维度//设置事件时间语义(关键配置)env.setS

- 用Flink实现的一个实时订单对账功能, Flink的双流实时对账

1.为什么业务订单数据不用Mysql之类的强事务性数据库监控反而用Flink的实时?一般这种涉及到订单的数据流都要用mysql监控实现,但是鉴于减少mysql的数据库压力和提高更实时性,可以考虑用Flink实时的数据流做实时的参考2.如何处理乱序数据?使用watermark水位保证第一层数据延迟.PS:这里的水位不能设置太长延迟使用processfuntion更加灵活的处理迟到数据,设置一个定时器

- Flink 多流转换 (三)CoProcessFunction合流操作案例

Alienware^

#FlinkFlink

文章目录下面是CoProcessFunction的一个具体示例:我们可以实现一个实时对账的需求,也就是app的支付操作和第三方的支付操作的一个双流Join。App的支付事件和第三方的支付事件将会互相等待5秒钟,如果等不来对应的支付事件,那么就输出报警信息。程序如下:Gitee源代码如下publicclassBillCheckExample{publicstaticvoidmain(String[]

- Flink双流处理:实时对账实现1

Flink双流处理:实时对账实现1去发现同类优质开源项目:https://gitcode.com/资源描述本资源文件详细介绍了Flink双流处理的实时对账实现。内容涵盖了基础概念、双流处理的方法以及实战案例,帮助开发者深入理解Flink在实时对账场景中的应用。内容概述基础概念介绍了Flink的基本概念和架构,为后续的双流处理打下基础。双流处理方法详细讲解了Flink中双流处理的核心方法和技巧,帮助

- Flink双流实时对账

在电商、金融、银行、支付等涉及到金钱相关的领域,为了安全起见,一般都有对账的需求。比如,对于订单支付事件,用户通过某宝付款,虽然用户支付成功,但是用户支付完成后并不算成功,我们得确认平台账户上是否到账了。针对上述的场景,我们可以采用批处理,或离线计算等技术手段,通过定时任务,每天结束后,扫描数据库中的数据,核对当天的支付数据和交易数据,进行对账。想要达到实时对账的效果,比如有的用户支付成功但是并没

- [特殊字符] 实时数据洪流突围战:Flink+Paimon实现毫秒级分析的架构革命(附压测报告)——日均百亿级数据处理成本降低60%的工业级方案

Lucas55555555

flink大数据

引言:流批一体的时代拐点据阿里云2025白皮书显示,实时数据处理需求年增速达240%,但传统Lambda架构资源消耗占比超运维成本的70%。某电商平台借助Flink+Paimon重构实时数仓后,端到端延迟从分钟级压缩至800ms,计算资源节省5.6万核/月。技术红利窗口期:2025年ApachePaimon1.0正式发布,支持秒级快照与湖仓一体,成为替代Iceberg的新范式一、痛点深挖:实时数仓

- Flink 2.0 DataStream算子全景

Edingbrugh.南空

大数据flinkflink人工智能

在实时流处理中,ApacheFlink的DataStreamAPI算子是构建流处理pipeline的基础单元。本文基于Flink2.0,聚焦算子的核心概念、分类及高级特性。一、算子核心概念:流处理的"原子操作1.数据流拓扑(StreamTopology)每个Flink应用可抽象为有向无环图(DAG),由源节点(Source)、算子节点(Operator)和汇节点(Sink)构成,算子通过数据流(S

- FlinkSQL 自定义函数详解

Tit先生

基础flinksql大数据java

FlinkSQL函数详解自定义函数除了内置函数之外,FlinkSQL还支持自定义函数,我们可以通过自定义函数来扩展函数的使用FlinkSQL当中自定义函数主要分为四大类:1.ScalarFunction:标量函数特点:每次只接收一行的数据,输出结果也是1行1列典型的标量函数如:upper(str),lower(str),abs(salary)2.TableFunction:表生成函数特点:运行时每

- Flink自定义函数之聚合函数(UDAGG函数)

土豆马铃薯

Flinkflink大数据

1.聚合函数概念聚合函数:将一个表的一个或多个行并且具有一个或多个属性聚合为标量值。聚合函数理解:假设一个关于饮料的表。表里面有三个字段,分别是id、name、price,表里有5行数据。假设你需要找到所有饮料里最贵的饮料的价格,即执行一个max()聚合。你需要遍历所有5行数据,而结果就只有一个数值。2.聚合函数实现聚合函数主要通过扩展AggregateFunction类实现。AggregateF

- Flink时间窗口详解

bxlj_jcj

Flinkflink大数据

一、引言在大数据流处理的领域中,Flink的时间窗口是一项极为关键的技术,想象一下,你要统计一个电商网站每小时的订单数量。由于订单数据是持续不断产生的,这就形成了一个无界数据流。如果没有时间窗口的概念,你就需要处理无穷无尽的数据,难以进行有效的统计分析。而时间窗口的作用,就是将这无界的数据流按照时间维度切割成一个个有限的“数据块”,方便我们对这些数据进行处理和分析。比如,我们可以定义一个1小时的时

- Flink DataStream API详解(一)

bxlj_jcj

Flinkflink大数据

一、引言Flink的DataStreamAPI,在流处理领域大显身手的核心武器。在很多实时数据处理场景中,如电商平台实时分析用户购物行为以实现精准推荐,金融领域实时监控交易数据以防范风险,DataStreamAPI都发挥着关键作用,能够对源源不断的数据流进行高效处理和分析。接下来,就让我们一起深入探索FlinkDataStreamAPI。二、DataStream编程基础搭建在开始使用FlinkDa

- flink自定义函数

逆风飞翔的小叔

flink入门到精通flink大数据bigdata

前言在很多情况下,尽管flink提供了丰富的转换算子API可供开发者对数据进行各自处理,比如map(),filter()等,但在实际使用的时候仍然不能满足所有的场景,这时候,就需要开发人员基于常用的转换算子的基础上,做一些自定义函数的处理1、来看一个常用的操作原始待读取的文件核心代码importorg.apache.flink.api.common.functions.FilterFunction

- Flink自定义函数的常用方式

飞Link

Waterflinkjava大数据

一、实现Flink提供的接口//自定义函数classMyMapFunctionimplementsMapFunction{publicIntegermap(Stringvalue){returnInteger.parseInt(value

- Flink DataStream API详解(二)

一、引言咱两书接上回,上一篇文章主要介绍了DataStreamAPI一些基本的使用,主要是针对单数据流的场景下,但是在实际的流处理场景中,常常需要对多个数据流进行合并、拆分等操作,以满足复杂的业务需求。Flink的DataStreamAPI提供了一系列强大的多流转换算子,如union、connect和split等,下面我们来详细了解一下它们的功能和用法。二、多流转换2.1union算子union算

- 【Kafka】Failed to send data to Kafka: Expiring 30 record(s) for xxx 732453 ms has passed since last

九师兄

kafkabigdatazookeeper

文章目录1.美图2.背景2.尝试方案13.尝试解决24.场景再现25.场景46.场景57.场景78.场景8M.拓展本文为博主九师兄(QQ:541711153欢迎来探讨技术)原创文章,未经允许博主不允许转载。1.美图问题与【Flink】Flink写入kafka报错FailedtosenddatatoKafka:Expiring4record(s)for20001mshaspassed重复了。2.背景

- 【Flink】flink Kafka报错 : Failed to send data to Kafka: This server is not the leader for that topic-pa

九师兄

flinkkafka大数据

1.背景出现这个问题的背景请参考:【Kafka】FailedtosenddatatoKafka:Expiring30record(s)forxxx732453mshaspassedsincelast[2020-09-0513:16:09

- 安全运维的 “五层防护”:构建全方位安全体系

KKKlucifer

安全运维

在数字化运维场景中,异构系统复杂、攻击手段隐蔽等挑战日益突出。保旺达基于“全域纳管-身份认证-行为监测-自动响应-审计溯源”的五层防护架构,融合AI、零信任等技术,构建全链路安全运维体系,以下从技术逻辑与实践落地展开解析:第一层:全域资产纳管——筑牢安全根基挑战云网基础设施包含分布式计算(Hadoop/Spark)、数据流处理(Storm/Flink)等异构组件,通信协议繁杂,传统方案难以全面纳管

- kafka单个生产者向具有多个partition的topic写数据(写入分区策略)

最近碰到生产环境现象一个flink程序单并行度(一个生产者),对应topic为8分区。每个分区都能消费到生产出的数据。整理知识点如下生产者写入消息到topic,kafka将依据不同的策略将数据分配到不同的分区中1.轮询分区策略2.随机分区策略3.按key分区分配策略4.自定义分区策略1.1轮询分区策略默认的策略,也是使用最多的策略,可以最大限度的保证所有消息平均分配到分区里面如果在生产消息时,ke

- 云原生--微服务、CICD、SaaS、PaaS、IaaS

青秋.

云原生docker云原生微服务kubernetesserverlessservice_meshci/cd

往期推荐浅学React和JSX-CSDN博客一文搞懂大数据流式计算引擎Flink【万字详解,史上最全】-CSDN博客一文入门大数据准流式计算引擎Spark【万字详解,全网最新】_大数据spark-CSDN博客目录1.云原生概念和特点2.常见云模式3.云对外提供服务的架构模式3.1IaaS(Infrastructure-as-a-Service)3.2PaaS(Platform-as-a-Servi

- Apache Iceberg数据湖基础

Aurora_NeAr

apache

IntroducingApacheIceberg数据湖的演进与挑战传统数据湖(Hive表格式)的缺陷:分区锁定:查询必须显式指定分区字段(如WHEREdt='2025-07-01')。无原子性:并发写入导致数据覆盖或部分可见。低效元数据:LIST操作扫描全部分区目录(云存储成本高)。Iceberg的革新目标:解耦计算引擎与存储格式(支持Spark/Flink/Trino等);提供ACID事务、模式

- Flink ClickHouse 连接器:实现 Flink 与 ClickHouse 无缝对接

Edingbrugh.南空

大数据flinkflinkclickhouse大数据

引言在大数据处理领域,ApacheFlink是一款强大的流处理和批处理框架,而ClickHouse则是一个高性能的列式数据库,专为在线分析处理(OLAP)场景设计。FlinkClickHouse连接器为这两者之间搭建了一座桥梁,使得用户能够在Flink中方便地与ClickHouse数据库进行交互,实现数据的读写操作。本文将详细介绍FlinkClickHouse连接器的相关内容,包括其特点、使用方法

- apache 安装linux windows

墙头上一根草

apacheinuxwindows

linux安装Apache 有两种方式一种是手动安装通过二进制的文件进行安装,另外一种就是通过yum 安装,此中安装方式,需要物理机联网。以下分别介绍两种的安装方式

通过二进制文件安装Apache需要的软件有apr,apr-util,pcre

1,安装 apr 下载地址:htt

- fill_parent、wrap_content和match_parent的区别

Cb123456

match_parentfill_parent

fill_parent、wrap_content和match_parent的区别:

1)fill_parent

设置一个构件的布局为fill_parent将强制性地使构件扩展,以填充布局单元内尽可能多的空间。这跟Windows控件的dockstyle属性大体一致。设置一个顶部布局或控件为fill_parent将强制性让它布满整个屏幕。

2) wrap_conte

- 网页自适应设计

天子之骄

htmlcss响应式设计页面自适应

网页自适应设计

网页对浏览器窗口的自适应支持变得越来越重要了。自适应响应设计更是异常火爆。再加上移动端的崛起,更是如日中天。以前为了适应不同屏幕分布率和浏览器窗口的扩大和缩小,需要设计几套css样式,用js脚本判断窗口大小,选择加载。结构臃肿,加载负担较大。现笔者经过一定时间的学习,有所心得,故分享于此,加强交流,共同进步。同时希望对大家有所

- [sql server] 分组取最大最小常用sql

一炮送你回车库

SQL Server

--分组取最大最小常用sql--测试环境if OBJECT_ID('tb') is not null drop table tb;gocreate table tb( col1 int, col2 int, Fcount int)insert into tbselect 11,20,1 union allselect 11,22,1 union allselect 1

- ImageIO写图片输出到硬盘

3213213333332132

javaimage

package awt;

import java.awt.Color;

import java.awt.Font;

import java.awt.Graphics;

import java.awt.image.BufferedImage;

import java.io.File;

import java.io.IOException;

import javax.imagei

- 自己的String动态数组

宝剑锋梅花香

java动态数组数组

数组还是好说,学过一两门编程语言的就知道,需要注意的是数组声明时需要把大小给它定下来,比如声明一个字符串类型的数组:String str[]=new String[10]; 但是问题就来了,每次都是大小确定的数组,我需要数组大小不固定随时变化怎么办呢? 动态数组就这样应运而生,龙哥给我们讲的是自己用代码写动态数组,并非用的ArrayList 看看字符

- pinyin4j工具类

darkranger

.net

pinyin4j工具类Java工具类 2010-04-24 00:47:00 阅读69 评论0 字号:大中小

引入pinyin4j-2.5.0.jar包:

pinyin4j是一个功能强悍的汉语拼音工具包,主要是从汉语获取各种格式和需求的拼音,功能强悍,下面看看如何使用pinyin4j。

本人以前用AscII编码提取工具,效果不理想,现在用pinyin4j简单实现了一个。功能还不是很完美,

- StarUML学习笔记----基本概念

aijuans

UML建模

介绍StarUML的基本概念,这些都是有效运用StarUML?所需要的。包括对模型、视图、图、项目、单元、方法、框架、模型块及其差异以及UML轮廓。

模型、视与图(Model, View and Diagram)

&

- Activiti最终总结

avords

Activiti id 工作流

1、流程定义ID:ProcessDefinitionId,当定义一个流程就会产生。

2、流程实例ID:ProcessInstanceId,当开始一个具体的流程时就会产生,也就是不同的流程实例ID可能有相同的流程定义ID。

3、TaskId,每一个userTask都会有一个Id这个是存在于流程实例上的。

4、TaskDefinitionKey和(ActivityImpl activityId

- 从省市区多重级联想到的,react和jquery的差别

bee1314

jqueryUIreact

在我们的前端项目里经常会用到级联的select,比如省市区这样。通常这种级联大多是动态的。比如先加载了省,点击省加载市,点击市加载区。然后数据通常ajax返回。如果没有数据则说明到了叶子节点。 针对这种场景,如果我们使用jquery来实现,要考虑很多的问题,数据部分,以及大量的dom操作。比如这个页面上显示了某个区,这时候我切换省,要把市重新初始化数据,然后区域的部分要从页面

- Eclipse快捷键大全

bijian1013

javaeclipse快捷键

Ctrl+1 快速修复(最经典的快捷键,就不用多说了)Ctrl+D: 删除当前行 Ctrl+Alt+↓ 复制当前行到下一行(复制增加)Ctrl+Alt+↑ 复制当前行到上一行(复制增加)Alt+↓ 当前行和下面一行交互位置(特别实用,可以省去先剪切,再粘贴了)Alt+↑ 当前行和上面一行交互位置(同上)Alt+← 前一个编辑的页面Alt+→ 下一个编辑的页面(当然是针对上面那条来说了)Alt+En

- js 笔记 函数

征客丶

JavaScript

一、函数的使用

1.1、定义函数变量

var vName = funcation(params){

}

1.2、函数的调用

函数变量的调用: vName(params);

函数定义时自发调用:(function(params){})(params);

1.3、函数中变量赋值

var a = 'a';

var ff

- 【Scala四】分析Spark源代码总结的Scala语法二

bit1129

scala

1. Some操作

在下面的代码中,使用了Some操作:if (self.partitioner == Some(partitioner)),那么Some(partitioner)表示什么含义?首先partitioner是方法combineByKey传入的变量,

Some的文档说明:

/** Class `Some[A]` represents existin

- java 匿名内部类

BlueSkator

java匿名内部类

组合优先于继承

Java的匿名类,就是提供了一个快捷方便的手段,令继承关系可以方便地变成组合关系

继承只有一个时候才能用,当你要求子类的实例可以替代父类实例的位置时才可以用继承。

在Java中内部类主要分为成员内部类、局部内部类、匿名内部类、静态内部类。

内部类不是很好理解,但说白了其实也就是一个类中还包含着另外一个类如同一个人是由大脑、肢体、器官等身体结果组成,而内部类相

- 盗版win装在MAC有害发热,苹果的东西不值得买,win应该不用

ljy325

游戏applewindowsXPOS

Mac mini 型号: MC270CH-A RMB:5,688

Apple 对windows的产品支持不好,有以下问题:

1.装完了xp,发现机身很热虽然没有运行任何程序!貌似显卡跑游戏发热一样,按照那样的发热量,那部机子损耗很大,使用寿命受到严重的影响!

2.反观安装了Mac os的展示机,发热量很小,运行了1天温度也没有那么高

&nbs

- 读《研磨设计模式》-代码笔记-生成器模式-Builder

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

/**

* 生成器模式的意图在于将一个复杂的构建与其表示相分离,使得同样的构建过程可以创建不同的表示(GoF)

* 个人理解:

* 构建一个复杂的对象,对于创建者(Builder)来说,一是要有数据来源(rawData),二是要返回构

- JIRA与SVN插件安装

chenyu19891124

SVNjira

JIRA安装好后提交代码并要显示在JIRA上,这得需要用SVN的插件才能看见开发人员提交的代码。

1.下载svn与jira插件安装包,解压后在安装包(atlassian-jira-subversion-plugin-0.10.1)

2.解压出来的包里下的lib文件夹下的jar拷贝到(C:\Program Files\Atlassian\JIRA 4.3.4\atlassian-jira\WEB

- 常用数学思想方法

comsci

工作

对于搞工程和技术的朋友来讲,在工作中常常遇到一些实际问题,而采用常规的思维方式无法很好的解决这些问题,那么这个时候我们就需要用数学语言和数学工具,而使用数学工具的前提却是用数学思想的方法来描述问题。。下面转帖几种常用的数学思想方法,仅供学习和参考

函数思想

把某一数学问题用函数表示出来,并且利用函数探究这个问题的一般规律。这是最基本、最常用的数学方法

- pl/sql集合类型

daizj

oracle集合typepl/sql

--集合类型

/*

单行单列的数据,使用标量变量

单行多列数据,使用记录

单列多行数据,使用集合(。。。)

*集合:类似于数组也就是。pl/sql集合类型包括索引表(pl/sql table)、嵌套表(Nested Table)、变长数组(VARRAY)等

*/

/*

--集合方法

&n

- [Ofbiz]ofbiz初用

dinguangx

电商ofbiz

从github下载最新的ofbiz(截止2015-7-13),从源码进行ofbiz的试用

1. 加载测试库

ofbiz内置derby,通过下面的命令初始化测试库

./ant load-demo (与load-seed有一些区别)

2. 启动内置tomcat

./ant start

或

./startofbiz.sh

或

java -jar ofbiz.jar

&

- 结构体中最后一个元素是长度为0的数组

dcj3sjt126com

cgcc

在Linux源代码中,有很多的结构体最后都定义了一个元素个数为0个的数组,如/usr/include/linux/if_pppox.h中有这样一个结构体: struct pppoe_tag { __u16 tag_type; __u16 tag_len; &n

- Linux cp 实现强行覆盖

dcj3sjt126com

linux

发现在Fedora 10 /ubutun 里面用cp -fr src dest,即使加了-f也是不能强行覆盖的,这时怎么回事的呢?一两个文件还好说,就输几个yes吧,但是要是n多文件怎么办,那还不输死人呢?下面提供三种解决办法。 方法一

我们输入alias命令,看看系统给cp起了一个什么别名。

[root@localhost ~]# aliasalias cp=’cp -i’a

- Memcached(一)、HelloWorld

frank1234

memcached

一、简介

高性能的架构离不开缓存,分布式缓存中的佼佼者当属memcached,它通过客户端将不同的key hash到不同的memcached服务器中,而获取的时候也到相同的服务器中获取,由于不需要做集群同步,也就省去了集群间同步的开销和延迟,所以它相对于ehcache等缓存来说能更好的支持分布式应用,具有更强的横向伸缩能力。

二、客户端

选择一个memcached客户端,我这里用的是memc

- Search in Rotated Sorted Array II

hcx2013

search

Follow up for "Search in Rotated Sorted Array":What if duplicates are allowed?

Would this affect the run-time complexity? How and why?

Write a function to determine if a given ta

- Spring4新特性——更好的Java泛型操作API

jinnianshilongnian

spring4generic type

Spring4新特性——泛型限定式依赖注入

Spring4新特性——核心容器的其他改进

Spring4新特性——Web开发的增强

Spring4新特性——集成Bean Validation 1.1(JSR-349)到SpringMVC

Spring4新特性——Groovy Bean定义DSL

Spring4新特性——更好的Java泛型操作API

Spring4新

- CentOS安装JDK

liuxingguome

centos

1、行卸载原来的:

[root@localhost opt]# rpm -qa | grep java

tzdata-java-2014g-1.el6.noarch

java-1.7.0-openjdk-1.7.0.65-2.5.1.2.el6_5.x86_64

java-1.6.0-openjdk-1.6.0.0-11.1.13.4.el6.x86_64

[root@localhost

- 二分搜索专题2-在有序二维数组中搜索一个元素

OpenMind

二维数组算法二分搜索

1,设二维数组p的每行每列都按照下标递增的顺序递增。

用数学语言描述如下:p满足

(1),对任意的x1,x2,y,如果x1<x2,则p(x1,y)<p(x2,y);

(2),对任意的x,y1,y2, 如果y1<y2,则p(x,y1)<p(x,y2);

2,问题:

给定满足1的数组p和一个整数k,求是否存在x0,y0使得p(x0,y0)=k?

3,算法分析:

(

- java 随机数 Math与Random

SaraWon

javaMathRandom

今天需要在程序中产生随机数,知道有两种方法可以使用,但是使用Math和Random的区别还不是特别清楚,看到一篇文章是关于的,觉得写的还挺不错的,原文地址是

http://www.oschina.net/question/157182_45274?sort=default&p=1#answers

产生1到10之间的随机数的两种实现方式:

//Math

Math.roun

- oracle创建表空间

tugn

oracle

create temporary tablespace TXSJ_TEMP

tempfile 'E:\Oracle\oradata\TXSJ_TEMP.dbf'

size 32m

autoextend on

next 32m maxsize 2048m

extent m

- 使用Java8实现自己的个性化搜索引擎

yangshangchuan

javasuperword搜索引擎java8全文检索

需要对249本软件著作实现句子级别全文检索,这些著作均为PDF文件,不使用现有的框架如lucene,自己实现的方法如下:

1、从PDF文件中提取文本,这里的重点是如何最大可能地还原文本。提取之后的文本,一个句子一行保存为文本文件。

2、将所有文本文件合并为一个单一的文本文件,这样,每一个句子就有一个唯一行号。

3、对每一行文本进行分词,建立倒排表,倒排表的格式为:词=包含该词的总行数N=行号