1)安装yum原名 https://www.gluster.org/install/

centos7 yum install centos-release-gluster

centos6 yum install xfsprogs

2)添加磁盘 格式化并挂载

# mkfs.xfs -i size=512 /dev/sdb1

# mkdir -p /bricks/brick1

# vi /etc/fstab

/dev/sdb1 /bricks/brick1 xfs defaults 0 0

# mount -a && mount

3) 安装软件

yum install glusterfs-server

4)启动

systemctl enable glusterd

systemctl start glusterd

systemctl status glusterd

5)在 swarm-manager 节点上配置,将 节点 加入到 集群中。

主节点上

# gluster peer probe server2

# gluster peer probe server1

注: 需要先做好hosts解析 或 server换成ip地址

6)创建数据目录

mkdir /bricks/brick1/gv0

7)创建逻辑磁盘

数据储存方法

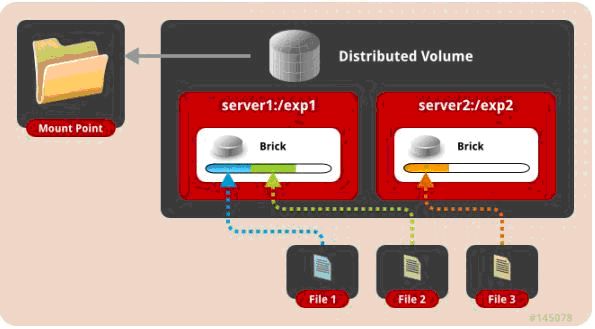

1默认模式,既DHT, 也叫 分布卷: 将文件已hash算法随机分布到 一台服务器节点中存储

gluster volume create gv0 server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0

2 复制模式,既AFR, 创建volume 时带 replica x 数量: 将文件复制到 replica x 个节点中

gluster volume create gv0 replica 2 server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0

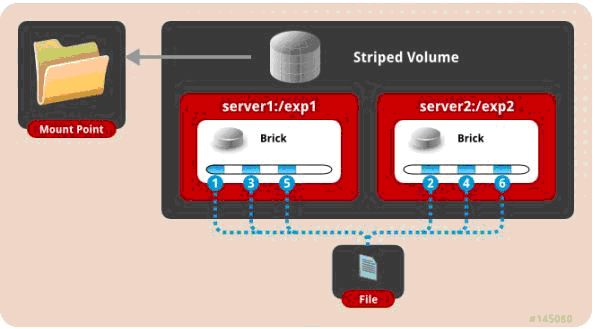

3 条带模式,既Striped, 创建volume 时带 stripe x 数量: 将文件切割成数据块,分别存储到 stripe x 个节点中 ( 类似raid 0 )

gluster volume create gv0 striped 2 server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0

4 分布式条带模式(组合型),最少需要4台服务器才能创建。 创建volume 时 stripe 2 server = 4 个节点: 是DHT 与 Striped 的组合型。

gluster volume create gv0 striped 2 transport tcp server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0 server3:/bricks/brick1/gv0 server4:/bricks/brick1/gv0

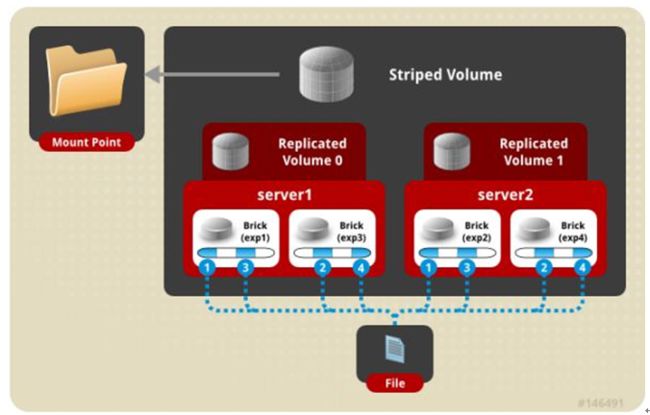

5分布式复制模式(组合型), 最少需要4台服务器才能创建。 创建volume 时 replica 2 server = 4 个节点:是DHT 与 AFR 的组合型。

gluster volume create gv0 replica 2 transport tcp server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0 server3:/bricks/brick1/gv0 server4:/bricks/brick1/gv0

6 条带复制卷模式(组合型), 最少需要4台服务器才能创建。 创建volume 时 stripe 2 replica 2 server = 4 个节点: 是 Striped 与 AFR 的组合型

gluster volume create gv0 striped 2 replica 2 transport tcp server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0 server3:/bricks/brick1/gv0 server4:/bricks/brick1/gv0

7三种模式混合, 至少需要8台 服务器才能创建。 stripe 2 replica 2 , 每4个节点 组成一个 组。

gluster volume create gv0 striped 2 replica 2 transport tcp server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0 server3:/bricks/brick1/gv0 server4:/bricks/brick1/gv0 server5:/bricks/brick1/gv0 server6:/bricks/brick1/gv0 server7:/bricks/brick1/gv0 server8:/bricks/brick1/gv0

注: 如果你把数据目录建立在根目录下 会报下面的错 可以在命令后面加上参数 orce

如: gluster volume create gv0 replica 2 server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0 force

报错内容: Replica 2 volumes are prone to split-brain. Use Arbiter or Replica 3 to avoid this. See: http://docs.gluster.org/en/latest/Administrator%20Guide/Split%20brain%20and%20ways%20to%20deal%20with%20it/.

Do you still want to continue?

(y/n) y

volume create: gv0: failed: The brick server1:/bricks/brick1/gv0 is being created in the root partition. It is recommended that you don't use the system's root partition for storage backend. Or use 'force' at the end of the command if you want to override this behavior.

gluster volume create gv0 replica 2 server1:/bricks/brick1/gv0 server2:/bricks/brick1/gv0 force

- 启动卷

gluster volume start gv0

9)查看卷

gluster volume info

gluster volume stop 卷名 停止

gluster volume delete 卷名 删除注: 删除 磁盘 以后,必须删除 磁盘( 数据目录 ) 中的 ( .glusterfs/ .trashcan/ )目录。 否则创建新 volume 相同的 磁盘 会出现文件 不分布,或者 类型 错乱 的问题。

gluster peer detach 节点名 删除节点

。

添加GlusterFS节点:

gluster peer probe swarm-node-3

gluster volume add-brick models swarm-node-3:/opt/gluster/data

注:如果是复制卷或者条带卷,则每次添加的Brick数必须是replica或者stripe的整数倍

配置卷

gluster volume set

缩容volume:

先将数据迁移到其它可用的Brick,迁移结束后才将该Brick移除:

gluster volume remove-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data start

在执行了start之后,可以使用status命令查看移除进度:

gluster volume remove-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data status

不进行数据迁移,直接删除该Brick:

gluster volume remove-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data commit

注意,如果是复制卷或者条带卷,则每次移除的Brick数必须是replica或者stripe的整数倍。

扩容:

gluster volume add-brick models swarm-node-2:/opt/gluster/data

修复命令:

gluster volume replace-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data commit -force

迁移volume:

gluster volume replace-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data start

pause 为暂停迁移

gluster volume replace-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data pause

abort 为终止迁移

gluster volume replace-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data abort

status 查看迁移状态

gluster volume replace-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data status

迁移结束后使用commit 来生效

gluster volume replace-brick models swarm-node-2:/opt/gluster/data swarm-node-3:/opt/gluster/data commit

均衡volume:

gluster volume models lay-outstart

gluster volume models start

gluster volume models startforce

gluster volume models status

gluster volume models stop

gluster 性能调优:

开启 指定 volume 的配额: (models 为 volume 名称)

gluster volume quota models enable

限制 models 中 / (既总目录) 最大使用 80GB 空间

gluster volume quota models limit-usage / 80GB

设置 cache 4GB

gluster volume set models performance.cache-size 4GB

开启 异步 , 后台操作

gluster volume set models performance.flush-behind on

设置 io 线程 32

gluster volume set models performance.io-thread-count 32

设置 回写 (写数据时间,先写入缓存内,再写入硬盘)

gluster volume set models performance.write-behind on

部署GlusterFS客户端并mount GlusterFS文件系统 (客户端必须加入 glusterfs hosts 否则报错。)

yum install -y glusterfs glusterfs-fuse

mkdir -p /opt/gfsmnt

mount -t glusterfs swarm-manager:models /opt/gfsmnt/

确认挂载结果:

mount -t fuse.glusterfs

查看卷

gluster volume list /列出集群中的所有卷/

gluster volume info [all] /查看集群中的卷信息/

gluster volume status [all] /查看集群中的卷状态/

更改卷类型

1.需要先卸载挂载的目录

umount /mnt

2.停止卷

3.更改卷的类型

语法:gluster volume set test-volume config.transport tcp,rdma OR tcp OR rdma

例子:

重新均衡卷

语法:gluster volume rebalance

例子:gluster volume rebalance test-volume fix-layout start