五分钟示范“教会”演员说外语,还可无缝切换语种,这家AI配音公司刚获2000万美元A轮融资...

行早 发自 凹非寺

量子位 | 公众号 QbitAI

只需要演员五分钟的声音素材,就可以让他在电影里说另外一种语言?

在没看到这段视频之前我是不相信的,来听听这段效果如何:

这段视频取自《博多之子》(英文名Every Time I Die),是一部英文惊悚片。

但是我们在播放中可以看到,只需要一键点击,就可以在任意时刻把英语转换为西班牙语,并且听起来还是原演员的声音。

连说话中惊恐、颤抖的细节也忠实地继承了下来,给我们展示了一把AI配音的神奇力量。

当然,这波操作也不出意外地打动了许多投资人。

制作这段内容的公司Deepdub (深度配音),最近就在A轮融资中拿到了2000万美元。投资人中还包括福克斯电视工作室前总裁、Snyk的联合创始人、Meta的工程副总裁等。

AI配音冲击传统模式

AI 配音何以这么受期待呢?因为这其中蕴含了巨大的商机。

要知道,像在美国等地的英语观众是没有看字幕的习惯的。因此,面对一些非英语的优秀作品,他们有很强的本土化需求,也就是英文配音版本。

例如前段时间爆火的韩剧《鱿鱼游戏》,在首映28天内,总观看时间就达到16.5亿小时,加起来相当于18.2万年。一举成为Netflix史上排名第一的节目。

可是这么大一块蛋糕,从传统的角度来说,吃起来却相当费劲。

△图注:《鱿鱼游戏》播放量,右栏第一排

例如,本地的发行商得花钱翻译剧本吧,得聘请配音演员扮演角色、租场地设备、完成大量的配音录制吧,最后还要把配音拼接到原视频中。

这里面还面临着很多文化差异。

这一套下来,按照行情怎么说也要15-20周。

而Deepdub的AI配音方法只需要原演员录制五分钟的随机文本,让神经网络学习演员的声音然后用另一种语言表达出来。

听起来就像原演员学会了另一种语言,并且时间上只用四周就可以完成相同的工作量,包括翻译、改编、混音等过程。

在技术细节方面,Deepdub没有公开太多,或许可以用在GitHub上大火的Mocking Bird做参考。

只需要五秒钟,就可以克隆任意的中文语音,再用同一音色合成其他语音内容,实现从语音到文本再到语音的过程。

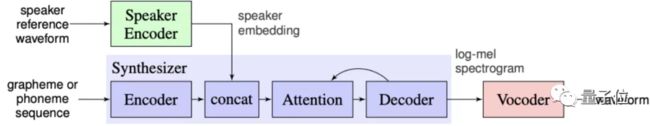

模型结构主要由说话人编码器(Speaker encoder)、合成器(Synthesizer)和声码器(Vocoder)组成。

其中说话人编码器(绿色)负责提取说话人语音的特征向量,学习音色。

然后再执行传统的TTS(Text-to-Speech)环节:

在合成器(蓝色)中把语音特征融入指定文本,以梅尔频谱为中间变量,将生成的语音频谱传给声码器(红色)。

最后使用深度自回归模型WaveNet作为声码器,用频谱生成最终的语音。

不过,Deepdub虽没有透露自己的技术细节,但是他们声称已经在这个学术研究领域处于领先地位。

这么说也是有些可信度的,从他们的产品、获得的投资和兄弟创始人背景中也能看出来:

弟弟Nir Krakowski有25年的专业研发经验,哥哥Ofir Krakowski还曾在以色列空军机器学习部门任职……

AI配音赛道多家竞速

当然,看上这块市场的也不止Deepdub一家,只是策略上有些不同。

Deepdub走的是修改音频的路,视频内容原封不动。他们打算将用这轮融资的钱扩充团队的营销、研究和工程部门,并且正在和好莱坞谈合作。

英国公司Papercup采取的方法和Deepdub类似,也是专注于音频,通过机翻重新部署原演员的声音,使用合成声,保持视频不变。

而另一家Flawless在音频上还依靠配音演员,但是会编辑视频中的人脸和口型,看起来更像是在说目标语言。

像其他的,还有亚马逊等科技巨头也在做相关的研究,但是现在还没有产品出来。

这么看来,或许我们将来真的可以造出视频界的“巴别塔”,在网剧这块做到无障碍交流。

又或者,某些个别演员真的不用背台词了?

参考链接:

[1]https://techcrunch.com/2022/02/10/deepdub-raises-20m-for-a-i-powered-dubbing-that-uses-actors-original-voices/

[2]https://venturebeat.com/2022/02/10/deepdub-closes-fresh-financing-round-for-ai-that-dubs-movies-shows-and-games/