特征增强SSD算法及其在遥感目标检测中的应用——史文旭

论文阅读笔记

摘要

- 对SSD的金字塔特征层中的浅层网络设计浅层特征增强模块,以提高浅层网络对小目标物体的特征提取能力;

- 设计深层特征融合模块,替换SSD金字塔特征层中的深层网络,提高深层网络的特征提取能力;

- 将提取的图像特征与不同纵横比的候选框进行匹配以执行不同尺度遥感图像目标检测与定位。

0. 引言

- 反卷积单发检测网络算法(DSSD)(DSSD: Deconvolutional single shot detector)

- 多尺度单发射击检测增强算法(ESSD)(An enhanced SSD with feature fusion and visual reasoning for object detection)

- 多尺度单发射击检测特征融合算法(FFSSD)(13)

- 文献Improved SSD algorithm and its performance analysis of small target detection in remote sensing images基于SSD算法并参考DenseNet网络(title: Densely connected convolutional networks)和特征金字塔(FPN)网络提出改进SSD算法并对遥感图像进行检测,该算法一定程度上提高了遥感图像目标检测的精度,但难以满足实时应用的需求;

- 文献Fast airplane detection incorporating multi-layer features offully convolutional Networks,全卷积网络多层特征融合的飞机快速检测和 End-to-end airplane detection using transfer learning in remote sensing images基于SSD算法提出了基于多尺度卷积神经网络的飞机目标检测算法,提高了遥感图像中的多尺度飞机目标的检测精度,但检测速度大幅降低,同时该方法对小目标的检测精度较差。

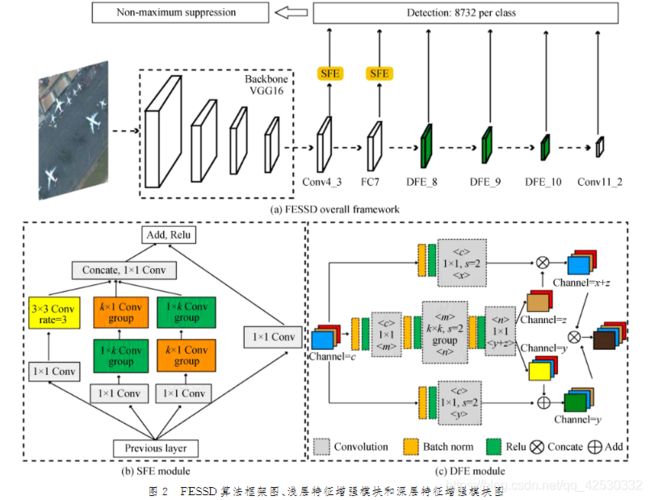

提出了一种特征增强的SSD算法(FESSD),

- 设计浅层特征增强模块(SFE),通过多分支卷积操作充分提取浅层网络特征,增强浅层网络对遥感图像小目标的特征提取能力;

- 设计深层特征增强模块(DFE),利用双路径网络提取高深层网络对遥感图像目标的特征提取能力;

- 设计新的损失函数,提高网络检测性能。

1. 特征增强SSD算法(FESSD)

1.1 SSD算法

浅层网络:Conv4_3, FC7;

深层网络:Conv8_2, Conv9_2, Conv10_2, Conv11_2;

1.2 FESSD算法

- 参考多分支卷积

Inception(title: Going deeper with convolutions)操作和残差网络ResNet(tiltle: Deep residual learning for image recognition)的思想设计浅层特征增强模块(SFE)对Conv4_3、FC7层进行特征增强操作; - 参考

Dual Path Network(title: Dual path networks)的思想,设计深层特征增强模块(DFE)替换原始SSD算法中的Conv8_2、Conv9_2、Conv10_2、Conv11_2,并命名为DFE_8、DFE_9、DFE_10; - 将上述得到的不同尺度的特征送入检测网络,与不同纵横比的候选框进行匹配以适应不同尺度大小的遥感图像目标,并通过NMS操作进行优化处理

两处改进模块SFE和DFE:

- SFE:基于多分支卷积操作的思想,使用 1 × 1 , 3 × 3 1 \times 1, 3 \times 3 1×1,3×3的卷积使得网络学习到更多的非线性关系的同时结合残差网络和空洞卷积使网络捕获更多的特征信息,拓宽特征的感受野,此外将 k × k k \times k k×k卷积分解为 k × 1 k \times 1 k×1和 1 × k 1 \times k 1×k,在保证感受野大小不变的同时使用分组卷积操作,节省该模块消耗的时间,另一分支的不同之处在于将 k × 1 k \times 1 k×1和 1 × k 1 \times k 1×k卷积反向组合,将得到的特征结果进行

Concate特征融合操作并与残差分支的 1 × 1 1 \times 1 1×1卷积结果进行Add特征融合操作。 - DFE:基于

Dual Path Network的思想,并结合残差网络ResNet和密集网络DenseNet对特征提取的特点,不仅深化了整个网络,而且具有从浅层到深层的隐式的特征融合,使得深层网络的特征信息更加丰富,同时使用分组卷积加快模块特征处理效率。

1.3 候选框选择与损失函数

为实现对遥感图像中不同尺度的目标进行检测,设计不同纵横比的候选框进行匹配以适应不同尺度大小的遥感图像目标,假设选取 m m m个层的卷积特征用于目标,则第 i i i层的特征图候选框尺寸为

S i = S m i n + S m a x − S m i n m − 1 ( i − 1 ) i ∈ [ 1 , m ] S_i = S_{min} + \frac {S_{max} - S_{min}}{m-1}(i-1) \quad \quad \quad i \in [1, m] Si=Smin+m−1Smax−Smin(i−1)i∈[1,m]

式中, S m i n S_{min} Smin和 S m a x S_{max} Smax分别取值为 0.2 0.2 0.2和 0.95 0.95 0.95,表示浅层和深层的候选框与特征图的尺度系数,候选框的宽和高的比取值为 a r ∈ { 1 , 2 , 3 , 1 / 2 , 1 / 3 } a_r \in \{ 1, 2, 3, 1/2, 1/3 \} ar∈{1,2,3,1/2,1/3},则候选框的宽度为 w i = S i ⋅ a r w_i = S_i \cdot \sqrt{a_r} wi=Si⋅ar,候选框的高为 h i = S i / a r h_i = S_i / \sqrt{a_r} hi=Si/ar,候选框的中心坐标为 ( i + 0.5 ∣ f k ∣ , j + 0.5 ∣ f k ∣ ) (\frac {i+0.5}{|f_k|}, \frac {j+0.5}{|f_k|}) (∣fk∣i+0.5,∣fk∣j+0.5), i , j ∈ [ 0 , ∣ f k ∣ ] i, j \in [0, |f_k|] i,j∈[0,∣fk∣],其中 ∣ f k ∣ |f_k| ∣fk∣表示第 k k k个特征的尺寸。

此外,针对模型训练过程中遥感图像正、负样本划分不平衡导致模型退化的问题,本文在SSD算法损失函数的基础上结合聚焦分类损失函数对模型进行优化训练,表示为

L ( x , c , p , l , g ) = 1 N [ L f 1 ( x , c , p ) + a L l o c ( x , l , g ) ] L(x, c, p, l, g) = \frac {1}{N} [L_{f1}(x, c, p) + aL_{loc}(x, l, g)] L(x,c,p,l,g)=N1[Lf1(x,c,p)+aLloc(x,l,g)]

式中, N N N表示与真实框相匹配的候选框的个数, x x x为输入图像, c c c为目标类别, p p p为预测类别概率, l l l为候选框, g g g代表真实的标签框, a a a为两者的权重, L f 1 ( x , c , p ) L_{f1}(x, c, p) Lf1(x,c,p)和 L l o c ( x , l , g ) L_{loc}(x, l, g) Lloc(x,l,g)分别为聚焦分类损失和边框回归损失。其中, L l o c ( x , l , g ) L_{loc}(x, l, g) Lloc(x,l,g)借鉴了Faster R-CNN的位置回归函数,表示为

L l o c ( x , l , g ) = ∑ i ∈ P o s N ∑ m ∈ c x , c y , w , h x i j k s m o o t h L 1 ( l i m − g j m ) L_{loc}(x, l, g) = \sum \limits ^{N} _{i \in Pos} \sum \limits _{m \in {c_x, c_y, w, h}} x^{k}_{ij} smooth_{L_1}(l^m _i - g ^m _j) Lloc(x,l,g)=i∈Pos∑Nm∈cx,cy,w,h∑xijksmoothL1(lim−gjm)

式中, x i j k x^{k}_{ij} xijk代表针对类别 k k k,第 i i i个候选框与第 j j j个真实框的结果是否保持一致,若一致则取值为1,否则取值为0. l i m l ^m _i lim表示候选框的值, g j m g ^m _j gjm为真实框的值。

L f 1 ( x , c , p ) L_{f1}(x, c, p) Lf1(x,c,p)结合聚焦分类损失函数采用交叉熵计算损失,表示为

L f 1 ( x , c , p ) = − ∑ i ∈ P o s N x i j k p l o g ( c i k ) − ∑ i ∈ n e g ( 1 − p ) l o g ( c j 0 ) L_{f1}(x, c, p) = - \sum \limits ^N _{i \in Pos} x^k _{ij} p log(c ^k _i) - \sum \limits _{i \in neg}(1-p)log(c ^0 _j) Lf1(x,c,p)=−i∈Pos∑Nxijkplog(cik)−i∈neg∑(1−p)log(cj0)

式中, c j 0 c ^0 _j cj0代表正确且类别为背景预测框的概率, c i k c ^k _i cik为利用Softmax函数计算的概率值。