- 良心高效的记单词软件

d6863d4a4904

墨墨背单词(名字千万别弄错了!)这款帮助大家学习英语单词的软件,相信很多学习党小伙伴们或者身边的同学都会有使用过的,尤其是在加深单词记忆方面,根据同学们每天对所学单词的熟练或者模糊程度,结合了艾宾浩斯的遗忘曲线,根据时间长短来不断复现,坚持使用的话效果很不错噢!以下内容均为本人(一名不知名的考研党)亲测。大家要是想加强英语词汇量一定要试试啊!强推背单词软件!!首先是app签到页面,这个页面只有你每

- 2021-06-04 不吼不叫如何调动孩子的主动性

天下谁人不读书

爸爸妈妈都有过这样的经验,叫孩子吃饭,三请四请都不动;让他去洗澡,东摸摸西看看,就是不去洗;要他去读书学习,更是这翻翻那弄弄,导致父母不得不靠吼叫的高压手段才会起点作用。父母和孩子的目标有着巨大的差距,当他不饿,不想洗澡,不愿读书写字的时候,内心是抗拒的,因为他只会想那是父母要他去做,而不是自己想去做的事。日常对孩子教育,就像推一个木偶,推一下动一下,每天的生活就是父母一直在重复吼叫、催促、唠叨教

- 红场

小霞老师mn

曼宁妈妈,晚上好。⊙∀⊙!这节课主要学习了红场,介绍了俄罗斯的首都莫斯科的中心广场红场及一些著名的建筑,如克里姆林宫等,用线描去表现装饰。这幅画还没有结束,曼宁说很喜欢俄罗斯的天空,下节课还会抽半小时,带着她把颜色上了。曼宁的学习状态很好,整节课都很认真,速度也很快。下次要注意一下画面的整洁性,线条再干净一点点就完美了。继续加油(^ω^)

- 讚(232-0857)|智能方法练习王羲之的《圣教序》(硬笔)|每日精进

开心练字

所谓取法乎上,学习行书自然要学习书圣王羲之,而学书圣行书的最佳入门途径是学习和练习《圣教序》,毛笔如此,硬笔亦如此。几种常见形态比较image《圣教序》的特色言字旁极度夸张的拉开上下距离为全字增加了一丝“动感”。开心指数欣赏指数:★★★★☆易写指数:★★★☆☆实用指数:★★☆☆☆行笔路线(笔顺)image行笔路线如图:行楷的结构特征image形体(整体视野)左右视角——左低右高:整体呈斜的“行”书

- 2020-12-30

c5d317597ea8

20201230智慧父母课堂李艳坚持分享第4天今天我们学习了《古人谈读书》这篇文章,古人就告诉我们了读书的方法及读书的三到,即心到、眼到、口到。难怪一些学生读书爱加字,缺字主要是没有用心,今后要告诉他们读书的时候一定要用心。在今后的学习中三到都要用到,这样才能提高成绩。

- 2019-03-12

黄侠_美兮妈

【美兮修能】20190312识字营009期D110(学习力践行记录D499)早上读了《民国老课本》第121课,看了《森林里的小房子》,读了一本牛津树《Thejourey》。图片发自App下午从幼儿园回来的路上背了《望庐山瀑布》《瀑布》。晚饭后上外教课,玩得很开心。图片发自App然后和小伙伴一起做实验,熔岩大爆发、颜色变变变和彩虹糖水。图片发自App然后他们一起玩颜色。又拼了小猪佩奇的拼图。图片发自

- 我的90天PPT修行历程

舞动_Echo

大家好,我是PPT营销力50期超越梦想最666组的黄玉丽看到我的名字你们应该能感受到我本是软妹子But,你们知道吗~提前嘚瑟一下我居然打卡了一次线下演讲秀的总统筹这其中的飞跃让我忍不住回过头看看自己究竟做了什么起源自工作以来,一直在修炼自己负责公司对外分享的PPT一次成功的商业分享不仅需要演讲者本身的能力更需要ppt视觉传达力的冲击在PPT学习道路上一直孤军奋战自学过程中水平持续保持稳定因此一直在

- 微服务网站开发学习路线与RuoYi-Cloud实战指南

你喜欢喝可乐吗?

ruoyi-cloudmicroservicesjavaweb微服务学习运维

微服务网站开发学习路线与RuoYi-Cloud实战指南微服务架构已成为现代网站开发的主流选择,它通过将大型应用拆分为小型自治服务,实现了系统的高内聚、低耦合、独立部署和扩展。掌握微服务开发技能需要系统性学习,从基础概念到技术栈再到实战应用。本文将为您提供从零开始学习微服务的完整路线图,并结合RuoYi-Cloud开源框架进行详细举例,帮助您快速上手微服务网站开发。一、微服务基础概念与架构特点微服务

- 我明明是老师,“病毒”把我变成了主播。

顾若_

我明明是老师,“病毒”把我变成了主播。或许这是资历较深的老师们第一次成为“主播”;或许这是刚刚步入教师职位的年轻教师第一次网上授课;或许都有所不习惯,甚至家长也可能不适应学生在家中学习。早有很多的app都有线上教学,如小猿搜题、作业帮、线上名师讲课E网通等等。这次的疫情,使得全国中小学、高中、乃至大学生都是在网上开展教学工作,还有一些企业也将在网上进行办公~~对于学生网上学习、教师网上办公、授课、

- 学习中

田慧婷

坚持打卡记录第98天今天期中考试成绩全部出来,孩子们考的不太理想,不过高分的还是可以的,全校前200名占了6个,好了太多!两级分化太严重!

- 初见:冬天开的猫印象

繁星月影

跟随着八月的雨的足迹,邂逅了一只优秀博学的猫。于辛丑年甲午月壬辰日晚,与友冬天开的猫初见,缘于友八月的雨文理解是一门艺术中的评论。由于这段对话,我也很好奇啊,于是我也去见识见识这脑洞大开想象力丰富的人儿,悄悄的关注一下,向优秀的友学习,打算悄悄的去膜拜友的文。猫姐姐,在这看不出年龄距离,看大家都这样称呼,感觉比较亲切。之前猫的签名“你好,我这有些故事”,正好我也是喜欢看故事的人,喜欢听故事。后来签

- 精进打卡1209

我怕我忘记你_6e63

【每日精进打卡第319天】姓名:张晓雪公司:淮安市金鸡喜满堂食品有限公司349期六项精进(南京)乐观二组学员一.【知-学习】10.《活法》9.诵读《六项精进》通篇1遍,共230遍;8.诵读《大学》1遍,共230遍;7.诵读《六项精进》大纲共101遍;6.诵读《大学》开篇译文共95遍;5.诵读《王门四句教》共89遍;4.诵读《立志篇》共91遍;3.诵读《经营与会计》共3遍;2.诵读《京瓷哲学》共2遍

- 日精进109天

金八力韩英雪

敬爱的老师,智慧的班主任,亲爱的跃友们:大家好!我是来自山峰教外教育的韩英雪,今天是我的日精进行动第109天,给大家分享我今天的进步,我们互相勉励,携手前行。每天进步一点点,距离成功便不远。1、比学习:教育的人口功能:一,减少人口数量,控制人口增长。二,改善人口素质提高人口质量。三是人口结构趋向合理化。四有利于人口迁移。社会政治经济制度对教育的影响和制约,决定教育的领导权,决定受教育权决定教育目的

- 我喜欢你,像风走了八百里,不问归期

简冉的生活日记

1缘分来源于他的撩骚和我的一见钟情我们认识的时候完全是两种性格的人,在和沙沙在一起前,我觉得我和这样的人是一辈子都不会有交集。那年我刚上大一,对大学生活充满好奇。沙沙大二,已经开始厌倦学校。我虽然学习不太好,可是还是乖乖的在上课。沙沙也学习不好,可是整天往学校外面跑。我妆画的有点浓,爱穿漂亮衣服,可是从不乱处朋友。沙沙打扮社会,爱穿热血高校那样的外套,乱七八糟的朋友一大堆。我会去酒吧,会喝点酒,可

- 私信回复 | 非英专翻译新手如何入行?有多难?

福州翻译Ivy

收到了一条写得清清楚楚的私信:我是今年的应届毕业生,本科经济学跨考了语言学,毕业前跟你一样签了一家大公司的市场岗,实习了几个月,也纠结了几个月,最终在签劳动合同前离职了。一是觉得公司带教机制不完善不利职业成长,二是纠结于千辛万苦为了热爱而跨考的语言专业会逐渐丢弃(日日加班打破了我业余做点翻译的幻想)。过去的整个七月,我想了很多也看了很多资料,最终还是决定做口笔译。但我研究生学习的是偏理论的语言学,

- 2022-12-26

胡诌文学

今天看到一个人发了文章说不再买书了,这是时代的悲哀,也是时代的幸运,以前,知识就像是一个象牙塔,虽说事事洞明皆学问,但躲不过黄金屋的书籍,但是现在,知识扩散越来越明显,我们只要有心,就可学习,不必纠结于书

- Kubernetes学习笔记(四)--Pod 状态与生命周期管理

Mr小三

Kubernetes云原生kubernetes

文章目录四、Pod状态与生命周期管理1.Pod概念网络存储用法pod的终止2.Init容器init模板用途3.Pause容器4.Pod的生命周期Podphase(阶段)Pod状态5.Pod健康-容器探针(Probe)概念EXEC探针HTTP探针TCPSocket探针四、Pod状态与生命周期管理Pod是kubernetes中最重要的基本概念,在kubernetes中最小的管理元素不是一个个独立的容器

- 仓库货物检测:基于YOLOv5的深度学习应用与UI界面开发

YOLO实战营

YOLO深度学习ui目标跟踪目标检测人工智能

一、引言随着电商和物流行业的快速发展,仓库货物管理已经成为企业运营中至关重要的环节。为了提高仓库管理的效率和准确性,越来越多的企业开始应用自动化技术来完成货物的盘点、分类、分拣等任务。传统的货物管理方式通常依赖人工检查,不仅效率低下,而且容易出现误差。为了克服这些问题,利用计算机视觉和深度学习技术来实现仓库货物的自动化检测成为了一种有效的解决方案。本博客将介绍如何使用YOLOv5进行仓库货物检测,

- 2021-5-11晨间日记

飞翔_8019

今天是什么日子起床:7:05就寝:23:32天气:晴天心情:好纪念日:昨天跟闺蜜聊天一个多小时叫我起床的不是闹钟是梦想年度目标及关键点:财富自由本月重要成果:理财投资学习今日三只青蛙/番茄钟1.读书2.日更文章成功日志-记录三五件有收获的事务1.不能自己欺骗自己,要实事求是能做多少,不能做多少,为什么做不了,要分析原因。不能太迁就自己。2.自己最近做事效率不高。要想办法提高效率。3.规定自己什么时

- KL散度:信息差异的量化标尺 | 从概率分布对齐到模型优化的核心度量

不对称性、计算本质与机器学习的普适应用本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!一、核心定义与数学本质KL散度(Kullback-LeiblerDivergence)用于衡量两个概率分布PPP和QQQ的差异程度,定义为:DKL(P∥Q)=∑x∈XP(x)logP(x)Q(x)(离散形式)D_

- 亲子日记第九天

康靖祺姑姑

2018年4月6日星期五天气阴转多云今天晚上吃过饭,问了康靖祺一些昨天作业上的知识,掌握的不是很好。这个学期开学以后数学学习直接下降了,两次都是80多,按理来说不应该这样。放假前发了一张试卷,出错率很高,有的直接没看懂题直接乱写,还有就是直接不会。今晚我问了一个15+15都答错了。他二姑姑还说早上说话口气太不行了,直接让他二姑姑闭嘴,我一听这话我就想起他妈妈训他的时候,除了闭嘴就是滚一边。家长是孩

- Transformer:自注意力驱动的神经网络革命引擎

大千AI助手

人工智能Python#OTHERtransformer神经网络深度学习google人工智能机器学习大模型

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!从语言理解到多模态智能的通用架构基石⚙️一、核心定义与历史意义Transformer是由Google团队在2017年论文《AttentionIsAllYouNeed》中提出的深度学习架构,其颠覆性创新在于:完全摒弃RNN/CNN:仅依赖自注意力机制(S

- [特殊字符] LLM(大型语言模型):智能时代的语言引擎与通用推理基座

大千AI助手

人工智能Python#OTHER语言模型人工智能自然语言处理LLM大模型Transformer

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!从千亿参数到人类认知的AI革命一、核心定义与核心特征LLM(LargeLanguageModel)是基于海量文本数据训练的深度学习模型,通过神经网络架构(尤其是Transformer)模拟人类语言的复杂规律,实现文本理解、生成与推理任务。其核心特征可概

- MAP最大后验估计:贝叶斯决策的优化引擎

大千AI助手

人工智能Python#OTHERpython人工智能算法贝叶斯MAP概率论条件概率

融合先验知识与观测数据的概率推断方法本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!一、核心概念与数学本质MAP(MaximumAPosteriori)估计是贝叶斯框架下的参数估计方法,其目标为:最大化后验概率(P(\theta\midX)),即:[\hat{\theta}{MAP}=\arg\ma

- MLE最大似然估计:数据驱动的概率模型参数推断基石

大千AI助手

人工智能Python#OTHER数据挖掘人工智能机器学习算法MLE参数估计概率论

从样本中还原未知分布的本质规律本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!一、核心思想与数学定义最大似然估计(MaximumLikelihoodEstimation,MLE)是频率学派的参数估计方法,其核心思想为:选择使观测数据出现概率最大的参数值。给定独立同分布样本X={x1,x2,…,xn}

- HTML+CSS制作人物介绍网页

Kyra17

html5css

*仅作个人学习记录用*网页效果视频演示代码实现HTML部分角色简介角色故事技能介绍艾尔海森「诲韬诤言」「文弱的学术分子」米哈游出品的游戏《原神》及其衍生作品中的角色,须弥教令院六大学派之一“知论派”的学者,现任教令院书记官兼任代理贤者,有过人的智慧与才能,生活得自由自在,一般人基本找不到他。在须弥的风波结束,虚空系统关闭之后,教令院还有很多亟待解决的难题。而艾尔海森身为代理贤者,又是当前教令院中非

- 理财学习复盘(1)

媛小医

五月,我的关键词——理财五月,我给自己设立了一个目标,就是学习理财。想理财这件事已经酝酿很久,自己也有意识的去接触,终于在这个月正式提上日程。原因很简单:缺钱自从背上房奴的包袱后,又一直不肯增加父母的养老负担,只能一个人默默的抗下。还款日在工资日前两天,意味着每个月工资到账要小心翼翼的计算着,不要花超了,否则月底没钱还款了。这样揪心的日子过了几个月,完全崩溃了!不敢去逛街、不敢去下馆子、不敢去计划

- 2021-08-10:误判的心理——查理·芒格对人类心理学研究所在 [1]

会说话的河马

昨天谈到盲点很难发现,涉及了一点人的心理。今天想了想,想停下来稍微来聊一下人复杂的心理。心理学其实是一门实证主义的学科,并不是很多人理解伪科学。同时心理学确又是不断在自我颠覆的学科,很多今天人理解的心理学现象的解释,已经经历过很多个理论或版本的演绎了。因为工作关系,需要学习心理学。不是专业学这个的门外汉要学一点专业性很强的学科,总是避免不要要找大众读物来科普自己。在汗牛充栋的心理学大厦门前,我拜读

- 思途html学习 0717

Asu5202

html学习前端

1.HTML基础概述HTML定义:超文本标记语言(HyperTextMarkupLanguage),用于创建网页结构。“超文本”指支持嵌入图像、音频、视频和脚本等非文本内容。编辑器推荐:VSCode、HBuilderX或IDEA都很实用。安装VSCode后,添加LiveServer插件(通过Extensions搜索安装),能实现实时预览网页(快捷键:Ctrl+S保存后自动刷新)。核心特性:空白处理

- 思途JAVA学习0716

Asu5202

javaidea

1.环境设置Java开发需要安装JDK(JavaDevelopmentKit),它包含JRE(JavaRuntimeEnvironment)和开发工具。设置环境变量是关键步骤:JAVA_HOME:指向JDK安装目录,例如C:\ProgramFiles\Java\jdk-21。Path:添加%JAVA_HOME%\bin,以便在命令行中直接使用java和javac命令。验证安装:在命令行输入java

- PHP,安卓,UI,java,linux视频教程合集

cocos2d-x小菜

javaUIPHPandroidlinux

╔-----------------------------------╗┆

- 各表中的列名必须唯一。在表 'dbo.XXX' 中多次指定了列名 'XXX'。

bozch

.net.net mvc

在.net mvc5中,在执行某一操作的时候,出现了如下错误:

各表中的列名必须唯一。在表 'dbo.XXX' 中多次指定了列名 'XXX'。

经查询当前的操作与错误内容无关,经过对错误信息的排查发现,事故出现在数据库迁移上。

回想过去: 在迁移之前已经对数据库进行了添加字段操作,再次进行迁移插入XXX字段的时候,就会提示如上错误。

&

- Java 对象大小的计算

e200702084

java

Java对象的大小

如何计算一个对象的大小呢?

- Mybatis Spring

171815164

mybatis

ApplicationContext ac = new ClassPathXmlApplicationContext("applicationContext.xml");

CustomerService userService = (CustomerService) ac.getBean("customerService");

Customer cust

- JVM 不稳定参数

g21121

jvm

-XX 参数被称为不稳定参数,之所以这么叫是因为此类参数的设置很容易引起JVM 性能上的差异,使JVM 存在极大的不稳定性。当然这是在非合理设置的前提下,如果此类参数设置合理讲大大提高JVM 的性能及稳定性。 可以说“不稳定参数”

- 用户自动登录网站

永夜-极光

用户

1.目标:实现用户登录后,再次登录就自动登录,无需用户名和密码

2.思路:将用户的信息保存为cookie

每次用户访问网站,通过filter拦截所有请求,在filter中读取所有的cookie,如果找到了保存登录信息的cookie,那么在cookie中读取登录信息,然后直接

- centos7 安装后失去win7的引导记录

程序员是怎么炼成的

操作系统

1.使用root身份(必须)打开 /boot/grub2/grub.cfg 2.找到 ### BEGIN /etc/grub.d/30_os-prober ### 在后面添加 menuentry "Windows 7 (loader) (on /dev/sda1)" {

- Oracle 10g 官方中文安装帮助文档以及Oracle官方中文教程文档下载

aijuans

oracle

Oracle 10g 官方中文安装帮助文档下载:http://download.csdn.net/tag/Oracle%E4%B8%AD%E6%96%87API%EF%BC%8COracle%E4%B8%AD%E6%96%87%E6%96%87%E6%A1%A3%EF%BC%8Coracle%E5%AD%A6%E4%B9%A0%E6%96%87%E6%A1%A3 Oracle 10g 官方中文教程

- JavaEE开源快速开发平台G4Studio_V3.2发布了

無為子

AOPoraclemysqljavaeeG4Studio

我非常高兴地宣布,今天我们最新的JavaEE开源快速开发平台G4Studio_V3.2版本已经正式发布。大家可以通过如下地址下载。

访问G4Studio网站

http://www.g4it.org

G4Studio_V3.2版本变更日志

功能新增

(1).新增了系统右下角滑出提示窗口功能。

(2).新增了文件资源的Zip压缩和解压缩

- Oracle常用的单行函数应用技巧总结

百合不是茶

日期函数转换函数(核心)数字函数通用函数(核心)字符函数

单行函数; 字符函数,数字函数,日期函数,转换函数(核心),通用函数(核心)

一:字符函数:

.UPPER(字符串) 将字符串转为大写

.LOWER (字符串) 将字符串转为小写

.INITCAP(字符串) 将首字母大写

.LENGTH (字符串) 字符串的长度

.REPLACE(字符串,'A','_') 将字符串字符A转换成_

- Mockito异常测试实例

bijian1013

java单元测试mockito

Mockito异常测试实例:

package com.bijian.study;

import static org.mockito.Mockito.mock;

import static org.mockito.Mockito.when;

import org.junit.Assert;

import org.junit.Test;

import org.mockito.

- GA与量子恒道统计

Bill_chen

JavaScript浏览器百度Google防火墙

前一阵子,统计**网址时,Google Analytics(GA) 和量子恒道统计(也称量子统计),数据有较大的偏差,仔细找相关资料研究了下,总结如下:

为何GA和量子网站统计(量子统计前身为雅虎统计)结果不同?

首先:没有一种网站统计工具能保证百分之百的准确出现该问题可能有以下几个原因:(1)不同的统计分析系统的算法机制不同;(2)统计代码放置的位置和前后

- 【Linux命令三】Top命令

bit1129

linux命令

Linux的Top命令类似于Windows的任务管理器,可以查看当前系统的运行情况,包括CPU、内存的使用情况等。如下是一个Top命令的执行结果:

top - 21:22:04 up 1 day, 23:49, 1 user, load average: 1.10, 1.66, 1.99

Tasks: 202 total, 4 running, 198 sl

- spring四种依赖注入方式

白糖_

spring

平常的java开发中,程序员在某个类中需要依赖其它类的方法,则通常是new一个依赖类再调用类实例的方法,这种开发存在的问题是new的类实例不好统一管理,spring提出了依赖注入的思想,即依赖类不由程序员实例化,而是通过spring容器帮我们new指定实例并且将实例注入到需要该对象的类中。依赖注入的另一种说法是“控制反转”,通俗的理解是:平常我们new一个实例,这个实例的控制权是我

- angular.injector

boyitech

AngularJSAngularJS API

angular.injector

描述: 创建一个injector对象, 调用injector对象的方法可以获得angular的service, 或者用来做依赖注入. 使用方法: angular.injector(modules, [strictDi]) 参数详解: Param Type Details mod

- java-同步访问一个数组Integer[10],生产者不断地往数组放入整数1000,数组满时等待;消费者不断地将数组里面的数置零,数组空时等待

bylijinnan

Integer

public class PC {

/**

* 题目:生产者-消费者。

* 同步访问一个数组Integer[10],生产者不断地往数组放入整数1000,数组满时等待;消费者不断地将数组里面的数置零,数组空时等待。

*/

private static final Integer[] val=new Integer[10];

private static

- 使用Struts2.2.1配置

Chen.H

apachespringWebxmlstruts

Struts2.2.1 需要如下 jar包: commons-fileupload-1.2.1.jar commons-io-1.3.2.jar commons-logging-1.0.4.jar freemarker-2.3.16.jar javassist-3.7.ga.jar ognl-3.0.jar spring.jar

struts2-core-2.2.1.jar struts2-sp

- [职业与教育]青春之歌

comsci

教育

每个人都有自己的青春之歌............但是我要说的却不是青春...

大家如果在自己的职业生涯没有给自己以后创业留一点点机会,仅仅凭学历和人脉关系,是难以在竞争激烈的市场中生存下去的....

&nbs

- oracle连接(join)中使用using关键字

daizj

JOINoraclesqlusing

在oracle连接(join)中使用using关键字

34. View the Exhibit and examine the structure of the ORDERS and ORDER_ITEMS tables.

Evaluate the following SQL statement:

SELECT oi.order_id, product_id, order_date

FRO

- NIO示例

daysinsun

nio

NIO服务端代码:

public class NIOServer {

private Selector selector;

public void startServer(int port) throws IOException {

ServerSocketChannel serverChannel = ServerSocketChannel.open(

- C语言学习homework1

dcj3sjt126com

chomework

0、 课堂练习做完

1、使用sizeof计算出你所知道的所有的类型占用的空间。

int x;

sizeof(x);

sizeof(int);

# include <stdio.h>

int main(void)

{

int x1;

char x2;

double x3;

float x4;

printf(&quo

- select in order by , mysql排序

dcj3sjt126com

mysql

If i select like this:

SELECT id FROM users WHERE id IN(3,4,8,1);

This by default will select users in this order

1,3,4,8,

I would like to select them in the same order that i put IN() values so:

- 页面校验-新建项目

fanxiaolong

页面校验

$(document).ready(

function() {

var flag = true;

$('#changeform').submit(function() {

var projectScValNull = true;

var s ="";

var parent_id = $("#parent_id").v

- Ehcache(02)——ehcache.xml简介

234390216

ehcacheehcache.xml简介

ehcache.xml简介

ehcache.xml文件是用来定义Ehcache的配置信息的,更准确的来说它是定义CacheManager的配置信息的。根据之前我们在《Ehcache简介》一文中对CacheManager的介绍我们知道一切Ehcache的应用都是从CacheManager开始的。在不指定配置信

- junit 4.11中三个新功能

jackyrong

java

junit 4.11中两个新增的功能,首先是注解中可以参数化,比如

import static org.junit.Assert.assertEquals;

import java.util.Arrays;

import org.junit.Test;

import org.junit.runner.RunWith;

import org.junit.runn

- 国外程序员爱用苹果Mac电脑的10大理由

php教程分享

windowsPHPunixMicrosoftperl

Mac 在国外很受欢迎,尤其是在 设计/web开发/IT 人员圈子里。普通用户喜欢 Mac 可以理解,毕竟 Mac 设计美观,简单好用,没有病毒。那么为什么专业人士也对 Mac 情有独钟呢?从个人使用经验来看我想有下面几个原因:

1、Mac OS X 是基于 Unix 的

这一点太重要了,尤其是对开发人员,至少对于我来说很重要,这意味着Unix 下一堆好用的工具都可以随手捡到。如果你是个 wi

- 位运算、异或的实际应用

wenjinglian

位运算

一. 位操作基础,用一张表描述位操作符的应用规则并详细解释。

二. 常用位操作小技巧,有判断奇偶、交换两数、变换符号、求绝对值。

三. 位操作与空间压缩,针对筛素数进行空间压缩。

&n

- weblogic部署项目出现的一些问题(持续补充中……)

Everyday都不同

weblogic部署失败

好吧,weblogic的问题确实……

问题一:

org.springframework.beans.factory.BeanDefinitionStoreException: Failed to read candidate component class: URL [zip:E:/weblogic/user_projects/domains/base_domain/serve

- tomcat7性能调优(01)

toknowme

tomcat7

Tomcat优化: 1、最大连接数最大线程等设置

<Connector port="8082" protocol="HTTP/1.1"

useBodyEncodingForURI="t

- PO VO DAO DTO BO TO概念与区别

xp9802

javaDAO设计模式bean领域模型

O/R Mapping 是 Object Relational Mapping(对象关系映射)的缩写。通俗点讲,就是将对象与关系数据库绑定,用对象来表示关系数据。在O/R Mapping的世界里,有两个基本的也是重要的东东需要了解,即VO,PO。

它们的关系应该是相互独立的,一个VO可以只是PO的部分,也可以是多个PO构成,同样也可以等同于一个PO(指的是他们的属性)。这样,PO独立出来,数据持

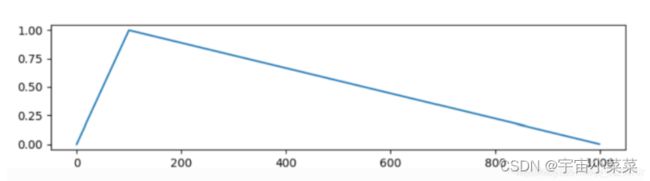

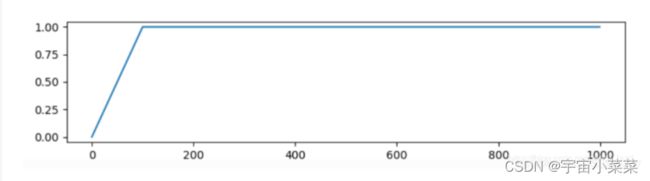

- Linear Warmup

- Linear Warmup