神经网络真实值和预测值,神经网络算法预测股票

如何人工神经网络来预测下一个数值

newff函数建立BP神经网络,历史数据作为样本,例如前n个数据作为输入,输入节点为n。当前数据作为p,输出节点为1。隐层节点根据试凑法得到。

通过matlab的train函数,得到训练好的BP神经网络。再将当前预测点的前n个数据作为输入,输出即为当前的预测值。

神经网络算法原理

4.2.1概述人工神经网络的研究与计算机的研究几乎是同步发展的A8U神经网络。

1943年心理学家McCulloch和数学家Pitts合作提出了形式神经元的数学模型,20世纪50年代末,Rosenblatt提出了感知器模型,1982年,Hopfiled引入了能量函数的概念提出了神经网络的一种数学模型,1986年,Rumelhart及LeCun等学者提出了多层感知器的反向传播算法等。

神经网络技术在众多研究者的努力下,理论上日趋完善,算法种类不断增加。目前,有关神经网络的理论研究成果很多,出版了不少有关基础理论的著作,并且现在仍是全球非线性科学研究的热点之一。

神经网络是一种通过模拟人的大脑神经结构去实现人脑智能活动功能的信息处理系统,它具有人脑的基本功能,但又不是人脑的真实写照。它是人脑的一种抽象、简化和模拟模型,故称之为人工神经网络(边肇祺,2000)。

人工神经元是神经网络的节点,是神经网络的最重要组成部分之一。目前,有关神经元的模型种类繁多,最常用最简单的模型是由阈值函数、Sigmoid函数构成的模型(图4-3)。

图4-3人工神经元与两种常见的输出函数神经网络学习及识别方法最初是借鉴人脑神经元的学习识别过程提出的。

输入参数好比神经元接收信号,通过一定的权值(相当于刺激神经兴奋的强度)与神经元相连,这一过程有些类似于多元线性回归,但模拟的非线性特征是通过下一步骤体现的,即通过设定一阈值(神经元兴奋极限)来确定神经元的兴奋模式,经输出运算得到输出结果。

经过大量样本进入网络系统学习训练之后,连接输入信号与神经元之间的权值达到稳定并可最大限度地符合已经经过训练的学习样本。

在被确认网络结构的合理性和学习效果的高精度之后,将待预测样本输入参数代入网络,达到参数预测的目的。

4.2.2反向传播算法(BP法)发展到目前为止,神经网络模型不下十几种,如前馈神经网络、感知器、Hopfiled网络、径向基函数网络、反向传播算法(BP法)等,但在储层参数反演方面,目前比较成熟比较流行的网络类型是误差反向传播神经网络(BP-ANN)。

BP网络是在前馈神经网络的基础上发展起来的,始终有一个输入层(它包含的节点对应于每个输入变量)和一个输出层(它包含的节点对应于每个输出值),以及至少有一个具有任意节点数的隐含层(又称中间层)。

在BP-ANN中,相邻层的节点通过一个任意初始权值全部相连,但同一层内各节点间互不相连。

对于BP-ANN,隐含层和输出层节点的基函数必须是连续的、单调递增的,当输入趋于正或负无穷大时,它应该接近于某一固定值,也就是说,基函数为“S”型(Kosko,1992)。

BP-ANN的训练是一个监督学习过程,涉及两个数据集,即训练数据集和监督数据集。

给网络的输入层提供一组输入信息,使其通过网络而在输出层上产生逼近期望输出的过程,称之为网络的学习,或称对网络进行训练,实现这一步骤的方法则称为学习算法。

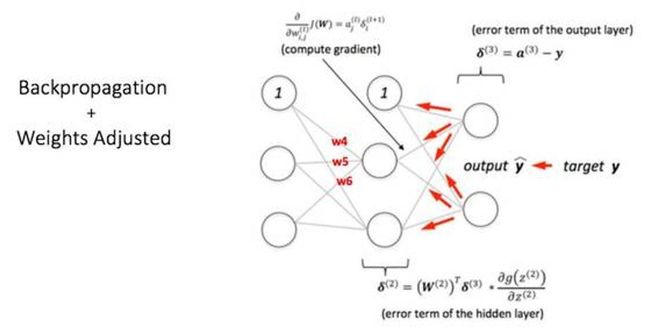

BP网络的学习过程包括两个阶段:第一个阶段是正向过程,将输入变量通过输入层经隐层逐层计算各单元的输出值;第二阶段是反向传播过程,由输出误差逐层向前算出隐层各单元的误差,并用此误差修正前层权值。

误差信息通过网络反向传播,遵循误差逐步降低的原则来调整权值,直到达到满意的输出为止。

网络经过学习以后,一组合适的、稳定的权值连接权被固定下来,将待预测样本作为输入层参数,网络经过向前传播便可以得到输出结果,这就是网络的预测。

反向传播算法主要步骤如下:首先选定权系数初始值,然后重复下述过程直至收敛(对各样本依次计算)。

(1)从前向后各层计算各单元Oj储层特征研究与预测(2)对输出层计算δj储层特征研究与预测(3)从后向前计算各隐层δj储层特征研究与预测(4)计算并保存各权值修正量储层特征研究与预测(5)修正权值储层特征研究与预测以上算法是对每个样本作权值修正,也可以对各个样本计算δj后求和,按总误差修正权值。

神经网络的准确率是怎么计算的?

其实神经网络的准确率的标准是自己定义的。我把你的例子赋予某种意义讲解:1,期望输出[1001],每个元素代表一个属性是否存在。

像着4个元素分别表示:是否肺炎,是否肝炎,是否肾炎,是否胆炎,1表示是,0表示不是。2,你的神经网络输出必定不可能全部都是输出只有0,1的输出。

绝大部分是像[0.99680.00000.00010.9970]这样的输出,所以只要输出中的某个元素大于一定的值,例如0.7,我们就认为这个元素是1,即是有某种炎。

否则为0,所以你的[0.99680.00000.00010.9970]可以看成是[1,0,0,1],。

3,所以一般神经网络的输出要按一定的标准定义成另一种输出(像上面说的),看调整后的输出和期望输出是否一致,一致的话算正确,不一致算错误。

4,用总量为n的检验样本对网络进行评价,输出调整后的输出,统计错误的个数,记为m。所以检验正确率可以定义为n/m。

求助:用神经网络做一个数据预测

。

下列代码为BP神经网络预测37-56周的销售量的代码:%x为原始序列load销售量.matdata=Cx=data';t=1:length(x);lag=2;fn=length(t);[f_out,iinput]=BP(x,lag,fn);%预测年份或某一时间段t1=fn:fn+20;n=length(t1);t1=length(x)+1:length(x)+n;%预测步数为fnfn=length(t1); [f_out,iinput]=BP(x,lag,fn);P=vpa(f_out,5);[t1'P']%画出预测图figure(6),plot(t,x,'b*-'),holdonplot(t(end):t1(end),[iinput(end),f_out],'rp-'),gridonxlabel('周数'),ylabel('销售量');str=['BP神经网络预测',num2str(length(x)+1),'-',num2str(length(x)+20),'周的销售量'];title(str)str1=['1-',num2str(length(x)),'周的销售量'];str2=[num2str(length(x)+1),'-',num2str(length(x)+20),'周的预测销售量'];legend(str1,str2)运行结果。

如何用BP神经网络实现预测

首先要知道你建立的这个模型的内部逻辑关系。。1,确定隐层数,画出简要模型图。2,确定采用什么样的神经网络来建立模型3.通过测试数据来训练模型。。

4.根据测试训练得到的数据和实际数据进行比对,或者算出误差。从而修改隐层中的权值和阀值。反复重复3-4.。最后得到一个最优的模型。大致是这样。。。楼主说的太概略。。。无法回答清楚请抱歉。

神经网络bp算法可以对样本进行预测,具体是预测什么?

。

关于神经网络(matlab)归一化的整理由于采集的各数据单位不一致,因而须对数据进行[-1,1]归一化处理,归一化方法主要有如下几种,供大家参考:(byjames)1、线性函数转换,表达式如下:y=(x-MinValue)/(MaxValue-MinValue)说明:x、y分别为转换前、后的值,MaxValue、MinValue分别为样本的最大值和最小值。

2、对数函数转换,表达式如下:y=log10(x)说明:以10为底的对数函数转换。

3、反余切函数转换,表达式如下:y=atan(x)*2/PI归一化是为了加快训练网络的收敛性,可以不进行归一化处理归一化的具体作用是归纳统一样本的统计分布性。

归一化在0-1之间是统计的概率分布,归一化在-1--+1之间是统计的坐标分布。归一化有同一、统一和合一的意思。

无论是为了建模还是为了计算,首先基本度量单位要同一,神经网络是以样本在事件中的统计分别几率来进行训练(概率计算)和预测的,归一化是同一在0-1之间的统计概率分布;当所有样本的输入信号都为正值时,与第一隐含层神经元相连的权值只能同时增加或减小,从而导致学习速度很慢。

为了避免出现这种情况,加快网络学习速度,可以对输入信号进行归一化,使得所有样本的输入信号其均值接近于0或与其均方差相比很小。

归一化是因为sigmoid函数的取值是0到1之间的,网络最后一个节点的输出也是如此,所以经常要对样本的输出归一化处理。所以这样做分类的问题时用[0.90.10.1]就要比用[100]要好。

但是归一化处理并不总是合适的,根据输出值的分布情况,标准化等其它统计变换方法有时可能更好。

关于用premnmx语句进行归一化:premnmx语句的语法格式是:[Pn,minp,maxp,Tn,mint,maxt]=premnmx(P,T)其中P,T分别为原始输入和输出数据,minp和maxp分别为P中的最小值和最大值。

mint和maxt分别为T的最小值和最大值。premnmx函数用于将网络的输入数据或输出数据进行归一化,归一化后的数据将分布在[-1,1]区间内。

我们在训练网络时如果所用的是经过归一化的样本数据,那么以后使用网络时所用的新数据也应该和样本数据接受相同的预处理,这就要用到tramnmx。

下面介绍tramnmx函数:[Pn]=tramnmx(P,minp,maxp)其中P和Pn分别为变换前、后的输入数据,maxp和minp分别为premnmx函数找到的最大值和最小值。

(byterry2008)matlab中的归一化处理有三种方法1.premnmx、postmnmx、tramnmx2.restd、poststd、trastd3.自己编程具体用那种方法就和你的具体问题有关了(byhappy)pm=max(abs(p(i,:)));p(i,:)=p(i,:)/pm;和fori=1:27p(i,:)=(p(i,:)-min(p(i,:)))/(max(p(i,:))-min(p(i,:)));end可以归一到01之间0.1+(x-min)/(max-min)*(0.9-0.1)其中max和min分别表示样本最大值和最小值。

这个可以归一到0.1-0.9。

求人工神经网络的具体算法,数学模型,比如求一个函数最优值之类的,不要各种乱七八糟的介绍,谢谢

神经网络就像多项式或者线性模型一样,是个看不见表达式的模型,它的表达式就是网络,它比一般模型具有更高的自由度和弹性;同时它是一个典型的黑箱模型方法;比多项式等模型还黑。

优化算法,就是寻优的算法,所谓寻优过程,就是寻找使目标函数最小时(都是统一表示成寻找使函数具有最小值)的自变量的值。

回归或者拟合一个模型,例如用一个多项式模型去拟合一组数据,其本质就是寻找使残差平方和最小的参数值,这就是一个寻优的过程,其实就是寻找使函数F(x)值最小时的x的值;对于这个具体的寻找过程就涉及到算法问题,就是如何计算。

所谓算法,是数值分析的一个范畴,就是解这问题的方法;例如一个一元二次方程x^2-3x+1=0的解法,因为简单可以直接求解,也可以用牛顿逐个靠近的方法求解,也即是迭代,慢慢接近真实解,如此下去不断接近真值,要注意迭代算法是涉及算法精度的,这些迭代算法是基于计算机的,算法的初衷也是用近似的算法用一定的精度来接近真实值。

比如上面的方程也可以用遗传算法来解,可以从一些初始值最终迭代到最佳解。

神经网络在寻找网络的参数即权值的时候,也有寻找使训练效果最好的过程,这也是寻优的过程,这里涉及到了算法就是所谓的神经网络算法,这和最小二乘算法是一样的道理;例如做响应面的时候,其实就是二次回归,用最小二乘得到二次模型的参数,得到一个函数,求最大产物量就是求函数模型的最大值,怎么算呢?

顶点处如果导数为0,这个地方对应的x值就是最优的,二次模型简单可以用偏导数=0来直接解决,这过程也可以遗传算法等来解决。说到底所谓寻优的本质就是,寻找函数极值处对应的自变量的值。