模型搭建和评估

第三章:模型搭建和评估

前期导入

import pandas as pd

import numpy as np

# 这是一个基于matplotlib进行高级封装的可视化库,相比之下,绘制图表更为集成化、绘图风格具有更高的定制性。

import seaborn as sns

import matplotlib.pyplot as plt

#Pyplot 是 Matplotlib 的子库,提供了和 MATLAB 类似的绘图 API。

from IPython.display import Image

%matplotlib inline

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.figsize'] = (10, 6) # 设置输出图片大小

# 读取训练数集

train = pd.read_csv('train.csv')

train.shape

train.head()

特征工程

1:缺失值填充

- 对分类变量缺失值:填充某个缺失值字符(NA)、用最多类别的进行填充

- 对连续变量缺失值:填充均值、中位数、众数

# 对分类变量进行填充

train['Cabin'] = train['Cabin'].fillna('NA')

train['Embarked'] = train['Embarked'].fillna('S')

# fillna()填充函数

# 对连续变量进行填充

train['Age'] = train['Age'].fillna(train['Age'].mean())

# 检查缺失值比例

train.isnull().sum().sort_values(ascending=False)

# sort_values()排序函数

2:编码分类变量

# 取出所有的输入特征

data = train[['Pclass','Sex','Age','SibSp','Parch','Fare', 'Embarked']]

# 进行虚拟变量转换

data = pd.get_dummies(data)

data.head()

模型搭建

- 处理完前面的数据我们就得到建模数据,下一步是选择合适模型

- 在进行模型选择之前我们需要先知道数据集最终是进行监督学习还是无监督学习

- 模型的选择一方面是通过我们的任务来决定的

- 除了根据我们任务来选择模型外,还可以根据数据样本量以及特征的稀疏性来决定

- 刚开始我们总是先尝试使用一个基本的模型来作为其baseline,进而再训练其他模型做对比,最终选择泛化能力或性能比较好的模型

通俗理解:

监督学习:我本不知道X 和 Y 能得倒一个什么样的关系,但是通过很多个X和Y且已知XY的关系的数据得知,他们存在一种函数式关系f(x,y)。并且在后续可以通过f(x,y)得到一个符合实际规律(相对准确)的结果。

无监督学习:无监督学习是一种通过奖励代理商(即计算机程序)来学习他们观察到的数据而无需考虑特定任务的情况下创建自治智能的范例。 换句话说,主体是为了学习而学习。

下面给出sklearn的算法选择路径,供大家参考

数据样本数量,数据结构,数据类别数目,重要特征等

模型产生过拟合可能由于以下几种原因:

1.模型过于复杂

2.数据有噪声,即数据中存在异常值和错误

3.用于训练的数据量可能不够

预防模型过拟合的方法有:

1.交叉验证

2.训练更多数据

3.删除某些特征

4.正则化

1:切割训练集和测试集

这里使用留出法划分数据集

- 将数据集分为自变量和因变量

- 按比例切割训练集和测试集(一般测试集的比例有30%、25%、20%、15%和10%)

- 使用分层抽样

- 设置随机种子以便结果能复现

from sklearn.model_selection import train_test_split

# 一般先取出X和y后再切割,有些情况会使用到未切割的,这时候X和y就可以用,x是清洗好的数据,y是我们要预测的存活数据'Survived'

X = data

y = train['Survived']

# 对数据集进行切割

X_train, X_test, y_train, y_test = train_test_split(X, y, stratify=y, random_state=0)

# 查看数据形状

X_train.shape, X_test.shape

train_test_split()默认先打乱顺序,随机种子是随机数的初始值

2:模型创建

- 创建基于线性模型的分类模型(逻辑回归)

- 创建基于树的分类模型(决策树、随机森林)

- 分别使用这些模型进行训练,分别的到训练集和测试集的得分

- 查看模型的参数,并更改参数值,观察模型变化

提示:

- 逻辑回归不是回归模型而是分类模型,常用于2分类,不要与LinearRegression混淆

- 随机森林其实是决策树集成为了降低决策树过拟合的情况

- 线性模型所在的模块为sklearn.linear_model

- 树模型所在的模块为sklearn.ensemble

from sklearn.linear_model import LogisticRegression

from sklearn.ensemble import RandomForestClassifier

# 默认参数逻辑回归模型

lr = LogisticRegression()

lr.fit(X_train, y_train)

# 查看训练集和测试集score值

print("Training set score: {:.2f}".format(lr.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(lr.score(X_test, y_test)))

# 调整参数后的逻辑回归模型

lr2 = LogisticRegression(C=100)

lr2.fit(X_train, y_train)

print("Training set score: {:.2f}".format(lr2.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(lr2.score(X_test, y_test)))

# 默认参数的随机森林分类模型

rfc = RandomForestClassifier()

rfc.fit(X_train, y_train)

print("Training set score: {:.2f}".format(rfc.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(rfc.score(X_test, y_test)))

# 调整参数后的随机森林分类模型

rfc2 = RandomForestClassifier(n_estimators=100, max_depth=5)

rfc2.fit(X_train, y_train)

print("Training set score: {:.2f}".format(rfc2.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(rfc2.score(X_test, y_test)))

3:输出模型预测结果

- 输出模型预测分类标签

- 输出不同分类标签的预测概率

提示:一般监督模型在sklearn里面有个predict能输出预测标签,predict_proba则可以输出标签概率

# 预测标签

pred = lr.predict(X_train)

# 此时我们可以看到0和1的数组

pred[:10]

# 预测标签概率

pred_proba = lr.predict_proba(X_train)

pred_proba[:10]

评估

前期准备

import pandas as pd

import numpy as np

import seaborn as sns

import matplotlib.pyplot as plt

from IPython.display import Image

from sklearn.linear_model import LogisticRegression

from sklearn.ensemble import RandomForestClassifier

%matplotlib inline

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.figsize'] = (10, 6) # 设置输出图片大小

1:加载数据并分割测试集和训练集

from sklearn.model_selection import train_test_split

# 一般先取出X和y后再切割,有些情况会使用到未切割的,这时候X和y就可以用,x是清洗好的数据,y是我们要预测的存活数据'Survived'

data = pd.read_csv('clear_data.csv')

train = pd.read_csv('train.csv')

X = data

y = train['Survived']

# 对数据集进行切割

X_train, X_test, y_train, y_test = train_test_split(X, y, stratify=y, random_state=0)

# 默认参数逻辑回归模型

lr = LogisticRegression()

lr.fit(X_train, y_train)

模型评估

- 模型评估是为了知道模型的泛化能力。

- 交叉验证(cross-validation)是一种评估泛化性能的统计学方法,它比单次划分训练集和测试集的方法更加稳定、全面。

- 在交叉验证中,数据被多次划分,并且需要训练多个模型。

- 最常用的交叉验证是 k 折交叉验证(k-fold cross-validation),其中 k 是由用户指定的数字,通常取 5 或 10。

- 准确率(precision)度量的是被预测为正例的样本中有多少是真正的正例

- 召回率(recall)度量的是正类样本中有多少被预测为正类

- f-分数是准确率与召回率的调和平均

1:交叉验证

提示:交叉验证在sklearn中的模块为sklearn.model_selection

from sklearn.model_selection import cross_val_score

lr = LogisticRegression(C=100)

scores = cross_val_score(lr, X_train, y_train, cv=10)

# k折交叉验证分数

scores

# 平均交叉验证分数

print("Average cross-validation score: {:.2f}".format(scores.mean()))

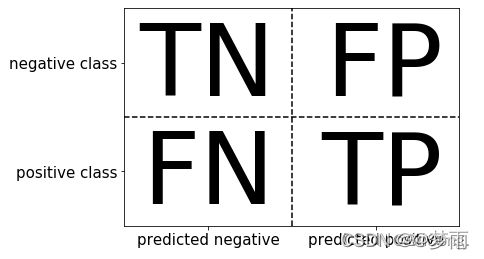

2:混淆矩阵

- 计算二分类问题的混淆矩阵

- 计算精确率、召回率以及f-分数

-

True Positive(TP):真正类。样本的真实类别是正类,并且模型识别的结果也是正类。

-

False Negative(FN):假负类。样本的真实类别是正类,但是模型将其识别为负类。

-

False Positive(FP):假正类。样本的真实类别是负类,但是模型将其识别为正类。

-

混淆矩阵的方法在sklearn中的sklearn.metrics模块

-

混淆矩阵需要输入真实标签和预测标签

-

精确率、召回率以及f-分数可使用classification_report模块

from sklearn.metrics import confusion_matrix

# 训练模型

lr = LogisticRegression(C=100)

lr.fit(X_train, y_train)

# 模型预测结果

pred = lr.predict(X_train)

# 混淆矩阵

confusion_matrix(y_train, pred)

from sklearn.metrics import classification_report

# 精确率、召回率以及f1-score

print(classification_report(y_train, pred))

3:ROC曲线

多个混淆矩阵的FP和TP形成的二维图,并找出最接近100%预测正确的点

提示

- ROC曲线在sklearn中的模块为sklearn.metrics

- ROC曲线下面所包围的面积越大越好

from sklearn.metrics import roc_curve

fpr, tpr, thresholds = roc_curve(y_test, lr.decision_function(X_test))

plt.plot(fpr, tpr, label="ROC Curve")

plt.xlabel("FPR")

plt.ylabel("TPR (recall)")

# 找到最接近于0的阈值

close_zero = np.argmin(np.abs(thresholds))

plt.plot(fpr[close_zero], tpr[close_zero], 'o', markersize=10, label="threshold zero", fillstyle="none", c='k', mew=2)

plt.legend(loc=4)