Pytorch 数据增广(Data Augmentation)

Pytorch 数据增广(Data Augmentation)

0. 环境介绍

环境使用 Kaggle 里免费建立的 Notebook

教程使用李沐老师的 动手学深度学习 网站和 视频讲解

小技巧:当遇到函数看不懂的时候可以按 Shift+Tab 查看函数详解。

1. 简介

图像增广在对训练图像进行一系列的随机变化之后,生成相似但不同的训练样本,从而扩大了训练集的规模。 此外,应用图像增广的原因是,随机改变训练样本可以减少模型对某些属性的依赖,从而提高模型的泛化能力。 例如,我们可以以不同的方式裁剪图像,使感兴趣的对象出现在不同的位置,减少模型对于对象出现位置的依赖。 我们还可以调整亮度、颜色等因素来降低模型对颜色的敏感度。 可以说,图像增广技术对于AlexNet的成功是必不可少的。在本节中,我们将讨论这项广泛应用于计算机视觉的技术。

增强一个已有数据集,使得有更多的多样性

- 在语言里面加入各种不同的背景噪音

- 改变图片的颜色和形状

- 翻转,切割等操作

2. 常用的图像增广方法

2.0 导入图片

老师的测试图片地址:

https://raw.githubusercontent.com/d2l-ai/d2l-zh/master/img/cat1.jpg

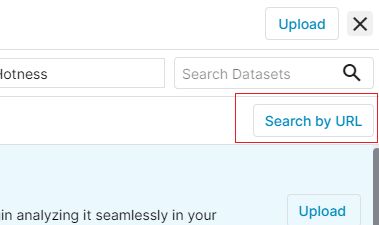

如果你和我一样用的 kaggle,可以在右侧添加数据集:

输入:https://www.kaggle.com/datasets/xenxiou/dive-into-deep-learning-image

(这个是我自己上传的,当然了,你也可以自己上传自己的数据集,可以点右上角的 Upload 自行上传)

点击 Add 即可:

导入图片:

!pip install -U d2l

%matplotlib inline

import torch

import torchvision

from torch import nn

from d2l import torch as d2l

d2l.set_figsize()

img = d2l.Image.open('../input/dive-into-deep-learning-image/img/cat1.jpg')

d2l.plt.imshow(img)

定义 apply 函数,该函数在输入图像 img 上多次运行图像增广方法 aug 并显示所有结果。

def apply(img, aug, num_rows=2, num_cols=4, scale=1.5):

Y = [aug(img) for _ in range(num_rows * num_cols)]

d2l.show_images(Y, num_rows, num_cols, scale=scale)

2.1 翻转和裁剪

随机( 50 % 50\% 50% 概率)水平翻转:

apply(img, torchvision.transforms.RandomHorizontalFlip())

apply(img, torchvision.transforms.RandomVerticalFlip())

随机裁剪一个面积为原始面积 10 % 10\% 10% 到 100 % 100\% 100% 的区域,该区域的宽高比从 0.5 0.5 0.5 到 2 2 2 之间随机取值,区域的宽度和高度都被 resize 到 200 × 200 200 \times 200 200×200像素:

shape_aug = torchvision.transforms.RandomResizedCrop(

(200, 200), scale=(0.1, 1), ratio=(0.5, 2))

apply(img, shape_aug)

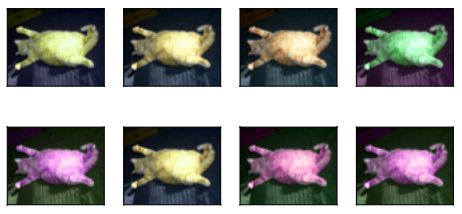

2.2 改变颜色

我们可以改变图像颜色的四个方面:亮度(brightness)、对比度(contrast)、饱和度(saturation)和色调(hue)。

我们随机更改图像的亮度,随机值为原始图像的 50 % 50\% 50%( 1 − 0.5 1-0.5 1−0.5)到 150 % 150\% 150%( 1 + 0.5 1+0.5 1+0.5)之间。

apply(img, torchvision.transforms.ColorJitter(

brightness=0.5, contrast=0, saturation=0, hue=0))

apply(img, torchvision.transforms.ColorJitter(

brightness=0, contrast=0, saturation=0, hue=0.5))

同时随机更改图像的亮度(brightness)、对比度(contrast)、饱和度(saturation)和色调(hue):

color_aug = torchvision.transforms.ColorJitter(

brightness=0.5, contrast=0.5, saturation=0.5, hue=0.5)

apply(img, color_aug)

2.3 结合多种图像增广方法

可以通过使用一个 Compose 实例来综合上面定义的不同的图像增广方法,并将它们应用到每个图像:

augs = torchvision.transforms.Compose([

torchvision.transforms.RandomHorizontalFlip(), color_aug, shape_aug])

apply(img, augs)

3. 使用数据增广进行训练

3.1 加载 CIFAR-10 数据集

使用 CIFAR-10 数据集:

all_images = torchvision.datasets.CIFAR10(train=True,

root="../data",

download=True)

d2l.show_images([all_images[i][0] for i in range(32)], 4, 8, scale=0.8)

为了在预测过程中得到确切的结果,我们通常对训练样本只进行图像增广,且在预测过程中不使用随机操作的图像增广。 在这里,我们只使用最简单的随机左右翻转。 此外,我们使用 ToTensor 实例将一批图像转换为深度学习框架所要求的格式,即形状为(批量大小,通道数,高度,宽度)的 32 32 32 位浮点数,取值范围为 0 0 0 到 1 1 1:

train_augs = torchvision.transforms.Compose([

torchvision.transforms.RandomHorizontalFlip(),

torchvision.transforms.ToTensor()])

test_augs = torchvision.transforms.Compose([

torchvision.transforms.ToTensor()])

定义一个辅助函数,以便于读取图像和应用图像增广,PyTorch 数据集提供的 transform 函数应用图像增广来转化图像:

def load_cifar10(is_train, augs, batch_size):

dataset = torchvision.datasets.CIFAR10(root="../data", train=is_train,

transform=augs, download=True)

dataloader = torch.utils.data.DataLoader(dataset, batch_size=batch_size,

shuffle=is_train, num_workers=4)

return dataloader

3.2 GPU 训练

李沐老师的环境是有多 GPU 的,我 kaggle 上只有一个 GPU,所以只用一个 GPU 训练了:

def train_batch_ch13(net, X, y, loss, trainer, devices):

"""用多GPU进行小批量训练"""

if isinstance(X, list):

X = [x.to(devices[0]) for x in X]

else:

X = X.to(devices[0])

y = y.to(devices[0])

net.train()

trainer.zero_grad()

pred = net(X)

l = loss(pred, y)

l.sum().backward()

trainer.step()

train_loss_sum = l.sum()

train_acc_sum = d2l.accuracy(pred, y)

return train_loss_sum, train_acc_sum

def train_ch13(net, train_iter, test_iter, loss, trainer, num_epochs,

devices=d2l.try_all_gpus()):

"""用多GPU进行模型训练"""

timer, num_batches = d2l.Timer(), len(train_iter)

animator = d2l.Animator(xlabel='epoch', xlim=[1, num_epochs], ylim=[0, 1],

legend=['train loss', 'train acc', 'test acc'])

net = nn.DataParallel(net, device_ids=devices).to(devices[0])

for epoch in range(num_epochs):

# 4个维度:储存训练损失,训练准确度,实例数,特点数

metric = d2l.Accumulator(4)

for i, (features, labels) in enumerate(train_iter):

timer.start()

l, acc = train_batch_ch13(

net, features, labels, loss, trainer, devices)

metric.add(l, acc, labels.shape[0], labels.numel())

timer.stop()

if (i + 1) % (num_batches // 5) == 0 or i == num_batches - 1:

animator.add(epoch + (i + 1) / num_batches,

(metric[0] / metric[2], metric[1] / metric[3],

None))

test_acc = d2l.evaluate_accuracy_gpu(net, test_iter)

animator.add(epoch + 1, (None, None, test_acc))

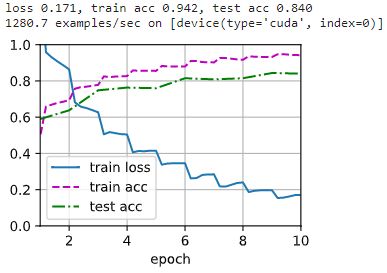

print(f'loss {metric[0] / metric[2]:.3f}, train acc '

f'{metric[1] / metric[3]:.3f}, test acc {test_acc:.3f}')

print(f'{metric[2] * num_epochs / timer.sum():.1f} examples/sec on '

f'{str(devices)}')

定义 train_with_data_aug 函数,使用图像增广来训练模型。该函数获取所有的 GPU,并使用Adam 作为训练的优化算法,将图像增广应用于训练集,最后调用刚刚定义的用于训练和评估模型的 train_ch13 函数:

batch_size, devices, net = 256, d2l.try_all_gpus(), d2l.resnet18(10, 3)

def init_weights(m):

if type(m) in [nn.Linear, nn.Conv2d]:

nn.init.xavier_uniform_(m.weight)

net.apply(init_weights)

def train_with_data_aug(train_augs, test_augs, net, lr=0.001):

train_iter = load_cifar10(True, train_augs, batch_size)

test_iter = load_cifar10(False, test_augs, batch_size)

loss = nn.CrossEntropyLoss(reduction="none")

trainer = torch.optim.Adam(net.parameters(), lr=lr)

train_ch13(net, train_iter, test_iter, loss, trainer, 10, devices)

使用 ResNet18 训练:

train_with_data_aug(train_augs, test_augs, net)