离离原上谱!当AI机器人开始除草;Python新手教程(40+常用脚本);伯克利·并行计算机应用课程;硬件信息高效获取工具;前沿论文 | ShowMeAI资讯日报

日报合辑 | 电子月刊 | 公众号下载资料 | @韩信子

FarmWise:累计融资超6000万美元,开发AI驱动的除草机器人

https://mp.weixin.qq.com/s/skMHliGttiuLv-IQertgeg

FarmWise是一家美国农业机器人公司,依靠将人工智能、计算机视觉和机器人技术相结合的专利技术来清理农田中的杂草。在田间工作时,农业机器人使用AI检测功能来驱动位于农作物周围的刀片。该农业机器人专为处理多种作物而设计,利用机器学习不断扩大其作物范围。

FarmWise最新的除草机器人型号Titan FT-35 是由一台自行式牵引机和一个除草机具组成,该除草机包含一组摄像头和传感器以及机械臂。FarmWise为了让他们的除草机器人能分辨不同的作物和杂草,该团队在数百万张作物图像上训练机器学习算法,并保证每周对后台数据库进行更新。

工具&框架

『GFPGAN』开发一种实用算法,用于现实世界的人脸修复

https://github.com/TencentARC/GFPGAN

https://replicate.com/tencentarc/gfpgan

GFPGAN是一个开发中的工具库,它提供了实用的算法用于现实世界的人脸修复。它利用预先训练好的人脸GAN(如StyleGAN2)中封装的丰富和多样的先验因素进行人脸修复。

『Image Sequence Localizer』在室外环境用图像序列进行视觉定位的框架

https://github.com/ovysotska/image_sequence_localizer

visual place recognition/视觉地点识别,也被称为弱定位,通过匹配图像序列进行的。假设输入是一连串的图像或图像特征。该程序输出代表同一地点的图像对的ID。

Image Sequence Localizer 提出了一个户外视觉地点识别的框架。它可以在 GPS 缺失的环境中识别视觉上相似的地方。在全 6DoF 机器人姿势估计的背景下,可以作为一种候选搜索技术。

『Fastfetch』C写的硬件信息高效获取工具

https://github.com/LinusDierheimer/fastfetch

Fastfetch 是一个类似于 neofetch 的工具,用于获取系统信息并以一种漂亮的方式呈现它们。它是用纯C语言编写的,考虑到了性能和可定制性。目前支持 Linux、Android、BSD、 MacOS 和 MSYS2 的 Windows。

『ggml』机器学习张量库(C语言)

https://github.com/ggerganov/ggml

ggml 是一个用C语言编写的机器学习的张量库。ggml 支持16位浮点数,针对Arm64架构(M1)、x86架构(M1)进行了优化,没有第三方的依赖性,运行期间零内存分配。

『JaxSeq』用JAX训练非常大的语言模型

https://github.com/Sea-Snell/JAXSeq

JaxSeq 建立在 Hugging Face Transformers 库之上,能够在 Jax 中训练非常大的语言模型,目前支持 GPT2、GPTJ、T5 和 OPT 模型。JaxSeq 被设计成轻量级且易于扩展,其目的是展示一个训练大型语言模型的工作流程,而不像其他现有框架那样笨重。

借助 Jax 的 pjit 函数,你可以直接用任意的模型和数据来训练;你也可以在多个主机上进行模型的并行化。它还提供了对梯度检查、梯度累积和 bfloat16 训练/推理的支持。

博文&分享

『python-tutorial』Python实用教程

https://github.com/shibing624/python-tutorial

Python 教程,包括:Python 基础,Python 高级特性,面向对象编程,多线程,数据库,数据科学,Flask,爬虫开发教程。

在本 Python 教程包含了一些范例,涵盖了大多数 Python 日常脚本任务,是入门 Python 的学习资料,也可以作为工作中编写 Python 脚本的参考实现。 以下所有实现均在 Python3 环境下测试。

『Applications of Parallel Computers』UC Berkeley CS267 · 并行计算机应用课程(2021年春季课程)

https://sites.google.com/lbl.gov/cs267-spr2021

CS267 旨在教学生如何并行编程,以有效解决复杂模拟、大量数据分析等需要快速计算来解决的科学与工程问题。

课程需要学习者具备基本的编程技能,以及能够理解算法与解决方案的数学知识储备。课程学习结束后,学生将了解并行架构空间,获得主流并行编程工具的使用经验,并接触到一些开放的研究问题。

- Memory Hierarchies and Matrix Multiplication(内存层次结构和矩阵乘法)

- More MatMul and the Roofline Performance Model(更多 MatMul 和 Roofline 性能模型)

- Shared Memory Parallelism(共享内存并行)

- Sources of Parallelism and Locality(并行性和局部性的来源)

- Communication-avoiding matrix multiplication(避免通信的矩阵乘法)

- An Introduction to CUDA and Graphics Processors (GPUs)(CUDA 和图形处理器(GPU) 简介)

- Data Parallel Algorithms(数据并行算法)

- Distributed Memory Machines and Programming(分布式内存机器和编程)

- Advanced MPI and Collective Communication Algorithms(高级 MPI 和集体通信算法)

- UPC++: Partitioned Global Address Space Languages(UPC++:分区全局地址空间语言)

- Parallel Algorithms for De Novo Genome Assembly(从头基因组组装的并行算法)

- Communication-Avoiding Graph Neural Networks(避免通信的图神经网络)

- Distributed Computing with Ray and NumS(Ray和NumS的分布式计算)

- Parallel Matrix Multiply(平行矩阵乘法)

- Dense Linear Algebra(密集线性代数)

- Structured Grids(结构化网格)

- Machine Learning(机器学习)

- Sparse-Matrix-Vector-Multiplication and Iterative Solvers(稀疏矩阵向量乘法和迭代求解器)

- Fast Fourier Transform(快速傅里叶变换)

- Graph Algorithms(图算法)

- Cloud Computing and HPC(云计算与高性能计算)

- Graph Partitioning(图分区)

- Load Balancing with Work Stealing(负载均衡与任务窃取)

- Hierarchical Methods for the N-Body Problem(N-Body问题的分层方法)

- Sorting and Searching(排序和搜索)

- Computational Biology(计算生物学)

数据&资源

『Awesome GFlowNets』GFlowNet 相关资源列表

https://github.com/zdhNarsil/Awesome-GFlowNets

研究&论文

可以点击 这里 回复关键字 日报,免费获取整理好的论文合辑。

科研进展

- 2022.10.05 『视频生成』 Phenaki: Variable Length Video Generation From Open Domain Textual Description

- 2022.10.11 『人脸识别』Unifying Diffusion Models’ Latent Space, with Applications to CycleDiffusion and Guidance

- 2022.09.25 『文本到图像生成』 Personalizing Text-to-Image Generation via Aesthetic Gradients

⚡ 论文:Phenaki: Variable Length Video Generation From Open Domain Textual Description

论文时间:5 Oct 2022

领域任务:Video Generation, 视频生成

论文地址:https://arxiv.org/abs/2210.02399

代码实现:https://github.com/LAION-AI/phenaki

论文作者:Ruben Villegas, Mohammad Babaeizadeh, Pieter-Jan Kindermans, Hernan Moraldo, Han Zhang, Mohammad Taghi Saffar, Santiago Castro, Julius Kunze, Dumitru Erhan

论文简介:To the best of our knowledge, this is the first time a paper studies generating videos from time variable prompts./据我们所知,这是第一篇研究从时间变量提示中生成视频的论文。

论文摘要:我们提出了Phenaki,一个能够在给定一连串文字提示的情况下进行现实的视频合成的模型。由于计算成本、高质量文本-视频数据的数量有限以及视频长度的变化,从文本中生成视频尤其具有挑战性。为了解决这些问题,我们引入了一个学习视频表征的新模型,该模型将视频压缩为离散标记的小表征。这个标记器在时间上使用了因果注意,这使它能够与可变长度的视频一起工作。为了从文本中生成视频标记,我们正在使用一个以预先计算的文本标记为条件的双向掩码变换器。生成的视频标记随后被去标记化,以创建实际的视频。为了解决数据问题,我们展示了在图像-文本对的大型语料库以及数量较少的视频-文本实例上的联合训练如何能够导致超越视频数据集中可用的泛化效果。与之前的视频生成方法相比,Phenaki可以在开放的领域中以一连串的提示(即时间可变的文本或一个故事)为条件生成任意长的视频。据我们所知,这是第一次有论文研究从时间可变的提示中生成视频。此外,与按帧计算的基线相比,所提出的视频编码器-解码器在每个视频中计算的标记较少,但却能产生更好的时空一致性。

⚡ 论文:Unifying Diffusion Models’ Latent Space, with Applications to CycleDiffusion and Guidance

论文时间:11 Oct 2022

领域任务:Face Recognition, Image-to-Image Translation, 人脸识别、图像到图像的翻译

论文地址:https://arxiv.org/abs/2210.05559

代码实现:https://github.com/chenwu98/cycle-diffusion , https://github.com/chenwu98/unified-generative-zoo

论文作者:Chen Henry Wu, Fernando de la Torre

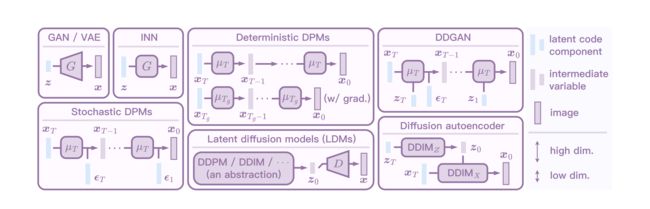

论文简介:The commonly-adopted formulation of the latent code of diffusion models is a sequence of gradually denoised samples, as opposed to the simpler (e. g., Gaussian) latent space of GANs, VAEs, and normalizing flows./扩散模型普遍采用的潜伏代码表述是逐渐去噪的样本序列,与GANs、VAEs和归一化流的较简单(如高斯)潜伏空间相反。

论文摘要:扩散模型在生成式建模中取得了前所未有的性能。通常采用的扩散模型潜伏代码的表述是逐渐去噪的样本序列,而不是GANs、VAEs和归一化流的更简单(例如高斯)的潜伏空间。本文提供了各种扩散模型潜伏空间的另一种高斯表述,以及将图像映射到潜伏空间的可逆DPM-编码器。虽然我们的表述纯粹是基于扩散模型的定义,但我们展示了几个有趣的结果。(1) 从经验上看,我们观察到,在相关领域独立训练的两个扩散模型出现了一个共同的潜空间。鉴于这一发现,我们提出了CycleDiffusion,它使用DPM-Encoder进行非配对图像到图像的翻译。此外,将CycleDiffusion应用于文本到图像的扩散模型,我们表明大规模的文本到图像的扩散模型可以被用作0-shot的图像到图像的编辑。(2)人们可以通过控制潜伏代码来指导预训练的扩散模型和GANs,这是一个统一的、基于能量的即插即用的表述。使用CLIP模型和人脸识别模型作为指导,我们证明了扩散模型比GANs对低密度子群体和个体有更好的覆盖。

⚡ 论文:Personalizing Text-to-Image Generation via Aesthetic Gradients

论文时间:25 Sep 2022

领域任务:Text to image generation, 文本到图像生成

论文地址:https://arxiv.org/abs/2209.12330

代码实现:https://github.com/vicgalle/stable-diffusion-aesthetic-gradients

论文作者:Victor Gallego

论文简介:This work proposes aesthetic gradients, a method to personalize a CLIP-conditioned diffusion model by guiding the generative process towards custom aesthetics defined by the user from a set of images./这项工作提出了审美梯度,这是一种通过引导生成过程走向用户从一组图像中定义的自定义美学来个性化CLIP条件的扩散模型的方法。

论文摘要:这项工作提出了审美梯度,这是一种通过引导生成过程走向用户从一组图像中定义的自定义美学来个性化CLIP条件的扩散模型的方法。该方法通过定性和定量实验进行验证,使用最近的稳定扩散模型和几个审美过滤的数据集。代码发布在 https://github.com/vicgalle/stable-diffusion-aesthetic-gradients

我们是 ShowMeAI,致力于传播AI优质内容,分享行业解决方案,用知识加速每一次技术成长!

◉ 点击 日报合辑,在公众号内订阅话题 #ShowMeAI资讯日报,可接收每日最新推送。

◉ 点击 电子月刊,快速浏览月度合辑。

◉ 点击 这里 ,回复关键字 日报 免费获取AI电子月刊与论文 / 电子书等资料包。