图像调试基本术语

图像调试基本术语

镜头光学

![]()

焦距

与光轴平行的光线射入到凸透镜时,理想的镜头应该是所有的光线聚集到一点,再以锥形扩散开来,这个聚集所有光线的一点,就叫做焦点。焦点距镜头中心的距离,或者在Camera中,镜头光学中心到成像平面(CCD或CMOS)的距离成为焦距。

弥散圆

在焦点前后,光线开始聚集和扩散,点的影像变成模糊的,形成一个扩大的圆,这个圆叫做弥散圆。如果弥散圆的直径小于人眼的鉴别能力,在一定范围内实际影像产生的模糊是人眼认为依旧清晰。这个弥散圆称为容许弥散圆。

景深

在焦点前后各有一个容许弥散圆,这两个弥散圆之间的距离就叫景深,即:在被摄主体(对焦点)前后,其影像仍然有一段清晰范围的,就是景深。换言之,被摄体的前后纵深,呈现在底片面的影象模糊度,都在容许弥散圆的限定范围内。

视场角(Field of View,FOV)

视场角是衡量一支相机镜头能够“看到”的最大视野范围的标度,通常以角度作为单位。很明显,决定视场角的关键在于镜头焦距,焦距越长的镜头视场角越小。

光圈

控制进光量的一种装置,光圈值通常有:f1 f1.4 f2 f2.8 f4 f5.6 f8 f11 f16 f22 f32,从左至右,相邻两个光圈进光量依次缩小一倍。

快门

控制曝光时间的装置。快门短可以拍摄高速运动的物体,但光的强度小;相反,在夜间拍摄,设置长快门可以获得更亮的图像。

光和图像

色温

色温是表示光线中包含颜色成分的一个计量单位,“K”(开尔文)。分为绝对色温和相对色温。绝对色温指黑体在相应温度发出的光所含的光谱成分;相对色温,指光源的光谱接近某一温度黑体的光谱成分,则称该光源的相对色温为该温度开尔文。

饱和度

指色彩的明艳程度

明度

眼睛对光源和物体表面明暗程度的感觉

灰度

表示光的强度信息

高低频

图像中,低频表示图像的平滑区域,高频表示图像的边缘或噪声。

动态范围

摄影机在同一场景中对最亮区域和较暗区域表现存在局限,计算方式是图像能分辨最亮光信号值与图像能分辨的最暗光信号值的比值。即图像最亮光信号值与最大噪声的比值。

ISP

![]()

DPC

图像传感器中的传感器上每一光线采集的点形成的阵列工艺存在缺陷,或光信号进行转化的过程中出现错误,会造成图像上有些像素的信息有误,导致图像中的像素值不准确,这些有缺陷的像素即为图像坏点(Bad pixel)。坏点分为静态坏点和动态坏点。静态坏点可通过查表插值矫正,动态坏点因为gain和温度的增加出现,具有不确定性,需要先检测坏点再进行矫正。

BLC

在没有光线照射的时候,sensor电路本身会存在暗电流,导致像素单位也有一定的输出电压。暗电流跟曝光时间和gain都有关系,不同的位置也不一样。因此在gain增大的时候,电路的增益增大,暗电流也会增强,因此在不同gain下减去不同的黑电平值进行校正。

HLC(High Light Compensation)

HLC(高光补偿)技术有助于提高例如在低光条件下拍摄明亮前照灯时车牌的可见性。图像中的亮部分被自动屏蔽和补偿,以实现更好的可见性。

LSC

由于Lens的不同区域透光性能不一致,导致图像中心区域较亮,图像四周较暗。简单的处理方法是拍摄一张均匀光照的白纸,计算距离中心不同半径范围的亮度与中心亮度比值,作为矫正系数。

AE

自动曝光,根据当前图像曝光量,调整曝光参数(快门,光圈,iso),使得曝光达到目标值。

NR DNR

图像降噪多采用滤波进行处理。可分为NR2D和NR3D,前者基于单个图像空间信息,后者在时域上利用前后多帧图像的关联信息。其中NR3D包含NR2D的操作。

AWB

颜色恒常性是人眼具备的一种视觉特性,能在不同光源下识别出物体的颜色。白平衡通过识别场景光源,转化为标准光源,从而矫正偏色物体,使得相机具备这种能力。

CFA(color filter array) CI

将BAYER模式通过插值变为RGB模式。

PS:Nyquist采样定理告诉我们,只有采样频率大于信号最高频率的2倍,我们才能完全重构出原信号。所以无论采用什么算法,欠采样是无法弥补的。所以出路似乎在于进一步提高像素密度。但是光子的波粒二象性使得光子入射噪音随着像素尺寸的减小而不断增大,而且像素尺寸现在已经接近了光学的衍射极限。

CCM(Color Correction Matrix)

CCM主要负责sensor_RGB空间到XYZ空间的转换再到线性sRGB空间的转换。

gamma

在相机中通过Gamma与反Gamma操作,扩展存储的动态范围,并在显示设备上显示符合人眼亮度响应(对暗敏感)的图像。

ALTM(Adaptive Local Tone Mapping)

将高动态图像压缩到低动态图像,增强图像对比度,让图像更好看,便于设备显示。

CSC(Color Space Conversion)

颜色空间转换,一般是将sRGB空间转换到YUV。

LUT(Look-Up Table)

查找表技术,可以在两组数据之间建立对应关系。可以用于颜色空间转换、CCM等。

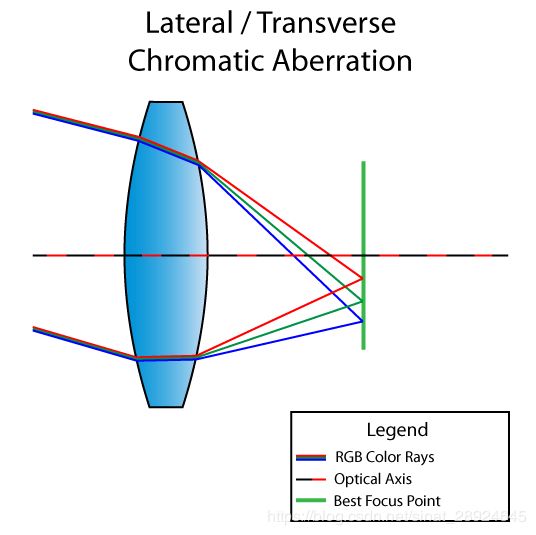

CAC (Chromatic Aberration Correction)

由于不同颜色的光在通过镜头时以不同的速度传播,镜头对于所有波长的光不能聚集于一点而引起的“紫边”现象。

如图左图为正常无色差,中图为纵向色差,右图为横向色差。纵向色差可通过缩小光圈(stopping down)矫正,横向色差需要通过后处理矫正。

CA (Chroma Adjustment)

色度调整,在亮度不变的情况下,调整色度。我的想法,这个处理应该是转到亮/色度分离的域,如YUV,对UV进行处理。

PCR (Preferred Color Reproduction)

大部分情况图像是给人看的,不同的人有不同的颜色喜好,根据用户爱好改变色调空间,称为喜好色。另一种称为感知色。

IE(Image Enhancement)

增强图像中的有用信息,它可以是一个失真的过程,其目的是要改善图像的视觉效果,针对给定图像的应用场合。图像增强涉及许多操作,如降噪,边缘增强,对比度增强。

这里说下与图像复原的区别,图像增强不考虑图像是如何退化的,只通过试探各种技术来来增强图像的视觉效果。因此,图像增强可以不顾增强后的图像是否失真,只要看着舒服就行。而图像复原则完全不同,需知道图像退化的机制和过程等先验知识,据此找出一种相应的逆过程解算方法,从而得到复原的图像。如果图像已退化,应先做复原处理,再做增强处理。

曝光时间为行数该怎么理解

以行为单位表示曝光时间(exposure time)的,比如说INT TIM为159,就是指sensor曝光时间为159行,

两者所代表的意思是相同的,都是表示sensor的曝光时间,但是integration time是一个相对的概念,即以行为单位,而每行所占的绝对时间与pclk的时钟频率和每一行包含多少pclk(即行长)有关;而exposure time则是指sensor曝光的绝对时间,两者换算的关系如下:

exposure time = integration time x 行长 /pclk 频率

ACM(Auto Color Manager)

ANR (Auto Noise Reduction)

MCTF(Motion Compensated Temporal-Filtering)

运动补偿是通过先前的局部图像来预测、补偿当前的局部图像,它是减少帧序列冗余信息的有效方法。MCTF是运动补偿的时域滤波。

频闪/闪烁抑制

普通光源用50Hz交流电工作,每秒会有100次闪烁,可以通过控制曝光时间为频闪/闪烁周期的整数倍来使得每一帧图像亮度大致一致。

宽动态技术

在亮与暗强烈对比下,让摄像机看到影像特点而运用的技术。即生成HDR图像。常见的方法是长短帧曝光,融合长帧的低位信息和短帧的高位信息。

图像问题

吉布斯现象

在工程应用时常用有限正弦项正弦波叠加逼近原周期信号。所用的谐波次数N的大小决定逼近原波形的程度,N增加,逼近的精度不断改善。但是由于对于具有不连续点的周期信号会发生一种现象:当选取的傅里叶级数的项数N增加时,合成的波形虽然更逼近原函数,但在不连续点附近会出现一个固定高度的过冲,N越大,过冲的最大值越靠近不连续点,但其峰值并不下降,而是大约等于原函数在不连续点处跳变值的9%,且在不连续点两侧呈现衰减振荡的形式

像素窜扰

进入一个像素的光窜到邻近像素所产生“浑浊”的现象。高端传感器会采用辅助的微镜头把这个光再次弯曲来修正

振铃效应

振铃效应可参考吉布斯现象。由于在图像复原中选取了不适当的图像模型造成的,振铃效应产生的直接原因是图像退化过程中信息量的丢失,尤其是高频信息的丢失

伪影(Artifacts)

果冻效应

用卷帘快门拍摄时,逐行扫描速度不够,拍摄结果出现倾斜、摇摆、部分倾斜的现象

Fliker现象

Sensor在日光灯作为光源下获取图像数据时会产生flicker,其根本原因是照在不同pixel上光能量不同产生的,所接受的光能量的 不同也就是图像的亮度的不同。

由于CMOS sensor的曝光方式是一行一行的方式进行的,任何一个pixel的曝光时间是一样的,也就是同一行上的每个pixel的曝光开始点和曝光的时间都是一模一样的,所以同一行的所有点所接收到的能量是一样的,而在不同行之间虽然曝光时间都是一样的,但是曝光的开始点是不同的,所以不同行之间所接受到的能量是不一定相同的。 为了使不同行之间所接受的能量相同,就必须找一个特定的条件,使得每一行即使曝光开始点不同,但是所接受的光能量是相同的,这样就避开了flicker,这个特定的条件就是曝光时间必须是光能量周期的整数倍时间。

伪彩色

插值后的图像出现原始图像中没有出现过的错误颜色或彩色条纹现象。

摩尔纹

当采样频率不满足采样定理时,就会产生摩尔纹。通俗点说,感光元件的空间频率与影像中条纹的空间频率接近时就极易出现摩尔纹。摩尔纹经常伴随伪彩色问题。

硬件/接口/其他

VPSS (Video Process Sub-System)

VPSS是视频前处理单元,全称为Video Process Sub-System 。支持对一幅输入图像进行统一预处理,如去噪、去隔行等,然后再对各通道分别进行缩放、锐化等处理,最后输出多种不同分辨率的图像。 VPSS单元支持的具体图像处理功能包括PreScale、De-ring/De-block、NR、IE 、DIE、Sharpen等

LVDS(Low Voltage Differential Signaling)

低压差分信号技术接口。液晶显示器驱动板输出的数字信号中,除了包括RGB数据信号外,还包括行同步、场同步、像素时钟等信号,其中像素时钟信号的最高频率可超过28MHz。采用TTL接口,数据传输速率不高,传输距离较短,且抗电磁干扰(EMI)能力也比较差,会对RGB数据造成一定的影响;另外,TTL多路数据信号采用排线的方式来传送,整个排线数量达几十路,不但连接不便,而且不适合超薄化的趋势。LVDS为解决这些问题被研制而出。

MIPI

移动行业处理器接口,专为移动应用处理器制定的开放标准,用于传输数据

FPN(Fixed Pattern Noise)

固定模式噪声。在相同曝光和温度的情况下,sensor中像素的值不一致,更多的是出现一些热像素(大于其他像素值)。每个像素结构中的光电二极管的尺寸、掺杂浓度、生产过程中的沾污以及MOS场效应管的参数的偏差等都会造成像素输出信号的变化。

DIS

数字图像稳定器。将连续拍摄两张照片,第一张是记录画面的色彩信息,第二张是记录拍摄主体轮廓,获得最清晰的影像,最终相机将这两张照片进行叠加计算得出最佳拍摄效果。低亮度环境中使用数字图像稳定功能可以最大程度确保画面的稳定,也可以利用这项功能拍摄快速移动的目标。

电子防抖(ASR)。提高快门速度达到图像稳定的效果。

光学防抖。镜头内的陀螺仪侦测到微小的移动,并且会将信号传至微处理器立即计算需要补偿的位移量,然后通过补偿镜片组,根据镜头的抖动方向及位移量加以补偿,从而有效的克服因相机的振动产生的影像模糊。

MPP (Media Process Platform)& MPI(MPP Programe Interface)

海思提供的媒体处理软件平台(Media Process Platform,简称MPP),可支持应用软件快速开发。该平台对应用软件屏蔽了芯片相关的复杂的底层处理,并对应用软件直接提供MPI(MPP Programe Interface)接口完成相应功能。

该平台支持应用软件快速开发以下功能:输入视频捕获、H.264/MJPEG/JPEG/MPEG4 编码、H264/VC1/MPEG4/MPEG2/AVS 解码、视频输出显示、视频图像前处理(包括去噪、增强、锐化、Deinterlace)、编码码流叠加OSD、视频侦测分析、智能分析、音频捕获及输出、音频编解码等功能。

PWM(Pulse Width Modulation)

脉冲宽度调制是利用微处理器的数字输出来对模拟电路进行控制的一种非常有效的技术。其根据相应载荷的变化来调制晶体管基极或MOS管栅极的偏置,来实现晶体管或MOS管导通时间的改变,从而实现开关稳压电源输出的改变。这种方式能使电源的输出电压在工作条件变化时保持恒定,是利用微处理器的数字信号对模拟电路进行控制的一种非常有效的技术。

CVBS

复合同步视频广播信号,分为PAL和NTSC

PAL & NTSC

目前世界上彩色电视主要有三种制式,即NTSC、PAL和SECAM制式,三种制式目前尚无法统一,不能互相兼容。NTSC与PAL制式的主要区别的是每秒帧数不同,NTSC为29/秒,PAL为25/秒。PAL制式使用的分辨率720576,而NTSC制式使用的是760480。中国(含香港地区)、印度、巴基斯坦等国家采用PAL制式,美国、日本、韩国以及中国台湾地区等采用NTSC制式。

标定

利用摄像机所拍到的图像来还原空间中的物体时,拍摄的图像与真实物体之间存在一定关系,求解这个关系矩阵的过程就叫标定。进行摄像机标定的目的:求出相机的内、外参数,以及畸变参数。标定相机后通常是想做两件事:一个是由于每个镜头的畸变程度各不相同,通过相机标定可以校正这种镜头畸变矫正畸变,生成矫正后的图像;另一个是根据获得的图像重构三维场景。

图像坐标系

以像素为单位的坐标系

相机坐标系

以相机光心为原点,X轴、Y轴与图像X轴、Y轴平行,Z轴为相机光轴,与图像平面垂直的直角坐标系。

世界坐标系

在环境中选择一个参考坐标系描述相机与物体之间位置的坐标系。

相机内参数

与相机自身特性相关的参数,如焦距,像素大小等

相机外参数

在世界坐标系中的参数,如相机位置,选择方向等

OSD叠加技术(On-Screen Display)

将图片和文字信息叠加到视频信号的技术。

ADPCM (ADPCM Adaptive Differential Pulse Code Modulation)

自适应差分脉冲编码调制。ADPCM 是一种针对16bit (或者更高) 声音波形数据的一种有损压缩算法, 它将声音流中每次采样的 16bit 数据以 4bit 存储, 所以压缩比1:4。

G.711

一种音频编码方式。

G.726

G.726是一种基于以16-40 kbit/s 比特率运行的 ADPCM 的 ITU-T 语音编解码算法。.G.726可将64kbps的PCM信号转换为40kbps、32kbps、24kbps、16kbps的ADPCM信号。

AEC(Automatic Echo Cancellation)

自动回音消除

AGC

自动增益补偿(调节麦克风音量)

OTP(One Time Programable)

一次性可编程,写入OTP寄存器后就不能更改

NVM(Non-Volatile Memory)

非易失性存储

POR(Power-on-reset)

上电复位

LSADC

数模转换器的一种型号

RMII

简化媒体独立接口,是用来传输以太网包的

FAE(Field application Engineer)

现场技术支持工程师

数码变焦(Digital Zoom)

变焦是镜头的另一个重点。所谓的变焦能力包括光学变焦(optical zoom),数码变焦(digital zoom)和双摄变焦(Hybrid zoom)等多种。虽然都有有助于望远拍摄时放大远方物体,但是只有光学变焦可以支持图像主体成像后,增加更多的像素,让主体不但变大,同时也相对更清晰。数码变焦通过数码相机内部的处理器将图片内每个像素面积增大(插值法)

反差对焦

图像最清晰的点也是对比度最大的点。相机会驱动镜头,沿着指向被摄物的轴线改变对焦点,并在每个对焦点上获取影像,类似于逐点扫描,先将每一个焦点上获得的影像数字化,数字化后的影像实际是一个整数矩阵,并传递给图像处理器,然后计算反差量,对比筛选出反差最大的,驱动镜头,将焦点放置于反差值最大的焦点上,即得到正确的焦点,并根据反差量最大的值确定是否合焦,即对焦完成。

PDAF

相位对焦(Phase Detection Auto Focus),在感光元件上预留一些遮蔽像素点,专门用于相位检测,通过像素间的距离及其变化等来决定对焦的偏移值来实现准确对焦

FPS(Frame Per Second)

PCK(Pixel Clock)

每秒钟所能扫描的像素点数。

FLL(Frame Length Line)

一帧画面需要扫描的行数。

LLP(Line Length PixelClock)

一行需要扫描的PCK数

水平消隐(HBlank)& 垂直消隐(VBlank)

电子枪从左到右画出象素,它每次只能画一条扫描线,画下一条之前要先回到左边并做好画下一条扫描线的准备,这之间有一段时间叫做水平消隐(HBlank)。在画完全部256条扫描线之后它又回到屏幕左上角准备下一次画屏幕(帧),这之间的一段时间就是垂直消隐(VBlank)。电子枪就是在不断的走‘之’字形。

视频显示输出方式

第一代是CVBS,第二代是S-VIDEO,第三代是VGA,第四代是DVI,第五代是HDMI

CVI

大华推出的同轴电缆高清视频传输规范

TVI(Transport Video Interface)

一种基于同轴电缆的高清视频传输规范,海康是代表厂家

AHD(Analog High Definition)

模拟高清,能够在已有的模拟传输线上实现超长距离(500米)高清视频信号的可靠传输,传输的信号为模拟高清信号

XVI

雄迈研发发同轴高清传输方式

SDI(Serial Digital Interface)

数字串行接口,不受传输网络影响,不会有IP网络监控产生的图像延迟问题,在有实时监控和高清要求的场合

模拟高清

在同轴电缆上传输高清视频,规范分为:CVI,TVI,AHD,SDI

PTZ(Pan/Tail/Zoom)

Pan/Tail/Zoom,表示云台全方位移动、镜头变倍、镜头变焦控制

SMPTE(The Society of Motion Picture and Television Engineers)

目前在影音工业中得到广泛应用的一个时间码概念。该码用于设备间驱动的时间同步,计数方式 ,主要参数格式是:Hours:Minutes:Second : Frames

数字横向溢出(DLO,Digital Lateral Overflow)

一种将多幅不同曝光时间的图片合成HDR图像的处理技术,适用于物体移动非常迅速的场景。使用高曝光的低位,中曝光的中位,低曝光的高位合成。

MC(Motion Compensation)

运动补偿

MTF(Modulation Transfer Function)

调制传递函数,是分析镜头质量的一个参考标准。

显色指数

用来衡量某一光源照射下所能看到的颜色与在自然光照射下,所能看到的颜色在之间的比值,即Ra=在某一光源照射下所能看到的颜色÷在自然光照射下所能看到的颜色,Ra愈接近100%,表明在该光源照射下,所显现的颜色与在自然光照射下所显现的颜色的差异就愈小。

coeff

Coefficients of a polynomial 回归系数。

可见光

波长范围:380-780nm之间的光

常用数字视频标准

BT656:SDTV 标准清晰度电视,YUV422;BT1120:HDTV 高清电视,YUV420;

QP值

QP值对应量化步长的序号,对于亮度而言,此值范围为0~51 。值越小,量化步长越小,量化的精度就越高,意味着同样画质的情况下,产生的数据量可能会更大。

IoV(Internet of Vehicles)

车联网

V2X(vehicle to everything)

车对车的信息交换。

FCW(Forward Collision Warning)

前方碰撞预警

LDW(Lane Departure Warning)

车道偏离预警

LKP

驾驶员状态监测

ANV

主动夜视系统

LCA

变道辅助系统

APS

自动泊车系统

BSD

盲区监测系统

AVM(Around View Monitor)

全景环视系统

HAL(Hardware Abstract Layer )

硬件抽象层,Google应厂商希望不开源的要求下,在Andriod中提出的层,硬件厂商可以将包含硬件重要参数的驱动写到HAL层,代码可以闭源。

OSAL(Operating System Abstraction Layer)

操作系统抽象层,功能是协议栈调度,它采用一个链表结构来管理协议栈各层相应的任务;通过为事件设置超时等待时间,一旦等待时间结束,便为对应任务设置事件发生标志,从而达到对事件进行延时处理目的;一旦调用了下层相关函数后,就立即返回,下层处理函数在操作结束后,将结果以消息的形式发送到上层并产生一个系统事件,调度程序发现这个事件后就会调用相应的事件处理函数对它进行处理。

DSI(Display Serail Interface)

定义了一个位于处理器和显示模组之间的高速串行接口

CSI(Camera Serail Interface)

定义了一个位于处理器和摄像模组之间的高速串行接口

IPC(IP Camera)

网络摄像机

Fakra

2000年时,由德国车厂为首的欧美12家车厂,共同推出的一种汽车用音响与天线规格接头

DCPC(Distortion/Perspective Correction)

畸变/透视矫正

ADAS(Advanced Driver Assistant System)

先进驾驶辅助系统,利用安装在车上的各式各样的传感器,在第一时间收集车内外环境数据,进行静态、动态物体识别,侦测与追踪等技术的处理,使驾驶者最快察觉可能危险的系统。