Pytorch-4.1 Fine tuning 模型微调

4.1 Fine tuning 模型微调

4.1.1 什么是微调

针对于某个任务,自己的训练数据不多,那怎么办?我们先找到一个同类的别人训练好的模型,把别人现成的训练好了的模型拿过来,换成自己的数据,调整一下参数,再训练一遍,这就是微调(fine-tune)。

为什么要微调

- 对于数据集本身很小(几千张图片)的情况,从头开始训练具有几千万参数的大型神经网络是不现实的,因为越大的模型对数据量的要求越大,过拟合无法避免。这时候如果还想用上大型神经网络的超强特征提取能力,只能靠微调已经训练好的模型。

- 可以降低训练成本:如果使用导出特征向量的方法进行迁移学习,后期的训练成本非常低,用 CPU 都完全无压力,没有深度学习机器也可以做。

- 前人花很大精力训练出来的模型在大概率上会比你自己从零开始搭的模型要强悍,没有必要重复造轮子。

迁移学习 Transfer Learning

迁移学习初衷是节省人工标注样本的时间,让模型可以通过一个已有的标记数据的领域向未标记数据领域进行迁移从而训练出适用于该领域的模型,直接对目标域从头开始学习成本太高,我们故而转向运用已有的相关知识来辅助尽快地学习新知识。

(推荐博客:https://blog.csdn.net/dakenz/article/details/85954548)

迁移学习按照学习方式可以分为基于样本的迁移,基于特征的迁移,基于模型的迁移,以及基于关系的迁移等。

4.1.2 如何微调

对于不同的领域微调的方法也不一样,比如语音识别领域一般微调前几层,图片识别问题微调后面几层。(待细学)

4.1.3 注意事项

- 新数据集和原始数据集合类似,那么直接可以微调一个最后的FC层或者重新指定一个新的分类器

- 新数据集比较小和原始数据集合差异性比较大,那么可以使用从模型的中部开始训练,只对最后几层进行fine-tuning

- 新数据集比较小和原始数据集合差异性比较大,如果上面方法还是不行的化那么最好是重新训练,只将预训练的模型作为一个新模型初始化的数据

- 新数据集的大小一定要与原始数据集相同,比如CNN中输入的图片大小一定要相同,才不会报错

- 如果数据集大小不同的话,可以在最后的fc层之前添加卷积或者pool层,使得最后的输出与fc层一致,但这样会导致准确度大幅下降,所以不建议这样做

对于不同的层可以设置不同的学习率,一般情况下建议,对于使用的原始数据做初始化的层设置的学习率要小于(一般可设置小于10倍)初始化的学习率,这样保证对于已经初始化的数据不会扭曲的过快,而使用初始化学习率的新层可以快速的收敛。

4.1.4 微调实例

导入相关库

%matplotlib inline

import torch,os,torchvision

import torch.nn as nn

import torch.nn.functional as F

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

from torch.utils.data import DataLoader, Dataset

from torchvision import datasets, models, transforms

from PIL import Image

from sklearn.model_selection import StratifiedShuffleSplit

torch.__version__

这里面我们使用官方训练好的resnet50来参加kaggle上面的 dog breed 狗的种类识别来做一个简单微调实例。

首先我们需要下载官方的数据解压,只要保持数据的目录结构即可,这里指定一下目录的位置,并且看下内容

DATA_ROOT = 'data'

all_labels_df = pd.read_csv(os.path.join(DATA_ROOT,'labels.csv'))

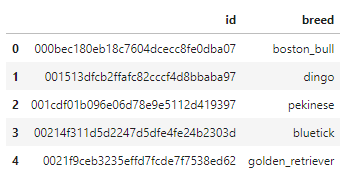

all_labels_df.head()

在Kaggle上的代码:

可以直接在Kaggle上导入Kaggle竞赛的数据Dog Breed Identification

DATA_ROOT = '../input/dog-breed-identification'

#../input/dog-breed-identification/labels.csv

all_labels_df = pd.read_csv(os.path.join(DATA_ROOT,'labels.csv'))

all_labels_df.head()

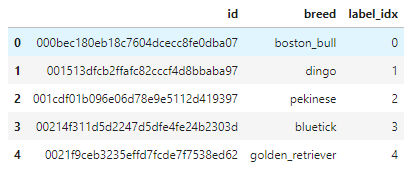

获取狗的分类根据分类进行编号

这里定义了两个字典,分别以名字和id作为对应,方便后面处理

breeds = all_labels_df.breed.unique()

breed2idx = dict((breed,idx) for idx,breed in enumerate(breeds))

idx2breed = dict((idx,breed) for idx,breed in enumerate(breeds))

len(breeds)#120

添加到列表中

all_labels_df['label_idx'] = [breed2idx[b] for b in all_labels_df.breed]

all_labels_df.head()

#由于我们的数据集不是官方指定的格式,我们自己定义一个数据集

class DogDataset(Dataset):

def __init__(self, labels_df, img_path, transform=None):

self.labels_df = labels_df

self.img_path = img_path

self.transform = transform

def __len__(self):

return self.labels_df.shape[0]

def __getitem__(self, idx):

image_name = os.path.join(self.img_path, self.labels_df.id[idx]) + '.jpg'

img = Image.open(image_name)

label = self.labels_df.label_idx[idx]

if self.transform:

img = self.transform(img)

return img, label

# 定义一些超参数

IMG_SIZE = 224 # resnet50的输入是224的所以需要将图片统一大小

BATCH_SIZE= 256 #这个批次大小需要占用4.6-5g的显存,如果不够的化可以改下批次,如果内存超过10G可以改为512

IMG_MEAN = [0.485, 0.456, 0.406]

IMG_STD = [0.229, 0.224, 0.225]

CUDA=torch.cuda.is_available()

DEVICE = torch.device("cuda" if CUDA else "cpu")

# 定义训练和验证数据的图片变换规则

train_transforms = transforms.Compose([

transforms.Resize(IMG_SIZE),

transforms.RandomResizedCrop(IMG_SIZE),

transforms.RandomHorizontalFlip(),

transforms.RandomRotation(30),

transforms.ToTensor(),

transforms.Normalize(IMG_MEAN, IMG_STD)

])

val_transforms = transforms.Compose([

transforms.Resize(IMG_SIZE),

transforms.CenterCrop(IMG_SIZE),

transforms.ToTensor(),

transforms.Normalize(IMG_MEAN, IMG_STD)

])

我们这里只分割10%的数据作为训练时的验证数据

# 使用官方的dataloader载入数据

image_transforms = {'train':train_transforms, 'valid':val_transforms}

train_dataset = DogDataset(train_df, os.path.join(DATA_ROOT,'train'), transform=image_transforms['train'])

val_dataset = DogDataset(val_df, os.path.join(DATA_ROOT,'train'), transform=image_transforms['valid'])

image_dataset = {'train':train_dataset, 'valid':val_dataset}

image_dataloader = {x:DataLoader(image_dataset[x],batch_size=BATCH_SIZE,shuffle=True,num_workers=0) for x in dataset_names}

dataset_sizes = {x:len(image_dataset[x]) for x in dataset_names}

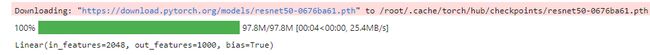

开始配置网络,由于ImageNet是识别1000个物体,我们的狗的分类一共只有120,所以需要对模型的最后一层全连接层进行微调,将输出从1000改为120

model_ft = models.resnet50(pretrained=True) # 这里自动下载官方的预训练模型,并且

# 将所有的参数层进行冻结

for param in model_ft.parameters():

param.requires_grad = False

# 这里打印下全连接层的信息

print(model_ft.fc)

num_fc_ftr = model_ft.fc.in_features #获取到fc层的输入

model_ft.fc = nn.Linear(num_fc_ftr, len(breeds)) # 定义一个新的FC层

model_ft=model_ft.to(DEVICE)# 放到设备中

print(model_ft) # 最后再打印一下新的模型

print(model_ft.fc)

criterion = nn.CrossEntropyLoss()

optimizer = torch.optim.Adam([

{'params':model_ft.fc.parameters()}

], lr=0.001)#指定 新加的fc层的学习率

定义训练函数

def train(model,device, train_loader, epoch):

model.train()

for batch_idx, data in enumerate(train_loader):

x,y= data

x=x.to(device)

y=y.to(device)

optimizer.zero_grad()

y_hat= model(x)

loss = criterion(y_hat, y)

loss.backward()

optimizer.step()

print ('Train Epoch: {}\t Loss: {:.6f}'.format(epoch,loss.item()))

定义测试函数

def test(model, device, test_loader):

model.eval()

test_loss = 0

correct = 0

with torch.no_grad():

for i,data in enumerate(test_loader):

x,y= data

x=x.to(device)

y=y.to(device)

optimizer.zero_grad()

y_hat = model(x)

test_loss += criterion(y_hat, y).item() # sum up batch loss

pred = y_hat.max(1, keepdim=True)[1] # get the index of the max log-probability

correct += pred.eq(y.view_as(pred)).sum().item()

test_loss /= len(test_loader.dataset)

print('\nTest set: Average loss: {:.4f}, Accuracy: {}/{} ({:.0f}%)\n'.format(

test_loss, correct, len(val_dataset),

100. * correct / len(val_dataset)))

训练9次,看看效果

for epoch in range(1, 10):

%time train(model=model_ft,device=DEVICE, train_loader=image_dataloader["train"],epoch=epoch)

test(model=model_ft, device=DEVICE, test_loader=image_dataloader["valid"])