对抗攻击层出不穷?神经科学带来新突破、导出智能统一框架,Hinton:我早有洞见...

最近的神经科学研究指出了如何击败对抗性示例,并为实现更具弹性、一致性和灵活性的人工智能指明了道路。

编译 | bluemin

转载自:AI科技评论

对抗性示例是当今深度学习研究的热点。数据中微妙的,通常是无形的更改可能会使深度学习网络铸成大错。作为人类,我们似乎对这些输入感官的扰动更具抵抗力(尽管并非完全免疫)。

在深度学习系统中有一种特定的工作模式,看上去卓尔不凡,但有时不堪一击。就像暴风雨中的一棵僵硬的树一样,它们看上去雄伟壮观,但随时都可能毫无征兆地裂开。为什么会发生这种情况,我们如何改善这种情况?

随着神经科学领域的新研究相继展开,谜团逐渐明晰化。在本文中,我们将对其进行探讨。

科学家兼企业家Jeff Hawkins在他最近出版的著作《千脑:新的智力理论》(A Thousand Brains: A New Theory of Intelligence,本文作者最欣赏的一部杰作)中,剖析了团队对新大脑皮层进行的最新研究,他们发现,负责人类高级智能的区域占据大脑容量的70%。(另外30%是古老原始化的低级神经活动区域)。

这是一次迷人的旅程,Jeff Hawkins将我们带入了人类智力的震中。他分享道:

新大脑皮层中的环路纷繁复杂。仅仅一平方毫米,就有大约十万个神经元,数十亿个连接(突触)以及数千米长的轴突和树突。

新皮层在各方面看起来都非常相似。区域之间的差异很小。

新大脑皮层的所有区域似乎都与运动的产生和运动任务有关。在大脑皮层的每一个区域,科学家们都发现了和旧皮层中与运动有关的区域相联系的细胞。

1

一个环路统治天下

Vernon Mountcastle是美国著名的神经生理学学家,约翰·霍普金斯大学的神经学名誉教授。他是皮质柱状结构的发现者。他提出,我们的新大脑皮层基本上是通过反复复制相同的内容和相同的基本环路,得到进化从而日益强大。

当在Jeff的书中读到Mountcastle的想法时,我想起了伟大的科学家Robert Sapolsky的精彩演讲。Sapolsky在回答有关黑猩猩与人类之间区别的问题时(https://www.youtube.com/watch?v=AzDLkPFjev4)解释道,黑猩猩和人类之间基因表达的差异大约有一半与编码嗅觉受体的基因有关,其他差异与骨盆弓的大小、体毛的数量、免疫系统识别能力、生殖隔离的某些方面等有关;上述因素以及其他因素几乎解释了黑猩猩和人类之间所有的基因差异。那么,与人脑相关的基因差异在哪里呢?Sapolsky解释说,几乎不存在差异,而且鉴定出的少数基因与胎儿大脑发育过程中细胞分裂的轮数有关。人类的神经元数目基本上是黑猩猩的3倍。这种规模上的差异似乎是人类具备高级智力的关键。

这与Mountcastle的想法异曲同工,即单一环路可以被多次复制(规模至关重要,但规模是否足以推动当今的深度学习系统朝通用人工智能(AGI)方向发展?接下来继续探讨)。

我们的新大脑皮层的所有区域都基于相似的原理,在同一个基本环路上工作,这符合我们大脑在不同场景中表现出的灵活性。如果规模至关重要,这是否意味着GPT-11能让我们更接近AGI?

但是这谈何容易?因为Jeff在他的书和理论中阐明了房间中的存在一头巨大的大象。这是一个我们忽略了太久的问题。

2

15万根皮质柱

在去参观房间里的大象之前,让我们先了解一下背景知识。根据科学家的说法,我们的新皮层中大约有15万根皮质柱。Jeff告诉我们可以将这些柱子看作是细细的意大利面条。因此想象一下15万根细细的意大利面条彼此相依的场景。隐喻地说,你的新大脑皮层就是这种情况。

这些皮质柱内发生了什么?在过去的几年里,科学家们逐渐认识到:大脑是一个预测机器。它生成了一个世界模型,并不断预测接下来会发生什么。

当我们大脑的预测不正确时,我们意识到有些事情不对,大脑就会更新它的世界模型。随着时间的推移,我们的世界模型变得缤纷复杂。

因此,从某种意义上说,我们确实生活在模拟环境中。因为我们所感知到事物的其实是大脑构建的模型,而不是外面的“现实”。这就解释了幻肢以及其他类似的情况。

Jeff Hawkins指出,我们的大脑通过关注它所接收的输入在我们移动时(或那些输入在移动时)是如何变化的来学习世界模型的。这就把我们带到了房间里的大象那里。

3

房间里的大象

世界在不断变化。一切都在运动中。随着事物的运动和变化,我们的大脑不断更新我们的世界模型(我们很快就会看到很多模型)是有一定道理的。

正如近年来注意力机制彻底改变了深度学习领域一样,注意力也是我们大脑学习这些模型的关键。

但是,如果我们的新大脑皮层不断做出大量的预测,并逐渐适应其模型和感知之间的任何偏差,为什么我们没有察觉到这些全部的预测,而是感知一个连续的现实呢?让我们一步一步地解开谜团。

通过最新研究,Jeff和他的团队获得了一些有趣的见解:

我们的每一根皮质柱(大概总计15万根)都在学习世界、物体、概念以及任何你能想象的事物的模型。他们提出,正如我们的旧皮层拥有位置细胞和格点细胞来建立周围环境的模型一样,新皮层也具有等效的细胞,这些细胞可以让大脑建立物体、概念等的模型。皮质柱使用的是Jeff所称的参考系,这些参考系就像具有多个维度的网格,可以帮助大脑组织任何种类的知识。

Jeff告诉我们,思维是一种运动形式。当我们在这些参考系中改变位置时,思考油然而生。所以你正在想什么,或者你的脑子里正在想什么,取决于你的大脑皮质柱此刻在不同的参考系中的位置。当你的大脑在这些结构中导航时,你的思维会不断进化。

请注意,运动的概念开始无处不在。运动和系统的动态本质是房间里的大象。我们将很快讨论这与对抗性示例问题以及当今深度学习的局限性有何联系。

因此,这全都与参考系或地图、物理空间地图、概念地图以及任何事物的地图有关。Jeff告诉我们,就像旧皮层中的参考系一直在学习不同环境的地图一样,新大脑皮层中的参考系一直在学习目标地图(在他们称为“what”柱的情景下),或者人体周围的空间(在“where”柱的情景下),或者在非感官柱内部的概念图。

我很喜欢Jeff所用的类比,即我们需要找到一种好方法来组织对某个领域掌握的知识,我们需要内在地创建该领域的出色参考系或地图,这样才能成为任何领域的专家。想想那些深刻而复杂的参考系,例如,莱奥纳多·达·芬奇或爱因斯坦为了在各自的专业领域内取得卓越成绩而拥有的参照系。

言归正传,我们的150000个大脑皮质柱中的每一个都在学习一个世界预测模型,因为它关注输入随时间的变化。每个皮质柱都学习大量元素、物体、概念等的模型。

因此,我们对任何事物(一个对象或一个概念)所具备的知识都分布在成千上万的皮质柱和成千上万的互补模型中。这与Jeff理论的名字(千脑)有关。

所有这些都与我们大脑的灵活性有关。我们的新大脑皮层不依赖于单个皮质柱。知识分布在成千上万的皮质柱中。因此,即使受伤损坏了一组皮质柱,大脑仍会继续工作(学术文献中这样的例子不胜枚举)。

接下来要考虑的是:如果每次运动发生时大脑都在生成新的预测,那么这些预测将存储在哪里?

Jeff和他的团队提出神经元不同树突上出现的尖峰包含预测信息的观点(树突是神经元的分支,通过突触接收输入)。树突尖峰使与之相连的细胞进入杰夫所说的预测状态。因此,预测发生在神经元内部。这些预测改变了神经元的电特性,使其比其他情况下更快地启动,但这些预测并没有通过轴突传递给其他神经元,这就解释了为什么我们意识不到大多数神经元的预测。现在的问题是:我们如何确定特定的预测?

4

表决一致

我们对现实的感知是投票过程的结果。不同的皮质柱通过投票达成共识,这就是产生单一感知的原因,该感知将来自系统不同部分的不同预测统一起来(这也可能与不同类型的感官输入有关)。

只有某些细胞需要投票,例如,代表我们正在感知的特定物体的细胞。那么它们如何投票?

我们大脑皮质柱中的大部分连接都在新皮层的不同层进行上下移动。但也有例外。科学家发现,有一些细胞通过新皮质将轴突(输出连接)从一侧传送到另一侧。Jeff和他的团队认为,这些具有长距离连接的细胞是负责投票的细胞。

当我们识别出一个物体时,我们的皮质柱已经就我们所看到的东西达成了共识。我们每个皮质柱中的投票单元(神经元)会形成一个稳定的模式,表征该物体以及该物体相对于我们的位置。

只要我们不断地感知同一个物体,当我们保持与这个元素互动时,这些投票神经元的状态就不会改变。当我们移动或物体移动时,其他神经元会改变它们的状态,但投票神经元会保持稳定。

这就是为什么我们的感知是稳定的,而我们没有意识到与正在发生的移动预测有关的活动的波动。我们只是知道最终的稳定模式源自投票细胞所达成的共识。

因此:

运动是我们大脑感知世界的关键。正是由于运动(改变了我们自身或我们周围的某个世界),我们的大脑才能丰富其内部的物体和概念模型(运动不必是物物理的,可以采用虚拟形式等等)。

使用单一原则处理各种输入,为与我们互动的每个元素创建成千上万的预测和模型,使这些模型丰富多彩。

通过投票达成的共识机制意味着我们对世界的感知是稳定的,同时灵活且富有弹性。

现在该回到对抗性示例和深度学习领域状况的探讨了。

5

如何击败对抗性示例?

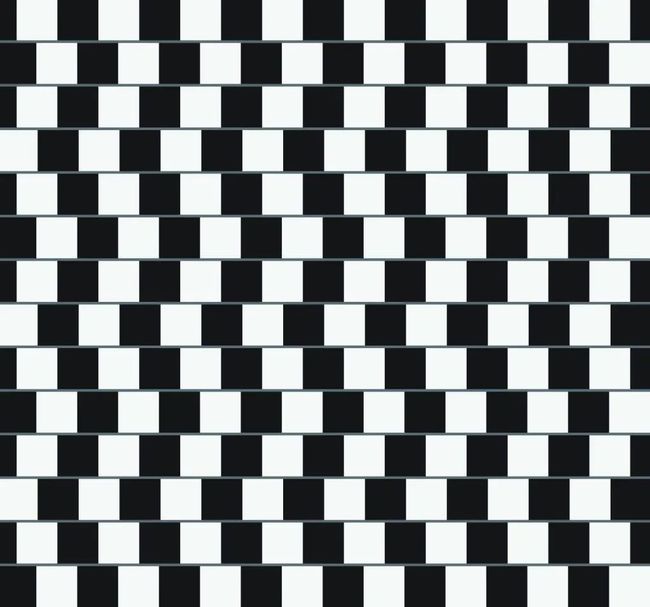

人类其实也会受对抗性示例的影响。感官输入中的扰动会使我们感到困惑,并使我们误解事物。我们大多数人都经历过各种各样的视觉错觉。然而,总的来说,我们的认知始终如一,而且富有弹性,肯定比我们在今天的深度学习系统中发现的更加一致,在这个系统中,无形的变化会完全破坏我们的结果。

经典视错觉图像(图中的横线是平行的吗?)

这种弹性、一致性和灵活性的背后是什么?无论是什么,它可能包括以下部分:

我们的大脑皮质柱基于运动和设立的参考系建立模型。当我们在周围移动或世界在我们周围移动时,我们的大脑会对每一个物体或概念产生成千上万的预测和模型。这体现了灵活性。我们不是把所有的鸡蛋放在一个篮子里。就像我们在深度学习中使用集成模型一样,我们在这个问题上下的赌注是上千个角度,而不仅仅是一个角度。

我们的感知形成以多模态和稳定的投票动态为基础。针对特定物体(或概念等)创建的不同模型正在应用多种预测,这些预测通常与不同的感官模式(视觉、触觉、听觉、手势等)相关。在负责最终表征的细胞之间进行投票生成稳定的模式,这些模式对变化具有弹性。物体或环境的微小变化不会破坏稳定的投票模式,因为这种模式是基于数千个独立预测的组合,而这些预测又是基于许多不同的角度、视角,并且通常是不同感官模式的组合。就像集成模型在Kaggle竞赛中非常受欢迎一样,投票模式也是一种在大脑中进行的集成学习,使我们人类的感知兼具稳定性、弹性和灵活性(当然这是相对而言,但与当前的深度学习系统相比,尤其如此)。

因此深度学习中的对抗性示例就此“终结”。而“终结”并不意味着绝对的结束,仅仅是达到一个类似于我们人类具备的弹性、一致性和灵活性的水平,将有可能结合以下几点:

运动:物理或虚拟。深度学习系统需要在其移动或或周围世界移动时,通过丰富其内部模型收集关于世界的不同观点和角度。机器人技术和人工智能必须进一步融合。除了机器人技术之外,运动也可以是虚拟的,所以这一原则超越了物理性。

模型集成:我们必须超越单一的表示形式或模型。为了适应对抗性示例和其他挑战,深度学习需要生成大量预测和不断更新的模型。然后投票机制可以创建稳定的模式和表示形式,从而更灵活地抵御对抗性扰动。

连续学习:外部世界不容等待。上述的一个结果是,学习需要锲而不舍。如今,深度学习系统过于静态化。持续学习是一个活跃的研究领域,其重要性只会有增无减。

参考系:我们可以从Jeff Hawkins在他的书和理论中描述的参考系中找到关于如何建立我们的表征和模型的许多灵感。正如Jeff所指出的那样,像 Hinton 这样的深度学习领导者已经在致力于使深度学习模型更加灵活的过程中研究了一段时间(请参阅胶囊网络)。但是前路漫漫,最新的神经科学研究正以新的迹象强化这一方向,而且会日益凸显;与深度学习模型相比,我们的大脑更灵活,更有弹性,现在我们开始理解为什么。

研究检测对抗性示例的新方法是一个有趣的领域,相关的学术活动不计其数。现在缺少的是重新思考我们的深度学习架构和系统,从当前的静态范式过渡到基于多模态、多模型、基于共识的预测系统(具有弹性、一致性和灵活性)的动态范式。当我们实现这一点时,我们将能够隐藏或扰乱系统的某些部分,并且仍然保持稳定的预测。

正如Jeff指出的那样,当我们尝试将AI系统应用于对灵活性和弹性需求量大的场景时,这将愈发关键。

Mountcastle的想法,Sapolsky的想法和我们对GPT架构的痴迷,所有这些都表明了规模的重要性。规模至关重要。拥有3倍多的神经元,或同一基本环路的数千个副本,或数千亿个参数而不只是10亿个,所有这些都很重要。

对于深度学习领域的现状来说,这是个好消息。在GPT系统这样的项目中,我们发现并确认了一个事实,即规模很重要!

但是,我们也开始意识到,与规模同等重要的一点是,它将不足以带我们到达理想殿堂。

如果你在一系列媒体中关注GPT-3这样的系统的最新对话,比如机器学习街谈播客,你会听到类似的结论。GPT-3的亮相令人印象深刻,但它也有点不堪一击,而且常常感觉像黑客。这与人类大脑的弹性和灵活性无关。

规模很重要,但运动亦如此。我们不能仅仅通过强调规模来逃避运动和变化。世界就像一场永不停息的风暴。

我们是一棵越来越大的静态树,但由于缺乏随风而动的能力,因此不断地分裂。

思维是一种运动。通过参考系进行运动。在共识机制统一的成千上万的预测和模型间运动。

6

唯有运动才能向前

后记:Pedro Domingos在他的《终极算法》一书中写到了与深度学习相关的不同范式:符号论者,连接论者,进化论者,贝叶斯论者和类推论者。显然,通向AGI的道路可能会是许多不同的途径和方法的组合。关于Jeff及其团队的工作和理论,正如Kenneth Stanley教授所说,我遵循的是一个兴趣梯度(与Jeff的工作有关的梯度幅度非常大)。作者看来,Jeff的理论和工作(以及他所有才华横溢的团队)能够支撑起非常有趣和有用的垫脚石,这可以使我们更接近AGI(或者至少他们的研究可以将我们引向这些垫脚石)。确实如此,我们可以通过许多不同的方式实现AGI,获取具有足够弹性和灵活性的智能系统仍任重道远。因此,深入探索来自神经科学的最新研究可能会为我们指明通往AGI的道路上有用的垫脚石,这将意义非凡。

原文链接:

https://towardsdatascience.com/towards-the-end-of-deep-learning-and-the-beginning-of-agi-d214d222c4cb