参数估计、点估计、极大似然估计

快速了解:

参数估计,估计的是随机变量分布的参数。可以先去博主的另一篇文章了解随机变量及其分布。

所谓分布的参数,例如正态分布 X X X~ N ( u , σ 2 ) N(u,\sigma^2) N(u,σ2), u , σ u,\sigma u,σ就是正态分布的参数。

后面要讲的点估计就是已知总体的一个样本,估计分布的参数。例如知道正态分布的一个样本,估计总体参数 u u u, σ \sigma σ。

参数估计指估计分布的参数。

点估计,是已知一个样本集的情况下,估计分布的参数。

1 参数估计

随机变量 X X X的分布函数已知,但它的一个或多个参数未知,根据已有样本,估计 X X X分布的参数。

2 点估计

根据 X X X的一个样本集估计总体未知参数的问题称为参数的点估计问题。

点估计问题的一般提法为:

设总体 X X X的分布函数 F ( x ; θ ) F(x;\theta) F(x;θ)的形式已知, θ \theta θ是待估参数。

X 1 , X 2 , ⋅ ⋅ ⋅ , X n X_1,X_2,\cdot \cdot \cdot,X_n X1,X2,⋅⋅⋅,Xn是 X X X的一个样本集, x 1 , 2 2 , ⋅ ⋅ ⋅ , x n x_1,2_2,\cdot \cdot \cdot,x_n x1,22,⋅⋅⋅,xn是对应的样本值。

点估计问题就是要构造一个估计量 θ ^ ( X 1 , X 2 , ⋅ ⋅ ⋅ , X n ) \widehat \theta(X_1,X_2,\cdot \cdot \cdot,X_n) θ (X1,X2,⋅⋅⋅,Xn),用它的观察值 θ ^ ( x 1 , x 2 , ⋅ ⋅ ⋅ , x n ) \widehat \theta(x_1,x_2,\cdot \cdot \cdot,x_n) θ (x1,x2,⋅⋅⋅,xn)作为未知参数 θ \theta θ的近似值。我们称 θ ^ ( X 1 , X 2 , ⋅ ⋅ ⋅ , X n ) \widehat \theta(X_1,X_2,\cdot \cdot \cdot,X_n) θ (X1,X2,⋅⋅⋅,Xn)为 θ \theta θ的估计量, θ ^ ( x 1 , x 2 , ⋅ ⋅ ⋅ , x n ) \widehat \theta(x_1,x_2,\cdot \cdot \cdot,x_n) θ (x1,x2,⋅⋅⋅,xn)为 θ \theta θ的估计值。不致混淆的情况下将估计量和估计值统称为估计,并都简记为 θ ^ \widehat\theta θ 。

由上面对点估计问题的描述,可以看出估计量是样本集的函数,对于不同的样本集 θ \theta θ的估计值一般不同。

下面的极大似然估计法即用于构造估计量。

3 极大似然估计

快速了解

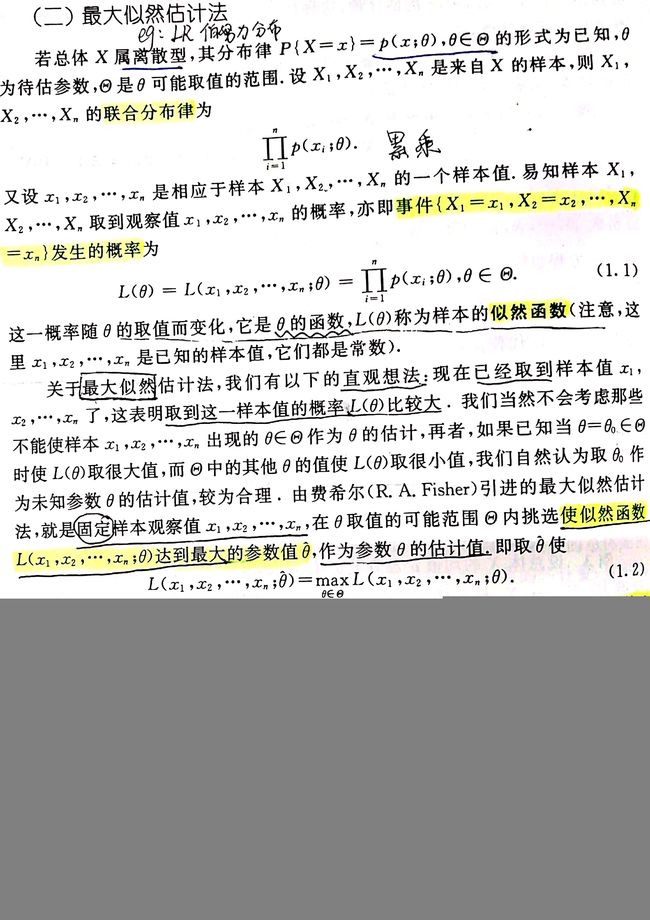

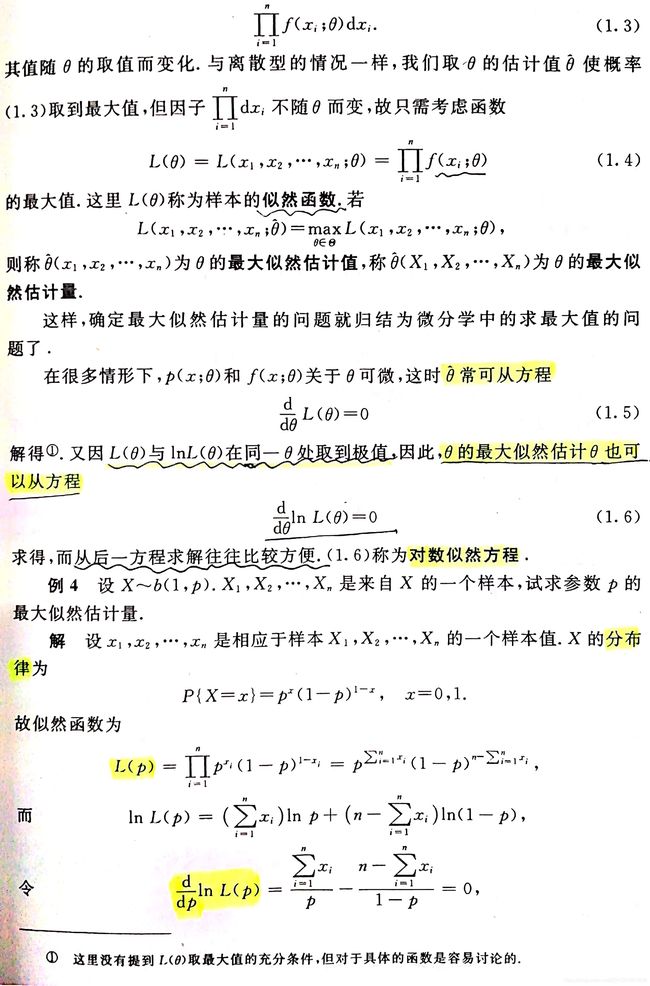

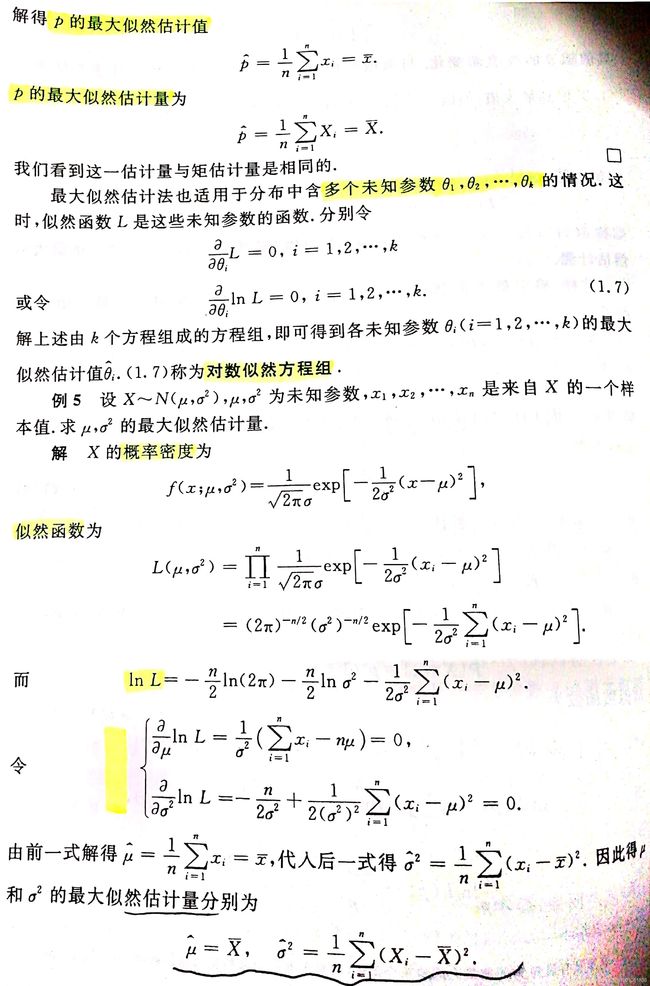

以离散型随机变量为例,进行快速总结:

- X 1 , X 2 , ⋅ ⋅ ⋅ , X n X_1,X_2,\cdot \cdot \cdot ,X_n X1,X2,⋅⋅⋅,Xn的联合分布律

X 1 , X 2 , ⋅ ⋅ ⋅ , X n X_1,X_2,\cdot \cdot \cdot ,X_n X1,X2,⋅⋅⋅,Xn是 X X X的样本集,则 X 1 , X 2 , ⋅ ⋅ ⋅ , X n X_1,X_2,\cdot \cdot \cdot ,X_n X1,X2,⋅⋅⋅,Xn的联合分布律为

∏ i = 1 n p ( x i ; θ ) . \prod_{i=1}^np(x_i;\theta). i=1∏np(xi;θ). - 事件{ X 1 = x 1 , X 2 = x 2 , ⋅ ⋅ ⋅ , X n = x n X_1=x_1,X_2=x_2,\cdot \cdot \cdot ,X_n=x_n X1=x1,X2=x2,⋅⋅⋅,Xn=xn}发生的概率为下式,该事件的概率( L ( θ ) L(\theta) L(θ))称为样本的似然函数。

L ( θ ) = L ( x 1 , x 2 , ⋅ ⋅ ⋅ , x n ; θ ) = ∏ i = 1 n p ( x i ; θ ) L(\theta)=L(x_1,x_2,\cdot \cdot \cdot ,x_n;\theta)=\prod_{i=1}^np(x_i;\theta) L(θ)=L(x1,x2,⋅⋅⋅,xn;θ)=i=1∏np(xi;θ) - 使似然函数 L ( θ ) L(\theta) L(θ)达到最大的参数值 θ ^ \widehat \theta θ ,称为参数 θ \theta θ的最大似然估计值。

- p ( x i ; θ ) p(x_i;\theta) p(xi;θ)关于 θ \theta θ可微,这时 θ ^ \widehat \theta θ 可通过下述方程(对似然函数求导,令其等于0)获得

d d θ L ( θ ) = 0 \frac{d}{d\theta}L(\theta)=0 dθdL(θ)=0 - 因为 L ( θ ) L(\theta) L(θ)与 l n L ( θ ) lnL(\theta) lnL(θ)在同一 θ \theta θ处取到极值,因此, θ \theta θ的最大似然估计也可以从下面的方程求得。从这一方程求解往往更简便。下面的方程称为对数似然方程。

d d θ L ( l n θ ) = 0 \frac{d}{d\theta}L(ln\theta)=0 dθdL(lnθ)=0

关于极大似然估计,下面贴上笔者标注后的浙江大学版《概率论与数理统计》的原文,这篇文章的解释实在是太过棒棒了,经典至极。

至此,困惑笔者已久的极大似然估计,通过随机变量及其分布和本文的复习总结,总算是明白了。呼~ 轻松嘤~

趣味阅读:极大似然估计的能力体现

给出一堆线性数据,用线性回归模拟,线性回归的参数很容易就能求得。

若给出另一堆数据,中间多,两边少,用线性回归就很难模拟,这适合用高斯分布曲线模拟。可是高斯分布的参数难求,这时就显示出极大似然估计的能力了。

参照网址:对数损失函数是如何度量损失的