Keras教学(2):使用Keras搭建LeNet-5卷积神经网络

【写在前面】:大家好,我是【猪葛】

一个很看好AI前景的算法工程师

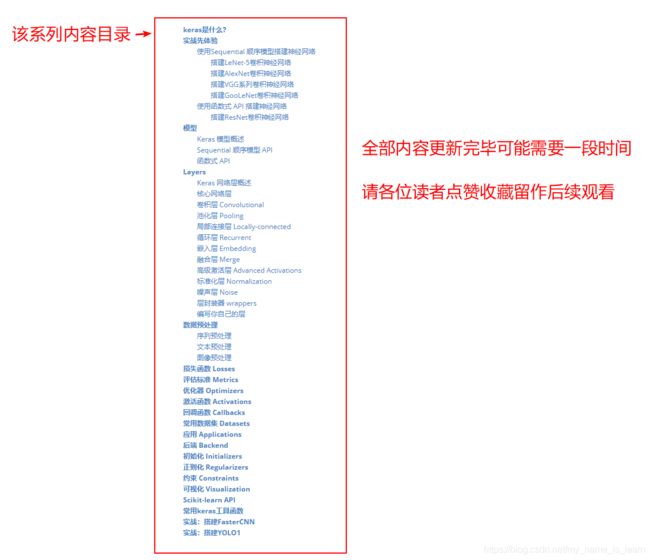

在接下来的系列博客里面我会持续更新Keras的教学内容(文末有大纲)

内容主要分为两部分

第一部分是Keras的基础知识

第二部分是使用Keras搭建FasterCNN、YOLO目标检测神经网络

代码复用性高

如果你也感兴趣,欢迎关注我的动态一起学习

学习建议:

有些内容一开始学起来有点蒙,对照着“学习目标”去学习即可

一步一个脚印,走到山顶再往下看一切风景就全明了了

本篇博客学习目标:1、掌握Sequential顺序模型的搭建方法;2、能自己动手敲一遍并理解LeNet-5网络结构

文章目录

- 一、搭建Sequential 顺序模型相关知识点

-

- 1-1、开始使用 Keras Sequential 顺序模型

- 1-2、指定输入数据的尺寸

- 1-3、模型编译

- 1-4、模型训练

- 1-5、运行几个小例子

-

- 1-5-1、基于多层感知器 (MLP) 的 softmax 多分类

- 1-5-2、基于多层感知器的二分类

- 1-5-3、类似 VGG 的卷积神经网络

- 二、搭建LeNet-5卷积神经网络

-

-

- 2-1、前言

- 2-2、开始搭建LeNet-5网络结构

- 2-3、准备数据

- 2-4、搭配优化器、损失函数、评价指标

- 2-5、开始训练

- 2-6、完整代码

-

一、搭建Sequential 顺序模型相关知识点

1-1、开始使用 Keras Sequential 顺序模型

顺序模型是多个网络层的线性堆叠。

你可以通过将网络层实例的列表传递给 Sequential 的构造器,来创建一个 Sequential 模型:

from keras.models import Sequential

from keras.layers import Dense, Activation

model = Sequential([

Dense(32, input_shape=(784,)),

Activation('relu'),

Dense(10),

Activation('softmax'),

])

也可以简单地使用 .add() 方法将各层添加到模型中:

model = Sequential()

model.add(Dense(32, input_dim=784))

model.add(Activation('relu'))

1-2、指定输入数据的尺寸

模型需要知道它所期望的输入的尺寸。出于这个原因,顺序模型中的第一层(且只有第一层,因为下面的层可以自动地推断尺寸)需要接收关于其输入尺寸的信息。有几种方法来做到这一点:

- 传递一个

input_shape参数给第一层。它是一个表示尺寸的元组 (一个由整数或None组成的元组,其中None表示可能为任何正整数)。在input_shape中不包含数据的 batch 大小 - 某些 2D 层,例如

Dense,支持通过参数input_dim指定输入尺寸,某些 3D 时序层支持input_dim和input_length参数。

因此,下面的代码片段是等价的:

model = Sequential()

model.add(Dense(32, input_shape=(784,)))

model = Sequential()

model.add(Dense(32, input_dim=784))

1-3、模型编译

在训练模型之前,您需要配置学习过程,这是通过 compile 方法完成的。它接收三个参数:

- 优化器 optimizer。它可以是现有优化器的字符串标识符,如

rmsprop或adagrad,也可以是 Optimizer 类的实例(后面会详细介绍)。 - 损失函数 loss,模型试图最小化的目标函数。它可以是现有损失函数的字符串标识符,如

categorical_crossentropy或mse,也可以是一个目标函数(后面会详细介绍)。 - 评估标准 metrics。对于任何分类问题,你都希望将其设置为

metrics = ['accuracy']。评估标准可以是现有的标准的字符串标识符,也可以是自定义的评估标准函数(后面会详细介绍)。

# 多分类问题

model.compile(optimizer='rmsprop',

loss='categorical_crossentropy',

metrics=['accuracy'])

# 二分类问题

model.compile(optimizer='rmsprop',

loss='binary_crossentropy',

metrics=['accuracy'])

# 均方误差回归问题

model.compile(optimizer='rmsprop',

loss='mse')

# 自定义评估标准函数

import keras.backend as K

def mean_pred(y_true, y_pred):

return K.mean(y_pred)

model.compile(optimizer='rmsprop',

loss='binary_crossentropy',

metrics=['accuracy', mean_pred])

1-4、模型训练

Keras 模型在输入数据和标签的 Numpy 矩阵上进行训练。为了训练一个模型,你通常会使用 fit 函数(后面会详细介绍该函数)。

# 对于具有 2 个类的单输入模型(二进制分类):

model = Sequential()

model.add(Dense(32, activation='relu', input_dim=100))

model.add(Dense(1, activation='sigmoid'))

model.compile(optimizer='rmsprop',

loss='binary_crossentropy',

metrics=['accuracy'])

# 生成虚拟数据

import numpy as np

data = np.random.random((1000, 100))

labels = np.random.randint(2, size=(1000, 1))

# 训练模型,以 32 个样本为一个 batch 进行迭代

model.fit(data, labels, epochs=10, batch_size=32)

# 对于具有 10 个类的单输入模型(多分类分类):

model = Sequential()

model.add(Dense(32, activation='relu', input_dim=100))

model.add(Dense(10, activation='softmax'))

model.compile(optimizer='rmsprop',

loss='categorical_crossentropy',

metrics=['accuracy'])

# 生成虚拟数据

import numpy as np

data = np.random.random((1000, 100))

labels = np.random.randint(10, size=(1000, 1))

# 将标签转换为分类的 one-hot 编码

one_hot_labels = keras.utils.to_categorical(labels, num_classes=10)

# 训练模型,以 32 个样本为一个 batch 进行迭代

model.fit(data, one_hot_labels, epochs=10, batch_size=32)

1-5、运行几个小例子

1-5-1、基于多层感知器 (MLP) 的 softmax 多分类

完整代码(建议自己运行一遍,注意看代码注释,注意看代码注释,注意看代码注释)

import tensorflow.keras as keras

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout, Activation

from tensorflow.keras.optimizers import SGD

# 生成虚拟数据

import numpy as np

x_train = np.random.random((1000, 20))

y_train = keras.utils.to_categorical(np.random.randint(10, size=(1000, 1)), num_classes=10)

x_test = np.random.random((100, 20))

y_test = keras.utils.to_categorical(np.random.randint(10, size=(100, 1)), num_classes=10)

model = Sequential()

# Dense(64) 是一个具有 64 个隐藏神经元的全连接层。

# 在第一层必须指定所期望的输入数据尺寸:使用input_shape或者input_dim

# 在这里,是一个 20 维的向量。

model.add(Dense(64, activation='relu', input_dim=20))

model.add(Dropout(0.5))

model.add(Dense(64, activation='relu'))

model.add(Dropout(0.5))

model.add(Dense(10, activation='softmax'))

sgd = SGD(lr=0.01, decay=1e-6, momentum=0.9, nesterov=True) # 自定义SGD实例初始化参数

model.compile(loss='categorical_crossentropy',

optimizer=sgd,

metrics=['accuracy'])

model.fit(x_train, y_train,

epochs=20,

batch_size=128)

score = model.evaluate(x_test, y_test, batch_size=128) # 评估

运行结果

Train on 1000 samples

Epoch 1/10

1000/1000 [==============================] - 0s 467us/sample - loss: 2.4079 - accuracy: 0.0910

Epoch 2/10

1000/1000 [==============================] - 0s 16us/sample - loss: 2.3660 - accuracy: 0.0770

Epoch 3/10

1000/1000 [==============================] - 0s 14us/sample - loss: 2.3282 - accuracy: 0.1130

Epoch 4/10

1000/1000 [==============================] - 0s 11us/sample - loss: 2.3266 - accuracy: 0.1080

Epoch 5/10

1000/1000 [==============================] - 0s 11us/sample - loss: 2.3114 - accuracy: 0.1240

Epoch 6/10

1000/1000 [==============================] - 0s 12us/sample - loss: 2.3223 - accuracy: 0.0940

Epoch 7/10

1000/1000 [==============================] - 0s 15us/sample - loss: 2.3054 - accuracy: 0.1010

Epoch 8/10

1000/1000 [==============================] - 0s 12us/sample - loss: 2.3114 - accuracy: 0.1090

Epoch 9/10

1000/1000 [==============================] - 0s 14us/sample - loss: 2.3101 - accuracy: 0.1020

Epoch 10/10

1000/1000 [==============================] - 0s 13us/sample - loss: 2.3040 - accuracy: 0.1170

100/1 [================================================================================================================================================================================================================================================================================================================================================================================================================================================================================] - 0s 2ms/sample - loss: 2.3056 - accuracy: 0.0900

score=[2.3056423664093018, 0.09]

Process finished with exit code 0

1-5-2、基于多层感知器的二分类

完整代码(建议自己运行一遍,注意看代码注释,注意看代码注释,注意看代码注释)

import numpy as np

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout

# 生成虚拟数据

x_train = np.random.random((1000, 20))

y_train = np.random.randint(2, size=(1000, 1))

x_test = np.random.random((100, 20))

y_test = np.random.randint(2, size=(100, 1))

model = Sequential()

model.add(Dense(64, input_dim=20, activation='relu'))

model.add(Dropout(0.5))

model.add(Dense(64, activation='relu'))

model.add(Dropout(0.5))

model.add(Dense(1, activation='sigmoid'))

model.compile(loss='binary_crossentropy',

optimizer='rmsprop',

metrics=['accuracy'])

model.fit(x_train, y_train,

epochs=20,

batch_size=128)

score = model.evaluate(x_test, y_test, batch_size=128)

运行结果

Train on 1000 samples

Epoch 1/10

1000/1000 [==============================] - 1s 861us/sample - loss: 0.7189 - accuracy: 0.4860

Epoch 2/10

1000/1000 [==============================] - 0s 17us/sample - loss: 0.7057 - accuracy: 0.5010

Epoch 3/10

1000/1000 [==============================] - 0s 16us/sample - loss: 0.7045 - accuracy: 0.5020

Epoch 4/10

1000/1000 [==============================] - 0s 17us/sample - loss: 0.7084 - accuracy: 0.4920

Epoch 5/10

1000/1000 [==============================] - 0s 16us/sample - loss: 0.6994 - accuracy: 0.4930

Epoch 6/10

1000/1000 [==============================] - 0s 14us/sample - loss: 0.7007 - accuracy: 0.4810

Epoch 7/10

1000/1000 [==============================] - 0s 15us/sample - loss: 0.6986 - accuracy: 0.5200

Epoch 8/10

1000/1000 [==============================] - 0s 15us/sample - loss: 0.6986 - accuracy: 0.5170

Epoch 9/10

1000/1000 [==============================] - 0s 15us/sample - loss: 0.6951 - accuracy: 0.5010

Epoch 10/10

1000/1000 [==============================] - 0s 18us/sample - loss: 0.6981 - accuracy: 0.5090

100/1 [===================================================================================================================================================================================================================================================================================================================================================================================] - 0s 2ms/sample - loss: 0.6897 - accuracy: 0.5100

Process finished with exit code 0

1-5-3、类似 VGG 的卷积神经网络

完整代码(建议自己运行一遍,注意看代码注释,注意看代码注释,注意看代码注释)

import numpy as np

import tensorflow.keras as keras

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout, Flatten

from tensorflow.keras.layers import Conv2D, MaxPooling2D

from tensorflow.keras.optimizers import SGD

# 生成虚拟数据

x_train = np.random.random((100, 100, 100, 3))

y_train = keras.utils.to_categorical(np.random.randint(10, size=(100, 1)), num_classes=10)

x_test = np.random.random((20, 100, 100, 3))

y_test = keras.utils.to_categorical(np.random.randint(10, size=(20, 1)), num_classes=10)

model = Sequential()

# 输入: 3 通道 100x100 像素图像 -> (100, 100, 3) 张量。

# 使用 32 个大小为 3x3 的卷积滤波器。

model.add(Conv2D(32, (3, 3), activation='relu', input_shape=(100, 100, 3)))

model.add(Conv2D(32, (3, 3), activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.25))

model.add(Conv2D(64, (3, 3), activation='relu'))

model.add(Conv2D(64, (3, 3), activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.25))

model.add(Flatten())

model.add(Dense(256, activation='relu'))

model.add(Dropout(0.5))

model.add(Dense(10, activation='softmax'))

sgd = SGD(lr=0.01, decay=1e-6, momentum=0.9, nesterov=True)

model.compile(loss='categorical_crossentropy', optimizer=sgd)

model.fit(x_train, y_train, batch_size=32, epochs=10)

score = model.evaluate(x_test, y_test, batch_size=32)

print("score = {}".format(score))

运行结果

Train on 100 samples

Epoch 1/10

100/100 [==============================] - 1s 13ms/sample - loss: 2.3616

Epoch 2/10

100/100 [==============================] - 1s 8ms/sample - loss: 2.3271

Epoch 3/10

100/100 [==============================] - 1s 6ms/sample - loss: 2.2990

Epoch 4/10

100/100 [==============================] - 1s 6ms/sample - loss: 2.2903

Epoch 5/10

100/100 [==============================] - 1s 7ms/sample - loss: 2.3114

Epoch 6/10

100/100 [==============================] - 1s 9ms/sample - loss: 2.2883

Epoch 7/10

100/100 [==============================] - 1s 8ms/sample - loss: 2.3056

Epoch 8/10

100/100 [==============================] - 1s 7ms/sample - loss: 2.3073

Epoch 9/10

100/100 [==============================] - 1s 7ms/sample - loss: 2.2976

Epoch 10/10

100/100 [==============================] - 1s 9ms/sample - loss: 2.2952

20/1 [======================================================================================================================================================================================================================================================================================] - 0s 9ms/sample - loss: 2.2835

score = 2.2834794521331787

Process finished with exit code 0

二、搭建LeNet-5卷积神经网络

2-1、前言

在 1990 年代,Yann LeCun 等人提出了用于手写数字和机器打印字符识别的神经网络,被命名为 LeNet-5 (Lecun, Bottou, Bengio, & Haffner, 1998)。LeNet-5 的提出,使得卷积神经网络在当时能够成功被商用,广泛应用在邮政编码、支票号码识别等任务中。

本小节实现一个数字识别任务,即,给计算机输入一张手写数字图片,让计算机告诉我们这张图片里面的数字是多少。网络结构我们选择LeNet-5卷积神经网络,训练数据集我们选择MNIST数据集。

MNIST数据集简介:为了方便业界统一测试和评估算法, (Lecun, Bottou, Bengio, & Haffner, 1998)发布了手写数字图片数据集,命名为 MNIST,它包含了 0~9 共 10 种数字的手写图片,每种数字一共有 7000 张图片,采集自不同书写风格的真实手写图片,一共 70000 张图片。其中60000张图片作为训练集,用来训练模型。10000张图片作为测试集,用来训练或者预测。训练集和测试集共同组成了整个 MNIST 数据集。MINIST数据集中的每张图片,大小为28 × 28,同时只保留灰度信息(即单通道)。

2-2、开始搭建LeNet-5网络结构

下面的代码分析非常详细(啰嗦),建议小白认真阅读,大神请绕道

LeNet-5网络结构图如下

LeNet网络逐层结构分析与代码实现:

图片输入shape:(32, 32, 1)

第一层是卷积层,从输出的特征图可知卷积核的个数是6, 输出的特征图大小是28, 论文中选择的卷积核大小是(5, 5),所以可知卷积步长为1, 没有对输入进行填充(因为第一层的输出size=32-5+1=28)

# 对应代码如下(我额外给它加了一个激活函数relu,增加它的非线性能力), 步长默认为1,可不写。

# padding填充默认为None

Conv2D(6, (5, 5), activation='relu', input_shape=(32, 32, 1))

然后是最大池化层,看图可知池化之后的特征图大小是(14, 14, 6),论文中选择的扫描窗口大小是(2, 2), 推断出池化的步长为2, padding为’same’

MaxPooling2D(pool_size=(2, 2), strides=2, padding='same')

第二层还是卷积层(一般不把池化层当作一层),从输出的特征图可知卷积核的个数是16, 输出的特征图大小是10, 论文中选择的卷积核大小是(5, 5),所以可知卷积步长为1, 没有对输入进行填充(因为第二层的输出size=14-5+1=10)

# 对应代码如下(我额外给它加了一个激活函数relu,增加它的非线性能力), 步长默认为1,可不写。

# padding填充默认为None

Conv2D(16, (5, 5), activation='relu')

然后是最大池化层,看图可知池化之后的特征图大小是(5, 5,16),论文中选择的扫描窗口大小是(2, 2), 推断出池化的步长为2, padding为’same’

MaxPooling2D(pool_size=(2, 2), strides=2, padding='same')

从图可知,第三层是全连接层,有120个隐藏神经元(因为这边的训练数据比较小,我怕过拟合,所以在这个全连接层后面加上一个Dropout()层)

Flatten() # 进行全连接之前要将多维变量变成二维变量,因为全连接层的输入只能是二维变量

Dense(120, activation='relu') # 增加一个激活函数提高模型参数的非线性能力

Dropout(0.5) # 表示随机去掉50%的神经元连接

第四层还是全连接层,有84个隐藏神经元(因为这边的训练数据比较小,我怕过拟合,所以在这个全连接层后面加上一个Dropout()层)

# Flatten() 因为上一层的输出就是一个二维变量,所以这里不需要进行拉直操作了

Dense(84, activation='relu') # 增加一个激活函数提高模型参数的非线性能力

Dropout(0.5) # 表示随机去掉50%的神经元连接

(重点细看)最后一层我们也称为输出层,从图中可知,我们应该输出一个shape为(None, 10)的变量,所以我们选择使用一个带“softmax”激活函数的全连接网络,然后就不使用Dropout()层了

Dense(10, activation='softmax') # 增加这个激活函数便于多分类

到这里模型的搭建就结束了,下面是LeNet-5模型的完整代码

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout, Flatten

from tensorflow.keras.layers import Conv2D, MaxPooling2D

model = Sequential()

# 对应代码如下(我额外给它加了一个激活函数relu,增加它的非线性能力), 步长默认为1,可不写。

# padding填充默认为None

model.add(Conv2D(6, (5, 5), activation='relu', input_shape=(32, 32, 1)))

model.add(MaxPooling2D(pool_size=(2, 2), strides=2, padding='same'))

# 对应代码如下(我额外给它加了一个激活函数relu,增加它的非线性能力), 步长默认为1,可不写。

# padding填充默认为None

model.add(Conv2D(16, (5, 5), activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2), strides=2, padding='same'))

model.add(Flatten()) # 进行全连接之前要将多维变量变成二维变量,因为全连接层的输入只能是二维变量

model.add(Dense(120, activation='relu')) # 增加一个激活函数提高模型参数的非线性能力

model.add(Dropout(0.5)) # 表示随机去掉50%的神经元连接

# Flatten() 因为上一层的输出就是一个二维变量,所以这里不需要进行拉直操作了

model.add(Dense(84, activation='relu')) # 增加一个激活函数提高模型参数的非线性能力

model.add(Dropout(0.5)) # 表示随机去掉50%的神经元连接

model.add(Dense(10, activation='softmax')) # 增加这个激活函数便于多分类

model.summary() # 最后我们把模型打印出来,看看各个尺寸有没有错误

打印出来的结果

Model: "sequential"

_________________________________________________________________

Layer (type) Output Shape Param #

=================================================================

conv2d (Conv2D) (None, 28, 28, 6) 156

_________________________________________________________________

max_pooling2d (MaxPooling2D) (None, 14, 14, 6) 0

_________________________________________________________________

conv2d_1 (Conv2D) (None, 10, 10, 16) 2416

_________________________________________________________________

max_pooling2d_1 (MaxPooling2 (None, 5, 5, 16) 0

_________________________________________________________________

flatten (Flatten) (None, 400) 0

_________________________________________________________________

dense (Dense) (None, 120) 48120

_________________________________________________________________

dropout (Dropout) (None, 120) 0

_________________________________________________________________

dense_1 (Dense) (None, 84) 10164

_________________________________________________________________

dropout_1 (Dropout) (None, 84) 0

_________________________________________________________________

dense_2 (Dense) (None, 10) 850

=================================================================

Total params: 61,706

Trainable params: 61,706

Non-trainable params: 0

_________________________________________________________________

Process finished with exit code 0

2-3、准备数据

因为数据集你安装tensorflow之后它自带有一个函数可以进行下载,所以我们进行调用既可

from tensorflow.keras import datasets

# 加载数据集,返回的是两个元组,分别表示训练集和测试集,元组的元素类型是数组

(x, y), (x_val, y_val) = datasets.mnist.load_data()

2-4、搭配优化器、损失函数、评价指标

模型的训练需要有一个损失函数,需要有一个优化损失函数的方法(我们称之为优化器),评价指标可有可无,但是如果没有的话,你不知道自己训练的模型准确率是什么样子的,所以一般也会加上去。它们三者在keras里面都有一些内置可供我们选择使用,我们后续也会更新说到关于他们的详细知识,欢迎关注收藏一起学习~

from tensorflow.keras.optimizers import SGD

sgd = SGD(lr=0.01, decay=1e-6, momentum=0.9, nesterov=True)

model.compile(loss='categorical_crossentropy',

optimizer=sgd,

metrics=['accuracy'])

2-5、开始训练

我们对模型进行训练其实就是不断地对模型的参数进行更新,每一次参数更新我们都会输出一个样本数据给模型进行运算,这个样本的大小就是常说的batch_size, 模型参数更新的总次数我们称之为epoch

我们使用fit()函数来进行模型的训练(具体的函数讲解后续会讲到)

model.fit(x_train, y_train,

epochs=20,

batch_size=128)

2-6、完整代码

建议自己敲一遍然后运行一次,注意看代码注释,注意看代码注释,注意看代码注释

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout, Flatten

from tensorflow.keras.layers import Conv2D, MaxPooling2D

model = Sequential()

# 对应代码如下(我额外给它加了一个激活函数relu,增加它的非线性能力), 步长默认为1,可不写。

# padding填充默认为None

model.add(Conv2D(6, (5, 5), activation='relu', input_shape=(32, 32, 1)))

# model.add(Conv2D(6, (5, 5), activation='relu', input_shape=(28, 28, 1))) # 为了适应fit()函数进行的更改

model.add(MaxPooling2D(pool_size=(2, 2), strides=2, padding='same'))

# 对应代码如下(我额外给它加了一个激活函数relu,增加它的非线性能力), 步长默认为1,可不写。

# padding填充默认为None

model.add(Conv2D(16, (5, 5), activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2), strides=2, padding='same'))

model.add(Flatten()) # 进行全连接之前要将多维变量变成二维变量,因为全连接层的输入只能是二维变量

model.add(Dense(120, activation='relu')) # 增加一个激活函数提高模型参数的非线性能力

model.add(Dropout(0.5)) # 表示随机去掉50%的神经元连接

# Flatten() 因为上一层的输出就是一个二维变量,所以这里不需要进行拉直操作了

model.add(Dense(84, activation='relu')) # 增加一个激活函数提高模型参数的非线性能力

model.add(Dropout(0.5)) # 表示随机去掉50%的神经元连接

model.add(Dense(10, activation='softmax')) # 增加这个激活函数便于多分类

model.summary() # 最后我们把模型打印出来,看看各个尺寸有没有错误

from tensorflow.keras import datasets

# 加载数据集,返回的是两个元组,分别表示训练集和测试集,元组的元素类型是数组

(x, y), (x_val, y_val) = datasets.mnist.load_data()

from tensorflow.keras.optimizers import SGD

sgd = SGD(lr=0.01, decay=1e-6, momentum=0.9, nesterov=True)

model.compile(loss='categorical_crossentropy',

optimizer=sgd,

metrics=['accuracy'])

# 因为我选择的损失函数要求’images‘的shape需要是(28, 28, 1),所以需要对x就是reshape操作

# 因为我选择的损失函数要求’label‘值是one_hot编码,所以对y要提前进行处理

import tensorflow.keras as keras

import numpy as np

x_train, y_train =np.reshape(x, (60000, 28, 28, 1)), keras.utils.to_categorical(y, 10)

"""

实际上如果你想要训练得到好的结果,你还应该对数据进行随机挑选操作

我们这节主要讲解模型的搭建,其它知识就暂且不涉及了

免得同学们搞不清楚学习的重点

"""

# 因为我们挑选的数据集的图片大小是(28, 28, 1),可是我们编写的网络的输入是(32, 32, 1)

# 所以如果想让下面的函数成功跑起来的话就要更改一下网络的输入为(28, 28, 1)

model.fit(x_train, y_train,

epochs=5,

batch_size=32)

看到这里恭喜你学完本节内容啦,本系列会持续更新的内容大纲如下,欢迎关注收藏一起学习哟~