目标检测Yolov5算法——两猫咪打架视频识别

本文的所有资源都放在作者的Github上了,有需要可以自己下载~

1.环境

需要安装好Pytorch,OpenCV,CUDA,CUDNN,nvidia,Anaconda以及paddle

2.安装labelImg

在终端运行

pip install labelimg

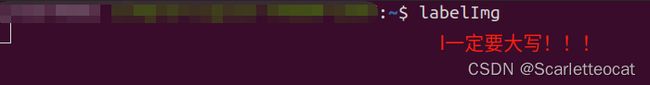

安装成功后,输入

labelImg。注意此处I必须大写!!!不然会显示没有labelimg。

3.下载labelImg(使用自己的数据集)

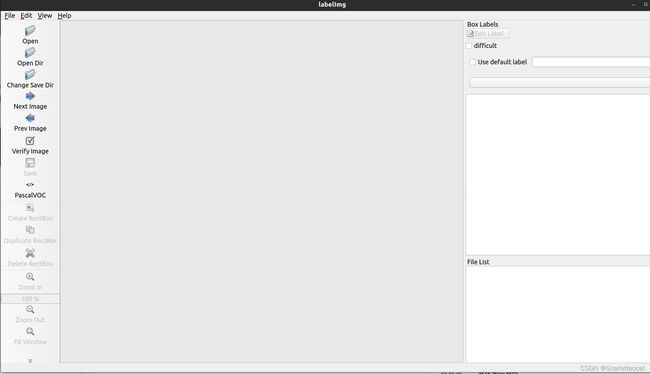

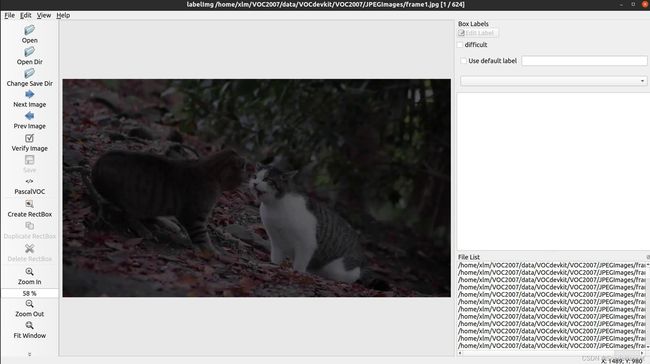

运行labelImg后,会弹出如下窗口

此时我们可以对自己的数据集图片进行标注。

此时我们可以对自己的数据集图片进行标注。

在home下新建一个名为VOC2007的文件夹,其中再新建两个文件夹,整个文件夹框架如下

VOC2007

│ JPEGImages

│ Annotations

其中JPEGImages文件夹用于存放需要标注的图片数据集,可以是jpg,png等;Annotations用于存放在labelImg中标注好的数据集,根据不同的格式有不同的后缀,voc下标注得到xml类型的结果。

4.获取数据集

我采用了b站一个两只猫咪打架的视频,下载好后每隔10帧得到一幅图像。这里是使用Python代码完成的

# 导入所有必要的库

import cv2

import os

# 从指定的路径读取视频(这里大家改成自己的video的绝对路径)

cam = cv2.VideoCapture("home\\xilm\\video\\888800093-1-208.mp4")

try :

# 创建名为data的文件夹

if not os.path.exists( 'data' ):

os.makedirs( 'data' )

# 如果未创建,则引发错误

except OSError:

print ( 'Error: Creating directory of data' )

# frame

currentframe = 0

while ( True ):

# reading from frame

ret, frame = cam.read()

if ret:

# 增加计数器,以便显示创建了多少帧

currentframe += 1

if currentframe%10 == 0:

# 如果视频仍然存在,继续创建图像

name = './data/frame' + str (int(currentframe/10)) + '.jpg'

print ( 'Creating...' + name)

# 写入提取的图像

cv2.imwrite(name, frame)

else :

break

# 一旦完成释放所有的空间和窗口

cam.release()

cv2.destroyAllWindows()

5.数据集标注

打开labelImg,点击左侧的OpenDir,选择VOC2007\JPEGImages路径,就会在界面上出现图片

接下来再点击左侧的Change Save Dir,选择

接下来再点击左侧的Change Save Dir,选择VOC2007\Annotations路径。

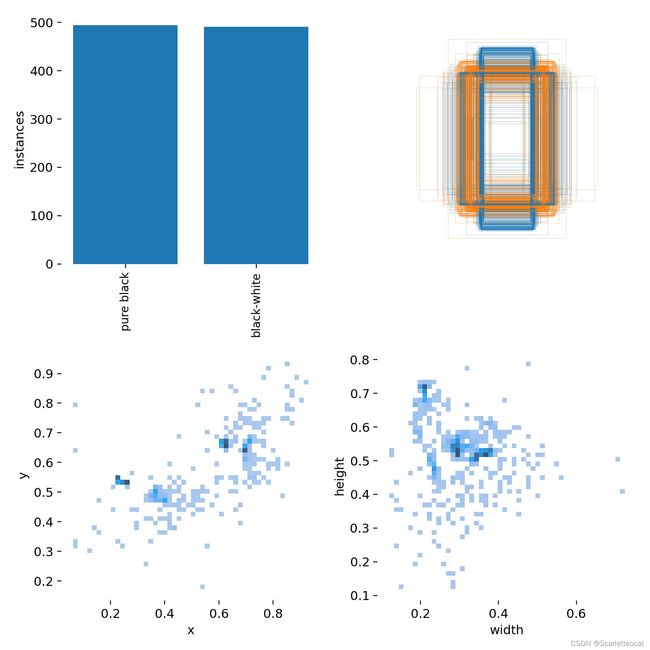

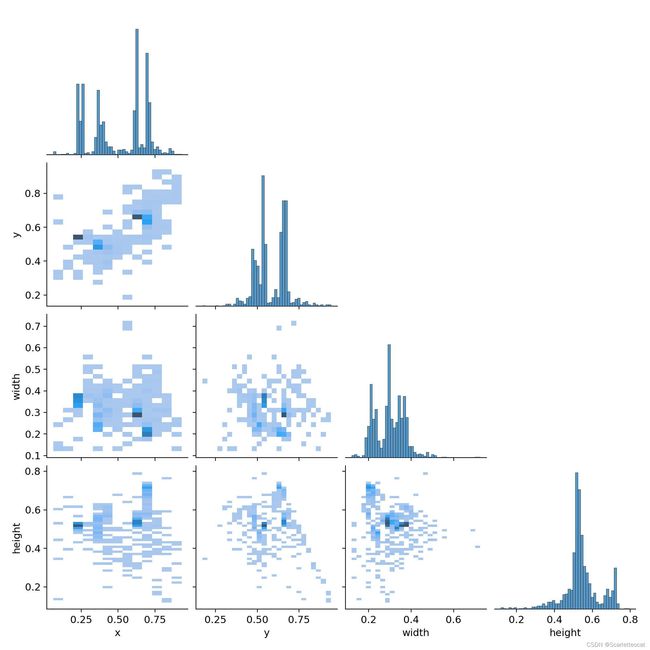

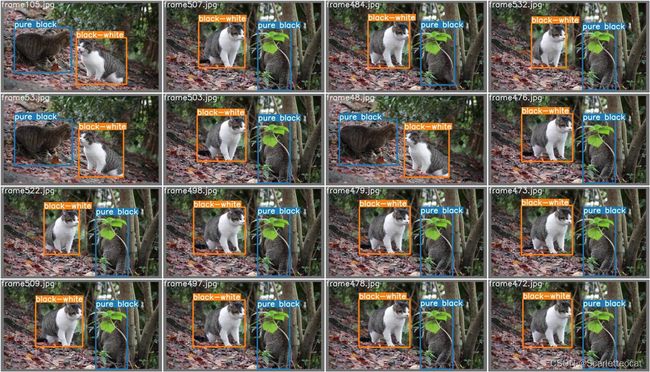

接下来,按下W键,就可以进行画框标注了。我标注了两类['pure black','black-white'],表示两只猫咪。

标注完毕后,按下Ctrl+s就可以保存,此时保存得到xml文件。按D进行下一张图片的标注;按A返回上一张图片。

6.制作train和val集

标注完数据集之后,进行训练集和测试集的制作。

在home下新建一个文件夹,名为data;在data下再新建一个文件夹,名为VOCdevkit,将前面的VOC2007整个文件夹复制到VOCdevkit下。最后的文件夹目录如下:

data

│ VOCdevkit

└───────VOC2007

│ │ Annotations

│ │ JPEGImages

在data文件夹下新建一个python文件,命名为data-classification.py,其内容如下:

import xml.etree.ElementTree as ET

import pickle

import os

from os import listdir, getcwd

from os.path import join

import random

from shutil import copyfile

classes = ['pure black','black-white']

# 分类的名称

TRAIN_RATIO = 80

def clear_hidden_files(path):

dir_list = os.listdir(path)

for i in dir_list:

abspath = os.path.join(os.path.abspath(path), i)

if os.path.isfile(abspath):

if i.startswith("._"):

os.remove(abspath)

else:

clear_hidden_files(abspath)

def convert(size, box):

dw = 1. / size[0]

dh = 1. / size[1]

x = (box[0] + box[1]) / 2.0

y = (box[2] + box[3]) / 2.0

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return (x, y, w, h)

def convert_annotation(image_id):

#in_file = open('VOCdevkit/VOC2007/Annotations/%s.xml' % image_id)

#out_file = open('VOCdevkit/VOC2007/YOLOLabels/%s.txt' % image_id, 'w')

in_file = open('VOCdevkit/VOC2007/Annotations/%s.xml' % image_id,encoding='UTF-8')

out_file = open('VOCdevkit/VOC2007/YOLOLabels/%s.txt' % image_id,'w',encoding='UTF-8')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

in_file.close()

out_file.close()

wd = os.getcwd()

wd = os.getcwd()

data_base_dir = os.path.join(wd, "VOCdevkit/")

if not os.path.isdir(data_base_dir):

os.mkdir(data_base_dir)

work_sapce_dir = os.path.join(data_base_dir, "VOC2007/")

if not os.path.isdir(work_sapce_dir):

os.mkdir(work_sapce_dir)

annotation_dir = os.path.join(work_sapce_dir, "Annotations/")

if not os.path.isdir(annotation_dir):

os.mkdir(annotation_dir)

clear_hidden_files(annotation_dir)

image_dir = os.path.join(work_sapce_dir, "JPEGImages/")

if not os.path.isdir(image_dir):

os.mkdir(image_dir)

clear_hidden_files(image_dir)

yolo_labels_dir = os.path.join(work_sapce_dir, "YOLOLabels/")

if not os.path.isdir(yolo_labels_dir):

os.mkdir(yolo_labels_dir)

clear_hidden_files(yolo_labels_dir)

yolov5_images_dir = os.path.join(data_base_dir, "images/")

if not os.path.isdir(yolov5_images_dir):

os.mkdir(yolov5_images_dir)

clear_hidden_files(yolov5_images_dir)

yolov5_labels_dir = os.path.join(data_base_dir, "labels/")

if not os.path.isdir(yolov5_labels_dir):

os.mkdir(yolov5_labels_dir)

clear_hidden_files(yolov5_labels_dir)

yolov5_images_train_dir = os.path.join(yolov5_images_dir, "train/")

if not os.path.isdir(yolov5_images_train_dir):

os.mkdir(yolov5_images_train_dir)

clear_hidden_files(yolov5_images_train_dir)

yolov5_images_test_dir = os.path.join(yolov5_images_dir, "val/")

if not os.path.isdir(yolov5_images_test_dir):

os.mkdir(yolov5_images_test_dir)

clear_hidden_files(yolov5_images_test_dir)

yolov5_labels_train_dir = os.path.join(yolov5_labels_dir, "train/")

if not os.path.isdir(yolov5_labels_train_dir):

os.mkdir(yolov5_labels_train_dir)

clear_hidden_files(yolov5_labels_train_dir)

yolov5_labels_test_dir = os.path.join(yolov5_labels_dir, "val/")

if not os.path.isdir(yolov5_labels_test_dir):

os.mkdir(yolov5_labels_test_dir)

clear_hidden_files(yolov5_labels_test_dir)

train_file = open(os.path.join(wd, "yolov5_train.txt"), 'w')

test_file = open(os.path.join(wd, "yolov5_val.txt"), 'w')

train_file.close()

test_file.close()

train_file = open(os.path.join(wd, "yolov5_train.txt"), 'a')

test_file = open(os.path.join(wd, "yolov5_val.txt"), 'a')

list_imgs = os.listdir(image_dir) # list image files

prob = random.randint(1, 100)

print("Probability: %d" % prob)

for i in range(0, len(list_imgs)):

path = os.path.join(image_dir, list_imgs[i])

if os.path.isfile(path):

image_path = image_dir + list_imgs[i]

voc_path = list_imgs[i]

(nameWithoutExtention, extention) = os.path.splitext(os.path.basename(image_path))

(voc_nameWithoutExtention, voc_extention) = os.path.splitext(os.path.basename(voc_path))

annotation_name = nameWithoutExtention + '.xml'

annotation_path = os.path.join(annotation_dir, annotation_name)

label_name = nameWithoutExtention + '.txt'

label_path = os.path.join(yolo_labels_dir, label_name)

prob = random.randint(1, 100)

print("Probability: %d" % prob)

if (prob < TRAIN_RATIO): # train dataset

if os.path.exists(annotation_path):

train_file.write(image_path + '\n')

convert_annotation(nameWithoutExtention) # convert label

copyfile(image_path, yolov5_images_train_dir + voc_path)

copyfile(label_path, yolov5_labels_train_dir + label_name)

else: # test dataset

if os.path.exists(annotation_path):

test_file.write(image_path + '\n')

convert_annotation(nameWithoutExtention) # convert label

copyfile(image_path, yolov5_images_test_dir + voc_path)

copyfile(label_path, yolov5_labels_test_dir + label_name)

train_file.close()

test_file.close()

这里只需要按需求更改两个位置:

- 第九行:

classes = ['pure black','black-white'],改为标注的类型; - 第十二行:

TRAIN_RATIO = 80,改为训练集个数占总数据集的比例。

如果运行作者的数据集可以不修改此处。

现在点击运行该Python文件,就会得到许多新生成的文件

首先,新生成了两个文件夹:

首先,新生成了两个文件夹:images和val,里面分别有两个文件夹train和test。不同在于:images里放的是train和val的图片,而labels里放的是yolo可以识别的train和val的txt标注文件。

其次,VOC2007文件夹里也生成了一个文件夹YOLOLabels;

最后,data文件夹下生成了两个txt文件,分别是yolov5_train/val.txt。

7.训练yolov5目标检测模型

-

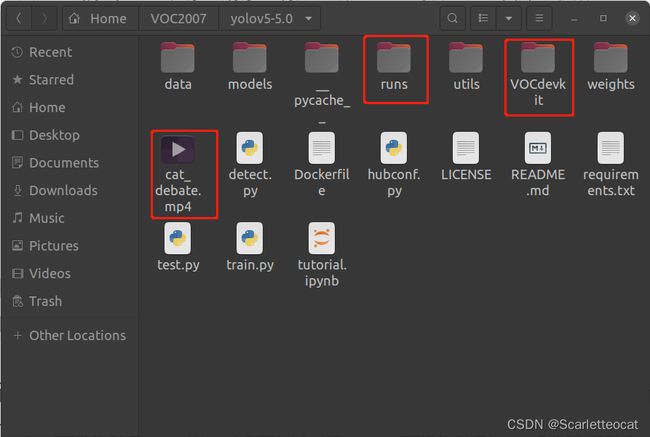

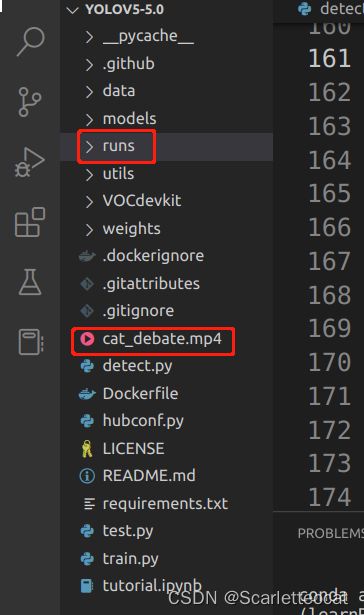

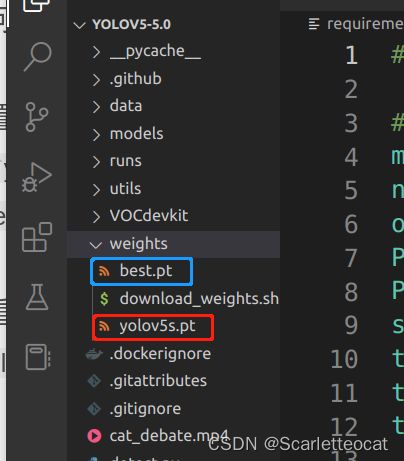

接下来,将刚才data文件夹下的

VOCdevkit文件复制到yolov5-5.0文件夹中,如上图所示。

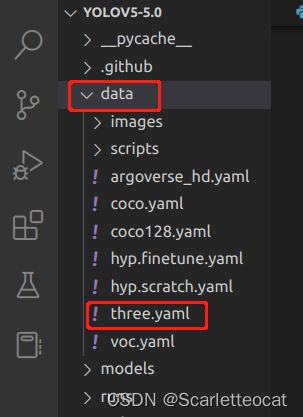

train: VOCdevkit/images/train

val: VOCdevkit/images/val

nc: 2

names: ['pure black','black-white']

这里大家可以根据需要,将nc改为自己的datasets类别个数,names改为标签。

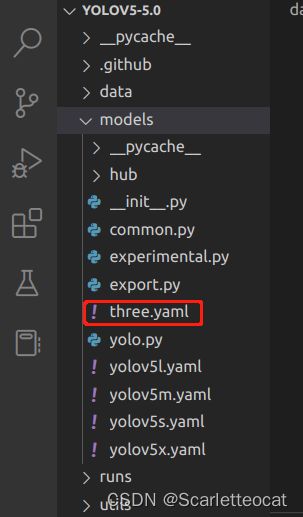

# parameters

nc: 2 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.50 # layer channel multiple

# anchors

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# YOLOv5 backbone

backbone:

# [from, number, module, args]

[[-1, 1, Focus, [64, 3]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 9, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 9, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 1, SPP, [1024, [5, 9, 13]]],

[-1, 3, C3, [1024, False]], # 9

]

# YOLOv5 head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[[17, 20, 23], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

这里可以根据自己的需要更改第二行nc: 2 ,改为自己的datasets的类别个数。

-

配置yolov5环境

点击yolov5-5.0文件夹下的requirements.txt文件,可以看到第一行为pip install -r requirements.txt,在VSCode的终端下运行这行命令。 -

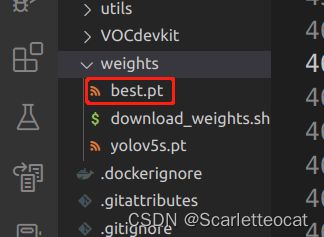

权重文件

将yolov5s.pt文件放在weight文件夹下,这个文件我放在了github里。

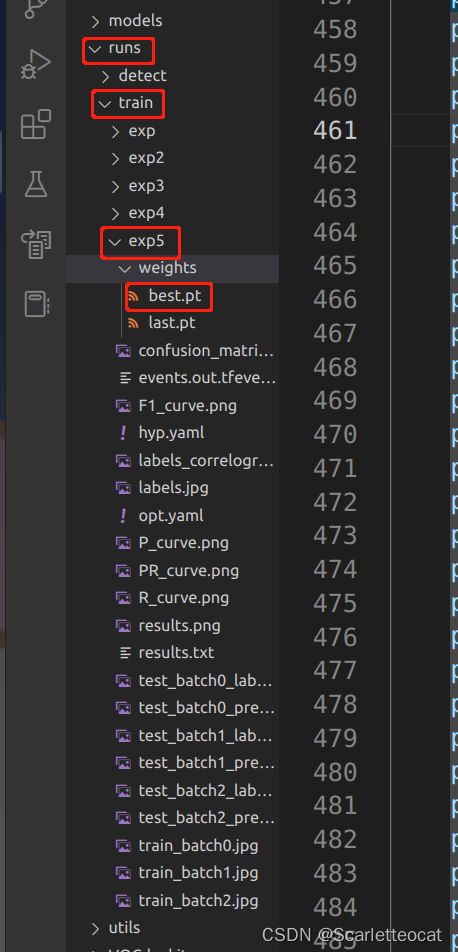

上图的

上图的best.pt文件是后面生成的,这里不用管。 -

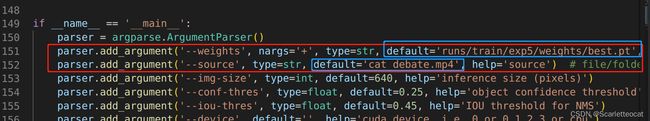

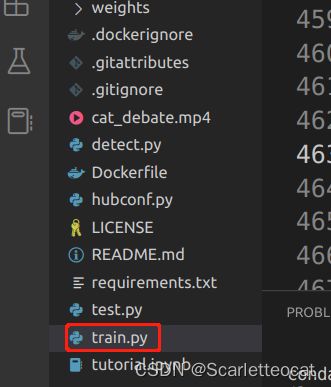

训练模型

打开yolov5-5.0文件夹下的train.py文件

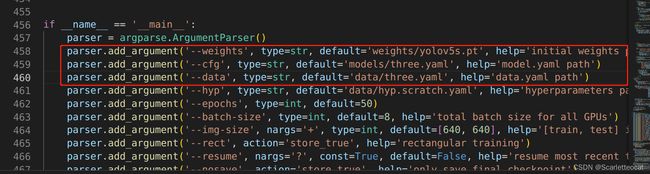

对该文件的458-460行进行调整,内容改为下图。

对该文件的458-460行进行调整,内容改为下图。

这里主要修改了

这里主要修改了default的内容,也就是这些文件的相对路径在哪里。

462行的default表示了训练次数,我这里选择训练50次。 -

接下来就可以点击运行了。

注意:当提示RuntimeError: cuDNN error: CUDNN_STATUS_NOT_INITIALIZED时,可以通过修改463行的

parser.add_argument('--batch-size', type=int, default=16, help='total batch size for all GPUs')

将default改小一点,我这里改了8,之后就可以正常运行了。

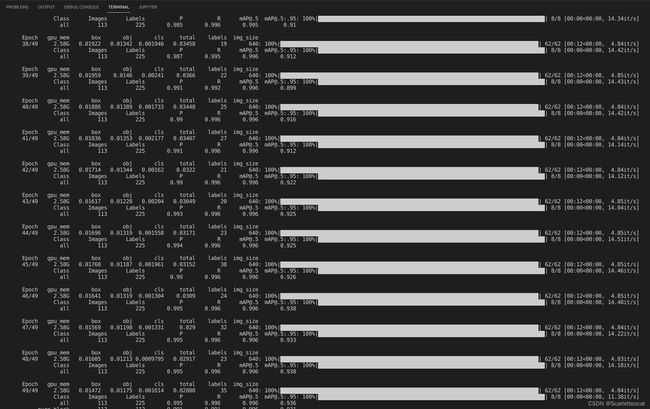

运行如下:

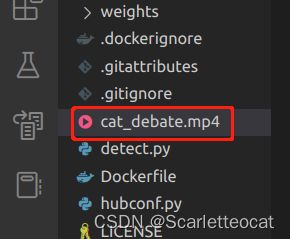

8.测试训练结果(以一个video为例)

这个视频就是我们取数据集的视频。一开始我们每隔10帧取一张图片,也就意味着这个视频里还有9倍数据集大小的数据供我们验证。这个视频我也放在github了。

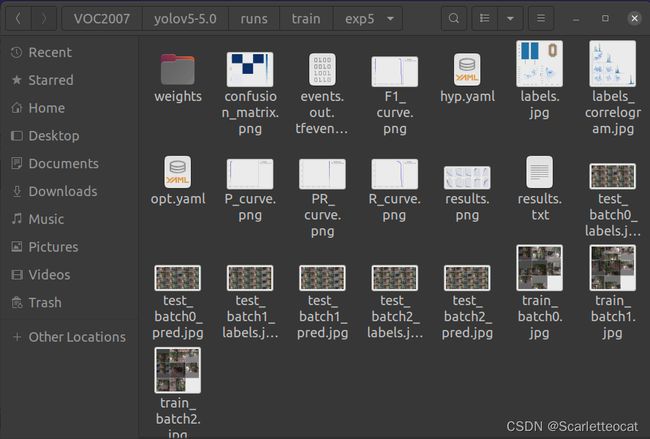

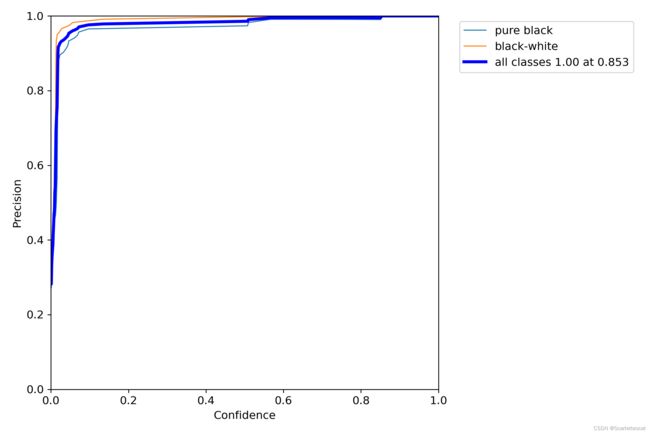

9.最终结果

参考资料:

1.讲的很赞的b站视频

2.RuntimeError: cuDNN error: CUDNN_STATUS_NOT_INITIALIZED

3.使用的b站一个两猫猫吵架视频