- PyTorch实现CNN:CIFAR-10图像分类实战教程

吴师兄大模型

PyTorchpytorchcnnCIFAR-10图像分类人工智能python卷积神经网络开发语言

Langchain系列文章目录01-玩转LangChain:从模型调用到Prompt模板与输出解析的完整指南02-玩转LangChainMemory模块:四种记忆类型详解及应用场景全覆盖03-全面掌握LangChain:从核心链条构建到动态任务分配的实战指南04-玩转LangChain:从文档加载到高效问答系统构建的全程实战05-玩转LangChain:深度评估问答系统的三种高效方法(示例生成、手

- 如何在DigitalOcean的H100 GPU服务器上运行DeepSeek R1 模型

DO_Community

教程DeepSeekGPUai大语言模型人工智能

在DigitalOcean,我们一直在关注开源大语言模型(LLMs)和商业封闭模型之间差距的不断缩小。其中一个最关键的能力就是“推理”,也就是用合乎逻辑、讲得通的方式思考问题。以前,大语言模型的表现比较单一。只要给它们一个提示,它们就会直接给出答案,根本没有什么“二次思考”的过程,也没有什么机制能让模型在出错时自己纠正。这就让它们在遇到那些指令本身就可能有问题的情况时,很难进行深入推理、提出疑问或

- 基于llama_cpp 调用本地模型(llama)实现基本推理

月光技术杂谈

大模型初探llamallama.cpppythonLLM集成显卡本地模型AI

零基础实践本地推理模型基本应用:基于llama_cpp的本地模型调用。本文先安装llama_cpppython库,再编写程序,利用其调用llama-2-7b-chat.Q4_K_M.ggu模型。背景llama_cpp是一个基于C++的高性能库(llama.cpp)的Python绑定,支持在CPU或GPU上高效运行LLaMA及其衍生模型(如LLaMA2),并通过量化技术(如GGUF格式)优化内存使用

- 基于PyTorch的深度学习6——数据处理工具箱2

Wis4e

深度学习pytorch人工智能

torchvision有4个功能模块:model、datasets、transforms和utils。主要介绍如何使用datasets的ImageFolder处理自定义数据集,以及如何使用transforms对源数据进行预处理、增强等。下面将重点介绍transforms及ImageFolder。transforms提供了对PILImage对象和Tensor对象的常用操作。1)对PILImage的常

- 基于PyTorch的深度学习——机器学习3

Wis4e

深度学习机器学习pytorch

激活函数在神经网络中作用有很多,主要作用是给神经网络提供非线性建模能力。如果没有激活函数,那么再多层的神经网络也只能处理线性可分问题。在搭建神经网络时,如何选择激活函数?如果搭建的神经网络层数不多,选择sigmoid、tanh、relu、softmax都可以;而如果搭建的网络层次较多,那就需要小心,选择不当就可导致梯度消失问题。此时一般不宜选择sigmoid、tanh激活函数,因它们的导数都小于1

- C# Winform做动画卡顿怎么办?

肖无疾

游戏gdi/gdi+opengldirectxc#

Winform用的GDI+,像全屏动画这种卡的稀巴烂,任务管理器看进程如果GPU没动静那就是渣,没加速。可以使用OpenGL或者DirectX这样有GPU加速就不卡了。OpenGL用下面这个,控件里会多出一个glControl,拖到form上CreateaWindowsApplication(.NETFramework4.6)NuGettoinstallOpenTK.GLControlNuGett

- 3.10 项目总结

不要不开心了

pyqt深度学习机器学习数据挖掘人工智能

今天的项目是一个使用PyTorch框架构建和训练神经网络的实例,旨在实现手写数字识别。以下是项目的总结、内容分析以及优化建议:项目总结1.目标:使用神经网络对MNIST数据集中的手写数字进行分类。2.步骤:-数据加载和预处理。-构建神经网络模型。-定义损失函数和优化器。-训练模型并评估其性能。-可视化训练结果。内容分析1.数据加载和预处理:-使用`torchvision.datasets`加载MN

- Windows 图形显示驱动开发-WDDM 3.2-用户模式工作提交(一)

程序员王马

windows图形显示驱动开发驱动开发

本文介绍在Windows11版本24H2(WDDM3.2)中仍在开发的用户模式(UM)工作提交功能。UM工作提交使应用程序能够直接从用户模式将工作提交到GPU,且延迟非常低。目标是提高经常向GPU提交小工作负载的应用程序的性能。此外,如果这些应用程序在容器或虚拟机(VM)中运行,则用户模式提交有望使它们受益匪浅。这一好处是因为在VM中运行的用户模式驱动程序(UMD)可以直接向GPU提交工作,而不必

- Windows 图形显示驱动开发-WDDM 3.2-自动显示切换(九)

程序员王马

windows驱动开发

面板驱动程序显示器驱动程序是根据从EDID生成的即插即用(PnP)硬件ID加载的。由于EDID保持不变,当任何一个GPU控制内部面板时,都会加载面板驱动程序。这两个驱动程序将显示相同的亮度功能。因此,加载应该不会造成任何问题,面板驱动程序也不需要知道哪个GPU在控制多路复用器。识别多路复用器控制的目标当OS启动驱动程序时,它会调用驱动程序的DxgkDdiQueryChildRelations来查询

- Windows 图形显示驱动开发-WDDM 3.2-自动显示切换(十)

程序员王马

驱动开发windows

电源转换序列以下示例描述了ADS系统的休眠电源转换。系统配置为连接dGPU的多路复用器。系统进入休眠状态。iGPU和dGPU都切换到了D3电源状态。系统关闭电源。用户开启系统电源。固件配置iGPU的多路复用器和iGPU在内部面板上的显示启动序列。Dxgkrnl读取最后的多路复用器配置(本例中为dGPU),并将其与使用ACPI的当前多路复用器位置(本例中为iGPU)进行比较。Dxgkrnl然后调用A

- 解密DeepSeek-R1模型微调实战:VIP专属技巧助你轻松掌握行业核心技术

竹木有心

人工智能

引言大模型微调已成为AI工程师的核心竞争力,但90%的学习者卡在以下痛点:❌开源数据集质量参差不齐❌实验环境搭建耗时易出错❌行业级调优方案闭源难获取CSDN大模型VIP专项计划针对上述问题,提供:✅金融/医疗/法律三大领域高质量微调数据集✅云端GPU实验环境即开即用✅行业头部企业实战案例库(附完整代码)一、基础篇:快速搭建微调环境(免费技巧)1.1使用HuggingFace标准流程fromtran

- 学习总结项目

苏小夕夕

学习人工智能深度学习机器学习

近段时间学习了机器学习、线性回归和softmax回归、多层感知机、卷积神经网络、Pytorch神经网络工具箱、Python数据处理工具箱、图像分类等的知识,学习了利用神经网络实现cifar10的操作、手写图像识别项目以及其对应的实验项目报告总结。项目总结本次项目我使用了VGG19模型、AlexNet模型和已使用的VGG16模型进行对比,在已有的条件下,对代码进行更改是,结果展示中,VGG19模型的

- 第N4周:NLP中的文本嵌入

OreoCC

自然语言处理人工智能

本人往期文章可查阅:深度学习总结词嵌入是一种用于自然语言处理(NLP)的技术,用于将单词表示为数字,以便计算机可以处理它们。通俗的讲就是,一种把文本转为数值输入到计算机中的方法。之前文章中提到的将文本转换为字典序列、one-hot编码就是最早期的词嵌入方法。Embedding和EmbeddingBag则是PyTorch中的用来处理文本数据中词嵌入(wordembedding)的工具,它们将离散的词

- 【大模型】DeepSeek-R1-Distill-Qwen部署及API调用

油泼辣子多加

大模型实战算法gptlangchain人工智能

DeepSeek-R1-Distill-Qwen是由中国人工智能公司深度求索(DeepSeek)开发的轻量化大语言模型,基于阿里巴巴的Qwen系列模型通过知识蒸馏技术优化而来。当前模型开源后,我们可以将其部署,使用API方式进行本地调用1.部署环境本文中的部署基础环境如下所示:PyTorch2.5.1Python3.12(ubuntu22.04)Cuda12.4GPURTX3090(24GB)*1

- opencv cuda例程 OpenCV和Cuda结合编程

weixin_44602056

opencvC++

本文转载自:https://www.fuwuqizhijia.com/linux/201704/70863.html此网页,仅保存下来供随时查看一、利用OpenCV中提供的GPU模块目前,OpenCV中已提供了许多GPU函数,直接使用OpenCV提供的GPU模块,可以完成大部分图像处理的加速操作。该方法的优点是使用简单,利用GpuMat管理CPU与GPU之间的数据传输,而且不需要关注内核函数调用参

- 利用CUDA与OpenCV实现高效图像处理:全面指南

快撑死的鱼

C++(C语言)算法大揭秘opencv图像处理人工智能

利用CUDA与OpenCV实现高效图像处理:全面指南前言在现代计算机视觉领域,图像处理的需求日益增加。无论是自动驾驶、安防监控,还是医疗影像分析,图像处理技术都扮演着至关重要的角色。然而,图像处理的计算量非常大,往往需要强大的计算能力来保证实时性和高效性。幸运的是,CUDA和OpenCV为我们提供了一种高效的图像处理解决方案。本篇文章将详细介绍如何结合CUDA与OpenCV,利用GPU的强大计算能

- 深度学习 PyTorch 中 18 种数据增强策略与实现

@Mr_LiuYang

计算机视觉基础数据增强深度学习torchvisiontransforms

深度学习pytorch之简单方法自定义9类卷积即插即用数据增强通过对训练数据进行多种变换,增加数据的多样性,它帮助我们提高模型的鲁棒性,并减少过拟合的风险。PyTorch提供torchvision.transforms模块丰富的数据增强操作,我们可以通过组合多种策略来实现复杂的增强效果。本文将介绍18种常用的图像数据增强策略,并展示如何使用PyTorch中的torchvision.transfor

- linux 下 CUDA + Opencv 编程 之 CMakeLists.txt

maxruan

编程图像处理CUDAopencvlinuxc++cuda

CMAKE_MINIMUM_REQUIRED(VERSION2.8)PROJECT(medianFilterGPU)#CUDApackageFIND_PACKAGE(CUDAREQUIRED)INCLUDE(FindCUDA)#CUDAincludedirectoriesINCLUDE_DIRECTORIES(/usr/local/cuda/include)#OpenCVpackageFIND_P

- Win11及CUDA 12.1环境下PyTorch安装及避坑指南:深度学习开发者的福音

郁云爽

Win11及CUDA12.1环境下PyTorch安装及避坑指南:深度学习开发者的福音【下载地址】Win11及CUDA12.1环境下PyTorch安装及避坑指南本资源文件旨在为在Windows11操作系统及CUDA12.1环境下安装PyTorch的用户提供详细的安装步骤及常见问题解决方案。无论你是初学者还是有经验的开发者,这份指南都将帮助你顺利完成PyTorch的安装,并避免常见的坑项目地址:htt

- Word2Vec 模型 PyTorch 实现并复现论文中的数据集

Illusionna.

word2vecpytorch人工智能算法自然语言处理nlpmatplotlib

详细注解链接:https://www.orzzz.net/directory/codes/Word2Vec/index.html欢迎咨询!

- UE发生GPU崩溃D3D丢失,真的跟硬件有关系。

虚幻叫兽

UE虚幻引擎MetaHumanue5GPU崩溃

先说一下我的配置:2022年4月全新台式机。i912900kfDDR560003070ti8G读写7000m的M.2win11,最新显卡驱动,GameReady和Studio都试过。===但是BUT===UE5每天GPU崩溃几十次,UE4比较少见。按说我这配置还可以吧,鲁大师全国排名六百多(4月8日),二百三十多万分,也算够用。但我没说运行哪个UE程序导致的GPU崩溃。也许你看出来了,问题就出在8

- ue5.5崩溃报gpu错误快速修复注册表命令方法

Maya和blender动画技术

ue5ue5.5崩溃报gpu错误

网上已经有很多方法了,自己写了个regedit比处理dos批处理命令,启动时需要win管理员身份拷贝后,将以下代码,保存为run.bat格式批处理文件,右键鼠标,在弹出菜单中,选择用管理员身份运行。即可。南无阿弥陀佛。命令如下:::如果存在先删除原来变量,如下:regdeleteHKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Graphics

- 基于PyTorch的深度学习4——使用numpy实现机器学习vs使用Tensor及Antograd实现机器学习

Wis4e

深度学习机器学习pytorch

首先,给出一个数组x,然后基于表达式y=3x2+2,加上一些噪音数据到达另一组数据y。然后,构建一个机器学习模型,学习表达式y=wx2+b的两个参数w、b。利用数组x,y的数据为训练数据。最后,采用梯度梯度下降法,通过多次迭代,学习到w、b的值。以下为具体步骤:1)导入需要的库。importnumpyasnp%matplotlibinlinefrommatplotlibimportpyplotas

- AWS AppStream 2.0:开启云端应用交付新范式(实战解决方案剖析)

AWS官方合作商

aws云计算系统架构

导言:数字化转型中的"最后一公里"挑战当企业加速上云进程时,CAD设计软件、财务系统等专业工具受制于终端性能、数据安全与跨平台难题。AWSAppStream2.0作为全托管应用流服务,正为2000+企业破解这一困局——无需代码改造,将Windows应用转化为云服务。一、为什么AppStream2.0成为技术决策者新宠?1.1技术架构革命(对比传统VDI)去终端化部署:3D渲染/CAD等GPU应用在

- Pytorch 第九回:卷积神经网络——ResNet模型

Start_Present

pytorchcnnpython分类深度学习

Pytorch第九回:卷积神经网络——ResNet模型本次开启深度学习第九回,基于Pytorch的ResNet卷积神经网络模型。这是分享的第四个卷积神经网络模型。该模型是基于解决因网络加深而出现的梯度消失和网络退化而进行设计的。接下来给大家分享具体思路。本次学习,借助的平台是PyCharm2024.1.3,python版本3.11numpy版本是1.26.4,pytorch版本2.0.0+cu11

- Pytorch的一小步,昇腾芯片的一大步

BRUCE_WUANG

pytorch人工智能python

Pytorch的一小步,昇腾芯片的一大步相信在AI圈的人多多少少都看到了最近的信息:PyTorch最新2.1版本宣布支持华为昇腾芯片!1、发生了什么事儿?在2023年10月4日PyTorch2.1版本的发布博客上,PyTorch介绍的beta版本新特性上有一个PRIVATEUSE1特性是提高了第三方设备的支持,并说明了华为AscendNPU(昇腾NPU芯片)的OSS小组已经成功将torch_npu

- 每天五分钟深度学习pytorch:基于Pytorch搭建ResNet模型的残差块

每天五分钟玩转人工智能

深度学习框架pytorch深度学习pytorch人工智能ResNet机器学习

残差块我们分析一下这个残差块,x经过两个卷积层得到F(x),然后F(x)+x作为残差块的输出,此时就有一个问题,这个问题就是F(x)+x的维度问题,如果图片数据经过两个卷积层之后F(x)变小(height和weight变小)或者通道数发生了变化,那么此时F(x)是没有办法和x相加的,当然我们可以学习前面的GoogLeNet的方式,也就是说卷积之后的F(x)和x一样,大小不变,或者对x变道和F(x)

- 实战1. 利用Pytorch解决 CIFAR 数据集中的图像分类为 10 类的问题

啥都鼓捣的小yao

深度学习pytorch分类人工智能深度学习

实战1.利用Pytorch解决CIFAR数据集中的图像分类为10类的问题加载数据建立模型模型训练测试评估你的任务是建立一个用于CIFAR图像分类的神经网络,并实现分类质量>0.5。注意:因为我们实战1里只讨论最简单的神经网络构建,所以准确率达到0.5以上就符合我们的目标,后面会不断学习新的模型进行优化CIFAR的数据集如下图所示:我们大概所需要的功能包如下:importnumpyasnpimpor

- Pycharm搭建CUDA,Pytorch教程(匹配版本,安装,搭建全保姆教程)_cuda12(1)

2401_84557821

程序员pycharmpytorchide

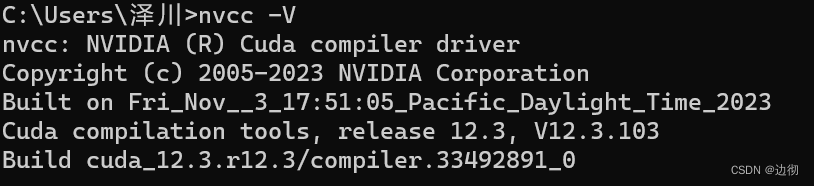

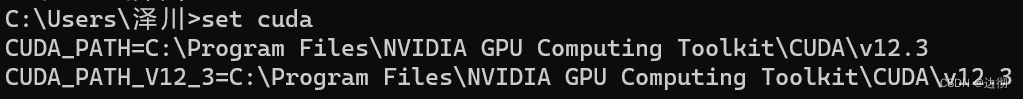

查看cuda版本输入setcuda查看环境变量如上两图即为下载成功!##二、安装Pytorch#

- python 程序一次启动有两个进程的问题(flask)

小郎碎碎念

我恨BUGpythonflask开发语言

0.背景写了一个使用flask作为服务框架的程序,发现每次启动程序的时候,使用ps都能观察到两个python进程。此外,这个程序占用了GPU资源,我发现有两个python进程,分别占用了完全相同的GPU显存1.原因问题出在flask的启动方式上,我启动的时候,是这样启动的app.run(debug=True,host='0.0.0.0',port=5000)查到的资料如下,Flask中的debug

- Maven

Array_06

eclipsejdkmaven

Maven

Maven是基于项目对象模型(POM), 信息来管理项目的构建,报告和文档的软件项目管理工具。

Maven 除了以程序构建能力为特色之外,还提供高级项目管理工具。由于 Maven 的缺省构建规则有较高的可重用性,所以常常用两三行 Maven 构建脚本就可以构建简单的项目。由于 Maven 的面向项目的方法,许多 Apache Jakarta 项目发文时使用 Maven,而且公司

- ibatis的queyrForList和queryForMap区别

bijian1013

javaibatis

一.说明

iBatis的返回值参数类型也有种:resultMap与resultClass,这两种类型的选择可以用两句话说明之:

1.当结果集列名和类的属性名完全相对应的时候,则可直接用resultClass直接指定查询结果类

- LeetCode[位运算] - #191 计算汉明权重

Cwind

java位运算LeetCodeAlgorithm题解

原题链接:#191 Number of 1 Bits

要求:

写一个函数,以一个无符号整数为参数,返回其汉明权重。例如,‘11’的二进制表示为'00000000000000000000000000001011', 故函数应当返回3。

汉明权重:指一个字符串中非零字符的个数;对于二进制串,即其中‘1’的个数。

难度:简单

分析:

将十进制参数转换为二进制,然后计算其中1的个数即可。

“

- 浅谈java类与对象

15700786134

java

java是一门面向对象的编程语言,类与对象是其最基本的概念。所谓对象,就是一个个具体的物体,一个人,一台电脑,都是对象。而类,就是对象的一种抽象,是多个对象具有的共性的一种集合,其中包含了属性与方法,就是属于该类的对象所具有的共性。当一个类创建了对象,这个对象就拥有了该类全部的属性,方法。相比于结构化的编程思路,面向对象更适用于人的思维

- linux下双网卡同一个IP

被触发

linux

转自:

http://q2482696735.blog.163.com/blog/static/250606077201569029441/

由于需要一台机器有两个网卡,开始时设置在同一个网段的IP,发现数据总是从一个网卡发出,而另一个网卡上没有数据流动。网上找了下,发现相同的问题不少:

一、

关于双网卡设置同一网段IP然后连接交换机的时候出现的奇怪现象。当时没有怎么思考、以为是生成树

- 安卓按主页键隐藏程序之后无法再次打开

肆无忌惮_

安卓

遇到一个奇怪的问题,当SplashActivity跳转到MainActivity之后,按主页键,再去打开程序,程序没法再打开(闪一下),结束任务再开也是这样,只能卸载了再重装。而且每次在Log里都打印了这句话"进入主程序"。后来发现是必须跳转之后再finish掉SplashActivity

本来代码:

// 销毁这个Activity

fin

- 通过cookie保存并读取用户登录信息实例

知了ing

JavaScripthtml

通过cookie的getCookies()方法可获取所有cookie对象的集合;通过getName()方法可以获取指定的名称的cookie;通过getValue()方法获取到cookie对象的值。另外,将一个cookie对象发送到客户端,使用response对象的addCookie()方法。

下面通过cookie保存并读取用户登录信息的例子加深一下理解。

(1)创建index.jsp文件。在改

- JAVA 对象池

矮蛋蛋

javaObjectPool

原文地址:

http://www.blogjava.net/baoyaer/articles/218460.html

Jakarta对象池

☆为什么使用对象池

恰当地使用对象池化技术,可以有效地减少对象生成和初始化时的消耗,提高系统的运行效率。Jakarta Commons Pool组件提供了一整套用于实现对象池化

- ArrayList根据条件+for循环批量删除的方法

alleni123

java

场景如下:

ArrayList<Obj> list

Obj-> createTime, sid.

现在要根据obj的createTime来进行定期清理。(释放内存)

-------------------------

首先想到的方法就是

for(Obj o:list){

if(o.createTime-currentT>xxx){

- 阿里巴巴“耕地宝”大战各种宝

百合不是茶

平台战略

“耕地保”平台是阿里巴巴和安徽农民共同推出的一个 “首个互联网定制私人农场”,“耕地宝”由阿里巴巴投入一亿 ,主要是用来进行农业方面,将农民手中的散地集中起来 不仅加大农民集体在土地上面的话语权,还增加了土地的流通与 利用率,提高了土地的产量,有利于大规模的产业化的高科技农业的 发展,阿里在农业上的探索将会引起新一轮的产业调整,但是集体化之后农民的个体的话语权 将更少,国家应出台相应的法律法规保护

- Spring注入有继承关系的类(1)

bijian1013

javaspring

一个类一个类的注入

1.AClass类

package com.bijian.spring.test2;

public class AClass {

String a;

String b;

public String getA() {

return a;

}

public void setA(Strin

- 30岁转型期你能否成为成功人士

bijian1013

成功

很多人由于年轻时走了弯路,到了30岁一事无成,这样的例子大有人在。但同样也有一些人,整个职业生涯都发展得很优秀,到了30岁已经成为职场的精英阶层。由于做猎头的原因,我们接触很多30岁左右的经理人,发现他们在职业发展道路上往往有很多致命的问题。在30岁之前,他们的职业生涯表现很优秀,但从30岁到40岁这一段,很多人

- [Velocity三]基于Servlet+Velocity的web应用

bit1129

velocity

什么是VelocityViewServlet

使用org.apache.velocity.tools.view.VelocityViewServlet可以将Velocity集成到基于Servlet的web应用中,以Servlet+Velocity的方式实现web应用

Servlet + Velocity的一般步骤

1.自定义Servlet,实现VelocityViewServl

- 【Kafka十二】关于Kafka是一个Commit Log Service

bit1129

service

Kafka is a distributed, partitioned, replicated commit log service.这里的commit log如何理解?

A message is considered "committed" when all in sync replicas for that partition have applied i

- NGINX + LUA实现复杂的控制

ronin47

lua nginx 控制

安装lua_nginx_module 模块

lua_nginx_module 可以一步步的安装,也可以直接用淘宝的OpenResty

Centos和debian的安装就简单了。。

这里说下freebsd的安装:

fetch http://www.lua.org/ftp/lua-5.1.4.tar.gz

tar zxvf lua-5.1.4.tar.gz

cd lua-5.1.4

ma

- java-14.输入一个已经按升序排序过的数组和一个数字, 在数组中查找两个数,使得它们的和正好是输入的那个数字

bylijinnan

java

public class TwoElementEqualSum {

/**

* 第 14 题:

题目:输入一个已经按升序排序过的数组和一个数字,

在数组中查找两个数,使得它们的和正好是输入的那个数字。

要求时间复杂度是 O(n) 。如果有多对数字的和等于输入的数字,输出任意一对即可。

例如输入数组 1 、 2 、 4 、 7 、 11 、 15 和数字 15 。由于

- Netty源码学习-HttpChunkAggregator-HttpRequestEncoder-HttpResponseDecoder

bylijinnan

javanetty

今天看Netty如何实现一个Http Server

org.jboss.netty.example.http.file.HttpStaticFileServerPipelineFactory:

pipeline.addLast("decoder", new HttpRequestDecoder());

pipeline.addLast(&quo

- java敏感词过虑-基于多叉树原理

cngolon

违禁词过虑替换违禁词敏感词过虑多叉树

基于多叉树的敏感词、关键词过滤的工具包,用于java中的敏感词过滤

1、工具包自带敏感词词库,第一次调用时读入词库,故第一次调用时间可能较长,在类加载后普通pc机上html过滤5000字在80毫秒左右,纯文本35毫秒左右。

2、如需自定义词库,将jar包考入WEB-INF工程的lib目录,在WEB-INF/classes目录下建一个

utf-8的words.dict文本文件,

- 多线程知识

cuishikuan

多线程

T1,T2,T3三个线程工作顺序,按照T1,T2,T3依次进行

public class T1 implements Runnable{

@Override

- spring整合activemq

dalan_123

java spring jms

整合spring和activemq需要搞清楚如下的东东1、ConnectionFactory分: a、spring管理连接到activemq服务器的管理ConnectionFactory也即是所谓产生到jms服务器的链接 b、真正产生到JMS服务器链接的ConnectionFactory还得

- MySQL时间字段究竟使用INT还是DateTime?

dcj3sjt126com

mysql

环境:Windows XPPHP Version 5.2.9MySQL Server 5.1

第一步、创建一个表date_test(非定长、int时间)

CREATE TABLE `test`.`date_test` (`id` INT NOT NULL AUTO_INCREMENT ,`start_time` INT NOT NULL ,`some_content`

- Parcel: unable to marshal value

dcj3sjt126com

marshal

在两个activity直接传递List<xxInfo>时,出现Parcel: unable to marshal value异常。 在MainActivity页面(MainActivity页面向NextActivity页面传递一个List<xxInfo>): Intent intent = new Intent(this, Next

- linux进程的查看上(ps)

eksliang

linux pslinux ps -llinux ps aux

ps:将某个时间点的进程运行情况选取下来

转载请出自出处:http://eksliang.iteye.com/admin/blogs/2119469

http://eksliang.iteye.com

ps 这个命令的man page 不是很好查阅,因为很多不同的Unix都使用这儿ps来查阅进程的状态,为了要符合不同版本的需求,所以这个

- 为什么第三方应用能早于System的app启动

gqdy365

System

Android应用的启动顺序网上有一大堆资料可以查阅了,这里就不细述了,这里不阐述ROM启动还有bootloader,软件启动的大致流程应该是启动kernel -> 运行servicemanager 把一些native的服务用命令启动起来(包括wifi, power, rild, surfaceflinger, mediaserver等等)-> 启动Dalivk中的第一个进程Zygot

- App Framework发送JSONP请求(3)

hw1287789687

jsonp跨域请求发送jsonpajax请求越狱请求

App Framework 中如何发送JSONP请求呢?

使用jsonp,详情请参考:http://json-p.org/

如何发送Ajax请求呢?

(1)登录

/***

* 会员登录

* @param username

* @param password

*/

var user_login=function(username,password){

// aler

- 发福利,整理了一份关于“资源汇总”的汇总

justjavac

资源

觉得有用的话,可以去github关注:https://github.com/justjavac/awesome-awesomeness-zh_CN 通用

free-programming-books-zh_CN 免费的计算机编程类中文书籍

精彩博客集合 hacke2/hacke2.github.io#2

ResumeSample 程序员简历

- 用 Java 技术创建 RESTful Web 服务

macroli

java编程WebREST

转载:http://www.ibm.com/developerworks/cn/web/wa-jaxrs/

JAX-RS (JSR-311) 【 Java API for RESTful Web Services 】是一种 Java™ API,可使 Java Restful 服务的开发变得迅速而轻松。这个 API 提供了一种基于注释的模型来描述分布式资源。注释被用来提供资源的位

- CentOS6.5-x86_64位下oracle11g的安装详细步骤及注意事项

超声波

oraclelinux

前言:

这两天项目要上线了,由我负责往服务器部署整个项目,因此首先要往服务器安装oracle,服务器本身是CentOS6.5的64位系统,安装的数据库版本是11g,在整个的安装过程中碰到很多的坑,不过最后还是通过各种途径解决并成功装上了。转别写篇博客来记录完整的安装过程以及在整个过程中的注意事项。希望对以后那些刚刚接触的菜鸟们能起到一定的帮助作用。

安装过程中可能遇到的问题(注

- HttpClient 4.3 设置keeplive 和 timeout 的方法

supben

httpclient

ConnectionKeepAliveStrategy kaStrategy = new DefaultConnectionKeepAliveStrategy() {

@Override

public long getKeepAliveDuration(HttpResponse response, HttpContext context) {

long keepAlive

- Spring 4.2新特性-@Import注解的升级

wiselyman

spring 4

3.1 @Import

@Import注解在4.2之前只支持导入配置类

在4.2,@Import注解支持导入普通的java类,并将其声明成一个bean

3.2 示例

演示java类

package com.wisely.spring4_2.imp;

public class DemoService {

public void doSomethin

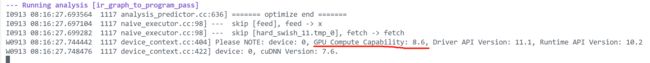

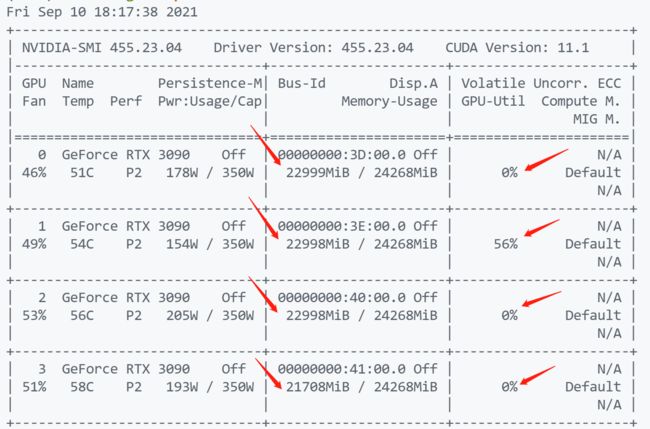

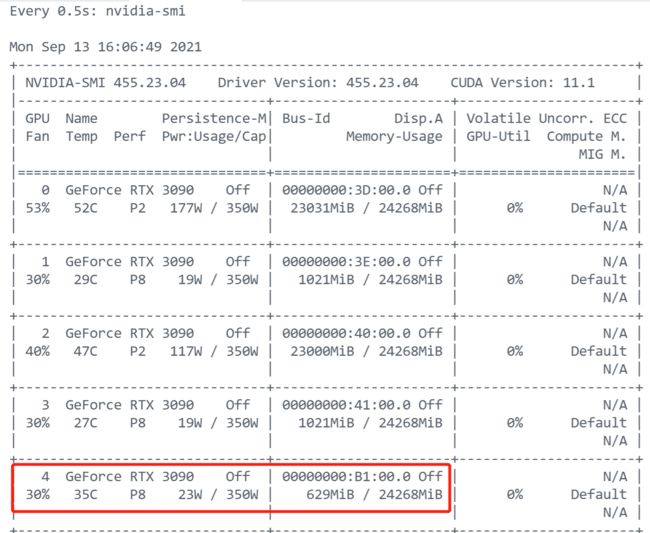

结合top命令发现,CPU数量48个,但是top命令中cpu最多就是9.4,根本占不满。。所以应该不是硬件的问题,不是cpu和gpu之间数据传输导致的

结合top命令发现,CPU数量48个,但是top命令中cpu最多就是9.4,根本占不满。。所以应该不是硬件的问题,不是cpu和gpu之间数据传输导致的