NNDL 作业4:第四章课后题

习题4-2

试设计一个前馈神经网络来解决XOR问题,要求该前馈神经网络具有两个隐藏神经元和一个输出神经元,并使用ReLU作为激活函数。

XOR问题就是异或问题,(数学符号为“ ⨁ \bigoplus ⨁”,程序符号为“^”)

代码实现:

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

class XORModule(nn.Module):

def __init__(self):

super(XORModule, self).__init__()

self.fc1 = nn.Linear(2, 2) # 输入层和隐藏层

self.fc2 = nn.Linear(2, 1) # 隐藏层和输出层

self.relu = nn.ReLU()

def forward(self, x):

x = x.view(-1, 2)

x = self.relu((self.fc1(x)))

x = self.fc2(x)

return x

# 输入和输出数据

input_x = torch.Tensor([[0, 0], [0, 1], [1, 0], [1, 1]])

input_x1 = input_x.float()

real_y = torch.Tensor([[0], [1], [1], [0]])

real_y1 = real_y.float()

# 设置损失函数和参数优化函数

net = XORModule()

loss_function = nn.MSELoss() # 用交叉熵损失函数会出现维度错误

optimizer = optim.SGD(net.parameters(), lr=0.5) # 用Adam优化参数选不好会出现计算值超出0-1的范围

# 进行训练

for epoch in range(100):

out_y = net(input_x1)

loss = loss_function(out_y, real_y1) # 计算损失函数

optimizer.zero_grad() # 对梯度清零,避免造成累加

loss.backward() # 反向传播

optimizer.step() # 参数更新

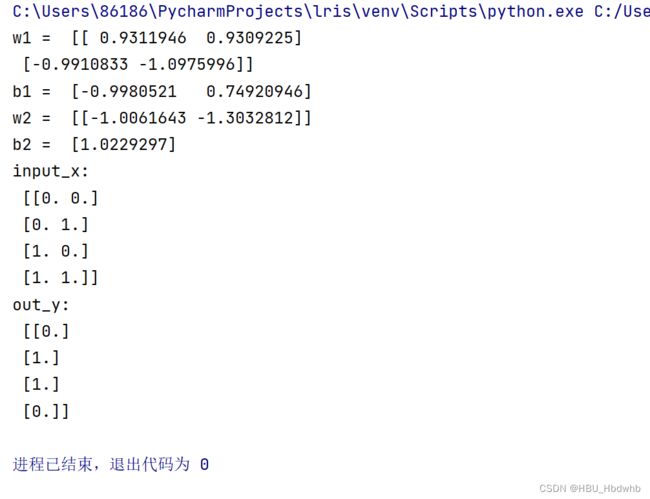

# 输出权值和偏置

print('w1 = ', net.fc1.weight.detach().numpy())

print('b1 = ', net.fc1.bias.detach().numpy())

print('w2 = ', net.fc2.weight.detach().numpy())

print('b2 = ', net.fc2.bias.detach().numpy())

# 测试

input_test = input_x1

out_test = net(input_test)

a = np.around(out_test.detach()).numpy().tolist()

b = real_y1.numpy().tolist()

count = 0

for i in range(4):

if a[i] == b[i]:

count += 1

print("正确率为", count*100/4, "%")

习题4-3

试举例说明“死亡ReLU问题”,并提出解决方法。

当前向传递中一个神经元的值恒等于 0(即z_{i} =0,表示该神经元未被激活),该神经元对应的权重的梯度将为0,这时权重得不到更新。这就会导致所谓的“死亡” ReLU问题。如果一个ReLU 神经元由于被不恰当地初始化而恒等于 0(这时不是模型参数的问题),或是其对应的参数在训练过程中由于大幅度的更新而接近于 0(这时在下一样本的计算中该神经元的值就会趋于为 0,随着而来的是权重的梯度为 0,权重无法更新,导致该神经元的值恒为 0),那么这个神经元将永远处于死亡状态。这就是“死亡” ReLU。

使用Leaky ReLU(带泄露的ReLU函数)替换掉ReLU函数。

习题4-7

为什么在神经网络模型的结构化风险函数中不对偏置进行正则化?

正则化的作用是为了限制模型的复杂度避免模型过拟合,提高模型的泛化能力。

对于某个神经元的输入来说,input = w(0)x(0) + w(1)x(1) + w(2)x(2) + ······ + b

对于样本特征向量X,其对input的贡献只与权重向量W有关。

若W向量中的值都很大,若特征向量X中的值发生细微的变化会导致input值的突变。

这就导致了模型的不稳定,所有我们希望得到较小的权重值。而偏置b对于所有输入样本来说都是一致的,是一个不变量,所以不需要考虑对B进行正则化。

习题4-8

为什么在用反向传播算法进行参数学习时要采用随机参数初始化的方式而不是直接令 w = 0 , b = 0?

若将和都初始化为0,则在输入层之后的所有隐藏层神经元接收到的输入都是一样的,那么在使用反向传播算法进行梯度的传递时,每一隐藏层的权重梯度值都是相同的,这就导致了权重只能向同一方向下降,这和问题4-1有一定的相似性,只不过是从权重和偏置方面导致了输入X值的非零均值化(更极端的是所有值相同)。