OpenCV目标跟踪(三)-camshift算法

这两天主要在学习目标跟踪的典型算法-camshift算法,在讨论和介绍camshift算法之前,我们先来讨论下meanshift算法。

(1)meanshift算法

meanshift算法是一种在一组数据的密度分布中寻找局部极值稳定的方法。具体的数学原理主要是基于概率统计的思想,略有点复杂,下面给出一篇博文链接,感兴趣的话可以去研究下meanshift算法背后的概率统计原理。

http://blog.csdn.net/jinshengtao/article/details/30258833

meanshift算法的主要步骤是:

a.选择搜索窗口

- 窗口的初始位置;

- 窗口的类型(均匀、多项式、指数或者高斯类型);

- 窗口的形状(对称的或歪斜的,可能旋转的,圆形或矩形);

- 窗口的大小(超出窗口大小则被截去)。

b.计算窗口(可能是带权重的)的重心。

c.将窗口的中心设置在计算出的重心处。

d.返回到b步,直到窗口的位置不再变化。

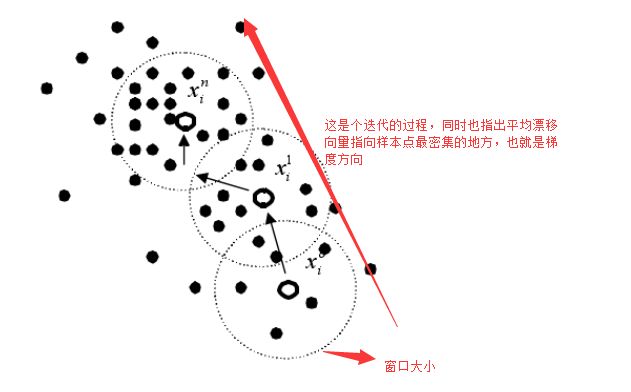

上述算法步骤中的窗口,实则就是上文中博文链接的数学原理中的核函数,meanshift算法与核密度估计的规则有关。如果在足够的点处有足够合适的带权重和尺度的核,数据分布便可以完全根据这些核来表示。而基于meanshift算法的目标跟踪,通过分别计算目标区域和候选区域内像素的特征值概率得到关于目标模型和候选模型的描述,然后利用相似函数度量初始帧目标模型和当前帧的候选模版的相似性,选择使相似函数最大的候选模型并得到关于目标模型的Meanshift向量,这个向量正是目标由初始位置向正确位置移动的向量。由于均值漂移算法的快速收敛性,通过不断迭代计算Meanshift向量,算法最终将收敛到目标的真实位置,达到跟踪的目的。

下面给出个直观的图描述这个跟踪的过程:

在OpenCV中有函数cvMeanShift(),下面简要介绍下这个函数中的参数。

int cvMeanShift(

const CvArr* prob_image,//单通道图像

CvRect window,//指定初始位置,大小为核窗口的大小

CvTermCriteria criteria,//迭代终止条件

CvConnectedComp *comp//连接部件,comp->rect中包含了收敛后搜索窗口的位置等信息

);(2)camshift算法

camshift是“continuously adaptive mean-shift”的缩写,顾名思义,camshift算法是基于meanshift算法的,与meanshift算法不同之处在于camshift搜索窗口会进行自我调整,更有利于对目标的跟踪,因此在OpenCV中cvCamShift()函数中的参数列表中相应的给出了box参数,在跟踪的应用中,会把由前一帧计算出的新尺寸box作为下一帧的window。

int cvCamShift(

const CvArr* prob_img,

CvRect window,

CvTermCriteria criteria,

CvConnectedComp* comp,

CvBox2D* box=NULL

);下面给出OpenCV中自带的工程示例程序camshiftdemo程序,这个程序的大致思路是这样的:通过计算目标HSV空间下的HUE分量直方图,通过直方图反向投影得到目标像素的概率分布,然后调用CV库中的camshift算法,自动跟踪并调整目标窗口的中心位置与大小。下面给出这个demo的完整程序段和注释:

/*

OpenCV中自带的Camshiftdemo,程序的思想是通过计算目标HSV空间下的HUE分量直方图,通过直方图反向投影

得到目标像素的概率分布,然后通过调用CV库中的Camshift算法,自动跟踪并调整目标窗口的中心位置和大小。

*/

#include "opencv2/video/tracking.hpp"

#include "opencv2/imgproc/imgproc.hpp"

#include "opencv2/highgui/highgui.hpp"

#include (i) = Vec3b(saturate_cast(i*180. / hsize), 255, 255);

cvtColor(buf, buf, CV_HSV2BGR);//hsv又转换成bgr

for (int i = 0; i < hsize; i++)

{

int val = saturate_cast<int>(hist.at<float>(i)*histimg.rows / 255);//at函数为返回一个指定数组元素的参考值

//在一幅输入图像上画一个简单抽的矩形,指定左上角和右下角,并定义颜色,大小,线型等

rectangle(histimg, Point(i*binW, histimg.rows),

Point((i + 1)*binW, histimg.rows - val),

Scalar(buf.at(i)), -1, 8);

}

}

//计算直方图的反向投影,计算hue图像0通道直方图hist的反向投影,并让入backproj中

calcBackProject(&hue, 1, 0, hist, backproj, &phranges);

backproj &= mask;

RotatedRect trackBox = CamShift(backproj, trackWindow,

TermCriteria(CV_TERMCRIT_EPS | CV_TERMCRIT_ITER, 10, 1)); //trackWindow为鼠标选择的区域,TermCriteria为确定迭代终止的准则

if (trackWindow.area() <= 1)

{

int cols = backproj.cols, rows = backproj.rows, r = (MIN(cols, rows) + 5) / 6;

trackWindow = Rect(trackWindow.x - r, trackWindow.y - r,

trackWindow.x + r, trackWindow.y + r) &

Rect(0, 0, cols, rows);

}

if (backprojMode)

cvtColor(backproj, image, COLOR_GRAY2BGR);

ellipse(image, trackBox, Scalar(0, 0, 255), 3, CV_AA);//跟踪的时候以椭圆为代表目标

}

}

else if (trackObject < 0)

paused = false;

if (selectObject && selection.width > 0 && selection.height > 0)

{

Mat roi(image, selection);

bitwise_not(roi, roi);// bitwise_not为将每一个bit位取反

}

imshow("CamShift Demo", image);

imshow("Histogram", histimg);

char c = (char)waitKey(10);

if (c == 27)//退出键

break;

switch (c)

{

case 'b'://反向投影模型交替

backprojMode = !backprojMode;

break;

case 'c'://清零跟踪目标对象

trackObject = 0;

histimg = Scalar::all(0);

break;

case 'h'://显示直方图交替

showHist = !showHist;

if (!showHist)

destroyWindow("Histogram");

else

namedWindow("Histogram", 1);

break;

case 'p'://暂停跟踪交替

paused = !paused;

break;

default:

;

}

}

return 0;

}

camshift算法相对于meanshift算法来说,有很多的优点,在工程实践中经常更能因为随时可以变化搜索窗口而被广泛使用。这个算法对于纯色物体在背景下跟踪效果是非常好的。但是如果背景的颜色和目标相近,或者是目标与附近物体的色调相近,则camshift算法的跟踪效果就会变差,会把相近的颜色也包含进来,导致跟踪窗口变大,甚至会扩大到整个视频区域。