k近邻推荐用到的各种距离

1 k k k-近邻推荐原理

2 各种距离

2.1 欧几里得距离

d 12 = ( x 1 − x 2 ) 2 + ( y 1 − y 2 ) 2 d_{12} = \sqrt{(x_{1} - x_{2})^2 + (y_{1} - y_{2})^2} d12=(x1−x2)2+(y1−y2)2

缺点:欧式距离是一种常用的距离度量,但它并不是尺度不变的,这意味着所计算的距离可能会根据特征的单位发生倾斜。通常,在使用欧式距离度量之前,需要对数据进行归一化处理。

此外,随着数据维数的增加,欧氏距离的作用也就越小。这与维数灾难(curse of dimensionality)有关。

用例:当数据的维度比较低,欧式距离的效果非常好。如果在低维数据上使用欧式距离,则如 k k k-NN 和 HDBSCAN 之类的方法可达到开箱即用的效果。

2.2 曼哈顿距离

在曼哈顿街区要从一个十字路口开车到另一个十字路口,驾驶距离显然不是两点间的直线距离。这个实际驾驶距离就是曼哈顿距离。 曼哈顿距离也称为“城市街区距离”(City Block distance)。

d 12 = ∣ x 1 − x 2 ∣ + ∣ y 1 − y 2 ∣ d_{12} = \left|x_{1} - x_{2}\right| + \left|y_{1} - y_{2}\right| d12=∣x1−x2∣+∣y1−y2∣

缺点:尽管曼哈顿距离在高维数据中可以工作,但它比欧式距离直观性差。此外,由于它可能不是最短路径,有可能比欧氏距离给出一个更高的距离值。

用例:当数据集具有离散或二进制属性时,曼哈顿距离似乎工作得很好,因为它考虑了在这些属性值中实际可以采用的路径。以欧式距离为例,它会在两个向量之间形成一条直线,但实际上这是不可能的。

2.3 切比雪夫距离 (Chebyshev Distance)

切比雪夫距离定义为两个向量在任意坐标维度上的最大差值。换句话说,它就是沿着一个轴的最大距离。切比雪夫距离通常被称为棋盘距离,因为国际象棋的国王从一个方格到另一个方格的最小步数等于切比雪夫距离。

d 12 = max ( ∣ x 1 − x 2 ∣ , ∣ y 1 − y 2 ∣ ) d_{12} = \max(\left|x_{1} - x_{2}\right|, \left|y_{1} - y_{2}\right|) d12=max(∣x1−x2∣,∣y1−y2∣)

缺点:切比雪夫距离通常用于特定的用例,这使得它很难像欧氏距离或余弦相似度那样作为通用的距离度量。因此,在确定适合用例时才使用它。

用例:切比雪夫距离用于提取从一个方块移动到另一个方块所需的最小移动次数。此外,在允许无限制八向移动的游戏中,这可能是有用的方法。在实践中,切比雪夫距离经常用于仓库物流,因为它非常类似于起重机移动一个物体的时间。

2.4 余弦距离

d 12 = x 1 x 2 + y 1 y 2 x 1 2 + y 1 2 x 2 2 + y 2 2 d_{12} = \frac{x_{1}x_{2} + y_1y_2}{\sqrt{x_1^2+y_1^2}\sqrt{x_2^2+y_2^2}} d12=x12+y12x22+y22x1x2+y1y2

缺点:余弦相似度的一个主要缺点是没有考虑向量的大小,而只考虑它们的方向。以推荐系统为例,余弦相似度就没有考虑到不同用户之间评分尺度的差异。

用例:当我们对高维数据向量的大小不关注时,可以使用余弦相似度。对于文本分析,当数据以单词计数表示时,经常使用此度量。例如,当一个单词在一个文档中比另一个单词更频繁出现时,这并不一定意味着文档与该单词更相关。可能是文件长度不均匀或者计数的重要性不太重要。我们最好使用忽略幅度的余弦相似度。

2.5 闵氏距离(Minkowski)

d 12 = [ ( x 1 − x 2 ) p + ( y 1 − y 2 ) p ] 1 p d_{12} =[(x_1 - x_2) ^p+ (y_1 - y_2)^p]^{\frac{1}{p}} d12=[(x1−x2)p+(y1−y2)p]p1

最有趣的一点是,我们可以使用参数 p p p 来操纵距离度量,使其与其他度量非常相似。常见的 p p p 值有:

- p = 1 p=1 p=1:曼哈顿距离

- p = 2 p=2 p=2:欧氏距离

- p = ∞ p=\infty p=∞:切比雪夫距离

缺点:闵氏距离与它们所代表的距离度量有相同的缺点,因此,对曼哈顿距离、欧几里得距离和切比雪夫距离等度量标准有个好的理解非常重要。此外,参数 p p p 的使用可能很麻烦,因为根据用例,查找正确的 p p p 值在计算上效率低。

用例: p p p的积极一面是可迭代,并找到最适合用例的距离度量。它允许在距离度量上有很大的灵活性,如果你非常熟悉 p p p和许多距离度量,将会获益多多。

2.6 雅卡尔指数(Jaccard Index)

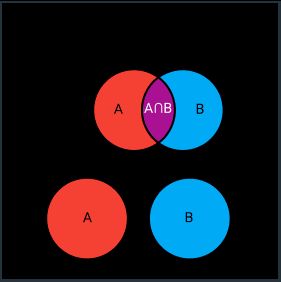

雅卡尔指数(交并比)是用于比较样本集相似性与多样性的统计量。雅卡尔系数能够量度有限样本集合的相似度,其定义为两个集合交集大小与并集大小之间的比例。

d A B = 1 − ∣ A ∩ B ∣ ∣ A ∪ B ∣ d_{AB} =1 - \frac{|A \cap B|}{|A \cup B|} dAB=1−∣A∪B∣∣A∩B∣

缺点:雅卡尔指数的一个主要缺点是它受数据大小的影响很大。大数据集对指数有很大影响,因为它可以显著增加并集,同时保持交集相似。

用例:雅卡尔指数通常用于使用二进制或二进制数据的应用程序中。当你有一个深度学习模型来预测图像分割时,比如一辆汽车,雅卡尔指数可以用来计算给定真实标签的预测分割的准确度。

类似地,它可以用于文本相似性分析,以测量文档之间有多少词语重叠。因此,它可以用来比较模式集合。

2.7 汉明距离(Hamming Distance)

汉明距离是两个向量之间不同值的个数。它通常用于比较两个相同长度的二进制字符串。它还可以用于字符串,通过计算不同字符的数量来比较它们之间的相似程度。

缺点:当两个向量长度不相等时,汉明距离使用起来很麻烦。当幅度是重要指标时,建议不要使用此距离指标。

用例:典型的用例包括数据通过计算机网络传输时的错误纠正 / 检测。它可以用来确定二进制字中失真的数目,作为估计误差的一种方法。此外,你还可以使用汉明距离来度量分类变量之间的距离。

2.8 半正矢(Haversine)

半正矢距离是指球面上的两点在给定经纬度条件下的距离。它与欧几里得距离非常相似,因为它可以计算两点之间的最短连线。主要区别在于半正矢距离不可能有直线,因为这里的假设是两个点都在一个球面上。

d = 2 r arcsin ( sin 2 ( φ 2 − φ 1 2 ) + cos ( φ 1 ) cos ( φ 2 ) sin 2 ( λ 2 − λ 1 2 ) ) d=2 \operatorname{r\arcsin}\left(\sqrt{\sin ^{2}\left(\frac{\varphi_{2}-\varphi_{1}}{2}\right)+\cos \left(\varphi_{1}\right) \cos \left(\varphi_{2}\right) \sin ^{2}\left(\frac{\lambda_{2}-\lambda_{1}}{2}\right)}\right) d=2rarcsin(sin2(2φ2−φ1)+cos(φ1)cos(φ2)sin2(2λ2−λ1))

符号说明:

d d d:两点之间的距离;

r r r:球的半径;

φ 1 , φ 2 \varphi_1,\varphi_2 φ1,φ2:点1和点2的纬度,以弧度制度量;

λ 1 , λ 2 \lambda_1, \lambda_2 λ1,λ2:点1和点2的经度,以弧度制度量。

缺点:这种距离测量的一个缺点是,假定这些点位于一个球体上。实际上,这种情况很少出现,例如,地球不是完美的圆形,在某些情况下可能使计算变得困难。相反,如果假定是椭球,使用 Vincenty 距离比较好。

用例:半正矢距离通常用于导航。例如,你可以使用它来计算两个国家之间的飞行距离。请注意,如果距离本身不那么大,则不太适合。

2.9 Sørensen-Dice 系数

Sørensen-Dice 系数与雅卡尔指数非常相似,都是度量样本集的相似性和多样性。尽管它们的计算方法相似,但是 Sørensen-Dice 系数更直观一些,因为它可以被视为两个集合之间重叠的百分比,这个值在 0 到 1 之间:

D ( A , B ) = 2 ∣ A ∩ B ∣ ∣ A ∣ + ∣ B ∣ D(A, B)=\frac{2|A \cap B|}{|A|+|B|} D(A,B)=∣A∣+∣B∣2∣A∩B∣

缺点:正如雅卡尔指数,Sørensen-Dice 系数也夸大了很少或没有真值的集合的重要性,因此,它可以控制多集合的平均得分,还可以控制多组平均得分并按相关集合的大小成反比地加权每个项目,而不是平等对待它们。

用例:用例与雅卡尔指数相似,它通常用于图像分割任务或文本相似性分析。

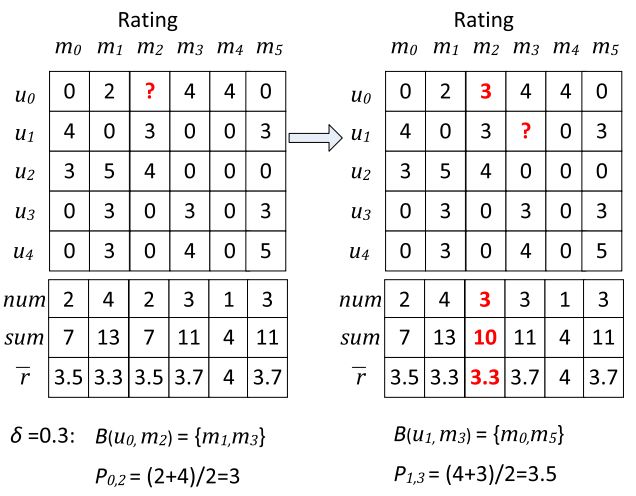

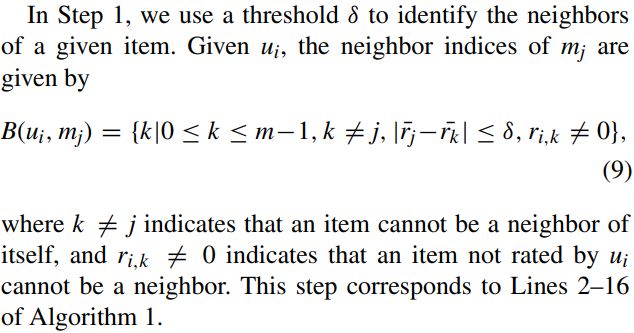

2.10 M-Distance

Mei Zheng, Fan Min, Heng-Ru Zhang, Wen-Bin Chen, Fast recommendations with the M-distance, IEEE Access 4 (2016) 1464–1468.

2.11 MCFV

Heng-Ru Zhang, Fan Min, Zhi-Heng Zhang, Song Wang, Efficient collaborative filtering recommendations with multi-channel feature vectors. International Journal of Machine Learning & Cybernetics. (2019)1165–1172.

2.12 三角距离Triangle

Triangle ( i j , i q ) = Triangle ( O A → , O B → ) = 1 − ∣ A B ∣ ∣ O A ∣ + ∣ O B ∣ Triangle ( i j , i q ) = 1 − ∑ u ∈ C i j , i q ( r u , j − r u , q ) 2 ∑ u ∈ C i , i , q r u , j 2 + ∑ u ∈ C i , i , q r u , q 2 \operatorname{Triangle}\left(i_{j}, i_{q}\right)=\operatorname{Triangle}(\overrightarrow{O A}, \overrightarrow{O B})=1-\frac{|A B|}{|O A|+|O B|} \\ \operatorname{Triangle}\left(i_{j}, i_{q}\right)=1-\frac{\sqrt{\sum_{u \in C_{i j, i_{q}}}\left(r_{u, j}-r_{u, q}\right)^{2}}}{\sqrt{\sum_{u \in C_{i, i, q}} r_{u, j}^{2}}+\sqrt{\sum_{u \in C_{i, i, q}} r_{u, q}^{2}}} Triangle(ij,iq)=Triangle(OA,OB)=1−∣OA∣+∣OB∣∣AB∣Triangle(ij,iq)=1−∑u∈Ci,i,qru,j2+∑u∈Ci,i,qru,q2∑u∈Cij,iq(ru,j−ru,q)2

where O A → \overrightarrow{O A} OA is the rating vector of i j i_{j} ij, O B → \overrightarrow{O B} OB is the rating vector of i q i_{q} iq.

Triangle considers both the length of vectors and the angle between them, so it is more reasonable than the angle based Cosine measure. For example, given the two vectors A = (5, 5, 5) and B = (1, 1, 1), the Cosine similarity is 1, which is contrary to common sense. In contrast, the Triangle similarity between them is 0.33, more in line with expectations.

三角距离既考虑了向量的长度,也考虑了它们之间的夹角,因此比基于角度的余弦测度更合理。 例如,给定两个向量 A = (5, 5, 5) 和 B = (1, 1, 1),则余弦相似度为 1,这与常识相反。 相比之下,它们之间的三角形相似度为0.33,更符合预期。

Shuang-Bo Sun, Zhi-Heng Zhang, Xin-Ling Dong, Heng-Ru Zhang, Tong-Jun Li, Lin Zhang, Fan Min, Integrating Triangle and Jaccard similarities for recommendation, PLOS ONE 12 (8) (2017) 1–16.