机翻《C-CAM: Causal CAM for Weakly Supervised Semantic Segmentation onMedical Image 》

前言

《C-CAM: Causal CAM for Weakly Supervised Semantic Segmentation onMedical Image》CVPR2022,有源码。

《C-CAM:用于医学图像弱监督语义分割的因果CAM》

作者Zhang Chen,田智强等6人,主页:CVPR 2022 Open Access Repository

github:https://github.com/Tian-lab/C-CAM

摘要:

最近,许多优秀的弱监督语义分割(WSSS)工作被提出来,这些工作是基于类激活映射(CAM)。然而,很少有作品考虑到医学图像的特点。在本文中,我们发现在WSSS中,医学图像主要存在两个挑战:i)物体前景和背景的边界不明确;ii)训练阶段的共现现象非常严重。因此,我们提出一种因果CAM(C-CAM)方法来克服上述挑战。我们的方法是由两个因果链引起的,包括类别-因果链和解剖-因果链。类别-因果关系链表示图像内容(因)影响类别(果)。解剖学因果链表示解剖结构(因)影响器官分割(果)。我们在三个公共医疗图像数据集上进行了广泛的实验。与其他类似CAM的方法相比,我们的CCAM在ProMRI、ACDC和CHAOS上产生了最好的pseudo-mask,DSC分别为77.26%、80.34%和78.15%。CCAM的伪掩模被进一步用于提高器官分割任务的分割性能。我们的C-CAM在ProMRI上实现了83.83%的DSC,在ACDC上实现了87.54%的DSC,这超过了最先进的WSSS方法。我们的代码可在https://github.com/Tian-lab/C-CAM访问。

- 介绍:

最近,由于深度学习的发展,语义分割[22]被广泛研究。现有的语义分割的方法是训练一个模型,用丰富的像素级标签数据对每个像素的类别进行分类。然而,像素级标签数据的获取既费时又费钱。因此,一种被称为弱监督语义分割(WSSS)的新范式出现了。与完全监督语义分割(FSSS)不同,WSSS利用弱注释,例如,图像级标签、点、涂鸦和边界框。在这些弱注释中,图像级别的标签是最容易获得的方法。同时,它也是用于分割的最具挑战性的方法。在本文中,我们主要研究医学图像分割中的图像级标签。

采用图像级标签的WSSS的主要问题是缺乏位置信息。类激活映射(CAM)方法[7, 14, 24, 30, 33, 44]创造性地赋予了卷积神经网络(CNN)以图像级标签的定位能力。然而,CAM只能对物体的鉴别性部分进行定位,这导致了糟糕的分离性能。许多基于CAM的WSSS方法[2, 8, 13, 18, 34, 39]相继被提出,以缩小WSSS和FSSS之间的差距。这些方法的主要思想是为了解决CAM不能完全覆盖物体的问题。一些方法[2, 8, 13, 18]使用CAM生成种子,并完善种子以覆盖整个目标。有些方法[19, 34, 39, 40]直接生成更准确的突出度图。然而,这些基于CAM的方法大多是针对自然图像而设计的,在医学图像上可能效果不佳。与自然图像相比,医学图像在基于图像级标签的WSSS上主要有以下两个挑战。我们在图1中直观地展示了这些挑战。

i) 前景和背景的边界不明确,这使得CAM模型很难对前景和背景的类别边界进行分类。

ii) 在训练阶段,医学图像中的共现现象非常严重,例如,在腹部磁共振成像(MRI)图像中,不同器官总是同时出现。然而,在自然图像中,共现现象并不那么严重。例如,"人 "不会总是和 "马"一起出现,反之亦然。因此,CAM模型可以通过丰富的图像级标签知道图像的哪一部分是"人"。不幸的是,CAM模型很难仅根据图像级别的标签来激活一个图像中正确的共现器官。

图1.医学图像的主要挑战。挑战1:医学图像的物体边界比自然图像更模糊。挑战2:在训练阶段,不同的器官经常出现在同一医学图像中。

因此,我们提出了一种因果CAM(C-CAM)方法来克服上述挑战。C-CAM从两个因果关系链出发。第一条链是类别因果关系X→Y,它表明图像内容X(原因)影响分类类别Y(结果)。第二条链是解剖学因果关系Z→S,表示解剖学结构Z(原因)影响口型分割S(效果)。在类别因果关系链中,我们使用因果干预[28],使C-CAM模型以预测类别的真正原因为中心。在解剖-因果链中,解剖约束被整合到一起,使C-CAM关注物体分割的真正原因,这可以很好地解决共现问题。

总之,本文的主要贡献有三个方面。

- 我们提出了用于医疗图像的WSSS的C-CAM。CCAM生成的伪分割掩码具有更清晰的边界和更准确的形状。就我们所知,C-CAM是第一个将因果关系引入医学图像WSSS的方法。

- 我们整合了两个因果关系链来应对医学图像的WSSS挑战。类别因果关系链的设计是为了缓解模糊边界的问题。解剖学因果关系链的设计是为了解决共同发生的问题。

- 我们通过在三个公共医疗图像数据集上进行广泛的实验来证明我们方法的有效性。我们的C-CAM生成的伪掩码在在ProMRI、ACDC和CHAOS数据集上,DSC分别为77.26%、80.34%和78.15%。分割性能在ProMRI上达到83.83%±5.14%,在ACDC上达到87.54%±7.77%,其性能优于最先进的方法。

图2.医学图像WSSS中的因果关系的动机。类别因果关系(第一行):有偏见的类别信息导致模型激活对象的错误类别。解剖类别(第二行):有偏见的形状信息导致模型激活物体的错误形状。热图代表CAM的显著性图。红色表示高值,蓝色表示低值。黄色曲线代表地面实况。

2. 相关工作:

2.1 弱监督的语义分割

在WSSS中主要有四种类型的弱标签被探索,包括图像级标签[2, 18]、点[3]、涂鸦[20, 37]和边界框[10, 17, 26]。特别是,由于图像级别的标签最容易获得,大多数工作是为图像级别的WSSS设计的。我们的工作也专注于图像级的监督。

目前的图像级监督的WSSS方法大多是基于CAM技术[44],它可以通过分类模型定位判别区域。然而,CAM只激活与分类类别高度相关的区域。基于CAM的方法的普通管道可以分为三个阶段。第一阶段是用CAM方法生成种子区域。第二阶段是细化种子区域以生成伪掩码。最后一个阶段是用伪掩码训练分割模型。s.AffinityNet[2]利用种子区域的亲和标签,训练一个亲和模型来完善种子区域。同样,BES[8]以明确的方式预测物体的边界,并使用预测的边界来修改种子区域。D-SRG[13]利用种子区域生长机制来逐步完善种子区域。最近,一些研究人员设计了直接生成更准确的突出性地图的模型。。M-CIS[34]利用跨图像的语义关联性来提高显著性地图的质量。SEAM[39]使用等价正则化来约束CAM的显著性地图,使其在重新缩放时更加一致。Wei等人[40]简单地利用多尺度扩张卷积来产生密集和可靠的显著性地图。然而,这些基于CAM的方法在医学图像上不能很好地工作,因为他们没有考虑医学图像中模糊的边界和共同发生的问题。

2.2 解剖学上的先例

将先验知识纳入图像分割是提高自然图像[12, 27, 42]和医学图像[11, 25, 31]性能的一个有用方法。在FSSS场景中,目前基于CNN的方法没有考虑到输出结构的约束,因为它们通常利用像素损失函数,如交叉熵。而一个好的先验设计可以提供更好的结构约束[27]。在WSSS场景中,先验知识更有价值,可以弥补弱标签所含信息的不足[12]。特别是,医学图像中的先验知识比自然图像有更大的影响,因为医学图像中的物体自然有更多的解剖学信息。解剖信息是固有的,如身体部位和器官的位置,这被称为解剖学先验。Zotti等人[45]利用形状先验来帮助心脏MRI分离。Mirikharaji等人[23]设计了一个用于皮肤病变分割的星形先验。Dalca等人[11]设计了一个用于生物医学分割的生成模型,它集成了丰富的概率解剖学先验。然而,现有的方法需要专门的知识或复杂的模型来利用解剖学先验。相比之下,我们的C-CAM从模型本身提取解剖学信息,并整合了解剖先验与解剖因果链。

2.3 计算机视觉中的因果关系

因果关系最近被广泛用于基于学习的计算机视觉任务中[29, 35, 38, 41, 43]。将因果关系引入机器学习有助于提供更好的学习和可解释的模型,因为传统的CNN模型只考虑关联关系,而不是因果关系。特别是,因果关系在医学成像中发挥着更重要的作用。Castro等人[6]强调了医学图像和其注释之间因果关系的重要性。然而,据我们所知,目前还没有人将因果关系应用于弱监督的医学图像分割的工作。在以往优秀作品的启发下,我们将因果关系引入医学图像的弱监督语义分割中。

3. 方法

3.1 激励

我们观察到,因果关系在医学影像中起着重要作用。医学图像WSSS的因果关系可以通过回答两个问题进行分析。问题1:为什么分类模型的准确性很高,但CAM的激活区域却不准确?问题2:为什么激活区域的形状与物体的地面真实轮廓相差甚远?第一个问题的答案是,分类模型本质上是一个关联模型,它在分类任务中表现良好。然而,它在医学图像分割任务中不起作用。例如,在统计学意义上,一些非前列腺区域可能与前列腺有很高的关联性。这将导致有偏见的类别信息,误导CAM激活与前列腺没有因果关系的错误区域,如图2中所示。第二个问题的答案是,目前基于学习的方法忽略了输出结构的约束,因为它们使用了像素级的损失函数。这一缺陷可以通过丰富的像素级标签来弥补,而这显然不适用于WSSS场景。因此,为了解决上述问题,我们提出了两个用于医学图像的WSSS的因果关系链。类别因果关系链的设计是为了缓解模糊边界的问题。解剖学因果关系链的设计是为了解决共同发生的问题。图3显示了我们的C-CAM网络结构。

3.2 全局取样模块

CAM的显著性对于全局分割任务来说不够准确。然而,它可以提供与医学图像的类别和解剖学高度相关的有价值的信息。因此,我们设计了一个全局采样(GS)模块来利用这些宝贵的信息。在本节中,GS模块被用来提取包含类别和解剖信息的全局背景。GS模块如图4所示。训练图像被直接输入到纯CAM(PCAM)模型中,以生成粗略的伪面具。P-CAM是一个类似CAM的模型,由一个CNN主干、一个分类头、一个映射操作和一个上采样操作组成。映射操作被称为CAM[44]。在训练阶段,只使用CNN主干和分类头。在推断阶段,映射操作和上采样操作被用来生成粗略的伪掩码。

映射操作为每个类别生成突出性地图。这个过程被定义为一个函数fp-cam (·)。GS模块最后输出全局语境图MGC ∈RC×H×W , 可表述为:

其中N表示训练图像的数量,I ∈RH×W×3表示输入图像,Up_Argmax ( ) 表示在argmax之后进行上采样的操作,C表示类别的数量,H、W表示原始图像尺寸的高度和宽度,H′ ,W′表示下采样的尺寸。具体来说,每个输入图像的粗分割掩码Coarsek = UP_Argmax (fpcam (Ik )) 也被保留。

图4.全局采样(GS)模块。GS对所有的训练数据进行采样,并将其送入纯CAM模型(P-CAM)。PCAM为每个训练图像生成粗略的掩码。此外,GS模块输出一个全局背景,并对所有的粗面罩进行总结性操作。

3.3 医学图像WSSS中的因果关系

WSSS的关键任务是生成具有准确类别和形状的伪面具。我们的CCAM从两个因果关系链开始,如图5所示。第一条链是类别因果关系X→Y。它表明图像内容X(因)影响分类的类别Y(果),并受到背景干扰因素C的影响。第二条链是解剖学上的因果关系Z→S,它表明解剖结构Z(原因)会影响到分割的形状S(效果)。因此,伪面具是由类别Y和形状S共同决定的。

图5.医学图像WSSS的因果图。X表示医学图像,Y表示分类类别,C表示上下文混淆器。Z表示解剖结构,S表示分割形状,P表示伪掩码。图5.1

3.4 因果关系模块

在本节中,我们设计了一个因果关系模块,如图6所示,以因果关系的方式提高我们的P-CAM的准确性。如第3.1节所述,因果关系模块是基于两个因果关系链设计的:类别-因果关系链和解剖-因果关系链。

图6.因果关系模块的网络结构。因果关系模块将粗略的分割掩码和全局背景图MGC作为输入。最后,为两个因果关系链分别生成类别因果关系图MGC和解剖因果关系图Ms.粗略掩码的值为[0, 1, ..., C-1],C为类别数。

类别-因果关系链

在类别因果关系中,粗略分割掩码Coarse∈R1×H×W和全局上下文图MGC∈RC×H×W被送入一个重塑层。两个卷积层被用来将Coarse和MGC分别投射到同一空间。然后,通过以下公式计算出一个类别意识的注意向量Acategory∈R1×C

其中Φ和Θ代表两个卷积操作。最后,图像特定的类别因果关系图Mc ∈R1×H`×W` 计算方法如下:

其中Down()是一个下采样操作,使输出MC ,可以与CNN的特征相连接。

解剖学-因果关系链

目标的形状和边界可以被很好地捕捉到,而语义却不能被完全确定,这一点后来被解剖结构信息所解决。特别是对于一些多器官场景,如腹部扫描,CAMcc甚至不能区分左肾和右肾,因为它们总是在图像中共同出现。为此,我们设计了一个解剖学因果关系链来解决这个问题。

在解剖学因果关系链中,一个1/0的指标被用来表示医学图像的解剖学信息。最后,解剖因果关系图Ms被计算为以下公式,以获得每个类别的可能位置。

Ms 被下采样并与CAMcc相乘,得到最终的显著性地图CAMac。最后,伪区段掩码Spseudo被表述为:

生成的伪分割掩码被用来训练一个U-Net[32]模型在以下全面监督阶段。

4. 实验

4.1 数据集

在我们的实验中,使用了三个用于人体器官分离的医学图像数据集。我们对每个数据集只使用了图像级别的弱监督。

ProMRI。这个数据集用于前列腺的分割,它包含172卷T2加权横向MRI。ProMRI是一个混合数据集,由三个子集组成,分别来自PROMISE12[21]、ISBI2013[5]和内部数据[36]。PROMISE12测试集中的30个容积被用于测试。其余142卷用于训练。

ACDC。这是一个用于左心室心内膜分割任务的数据集。ACDC包括100个cine MRI病例,在2017年自动心脏诊断挑战赛(ACDC)上是公开的[4]。这100个案例被随机分为两部分。第一部分包括75个病例,用于训练。第二部分包括25个病例,用于测试。

CHAOS。这是一个公共数据集,来自联合健康腹部器官分割(CHAOS)的挑战[15]。这个数据集包含4个腹部器官,分别是肝脏、左肾、右肾和脾脏。我们选择了T2光谱预饱和反转恢复(SPIR)模式来评估我们的方法。分离任务提供了20个带标签掩码的病例用于训练,20个不带标签掩码的病例用于测试。

4.2实施细节

我们的工作主要是用Python和PyTorch框架实现的。所有的代码都在Ubuntu上运行

16.04.1平台,配备2个NVIDIA GTX 1080Ti GPU。在伪面具生成阶段,我们的P-CAM模型首先用包括负样本在内的所有训练图像进行训练。阴性样本代表不含器官的图像。只有阳性样本被用来训练我们的C-CAM模型。两种模型都通过随机梯度(SGD)计划进行优化,初始学习率不同,P-CAM模型为0.1,C-CAM模型为0.001。U-Net模型被采用来训练一个带有伪分割掩码的分割模型。该模型分割模型由Adam优化器优化,初始学习率为5e-4。我们对每个数据集进行了100次的模型训练。

4.3. C-CAM的消融研究

表1. C-CAM各部分的消融研究。AC:解剖学因果关系。CC:类别因果关系。Aff:亲和力提炼。DSC: Dice相似性系数。

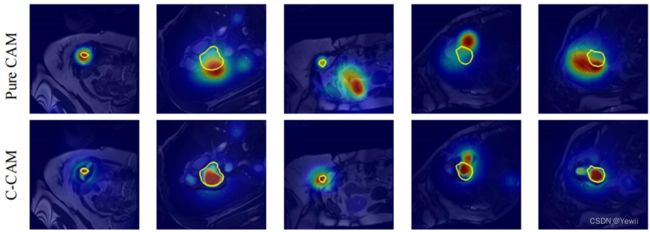

表1给出了我们的方法中每个模块的消融研究。1给出了我们方法中每个模块的消融研究。它显示,与P-CAM(没有任何经过验证的设计)相比,类别因果关系和解剖因果关系都提高了三个数据集上的伪面具的准确性。解剖因果关系在ProMRI上实现了2.43%的提高,在ACDC上实现了1.79%的提高。特别是对于多标签分割任务,如CHAOS,解剖因果关系带来了18.3%的显著性能提升。原因是,如图7所示,CHAOS的共现现象非常严重。传统的CAM模型不能有效地激活图像中没有解剖学信息的正确器官区域。相比之下,我们的C-CAM可以准确区分同一图像中出现的四个不同器官。随着类别因果关系的整合,生成的伪掩码在ProMRI、ACDC和CHAOS数据集上分别取得了4.22%、3.46%和5.41%的DSC模拟系数(DSC[36])的改进。如同在[2]中使用的那样,一个亲和模型被进一步训练以提高最终伪分割掩码的准确性。最后,生成的伪分割掩码在三个数据集上分别达到了77.26%、80.34%和78.15%的DSC。

4.4. 与其他类似CAM的方法比较

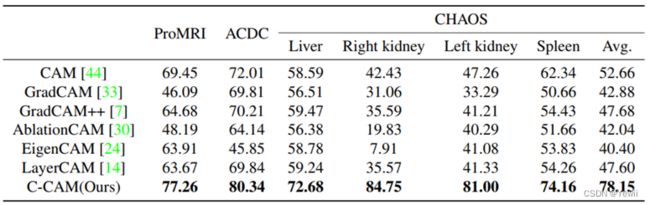

我们的C-CAM与一些类似CAM的计算方法进行了比较,包括Grad-CAM [33], Grad-CAM++ [7], Ablation-CAM [30], Eigen-CAM [24] and Layer-CAM [14]。在实验中,这些不同的类似CAM的方法是用我们的C-CAM中使用的相同的训练过的基线模型进行评估。所有的背景阈值都被测试。所有来自不同方法的伪面具的最佳DSC结果都被呈现出来,而不是比较不同方法的相同阈值。评估结果见表2。从这些结果中,我们发现我们的C-CAM在所有三个医疗图像数据集上实现了最好的伪掩码性能。特别是,我们的C-CAM在CHAOS的所有类别上都表现良好。

表2.用Dice相似性系数(DSC:%)对三个数据集的不同CAM-like定位方法进行评估

4.5. 参数敏感度

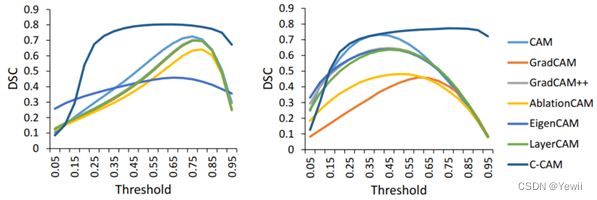

选择一个合适的背景阈值是一个基本但关键的步骤,以从突出度图中生成伪分割掩码。为了评估背景阈值的影响,我们进行了大量的实验。对几种不同的类似CAM的方法进行了比较。在[0.05, 0.95]的范围内,用不同的背景阈值评估了显著性地图的准确性。如图8所示,目前大多数类似CAM的方法对不同的背景阈值是敏感的。首先,对于同一个类似CAM的方法,不同的阈值使突出显示图的DSC有很大的差异。其次,在这些类似CAM的方法中,DSC的最佳阈值是不同的。第三,在不同的数据集上,一个阈值的准确性变化很大。相比之下,我们的C-CAM对背景阈值不太敏感。如图8所示,在背景阈值为0.3到0.9的情况下,C-CAM的显著性地图的DSC可以稳定在高值。一方面,这将使我们更容易选择一个背景阈值。另一方面,它也表明了算法对背景阈值的鲁棒性。

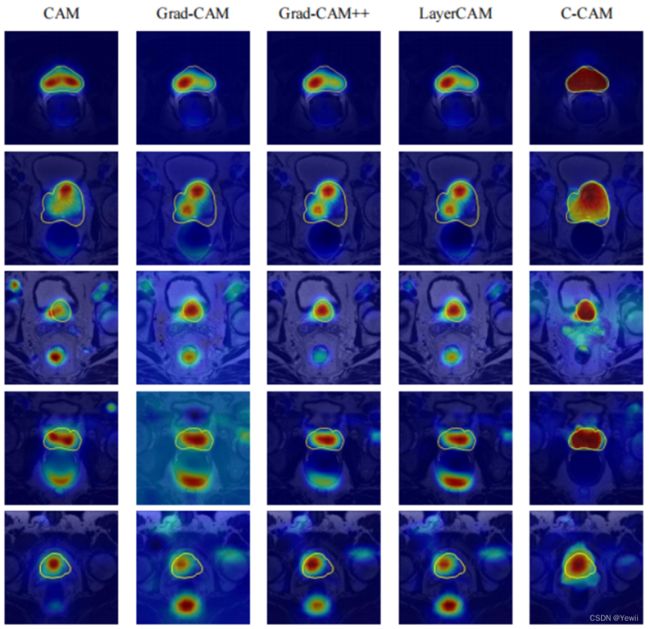

4.6 C-CAM中显著性地图的可视化

图9和图10直观地说明了我们的C-CAM所带来的好处。随着类别因果关系的整合,我们的C-CAM可以很好地解决边界模糊的问题。在ProMRI和ACDC数据集上,C-CAM的显著性地图在前景和背景之间都有清晰的边界。此外,如图9和图10所示,在解剖因果关系的帮助下,共同发生的问题得到了明显的缓解。图7显示了更多的视觉化。最后,C-CAM的显著性图有较少的错误激活区域对应于不相关的背景区域,这进一步证实了C-CAM的优越性。

图8. 不同方法对背景阈值的敏感性说明。线图显示了不同方法在不同背景阈值下对不同数据集(左:ProMRI,右:ACDC)的显著性地图的准确性。

表3. 所提方法与ProMRI上最先进的WSSS方法的比较。比较了全腺和三个子区域的前列腺体积。子区域是根据前列腺的大小来划分的,包括先端、腺中和腺底子区域。三个亚区的前列腺大小:顶点<底点<中点。

图9.来自ProMRI的不同方法的显著性地图的可视化。黄色曲

线代表地面实况。

图10. 带有/不带有类别因果关系和解剖因果关系的ACDC的显著性地图的可视化。黄色曲线代表地面实况。

表4.所提方法与ACDC上最先进的WSSS方法的比较。

4.7. 与其他WSSS方法的比较

为了进一步评估我们提出的C-CAM的有效性,伪分割掩码被用来在完全监督下训练一个U-Net模型。测试数据的最终分割结果与其他一些最先进的WSSS方法进行了比较。由于其他一些方法是为自然图像设计的,这些方法的代码在我们的实验中使用了相同的数据集,以进行公平的比较。表3显示了定量比较。3显示了定量比较的结果。对于整个前列腺,我们的C-CAM得到最高的DSC为83.83%,最低的标准偏差为5.14%。在其他两个指标方面,平均表面距离(ASD)和平均绝对距离(MAD)[36],C-CAM也取得了最佳性能。为了验证在不同物体大小上的性能,明确比较了整个腺体的三个子区域的前列腺体积。这些子区域分别表示为顶点、底部和中部,对象大小递增。对于三个子区域,我们可以看到,我们的方法在腺体中部和基部子区域表现得相当好。对于顶点子区域,我们的方法取得了比SizeLoss [16]略低的性能。原因是SizeLoss使用地面真相来生成弱标签,这就避免了错误定位,特别是对于小尺寸的物体。然而,我们的C-CAM从突出度图中生成伪掩码,而没有地面真相,这可能会对小物体产生较大的定位误差。对ACDC数据集的分割性能也进行了评估。如表4所示,我们的C-CAM在所有三个指标方面都取得了最佳性能。4. 上述实验结果表明,我们的C-CAM明显提高了分割的性能。

5. 结论和未来工作

在本文中,我们提出了一种用于医学图像的因果关系CAM方法。医学图像上的WSSS。基于对医学图像WSSS中因果关系的分析 医学图像WSSS中的因果关系,我们设计了C-CAM,它整合了两个因果链,以生成准确的假象。集成了两个因果链,以生成准确的伪 分割掩码。类别-因果关系链的设计 以缓解模糊边界的问题。解剖因果链的设计是为了解决共同发生的概率问题。C-CAM生成的显著性地图不仅具有 前景和背景之间有明确的界限,而且还与解剖学知识保持一致。在ProMRI、ACDC和CHAOS数据集上,C-CAM的显著性地图优于六种最先进的类似CAM的方法。用我们的伪掩码训练的分割网络U-Net 在ProMRI和ACDC数据集上取得了最先进的性能,这进一步证明了我们的C-CAM的优越性。然而,所提出的C-CAM很难对具有复杂形状的物体进行分离。在未来的工作中,我们有可能将少量强的 有可能将少量的强注释和大量的弱注释结合起来,以提供更多的 准确的类别和解剖学信息。