深度学习第五周 ShuffleNet & EfficientNet

1.Shuffle Net v1

ShuffleNet是Face++的一篇关于降低深度网络计算量的论文,号称是可以在移动设备上运行的深度网络。

首先来看一下,Shuffle Net的性能。在速度上比1.0的Mobile Net要快,而且错误率要更低。

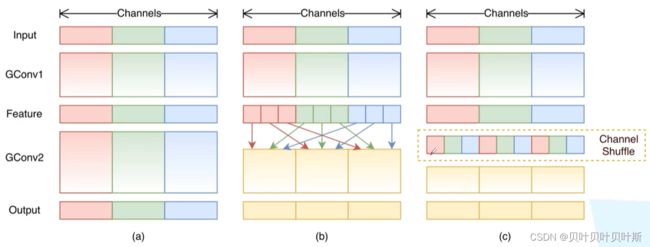

channel shuffle。如下图,普通的组卷积仅仅作用在组内,组间是没有信息交流的(使用组卷积可以减少参数和计算量)。channel shuffle就是解决组织间信息交流的问题,通过将每个组内划分若干个小块,并将各个组织间的小块组合起来,形成新的组合的channel。

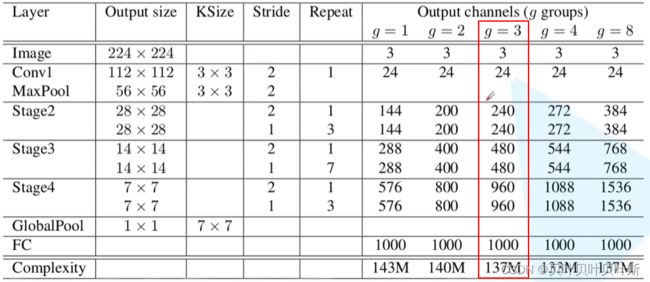

Shuffle Net网络结构,这里只要理解group=3的情况就好,因为论文中大多数是基于group为3的情况写的。

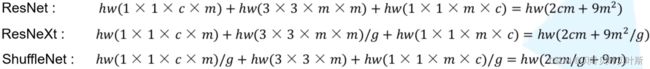

Shuffle Net浮点计算数(FLOPs)与ResNet对比。其中h,w代表特征矩阵的高和宽,c代表channel,m代表 输出矩阵的channel。

2.Shuffle Net v2

提出评价检测的速度不能只关注浮点计算数,还要关注其他的影响因素,比如memory access cost(MAC,内存访问的时间成本)。作者提出设计高效率的模型的四条准则。

G1: 当卷积层的输入特征矩阵与输出特征矩阵的channel相等时MAC最小。(保持FLOPs不变的情况下)

G2: 当分组卷积的分组数增大时,MAC也会增加。(保持FLOPs不变的情况下)

G3: 网络设计的碎片化程度越高,速度越慢。(碎片化程度可以理解为网络的分支化程度)

G4: Element-wise的操作带来的影响也是不可忽略的。(Element-wise包括,激活函数ReLU,Tensor相加,Bias相加等)

3. Efficient Net

在Efficient Net中探讨了输入分辨率,网络深度、宽度的影响。

可以看到Efficient Net B7的参数数量比较少,而且准确率比主流的神经网络的准确度高。

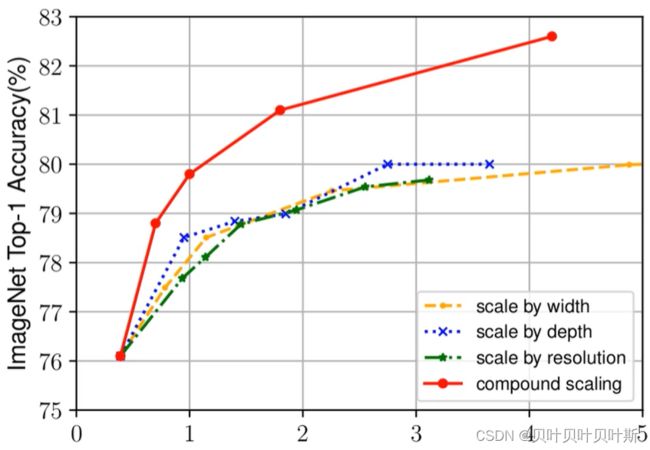

作者在网络的深度、宽度和输入图像的分辨率方面进行试验得出:

- 增加网络深度,能够得到更加丰富、复杂的特征,但网络深度过深会面临梯度消失、训练困难的问题。

- 增加网络的宽度,能够获得更加细粒度的特征,也更加容易训练,但是对于宽度大深度浅的网络难以学习到深层次的特征。

- 增加图像分辨率,能够潜在获得更高细粒度的特征,但是大分辨率的图像会增加计算量。

上图可以得出,当单一改变这三个因素的时候大概到80%的时候就达到了饱和,但是同时改变这三个因素的时候可以获得更好的效果。

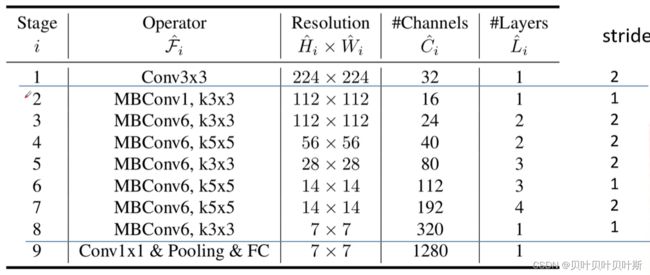

以下是 Efficient Net B0 baseline network的网络结构。其他的网络也是在这个基础上改造的。

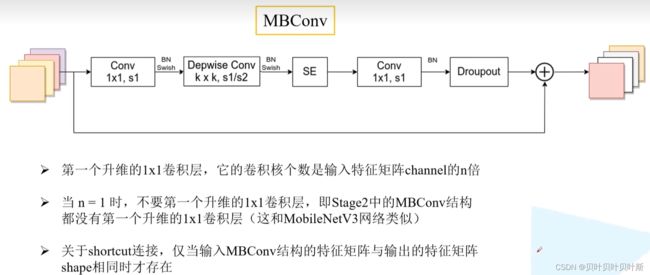

其网络结构中使用的MB卷积层结构如下:

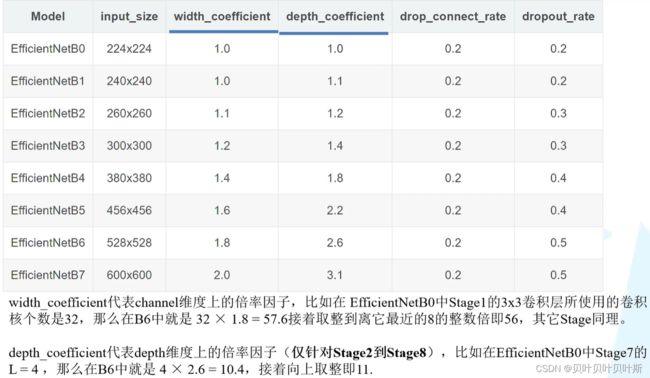

Effient Net的网络设置:

4. Transformer

Transformer是2017年Google在Computation and Language上发表的,当时主要是针对自然语言处理领域提出的。

Self-Attention

![]()

在Self-Attention中最重要的就是利用公式:

Multi-Head Attention

在Multi-Head Attention中将q k v分成n块,n代表head的个数,然后将右上标相同的部分与同号的head归类一起。

最后将分组融合在一起,利用矩阵乘法将分组的数据融合成![]() 。

。

5. 使用VGG模型进行猫狗大战

5.1 加载数据

! wget http://fenggao-image.stor.sinaapp.com/dogscats.zip 是在linux环境下使用

import wget

wget.download("http://fenggao-image.stor.sinaapp.com/dogscats.zip")5.2 数据处理

normalize = transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

vgg_format = transforms.Compose([

transforms.CenterCrop(224),

transforms.ToTensor(),

normalize,

])

data_dir = './dogscats'

dsets = {x: datasets.ImageFolder(os.path.join(data_dir, x), vgg_format)

for x in ['train', 'valid']}

dset_sizes = {x: len(dsets[x]) for x in ['train', 'valid']}

dset_classes = dsets['train'].classes

loader_train = torch.utils.data.DataLoader(dsets['train'], batch_size=64, shuffle=True, num_workers=6)

loader_valid = torch.utils.data.DataLoader(dsets['valid'], batch_size=5, shuffle=False, num_workers=6)5.3 创建VGG网络

wget.download("https://s3.amazonaws.com/deep-learning-models/image-models/imagenet_class_index.json")

model_vgg = models.vgg16(pretrained=True)

with open('./imagenet_class_index.json') as f:

class_dict = json.load(f)

dic_imagenet = [class_dict[str(i)][1] for i in range(len(class_dict))]

inputs_try , labels_try = inputs_try.to(device), labels_try.to(device)

model_vgg = model_vgg.to(device)

outputs_try = model_vgg(inputs_try)本次使用的是迁移学习,但是由于识别的种类不同,需要修稿全连接层的1000类替换2各类。

model_vgg_new = model_vgg;

for param in model_vgg_new.parameters():

param.requires_grad = False

model_vgg_new.classifier._modules['6'] = nn.Linear(4096, 2)

model_vgg_new.classifier._modules['7'] = torch.nn.LogSoftmax(dim = 1)

model_vgg_new = model_vgg_new.to(device)进行模型训练

criterion = nn.NLLLoss()

# 学习率

lr = 0.001

# 随机梯度下降

optimizer_vgg = torch.optim.SGD(model_vgg_new.classifier[6].parameters(),lr = lr)

'''

第二步:训练模型

'''

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

print(device)

def train_model(model,dataloader,size,epochs=1,optimizer=None):

model.train()

for epoch in tqdm(range(epochs)):

running_loss = 0.0

running_corrects = 0

count = 0

for inputs,classes in dataloader:

inputs = inputs.to(device)

classes = classes.to(device)

outputs = model(inputs)

loss = criterion(outputs,classes)

optimizer = optimizer

optimizer.zero_grad()

loss.backward()

optimizer.step()

_,preds = torch.max(outputs.data,1)

# statistics

running_loss += loss.data.item()

running_corrects += torch.sum(preds == classes.data)

count += len(inputs)

# print('Training: No. ', count, ' process ... total: ', size)

epoch_loss = running_loss / size

epoch_acc = running_corrects.data.item() / size

print('Loss: {:.4f} Acc: {:.4f}'.format(

epoch_loss, epoch_acc))

# 模型训练

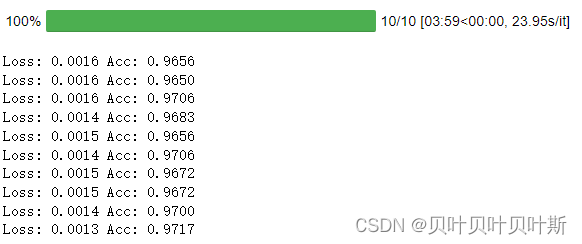

train_model(model_vgg_new,loader_train,size=dset_sizes['train'], epochs=10,

optimizer=optimizer_vgg) 训练结果