动手学习深度学习(总结梳理)——13. 深度卷积神经网络(AlexNet)

目录

1. 模型设计

2. 激活函数

3. 模型

3. 读取数据集

4. 训练AlexNet

AlexNet的背景故事和深度学习的发展

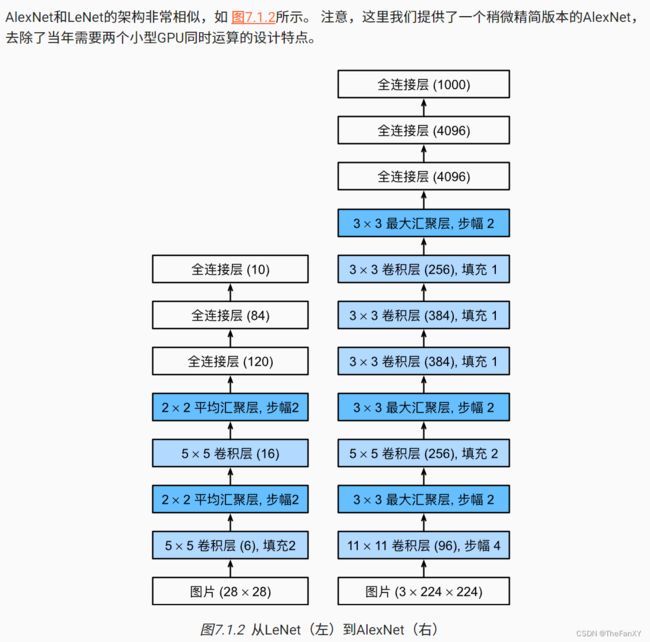

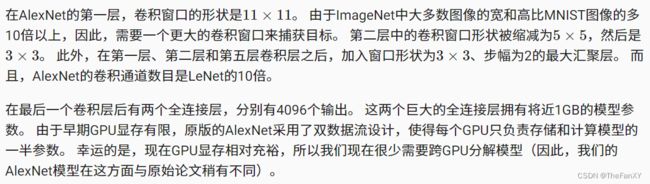

AlexNet和LeNet的设计理念非常相似,但也存在显著差异。 首先,AlexNet比相对较小的LeNet5要深得多。 AlexNet由八层组成:五个卷积层、两个全连接隐藏层和一个全连接输出层。 其次,AlexNet使用ReLU而不是sigmoid作为其激活函数。 下面,让我们深入研究AlexNet的细节。

1. 模型设计

2. 激活函数

此外,AlexNet将sigmoid激活函数改为更简单的ReLU激活函数。 一方面,ReLU激活函数的计算更简单,它不需要如sigmoid激活函数那般复杂的求幂运算。 另一方面,当使用不同的参数初始化方法时,ReLU激活函数使训练模型更加容易。 当sigmoid激活函数的输出非常接近于0或1时,这些区域的梯度几乎为0,因此反向传播无法继续更新一些模型参数。 相反,ReLU激活函数在正区间的梯度总是1。 因此,如果模型参数没有正确初始化,sigmoid函数可能在正区间内得到几乎为0的梯度,从而使模型无法得到有效的训练。

3. 模型

import torch

from torch import nn

from d2l import torch as d2l

net = nn.Sequential(

''' 这里,我们使用一个11*11的更大窗口来捕捉对象 '''

''' 同时,步幅为4,以减少输出的高度和宽度 '''

''' 另外,输出通道的数目远大于LeNet '''

nn.Conv2d(1, 96, kernel_size=11, stride=4, padding=1), nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2),

''' 减小卷积窗口,使用填充为2来使得输入与输出的高和宽一致,且增大输出通道数 '''

nn.Conv2d(96, 256, kernel_size=5, padding=2), nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2),

''' 使用三个连续的卷积层和较小的卷积窗口。 '''

''' 除了最后的卷积层,输出通道的数量进一步增加。 '''

''' 在前两个卷积层之后,汇聚层不用于减少输入的高度和宽度 '''

nn.Conv2d(256, 384, kernel_size=3, padding=1), nn.ReLU(),

nn.Conv2d(384, 384, kernel_size=3, padding=1), nn.ReLU(),

nn.Conv2d(384, 256, kernel_size=3, padding=1), nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2),

nn.Flatten(),

''' 这里,全连接层的输出数量是LeNet中的好几倍。使用dropout层来减轻过拟合 '''

nn.Linear(6400, 4096), nn.ReLU(),

nn.Dropout(p=0.5),

nn.Linear(4096, 4096), nn.ReLU(),

nn.Dropout(p=0.5),

''' 最后是输出层。由于这里使用Fashion-MNIST,所以用类别数为10,而非论文中的1000 '''

nn.Linear(4096, 10))我们构造一个高度和宽度都为224的单通道数据,来观察每一层输出的形状。 它与最开始的图中的AlexNet架构相匹配。

X = torch.randn(1, 1, 224, 224)

for layer in net:

X=layer(X)

print(layer.__class__.__name__,'output shape:\t',X.shape)Conv2d output shape: torch.Size([1, 96, 54, 54])

ReLU output shape: torch.Size([1, 96, 54, 54])

MaxPool2d output shape: torch.Size([1, 96, 26, 26])

Conv2d output shape: torch.Size([1, 256, 26, 26])

ReLU output shape: torch.Size([1, 256, 26, 26])

MaxPool2d output shape: torch.Size([1, 256, 12, 12])

Conv2d output shape: torch.Size([1, 384, 12, 12])

ReLU output shape: torch.Size([1, 384, 12, 12])

Conv2d output shape: torch.Size([1, 384, 12, 12])

ReLU output shape: torch.Size([1, 384, 12, 12])

Conv2d output shape: torch.Size([1, 256, 12, 12])

ReLU output shape: torch.Size([1, 256, 12, 12])

MaxPool2d output shape: torch.Size([1, 256, 5, 5])

Flatten output shape: torch.Size([1, 6400])

Linear output shape: torch.Size([1, 4096])

ReLU output shape: torch.Size([1, 4096])

Dropout output shape: torch.Size([1, 4096])

Linear output shape: torch.Size([1, 4096])

ReLU output shape: torch.Size([1, 4096])

Dropout output shape: torch.Size([1, 4096])

Linear output shape: torch.Size([1, 10])3. 读取数据集

尽管本文中AlexNet是在ImageNet上进行训练的,但我们在这里使用的是Fashion-MNIST数据集。因为即使在现代GPU上,训练ImageNet模型,同时使其收敛可能需要数小时或数天的时间。 将AlexNet直接应用于Fashion-MNIST的一个问题是,Fashion-MNIST图像的分辨率(28×28像素)低于ImageNet图像。 为了解决这个问题,我们将它们增加到224×224(通常来讲这不是一个明智的做法,但我们在这里这样做是为了有效使用AlexNet架构)。 我们使用d2l.load_data_fashion_mnist函数中的resize参数执行此调整。

batch_size = 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)4. 训练AlexNet

现在,我们可以开始训练AlexNet了。与此前的LeNet相比,这里的主要变化是使用更小的学习速率训练,这是因为网络更深更广、图像分辨率更高,训练卷积神经网络就更昂贵

lr, num_epochs = 0.01, 10

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())5. QA

5.1 alexNet让机器去自己寻找特征,这些找到的特征都符合人类的逻辑嘛?如果不符合要怎么解释?

当然不符合,我们设计之初就是为了让模型朝着损失降低的方向走,所以根本没有加入人为的因素进去,自然根本就不会涉及人类逻辑的地方。

5.2 为什么AlexNet最后要有两个相同的全连接层Dense(4096)?一个不行嘛?

我尝试过,这里其实采用两个全连接层效果会更好,两个非常大的全连接层的组合是个非常大的MLP模型了,可能我们之前的卷积层筛选的特征不够好不够深,需要两个全连接层进行模型的复杂化。