SemanticKITTI 数据集(ICCV 2019)

SemanticKITTI 数据集(ICCV 2019)

- 摘要

- 1. 导言

- 2. 相关工作

- 3. SemanticKITTI数据集

-

- 3.1. 标注过程

- 3.2. 数据集统计信息

- 4. 语义分割评价

-

- 4.1. 单扫描实验

- 4.2. 多次扫描实验

- 5. 语义场景补全评估

- 6. 结论与展望

- References

- A、 LiDAR序列的一致标签

- B、 数据集的基础

- C、 类别定义

- D、 基线设置

- E、 使用多次扫描的结果

- F、 语义场景补全

- G、 定性结果

- H、 数据集和基线访问API

声明:此翻译仅为个人学习记录

文章信息

- 标题:SemanticKITTI: A Dataset for Semantic Scene Understanding of LiDAR Sequences (ICCV 2019)

- 作者:Jens Behley∗, Martin Garbade∗, Andres Milioto, Jan Quenzel, Sven Behnke, Cyrill Stachniss, Juergen Gall (∗ 表示同等贡献)

- 文章链接:https://arxiv.org/pdf/1904.01416.pdf

数据集简介

- 数据集官网:http://www.semantic-kitti.org/dataset.html#overview

- 数据集开发工具包:http://www.semantic-kitti.org/resources.html#devkit

(依靠数据集开发工具包,可以了解标签的更多信息,并可以使用 Python 阅读标签,可视化点云)- 官方下载地址:http://www.semantic-kitti.org/dataset.html#overview

- 第三方下载地址:https://gas.graviti.com/dataset/graviti/SemanticKITTI

摘要

语义场景理解对于各种应用都很重要。特别是,自动驾驶汽车需要对其附近的表面和物体进行精细的理解。光探测和测距(LiDAR)提供关于环境的精确几何信息,因此是几乎所有自动驾驶汽车的传感器套件的一部分。尽管语义场景理解与该应用程序相关,但该任务缺乏基于汽车激光雷达的大型数据集。

在本文中,我们引入了一个大数据集来推进基于激光的语义分割研究。我们标注了KITTI Vision Odometry Benchmark的所有序列,并为所使用的汽车激光雷达的完整360°视野提供了密集的逐点标注。我们基于该数据集提出了三个基准任务:(i)使用单个扫描对点云进行语义分割,(ii)使用多个过去扫描进行语义分割和(iii)语义场景补全,这需要预测未来的语义场景。我们提供了基线实验,并表明需要更复杂的模型来有效地处理这些任务。我们的数据集为开发更先进的方法打开了大门,但也为研究新的研究方向提供了丰富的数据。

图1:我们的数据集为KITTI Odometry Benchmark[19]中所有序列的每次扫描提供了密集标注。这里,我们展示了使用SLAM方法估计的姿态信息聚合的多个扫描。

1. 导言

语义场景理解对于许多应用程序是必不可少的,也是自动驾驶汽车不可或缺的一部分。特别是,语义分割提供的细粒度理解对于区分可驾驶和不可驾驶表面以及推理功能特性(如停车区和人行道)是必要的。目前,在所谓的高清晰度地图中表示的这种理解主要是使用测量车辆预先生成的。然而,自动驾驶汽车也应该能够在未绘制地图的区域行驶,并在环境发生变化时调整其行为。

目前大多数自动驾驶汽车使用多个不同的传感器来感知环境。补充传感器模态能够应对特定传感器的缺陷或故障。除了相机,光探测和测距(LiDAR)传感器也经常被使用,因为它们提供不受照明影响的精确距离测量。

公开可用的数据集和基准对研究的实证评估至关重要。它们主要实现三个目的:(i)它们提供了衡量进展的基础,因为它们能够提供可复制和可比较的结果,(ii)它们揭示了现有技术的缺点,从而为新的方法和研究方向铺平了道路,以及(iii)它们使开发方法成为可能,而无需首先费力地收集和标注数据。尽管存在用于基于图像的语义分割的多个大型数据集[10,39],但具有三维点云逐点标注的公共可用数据集仍然相对较小,如表1所示。

表1:具有语义标注的其他点云数据集概述。我们的数据集是迄今为止最大的序列信息数据集。1 训练和测试的扫描次数,2点数以百万计,3 用于计算的类数和括号中标注的类数。

为了弥补这一差距,我们提出了SemanticKITTI,这是一个大型数据集,在28个类的逐点标注中显示了前所未有的细节,适用于各种任务。在本文中,我们主要关注基于激光的语义分割,但也关注语义场景的完成。该数据集与其他激光数据集不同,因为我们提供了序列的精确扫描标注。总体而言,我们标注了KITTI视觉基准[19]的里程计基准的所有22个序列,包括超过43000次扫描。此外,我们标注了完整的水平360°旋转激光传感器的视场。图1显示了所提供数据集的示例场景。总之,我们的主要贡献是:

- 我们提供了一个点云序列的逐点标注数据集,每个扫描都具有前所未有的类别数量和前所未见的详细程度。

- 我们还对点云语义分割的最先进方法进行了评估。

- 我们研究了使用多重扫描进行语义分割的序列信息的使用情况。

- 基于移动汽车序列的标注,我们进一步引入了用于语义场景补全的真实世界数据集,并提供了基线结果。

- 与基准网站一起,点云标注工具也可公开使用,使其他研究人员能够在未来生成其他标注数据集。

这个大数据集将刺激新算法的发展,使研究新的研究方向成为可能,并将这些新算法的评估和比较置于更坚实的基础上。

2. 相关工作

计算机视觉的进步一直是由基准和数据集驱动的[55],但特别大规模的数据集(如ImageNet[13])的可用性甚至是深度学习出现的关键先决条件。

还提出了更多针对自动驾驶汽车的任务特定数据集。值得注意的是KITTI Vision Benchmark[19],因为它表明现成的解决方案并不总是适合自动驾驶。Cityscapes数据集[10]是自动驾驶汽车应用程序的第一个数据集,它提供了大量适合深度学习的像素标注图像。与Cityscapes相比,Mapillary Vistas数据集[39]超过了标注数据的数量和多样性。

此外,在基于点云的解释(例如,语义分割)中,基于RGB-D的数据集实现了巨大的进步。ShapeNet[8]对于显示单个对象的点云尤其值得注意,但此类数据不能直接转移到其他领域。具体而言,由于其较低的角度分辨率,特别是在垂直方向,LiDAR传感器通常不会像RGB-D传感器那样密集地覆盖物体。

对于室内环境,有几个数据集[48、46、24、3、11、35、32、12]可用,这些数据集主要使用RGB-D相机记录或合成生成。然而,与室外环境相比,这些数据显示出非常不同的特征,这也是由环境的大小造成的,因为由于扫描对象的范围,室内捕获的点云往往更密集。此外,传感器在稀疏性和准确性方面具有不同的特性。虽然激光传感器比RGB-D传感器更精确,但与RGB-D相比,它们通常只捕获稀疏的点云。

对于室外环境,最近提出了使用地面激光扫描仪(TLS)记录数据集,如Semantic3d数据集[23],或使用汽车激光雷达记录数据集(如Paris-Lille-3D数据集[47])。然而,Paris-Lille-3D仅为50个类别提供了具有逐点标注的聚集扫描,从中选择了9个类别进行评估。另一个最近用于自动驾驶的大型数据集[57],但种类较少,尚未公开。

Virtual KITTI数据集[17]提供了具有深度信息和密集像素标注的合成生成的序列图像。深度信息也可用于生成点云。然而,这些点云并没有表现出与真实旋转激光雷达相同的特征,包括反射和异常值等缺陷。

与这些数据集相比,我们的数据集结合了大量标注点、大量类别和自动驾驶中常用传感器生成的顺序扫描,这与所有公开可用的数据集不同,如表1所示。

3. SemanticKITTI数据集

我们的数据集基于KITTI Vision Benchmark[19]的里程数据集,该数据集显示了德国卡尔斯鲁厄附近的城市内部交通、居民区以及高速公路场景和乡村道路。原始里程数据集由22个序列组成,将序列00至10作为训练集,将序列11至21作为测试集。为了与原始基准保持一致,我们对训练和测试集采用了相同的划分。此外,我们只为训练数据提供标签,不会干扰原始的里程计基准。总体而言,我们为训练提供了23201次全3D扫描,为测试提供了20351次全三维扫描,这使得它在很大程度上成为公开可用的最大数据集。

我们决定使用KITTI数据集作为我们标注工作的基础,因为它允许我们利用汽车捕获的最大可用原始点云数据集之一。此外,我们预计,我们的标注和现有基准之间也存在潜在的协同作用,这将有助于调查和评估其他研究方向,例如使用语义进行基于激光的里程计估计。

与其他数据集(参见表1)相比,我们为使用常用汽车激光雷达(即Velodyne HDL-64E)生成的连续点云提供了标签。其他公开可用的数据集,如Paris-Lille-3D[47]或Wachtberg[6],也使用此类传感器,但仅分别提供整个采集序列的聚集点云或整个序列的一些单独扫描。由于我们提供了整个序列的单独扫描,我们还可以研究聚合多个连续扫描如何影响语义分割的性能,并使用这些信息来识别移动对象。

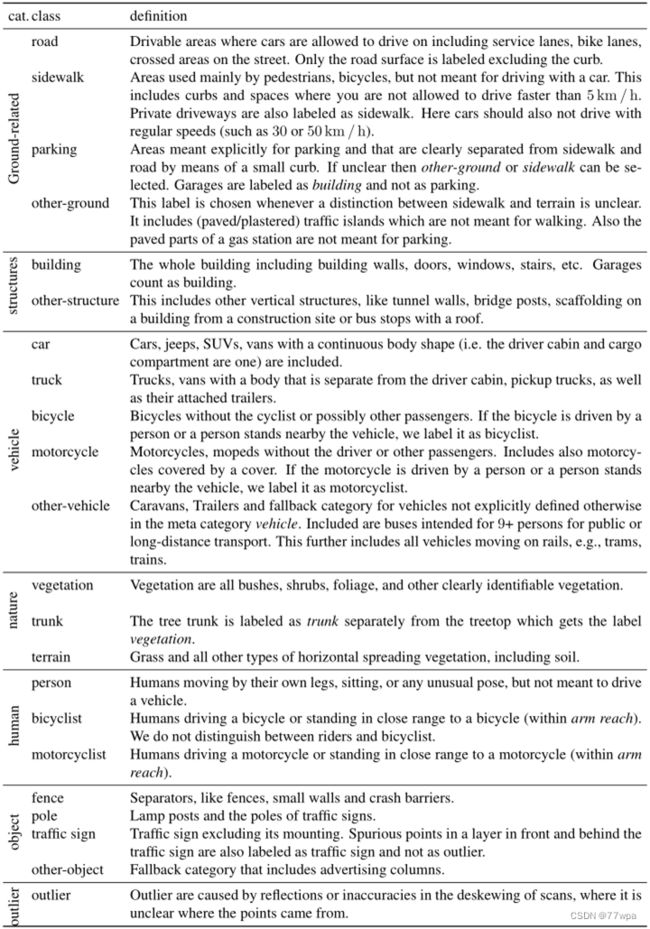

我们标注了28个类,其中我们确保了类与Mapillary Vistas数据集[39]和Cityscapes数据集[10]的大量重叠,并在必要时进行了修改,以说明稀疏性和垂直视野。更具体地说,我们不区分乘坐车辆的人和车辆,而是将车辆和人员标注为骑自行车的人或骑摩托车的人。

我们进一步区分了移动和非移动的车辆和人类,即,如果车辆或人类在观察它们的同时在某些扫描中移动,就会得到相应的移动类,如图2的下部所示。所有标注类都在图3中列出,不同类的更详细讨论和定义可以在补充材料中找到。总之,我们有28个类,其中6个类被指定为移动或非移动属性,其中一个异常值类用于反射或其他影响导致的错误激光测量。

数据集可通过基准网站公开获取,我们只提供带有真值标签的训练集,并在线执行测试集评估。此外,我们还将限制可能的测试集评估数量,以防止过度拟合测试集[55]。

图2:单次扫描(顶部)和带有标签的多次叠加扫描(底部)。图中还显示了一辆在图像中心移动的汽车,产生了一条点迹。

图3:标签分布。将显示每个类的标注点数和类的根类别。对于可移动类,我们还显示了非移动(实心条)和移动对象(阴影条)上的点数。

3.1. 标注过程

为了使点云序列的标注实用,我们将多个扫描重叠在一起,这反过来允许我们一致地标注多个扫描。为此,我们首先使用现成的基于激光的SLAM系统注册并循环闭合序列[5]。需要该步骤,因为惯性导航系统(INS)提供的信息经常导致地图不一致,即,一段时间后重新访问的街道具有不同的高度。对于三个序列,我们必须手动添加循环闭合约束以获得正确的循环闭合轨迹,因为这对于获得用于标注的一致点云至关重要。循环闭合姿势允许我们加载特定位置的所有重叠点云,并将它们一起可视化,如图2所示。

我们将点云序列细分为100米乘100米的区块。对于每个区块,我们只加载与区块重叠的扫描。这使我们能够一致地标注所有扫描,即使当我们遇到时间上遥远的循环关闭时也是如此。为了确保与多个区块重叠的扫描的一致性,我们显示每个区块内的所有点以及与相邻区块重叠的小边界。因此,可以从相邻区块继续标签。

根据最佳实践,我们编写了一份标签说明,并提供了如何为某些物体(如站在墙上的汽车和自行车)贴标签的指导视频。与基于图像的标注相比,使用点云的标注过程更复杂,因为标注者经常需要更改视点。当标注与最复杂的风景相对应的住宅区时,标注者平均每个区块需要4.5小时,而标注公路区块平均需要1.5小时。

我们明确地没有为KITTI数据集使用边界框或其他可用的标注,因为我们希望确保标签一致,并且逐点标签应仅包含对象本身。

我们定期向标注器提供反馈,以提高标签的质量和准确性。尽管如此,一个标注器也在第二遍中验证了标签,即纠正了不一致并添加了缺失的标签。总之,整个数据集包括518个区块,已投入超过1400小时的标注工作,每个区块额外10-60分钟的验证和校正,总共超过1700小时。

3.2. 数据集统计信息

图3显示了不同类的分布,其中我们还将根类别作为x轴上的标签。地面类别、道路、人行道、建筑、植被和地形是最常见的类别。摩托车手这个级别很少出现,但仍有超过10个点云点被标注。

在自然环境中捕获的数据集中,类的数量不平衡是很常见的,因为有些类并不经常出现,所以它们总是表现不足。因此,不平衡的阶级分布是一种方法必须掌握的问题的一部分。总体而言,类之间的分布和相对差异在其他数据集中非常相似,例如Cityscape[10]。

4. 语义分割评价

在本节中,我们将评估几种最先进的单扫描语义分割方法。我们还提供了利用多次扫描序列提供的信息的实验。

4.1. 单扫描实验

任务和指标。在点云的语义分割中,我们希望推断每个三维点的标签。因此,所有评估方法的输入都是三维点的坐标列表及其反射强度,即反射激光束的强度,这取决于被击中表面的性质。然后,每个方法都应该为扫描的每个点输出一个标签,即旋转的LiDAR传感器旋转一整圈。为了评估标注性能,我们依赖于所有类别上常用的平均Jaccard指数或平均交合(mIoU)度量[15],由下式给出:

其中TPc、FPc和FNc对应于类c的真阳性、假阳性和假阴性预测的数量,c是类的数量。

由于其他结构和其他对象的类要么只有几个点,要么太多样化,类内差异很大,因此我们决定不在评估中包含这些类。因此,我们使用25个而不是28个类,在训练和推理过程中忽略了离群值、其他结构和其他对象。

此外,我们不能指望用一次扫描就能区分运动物体和非运动物体,因为这种Velodyne LiDAR无法像利用多普勒效应的雷达那样测量速度。因此,我们将移动类别与相应的非移动类别相结合,总共有19个类别用于训练和评估。

最新技术。点云的语义分割或逐点分类是一个长期存在的话题[2],传统上使用特征提取器(如Spin Images[29])结合传统分类器(如支持向量机[1]甚至语义哈希[4])来解决。许多方法使用条件随机场(CRF)来加强相邻点的标签一致性[56,37,36,38,63]。

随着深度学习方法在基于图像的分类中的出现,整个特征提取和分类流程已经被端到端的深度神经网络所取代。基于体素的方法将点云转换为体素网格,然后将卷积神经网络(CNN)与3D卷积应用于对象分类[34]和语义分割[26],是最早研究的模型之一,因为它们允许利用图像已知的架构和见解。

为了克服基于体素的表示的局限性,例如当体素网格的分辨率增加时内存消耗爆炸,最近的方法要么使用CRF对体素预测[53]进行上采样,要么使用不同的表示,如更有效的空间细分[30、44、64、59、21]、渲染的2D图像视图[7]、图形[31、54]、散点[51]、,或者甚至直接是点[41、40、25、22、43、28、14]。

基线方法。我们为数据集中的点云语义分割提供了六种最先进架构的结果:PointNet [40], PointNet++ [41], Tangent Convolutions [52], SPLATNet [51], Superpoint Graph [31], and SqueezeSeg (V1 and V2) [60, 61]。此外,我们研究了SqueezeSeg的两个扩展:DarkNet21Seg和DarkNet53Seg。

PointNet[40]和PointNet++[41]使用原始无序点云数据作为输入。这些方法的核心是最大池化,以获得一个顺序不变的运算符,该运算符在形状的语义分割和其他几个基准测试中非常有效。然而,由于这种性质,PointNet无法捕捉特征之间的空间关系。为了缓解这一问题,PointNet++[41]将单独的PointNets应用于局部临近区域,并使用分层方法组合其输出。这使它能够构建复杂的分层特性,以捕获局部细粒度和全局上下文信息。

切线卷积[52]还通过直接在曲面上应用卷积神经网络来处理非结构化点云。这是通过假设数据是从光滑表面采样的,并将切线卷积定义为应用于局部表面在每个点到切平面的投影的卷积来实现的。

SPLATNet[51]采用与上述体素化方法类似的方法,并在高维稀疏网格中表示点云。与基于体素的方法一样,这种方法在计算和存储成本方面的缩放都很差,因此它们通过使用双边卷积[27]来利用这种表示的稀疏性,这种卷积仅对占用的晶格部分进行操作。

与PointNet类似,Superpoint Graph[31]通过将几何上均匀的点组汇总为叠加点来捕捉局部关系,这些叠加点随后被局部PointNet嵌入。结果是一个叠加点图形表示,它比原始点云更紧凑和丰富,利用了叠加点之间的上下文关系。

SquezeSeg[60,61]还以一种可以利用旋转LiDAR的传感器几何结构对点云数据应用2D卷积的方式对点云进行离散化。在旋转激光雷达的情况下,通过使用球面投影,可以将单圈的所有点投影到图像上。应用完全卷积神经网络,然后最后用CRF滤波以平滑结果。由于SquezeSeg的良好结果和快速训练,我们研究了模型参数的数量如何影响标注性能。为此,我们使用了基于Darknet架构[42]的不同主干,分别具有21层和53层,以及2500万和5000万个参数。我们还消除了架构中使用的垂直下采样。

我们修改了可用的实现,以便可以在我们的大规模数据集上训练和评估这些方法。注意,迄今为止,大多数这些方法仅在形状[8]或RGB-D室内数据集上进行了评估[48]。然而,由于内存限制,一些方法[40,41]只能在相当大的下采样到50000点的情况下运行。

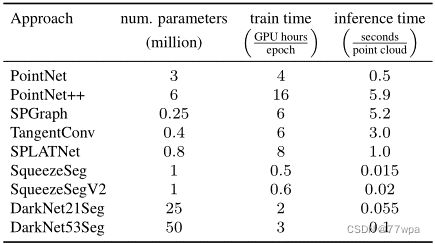

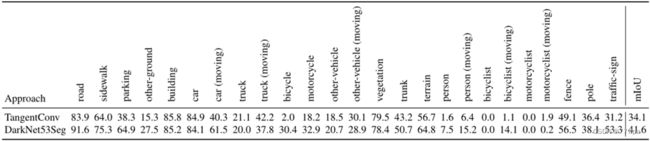

结果和讨论。表2显示了直接使用点云信息[40、41、51、52、31]或点云投影[60]的各种方法的基线实验结果。结果表明,当前点云语义分割的技术水平无法满足数据集的大小和复杂性。

我们认为,这主要是由于所用架构的容量有限(见表7),因为这些方法的参数数量远远低于领先的基于图像的语义分割网络中使用的参数数量。如上所述,我们添加了DarkNet21Seg和DarkNet53Seg来测试这一假设,结果表明,这种简单的修改将精度从SquezeSeg的29.5%提高到了DarkNet 21Seg的47.4%和DarkNet 53Seg的49.9%。

表2:序列11至21(测试集)上所有基线的单次扫描结果(19类)。除了用作验证集的序列08之外,所有方法都在序列00至10上进行了训练。

图4:IoU与传感器的距离。

表3:方法统计。

另一个原因是LiDAR生成的点云相对稀疏,特别是当距离传感器的距离增加时。这在SquezeSeg中得到了部分解决,它利用旋转扫描仪捕获数据的方式来生成密集范围图像,其中每个像素大致对应于扫描中的一个点。

这些影响在图4中进一步分析,其中mIoU与到传感器的距离相关。结果表明,所有方法的结果都会随着距离的增加而变差。这进一步证实了我们的假设,即稀疏性是导致大距离结果更差的主要原因。然而,结果也表明,一些方法,如SPGraph,较少受距离相关稀疏性的影响,这可能是未来研究的一个有希望的方向,以结合两种范式的优势。

尤其是像摩托车手和卡车这样的样本很少的类别,似乎对所有方法都更难。但是,在单个点云中只有少量点的类别,如自行车和杆,也是很难的类别。

最后,具有49.9%mIoU的最佳性能方法(DarkNet53Seg)仍远未达到与基于图像的方法相当的结果,例如,Cityscapes基准的80%[10]。

4.2. 多次扫描实验

任务和指标。在本任务中,我们允许方法利用来自多个过去扫描序列的信息来改进当前扫描的分割。此外,我们希望这些方法能够区分移动类和非移动类,即,必须预测所有25个类,因为这些信息应该在多次过去扫描的时间信息中可见。该任务的评估度量仍然与单次扫描情况相同,即,无论使用多少次过去的扫描来计算结果,我们都评估当前扫描的平均IoU。

基线。我们通过将5次扫描组合成单个大点云来利用顺序信息,即,时间戳t处的当前扫描和时间戳t之前的4次扫描t-1,…,t-4。我们评估了DarkNet53Seg和TangentConv,因为这些方法可以处理大量的点,而无需对点云进行下采样,并且仍然可以在合理的时间内进行训练。

结果和讨论。表4显示了可移动类的每类结果以及所有类的平均IoU(mIoU)。对于每种方法,我们在行的上部显示非移动(无阴影)的IoU,在行的下部显示移动对象的IoU(阴影)。其余静态类的性能类似于单次扫描结果,我们参考了包含所有类的表的补充。

表4:使用多次过去扫描序列的IoU结果(%)。阴影单元格对应于移动类的IoU,而非阴影条目则是非移动类。

投影方法比基于点的方法表现更好的总体趋势仍然很明显,这也可以归因于在单扫描情况下更大量的参数。这两种方法都显示了分离移动和非移动对象的困难,这可能是由于我们的设计决定将多个扫描聚集到单个大型点云中所致。结果表明,尤其是骑自行车和骑摩托车的人永远不会被正确地分配到非移动类,这很可能是由于物体点云通常更稀疏的结果。

我们预计,新的方法可以通过使用架构的多个输入流甚至递归神经网络来解释时间信息,从而明确地利用顺序信息,这可能再次开辟一条新的研究路线。

5. 语义场景补全评估

在利用一系列过去的扫描进行语义点云分割之后,我们现在展示了一个利用未来扫描的场景。由于其连续性,我们的数据集为3D语义场景补全任务提供了独特的扩展机会。请注意,这是该任务的第一个真实室外基准。现有的点云数据集不能用于解决这一任务,因为它们不允许聚集在空间和时间上都足够密集的标记点云。

在语义场景补全中,一个基本问题是获取真实世界数据集的真值标签。在NYUv2[48]的情况下,使用Kinect传感器捕获的RGB-D图像将CAD模型拟合到场景[45]中。新方法通常会在更大但合成的SUNCG数据集上证明其有效性[49]。然而,结合了非合成数据集的规模和真实世界数据的使用的数据集仍然缺失。

在我们提出的数据集中,搭载LiDAR的汽车经过场景中的3D对象,从而记录它们的背面,这些背面由于自遮挡而隐藏在初始扫描中。这正是语义场景补全所需的信息,因为它包含所有对象的完整3D几何体,而它们的语义由我们的密集标注提供。

数据集生成。通过在汽车前面的预定义区域叠加大量未来激光扫描,我们可以生成与语义场景补全任务相对应的输入和目标对。正如Song等人提出的[49],我们的场景补全任务数据集是3D场景的体素化表示。

我们选择了汽车前方51.2米、每边25.6米、高度6.4米的体积,体素分辨率为0.2米,因此预测的体积为256×256×32体素。我们基于对体素内所有标记点的多数投票,为每个体素分配单个标签。不包含任何点的体素标记为空。

为了计算哪些体素属于被遮挡空间,我们通过跟踪光线来检查汽车的每个姿势,哪些体素对传感器可见。一些体素(例如,物体内部或墙后的体素)永远不可见,因此我们在训练和评估期间忽略它们。

总体而言,我们提取了19130对输入和目标体素网格用于训练,815对用于验证,3992对用于测试。对于测试集,我们只提供未标记的输入体素网格并保留目标体素网格。图5显示了输入和目标对的示例。

任务和指标。在语义场景补全中,我们感兴趣的是从单个初始扫描预测特定体积内的完整场景。更具体地说,我们使用体素网格作为输入,其中每个体素被标记为空或被占用,这取决于它是否包含激光测量。对于语义场景补全,需要预测体素是否被占用以及其在补全的场景中的语义标签。

对于评估,我们遵循Song等人的评估协议[49],并计算场景补全任务的IoU,其仅将体素分类为被占用或空,即忽略语义标签,以及mIoU(1)用于单扫描语义分割任务的相同19个类的语义场景补全任务(见第4节)。

最新技术。早期的方法解决了场景补全的任务,要么不预测语义[16],从而无法提供对场景的整体理解,要么尝试将固定数量的网格模型与场景几何体相匹配[20],这限制了该方法的表现力。

Song等人[49]是第一个以端到端方式解决语义场景补全任务的人。他们的工作引发了对结合颜色和深度信息的使用[33,18]或通过引入子流形卷积解决稀疏3D特征图问题[65]或通过部署多级粗到细训练方案提高输出分辨率[12]的领域产生模型的大量兴趣。其他工作尝试了新的编码器-解码器CNN架构,并通过添加对抗性损失组件来改善损失项[58]。

图5:左图:语义场景补全基准的不完整输入的可视化。注意,我们显示标签只是为了更好地可视化,但实际输入是没有任何标签的单个原始体素网格。右:对应的目标输出,表示已补全且完全标记的3D场景。

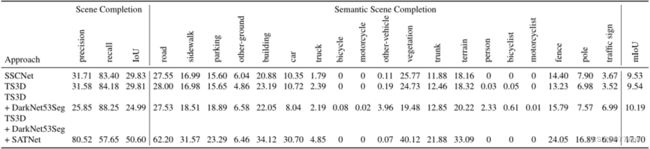

表5:语义场景补全基线。

基线方法。我们报告了四种语义场景补全方法的结果。在第一种方法中,我们应用SSCNet[49],而不使用翻转TSDF作为输入特征。这对性能的影响最小,但由于预处理速度更快,大大加快了训练时间[18]。然后,我们使用双流(TS3D)方法[18],该方法利用来自与输入激光扫描相对应的RGB图像的附加信息。因此,RGB图像首先由2D语义分割网络处理,使用在Cityscapes上训练的方法DeepLab v2(ResNet-101)[9]来生成语义分割。来自单个激光扫描的深度信息和从RGB图像推断的标签在早期融合中被组合。此外,我们分两个步骤修改了TS3D方法:首先,通过直接使用基于LiDAR的最佳语义分割方法(DarkNet53Seg)中的标签,其次,通过SATNet交换3D-CNN主干[33]。

结果和讨论。表5显示了每个基线的结果,而补充中报告了各个类别的结果。TS3D网络结合了RGB图像的2D语义分割,其性能类似于仅使用深度信息的SSCNet。然而,直接在点云上工作的最佳语义分割的使用在语义场景补全方面稍微优于SSCNet(TS3D+DarkNet53Seg)。注意,前三种方法基于SSCNet的3D-CNN架构,该架构在前向通道中执行4倍下采样,因此无法处理场景细节。在我们的最后一种方法中,我们将TS3D+DarkNet53Seg的SSCNet主干与SATNet交换[33],SATNet能够处理所需的输出分辨率。由于内存的限制,我们在训练中使用随机裁剪。在推理过程中,我们将每个卷分成六个相等的部分,分别对它们进行场景补全,然后将它们融合。这种方法比基于SSCNet的方法性能要好得多。

除了处理目标分辨率外,当前模型的一个挑战是远场中激光输入信号的稀疏性,如图5所示。为了在远场中获得更高分辨率的输入信号,方法必须更有效地利用与每次激光扫描一起提供的高分辨率RGB图像中的信息。

6. 结论与展望

在这项工作中,我们展示了一个大规模数据集,显示了点云序列的逐点标注的空前规模。我们为三项任务提供了一系列不同的基线实验:(i)使用单个扫描的语义分割,(ii)使用多个扫描的语义分割,以及(iii)语义场景补全。

在未来的工作中,我们还计划在整个序列上提供实例级标注,即,我们希望在扫描中区分不同的对象,但也要随着时间的推移识别相同的对象。这将能够研究序列上的时间实例分割。然而,我们也看到了基于我们标注工作的其他新任务的潜力,例如语义SLAM的评估。

致谢 我们感谢所有帮助注释数据的学生。The work has been funded by the Deutsche Forschungsgemeinschaft (DFG, German Research Foundation) under FOR 1505 Mapping on Demand, BE 5996/1-1, GA 1927/2-2, and under Germanys Excellence Strategy, EXC2070 – 390732324 (PhenoRob).

References

[1] Anuraag Agrawal, Atsushi Nakazawa, and Haruo Takemura. MMM-classification of 3D Range Data. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2009. 5

[2] Dragomir Anguelov, Ben Taskar, Vassil Chatalbashev, Daphne Koller, Dinkar Gupta, Geremy Heitz, and Andrew Ng. Discriminative Learning of Markov Random Fields for Segmentation of 3D Scan Data. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), pages 169–176, 2005. 5

[3] Iro Armeni, Alexander Sax, Amir R. Zamir, and Silvio Savarese. Joint 2D-3D-Semantic Data for Indoor Scene Understanding. arXiv preprint, 2017. 2

[4] Jens Behley, Kristian Kersting, Dirk Schulz, Volker Steinhage, and Armin B. Cremers. Learning to Hash Logistic Regression for Fast 3D Scan Point Classification. In Proc. of the IEEE/RSJ Intl. Conf. on Intelligent Robots and Systems (IROS), pages 5960–5965, 2010. 5

[5] Jens Behley and Cyrill Stachniss. Efficient Surfel-Based SLAM using 3D Laser Range Data in Urban Environments. In Proc. of Robotics: Science and Systems (RSS), 2018. 3

[6] Jens Behley, Volker Steinhage, and Armin B. Cremers. Performance of Histogram Descriptors for the Classification of 3D Laser Range Data in Urban Environments. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2012. 2,3

[7] Alexandre Boulch, Joris Guerry, Bertrand Le Saux, and Nicolas Audebert. SnapNet: 3D point cloud semantic labeling with 2D deep segmentation networks. Computers & Graphics, 2017. 5

[8] Angel X. Chang, Thomas Funkhouser, Leonidas J. Guibas, Pat Hanrahan, Qixing Huang, Zimo Li, Silvio Savarese, Manolis Savva, Shuran Song, Hao Su, Jianxiong Xiao, Li Yi, and Fisher Yu. ShapeNet: An Information-Rich 3D Model Repository. Technical Report arXiv:1512.03012 [cs.GR], Stanford University and Princeton University and Toyota Technological Institute at Chicago, 2015. 2, 5

[9] Liang-Chieh Chen, George Papandreou, Iasonas Kokkinos, Kevin Murphy, and Alan L. Yuille. DeepLab: Semantic Image Segmentation withDeep Convolutional Nets, Atrous Convolution,and Fully Connected CRFs. IEEE Transactions on Pattern Analysis and Machine Intelligence (PAMI), 40(4):834–848, 2018. 8, 14

[10] Marius Cordts, Mohamed Omran, Sebastian Ramos, Timo Rehfeld, Markus Enzweiler, Rodrigo Benenson, Uwe Franke, Stefan Roth, and Bernt Schiele. The Cityscapes Dataset for Semantic Urban Scene Understanding. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2016. 2, 3, 4, 6, 12, 14

[11] Angela Dai, Angel X. Chang, Manolis Savva, Maciej Halber, Thomas Funkhouser, and Matthias Nießner. ScanNet: Richly-annotated 3D Reconstructions of Indoor Scenes. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2009. 2

[12] Angela Dai, Daniel Ritchie, Martin Bokeloh, Scott Reed, Jürgen Sturm, and Matthias Nießner. ScanComplete: Large-Scale Scene Completion and Semantic Segmentation for 3D Scans. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 2, 8

[13] Jia Deng, Wei Dong, Richard Socher, Li-Jia Li, Kai Li, and Li Fei-Fei. ImageNet: A Large-Scale Hierarchical Image Database. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2009. 2

[14] Francis Engelmann, Theodora Kontogianni, Jonas Schult, and Bastian Leibe. Know What Your Neighbors Do: 3D Semantic Segmentation of Point Clouds. arXiv preprint, 2018.5

[15] Mark Everingham, S.M. Ali Eslami, Luc van Gool, Christopher K.I. Williams, John Winn, and Andrew Zisserman. The Pascal Visual Object Classes Challenge a Retrospective. International Journal on Computer Vision (IJCV), 111(1):98–136, 2015. 4

[16] Michael Firman, Oisin Mac Aodha, Simon Julier, and Gabriel J. Brostow. Structured Prediction of Unobserved Voxels From a Single Depth Image. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), pages 5431–5440, 2016. 7

[17] Adrien Gaidon, Qiao Wang, Yohann Cabon, and Eleonora Vig. Virtual Worlds as Proxy for Multi-Object Tracking Analysis. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2016. 3

[18] Martin Garbade, Yueh-Tung Chen, J. Sawatzky, and Juergen Gall. Two Stream 3D Semantic Scene Completion. In Proc. of the IEEE/CVF Conf. on Computer Vision and Pattern Recognition (CVPR) Workshops, 2019. 7, 8

[19] Andreas Geiger, Philip Lenz, and Raquel Urtasun. Are we ready for Autonomous Driving? The KITTI Vision Benchmark Suite. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), pages 3354–3361, 2012.1, 2, 3, 12

[20] Andres Geiger and Chaohui Wang. Joint 3d Object and Layout Inference from a single RGB-D Image. In Proc. of the German Conf. on Pattern Recognition (GCPR), pages 183–195, 2015. 7

[21] Benjamin Graham, Martin Engelcke, and Laurens van der Maaten. 3D Semantic Segmentation with Submanifold Sparse Convolutional Networks. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 5

[22] Fabian Groh, Patrick Wieschollek, and Hendrik Lensch. Flex-Convolution (Million-Scale Pointcloud Learning Beyond Grid-Worlds). In Proc. of the Asian Conf. on Computer Vision (ACCV), Dezember 2018. 5

[23] Timo Hackel, Nikolay Savinov, Lubor Ladicky, Jan D.

Wegner, Konrad Schindler, and Marc Pollefeys. SEMAN-

TIC3D.NET: A new large-scale point cloud classification benchmark. In ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, volume IV1-W1, pages 91–98, 2017. 2

[24] Binh-Son Hua, Quang-Hieu Pham, Duc Thanh Nguyen, Minh-Khoi Tran, Lap-Fai Yu, and Sai-Kit Yeung. SceneNN: A Scene Meshes Dataset with aNNotations. In Proc. of the Intl. Conf. on 3D Vision (3DV), 2016. 2

[25] Binh-Son Hua, Minh-Khoi Tran, and Sai-Kit Yeung. Point-wise Convolutional Neural Networks. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 5

[26] Jing Huang and Suya You. Point Cloud Labeling using 3D Convolutional Neural Network. In Proc. of the Intl. Conf. on Pattern Recognition (ICPR), 2016. 5

[27] Varun Jampani, Martin Kiefel, and Peter V. Gehler. Learning Sparse High Dimensional Filters: Image Filtering, Dense CRFs and Bilateral Neural Networks. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2016. 5

[28] Mingyang Jiang, Yiran Wu, and Cewu Lu. PointSIFT: A SIFT-like Network Module for 3D Point Cloud Semantic Segmentation. arXiv preprint, 2018. 5

[29] Andrew E. Johnson and Martial Hebert. Using spin images for effcient object recognition in cluttered 3D scenes. Trans. on Pattern Analysis and Machine Intelligence (TPAMI), 21(5):433–449, 1999. 5

[30] Roman Klukov and Victor Lempitsky. Escape from Cells: Deep Kd-Networks for the Recognition of 3D Point Cloud Models. In Proc. of the IEEE Intl. Conf. on Computer Vision (ICCV), 2017. 5

[31] Loic Landrieu and Martin Simonovsky. Large-scale Point Cloud Semantic Segmentation with Superpoint Graphs. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 5, 6, 15

[32] Wenbin Li, Sajad Saeedi, John McCormac, Ronald Clark, Dimos Tzoumanikas, Qing Ye, Yuzhong Huang, Rui Tang, and Stefan Leutenegger. InteriorNet: Mega-scale Multi-sensor Photo-realistic Indoor Scenes Dataset. In Proc. of the British Machine Vision Conference (BMVC), 2018. 2

[33] Shice Liu, Yu Hu, Yiming Zeng, Qiankun Tang, Beibei Jin, Yainhe Han, and Xiaowei Li. See and Think: Disentangling Semantic Scene Completion. In Proc. of the Conf. on Neural Information Processing Systems (NeurIPS), pages 261–272, 2018. 7, 8

[34] Daniel Maturana and Sebastian Scherer. VoxNet: A 3D Convolutional Neural Network for Real-Time Object Recognition. In Proc. of the IEEE/RSJ Intl. Conf. on Intelligent Robots and Systems (IROS), 2015. 5

[35] John McCormac, Ankur Handa, Stefan Leutenegger, and Andrew J. Davison. SceneNet RGB-D: Can 5M Synthetic Images Beat Generic ImageNet Pre-training on Indoor Segmentation? In Proc. of the IEEE Intl. Conf. on Computer Vision (ICCV), 2017. 2

[36] Daniel Munoz, J. Andrew Bagnell, Nicolas Vandapel, and Martial Hebert. Contextual Classification with Functional Max-Margin Markov Networks. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2009. 2, 5

[37] Daniel Munoz, Nicholas Vandapel, and Marial Hebert. Directional Associative Markov Network for 3-D Point Cloud Classification. In Proc. of the International Symposium on 3D Data Processing, Visualization and Transmission (3DPVT), pages 63–70, 2008. 5

[38] Daniel Munoz, Nicholas Vandapel, and Martial Hebert. Onboard Contextual Classification of 3-D Point Clouds with Learned High-order Markov Random Fields. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2009. 5

[39] Gerhard Neuhold, Tobias Ollmann, Samuel Rota Bulo, and Peter Kontschieder. The Mapillary Vistas Dataset for Semantic Understanding of Street Scenes. In Proc. of the IEEE Intl. Conf. on Computer Vision (ICCV), 2017. 2, 3, 12

[40] Charles R. Qi, Hao Su, Kaichun Mo, and Leonidas J. Guibas. PointNet: Deep Learning on Point Sets for 3D Classification and Segmentation. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2017. 5, 6, 14, 15

[41] Charles R. Qi, Li Yi, Hao Su, and Leonidas J. Guibas. PointNet++: Deep Hierarchical Feature Learning on Point Sets in a Metric Space. In Proc. of the Conf. on Neural Information Processing Systems (NeurIPS), 2017. 5, 6, 14, 15

[42] Joseph Redmon and Ali Farhadi. YOLOv3: An Incremental Improvement. arXiv preprint, 2018. 5

[43] Dario Rethage, Johanna Wald, Jürgen Sturm, Nassir Navab, and Frederico Tombari. Fully-Convolutional Point Networks for Large-Scale Point Clouds. Proc. of the European Conf. on Computer Vision (ECCV), 2018. 5

[44] Gernot Riegler, Ali Osman Ulusoy, and Andreas Geiger. OctNet: Learning Deep 3D Representations at High Resolutions. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2017. 5

[45] Jason Rock, Tanmay Gupta, Justin Thorsen, JunYoung Gwak, Daeyun Shin, and Derek Hoiem. Completing 3D Object Shape from One Depth Image. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2015. 7

[46] German Ros, Laura Sellart, Joanna Materzynska, David Vazquez, and Antonio Lopez. The SYNTHIA Dataset: A Large Collection of Synthetic Images for Semantic Segmentation of Urban Scenes. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), June 2016. 2

[47] Xavier Roynard, Jean-Emmanuel Deschaud, and Francois Goulette. Paris-Lille-3D: A large and high-quality ground-truth urban point cloud dataset for automatic segmentation and classification. Intl. Journal of Robotics Research (IJRR), 37(6):545–557, 2018. 2, 3

[48] Nathan Silberman, Derek Hoiem, Pushmeet Kohli, and Rob Fergus. Indoor Segmentation and Support Inference from RGBD Images. In Proc. of the European Conf. on Computer Vision (ECCV), 2012. 2, 5, 7

[49] Shuran Song, Fisher Yu, Andy Zeng, Angel X. Chang, Manolis Savva, and Thomas Funkhouser. Semantic Scene Completion from a Single Depth Image. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2017. 7, 8

[50] Bastian Steder, Giorgio Grisetti, and Wolfram Burgard. Robust Place Recognition for 3D Range Data based on Point Features. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2010. 2

[51] Hang Su, Varun Jampani, Deqing Sun, Subhransu Maji, Evangelos Kalogerakis, Ming-Hsuan Yang, and Jan Kautz. SPLATNet: Sparse Lattice Networks for Point Cloud Processing. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 5, 6, 14, 15

[52] Maxim Tatarchenko, Jaesik Park, Vladen Koltun, and Qian-Yi Zhou. Tangent Convolutions for Dense Prediction in 3D. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 5, 6, 7, 15

[53] Lyne P. Tchapmi, Christopher B. Choy, Iro Armeni, Jun Young Gwak, and Silvio Savarese. SEGCloud: Semantic Segmentation of 3D Point Clouds. In Proc. of the Intl. Conf. on 3D Vision (3DV), 2017. 5

[54] Gusi Te, Wei Hu, Zongming Guo, and Amin Zheng. RGCNN: Regularized Graph CNN for Point Cloud Segmentation. arXiv preprint, 2018. 5

[55] Antonio Torralba and Alexei A. Efros. Unbiased Look at Dataset Bias. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2011. 2, 3

[56] Rudolph Triebel, Krisitian Kersting, and Wolfram Burgard. Robust 3D Scan Point Classification using Associative Markov Networks. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), pages 2603–2608, 2006. 5

[57] Shenlong Wang, Simon Suo, Wei-Chiu Ma, Andrei Pokrovsky, and Raquel Urtasun. Deep Parametric Continuous Convolutional Neural Networks. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2018. 3

[58] Yida Wang, Davod Tan Joseph, Nassir Navab, and Frederico Tombari. Adversarial Semantic Scene Completion from a Single Depth Image. In Proc. of the Intl. Conf. on 3D Vision (3DV), pages 426–434, 2018. 8

[59] Zongji Wang and Feng Lu. VoxSegNet: Volumetric CNNs for Semantic Part Segmentation of 3D Shapes. arXiv preprint, 2018. 5

[60] Bichen Wu, Alvin Wan, Xiangyu Yue, and Kurt Keutzer. SqueezeSeg: Convolutional Neural Nets with Recurrent CRF for Real-Time Road-Object Segmentation from 3D LiDAR Point Cloud. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2018. 5, 6, 14, 15

[61] Bichen Wu, Xuanyu Zhou, Sicheng Zhao, Xiangyu Yue, and Kurt Keutzer. SqueezeSegV2: Improved Model Structure and Unsupervised Domain Adaptation for Road-Object Segmentation from a LiDAR Point Cloud. Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2019. 5, 6

[62] Jun Xie, Martin Kiefel, Ming-Ting Sun, and Andreas Geiger. Semantic Instance Annotation of Street Scenes by 3D to 2D Label Transfer. In Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition (CVPR), 2016. 11

[63] Xuehan Xiong, Daniel Munoz, J. Andrew Bagnell, and Martial Hebert. 3-D Scene Analysis via Sequenced Predictions over Points and Regions. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), pages 2609–2616, 2011. 5

[64] Wei Zeng and Theo Gevers. 3DContextNet: K-d Tree Guided Hierarchical Learning of Point Clouds Using Local and Global Contextual Cues. arXiv preprint, 2017. 5

[65] Jiahui Zhang, Hao Zhao, Anbang Yao, Yurong Chen, Li Zhang, and Hongen Liao. Efficient Semantic Scene Completion Network with Spatial Group Convolution. In Proc. of theEuropean Conf.on Computer Vision(ECCV),pages 733–749, 2018. 8

[66] Richard Zhang, Stefan A. Candra, Kai Vetter, and Avideh Zakhor. Sensor Fusion for Semantic Segmentation of Urban Scenes. In Proc. of the IEEE Intl. Conf. on Robotics & Automation (ICRA), 2015. 2

图6:点云标注工具。在左上角,用户看到由红色轨迹指示的区块和传感器的路径。

A、 LiDAR序列的一致标签

在本节中,我们将更详细地解释点云标注工具的实现,以及我们决定在空间上(而不是时间上)细分序列以获得一致标注的点云序列背后的原理。标注工具本身对于提供这种细粒度标签的扫描量至关重要。

总之,我们开发了一个基于OpenGL的标注工具,它利用GPU上的并行化。主要的挑战是大量点数据的可视化,同时还要处理这些数据,同时实现响应性,从而允许注释者以交互方式标注聚集的点云。图6显示了我们的点云注释程序,它可视化了超过2000万个点的聚合点云。我们提供了一系列用于注释的工具,如画笔、多边形工具,以及用于隐藏选定标签的不同过滤方法。即使有这么多点,我们仍然能够保持交互式标注功能。对聚集点云内的点的标注的更改反映在单独的扫描中,这使得标注随着时间的推移具有高度一致性。

由于我们对每个点进行了标注,因此我们能够对对象进行注释,即使是复杂的遮挡,也比仅使用边界体积更精确[62]。例如,我们确保汽车下方的地面点被相应地标注,这是通过注释工具的过滤功能实现的。

为了加速搜索必须标注的点,我们使用了投影方法来分配标签。为此,我们为每个点确定屏幕上的二维投影,然后确定该点是否靠近单击的位置(在笔刷的情况下)或在选定多边形内。因此,注释者必须确保他们没有选择实质上破坏先前分配的点的视图。

通常,注释者执行以下循环来注释点:(1)使用特定标签标记点,(2)使用该标签过滤点。由于已经标注的点的过滤,可以解决遮挡,并且进一步确保上述投影标注不会破坏已经标注的点。

基于区块的标注。一个重要的细节是前面提到的将完整的聚集点云空间细分为小块(也显示在图6的左上部分)。最初,我们只是在一个时间戳范围内渲染所有扫描,例如100-150,然后移动到下一部分,例如150-200。然而,这很快导致标签不一致,因为这些部分的扫描仍然重叠,因此必须重新标注以匹配之前的标签。此外,由于我们遇到具有相当时间距离的循环闭包,这种重叠甚至可能发生在时间上不接近的序列部分之间,这使得任务更加复杂。

因此,很明显,这样一种额外的努力来确保一致的标签将导致不合理的复杂标注过程,从而导致不充分的结果。因此,我们决定将序列在空间上细分为区块,其中每个块包含与该块重叠的扫描中的所有点。区块之间的边界一致性是通过区块之间的小重叠实现的,这使得标签能够从一个区块持续到另一个相邻区块。

移动对象。我们注释了所有移动对象,即汽车、卡车、人、自行车手和摩托车手,每个移动对象由不同的类表示,以将其与对应的非移动类区分开来。在我们的例子中,当一个物体在某个时间点移动时,我们给它分配了相应的移动类,同时用传感器观察它。

由于在聚集从不同传感器位置捕获的扫描时,移动对象将出现在不同的位置,因此我们必须特别注意注释移动对象。当多种类型的车辆在同一车道上行驶时,这尤其具有挑战性,就像大多数遇到的高速公路场景一样。我们通过过滤地面点或单独标注每个扫描注释移动物体,这通常是标注汽车和自行车轮胎点或人的脚所必需的。但在上述情况下,不同类型的多辆车在同一车道上行驶时,逐个扫描标注也是必要的。移动对象的标注通常是注释区块时的第一步,因为这允许注释器过滤所有移动点,然后集中于环境的静态部分。

B、 数据集的基础

我们数据集的基础是KITTI Vision Benchmark[19]的数据,在撰写本文时,该数据集仍然是自动驾驶中使用的最大数据集。KITTI数据集是不同环境下许多实验评估的基础,并随着时间的推移通过新任务或附加数据进行了扩展。因此,我们决定在这一传统的基础上再接再厉,并使我们的注释与KITTI Vision Benchmark的其他部分和任务之间发挥协同作用。

我们特别决定使用Odometry Benchmark来实现注释数据的使用。我们期望在里程计估计中利用语义信息是未来研究的一个有趣途径。然而,KITTI Vision Benchmark的其他任务可能会从我们的注释和我们将在数据集网站上发布的预训练模型中获益。

尽管如此,我们希望,我们的努力和点标注工具的可用性将使其他人能够复制我们在汽车激光雷达未来公开可用数据集上的工作。

C、 类别定义

在标注如此大量数据的过程中,我们必须决定在某个时间点对哪些类进行注释。通常,我们遵循Mapillary Vistas数据集[39]和Cityscapes[10]的类定义和选择,但对所使用的数据源进行了一些简化和调整。

首先,我们没有明确考虑骑摩托车或自行车的人的骑手类别,因为可用的点云没有提供单个扫描的密度来区分骑车辆的人。此外,对于此类类,我们只能得到移动示例,因此无法容易地聚合点云以增加点云的保真度,并使其更容易区分车辆的驾驶员和车辆。

其他结构、其他车辆和其他对象的类别在不清楚的情况下或缺失的类别中是其各自根类别的后备类别,因为这简化了标注过程,并可能在将来用于进一步区分这些类别。

注释者通常对场景的某些对象或部分进行注释,然后隐藏标注的点,以避免覆盖或删除标签。因此,在不明确的情况下或缺少特定类的情况下分配回退类,可以简单地隐藏该类以避免覆盖它。如果我们指示注释者将这些部分标注为未标注的,那么将导致一致地标注点云的问题。

此外,我们还区分了移动和非移动的车辆和人类,即,如果车辆或人类在LiDAR传感器观察时在一些连续扫描中移动,则会获得“移动”标签。

总之,我们注释了28个类,下一页的表6中列出了所有带注释的类及其各自的定义。

表6:类别定义。

表7:方法统计。在epochs数字中的∗ 意味着它是从单扫描版本的预训练权重开始的。

D、 基线设置

我们修改了可用的实现,以便可以在我们的大规模数据集上训练和评估这些方法,因为LiDAR传感器具有非常稀疏的点云。注意,迄今为止,这些方法中的大多数仅在小型RGB-D室内数据集上进行了评估。

由于某些方法[40,41]的内存限制,我们通过随机抽样将单个扫描中的点数限制为50000。

对于SPLATNet,我们使用了[51]中的SPLATNet 3D (1 https://github.com/NVlabs/splatnet)架构。输入由3D位置及其法线的每个点组成。在30个最近邻居的情况下,先前估计了法线。

对于TangentConv(2 https://github.com/tatarchm/tangent_conv),我们使用了Semantic3D的现有配置。我们通过预计算扫描批并添加异步数据加载,加快了训练和验证过程。培训期间提供了完整的单次扫描。在多扫描实验中,由于内存限制,我们将每个批次的点数固定为500000,并从单扫描权重开始训练。

对于SquezeSeg[60]及其Darknet主干等价物,我们使用了与原始Squezeseg方法相同的扫描球面投影。该投影包含64条高度线,与传感器的单独光束相对应,并外推了仅使用前90°水平分辨率为512,我们在整个扫描中使用2048。因为在这个采样过程中有些点是重复的,所以我们总是保持最接近的范围值,在每次扫描的推断中,我们遍历整个点列表,并在输出网格中检查其语义值。

表7中给出了所用参数的概述。此外,我们还提供了训练epochs的数量,以及我们是否能够获得在给定时间内似乎收敛的结果。

E、 使用多次扫描的结果

表8列出了多次扫描实验的全部每类IoU结果。正如正文中已经提到的,我们通常观察到静态类的IoU不受多次过去扫描可用性的影响。在某种程度上,某些类别的IoU略有增加。mIoU方面的性能下降主要是由于正确区分移动类和非移动类带来的额外挑战。

F、 语义场景补全

表9显示了语义场景补全的类结果以及场景补全的精度和召回。可以看出,TS3D+DarkNet53Seg的性能略优于SSCNet和TS3D。注意,DarkNet53Seg已经在语义场景补全所需的完全相同的类上进行了预训练。另一方面,TS3D使用了在Cityscapes[10]数据集上预训练的DeepLab v2(ResNet-101)[9],该数据集不区分其他地面、停车场或干线等类别。另一个原因可能是投影回点云的2D语义标签不是很准确,尤其是在对象边界,标签通常会流到远处的对象上。这是因为在2D投影中,它们彼此接近,这是投影方法固有的问题。最佳方法(TS3D+DarkNet53Seg+SATNet)显著优于其他方法(场景补全率为20.77%IoU,语义场景补全率+7.51%mIoU)。如上所述,这是唯一能够产生高分辨率输出的方法。然而,这种方法存在巨大的内存消耗。因此,在训练期间,输入体积被随机裁剪为网格大小为64×64×32的体积,而在推断期间,每个体积被划分为大小为90×138×32的6个重叠块,分别对其进行推断。随后对各个块进行融合以获得最终结果。图7显示了这种方法的示例结果。

像自行车、摩托车、摩托车手和人这样的罕见类别不被辨别或几乎不被辨别。这表明这些类可能很难识别,因为它们代表SemanticKITTI数据中的一个小而罕见的信号。

图7:语义场景补全方法TS3D+DarkNet53Seg+SATNet的定性结果。左:输入体积。中间:网络预测。右:真值。由于内存限制,必须在重叠子卷上分六步进行推断。子体积因此被融合以获得最终结果。

图8:所有方法的推理示例。使用球形投影将点云投影到2D,以便于比较。

表8:使用多次过去扫描序列的IoU结果(%)。

表9:场景补全的结果和语义场景补全的分类结果(%)。

G、 定性结果

图8显示了从验证数据中扫描的评估基线方法的定性结果。这里我们展示了结果的球形投影,以便于比较结果。

随着平均IoU(从上到下)方面的表现不断提高,请参见本文的表2,我们看到地面点可以更好地划分为人行道、道路和停车场。特别是,停车区需要大量的上下文信息以及来自相邻点的信息,因为通常一个小的路缘将停车区与道路区分开来。

总的来说,我们可以肯定地看到,对于像图像右侧的杆子这样的较小对象,精度会有所提高,这表明需要使用容量最大的模型的额外参数(在DarkNet21Seg的情况下为2500万个,在Darknet 53Seg的情况下为5000万个)来区分较小的类和示例很少的类。

H、 数据集和基线访问API

除了注释和标注工具,我们还提供了一个用Python实现的公共API。

我们的标注工具旨在允许用户轻松扩展此数据集,并为其他目的生成其他数据集,与此相反,此API旨在用于轻松访问数据、计算统计数据、评估度量,以及访问不同最先进语义分割方法的数种实现。我们希望该API将作为实现新的点云语义分割方法的基线,并将提供一个通用框架来评估它们,并将它们与其他方法进行更透明的比较。选择Python作为API的底层语言是因为它是深度学习框架开发人员以及深度学习从业者当前选择的前端语言。

图9给出了标注序列的概述,显示了整个序列上的估计轨迹和聚集点云。

图9:标注序列和轨迹的定性概述。