拾遗-卷积神经网络关于通道数改变

以RGB图像为例。

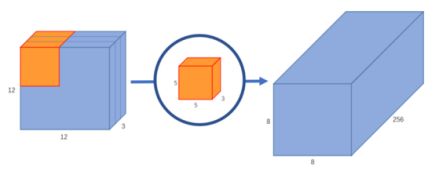

一个12*12的像素图,对其进行5*5的卷积,最后得到一个8*8的像素图。

RGB图像有3个通道(12*12*3),所以卷积核也要有3个通道(5*5*3),对像素图进行卷积后得到的结果是8*8*1而不是8*8*3的图像。最后像素图的深度(输出图像的信道数)取决于卷积核的个数。

如果要得到8*8*256的结果,应该这样做:用256个5*5*3的卷积核来卷12*12*3的像素图。最后得到的结果进行堆叠就是8*8*256的图像。(256个5*5*3的卷积核可以想象成它的输入信道数为3,而输出信道数为256,两者互不影响。)

这里代码补上

import tensorflow as tf

from tensorflow.keras import layers, optimizers, datasets, Sequential

import os

os.environ['TF_CPP_MIN_LOG_LEVEL']='2'

tf.random.set_seed(2345)

conv_layers = [#主要关注全链接层和卷积层

#unit 1

layers.Conv2D(64, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),#64 64个核心 padding 输入和输出的h,w相同

layers.Conv2D(64, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),#32 * 32 * 64

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'), #16 * 16 * 64

#unit 2

layers.Conv2D(128, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),#64 64个核心 padding 输入和输出的h,w相同

layers.Conv2D(128, kernel_size=[3, 3], padding="same", activation=tf.nn.relu), #16 * 16 * 128

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'),# 8 * 8 * 128

#unit 3

layers.Conv2D(256, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),#64 64个核心 padding 输入和输出的h,w相同

layers.Conv2D(256, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'), # 4 * 4 * 256

#unit 4

layers.Conv2D(512, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),#64 64个核心 padding 输入和输出的h,w相同

layers.Conv2D(512, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'), #2 * 2 * 512

#unit 5

layers.Conv2D(512, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),#64 64个核心 padding 输入和输出的h,w相同

layers.Conv2D(512, kernel_size=[3, 3], padding="same", activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same') #1 * 1 * 512

]

def main():

# [b, 32, 32, 3] => [b, 1, 1, 512]

conv_net = Sequential(conv_layers)

conv_net.build(input_shape=[None, 32, 32, 3])

x = tf.random.normal([4, 32, 32, 3])

out = conv_net(x)

print(out.shape)

if __name__ == '__main__':

main()