智能语音识别技术入门系列(上)

本系列文章开始,我们将一起探索自动语音识别、语言处理技术所包含的核心算法、模型及未来的发展趋势。本篇文章我们主要讨论语音识别的基本概念。并理解语音识别技术的流程。

(一) 自动语音识别技术ASR

自动语音识别,简称ASR。这项技术是使人与人,人与机器更顺畅交流的关键技术。

随着人们对生活的仪式感的追求,移动设备、可穿戴设备、智能家居设备、车载信息娱乐系统也变得越来越流行。在这些设备和系统上,以往鼠标、键盘这样的交互方式就不再延续像用在电脑上一样的便捷性了。而语音作为人类之间自然的交流方式,在这些设备和系统上就成为了更受欢迎的交互方式了。

如果有一个语音到语音翻译系统其实就可以完美消除这个交流壁垒。这样的话就算语言不通人们也可以自由地进行交流。比如我们现在这里看到的就是一个典型的语音到语音的翻译系统,可以看到,语音识别是这个流水过程中的第一环。

(二) 人机交流场景

我们说语音技术可以极大地提升人机交流的能力,其中最流行的应用场景就有大家所熟知的语音搜索、个人数码助理、游戏、起居室交互系统和车载信息娱乐系统。

对于语音搜索而言,它能使用户直接通过语音来搜索餐馆、行驶路线和商品评价的信息。这极大地简化了用户输入搜索请求的方式。目前,语音搜索类的应用在各类品牌和系统的手机上都已非常流行。

第二个个人数码助理已经作为原型产品出现了十年,siri系统就是从它变得流行起来的。自那以后,很多公司都发布了类似的产品。我们把这种系统简称PDA。PDA系统知晓我们在移动设备上的信息,了解一些常识并记录了用户与系统的交互历史。有了这些信息后,PDA可以更好的服务用户。比如,可以完成拨打电话、回答问题和音乐搜索等工作。而用户所需要做的只是直接向系统发出语音指令即可。

在融合语音技术之后,游戏的体验将得到很大的提升。例如,玩家可以和游戏角色对话以询问信息或者发出指令。

最后,起居室交互系统和车载信息娱乐信息在功能上十分相似。这种系统允许用户使用语音与之交互,我们可以通过他们来播放音乐、询问信息或者控制系统。当然,由于这些系统的使用条件不同,设计这样的系统时会遇到不同的挑战。

(三) 语音对话系统的组成

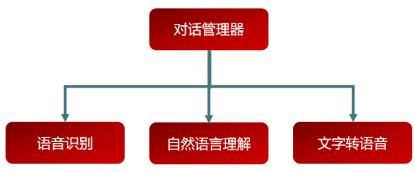

在上述的所有应用场景和系统讨论的都是语音对话系统。如下图所示,语音对话系统通常包括四个主要组成部分的一个或多个:语音识别系统将语音转化为文本、语音理解系统提取用户说话的语义信息、文字转语音系统将内容转化为语音、对话管理系统将前面的三个系统连接起来并完成与实际应用场景的沟通。这些内容对建立一个成功的语音对话系统都是很关键的,我们的关注重点主要是在语音识别系统。

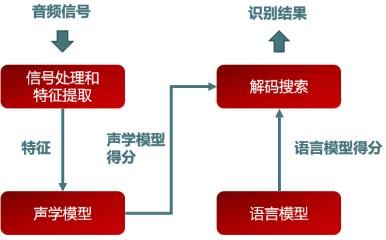

下面展示的语音识别系统的典型结构,语音识别系统主要由图中四个部分组成:信号处理和特征提取、声学模型、语言模型和解码搜索部分。信号处理和特征提取部分是以音频信号作为输入,通过消除噪声和信道失真对语音进行增强,为后面的声学模型提取合适的有代表性的特征向量。声学模型将声学和发音学的知识进行了融合,以特征提取部分生成的特征作为输入,并为可变长特征序列生成声学模型的分数。语言模型估计通过从训练语料,通常是文本形式,学习词之间的相互关系,来估计假设词序列的可能性,又被称作语言模型分数。如果了解了领域或任务相关的先验知识,语言模型分数通常可以估计得更准确。解码搜索对给定的特征向量序列和若干假设词序列计算声学模型分数和语言模型分数,将总体输出分数最高的词序列当做识别结果。在这里,我们主要讨论声学模型。

关于声学模型,有两个主要问题,分别是不定长的特征向量序列和丰富多变的音频信号。不定长的问题通常由动态时间规整方法和隐马尔可夫模型方法来解决。而丰富多变性主要是由于说话的人的各种复杂特性,比如音色、风格、速度等,还有加之环境噪声、周围人声、方言差异等引起。所以,一个成功的语音识别系统必须能够音符所有可能性的变化因素。

这样的话,我们从特定领域任务向真实应用转变时,就会遇到一些困难。就像上图当中所展示的,一个时下实际的语音识别系统需要处理大量的词汇,可能是数百万量级的,自由式对话,带噪声的远场自发语音和多语言混合的问题。由于有了真实世界任务的需求,当今正在解决的语音识别相关的问题,如最右侧所示,就比过去已经解决的问题要难很多。

(四) 传统声学模型

下面我们就来介绍一下传统的声学模型。语音识别建模对语音识别来说是不可或缺的一部分,因为不同的建模技术通常意味着不同的识别性能,所以这是各个语音识别团队重点优化的方向。也正是因为如此,语音识别的模型也层出不穷,在声学模型里面又涵盖了HMM、DNN、RNN等模型。简单来说,声学模型的任务就是描述语音的物理变化规律,而语言模型则表达了自然语言包含的语言学知识。而其中语音信号作为整个系统的输入就显得比较重要了。语音信号计算机中是采用PCM编码按时间序列保存的一连串数据。计算机中最原始语音文件是wav,可以通过各种录音软件录制,其中录制通道表示很多音频都有左右2个通道,在语音识别中通常有一个通道的数据就够了。

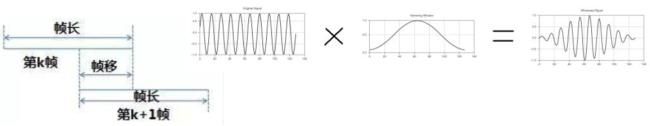

再来说说我们做信号处理的目的----获得频率成分的分布,而语音作为非平稳信号要实现就要通过分帧来实现。这时候还有一个操作叫做加窗,加窗的目的是让一帧信号的幅度在两端渐变到 0。渐变对傅里叶变换有好处,可以提高变换结果的分辨率。加窗的代价是一帧信号两端的部分被削弱了,没有像中央的部分那样得到重视。弥补的办法是,帧不要背靠背地截取,而是相互重叠一部分。

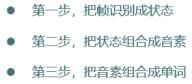

这样通常加窗之后我们可以实现特征数的降维以及提取出比原始语音更具表征力的特征。以上可以理解为若干帧对应一个音素,若干音素对应一个单词,如果我们想要识别对应的单词状态,我们只要知道对应的帧状态就行,用计算机能识别的方式最简单的就是概率匹配,这些概率我们就可以通过声学模型获得,所以要做的就是通过训练获得合适的模型参数以拟合好的匹配效果。

(五) 语音识别三步

语音识别大体上包含前端处理,特征提取,模型训练,解码四个模块。其中前端处理包括了,语音转码,高通滤波,端点检测等。

上图是目前语音识别的基本流程,输入的语音数据流经过前端处理(语音格式转码,高通,端点检测),语音格式转码是将输入的语音数据转成pcm或者wav格式的语音,端点检测是检测出转码后语音中的有效语音,这样对解码速度和识别率上都会改善。经过前端处理之后的得到的分段语音数据送入特征提取模块,进行声学特征提取。最后解码模块对提取的特征数据进行解码,解码过程中利用发音字典,声学模型,语言模型等信息构建WFST搜索空间,在搜索空间内寻找匹配概率最大的最优路径,便得到最优的识别结果。

(六) 主流声学建模技术

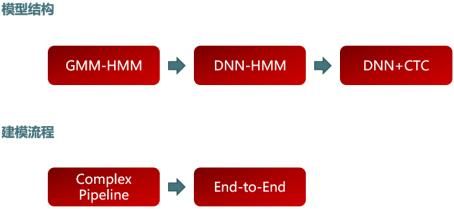

近年来,随着深度学习的兴起,使用了接近30年的语音识别声学模型HMM(隐马尔科夫模型)逐渐被DNN(泛指深度神经网络)所替代,模型精度也有了突飞猛进的变化,整体来看声学建模技术从建模单元、模型结构、建模流程等三个维度都有了比较明显的变化。其中,深度神经网络超强的特征学习能力大大简化了特征抽取的过程,降低了建模对于专家经验的依赖,因此建模流程逐步从之前复杂多步的流程转向了简单的端到端的建模流程,由此带来的影响是建模单元逐步从状态、三音素模型向音节、字等较大单元演进,模型结构从经典的GMM-HMM向DNN+CTC(DNN泛指深度神经网络)转变,演进的中间态是DNN-HMM的混合模型结构。

(七) 混合高斯模型(GMM)

让我们先来看看GMM混合高斯模型。简单来说,当使用混合高斯随机变量的分布用于匹配真实世界的数据,比如语音特征时,就形成了混合高斯模型。GMM作为描述基于傅里叶频谱语音特征的统计模型,在传统的语音识别系统的声学建模中发挥了重要作用。GMM的优势使得期望最大化算法可以被有效地用来训练模型,以更好的匹配语音特征。原始的语音数据经过变换后会成为特征序列,在忽略时序信息的条件下,GMM就非常适合拟合这样的语音特征。也就是说,可以以帧为单位,用GMM对语音特征进行建模。

(八) 通信模型(HMM)

但是呢?如果把语音顺序信息考虑进去,GMM就不再是一个好模型了,因为它不包含任何顺序信息。这时隐马尔可夫模型就更加通用了,因为它可以对时序信息进行建模。但其实,当给定HMM的一个状态后,若要对属于该状态的语音特征向量的概率分布进行建模,GMM仍不失为一个好的模型。使用GMM对HMM每个状态的语音特征分布进行建模,有许多明显的优势。只要混合的高斯分布足够多,那么GMM可以拟合任意精度的概率分布,并且他可以通过EM算法很容易拟合数据。GMM参数通过EM算法的优化,可以使其在训练数据上生成语音观察特征的概率最大化,在此基础上,若通过鉴别性训练,基于GMM-HMM的语音识别系统的识别准确率可以得到显著提升。尽管GMM有着众多优势,但它也有一个严重的不足,那就是GMM不能有效地对呈非线性或近似非线性的数据进行建模。这就意味着隐藏在语音特征下的真正结构的复杂度,比直接描述现有特征,使其作为语音声学模型的能力比GMM更好,我们要求这种模型要能更加有效地挖掘隐藏在长窗宽语音帧中的信息。这时我们就可以将随机变量的概念延伸到随机序列,它可以是离散的也可以是连续的,非常符合我们的要求,而这种状态就是马尔可夫序列的基本状态,由它衍生出的模型叫做HMM隐马尔可夫模型。大家现在看到的这整个结构就是一个典型的通信系统,而这种系统就特别适合隐马尔科夫模型来进行估计计算了。那么下节课我们就会把重点放在HMM上来做介绍。

本文章就到这里暂时告一个段落,我们下一篇文章再见。