计算机视觉学习笔记(四)---卷积神经网络之手写数字识别

文章目录

- 前言

- 一、读入数据进行数据预处理

- 二、搭建网络

前言

本文承接pytorch学习笔记(三),以波士顿房价预测为例演示利用pytorch搭建一个简单的传统神经网络

一、读入数据进行数据预处理

数据集为MNIST手写数字数据集,从torchvision 中导入数据。输入图像的总尺寸为28*28。

# 定义超参数

input_size = 28 #图像的总尺寸28*28

num_classes = 10 #标签的种类数

num_epochs = 3 #训练的总循环周期

batch_size = 64 #一个撮(批次)的大小,64张图片

# 训练集

train_dataset = datasets.MNIST(root='./data',

train=True,

transform=transforms.ToTensor(),

download=True)

# 测试集

test_dataset = datasets.MNIST(root='./data',

train=False,

transform=transforms.ToTensor())

# 构建batch数据

train_loader = torch.utils.data.DataLoader(dataset=train_dataset,

batch_size=batch_size,

shuffle=True)

test_loader = torch.utils.data.DataLoader(dataset=test_dataset,

batch_size=batch_size,

shuffle=True)

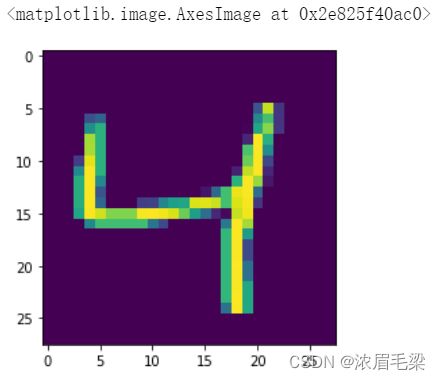

展示其中一张手写数字图片

a=np.array(train_dataset.data)

plt.imshow(a[2])

二、搭建网络

数据处理完成之后就要搭建网络结构了,由于我们的输入是图片,选择进行三次二维卷积、激活、池化序列操作。

自己的网络要继承nn.Module,并在构造方法中调用父类的构造方法。

在第一次二维卷积中,由于我们的输入是灰度图,即在RGB中选一个通道,故in_channels=1,即输入通道数为1;由于要输出16个特征图(有几个特征图就有几个卷积核),故out_channels=16,即输出通道数为16;卷积核尺寸kernel_size设为33,是一个正方形;步长stride设为1;设填充了1圈0,即padding=1。输出的特征图维度为(16,28,28)。

卷积后激活。

激活后池化(卷积和激活必不可少,而池化可选写) 操作22区域,池化后变成(16,14,14)。

在第一次二维卷积中,由于此层的输入是上一层的输出,故输入通道in_channels=16;

代码如下:

class my_conv(nn.Module):

def __init__(self):

super().__init__()

self.conv1=torch.nn.Sequential(

nn.Conv2d

in_channels=1,

out_channels=16,

kernel_size=3,

stride=1,

padding=1

),

nn.ReLU(),

nn.MaxPool2d(kernel_size=2),)

self.conv2=torch.nn.Sequential(

nn.Conv2d(

in_channels=16,

out_channels=32,

kernel_size=3,

stride=1,

padding=1

),

nn.ReLU(),

nn.MaxPool2d(kernel_size=2),)

self.conv3=torch.nn.Sequential(

nn.Conv2d(

in_channels=32,

out_channels=64,

kernel_size=3,

stride=1,

padding=1

),

nn.ReLU())

self.out=nn.Linear(64*7*7,10)

def forward(self,x):

x=self.conv1(x)

x=self.conv2(x)

x=self.conv3(x)

x=x.view(x.shape[0],-1)

x=self.out(x)

return x

# 三、训练与评估

和之前文章(https://blog.csdn.net/weixin_43535003/article/details/126085626)类似,此处不再赘述