变化检测阅读(二)

文章目录

- 摘要

- 一、INTRODUCTION

- 二、RELATED WORKS

-

- 1.基于深度学习的CD

- 2.CD策略

- 3.超分辨率

- 三、METHODOLOGY

-

- 1.Overview

- 2.SR模块

- 3.CD模块

- 4.LOSS函数

- 四、EXPERIMENTAL SETTINGS

-

- 1.数据集

- 2.实验设计

- 五、RESULTS AND ANAYSIS

- 结论

摘要

提示:实际应用中,CD通常采用不同分辨率的双时态图像。

本文提出了一种基于超分辨率的变化检测网络(SRCDNet),该网络具有堆叠式注意力模块(SAM)。SRCDNet使用一个超分辨率(SR)模块,该模块包含一个生成器和一个鉴别器,通过对抗式学习直接学习SR图像,并克服双时态图像之间的分辨率差异。为了增强多尺度特征中的有用信息,将由五个卷积块注意模块(CBAM)组成的SAM集成到特征提取器中。最终的变化图通过基于度量学习的变化决策模块获得,其中计算双时态特征之间的距离图。

提示:以下是本篇文章正文内容,下面案例可供参考

一、INTRODUCTION

背景

传统的CD方法:CVA、PCA(主要利用双时态图像中的光谱信息)

改进:利用CNN从HR图像分层提取空间和语义特征。

提出问题:当双时相图像的分辨率不一致时怎么获取精确的CD方法。

引出本文

SRCDNet,为了解决双时图像空间分辨率不匹配的问题,采用超分辨率SR图像,以恢复更多的语义信息,后将SR图像与对应于其他时间戳的HR图像一起输入到特征提取器中,为了充分提取HR图像中的多级信息,在特征器中添加了五个卷积块注意力模块(CBAM)组成的堆叠注意力模块(SAM)。

然后从双时态图像的多尺度特征中学习精确的变化图,计算特征直接的距离图,并和真值进行比较,采用对比熵来帮助增加变化区域的距离,减少不变区域的距离。最后通过简单的阈值化,从距离图中获得到变化图。

①通过LR图像和初始HR图像之间的映射来学习SR图像,避免传统基于亚像素的方法所遇到的误差累计。

②特征器中添加了五个卷积块注意力模块(CBAM)组成的堆叠注意力模块(SAM),增强特征的有效信息。

二、RELATED WORKS

1.基于深度学习的CD

以往的尝试:

①基于像素级、双时态CD的UNet

②UNet++和多尺度特征融合策略

其中编码器用于提取双时态图像的多级语义特征,解码器用于从层次特征中恢复空间信息,并通过分类生成CD图像。

③将度量学习引入到CD中,以取代解码器的上采样过程,该过程通过计算双时态图像特征之间的距离直接获取变化图。

2.CD策略

以往的尝试:RNN和注意力机制

RNN可以有效捕获图像之间的光谱或时间关系。

注意力机制可以更换利用HR图像中丰富的空间信息。

3.超分辨率

超分辨率的目标:从LR图像中获得更高质量的图像。

①在从LR图像重建HR图像时更好地恢复图像的详细信息,将CNN作为超分辨率卷积神经网络SRCNN引入SR应用。

②将GAN网络应用于SR,并提出超分辨率生成对抗网络SRGAN(GANs性能优异)。

–本文提出深度度量学习变化检测网络CDNet,结合超分辨率学习LR图像到HR图像的映射,并结合注意力机制获得更有效的多尺度特征。

三、METHODOLOGY

1.Overview

SRCDNet由两部分组成:超分辨率(SR)模块和CD模块

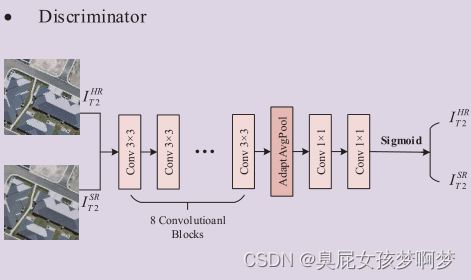

SR模块基于GAN结构,由发生器和鉴别器组成,旨在将双时态图像的LR图像重建为HR图像。

CD模块负责特征提取和CD。

具有五个CBAM的SAM是一种轻量级注意力机制,可以在通道和空间方面增强特征,他集成到特征提取器中以提取多尺度特征。

预设:给出T1和T2处的一组HR双时态图像,然后通过N次下采样得到T2处的LR图像。

①向SR模块输入T2时刻的LR图像,通过生成器G得到SR图像。鉴别器D通过HR和SR图像的输出构成的loss来区分HR和SR。

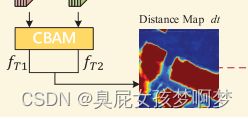

②T1的HR图像和T2的SR图像送到权值共享特征提取器中,用于分层特征。前四个CBAM应用于四个中间特征,然后再将其堆叠为一个。第五个CBAM块将应用于其中。

③基于双时态特征的FT1和FT2计算距离映射dt,以测量HR和SR之间的距离,该距离将与地面真值gt进行比较,并获得对比损失。

④根据T2时刻的SR图像和T2时刻的HR图像、鉴别器的结果和CD性能损失,对生成器G进行优化,以生成具有丰富语义信息的SR图像。

2.SR模块

SR模块中,生成器负责从LR图像生成SR图像,鉴别器从SR图像与初始HR图像区分开,后,生成器能够输出用于有细密纹理CD的SR图像。

生成器:用99卷积层来捕获输入LR图像的浅层特征,然后用五个残差块来提取高层特征,每个残差块都有两个33卷积层和一个批量归一化(BN)层。将残差块提取的深层特征与第一卷积层获得的浅层特征进行融合,得到具有丰富空间和语义信息的特征。

鉴别器:区分SR图像和HR图像,可采用对抗性训练提示生成器生成与原始HR图像更相似的SR样本。

3.CD模块

CD模块任务是生成基于另一个时间戳的SR图像的精确更改映射。

①使用预训练的ResNet18作为特征提取器,采用步长为1的7*7卷积层提取空间信息丰富的浅层特征,然后采用BN层和ReLU函数,然后采用步长为2的maxpooling。

②四个残差块,每个残差块输出特征的大小是输入图像的1/2、1/4、1/8、1/8,通道分别为64、128、256、512。

③四个CBAM应用于每个残差块的输出特征,以强调有用信息。

CBAM包括:用于捕捉通道关系的通道注意力模块和一个用于探索空间上下文信息的注意模块。

emmm中间一些没太看懂。之后再看一边吧~~

通过度量学习,可以获得变化区域和不变区域之间的差值尽可能大的距离图。因此通过阈值分割可以从距离图中获得更精确的变化图。

4.LOSS函数

①鉴别器的损失函数:

鉴别器输出接近1的HR图像概率和接近0的SR图像概率。

②生成器的损失函数:

生成器的损失包括:图像损失、内容损失、对抗性损失和更改损失。

③SRCDNet流程图:

四、EXPERIMENTAL SETTINGS

1.数据集

①BCCDD建筑变化检测数据集:一对3250715354的0.2m的图像,以及他们之间建筑变化的基本真相。

预处理:将图像裁剪7434个大小为256256,以8:1:1的比例随机分为了训练集、验证集、测试集。

②CDD变化检测数据集:16000个256256的真实基金变化谷歌地球图像对,包括10000个训练样本、3000个验证样本和3000个测试样本。

③谷歌数据集:由广州的19对谷歌地球图像组成,分辨率为0.55米,大小从10061168像素到4936*5224像素不等。以6:2:2的比例随机分为了训练集、验证集、测试集。

2.实验设计

五、RESULTS AND ANAYSIS

结论

针对不同分辨率的双时态图像,提出了一种端到端的SRCDNet。为了克服双时态图像之间的分辨率差异,采用了一种由生成器和鉴别器组成的SRM将LR图像恢复到HR图像的大小,这被证明是从LR图像生成真实SR图像的有效方法。暹罗特征提取器从两个输入图像中提取多尺度特征:对应于不同时间戳的SR图像和HR图像,在其上应用SAM以捕获更有用的通道信息和空间信息。SRCDNet采用深度度量学习来学习最终的变更图。消融研究验证了SRM和SAM在SRCDNet中的有效性。然后在BCDD和CDD上进行了对比实验,其中SRCDNet不仅在相同分辨率的图像上获得了最好的结果,而且在4倍和8倍不同分辨率的图像上也优于其他比较方法,这充分证明了SRCDNet是一种通用的多分辨率CD解决方案。在4倍分辨率差的Google数据集上进行的真实图像实验进一步验证了SRCDNet在真实图像上的有效性。未来,我们将寻求探索其他不同分辨率CD的方法,促进CD应用中深度学习的发展。

参考文献:[1] Liu M , Shi Q , Marinoni A , et al. Super-resolution-based Change Detection Network with Stacked Attention Module for Images with Different Resolutions[J]. 2021.

源代码链接: https://github.com/liumency/SRCDNet