- PyTorch 在 Python 自然语言处理中的运用

Python编程之道

Python编程之道pythonpytorch自然语言处理ai

PyTorch在Python自然语言处理中的运用关键词:PyTorch,Python,自然语言处理,深度学习,文本分类,情感分析摘要:本文全面探讨了PyTorch在Python自然语言处理(NLP)领域的运用。首先介绍了相关背景知识,包括目的范围、预期读者等内容。接着详细阐述了核心概念,如词嵌入、循环神经网络等,并给出了相应的原理示意图和流程图。深入讲解了核心算法原理,结合Python代码进行详细

- 神经网络初步学习3——数据与损失

X Y O

神经网络学习人工智能

一、传统机器学习与神经网络前言:该部分需要一定的机器学习与数学基础(很浅的基础),如果有不理解的地方可以自行查阅。(1)区别这里不妨以图像识别为例子:(1)在传统的机器学习视角中:我们需要人工手动去设置并提取我们的特征量,例如常见的SIFT、SURF和HOG等,随后需要我们选择合适的分类器(例如:SVM、KNN等分类器),接着把我们的参数训练出来。(2)而在神经网络的视角中:我们只需要把图片喂给它

- 异物检测的计算机视觉算法技术路线

思绪漂移

计算机视觉算法人工智能

异物检测的计算机视觉算法技术路线在现代智能监测系统中,异物检测有着其必要性和运维重要性,通过计算机视觉算法,可以实时识别各种异常物体,为设备安全运行提供有力保障。本文将介绍异物检测的主要技术路线。一、分类识别适应场景分类识别技术主要适用于已知目标类别的异物检测场景。在运维环境中,这类场景包括:固定区域内的障碍物监测(如轨道区域的石块、工具、动物等)关键部件的异物附着检测(如固定装置上的杂物)安全通

- 量化价值投资中的深度学习技术:TensorFlow实战

量化价值投资中的深度学习技术:TensorFlow实战关键词:量化价值投资,深度学习,TensorFlow,股票预测,因子模型,LSTM神经网络,量化策略摘要:本文将带你走进"量化价值投资"与"深度学习"的交叉地带,用小学生都能听懂的语言解释复杂概念,再通过手把手的TensorFlow实战案例,教你如何用AI技术挖掘股票市场中的价值宝藏。我们会从传统价值投资的痛点出发,揭示深度学习如何像"超级分析

- Spring Data Neo4j 与后端人工智能算法的数据交互

AI大模型应用实战

springneo4j人工智能ai

SpringDataNeo4j与后端人工智能算法的数据交互关键词:SpringDataNeo4j、图数据库、人工智能算法、数据交互、知识图谱、图神经网络、数据集成摘要:本文深入探讨了如何利用SpringDataNeo4j框架实现后端人工智能算法与图数据库的高效数据交互。文章首先介绍了图数据库和人工智能算法的基本概念,然后详细解析了SpringDataNeo4j的核心架构和原理。接着,通过实际代码示

- ResNet:深度卷积神经网络的里程碑

心想事“程”

小知识点cnn人工智能神经网络

一、引言在深度学习的发展历程中,深度卷积神经网络(CNN)不断演进,旨在提升对图像等数据的特征提取与分类能力。然而,随着网络层数的增加,传统CNN面临着梯度消失、梯度爆炸以及退化等棘手问题,训练变得愈发困难。2015年,由微软研究院提出的ResNet(ResidualNetworks,残差网络)横空出世,它以独特的残差学习思想,成功攻克了这些难题,在ImageNet竞赛中大放异彩,开创了深度神经网

- 视觉算法之卷积神经网络

清风AI

深度学习算法详解及代码复现计算机视觉cnn神经网络深度学习python课程设计毕业设计

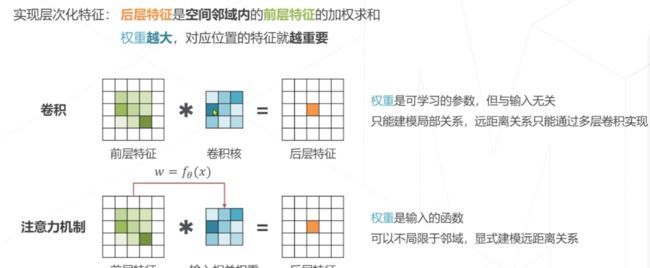

定义与特点卷积神经网络(ConvolutionalNeuralNetwork,CNN)是一种专为处理具有网格结构的数据而设计的深度学习模型。其独特的结构和功能使其在图像处理、语音识别等领域展现出卓越的性能:CNN的核心设计理念源于对生物视觉系统的模仿。通过模拟大脑皮层中视网膜和视觉皮层的层次化结构,CNN能够有效地捕捉图像中的局部特征并逐步抽象为高层语义信息。这种设计使得CNN特别擅长处理图像和音

- 卷积神经网络架构的演进:从AlexNet到EfficientNet

t0_54manong

大数据与人工智能cnn架构人工智能个人开发

在过去的8.5年里,深度学习取得了飞速的进步。回溯到2012年,AlexNet在ImageNet上的Top-1准确率仅为63.3%,而如今,借助EfficientNet架构和师生训练法,我们已经能达到超过90%的准确率。本文将聚焦于卷积神经网络(CNN)架构的演变,深入探究其背后的基本原理。一些关键术语在深入了解各种架构之前,我们需要明确几个关键术语。更宽的网络意味着卷积层中有更多的特征图(滤波器

- 【AI大模型】深入解析预训练:大模型时代的核心引擎

我爱一条柴ya

学习AI记录深度学习人工智能aipythonAI编程算法

预训练已成为现代人工智能,尤其是自然语言处理和计算机视觉领域的基石技术。它彻底改变了模型开发范式,催生了BERT、GPT等革命性模型。本文将系统阐述预训练的核心概念、原理、方法、应用及挑战。一、预训练的本质:为何需要它?核心问题:数据标注的瓶颈监督学习依赖海量高质量标注数据,获取成本极高(时间、金钱、专业知识)。对于复杂任务(如理解语义、生成文本),标注难度呈指数级上升。标注数据稀缺导致模型泛化能

- 一文搞懂 Cursor 内部工作原理~

zz_jesse

介绍了Cursor,一个结合了AI技术的代码编辑器,它通过深度学习和语义索引的方式,提升了开发者的工作效率。Cursor通过与VSCode相似的界面和功能,以及自己的AI特性,实现了代码的智能化编辑和错误检查。译文从这开始~~你可能已经看到新闻:OpenAI正以高达30亿美元的价格收购Windsurf!与此同时,Cursor的母公司Anysphere也正在以90亿美元估值融资9亿美元!这对于代码生

- 开源人工神经网络库(OpenANN)

deepdata_cn

人工智能神经网络

OpenANN(OpenANN,OpenArtificialNeuralNetworkLibrary)是一个开源的人工神经网络库,基于C++编写,依赖Eigen3库进行高效的矩阵运算,使用CMake进行项目构建,支持多种神经网络架构,包括前馈神经网络、卷积神经网络和循环神经网络等,适用于图像识别、自然语言处理、时间序列预测等多种场景。提供数据预处理、模型保存和加载、超参数优化等功能。支持GPU加速

- 目标检测YOLO实战应用案例100讲-基于深度学习的自动驾驶目标检测算法研究(续)

林聪木

目标检测YOLO深度学习

目录基于双蓝图卷积的轻量化自动驾驶目标检测算法5.1引言5.2DarkNet53网络冗余性分析5.3双蓝图卷积网络5.4实验结果及分析基于深度学习的自动驾驶目标检测算法研究与应用传统的目标检测算法目标检测基线算法性能对比与选择相关理论和算法基础2.1引言2.2人工神经网络2.3FCOS目标检测算法2.4复杂交通场景下的目标检测难点与FCOS改进方案基于FCOS的目标检测算法改进3.1引言3.2Re

- AI人工智能遇上TensorFlow:技术融合新趋势

AI大模型应用之禅

人工智能tensorflowpythonai

AI人工智能遇上TensorFlow:技术融合新趋势关键词:人工智能、TensorFlow、深度学习、神经网络、机器学习、技术融合、AI开发摘要:本文深入探讨了人工智能技术与TensorFlow框架的融合发展趋势。我们将从基础概念出发,详细分析TensorFlow在AI领域的核心优势,包括其架构设计、算法实现和实际应用。文章包含丰富的技术细节,如神经网络原理、TensorFlow核心算法实现、数学

- OpenCvSharp 实现环形文字识别OCR实例(C#)

XisVisual_Basic

ocrc#计算机视觉C#

近年来,随着计算机视觉和图像处理的不断发展,光学字符识别(OCR)技术也变得愈发成熟。OCR技术可以将图像中的文字转换为可编辑和可搜索的文本,为人们带来了极大的便利。在本篇文章中,我们将介绍如何使用OpenCvSharp库来实现环形文字的识别。首先,在使用OpenCvSharp之前,我们需要确保已经在项目中引用了该库,并添加相应的命名空间。usingOpenCvSharp;接下来,我们需要准备一张

- Python|OpenCV-实现识别弧形文字(17)

写python的鑫哥

OpenCV入门与进阶pythonopencv人工智能计算机视觉弧形文字环形文字识别

前言本文是该专栏的第19篇,后面将持续分享OpenCV计算机视觉的干货知识,记得关注。我们知道,OCR可以识别文字方面的需求,但是如果遇到那些目标文字是“弧形文字”,需要怎么去识别呢?遇到想要识别“弧形文字”的需求,这个时候你可以借助于Opencv+OCR技术来实现。而本文,笔者将针对上述问题需求,利用OpenCV结合OCR来实现“弧形文字”的识别。废话不多说,具体的细节部分以及详细的解决方案,跟

- 深度学习核心知识简介和模型调参

研术工坊

深度学习知识和技巧深度学习人工智能python

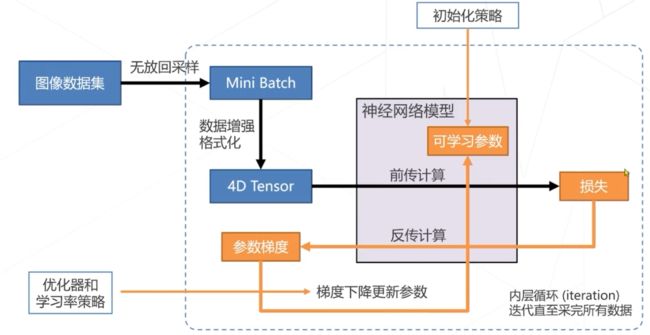

深度学习模型调优就像调制一道复杂的菜肴,需要掌握多种"调料"的用法。本文将为您详解这些关键"调料",帮助您烹饪出高性能的模型。###核心参数及其影响####1️⃣Loss(损失函数)**基本介绍**:衡量模型预测与真实值差距的指标,是模型优化的指南针。**生活类比**:想象你在教小孩认识动物:-**完美情况**:小孩看到猫说"猫",看到狗说"狗"→Loss=0-**有错误**:小孩看到猫说"狗"→

- 【小白入门必看】一文读懂深度学习计算机视觉技术及学习路线

一、什么是计算机视觉?计算机视觉,其实就是教机器怎么像我们人一样,用摄像头看看周围的世界,然后理解它。比如说,它能认出这是个苹果,或者那边有辆车。除此之外,还能把拍到的照片或者视频转换成有用的信息,帮我们做决定。整个过程就是为了让机器能看懂图像,然后根据这些图像来做出聪明的选择。二、计算机视觉实现起来难吗?人类依赖视觉,找辆汽车轻而易举,毕竟汽车那么大,一眼就能看出来,所以常误以为计算机视觉简单,

- 2025年跑深度学习电脑配置-深度学习显卡推荐

OpenCV图像识别

人工智能深度学习智能电视人工智能

2025年跑深度学习任务,电脑配置需从处理器、内存、显卡、存储、散热与电源、扩展性、网络连接等多方面综合考量,以下是具体分析:处理器(CPU)多核高性能:深度学习涉及大量并行计算任务,需要处理器具备强大的多核处理能力。英特尔至强Scalable处理器(SapphireRapids或后续架构)和AMDEPYC处理器(Genoa或后续架构)是不错的选择。英特尔至强Scalable处理器提供卓越的单核性

- 计算机视觉:Transformer的轻量化与加速策略

xcLeigh

计算机视觉CV计算机视觉transformer人工智能AI策略

计算机视觉:Transformer的轻量化与加速策略一、前言二、Transformer基础概念回顾2.1Transformer架构概述2.2自注意力机制原理三、Transformer轻量化策略3.1模型结构优化3.1.1减少层数和头数3.1.2优化Patch大小3.2参数共享与剪枝3.2.1参数共享3.2.2剪枝3.3知识蒸馏四、Transformer加速策略4.1模型量化4.2.2TPU加速4.

- 【零基础学AI】第30讲:生成对抗网络(GAN)实战 - 手写数字生成

1989

0基础学AI人工智能生成对抗网络神经网络python机器学习近邻算法深度学习

本节课你将学到GAN的基本原理和工作机制使用PyTorch构建生成器和判别器DCGAN架构实现技巧训练GAN模型的实用技巧开始之前环境要求Python3.8+需要安装的包:pipinstalltorchtorchvisionmatplotlibnumpyGPU推荐(可大幅加速训练)前置知识第21讲TensorFlow基础第23讲神经网络原理基本PyTorch使用经验核心概念什么是GAN?GAN就像

- 【深度学习第六期深度学习中的归一化与正则化技术:原理、实践与应用】

码上有前

Python深度学习Pytorch深度学习人工智能cnn

作者:“码上有前”文章简介:深度学习欢迎小伙伴们点赞、收藏⭐、留言深度学习中的归一化与正则化技术:原理、实践与应用摘要:本文深入探讨深度学习中批量归一化(BN)、层归一化(LN)、标准化以及正则化等关键技术。详细阐述它们的基本原理,包括如何调整数据分布、控制模型复杂度等;通过丰富的实例和对应代码,展示在不同网络架构中这些技术的具体实现方式,以及对模型训练和性能的影响;同时,对比分析各项技术的特点和

- 10、 量子神经网络:从理论到实践

安检

量子神经网络PennyLaneQiskit

量子神经网络:从理论到实践1.量子神经网络简介量子神经网络(QuantumNeuralNetworks,QNNs)是量子计算与经典机器学习相

- 深度神经网络课程设计:从理论到实践

Vita Libre

本文还有配套的精品资源,点击获取简介:深度神经网络是深度学习预测的核心技术,本课程设计项目旨在教授学生如何构建和应用深度神经网络进行各种预测任务,包括图像识别和自然语言处理。学生将通过源代码示例学习从网络架构设计、数据预处理到模型训练与评估的完整流程,并掌握深度学习的基本概念、组件及技巧。1.深度神经网络定义和在深度学习预测中的角色深度神经网络(DeepNeuralNetworks,DNNs)是深

- 深度学习基础与应用:从理论到实战

创新工场

本文还有配套的精品资源,点击获取简介:深度学习是人工智能的核心分支,通过模拟人脑神经网络处理大量数据以执行复杂任务。Python因其简洁性和强大的库支持成为深度学习研究的首选语言。本文概述了深度学习基础概念、核心算法、Python框架,并假设了一个包含教程、示例代码、数据集、交互式学习环境、性能评估指标和进阶主题的“deep-learning-study-main”压缩包内容,旨在帮助学习者深入理

- 深层神经网络:原理与传播机制详解

网安spinage

深度学习神经网络人工智能机器学习深度学习

网络架构概述本文探讨的深层神经网络结构如下:输入层:3个神经元第一隐藏层:5个神经元第二隐藏层:5个神经元第三隐藏层:3个神经元输出层:1个神经元输出层隐藏层3隐藏层2隐藏层1输入层输出神经元3.1神经元3.2神经元3.3神经元2.1神经元2.2神经元2.3神经元2.4神经元2.5神经元1.1神经元1.2神经元1.3神经元1.4神经元1.5输入1输入2输入3数学符号定义符号含义维度XXX输入数据3

- 大模型与智能体:螺旋共生,绘就智能新蓝图

东锋17

人工智能大模型智能体人工智能

大模型与智能体:螺旋共生,绘就智能新蓝图在人工智能的前沿领域,大模型与智能体宛如两颗璀璨的星辰,以一种精妙的螺旋共生关系,重塑着智能世界的格局,深刻影响着我们生活与工作的方方面面。大模型:构筑智能大厦的基石大语言模型,像广为人知的GPT-4、通义千问等,凭借在海量数据中深度学习的锤炼,展现出卓越的语言理解与生成天赋。它们就像知识渊博的学者,能熟练应对各类自然语言任务。无论是洋洋洒洒的文章创作,还是

- 深度学习之迁移学习

路溪非溪

人工智能迁移学习机器学习

认识迁移学习迁移学习(TransferLearning)是机器学习中的一种重要技术,其核心思想是将在一个任务上学习到的知识(模型参数、特征表示等),迁移应用到另一个相关但不同的任务中,从而提升新任务的学习效率和性能,尤其是在新任务数据有限的情况下。一、迁移学习的核心动机传统机器学习通常要求为每个新任务收集大量标注数据并从头训练模型,但现实中面临以下挑战:数据稀缺:例如医疗影像分析(罕见疾病样本少)

- 【机器学习】解密计算机视觉:CNN、目标检测与图像识别核心技术(第25天)

吴师兄大模型

0基础实现机器学习入门到精通机器学习计算机视觉cnn人工智能目标检测图像识别pytorch

Langchain系列文章目录01-玩转LangChain:从模型调用到Prompt模板与输出解析的完整指南02-玩转LangChainMemory模块:四种记忆类型详解及应用场景全覆盖03-全面掌握LangChain:从核心链条构建到动态任务分配的实战指南04-玩转LangChain:从文档加载到高效问答系统构建的全程实战05-玩转LangChain:深度评估问答系统的三种高效方法(示例生成、手

- 【深度学习-Day 35】实战图像数据增强:用PyTorch和TensorFlow扩充你的数据集

吴师兄大模型

深度学习入门到精通深度学习pytorchtensorflow人工智能python大模型LLM

Langchain系列文章目录01-玩转LangChain:从模型调用到Prompt模板与输出解析的完整指南02-玩转LangChainMemory模块:四种记忆类型详解及应用场景全覆盖03-全面掌握LangChain:从核心链条构建到动态任务分配的实战指南04-玩转LangChain:从文档加载到高效问答系统构建的全程实战05-玩转LangChain:深度评估问答系统的三种高效方法(示例生成、手

- 【深度学习】【入门】Linear和flatten

学习中的阿陈

深度学习人工智能

1.Linear1.Linear的概念Linear层,通常也被称为全连接层,是神经网络中一种经典且基础的层结构。它的核心特点是每一个神经元都与上一层的所有神经元相连接,这种全连接的方式使得信息能够在层与层之间充分传递和整合2.Linear层的作用Linear层在神经网络中主要承担着特征整合与输出映射的重任。在经过卷积、池化等层提取出数据的局部特征后,Linear层能够将这些分散的局部特征进行整合,

- SQL的各种连接查询

xieke90

UNION ALLUNION外连接内连接JOIN

一、内连接

概念:内连接就是使用比较运算符根据每个表共有的列的值匹配两个表中的行。

内连接(join 或者inner join )

SQL语法:

select * fron

- java编程思想--复用类

百合不是茶

java继承代理组合final类

复用类看着标题都不知道是什么,再加上java编程思想翻译的比价难懂,所以知道现在才看这本软件界的奇书

一:组合语法:就是将对象的引用放到新类中即可

代码:

package com.wj.reuse;

/**

*

* @author Administrator 组

- [开源与生态系统]国产CPU的生态系统

comsci

cpu

计算机要从娃娃抓起...而孩子最喜欢玩游戏....

要让国产CPU在国内市场形成自己的生态系统和产业链,国家和企业就不能够忘记游戏这个非常关键的环节....

投入一些资金和资源,人力和政策,让游

- JVM内存区域划分Eden Space、Survivor Space、Tenured Gen,Perm Gen解释

商人shang

jvm内存

jvm区域总体分两类,heap区和非heap区。heap区又分:Eden Space(伊甸园)、Survivor Space(幸存者区)、Tenured Gen(老年代-养老区)。 非heap区又分:Code Cache(代码缓存区)、Perm Gen(永久代)、Jvm Stack(java虚拟机栈)、Local Method Statck(本地方法栈)。

HotSpot虚拟机GC算法采用分代收

- 页面上调用 QQ

oloz

qq

<A href="tencent://message/?uin=707321921&Site=有事Q我&Menu=yes">

<img style="border:0px;" src=http://wpa.qq.com/pa?p=1:707321921:1></a>

- 一些问题

文强chu

问题

1.eclipse 导出 doc 出现“The Javadoc command does not exist.” javadoc command 选择 jdk/bin/javadoc.exe 2.tomcate 配置 web 项目 .....

SQL:3.mysql * 必须得放前面 否则 select&nbs

- 生活没有安全感

小桔子

生活孤独安全感

圈子好小,身边朋友没几个,交心的更是少之又少。在深圳,除了男朋友,没几个亲密的人。不知不觉男朋友成了唯一的依靠,毫不夸张的说,业余生活的全部。现在感情好,也很幸福的。但是说不准难免人心会变嘛,不发生什么大家都乐融融,发生什么很难处理。我想说如果不幸被分手(无论原因如何),生活难免变化很大,在深圳,我没交心的朋友。明

- php 基础语法

aichenglong

php 基本语法

1 .1 php变量必须以$开头

<?php

$a=” b”;

echo

?>

1 .2 php基本数据库类型 Integer float/double Boolean string

1 .3 复合数据类型 数组array和对象 object

1 .4 特殊数据类型 null 资源类型(resource) $co

- mybatis tools 配置详解

AILIKES

mybatis

MyBatis Generator中文文档

MyBatis Generator中文文档地址:

http://generator.sturgeon.mopaas.com/

该中文文档由于尽可能和原文内容一致,所以有些地方如果不熟悉,看中文版的文档的也会有一定的障碍,所以本章根据该中文文档以及实际应用,使用通俗的语言来讲解详细的配置。

本文使用Markdown进行编辑,但是博客显示效

- 继承与多态的探讨

百合不是茶

JAVA面向对象 继承 对象

继承 extends 多态

继承是面向对象最经常使用的特征之一:继承语法是通过继承发、基类的域和方法 //继承就是从现有的类中生成一个新的类,这个新类拥有现有类的所有extends是使用继承的关键字:

在A类中定义属性和方法;

class A{

//定义属性

int age;

//定义方法

public void go

- JS的undefined与null的实例

bijian1013

JavaScriptJavaScript

<form name="theform" id="theform">

</form>

<script language="javascript">

var a

alert(typeof(b)); //这里提示undefined

if(theform.datas

- TDD实践(一)

bijian1013

java敏捷TDD

一.TDD概述

TDD:测试驱动开发,它的基本思想就是在开发功能代码之前,先编写测试代码。也就是说在明确要开发某个功能后,首先思考如何对这个功能进行测试,并完成测试代码的编写,然后编写相关的代码满足这些测试用例。然后循环进行添加其他功能,直到完全部功能的开发。

- [Maven学习笔记十]Maven Profile与资源文件过滤器

bit1129

maven

什么是Maven Profile

Maven Profile的含义是针对编译打包环境和编译打包目的配置定制,可以在不同的环境上选择相应的配置,例如DB信息,可以根据是为开发环境编译打包,还是为生产环境编译打包,动态的选择正确的DB配置信息

Profile的激活机制

1.Profile可以手工激活,比如在Intellij Idea的Maven Project视图中可以选择一个P

- 【Hive八】Hive用户自定义生成表函数(UDTF)

bit1129

hive

1. 什么是UDTF

UDTF,是User Defined Table-Generating Functions,一眼看上去,貌似是用户自定义生成表函数,这个生成表不应该理解为生成了一个HQL Table, 貌似更应该理解为生成了类似关系表的二维行数据集

2. 如何实现UDTF

继承org.apache.hadoop.hive.ql.udf.generic

- tfs restful api 加auth 2.0认计

ronin47

目前思考如何给tfs的ngx-tfs api增加安全性。有如下两点:

一是基于客户端的ip设置。这个比较容易实现。

二是基于OAuth2.0认证,这个需要lua,实现起来相对于一来说,有些难度。

现在重点介绍第二种方法实现思路。

前言:我们使用Nginx的Lua中间件建立了OAuth2认证和授权层。如果你也有此打算,阅读下面的文档,实现自动化并获得收益。SeatGe

- jdk环境变量配置

byalias

javajdk

进行java开发,首先要安装jdk,安装了jdk后还要进行环境变量配置:

1、下载jdk(http://java.sun.com/javase/downloads/index.jsp),我下载的版本是:jdk-7u79-windows-x64.exe

2、安装jdk-7u79-windows-x64.exe

3、配置环境变量:右击"计算机"-->&quo

- 《代码大全》表驱动法-Table Driven Approach-2

bylijinnan

java

package com.ljn.base;

import java.io.BufferedReader;

import java.io.FileInputStream;

import java.io.InputStreamReader;

import java.util.ArrayList;

import java.util.Collections;

import java.uti

- SQL 数值四舍五入 小数点后保留2位

chicony

四舍五入

1.round() 函数是四舍五入用,第一个参数是我们要被操作的数据,第二个参数是设置我们四舍五入之后小数点后显示几位。

2.numeric 函数的2个参数,第一个表示数据长度,第二个参数表示小数点后位数。

例如:

select cast(round(12.5,2) as numeric(5,2))

- c++运算符重载

CrazyMizzz

C++

一、加+,减-,乘*,除/ 的运算符重载

Rational operator*(const Rational &x) const{

return Rational(x.a * this->a);

}

在这里只写乘法的,加减除的写法类似

二、<<输出,>>输入的运算符重载

&nb

- hive DDL语法汇总

daizj

hive修改列DDL修改表

hive DDL语法汇总

1、对表重命名

hive> ALTER TABLE table_name RENAME TO new_table_name;

2、修改表备注

hive> ALTER TABLE table_name SET TBLPROPERTIES ('comment' = new_comm

- jbox使用说明

dcj3sjt126com

Web

参考网址:http://www.kudystudio.com/jbox/jbox-demo.html jBox v2.3 beta [

点击下载]

技术交流QQGroup:172543951 100521167

[2011-11-11] jBox v2.3 正式版

- [调整&修复] IE6下有iframe或页面有active、applet控件

- UISegmentedControl 开发笔记

dcj3sjt126com

// typedef NS_ENUM(NSInteger, UISegmentedControlStyle) {

// UISegmentedControlStylePlain, // large plain

&

- Slick生成表映射文件

ekian

scala

Scala添加SLICK进行数据库操作,需在sbt文件上添加slick-codegen包

"com.typesafe.slick" %% "slick-codegen" % slickVersion

因为我是连接SQL Server数据库,还需添加slick-extensions,jtds包

"com.typesa

- ES-TEST

gengzg

test

package com.MarkNum;

import java.io.IOException;

import java.util.Date;

import java.util.HashMap;

import java.util.Map;

import javax.servlet.ServletException;

import javax.servlet.annotation

- 为何外键不再推荐使用

hugh.wang

mysqlDB

表的关联,是一种逻辑关系,并不需要进行物理上的“硬关联”,而且你所期望的关联,其实只是其数据上存在一定的联系而已,而这种联系实际上是在设计之初就定义好的固有逻辑。

在业务代码中实现的时候,只要按照设计之初的这种固有关联逻辑来处理数据即可,并不需要在数据库层面进行“硬关联”,因为在数据库层面通过使用外键的方式进行“硬关联”,会带来很多额外的资源消耗来进行一致性和完整性校验,即使很多时候我们并不

- 领域驱动设计

julyflame

VODAO设计模式DTOpo

概念:

VO(View Object):视图对象,用于展示层,它的作用是把某个指定页面(或组件)的所有数据封装起来。

DTO(Data Transfer Object):数据传输对象,这个概念来源于J2EE的设计模式,原来的目的是为了EJB的分布式应用提供粗粒度的数据实体,以减少分布式调用的次数,从而提高分布式调用的性能和降低网络负载,但在这里,我泛指用于展示层与服务层之间的数据传输对

- 单例设计模式

hm4123660

javaSingleton单例设计模式懒汉式饿汉式

单例模式是一种常用的软件设计模式。在它的核心结构中只包含一个被称为单例类的特殊类。通过单例模式可以保证系统中一个类只有一个实例而且该实例易于外界访问,从而方便对实例个数的控制并节约系统源。如果希望在系统中某个类的对象只能存在一个,单例模式是最好的解决方案。

&nb

- logback

zhb8015

loglogback

一、logback的介绍

Logback是由log4j创始人设计的又一个开源日志组件。logback当前分成三个模块:logback-core,logback- classic和logback-access。logback-core是其它两个模块的基础模块。logback-classic是log4j的一个 改良版本。此外logback-class

- 整合Kafka到Spark Streaming——代码示例和挑战

Stark_Summer

sparkstormzookeeperPARALLELISMprocessing

作者Michael G. Noll是瑞士的一位工程师和研究员,效力于Verisign,是Verisign实验室的大规模数据分析基础设施(基础Hadoop)的技术主管。本文,Michael详细的演示了如何将Kafka整合到Spark Streaming中。 期间, Michael还提到了将Kafka整合到 Spark Streaming中的一些现状,非常值得阅读,虽然有一些信息在Spark 1.2版

- spring-master-slave-commondao

王新春

DAOspringdataSourceslavemaster

互联网的web项目,都有个特点:请求的并发量高,其中请求最耗时的db操作,又是系统优化的重中之重。

为此,往往搭建 db的 一主多从库的 数据库架构。作为web的DAO层,要保证针对主库进行写操作,对多个从库进行读操作。当然在一些请求中,为了避免主从复制的延迟导致的数据不一致性,部分的读操作也要到主库上。(这种需求一般通过业务垂直分开,比如下单业务的代码所部署的机器,读去应该也要从主库读取数