大数据入门概念及应用场景

参考内容:

【知乎】深入浅出大数据:到底什么是Hadoop?

【知乎】五万字 | Hive知识体系保姆级教程

大数据入门概念及应用场景

-

- 一、入门概念

-

- 1.1 大数据的4V

- 1.2 大数据处理的最佳工具--Hadoop

- 1.3 Hadoop的核心架构

- 二、一些重要的知识点

-

- 2.1 HDFS

-

- 2.1.1 HDFS的写入流程

- 2.1.2 HDFS的读取流程

- 2.1.3 Hadoop1.0版本与2.0版本

- 2.1.4 Hadoop的生态圈

- 2.1.5 Hadoop的优点和应用

- 2.2 HIVE

-

- 2.2.1 为什么使用hive

- 2.2.2 hive的特点

- 2.2.3 hive的架构

- 2.2.5 hive的数据存储

- 三、大数据应用场景

-

- 3.1 数据价值

- 3.2 行业案例

- 四、平台使用

一、入门概念

1.1 大数据的4V

- Volume(体积)

- Variety (多样)

- Velocity(效率)

- Veracity( Value,价值)

Veracity( Value,价值):数据的体积并不能决定其是否对决策产生帮助,数据的重要性就在于对决策的支持,并产生价值。

1.2 大数据处理的最佳工具–Hadoop

- 由 Doug Cutting所发起的开源分布式计算框架

- 储存并处理海量结构与非结构信息

- 执行数据分析程序于分布式系统上

- 简化分布式系统的管理与资源调度

- 线性化的扩充能力

- 高可用性与容错性

1.3 Hadoop的核心架构

Hadoop的核心,说白了,就是HDFS和MapReduce。HDFS为海量数据提供了存储,而MapReduce为海量数据提供了计算框架。

二、一些重要的知识点

2.1 HDFS

整个HDFS有三个重要角色:NameNode(名称节点)、DataNode(数据节点)和Client(客户机)。

**NameNode:**是Master节点(主节点),可以看作是分布式文件系统中的管理者,主要负责管理文件系统的命名空间、集群配置信息和存储块的复制等。NameNode会将文件系统的Meta-data存储在内存中,这些信息主要包括了文件信息、每一个文件对应的文件块的信息和每一个文件块在DataNode的信息等。

**DataNode:**是Slave节点(从节点),是文件存储的基本单元,它将Block存储在本地文件系统中,保存了Block的Meta-data,同时周期性地将所有存在的Block信息发送给NameNode。

**Client:**切分文件;访问HDFS;与NameNode交互,获得文件位置信息;与DataNode交互,读取和写入数据。

还有一个**Block(块)**的概念:Block是HDFS中的基本读写单元;HDFS中的文件都是被切割为block(块)进行存储的;这些块被复制到多个DataNode中;块的大小(通常为64MB)和复制的块数量在创建文件时由Client决定。

2.1.1 HDFS的写入流程

- 用户向Client(客户机)提出请求。例如,需要写入200MB的数据。

- Client制定计划:将数据按照64MB为块,进行切割;所有的块都保存三份。

- Client将大文件切分成块(block)。

- 针对第一个块,Client告诉NameNode(主控节点),请帮助我,将64MB的块复制三份。

- NameNode告诉Client三个DataNode(数据节点)的地址,并且将它们根据到Client的距离,进行了排序。

- Client把数据和清单发给第一个DataNode。

- 第一个DataNode将数据复制给第二个DataNode。

- 第二个DataNode将数据复制给第三个DataNode。

- 如果某一个块的所有数据都已写入,就会向NameNode反馈已完成。

- 对第二个Block,也进行相同的操作。

- 所有Block都完成后,关闭文件。NameNode会将数据持久化到磁盘上。

2.1.2 HDFS的读取流程

- 用户向Client提出读取请求。

- Client向NameNode请求这个文件的所有信息。

- NameNode将给Client这个文件的块列表,以及存储各个块的数据节点清单(按照和客户端的距离排序)。

- Client从距离最近的数据节点下载所需的块。

2.1.3 Hadoop1.0版本与2.0版本

2011年11月,Hadoop 1.0.0版本正式发布,意味着可以用于商业化。

但是,1.0版本中,存在一些问题:

- 扩展性差,JobTracker负载较重,成为性能瓶颈。

- 可靠性差,NameNode只有一个,万一挂掉,整个系统就会崩溃。

- 仅适用MapReduce一种计算方式。

- 资源管理的效率比较低。

所以,2012年5月,Hadoop推出了 **2.0版本 。

2.0版本中,在HDFS之上,增加了YARN(资源管理框架)**层。它是一个资源管理模块,为各类应用程序提供资源管理和调度。

此外,2.0版本还提升了系统的安全稳定性。

所以,后来行业里基本上都是使用2.0版本。目前Hadoop又进一步发展到3.X版本。

2.1.4 Hadoop的生态圈

在整个Hadoop架构中,计算框架起到承上启下的作用,一方面可以操作HDFS中的数据,另一方面可以被封装,提供Hive、Pig这样的上层组件的调用。

我们简单介绍一下其中几个比较重要的组件。

HBase:来源于Google的BigTable;是一个高可靠性、高性能、面向列、可伸缩的分布式数据库。

Hive:是一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,通过类SQL语句快速实现简单的MapReduce统计,不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

Pig:是一个基于Hadoop的大规模数据分析工具,它提供的SQL-LIKE语言叫Pig Latin,该语言的编译器会把类SQL的数据分析请求转换为一系列经过优化处理的MapReduce运算。

ZooKeeper:来源于Google的Chubby;它主要是用来解决分布式应用中经常遇到的一些数据管理问题,简化分布式应用协调及其管理的难度。

Ambari:Hadoop管理工具,可以快捷地监控、部署、管理集群。

Sqoop:用于在Hadoop与传统的数据库间进行数据的传递。

Mahout:一个可扩展的机器学习和数据挖掘库。

2.1.5 Hadoop的优点和应用

总的来看,Hadoop有以下优点:

高可靠性:这个是由它的基因决定的。它的基因来自Google。Google最擅长的事情,就是“垃圾利用”。Google起家的时候就是穷,买不起高端服务器,所以,特别喜欢在普通电脑上部署这种大型系统。虽然硬件不可靠,但是系统非常可靠。

高扩展性:Hadoop是在可用的计算机集群间分配数据并完成计算任务的,这些集群可以方便地进行扩展。说白了,想变大很容易。

高效性:Hadoop能够在节点之间动态地移动数据,并保证各个节点的动态平衡,因此处理速度非常快。

高容错性:Hadoop能够自动保存数据的多个副本,并且能够自动将失败的任务重新分配。这个其实也算是高可靠性。

低成本:Hadoop是开源的,依赖于社区服务,使用成本比较低。

基于这些优点,Hadoop适合应用于大数据存储和大数据分析的应用,适合于服务器几千台到几万台的集群运行,支持PB级的存储容量。

Hadoop的应用非常广泛,包括:搜索、日志处理、推荐系统、数据分析、视频图像分析、数据保存等,都可以使用它进行部署。

2.2 HIVE

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供类SQL查询功能。

其本质是将SQL转换为MapReduce/Spark的任务进行运算,底层由HDFS来提供数据的存储,说白了hive可以理解为一个将SQL转换为MapReduce/Spark的任务的工具,甚至更进一步可以说hive就是一个MapReduce/Spark Sql的客户端

2.2.1 为什么使用hive

- 学习MapReduce的成本比较高, 项目周期要求太短, MapReduce如果要实现复杂的查询逻辑开发的难度是比较大的。

- 而如果使用hive, hive采用操作接口类似SQL语法, 提高快速开发的能力. 避免去书写MapReduce,减少学习成本, 而且提供了功能的扩展

2.2.2 hive的特点

- 可扩展 : Hive可以自由的扩展集群的规模,一般情况下不需要重启服务。

- 延展性 : Hive支持用户自定义函数,用户可以根据自己的需求来实现自己的函数。

- 容错 : 良好的容错性,节点出现问题SQL仍可完成执行。

2.2.3 hive的架构

基本组成:

用户接口:包括CLI、JDBC/ODBC、WebGUI。其中,CLI(command line interface)为shell命令行;JDBC/ODBC是Hive的JAVA实现,与传统数据库JDBC类似;WebGUI是通过浏览器访问Hive。

元数据存储:通常是存储在关系数据库如mysql/derby中。Hive 将元数据存储在数据库中。Hive 中的元数据包括表的名字,表的列和分区及其属性,表的属性(是否为外部表等),表的数据所在目录等。

解释器、编译器、优化器、执行器:完成HQL 查询语句从词法分析、语法分析、编译、优化以及查询计划的生成。生成的查询计划存储在HDFS 中,并在随后有MapReduce 调用执行。

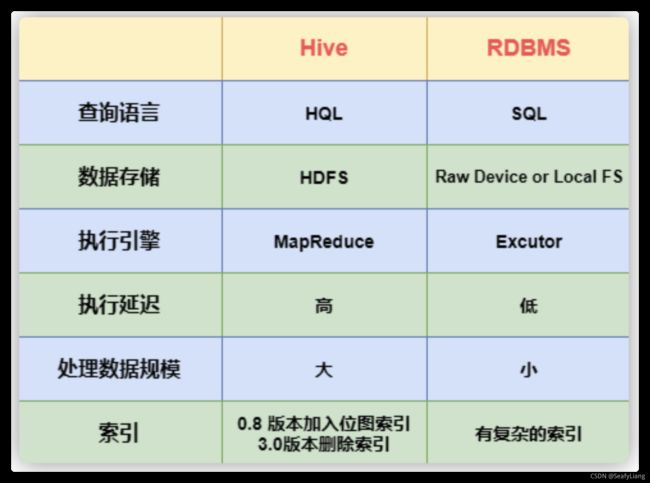

2.2.4 hive与传统数据库对比

hive主要是用于海量数据的离线数据分析

- 查询语言。由于 SQL 被广泛的应用在数据仓库中,因此,专门针对 Hive 的特性设计了类 SQL 的查询语言 HQL。熟悉 SQL 开发的开发者可以很方便的使用 Hive 进行开发。

- 数据存储位置。Hive 是建立在 Hadoop 之上的,所有 Hive 的数据都是存储在 HDFS 中的。而数据库则可以将数据保存在块设备或者本地文件系统中。

- 数据格式。Hive 中没有定义专门的数据格式,数据格式可以由用户指定,用户定义数据格式需要指定三个属性:列分隔符(通常为空格、”\t”、”\x001″)、行分隔符(”\n”)以及读取文件数据的方法(Hive 中默认有三个文件格式 TextFile,SequenceFile 以及 RCFile)。由于在加载数据的过程中,不需要从用户数据格式到 Hive 定义的数据格式的转换,因此,Hive 在加载的过程中不会对数据本身进行任何修改,而只是将数据内容复制或者移动到相应的 HDFS 目录中。而在数据库中,不同的数据库有不同的存储引擎,定义了自己的数据格式。所有数据都会按照一定的组织存储,因此,数据库加载数据的过程会比较耗时。

- 数据更新。由于 Hive 是针对数据仓库应用设计的,而数据仓库的内容是读多写少的。因此,Hive 中不支持对数据的改写和添加,所有的数据都是在加载的时候中确定好的。而数据库中的数据通常是需要经常进行修改的,因此可以使用 INSERT INTO … VALUES 添加数据,使用 UPDATE … SET 修改数据。

- 索引。之前已经说过,Hive 在加载数据的过程中不会对数据进行任何处理,甚至不会对数据进行扫描,因此也没有对数据中的某些 Key 建立索引。Hive 要访问数据中满足条件的特定值时,需要暴力扫描整个数据,因此访问延迟较高。由于 MapReduce 的引入, Hive 可以并行访问数据,因此即使没有索引,对于大数据量的访问,Hive 仍然可以体现出优势。数据库中,通常会针对一个或者几个列建立索引,因此对于少量的特定条件的数据的访问,数据库可以有很高的效率,较低的延迟。由于数据的访问延迟较高,决定了 Hive 不适合在线数据查询。

- 执行。Hive 中大多数查询的执行是通过 Hadoop 提供的 MapReduce 来实现的,而数据库通常有自己的执行引擎。

- 执行延迟。之前提到,Hive 在查询数据的时候,由于没有索引,需要扫描整个表,因此延迟较高。另外一个导致 Hive 执行延迟高的因素是 MapReduce 框架。由于 MapReduce 本身具有较高的延迟,因此在利用 MapReduce 执行 Hive 查询时,也会有较高的延迟。相对的,数据库的执行延迟较低。当然,这个低是有条件的,即数据规模较小,当数据规模大到超过数据库的处理能力的时候,Hive 的并行计算显然能体现出优势。

- 可扩展性。由于 Hive 是建立在 Hadoop 之上的,因此 Hive 的可扩展性是和 Hadoop 的可扩展性是一致的(世界上最大的 Hadoop 集群在 Yahoo!,2009年的规模在 4000 台节点左右)。而数据库由于 ACID 语义的严格限制,扩展行非常有限。目前最先进的并行数据库 Oracle 在理论上的扩展能力也只有 100 台左右。

- 数据规模。由于 Hive 建立在集群上并可以利用 MapReduce 进行并行计算,因此可以支持很大规模的数据;对应的,数据库可以支持的数据规模较小。

总结:hive具有sql数据库的外表,但应用场景完全不同,hive只适合用来做批量数据统计分析。

2.2.5 hive的数据存储

- Hive中所有的数据都存储在 HDFS 中,没有专门的数据存储格式(可支持Text,SequenceFile,ParquetFile,ORC格式RCFILE等)

SequenceFile是hadoop中的一种文件格式: 文件内容是以序列化的kv对象来组织的

- 只需要在创建表的时候告诉 Hive 数据中的列分隔符和行分隔符,Hive 就可以解析数据。

- Hive 中包含以下数据模型:DB、Table,External Table,Partition,Bucket。

- db:在hdfs中表现为hive.metastore.warehouse.dir目录下一个文件夹。

- table:在hdfs中表现所属db目录下一个文件夹。

- external table:与table类似,不过其数据存放位置可以在任意指定路径。

- partition:在hdfs中表现为table目录下的子目录。

- bucket:在hdfs中表现为同一个表目录下根据hash散列之后的多个文件。