[云原生k8s] Kubeadm搭建K8S集群

目录

一、部署步骤

二、实验环境

1、所有节点,关闭防火墙规则,关闭selinux,关闭swap交换

2、修改主机名,并写入三台服务器的host中

3、调整内核参数

4、所有节点安装Docker

5、所有节点配置k8s源

6、所有节点安装kubeadm、kubelet和kubectl

7、部署kubernetes Mater节点(master节点上执行)

8、token制作

9、k8s-node节点加入master节点(两个node节点执行)

10、master节点安装部署pod网络插件(flannel)

11.给node节点添加标签

12、master检查

13、再次查询服务是否正常

14、测试k8s集群,在集群中创建pod,验证是否能正常运行

一、部署步骤

在所有节点上安装Docker和kubeadm

部署Kubernetes Master

部署容器网络插件

部署 Kubernetes Node,将节点加入Kubernetes集群中

部署 Dashboard Web 页面,可视化查看Kubernetes资源

二、实验环境

| 服务器类型 | IP地址 |

|---|---|

| master | 192.168.80.70 |

| node01 | 192.168.80.80 |

| node02 | 192.168.80.90 |

1、所有节点,关闭防火墙规则,关闭selinux,关闭swap交换

#所有节点,关闭防火墙规则,关闭selinux,关闭swap交换

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X

swapoff -a #交换分区必须要关闭(临时)

sed -ri 's/.*swap.*/#&/' /etc/fstab #永久关闭swap分区,&符号在sed命令中代表上次匹配的结果

2、修改主机名,并写入三台服务器的host中

cat >> /etc/hosts << EOF

192.168.80.70 master

192.168.80.80 node01

192.168.80.90 node02

EOF3、调整内核参数

将桥接得IPV4流量传递到iptables链(三台都执行)

#调整内核参数

cat > /etc/sysctl.d/kubernetes.conf << EOF

#开启网桥模式,可将网桥的流量传递给iptables链

net.bridge.bridge-nf-call-ip6tables=1

net.bridge.bridge-nf-call-iptables=1

#关闭ipv6协议

net.ipv6.conf.all.disable_ipv6=1

net.ipv4.ip_forward=1

EOF

#加载参数

sysctl --system

4、所有节点安装Docker

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io

mkdir /etc/docker

cat > /etc/docker/daemon.json <5、所有节点配置k8s源

#定义kubernetes源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

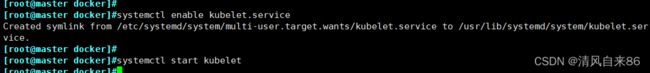

6、所有节点安装kubeadm、kubelet和kubectl

yum install -y kubelet-1.21.3 kubeadm-1.21.3 kubectl-1.21.3

#开机自启kubelet

systemctl enable kubelet.service

systemctl start kubelet

#K8S通过kubeadm安装出来以后都是以Pod方式存在,即底层是以容器方式运行,所以kubelet必须设置开机自启

7、部署kubernetes Mater节点(master节点上执行)

kubeadm init \

--apiserver-advertise-address=192.168.80.70 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version v1.21.3 \

--service-cidr=10.96.0.0/12 \

--pod-network-cidr=10.244.0.0/16参数说明

kubeadm init \

--apiserver-advertise-address=10.0.0.116 \ #指定master监听的地址,修改为自己的master地址

--image-repository registry.aliyuncs.com/google_containers \ #指定为aliyun的下载源

--kubernetes-version v1.18.0 \ #指定k8s版本,1.18.0版本比较稳定

--service-cidr=10.96.0.0/12 \ #设置集群内部的网络

--pod-network-cidr=10.244.0.0/16 #设置pod的网络

# service-cidr 和 pod-network-cidr 最好就用这个,不然需要修改后面的 kube-flannel.yaml 文件

执行以下命令可使用kubectl管理工具

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

8、token制作

node 节点加入集群需要生成的 token,token 有效期为 24 小时,过期需要重新创建

创建命令为

kubeadm token create --print-join-command

9、k8s-node节点加入master节点(两个node节点执行)

#拿前面创建好的token令牌

kubeadm join 192.168.80.70:6443 --token 9loncr.rhncodpmpnjhf8l3 --discovery-token-ca-cert-hash sha256:68160bdc54caf5215a7fd90231e3483b2db425799ac68e1b6e3849e62b269f10

主节点查看

kubectl get node节点显示 NotReady 状态,需要安装网络插件

token 过期重新生成 token

kubeadm token create --print-join-command

10、master节点安装部署pod网络插件(flannel)

下载插件yaml插件

#github仓库下载

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

#国内站点下载证书

wget http://120.78.77.38/file/kube-flannel.yaml

#安装

kubectl apply -f kube-flannel.yaml

kubectl get node 查看node状态

kubectl get pods -A

#查询master是否正常

kubectl get cs

#若为unhealthy

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

#将- --port=0注释掉11.给node节点添加标签

kubectl label node node01 node-role.kubernetes.io/node=node1

kubectl label node node02 node-role.kubernetes.io/node=node2

#获取节点信息

kubectl get nodes12、master检查

#查询master是否正常

kubectl get cs

#若为unhealthy

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

#将- --port=0注释掉

13、再次查询服务是否正常

监测K8s集群是否正常后,再运行服务部署

#查询所有pod是否正常运行

kubectl get pods -A

#查询master是否正常

kubectl get cs

#查询node节点是否ready

kubectl get nodes

14、测试k8s集群,在集群中创建pod,验证是否能正常运行

#部署服务

kubectl create deployment nginx --image=nginx

#暴露端口

kubectl expose deployment nginx --port=80 --type=NodePort

kubectl get pods

kubectl get svc(service)

#删除pod与svc

kubectl delete deploy/nginx

kubectl delete svc/nginx

测试一下,master和node都能通过自己IP的30282端口去访问

![[云原生k8s] Kubeadm搭建K8S集群_第1张图片](http://img.e-com-net.com/image/info8/be544d504fee4eda9eef387c4fbc5ac7.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第2张图片](http://img.e-com-net.com/image/info8/488fd022d7574737bcb5f0e92ed1c36b.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第3张图片](http://img.e-com-net.com/image/info8/5724b2f706ce46daae0a38ebf692049e.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第4张图片](http://img.e-com-net.com/image/info8/899ca593800f4cf6bb784b1b0b9c7d61.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第5张图片](http://img.e-com-net.com/image/info8/caa94e62515246949c293f217fa8dfe6.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第6张图片](http://img.e-com-net.com/image/info8/1052cf6e48e44189bb58e384e9283828.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第7张图片](http://img.e-com-net.com/image/info8/9e41b81c7f1e42e6971feda637fb5039.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第8张图片](http://img.e-com-net.com/image/info8/69baac0916644774895eab447d78da6e.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第9张图片](http://img.e-com-net.com/image/info8/a57c4abf65ed438b852aaf22a44d8ea9.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第10张图片](http://img.e-com-net.com/image/info8/a9dcf9b47d0e48d4b9bcaa5226635ea5.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第11张图片](http://img.e-com-net.com/image/info8/a4257286bc9141a0a6bb5ed00faa32f5.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第12张图片](http://img.e-com-net.com/image/info8/7adda8f62037478b8b453d8a836d0b17.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第13张图片](http://img.e-com-net.com/image/info8/4b79a2d76bc94fba96caa68e69314e49.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第14张图片](http://img.e-com-net.com/image/info8/51c59c65f9f64982b959278c94888583.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第15张图片](http://img.e-com-net.com/image/info8/7e023b17fde34beebb3b7c9c1cd577e1.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第16张图片](http://img.e-com-net.com/image/info8/c708608648074240ab010ef4ea0dd58c.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第17张图片](http://img.e-com-net.com/image/info8/f58a0b58159d430e9f73659bf5194c4b.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第18张图片](http://img.e-com-net.com/image/info8/5c83ca3e8e9e4a4fbd693db08d201b75.jpg)

![[云原生k8s] Kubeadm搭建K8S集群_第19张图片](http://img.e-com-net.com/image/info8/ff1bb8ee970042e1afe1f5a3de5cc611.jpg)