Spark-SQL连接Hive 的五种方法

Spark-SQL连接Hive

Apache Hive 是 Hadoop 上的 SQL 引擎,Spark SQL 编译时可以包含 Hive 支持,也可以不包含。包含 Hive 支持的 Spark SQL 可以支持 Hive 表访问、UDF (用户自定义函数)、Hive 查询语言(HQL)等。需要强调的一点是,如果要在 Spark SQL 中包含Hive 的库,并不需要事先安装 Hive。一般来说,最好还是在编译 Spark SQL 时引入 Hive支持,这样就可以使用这些特性了。

使用方式分为内嵌Hive、外部Hive、Spark-SQL CLI、Spark beeline 以及代码操作。

第一种方法:内嵌的 HIVE

如果使用 Spark 内嵌的 Hive, 则什么都不用做, 直接使用即可。但是在实际生产活动当中,几乎没有人去使用内嵌Hive这一模式。

第二种方法:外部的 HIVE

如果想在spark-shell中连接外部已经部署好的 Hive,需要通过以下几个步骤:

1.Spark 要接管 Hive 需要把 hive-site.xml 拷贝到 conf/目录下

2.把 Mysql 的驱动 copy 到 jars/目录下

3.如果访问不到 hdfs,则需要把 core-site.xml 和 hdfs-site.xml 拷贝到 conf/目录下

4.重启 spark-shell

5.到spark的bin目录下打开spark-shell.cmd

6.查询数据库库,表

第三种方法:运行 Spark beeline

Spark Thrift Server 是 Spark 社区基于 HiveServer2 实现的一个 Thrift 服务。旨在无缝兼容HiveServer2。因为 Spark Thrift Server 的接口和协议都和 HiveServer2 完全一致,因此我们部署好 Spark Thrift Server 后,可以直接使用 hive 的 beeline 访问 Spark Thrift Server 执行相关语句。Spark Thrift Server 的目的也只是取代 HiveServer2,因此它依旧可以和 Hive Metastore进行交互,获取到 hive 的元数据。如果想连接 Thrift Server,需要通过以下几个步骤:

1.Spark 要接管 Hive 需要把 hive-site.xml 拷贝到 conf/目录下

![]()

2.把 Mysql 的驱动 copy 到 jars/目录下

3.如果访问不到 hdfs,则需要把 core-site.xml 和 hdfs-site.xml 拷贝到 conf/目录下

sbin/start-thriftserver.sh

5.使用 beeline 连接 Thrift Server

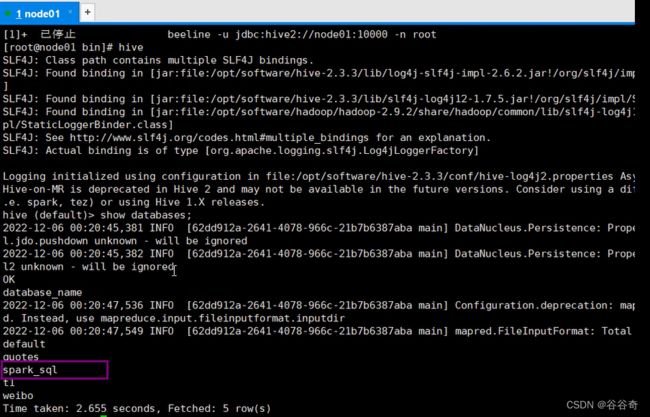

beeline -u jdbc:hive2://node01:10000 -n root

第四种方法:运行Spark-SQL CLI

Spark SQL CLI 可以很方便的在本地运行 Hive 元数据服务以及从命令行执行查询任务。在 Spark 目录下执行如下命令启动 Spark SQL CLI,直接执行 SQL 语句,类似于 Hive 窗口。

操作步骤:

1.将mysql的驱动放入jars/当中;

2.将hive-site.xml文件放入conf/当中;

3.运行bin/目录下的spark-sql.cmd 或者打开cmd,在 D:\spark\spark-3.0.0-bin-hadoop3.2\bin当中直接运行spark-sql

第五种方法:代码操作Hive

1.导入依赖

<dependency>

<groupId>org.apache.sparkgroupId>

<artifactId>spark-hive_2.12artifactId>

<version>3.0.0version>

dependency>

<dependency>

<groupId>org.apache.hivegroupId>

<artifactId>hive-execartifactId>

<version>2.3.3version>

dependency>

2.将hive-site.xml 文件拷贝到项目的 resources 目录中

3.代码实现

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("hive")

val spark:SparkSession = SparkSession.builder()

.enableHiveSupport()

.config(sparkConf)

.getOrCreate()

spark.sql("show databases").show()

spark.sql("create database spark_sql")

spark.sql("show databases").show()

第一个结果是以前存在的数据库,第二个结果是刚刚创建的数据库

到hive里面查看数据库也能查到,没问题的

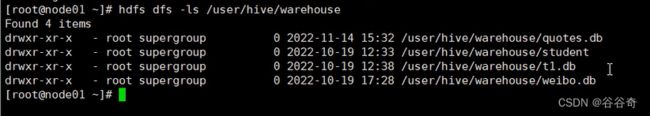

但是到hdfs查看并没有spark-sql内容

只会保存到IDEA本地

将把路径要放入到虚拟机里的话,通过参数修改,添加以下配置

config("spark.sql.warehouse.dir", "hdfs://node01:9000/user/hive/warehouse")

会把对应的数据库删掉,重新创建

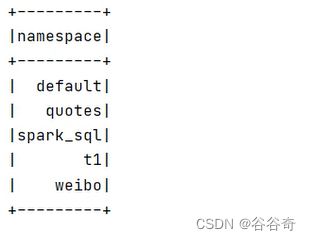

运行结果:

以下是本地仓库里面创建的

以下结果是删掉之后剩下的数据库

以下结果是重新创建之后的数据库

然后再到hdfs查看已经有了