ELK日志分析

目录

ELK简介

日志服务器

日志处理步骤

完整日志系统基本特征

Elasticsearch概述

Elasticsearch核心概念

Logstash介绍

Logstash主要组件

Kibana介绍

Kibana主要功能

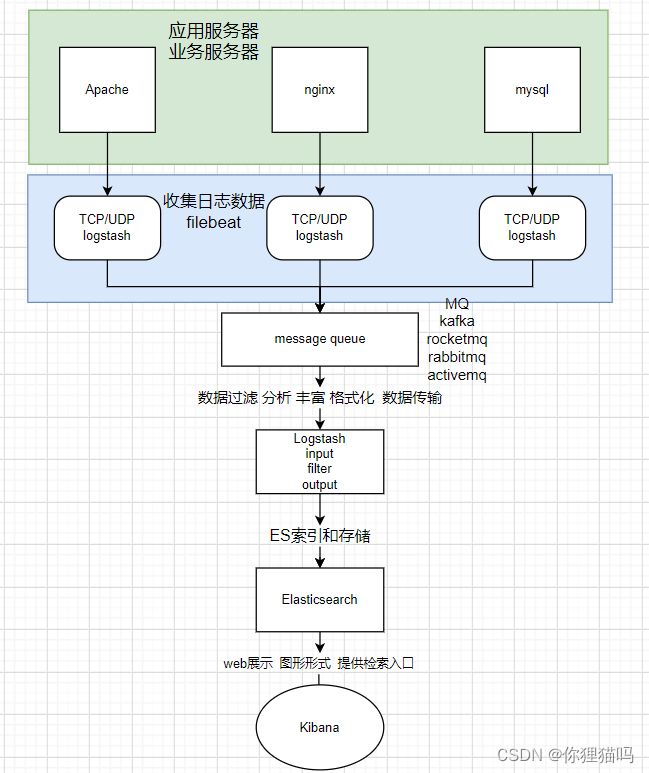

ELK 的工作原理

ELK部署

ELK Elasticsearch集群部署(在node1、node2节点上操作)

安装 Elasticsearch-head 插件

ELK Logstash 部署(在 Apache 节点上操作)

定义 logstash配置文件

ELK Kiabana 部署(在 Node1 节点上操作)

Filebeat+ELK 部署

ELK简介

ELK平台是一套完整的日志集中处理解决方案,将 ElasticSearch、Logstash 和 Kiabana 三个开源工具配合使用, 完成更强大的用户对日志的查询、排序、统计需求。

日志服务器

提高安全性、集中存放日志

缺陷:对日志的分析困难

日志处理步骤

①将日志进行集中化管理

②将日志格式化(Logstash)并输出到Elasticsearch

③对格式化后的数据进行索引和存储(Elasticsearch)

④前段数据的展示(Kibana)

完整日志系统基本特征

收集:能够采集多种来源的日志数据

传输:能够稳定的把日志数据解析过滤并传输到存储系统

存储:存储日志数据

分析:支持 UI 分析

警告:能够提供错误报告,监控机制

Elasticsearch概述

提供了一个分布式多用户能力的全文搜索引擎

Elasticsearch核心概念

接近实时

集群

节点

索引:索引(库)→类型(表)→文档(记录)

分片和副本

Logstash介绍

一款强大的数据处理工具,可实现数据传输、格式处理、格式化输出,数据输入、数据加工(如过滤,改写等)以及数据输出

Logstash主要组件

Shipper 日志收集者

Indexer 日志存储者

Broker 把日志收集者、日志存储者、搜索和存储集合在一起

Search and Storage 搜索和存储

Web Interface 基于web的展示页面

Kibana介绍

一个针对在Elasticsearch的开源分析及可视化平台

搜索、查看存储在Elasticsearch索引中的数据

通过各种图表进行高级数据分析及展示

Kibana主要功能

Elasticsearch无缝之集成

整合数据,复杂数据分析

让更多团队成员受益

接口灵活,分享更容易

配置简单,可视化多数据源

简单数据导出

ELK 的工作原理

①在所有需要收集日志的服务器上部署Logstash;或者先将日志进行集中化管理在日志服务器上,在日志服务器上部署 Logstash。

②Logstash 收集日志,将日志格式化并输出到 Elasticsearch 群集中。

③Elasticsearch 对格式化后的数据进行索引和存储。

④Kibana 从 ES 群集中查询数据生成图表,并进行前端数据的展示。

总结:logstash作为日志搜集器,从数据源采集数据,并对数据进行过滤,格式化处理,然后交由Elasticsearch存储,kibana对日志进行可视化处理。

ELK部署

ELK Elasticsearch集群部署(在node1、node2节点上操作)

实验中出现的资源包已打包到博客

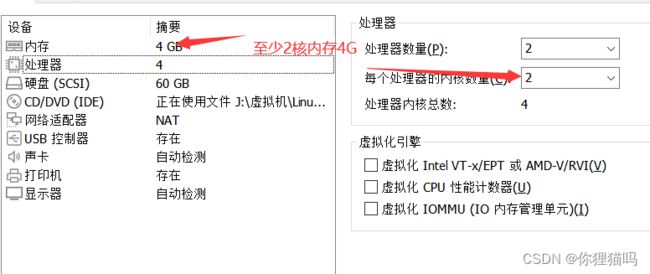

实验环境

Node1节点(2C/4G):node1/192.168.131.100 Elasticsearch Kibana

Node2节点(2C/4G):node2/192.168.131.101 Elasticsearch

Apache节点:apache/192.168.131.102 Logstash Apache

systemctl stop firewalld

setenforce 0

#更改主机名、配置域名解析、查看Java环境

Node1节点:hostnamectl set-hostname node1

Node2节点:hostnamectl set-hostname node2

vim /etc/hosts

192.168.131.100 node1

192.168.131.101 node2

su

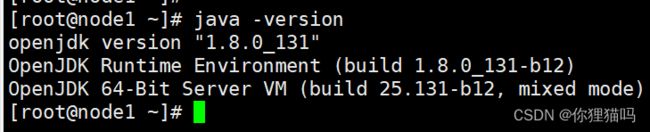

注:版本问题

java -version #如果没有安装,yum -y install java

openjdk version "1.8.0_131"

OpenJDK Runtime Environment (build 1.8.0_131-b12)

OpenJDK 64-Bit Server VM (build 25.131-b12, mixed mode)

建议使用jdknode1 和node2都要操作

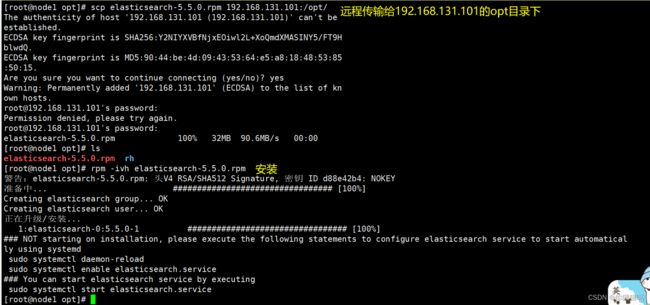

部署Elasticsearch软件

安装elasticsearch—rpm包

加载系统服务

systemctl daemon-reload

systemctl enable elasticsearch.service

修改elasticsearch主配置文件

vim /etc/elasticsearch/elasticsearch.yml

--17--取消注释,指定集群名字

cluster.name: my-elk-cluster

--23--取消注释,指定节点名字:Node1节点为node1,Node2节点为node2

node.name: node1

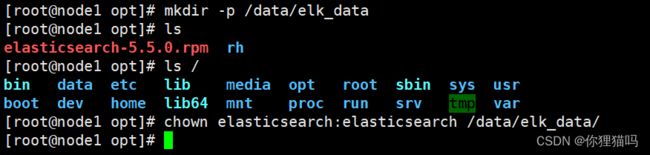

--33--取消注释,指定数据存放路径

path.data: /data/elk_data

--37--取消注释,指定日志存放路径

path.logs: /var/log/elasticsearch/

--43--取消注释,改为在启动的时候不锁定内存

bootstrap.memory_lock: false

--55--取消注释,设置监听地址,0.0.0.0代表所有地址

network.host: 0.0.0.0

--59--取消注释,ES 服务的默认监听端口为9200

http.port: 9200

--68--取消注释,集群发现通过单播实现,指定要发现的节点 node1、node2

discovery.zen.ping.unicast.hosts: ["node1", "node2"]创建数据存放路径并授权

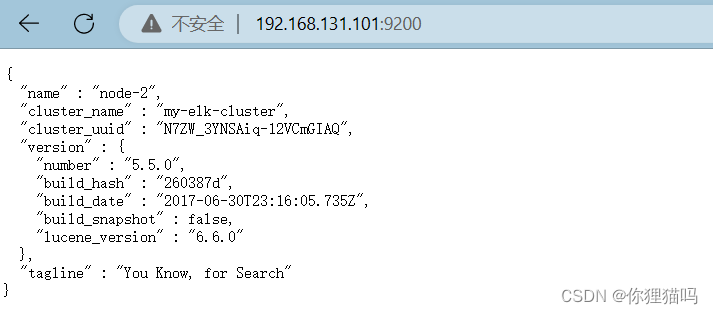

启动elasticsearch是否成功开启

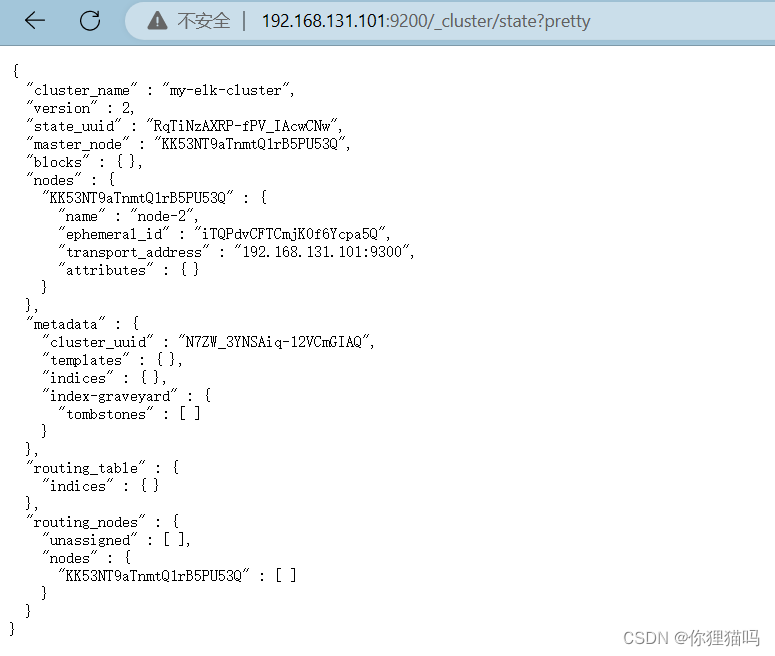

查看节点信息

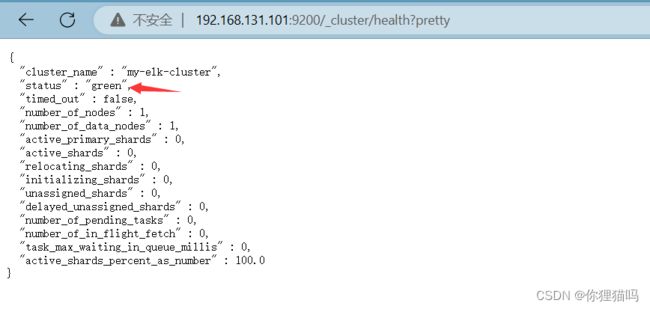

查看群集的健康情况,status栏显示green代表节点正常运行

使用上述方式查看群集的状态对用户并不友好,可以通过安装 Elasticsearch-head 插件,可以更方便地管理群集。

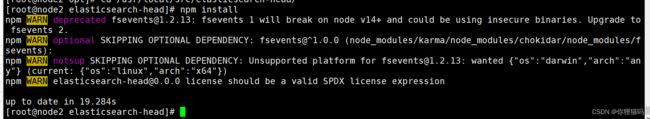

安装 Elasticsearch-head 插件

Elasticsearch 在 5.0 版本后,Elasticsearch-head 插件需要作为独立服务进行安装,需要使用npm工具(NodeJS的包管理工具)安装。

安装 Elasticsearch-head 需要提前安装好依赖软件 node 和 phantomjs。

node:是一个基于 Chrome V8 引擎的 JavaScript 运行环境。

phantomjs:是一个基于 webkit 的JavaScriptAPI,可以理解为一个隐形的浏览器,任何基于 webkit 浏览器做的事情,它都可以做到。

编译安装 node

#上传软件包 node-v8.2.1.tar.gz 到/opt

yum install gcc gcc-c++ make -y

cd /opt

tar zxvf node-v8.2.1.tar.gz

cd node-v8.2.1/

./configure && make -j 4 && make install #过程很长安装 phantomjs(前端的框架)

#上传软件包 phantomjs-2.1.1-linux-x86_64.tar.bz2 到

cd /opt

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /usr/local/src/

cd /usr/local/src/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin安装 Elasticsearch-head 数据可视化工具

#上传软件包 elasticsearch-head.tar.gz 到/opt

cd /opt

tar zxvf elasticsearch-head.tar.gz -C /usr/local/src/

cd /usr/local/src/elasticsearch-head/

npm install修改 Elasticsearch 主配置文件

vim /etc/elasticsearch/elasticsearch.yml

--末尾添加以下内容--

http.cors.enabled: true #开启跨域访问支持,默认为 false

http.cors.allow-origin: "*" #指定跨域访问允许的域名地址为所有

systemctl restart elasticsearch

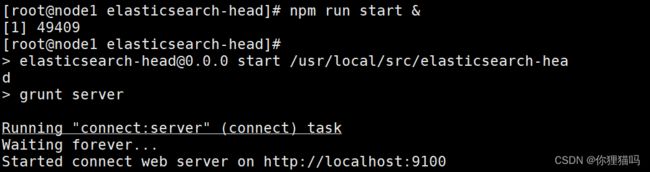

启动 elasticsearch-head 服务

#必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

cd /usr/local/src/elasticsearch-head/

npm run start &通过 Elasticsearch-head 查看 Elasticsearch 信息

通过浏览器访问 http://192.168.131.100:9100/ 地址并连接群集。如果看到群集健康值为 green 绿色,代表群集很健康。

通过命令插入一个测试索引,索引为 index-demo,类型为 test。

浏览器访问 http://192.168.131.100:9100/ 查看索引信息,可以看见索引默认被分片5个,并且有一个副本。

点击“数据浏览”,会发现在node1上创建的索引为 index-demo,类型为 test 的相关信息。

ELK Logstash 部署(在 Apache 节点上操作)

Logstash 一般部署在需要监控其日志的服务器。在本案例中,Logstash 部署在 Apache 服务器上,用于收集 Apache 服务器的日志信息并发送到 Elasticsearch。

实验环境

systemctl stop firewalld

setenforce 0

更改主机名

hostnamectl set-hostname apache

安装Apahce服务(httpd)

yum -y install httpd

systemctl start httpd

安装Java环境

yum -y install java

java -version安装Logstash

cd /opt

rpm -ivh logstash-5.5.1.rpm

systemctl start logstash.service

systemctl enable logstash.service

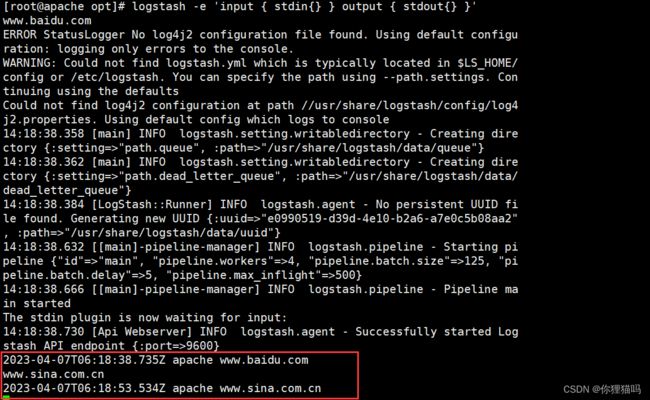

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/测试Logstash

Logstash 命令常用选项:

-f:通过这个选项可以指定 Logstash 的配置文件,根据配置文件配置 Logstash 的输入和输出流。

-e:从命令行中获取,输入、输出后面跟着字符串,该字符串可以被当作 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出)。

-t:测试配置文件是否正确,然后退出。

定义输入和输出流:

#输入采用标准输入,输出采用标准输出(类似管道)

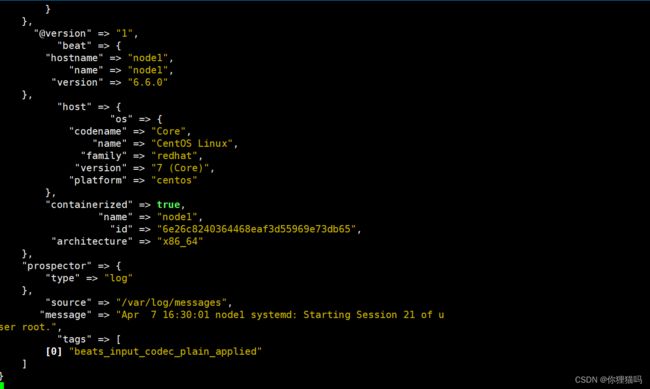

logstash -e 'input { stdin{} } output { stdout{} }'使用 rubydebug 输出详细格式显示,codec 为一种编解码器

logstash -e 'input { stdin{} } output { stdout{ codec=>rubydebug } }'使用 Logstash 将信息写入 Elasticsearch 中

logstash -e 'input { stdin{} } output { elasticsearch { hosts=>["192.168.131.100:9200"] } }'

...

www.baidu.com

www.sina.com.cn

www.google.com

//结果不在标准输出显示,而是发送至 Elasticsearch 中,可浏览器访问 http://192.168.131.100:9100/ 查看索引信息和数据浏览。

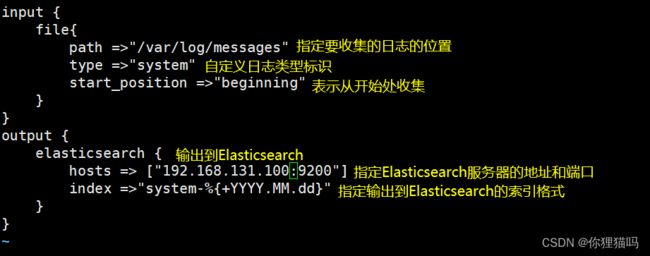

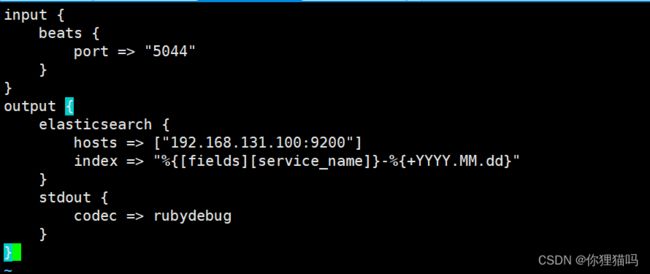

定义 logstash配置文件

Logstash 配置文件基本由三部分组成:input、output 以及 filter(可选,根据需要选择使用)。

input:表示从数据源采集数据,常见的数据源如Kafka、日志文件等

filter:表示数据处理层,包括对数据进行格式化处理、数据类型转换、数据过滤等,支持正则表达式

output:表示将Logstash收集的数据经由过滤器处理之后输出到Elasticsearch。

chmod +r /var/log/messages #让 Logstash 可以读取日志

vim /etc/logstash/conf.d/system.conf

systemctl restart logstash

浏览器访问 http://192.168.131.100:9100/ 查看索引信息ELK Kiabana 部署(在 Node1 节点上操作)

上传软件包 kibana-5.5.1-x86_64.rpm 到/opt目录

cd /opt

rpm -ivh kibana-5.5.1-x86_64.rpm

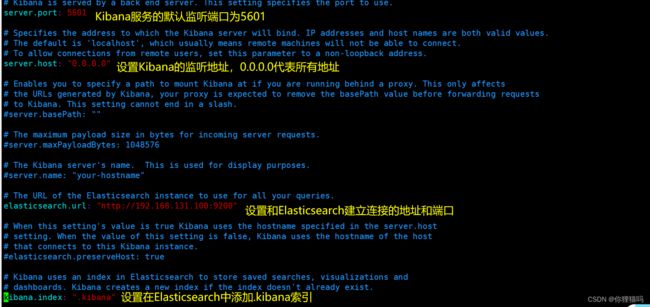

vim /opt/kibana-5.5.1-linux-x86_64/config

--2--取消注释,Kiabana 服务的默认监听端口为5601

server.port: 5601

--7--取消注释,设置 Kiabana 的监听地址,0.0.0.0代表所有地址

server.host: "0.0.0.0"

--21--取消注释,设置和 Elasticsearch 建立连接的地址和端口

elasticsearch.url: "http://192.168.10.13:9200"

--30--取消注释,设置在 elasticsearch 中添加.kibana索引

kibana.index: ".kibana"启动 Kibana 服务

systemctl start kibana.service

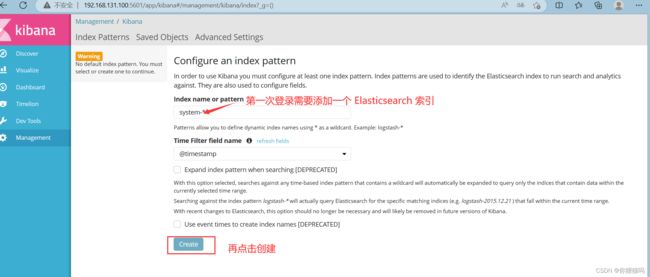

systemctl enable kibana.service验证 Kibana

真机访问192.168.131.100:5601

将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

vim /etc/logstash/conf.d/apache_log.conf

cd /etc/logstash/conf.d/

/usr/share/logstash/bin/logstash -f apache_log.conf浏览器访问 http://192.168.131.100:9100 查看索引已经创建

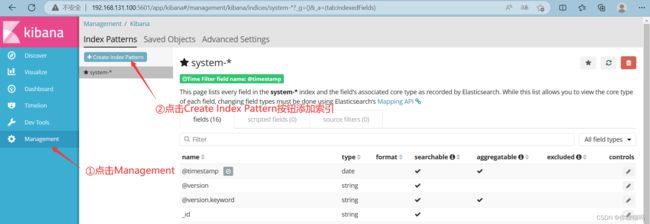

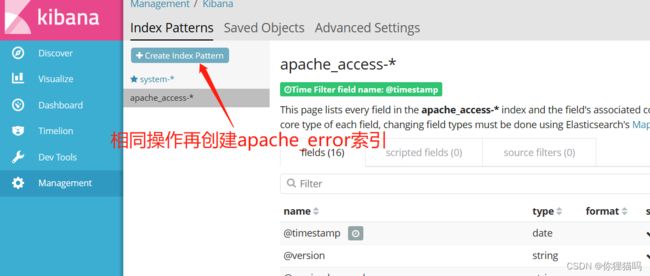

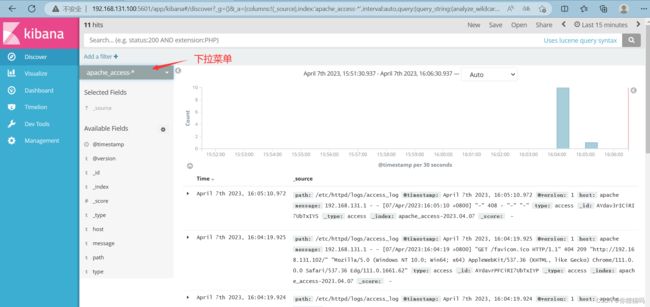

浏览器访问 http://192.168.131.100:5601 登录 Kibana,单击“Create Index Pattern”按钮添加索引, 在索引名中输入之前配置的 Output 前缀 apache_access-*,并单击“Create”按钮。在用相同的方法添加 apache_error-*索引。

选择“Discover”选项卡,在中间下拉列表中选择刚添加的 apache_access-* 、apache_error-* 索引, 可以查看相应的图表及日志信息。

Filebeat+ELK 部署

实验环境

Node1节点(2C/4G):node1/192.168.131.100 Elasticsearch Kibana

Node2节点(2C/4G):node2/192.168.131.101 Elasticsearch

Apache节点:apache/192.168.131.102 Logstash Apache

Filebeat节点:filebeat/192.168.131.103 Filebeat

systemctl stop firewalld

setenforce 0

在filebeat节点上操作

安装 Filebeat

#上传软件包 filebeat-6.2.4-linux-x86_64.tar.gz 到/opt目录

tar zxvf filebeat-6.2.4-linux-x86_64.tar.gz

mv filebeat-6.2.4-linux-x86_64/ /usr/local/filebeat设置 filebeat 的主配置文件

Logstash output

启动filebeat

在 Logstash 组件所在节点上新建一个 Logstash 配置文件

cd /etc/logstash/conf.d

vim logstash.conf

#启动 logstash

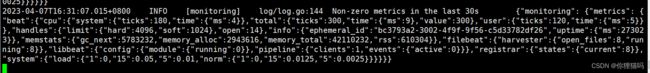

logstash -f logstash.conf#启动 logstash

logstash -f logstash.conf

filebeat也在传输数据

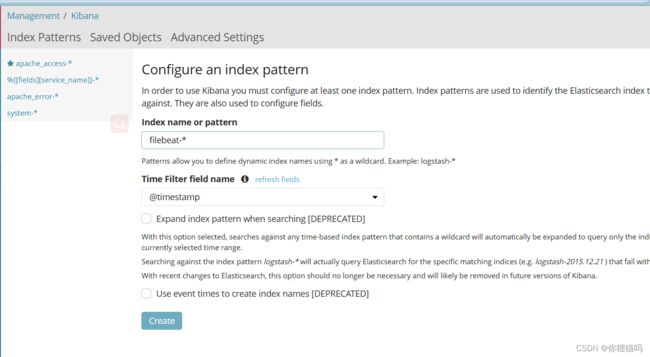

浏览器访问 http://192.168.131.100:5601 登录 Kibana,单击“Create Index Pattern”按钮添加索引“filebeat-*”,单击 “create” 按钮创建,单击 “Discover” 按钮可查看图表信息及日志信息。