Spark核心编程

Spark核心编程

- 1.1 RDD

-

- 1.1.1 什么是 RDD

- 1.1.2 核心属性

- 1.1.3 执行原理

- 1.1.4 基本编程

-

- 1.1.4.1 RDD创建

- 1.1.4.2 RDD 并行度与分区

- 1.1.4.3 RDD 转换算子

Spark 计算框架为了能够进行高并发和高吞吐的数据处理,封装了三大数据结构,用于

处理不同的应用场景。三大数据结构分别是:

➢ RDD : 弹性分布式数据集

➢ 累加器:分布式共享只写变量

➢ 广播变量:分布式共享只读变量

接下来我们一起看看这三大数据结构是如何在数据处理中使用的。

1.1 RDD

1.1.1 什么是 RDD

RDD(Resilient Distributed Dataset)叫做弹性分布式数据集,是 Spark 中最基本的数据处理模型。代码中是一个抽象类,它代表一个弹性的、不可变、可分区、里面的元素可并行计算的集合。

➢ 弹性

⚫ 存储的弹性:内存与磁盘的自动切换;

⚫ 容错的弹性:数据丢失可以自动恢复;

⚫ 计算的弹性:计算出错重试机制;

⚫ 分片的弹性:可根据需要重新分片。

➢ 分布式:数据存储在大数据集群不同节点上

➢ 数据集:RDD 封装了计算逻辑,并不保存数据

➢ 数据抽象:RDD 是一个抽象类,需要子类具体实现

➢ 不可变:RDD 封装了计算逻辑,是不可以改变的,想要改变,只能产生新的 RDD,在

新的 RDD 里面封装计算逻辑

➢ 可分区、并行计算

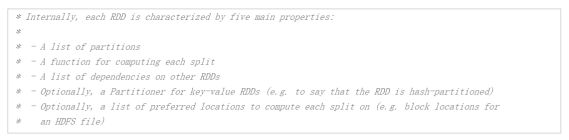

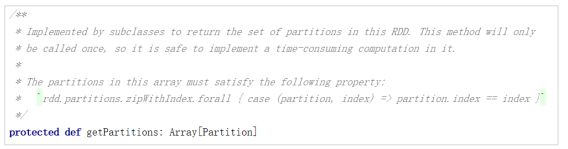

1.1.2 核心属性

➢ 分区列表

RDD 数据结构中存在分区列表,用于执行任务时并行计算,是实现分布式计算的重要属性。

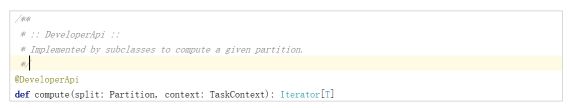

➢ 分区计算函数

Spark 在计算时,是使用分区函数对每一个分区进行计算

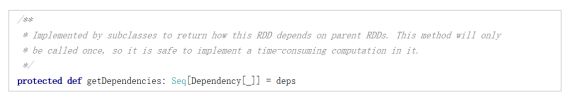

➢ RDD 之间的依赖关系

RDD 是计算模型的封装,当需求中需要将多个计算模型进行组合时,就需要将多个 RDD 建

立依赖关系

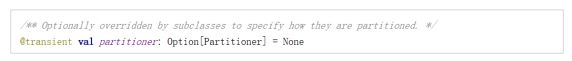

➢ 分区器(可选)

当数据为 KV 类型数据时,可以通过设定分区器自定义数据的分区

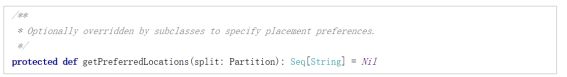

➢ 首选位置(可选)

计算数据时,可以根据计算节点的状态选择不同的节点位置进行计算

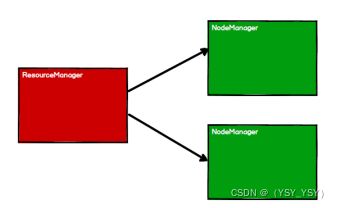

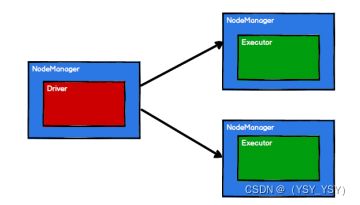

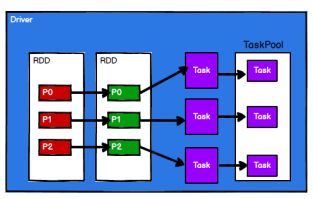

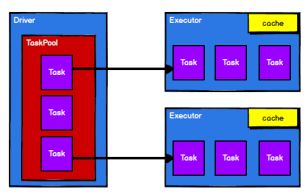

1.1.3 执行原理

从计算的角度来讲,数据处理过程中需要计算资源(内存 & CPU)和计算模型(逻辑)。执行时,需要将计算资源和计算模型进行协调和整合。

Spark 框架在执行时,先申请资源,然后将应用程序的数据处理逻辑分解成一个一个的计算任务。然后将任务发到已经分配资源的计算节点上, 按照指定的计算模型进行数据计算。最后得到计算结果。

RDD 是 Spark 框架中用于数据处理的核心模型,接下来我们看看,在 Yarn 环境中,RDD的工作原理:

从以上流程可以看出 RDD 在整个流程中主要用于将逻辑进行封装,并生成 Task 发送给Executor 节点执行计算,接下来我们就一起看看 Spark 框架中 RDD 是具体是如何进行数据处理的。

1.1.4 基本编程

1.1.4.1 RDD创建

在Spark中创建RDD的创建方式可以分为四种:

- 从集合(内存)中创建RDD

从集合中创建RDD,Spark主要提供了两个方法:parallelize和makeRDD

val sparkConf = new SparkConf().setMater("local[*]").setAppName("spark")

val sparkContext = new SparkContext(sparkConf)

val rdd1 = sparkContext.parallelize(

List(1,2,3,4)

)

val rdd2 = sparkContext.makeRDD(

List(1,2,3,4)

)

rdd1.collect().foreach(println)

rdd2.collect().foreach(println)

sparkContext.stop()

从底层代码实现来讲,makeRDD方法其实就是parallelize方法

def makeRDD[T:ClassTag](

seq:Seq[T],

numSlices:Int = defaultParallelism):RDD[T] = withScope {

parallelize(seq,numSlices)

}

2)从外部存储(文件)创建RDD

由外部存储系统的数据集创建RDD包括:本地的文件系统,所有Hadoop支持的数据集,比如HDFS,HBase等。

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("spark")

val sparkContext = new SparkContext(sparkConf)

val fileRDD:RDD[String] = sparkContext.textFile("input")

sparkContext.stop()

3 )从其他RDD创建

主要通过一个RDD运算完后,再产生新的RDD。详情请参考后续章节

4 )直接创建RDD(new)

使用new的方式直接构造RDD,一般由Spark框架自身使用。

1.1.4.2 RDD 并行度与分区

默认情况下,Spark 可以将一个作业切分多个任务后,发送给 Executor 节点并行计算,而能够并行计算的任务数量我们称之为并行度。这个数量可以在构建 RDD 时指定。记住,这里的并行执行的任务数量,并不是指的切分任务的数量,不要混淆了。

val sparkConf =new SparkConf() .setMaster("local[*]") .setAppName("sp ark")

val sparkContext = new SparkContext(sparkConf)

val dataRDD: RDD[Int] =sparkContext.makeRDD(List(1,2,3,4), 4)

val fileRDD: RDD[String] = sparkContext.textFile("input",2)

fileRDD.collect().foreach(println)

sparkContext.stop()

⚫ 读取内存数据时,数据可以按照并行度的设定进行数据的分区操作,数据分区规则的

Spark 核心源码如下:

def positions(length: Long, numSlices: Int): Iterator[(Int, Int)] = {

(0 until numSlices).iterator.map { i =>

val start = ((i * length) / numSlices).toInt

val end = (((i + 1) * length) / numSlices).toInt

(start, end)

}

}

⚫ 读取文件数据时,数据是按照 Hadoop 文件读取的规则进行切片分区,而切片规则和数据读取的规则有些差异,具体 Spark 核心源码如下

public InputSplit[] getSplits(JobConf job, int numSplits)

throws IOException {

long totalSize = 0; // compute total size

for (FileStatus file: files) { // check we have valid files

if (file.isDirectory()) {

throw new IOException("Not a file: "+ file.getPath());

}

totalSize += file.getLen();

}

long goalSize = totalSize / (numSplits == 0 ? 1 : numSplits);

long minSize = Math.max(job.getLong(org.apache.hadoop.mapreduce.lib.input.

FileInputFormat.SPLIT_MINSIZE, 1), minSplitSize);

...

for (FileStatus file: files) {

...

if (isSplitable(fs, path)) {

long blockSize = file.getBlockSize();

long splitSize = computeSplitSize(goalSize, minSize, blockSize);

...

}

protected long computeSplitSize(long goalSize, long minSize,

long blockSize) {

return Math.max(minSize, Math.min(goalSize, blockSize));

}

1.1.4.3 RDD 转换算子

RDD 根据数据处理方式的不同将算子整体上分为Value类型,双Value类型和Key-Value类型

⚫ Value 类型

- map

➢ 函数签名

def map[U: ClassTag](f: T => U): RDD[U]

➢ 函数说明

将处理的数据逐条进行映射转换,这里的转换可以是类型的转换,也可以是值的转换。

val dataRDD: RDD[Int] = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD1: RDD[Int] = dataRDD.map(

num => {

num * 2

}

)

val dataRDD2: RDD[String] = dataRDD1.map(

num => {

"" + num

}

)

- mapPartitions

➢ 函数签名

def mapPartitions[U: ClassTag](

f: Iterator[T] => Iterator[U],

preservesPartitioning: Boolean = false): RDD[U]

➢ 函数说明

将待处理的数据以分区为单位发送到计算节点进行处理,这里的处理是指可以进行任意的处理,哪怕是过滤数据。

val dataRDD1: RDD[Int] = dataRDD.mapPartitions(

datas => {

datas.filter(_==2)

}

)

❖ 小功能:获取每个数据分区的最大值

思考一个问题:map 和 mapPartitions 的区别?

➢ 数据处理角度

Map 算子是分区内一个数据一个数据的执行,类似于串行操作。而 mapPartitions 算子

是以分区为单位进行批处理操作。

➢ 功能的角度

Map 算子主要目的将数据源中的数据进行转换和改变。但是不会减少或增多数据。

MapPartitions 算子需要传递一个迭代器,返回一个迭代器,没有要求的元素的个数保持不变,

所以可以增加或减少数据

➢ 性能的角度

Map 算子因为类似于串行操作,所以性能比较低,而是 mapPartitions 算子类似于批处

理,所以性能较高。但是 mapPartitions 算子会长时间占用内存,那么这样会导致内存可能

不够用,出现内存溢出的错误。所以在内存有限的情况下,不推荐使用。使用 map 操作。

完成比完美更重要

3)mapPartitionsWithIndex

➢ 函数签名

def mapPartitionsWithIndex[U: ClassTag](

f: (Int, Iterator[T]) => Iterator[U],

preservesPartitioning: Boolean = false): RDD[U]

➢ 函数说明

将待处理的数据以分区为单位发送到计算节点进行处理,这里的处理是指可以进行任意的处

理,哪怕是过滤数据,在处理时同时可以获取当前分区索引。

val dataRDD1 = dataRDD.mapPartitionsWithIndex(

(index,datas) =>{

datas.map(index,_)

}

)

❖ 小功能:获取第二个数据分区的数据

val mapRDD = rdd.mapPartitionsWithIndex(

(index,datas) =>{

if(index == 1) {

datas.map((index, _))

}else{

Nil.iterator

}

}

)

- flatMap

➢ 函数签名

def flatMap[U: ClassTag](f: T => TraversableOnce[U]): RDD[U]

➢ 函数说明

将处理的数据进行扁平化后再进行映射处理,所以算子也称之为扁平映射

val dataRDD = sparkContext.makeRDD(List(List(1,2),List(3,4),1))

val dataRDD1 = dataRDD.flatMap( list => list)

❖ 小功能:将 List(List(1,2),3,List(4,5))进行扁平化操作

val dataRDD = sc.makeRDD(List(List(1,2),3,List(4,5)),1)

val mapRDD = dataRDD.flatMap(list => list match {

case list:List[_] => list

case _ => List(list)

})

- glom

➢ 函数签名

def glom(): RDD[Array[T]]

➢ 函数说明

将同一个分区的数据直接转换为相同类型的内存数组进行处理,分区不变

val dataRDD = sparkContext.makeRDD(List(1,2,3,4),1)

val dataRDD1:RDD[Array[Int]] = dataRDD.glom()

❖ 小功能:计算所有分区最大值求和(分区内取最大值,分区间最大值求和)

6)groupBy

➢ 函数签名

def groupBy[K](f: T => K)(implicit kt: ClassTag[K]): RDD[(K, Iterable[T])]

➢ 函数说明

将数据根据指定的规则进行分组, 分区默认不变,但是数据会被打乱重新组合,我们将这样的操作称之为 shuffle。极限情况下,数据可能被分在同一个分区中

一个组的数据在一个分区中,但是并不是说一个分区中只有一个组

val dataRDD = sparkContext.makeRDD(List(1,2,3,4),1)

val dataRDD1 = dataRDD.groupBy( _%2 )

❖ 小功能:将 List(“Hello”, “hive”, “hbase”, “Hadoop”)根据单词首写字母进行分组。

❖ 小功能:从服务器日志数据 apache.log 中获取每个时间段访问量。

❖ 小功能:WordCount。

7) filter

➢ 函数签名

def filter(f: T => Boolean): RDD[T]

➢ 函数说明

将数据根据指定的规则进行筛选过滤,符合规则的数据保留,不符合规则的数据丢弃。当数据进行筛选过滤后,分区不变,但是分区内的数据可能不均衡,生产环境下,可能会出现数据倾斜。

❖ 小功能:从服务器日志数据 apache.log 中获取 2015 年 5 月 17 日的请求路径

8) sample

def sample(

withReplacement: Boolean,

fraction: Double,

seed: Long = Utils.random.nextLong): RDD[T]

➢ 函数说明

根据指定的规则从数据集中抽取数据

val dataRDD = sparkContext.makeRDD(List(1,2,3,4),1)

// 抽取数据不放回(伯努利算法)

//伯努利算法:又叫0,1分布。例如扔硬币,要么正面,要么反面。

//具体实现:根据种子和随机算法算出一个数和第二个参数设置几率比较,小于第二个参数要,大于不要

//第一个参数:抽取的数据是否放回,false:不放回

//第二个参数:抽取的几率,范围在【0,1】之间,0:全不取

思考一个问题:有啥用,抽奖吗?

- distinct

➢ 函数签名

def distinct()(implicit ord: Ordering[T] = null): RDD[T]

def distinct(numPartitions: Int)(implicit ord: Ordering[T] = null): RDD[T]

➢ 函数说明

将数据集中的重复数据去重

val dataRDD = sparkContext.makeRDD(List(1,2,3,4,1,2),1)

val dataRDD1 = dataRDD.distinct()

val dataRDD2 = dataRDD.distinct(2)

思考一个问题:如果不用该算子,你有什么办法实现数据去重?

- coalesce

➢ 函数签名

def coalesce(numPartitions: Int, shuffle: Boolean = false,

partitionCoalescer: Option[PartitionCoalescer] = Option.empty)

(implicit ord: Ordering[T] = null)

: RDD[T]

➢ 函数说明

根据数据量缩减分区,用于大数据集过滤后,提高小数据集的执行xiaolv

当spark程序中,存在过多的小任务的时候,可以通过coalesce方法,收缩合并分区,减少分区的个数,减小任务调度成本

val dataRDD = sparkContext.makeRDD(List(1,2,3,4,1,2),6)

val dataRDD1 = dataRDD.coalesce(2)

思考一个问题:我想要扩大分区,怎么办?

11) repartition

➢ 函数签名

def repartition(numPartitions: Int)(implicit ord: Ordering[T] = null): RDD[T]

➢ 函数说明

该操作内部其实执行的是coalesce操作,参数shuffle的默认值为true。无论是将分区数多的RDD转换为分区数少的RDD,还是将分区数少的RDD转换为分区数多的RDD,repartion操作都可以完成,因为无论如何都会经shuffle过程。

val dataRDD = sparkContext.makeRDD(List(1,2,3,4,1,2),2)

val dataRDD1 = dataRDD.repartition(4)

思考一个问题:coalesce 和 repartition 区别?

- sortBy

➢ 函数签名

def sortBy[K](

f: (T) => K,

ascending: Boolean = true,

numPartitions: Int = this.partitions.length)

(implicit ord: Ordering[K], ctag: ClassTag[K]): RDD[T]

➢ 函数说明

该操作用于排序数据。在排序之前,可以将数据通过f函数进行处理,之后按照f函数处理的结果进行排序,默认为升序排序。排序后新产生的RDD的分区数与原RDD的分区数一致。中间存在shuffle的过程

val dataRDD = sparkContext.makeRDD(List(1,2,3,4,1,2),2)

val dataRDD1 = dataRDD.sortBy(num=>num,false,4)

⚫ 双 Value 类型

13) intersection

➢ 函数签名

def intersection(other: RDD[T]): RDD[T]

➢ 函数说明

对源RDD和参数RDD求交集后返回一个新的RDD

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = saprkContext.makeRDD(List(3,4,5,6))

val dataRDD3 = dataRDD1.intersection(dataRDD2)

思考一个问题:如果两个 RDD 数据类型不一致怎么办?

- union

➢ 函数签名

def union(other: RDD[T]): RDD[T]

➢ 函数说明

对源 RDD 和参数 RDD 求并集后返回一个新的 RDD

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = sparkContext.makeRDD(List(3,4,5,6))

val dataRDD = dataRDD1.union(dataRDD2)

思考一个问题:如果两个 RDD 数据类型不一致怎么办?

- subtract

➢ 函数签名

def subtract(other: RDD[T]): RDD[T]

以一个RDD元素为主,去除两个RDD中重复元素,将其他元素保留下来。求差集

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = sparkContext.makeRDD(List(3,4,5,6))

val dataRDD = dataRDD1.subtract(dataRDD2)

思考一个问题:如果两个 RDD 数据类型不一致怎么办?

- zip

➢ 函数签名

def zip[U: ClassTag](other: RDD[U]): RDD[(T, U)]

➢ 函数说明

将两个RDD中的元素,以键值对的形式进行合并。其中,键值对中的Key为第1个RDD中的元素,Value为第2个RDD中的相同位置的元素。

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = sparkContext.makeRDD(List(3,4,5,6))

val dataRDD = dataRDD1.zip(dataRDD2)

思考一个问题:如果两个 RDD 数据类型不一致怎么办?

思考一个问题:如果两个 RDD 数据分区不一致怎么办?

思考一个问题:如果两个 RDD 分区数据数量不一致怎么办?

⚫ Key - Value 类型

- partitionBy

➢ 函数签名

def partitionBy(partitioner: Partitioner): RDD[(K, V)]

➢ 函数说明

将数据按照指定Partitioner重新进行分区。Spark默认的分区器是HashPartitioner

val rdd:RDD[(Int,String)] = sc.makeRDD((Array(1,"aaa"),(2,"bbb"),(3,"ccc")),3)

import org.apache.spark.HashPartitioner

val rdd2:RDD[(Int,String)] = rdd.partitionBy(new HashParttioner(2))

思考一个问题:如果重分区的分区器和当前 RDD 的分区器一样怎么办?

思考一个问题:Spark 还有其他分区器吗?

思考一个问题:如果想按照自己的方法进行数据分区怎么办?

思考一个问题:哪那么多问题?

- reduceByKey

➢ 函数签名

def reduceByKey(func: (V, V) => V): RDD[(K, V)]

def reduceByKey(func: (V, V) => V, numPartitions: Int): RDD[(K, V)]

➢ 函数说明

可以将数据按照相同的Key对Value进行聚合

val dataRDD1 = sparkContetxt.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.reduceByKey(_+_)

val dataRDD3 = dataRDD2.reduceByKey(_+_,2)

19)groupByKey

➢ 函数签名

def groupByKey(): RDD[(K, Iterable[V])]

def groupByKey(numPartitions: Int): RDD[(K, Iterable[V])]

def groupByKey(partitioner: Partitioner): RDD[(K, Iterable[V])]

➢ 函数说明

将数据源的数据根据 key 对 value 进行分组

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.groupByKey()

val dataRDD3 = dataRDD1.groupByKey(2)

val dataRDD4 = dataRDD1.groupByKey(new HashPartitioner(2))

思考一个问题:reduceByKey 和 groupByKey 的区别?

从shuffle角度:reduceByKey和groupByKey都存在shuffle的操作,但是reduceByKey可以在shuffle前对分区内相同key的数据进行预聚合(combine)功能,这样会减少落盘的数据量,而groupByKey只是进行分组,不存在数据量减少的问题,reduceByKey性能比较高。

从功能的角度:reduceByKey其实包含分组和聚合的功能。GroupByKey只能分组,不能聚合,所以在分组聚合的场合下,推荐使用reduceByKey,如果仅仅是分组不需要聚合,那么还是只能使用groupByKey

❖ 小功能:WordCount

- aggregateByKey

➢ 函数签名

def aggregateByKey[U: ClassTag](zeroValue: U)(seqOp: (U, V) => U,

combOp: (U, U) => U): RDD[(K, U)]

➢ 函数说明

将数据根据不同的规则进行分区内计算和分区间计算

val dataRDD1 = sparkContext.makeRDD(List("a",1),("b",2),("c",3))

val dataRDD2 = dataRDD1.aggregateByKey(0)(_+_,_+_)

❖ 取出每个分区内相同 key 的最大值然后分区间相加

// TODO:取出每个分区内相同key的最大值然后分区间相加

// aggregateByKey 算子是函数柯里化,存在两个参数列表

//1.第一个参数列表中的参数表示初始值

//2.第二个参数列表中含两个参数

// 2.1 第一个参数表示分区内的计算规则

// 2.2 第二个参数表示分区间的计算规则

val rdd = sc.makeRDD(List("a",1),("a",2),("c",3),("b",4),("c",5),("c",6),2)

// 0:("a",1),("a",2),("c",3) => (a,10)(c,10)

=>(a,10)(b,10)(c,20)

//1:("b",4),("c",5),("c",6) => (b,10)(c,10)

val resultRDD = rdd.aggregateByKey(10)(

(x,y) => math.max(x,y)

(x,y) => x + y

)

resultRDD.collect().foreach(println)

思考一个问题:分区内计算规则和分区间计算规则相同怎么办?(WordCount)

- foldByKey

➢ 函数签名

def foldByKey(zeroValue: V)(func: (V, V) => V): RDD[(K, V)]

➢ 函数说明

当分区内计算规则和分区间计算规则相同时,aggregateByKey就可以简化foldByKey

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.foldByKey(0)(_+_)

- combineByKey

➢ 函数签名

def combineByKey[C](

createCombiner: V => C,

mergeValue: (C, V) => C,

mergeCombiners: (C, C) => C): RDD[(K, C)]

➢ 函数说明

最通用的对key-value型rdd进行聚集操作的聚集函数(aggregation function)。类似于aggregate( ) , combineByKey()允许用户返回值的类型与输入不一致。

小练习:将数据List((“a”, 88), (“b”, 95), (“a”, 91), (“b”, 93), (“a”, 95), (“b”, 98))求每个 key 的平

均值

val list:List[(String,Int)] = List(("a",88),("b",95),("a",91),("b",93),("a",95),("b",98))

val input:RDD[(String,Int)] = sc.makeRDD(list,2)

val combineRdd:[(String,(Int,Int))] = input.combineByKey(

(_,1),

(acc:(Int,Int),v) => (acc._1 + v,acc._2 + 1),

(acc1:(Int,Int),acc2:(Int,Int)) => (acc._1 + acc2._1,acc1._2 + acc2._2)

)

思考一个问题:reduceByKey、foldByKey、aggregateByKey、combineByKey 的区别?

rduceByKey:相同key的第一个数据不进行任何计算,分区内和分区间计算规则相同

FoldByKey:相同key的第一个数据和初始值进行分区内计算,分区内和分区间计算规则相同

AggregateByKey:相同key的第一个数据和初始值进行分区内计算,分区内和分区间计算规则可以不相同

CombineByKey:当计算时,发现数据结构不满足要求时,可以让第一个数据转换结构。分区内和分区间计算规则不相同。

23)sortByKey

➢ 函数签名

def sortByKey(ascending: Boolean = true, numPartitions: Int = self.partitions.length)

: RDD[(K, V)]

➢ 函数说明

在一个(K,V)的 RDD 上调用,K 必须实现 Ordered 接口(特质),返回一个按照 key 进行排序的

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val sortRDD1: RDD[(String, Int)] = dataRDD1.sortByKey(true)

val sortRDD1: RDD[(String, Int)] = dataRDD1.sortByKey(false)

❖ 小功能:设置 key 为自定义类 Use

24) join

➢ 函数签名

def join[W](other: RDD[(K, W)]): RDD[(K, (V, W))]

➢ 函数说明

在类型为(K,V)和(K,W)的 RDD 上调用,返回一个相同 key 对应的所有元素连接在一起的(K,(V,W))的 RDD

val rdd: RDD[(Int, String)] = sc.makeRDD(Array((1, "a"), (2, "b"), (3, "c")))

val rdd1: RDD[(Int, Int)] = sc.makeRDD(Array((1, 4), (2, 5), (3, 6)))

rdd.join(rdd1).collect().foreach(println)

思考一个问题:如果 key 存在不相等呢?

- leftOuterJoin

➢ 函数签名

def leftOuterJoin[W](other: RDD[(K, W)]): RDD[(K, (V, Option[W]))]

➢ 函数说明

类似于 SQL 语句的左外连接

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val rdd: RDD[(String, (Int, Option[Int]))] = dataRDD1.leftOuterJoin(dataRDD2)

- cogroup

➢ 函数签名

def cogroup[W](other: RDD[(K, W)]): RDD[(K, (Iterable[V], Iterable[W]))]

➢ 函数说明

在类型为(K,V)和(K,W)的 RDD 上调用,返回一个(K,(Iterable,Iterable))类型的 RDD

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("a",2),("c",3)))

val dataRDD2 = sparkContext.makeRDD(List(("a",1),("c",2),("c",3)))

val value: RDD[(String, (Iterable[Int], Iterable[Int]))] =

dataRDD1.cogroup(dataRDD2)

5.1.4.4 案例实操

- 数据准备

agent.log:时间戳,省份,城市,用户,广告,中间字段使用空格分隔。 - 需求描述

统计出每一个省份每个广告被点击数量排行的 Top3 - 需求分析

- 功能实现