Hive3.1.3

文章目录

- 1、Hive入门

-

- 1.1 Hive简介

- 1.2 Hive本质

- 1.3 Hive架构原理

- 2、Hive安装

-

- 2.1 Hive安装地址

- 2.2 Hive安装部署

-

- 2.2.1 安装Hive(最小化)

- 2.2.2 启动并使用Hive

- 2.3 MySQL安装

-

- 2.3.1 安装MySQL

- 2.3.2 配置MySQL

- 2.4 配置Hive元数据存储到MySQL

-

- 2.4.1 配置元数据到MySQL

- 2.4.2 验证元数据是否配置成功

- 2.4.3 查看MySQL中的元数据

- 2.5 Hive服务部署

-

- 2.5.1 hiveserver2服务

- 2.5.2 metastore服务

- 2.6 Hive使用技巧

-

- 2.6.1 Hive常用交互命令

- 2.6.2 Hive参数配置方式

- 2.6.3 Hive常见属性配置

- 3、DDL 数据定义

-

- 3.1 数据库(database)

-

- 3.1.1 创建数据库

- 3.1.2 查询数据库

- 3.1.3 修改数据库

- 3.1.4 删除数据库

- 3.1.5 切换当前数据库

- 3.2 表(table)

-

- 3.2.1 创建表

- 3.2.2 内部表与外部表

- 3.2.3 SERDE和复杂数据类型

- 3.2.4 create table as select和create table like

- 3.2.5 查看表

- 3.2.6 修改表

- 3.2.7 删除表

- 3.2.8 清空表

- 4、DML 数据操作

-

- 4.1 Load

- 4.2 Insert

-

- 4.2.1 将查询结果插入表中

- 4.2.2 将给定values插入表中

- 4.2.3 将查询结果写入目标路径

- 4.3 Export&Import

- 5、查询

-

- 5.1 基础语法

- 5.2 基本查询

-

- 5.2.1 数据准备

- 5.2.2 全表和特定列查询

- 5.2.3 列别名

- 5.2.4 Limit语句

- 5.2.5 Where语句

- 5.2.6 关系运算函数

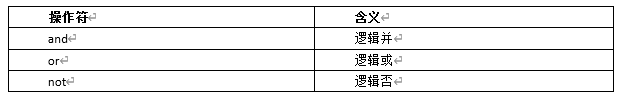

- 5.2.7 逻辑运算函数

- 5.2.8 聚合函数

- 5.3 分组

-

- 5.3.1 Group By

- 5.3.2 Having

- 5.4 Join

-

- 5.4.1 等值join

- 5.4.2 表的别名

- 5.4.3 内连接

- 5.4.4 左外连接

- 5.4.5 右外连接

- 5.4.6 满外连接

- 5.4.7 多表连接

- 5.4.8 笛卡尔集

- 5.4.9 联合(union & union all)

- 5.5 排序

-

- 5.5.1 全局排序(Order By)

- 5.5.2 每个Reduce内部排序(Sort By)

- 5.5.3 分区(Distribute By)

- 5.5.4 分区排序(Cluster By)

- 6、函数

-

- 6.1 函数简介

- 6.2 单行函数

-

- 6.2.1 算术运算函数

- 6.2.2 数值函数

- 6.2.3 字符串函数

- 6.2.4 日期函数

- 6.2.5 流程控制函数

- 6.2.6 集合函数

- 6.3 高级聚合函数

- 6.4 炸裂函数

- 6.5 窗口函数

-

- 6.5.1 概述

- 6.5.2 常用窗口函数

- 6.5.3 案例练习

- 6.6 自定义函数

- 6.7 自定义UDF函数

- 7、分区表

-

- 7.1 概述

- 7.2 分区表基本语法

-

- 7.2.1 创建分区表

- 7.2.2 分区表读写数据

-

- 7.2.2.1 写数据

- 7.2.2.2 读数据

- 7.3 分区表基本操作

-

- 7.3.1 查看所有分区信息

- 7.3.2 增加分区

- 7.3.3 删除分区

- 7.3.4 修复分区

- 7.4 二级分区表

-

- 7.4.1 二级分区表建表语句

- 7.4.2 数据装载语句

- 7.4.3 查询分区数据

- 7.5 动态分区

-

- 7.5.1 动态分区相关参数

- 7.5.2 案例实操

- 8、分桶表

-

- 8.1 概述

- 8.2 分桶表基本语法

-

- 8.2.1 建表语句

- 8.2.2 数据装载

- 8.3 分桶排序表

-

- 8.3.1 建表语句

- 8.3.2 数据装载

- 9 、文件格式和压缩

-

- 9.1 Hadoop压缩概述

- 9.2 Hive文件格式

-

- 9.2.1 Text File

- 9.2.2 ORC

- 9.2.3 Parquet

- 9.3 压缩

-

- 9.3.1 Hive表数据进行压缩

- 9.3.2 计算过程中使用压缩

- 10、企业级调优

-

- 10.1 计算资源配置

-

- 10.1.1 Yarn资源配置

- 10.1.2 MapReduce资源配置

- 10.2 测试用表

-

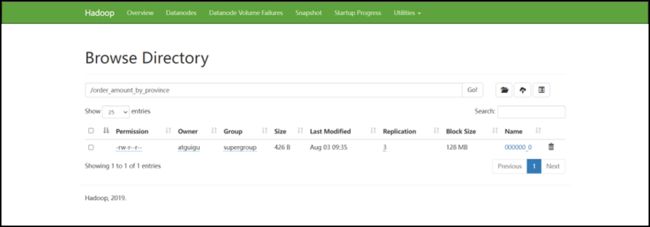

- 10.2.1 订单表(2000w条数据)

- 10.2.2 支付表(600w条数据)

- 10.2.3 商品信息表(100w条数据)

- 10.2.4 省份信息表(34条数据)

- 10.3 Explain查看执行计划(重点)

-

- 10.3.1 Explain执行计划概述

- 10.3.2 基本语法

- 10.3.3 案例实操

- 10.3.4 可视化工具

- 10.4 HQL语法优化之分组聚合优化

-

- 10.4.1 优化说明

- 10.4.2 优化案例

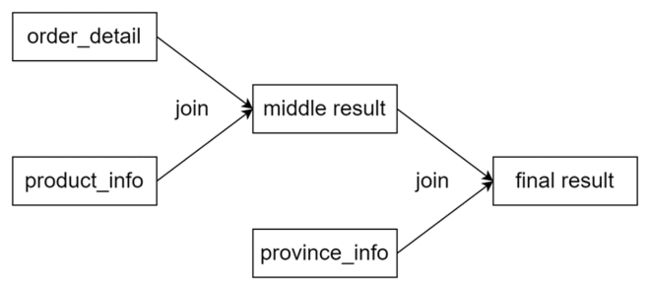

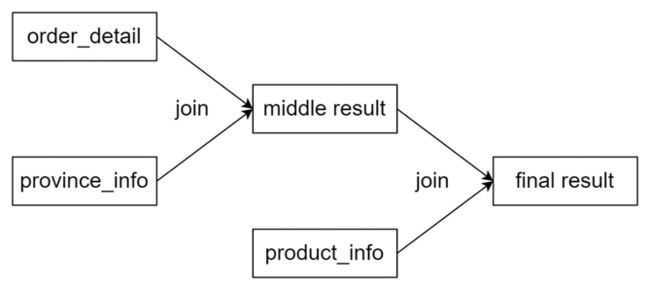

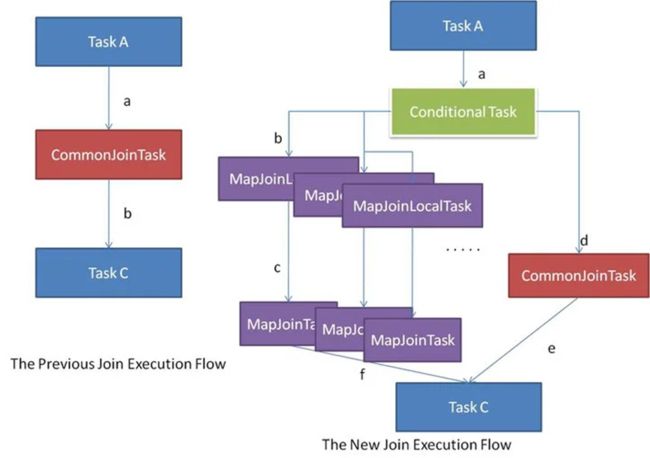

- 10.5 HQL语法优化之Join优化

-

- 10.5.1 Join算法概述

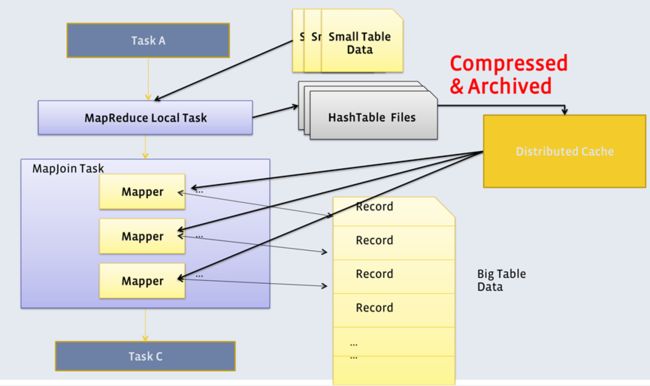

- 10.5.2 Map Join

-

- 10.5.2.1 优化说明

- 10.5.2.2 优化案例

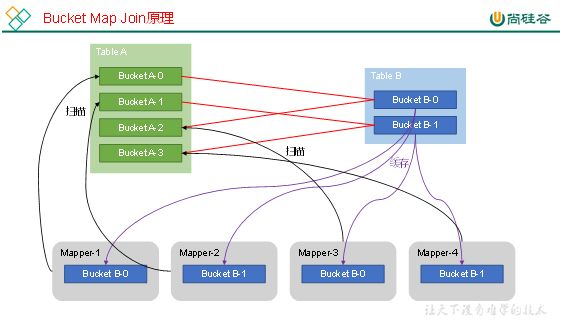

- 10.5.3 Bucket Map Join

-

- 10.5.3.1 优化说明

- 10.5.3.2 优化案例

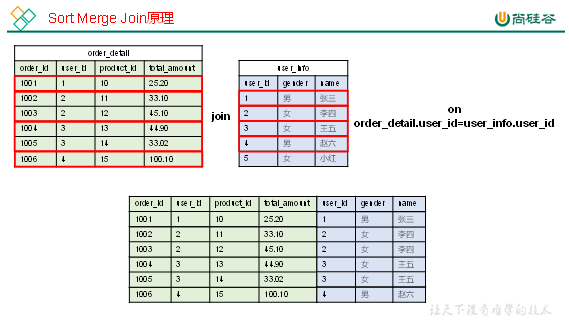

- 10.5.4 Sort Merge Bucket Map Join

-

- 10.5.4.1 优化说明

- 10.5.4.2 优化案例

- 10.6 HQL语法优化之数据倾斜

-

- 10.6.1 数据倾斜概述

- 10.6.2 分组聚合导致的数据倾斜

-

- 10.6.2.1 优化说明

- 10.6.2.2 优化案例

- 10.6.3 Join导致的数据倾斜

-

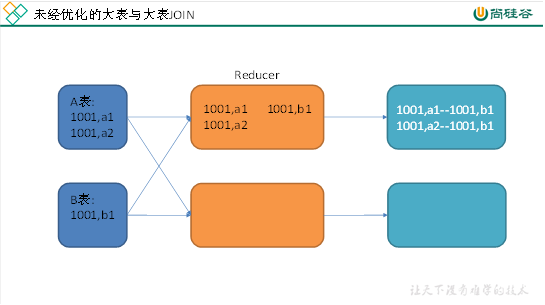

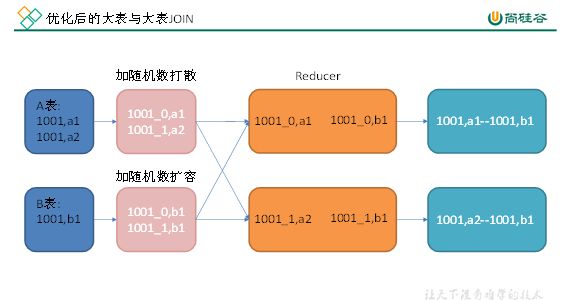

- 10.6.3.1 优化说明

- 10.6.3.2 优化案例

- 10.7 HQL语法优化之任务并行度

-

- 10.7.1 优化说明

-

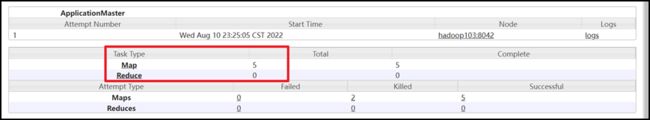

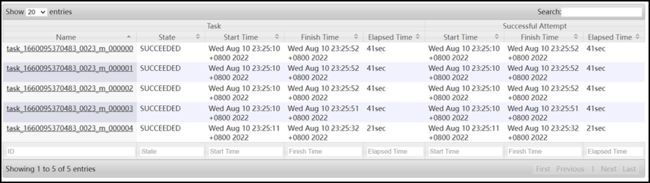

- 10.7.1.1 Map端并行度

- 10.7.1.2 Reduce端并行度

- 10.7.2 优化案例

- 10.8 HQL语法优化之小文件合并

-

- 10.8.1 优化说明

-

- 10.8.1.1 Map端输入文件合并

- 10.8.1.2 Reduce输出文件合并

- 10.8.2 优化案例

- 10.9 其他优化

-

- 10.9.1 CBO优化

-

- 10.9.1.1 优化说明

- 10.9.2.2 优化案例

- 10.9.2 谓词下推

-

- 10.9.2.1 优化说明

- 10.9.2.2 优化案例

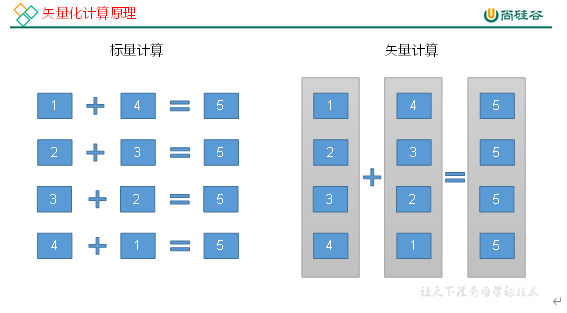

- 10.9.3 矢量化查询

- 10.9.4 Fetch抓取

- 10.9.5 本地模式

-

- 10.9.5.1 优化说明

- 10.9.5.2 优化案例

- 10.9.6 并行执行

- 10.9.7 严格模式

- 附录:常见错误及解决方案

1、Hive入门

1.1 Hive简介

- Hive:由 Facebook 开源用于解决海量结构化日志的数据统计工具。

- Hive 是基于 Hadoop 的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并提供类 SQL 查询功能。

1.2 Hive本质

Hive是一个Hadoop客户端,用于将HQL(Hive SQL)转化成MapReduce程序。

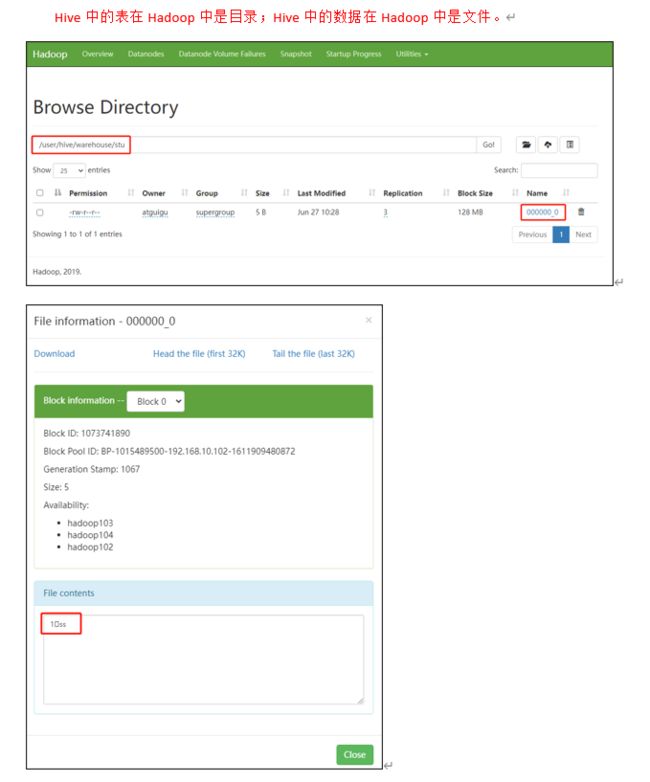

(1)Hive中每张表的数据存储在HDFS

(2)Hive分析数据底层的实现是MapReduce(也可配置为Spark或者Tez)

(3)执行程序运行在Yarn上

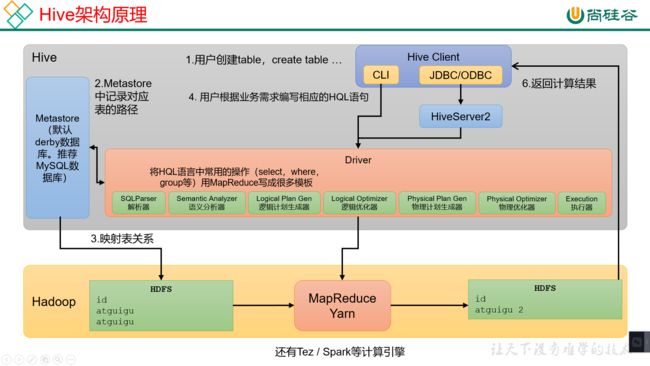

1.3 Hive架构原理

-

用户接口:Client

CLI(command-line interface)、JDBC/ODBC。

说明:JDBC和ODBC的区别。

(1)JDBC的移植性比ODBC好;(通常情况下,安装完ODBC驱动程序之后,还需要经过确定的配置才能够应用。而不相同的配置在不相同数据库服务器之间不能够通用。所以,安装一次就需要再配置一次。JDBC只需要选取适当的JDBC数据库驱动程序,就不需要额外的配置。在安装过程中,JDBC数据库驱动程序会自己完成有关的配置。)

(2)两者使用的语言不同,JDBC在Java编程时使用,ODBC一般在C/C++编程时使用。 -

元数据:Metastore

元数据包括:数据库(默认是default)、表名、表的拥有者、列/分区字段、表的类型(是否是外部表)、表的数据所在目录等。

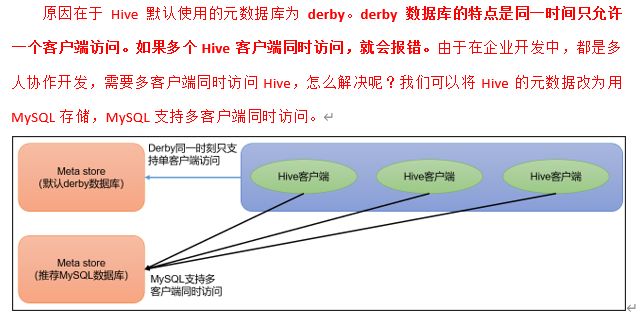

默认存储在自带的derby数据库中,由于derby数据库只支持单客户端访问,生产环境中为了多人开发,推荐使用MySQL存储Metastore。 -

驱动器:Driver

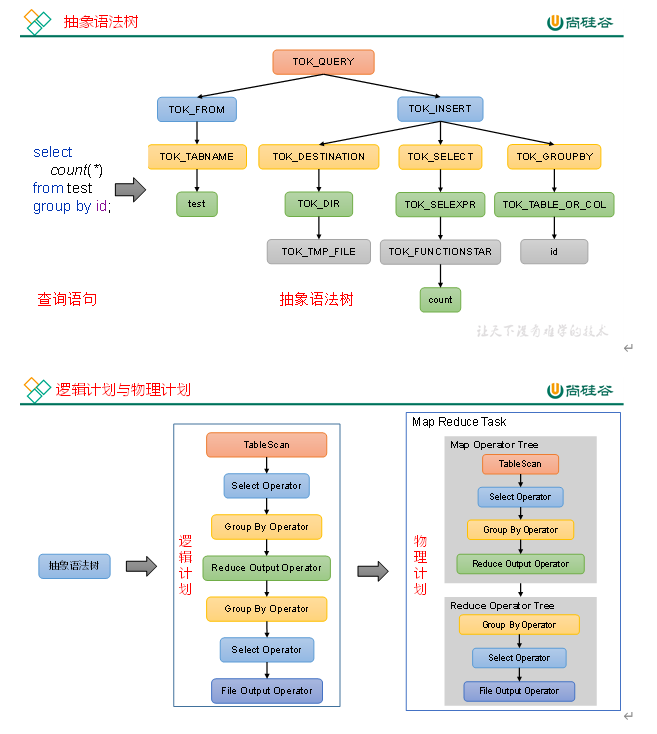

(1)解析器(SQLParser):将SQL字符串转换成抽象语法树(AST)

(2)语义分析(Semantic Analyzer):将AST进一步划分为QeuryBlock

(3)逻辑计划生成器(Logical Plan Gen):将语法树生成逻辑计划

(4)逻辑优化器(Logical Optimizer):对逻辑计划进行优化

(5)物理计划生成器(Physical Plan Gen):根据优化后的逻辑计划生成物理计划

(6)物理优化器(Physical Optimizer):对物理计划进行优化

(7)执行器(Execution):执行该计划,得到查询结果并返回给客户端

2、Hive安装

2.1 Hive安装地址

1)Hive官网地址

http://hive.apache.org/

2)文档查看地址

https://cwiki.apache.org/confluence/display/Hive/GettingStarted

3)下载地址

http://archive.apache.org/dist/hive/

4)github地址

https://github.com/apache/hive

2.2 Hive安装部署

2.2.1 安装Hive(最小化)

1)把apache-hive-3.1.3-bin.tar.gz上传到Linux的/opt/software目录下

2)解压apache-hive-3.1.3-bin.tar.gz到/opt/module/目录下面

[atguigu@hadoop102 software]$ tar -zxvf /opt/software/apache-hive-3.1.3-bin.tar.gz -C /opt/module/

3)修改apache-hive-3.1.3-bin.tar.gz的名称为hive

[atguigu@hadoop102 software]$ mv /opt/module/apache-hive-3.1.3-bin/ /opt/module/hive

4)修改/etc/profile.d/my_env.sh,添加环境变量

[atguigu@hadoop102 software]$ sudo vim /etc/profile.d/my_env.sh

(1)添加内容

#HIVE_HOME

export HIVE_HOME=/opt/module/hive

export PATH=$PATH:$HIVE_HOME/bin

(2)source一下

[atguigu@hadoop102 hive]$ source /etc/profile.d/my_env.sh

5)初始化元数据库(默认是derby数据库)

[atguigu@hadoop102 hive]$ bin/schematool -dbType derby -initSchema

2.2.2 启动并使用Hive

1)启动Hive

[atguigu@hadoop102 hive]$ bin/hive

2)使用Hive

hive> show databases;

hive> show tables;

hive> create table stu(id int, name string);

hive> insert into stu values(1,"ss");

hive> select * from stu;

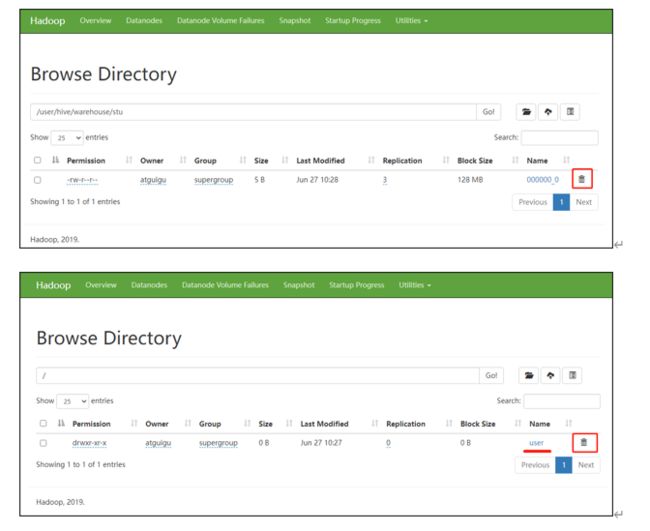

观察HDFS的路径/user/hive/warehouse/stu,体会Hive与Hadoop之间的关系。

3)在Xshell窗口中开启另一个窗口开启Hive,在/tmp/atguigu目录下监控hive.log文件

[atguigu@hadoop102 atguigu]$ tail -f hive.log

Caused by: ERROR XSDB6: Another instance of Derby may have already booted the database /opt/module/hive/metastore_db.

at org.apache.derby.iapi.error.StandardException.newException(Unknown Source)

at org.apache.derby.iapi.error.StandardException.newException(Unknown Source)

at org.apache.derby.impl.store.raw.data.BaseDataFileFactory.privGetJBMSLockOnDB(Unknown Source)

at org.apache.derby.impl.store.raw.data.BaseDataFileFactory.run(Unknown Source)

...

4)首先退出hive客户端。然后在Hive的安装目录下将derby.log和metastore_db删除,顺便将HDFS上目录删除

hive> quit;

[atguigu@hadoop102 hive]$ rm -rf derby.log metastore_db

[atguigu@hadoop102 hive]$ hadoop fs -rm -r /user

5)删除HDFS中/user/hive/warehouse/stu中数据

2.3 MySQL安装

2.3.1 安装MySQL

1)上传MySQL安装包以及MySQL驱动jar包

mysql-5.7.28-1.el7.x86_64.rpm-bundle.tar

mysql-connector-java-5.1.37.jar

2)解压MySQL安装包

[atguigu@hadoop102 software]$ mkdir mysql_lib

[atguigu@hadoop102 software]$ tar -xf mysql-5.7.28-1.el7.x86_64.rpm-bundle.tar -C mysql_lib/

3)卸载系统自带的mariadb

[atguigu@hadoop102 ~]$ sudo rpm -qa | grep mariadb | xargs sudo rpm -e --nodeps

4)安装MySQL依赖

[atguigu@hadoop102 software]$ cd mysql_lib

[atguigu@hadoop102 mysql_lib]$ sudo rpm -ivh mysql-community-common-5.7.28-1.el7.x86_64.rpm

[atguigu@hadoop102 mysql_lib]$ sudo rpm -ivh mysql-community-libs-5.7.28-1.el7.x86_64.rpm

[atguigu@hadoop102 mysql_lib]$ sudo rpm -ivh mysql-community-libs-compat-5.7.28-1.el7.x86_64.rpm

5)安装mysql-client

[atguigu@hadoop102 mysql_lib]$ sudo rpm -ivh mysql-community-client-5.7.28-1.el7.x86_64.rpm

6)安装mysql-server

[atguigu@hadoop102 mysql_lib]$ sudo rpm -ivh mysql-community-server-5.7.28-1.el7.x86_64.rpm

注意:若出现以下错误

warning: 05_mysql-community-server-5.7.16-1.el7.x86_64.rpm: Header V3 DSA/SHA1 Signature, key ID 5072e1f5: NOKEY

error: Failed dependencies:

libaio.so.1()(64bit) is needed by mysql-community-server-5.7.16-1.el7.x86_64

解决办法:

[atguigu@hadoop102 software]$ sudo yum -y install libaio

7)启动MySQL

[atguigu@hadoop102 software]$ sudo systemctl start mysqld

8)查看MySQL密码

[atguigu@hadoop102 software]$ sudo cat /var/log/mysqld.log | grep password

2.3.2 配置MySQL

配置主要是root用户 + 密码,在任何主机上都能登录MySQL数据库。

1)用刚刚查到的密码进入MySQL(如果报错,给密码加单引号)

[atguigu@hadoop102 software]$ mysql -uroot -p'password'

2)设置复杂密码(由于MySQL密码策略,此密码必须足够复杂)

mysql> set password=password("Qs23=zs32");

3)更改MySQL密码策略

mysql> set global validate_password_policy=0;

mysql> set global validate_password_length=4;

4)设置简单好记的密码

mysql> set password=password("123456");

5)进入MySQL库

mysql> use mysql

6)查询user表

mysql> select user, host from user;

7)修改user表,把Host表内容修改为%

mysql> update user set host="%" where user="root";

8)刷新

mysql> flush privileges;

9)退出

mysql> quit;

2.4 配置Hive元数据存储到MySQL

![]()

2.4.1 配置元数据到MySQL

1)新建Hive元数据库

#登录MySQL

[atguigu@hadoop102 software]$ mysql -uroot -p123456

#创建Hive元数据库

mysql> create database metastore;

mysql> quit;

2)将MySQL的JDBC驱动拷贝到Hive的lib目录下。

[atguigu@hadoop102 software]$ cp /opt/software/mysql-connector-java-5.1.37.jar $HIVE_HOME/lib

3)在$HIVE_HOME/conf目录下新建hive-site.xml文件

[atguigu@hadoop102 software]$ vim $HIVE_HOME/conf/hive-site.xml

添加如下内容:

"1.0"?>

type="text/xsl" href="configuration.xsl"?>

<!-- jdbc连接的URL -->

javax.jdo.option.ConnectionURL</name>

jdbc:mysql://hadoop102:3306/metastore?useSSL=false</value>

</property>

<!-- jdbc连接的Driver-->

javax.jdo.option.ConnectionDriverName</name>

com.mysql.jdbc.Driver</value>

</property>

<!-- jdbc连接的username-->

javax.jdo.option.ConnectionUserName</name>

root</value>

</property>

<!-- jdbc连接的password -->

javax.jdo.option.ConnectionPassword</name>

123456</value>

</property>

<!-- Hive默认在HDFS的工作目录 -->

hive.metastore.warehouse.dir</name>

/user/hive/warehouse</value>

</property>

</configuration>

5)初始化Hive元数据库(修改为采用MySQL存储元数据)

[atguigu@hadoop102 hive]$ bin/schematool -dbType mysql -initSchema -verbose

2.4.2 验证元数据是否配置成功

1)再次启动Hive

[atguigu@hadoop102 hive]$ bin/hive

2)使用Hive

hive> show databases;

hive> show tables;

hive> create table stu(id int, name string);

hive> insert into stu values(1,"ss");

hive> select * from stu;

3)在Xshell窗口中开启另一个窗口开启Hive(两个窗口都可以操作Hive,没有出现异常)

hive> show databases;

hive> show tables;

hive> select * from stu;

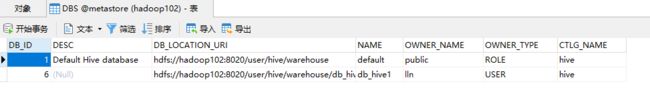

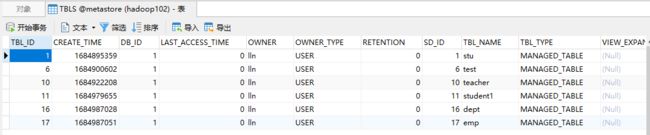

2.4.3 查看MySQL中的元数据

1)登录MySQL

[atguigu@hadoop102 hive]$ mysql -uroot -p123456

2)查看元数据库metastore

mysql> show databases;

mysql> use metastore;

mysql> show tables;

(3)查看元数据库中存储的表中列相关信息

mysql> select * from COLUMNS_V2;

+-------+----------+---------+------------+-------------+-------------+--------+

| CS_ID | CAT_NAME | DB_NAME | TABLE_NAME | COLUMN_NAME | COLUMN_TYPE | TBL_ID |

+-------+----------+---------+------------+-------------+-------------+--------+

| 1 | hive | default | stu | id | int | 1 |

| 2 | hive | default | stu | name | string | 1 |

+-------+----------+---------+------------+-------------+-------------+--------+

2.5 Hive服务部署

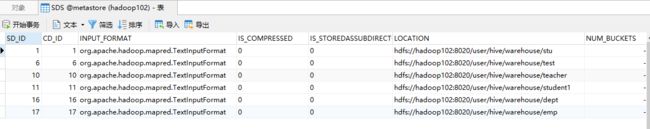

2.5.1 hiveserver2服务

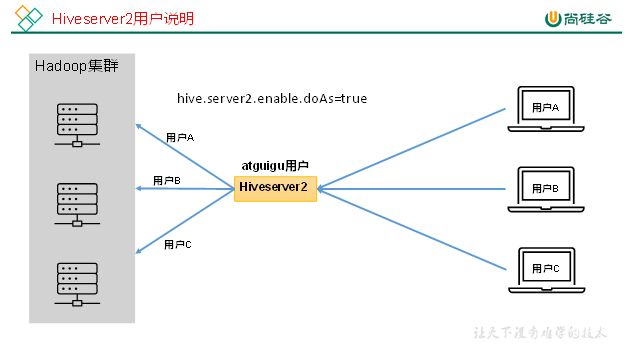

Hive的hiveserver2服务的作用是提供jdbc/odbc接口,为用户提供远程访问Hive数据的功能,例如用户期望在个人电脑中访问远程服务中的Hive数据,就需要用到Hiveserver2。

1)用户说明

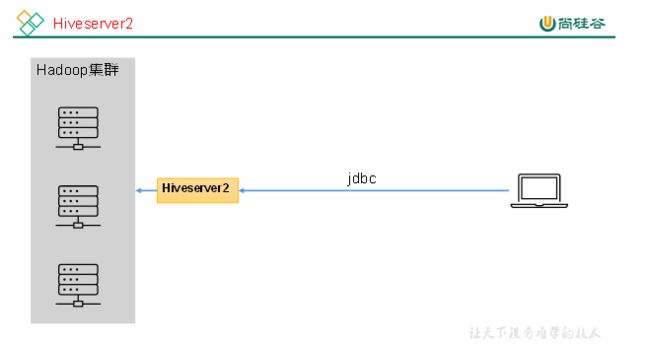

在远程访问Hive数据时,客户端并未直接访问Hadoop集群,而是由Hivesever2代理访问。由于Hadoop集群中的数据具备访问权限控制,所以此时需考虑一个问题:那就是访问Hadoop集群的用户身份是谁?是Hiveserver2的启动用户?还是客户端的登录用户?

答案是都有可能,具体是谁,由Hiveserver2的hive.server2.enable.doAs参数决定,该参数的含义是是否启用Hiveserver2用户模拟的功能。若启用,则Hiveserver2会模拟成客户端的登录用户去访问Hadoop集群的数据,不启用,则Hivesever2会直接使用启动用户访问Hadoop集群数据。模拟用户的功能,默认是开启的。

具体逻辑如下:

未开启用户模拟功能:

开启用户模拟功能:

生产环境,推荐开启用户模拟功能,因为开启后才能保证各用户之间的权限隔离。

2)hiveserver2部署

(1)Hadoop端配置

hivesever2的模拟用户功能,依赖于Hadoop提供的proxy user(代理用户功能),只有Hadoop中的代理用户才能模拟其他用户的身份访问Hadoop集群。因此,需要将hiveserver2的启动用户设置为Hadoop的代理用户,配置方式如下:

修改配置文件core-site.xml,然后记得分发三台机器

[atguigu@hadoop102 ~]$ cd $HADOOP_HOME/etc/hadoop

[atguigu@hadoop102 hadoop]$ vim core-site.xml

增加如下配置:

<!--配置所有节点的atguigu用户都可作为代理用户-->

hadoop.proxyuser.atguigu.hosts</name>

*</value>

</property>

<!--配置atguigu用户能够代理的用户组为任意组-->

hadoop.proxyuser.atguigu.groups</name>

*</value>

</property>

<!--配置atguigu用户能够代理的用户为任意用户-->

hadoop.proxyuser.atguigu.users</name>

*</value>

</property>

(2)Hive端配置

在hive-site.xml文件中添加如下配置信息

[atguigu@hadoop102 conf]$ vim hive-site.xml

<!-- 指定hiveserver2连接的host -->

hive.server2.thrift.bind.host</name>

hadoop102</value>

</property>

<!-- 指定hiveserver2连接的端口号 -->

hive.server2.thrift.port</name>

10000</value>

</property>

3)测试

(1)启动hiveserver2

[atguigu@hadoop102 hive]$ bin/hive --service hiveserver2

nohup bin/hiveserver2 1>/dev/null 2>/dev/null &

[lln@hadoop102 hive]$ jps -ml

29936 org.apache.hadoop.util.RunJar /opt/module/hive/lib/hive-service-3.1.3.jar org.apache.hive.service.server.HiveServer2

10753 org.apache.hadoop.yarn.server.nodemanager.NodeManager

10929 org.apache.hadoop.mapreduce.v2.hs.JobHistoryServer

10295 org.apache.hadoop.hdfs.server.namenode.NameNode

33751 sun.tools.jps.Jps -ml

10457 org.apache.hadoop.hdfs.server.datanode.DataNode

(2)使用命令行客户端beeline进行远程访问

启动beeline客户端

[atguigu@hadoop102 hive]$ bin/beeline -u jdbc:hive2://hadoop102:10000 -n atguigu

看到如下界面

Connecting to jdbc:hive2://hadoop102:10000

Connected to: Apache Hive (version 3.1.3)

Driver: Hive JDBC (version 3.1.3)

Transaction isolation: TRANSACTION_REPEATABLE_READ

Beeline version 3.1.3 by Apache Hive

0: jdbc:hive2://hadoop102:10000>

(3)使用Datagrip图形化客户端进行远程访问

2.5.2 metastore服务

Hive的metastore服务的作用是为Hive CLI或者Hiveserver2提供元数据访问接口。

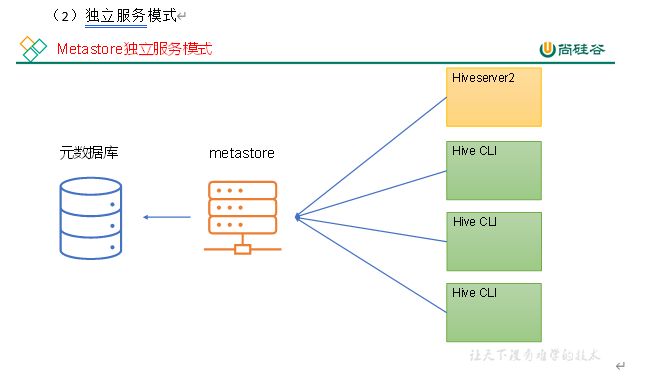

1)metastore运行模式

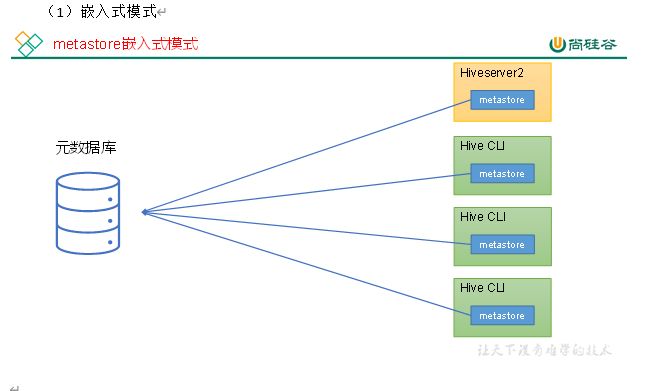

metastore有两种运行模式,分别为嵌入式模式和独立服务模式。下面分别对两种模式进行说明:

生产环境中,不推荐使用嵌入式模式。因为其存在以下两个问题:

(1)嵌入式模式下,每个Hive CLI都需要直接连接元数据库,当Hive CLI较多时,数据库压力会比较大。

(2)每个客户端都需要用户元数据库的读写权限,元数据库的安全得不到很好的保证。

2)metastore部署

(1)嵌入式模式

嵌入式模式下,只需保证Hiveserver2和每个Hive CLI的配置文件hive-site.xml中包含连接元数据库所需要的以下参数即可:

<!-- jdbc连接的URL -->

javax.jdo.option.ConnectionURL</name>

jdbc:mysql://hadoop102:3306/metastore?useSSL=false</value>

</property>

<!-- jdbc连接的Driver-->

javax.jdo.option.ConnectionDriverName</name>

com.mysql.jdbc.Driver</value>

</property>

<!-- jdbc连接的username-->

javax.jdo.option.ConnectionUserName</name>

root</value>

</property>

<!-- jdbc连接的password -->

javax.jdo.option.ConnectionPassword</name>

123456</value>

</property>

(2)独立服务模式

独立服务模式需做以下配置:

首先,保证metastore服务的配置文件hive-site.xml中包含连接元数据库所需的以下参数:

<!-- jdbc连接的URL -->

javax.jdo.option.ConnectionURL</name>

jdbc:mysql://hadoop102:3306/metastore?useSSL=false</value>

</property>

<!-- jdbc连接的Driver-->

javax.jdo.option.ConnectionDriverName</name>

com.mysql.jdbc.Driver</value>

</property>

<!-- jdbc连接的username-->

javax.jdo.option.ConnectionUserName</name>

root</value>

</property>

<!-- jdbc连接的password -->

javax.jdo.option.ConnectionPassword</name>

123456</value>

</property>

其次,保证Hiveserver2和每个Hive CLI的配置文件hive-site.xml中包含访问metastore服务所需的以下参数:

<!-- 指定metastore服务的地址 -->

hive.metastore.uris</name>

thrift://hadoop102:9083</value>

</property>

注意:主机名需要改为metastore服务所在节点,端口号无需修改,metastore服务的默认端口就是9083。

3)测试

此时启动Hive CLI,执行shou databases语句,会出现一下错误提示信息:

hive (default)> show databases;

FAILED: HiveException java.lang.RuntimeException: Unable to instantiate org.apache.hadoop.hive.ql.metadata.SessionHiveMetaStoreClient

这是因为我们在Hive CLI的配置文件中配置了hive.metastore.uris参数,此时Hive CLI会去请求我们执行的metastore服务地址,所以必须启动metastore服务才能正常使用。

metastore服务的启动命令如下:

[atguigu@hadoop202 hive]$ hive --service metastore

2022-04-24 16:58:08: Starting Hive Metastore Server

nohup hive --service metastore &

注意:启动后该窗口不能再操作,需打开一个新的Xshell窗口来对Hive操作。

重新启动 Hive CLI,并执行show databases语句,就能正常访问了

[atguigu@hadoop202 hive]$ bin/hive

2.6 Hive使用技巧

2.6.1 Hive常用交互命令

[atguigu@hadoop102 hive]$ bin/hive -help

usage: hive

-d,--define Variable subsitution to apply to hive

commands. e.g. -d A=B or --define A=B

--database Specify the database to use

-e SQL from command line

-f SQL from files

-H,--help Print help information

--hiveconf Use value for given property

--hivevar Variable subsitution to apply to hive

commands. e.g. --hivevar A=B

-i Initialization SQL file

-S,--silent Silent mode in interactive shell

-v,--verbose Verbose mode (echo executed SQL to the console)

1)在Hive命令行里创建一个表student,并插入1条数据

hive (default)> create table student(id int,name string);

OK

Time taken: 1.291 seconds

hive (default)> insert into table student values(1,"zhangsan");

hive (default)> select * from student;

OK

student.id student.name

1 zhangsan

Time taken: 0.144 seconds, Fetched: 1 row(s)

2)“-e”不进入hive的交互窗口执行hql语句

[atguigu@hadoop102 hive]$ bin/hive -e "select id from student;"

3)“-f”执行脚本中的hql语句

(1)在/opt/module/hive/下创建datas目录并在datas目录下创建hivef.sql文件

[atguigu@hadoop102 hive]$ mkdir datas

[atguigu@hadoop102 datas]$ vim hivef.sql

(2)文件中写入正确的hql语句

select * from student;

(3)执行文件中的hql语句

[atguigu@hadoop102 hive]$ bin/hive -f /opt/module/hive/datas/hivef.sql

(4)执行文件中的hql语句并将结果写入文件中

[atguigu@hadoop102 hive]$ bin/hive -f /opt/module/hive/datas/hivef.sql > /opt/module/hive/datas/hive_result.txt

2.6.2 Hive参数配置方式

1)查看当前所有的配置信息

hive>set;

2)参数的配置三种方式

(1)配置文件方式

- 默认配置文件:hive-default.xml

- 用户自定义配置文件:hive-site.xml

注意:用户自定义配置会覆盖默认配置。另外,Hive也会读入Hadoop的配置,因为Hive是作为Hadoop的客户端启动的,Hive的配置会覆盖Hadoop的配置。配置文件的设定对本机启动的所有Hive进程都有效。

(2)命令行参数方式

①启动Hive时,可以在命令行添加-hiveconf param=value来设定参数。例如:

[atguigu@hadoop103 hive]$ bin/hive -hiveconf mapreduce.job.reduces=10;

注意:仅对本次Hive启动有效。

②查看参数设置

hive (default)> set mapreduce.job.reduces;

(3)参数声明方式

可以在HQL中使用SET关键字设定参数,例如:

hive(default)> set mapreduce.job.reduces=10;

注意:仅对本次Hive启动有效。

查看参数设置:

hive(default)> set mapreduce.job.reduces;

上述三种设定方式的优先级依次递增。即配置文件 < 命令行参数 < 参数声明。注意某些系统级的参数,例如log4j相关的设定,必须用前两种方式设定,因为那些参数的读取在会话建立以前已经完成了。

2.6.3 Hive常见属性配置

1)Hive客户端显示当前库和表头

(1)在hive-site.xml中加入如下两个配置:

[atguigu@hadoop102 conf]$ vim hive-site.xml

hive.cli.print.header</name>

true</value>

Whether to print the names of the columns in query output.</description>

</property>

hive.cli.print.current.db</name>

true</value>

Whether to include the current database in the Hive prompt.</description>

</property>

(2)hive客户端在运行时可以显示当前使用的库和表头信息

[atguigu@hadoop102 conf]$ hive

hive (default)> select * from stu;

OK

stu.id stu.name

1 ss

Time taken: 1.874 seconds, Fetched: 1 row(s)

hive (default)>

2)Hive运行日志路径配置

(1)Hive的log默认存放在/tmp/atguigu/hive.log目录下(当前用户名下)

[atguigu@hadoop102 atguigu]$ pwd

/tmp/atguigu

[atguigu@hadoop102 atguigu]$ ls

hive.log

hive.log.2022-06-27

(2)修改Hive的log存放日志到/opt/module/hive/logs

修改$HIVE_HOME/conf/hive-log4j2.properties.template文件名称为hive-log4j2.properties

[atguigu@hadoop102 conf]$ pwd

/opt/module/hive/conf

[atguigu@hadoop102 conf]$ mv hive-log4j2.properties.template hive-log4j2.properties

在hive-log4j2.properties文件中修改log存放位置

[atguigu@hadoop102 conf]$ vim hive-log4j2.properties

修改配置如下

property.hive.log.dir=/opt/module/hive/logs

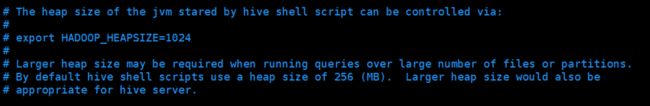

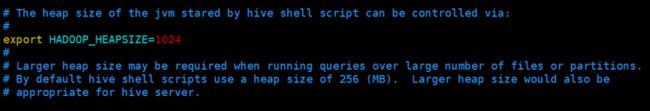

3)Hive的JVM堆内存设置

新版本的Hive启动的时候,默认申请的JVM堆内存大小为256M,JVM堆内存申请的太小,导致后期开启本地模式,执行复杂的SQL时经常会报错:java.lang.OutOfMemoryError: Java heap space,因此最好提前调整一下HADOOP_HEAPSIZE这个参数。

(1)修改$HIVE_HOME/conf下的hive-env.sh.template为hive-env.sh

[atguigu@hadoop102 conf]$ pwd

/opt/module/hive/conf

[atguigu@hadoop102 conf]$ mv hive-env.sh.template hive-env.sh

(2)将hive-env.sh其中的参数 export HADOOP_HEAPSIZE修改为2048,重启Hive。

修改前

# The heap size of the jvm stared by hive shell script can be controlled via:

# export HADOOP_HEAPSIZE=1024

修改后

# The heap size of the jvm stared by hive shell script can be controlled via:

export HADOOP_HEAPSIZE=2048

4)关闭Hadoop虚拟内存检查

在yarn-site.xml中关闭虚拟内存检查(虚拟内存校验,如果已经关闭了,就不需要配了)。

(1)修改前记得先停Hadoop

[atguigu@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.1.3/etc/hadoop

[atguigu@hadoop102 hadoop]$ vim yarn-site.xml

(2)添加如下配置

yarn.nodemanager.vmem-check-enabled</name>

false</value>

</property>

(3)修改完后记得分发yarn-site.xml,并重启yarn。

3、DDL 数据定义

3.1 数据库(database)

3.1.1 创建数据库

语法

CREATE DATABASE [IF NOT EXISTS] database_name

[COMMENT database_comment]

[LOCATION hdfs_path]

[WITH DBPROPERTIES (property_name=property_value, ...)];

案例

(1)创建一个数据库,不指定路径

hive (default)> create database db_hive1;

注:若不指定路径,其默认路径为${hive.metastore.warehouse.dir}/database_name.db

(2)创建一个数据库,指定路径

hive (default)> create database db_hive2 location ‘/db_hive2’;

(2)创建一个数据库,带有dbproperties

hive (default)> create database db_hive3 with dbproperties(‘create_date’=‘2022-11-18’);

3.1.2 查询数据库

1)展示所有数据库

(1)语法

SHOW DATABASES [LIKE 'identifier_with_wildcards'];

注:like通配表达式说明:*表示任意个任意字符,|表示或的关系。

(2)案例

hive> show databases like 'db_hive*';

OK

db_hive_1

db_hive_2

2)查看数据库信息

(1)语法

DESCRIBE DATABASE [EXTENDED] db_name;

(2)案例

1查看基本信息

hive> desc database db_hive3;

OK

db_hive hdfs://hadoop102:8020/user/hive/warehouse/db_hive.db atguigu USER

2查看更多信息

hive> desc database extended db_hive3;

OK

db_name comment location owner_name owner_type parameters

db_hive3 hdfs://hadoop102:8020/user/hive/warehouse/db_hive3.db atguigu USER {create_date=2022-11-18}

3.1.3 修改数据库

用户可以使用alter database命令修改数据库某些信息,其中能够修改的信息包括dbproperties、location、owner user。需要注意的是:修改数据库location,不会改变当前已有表的路径信息,而只是改变后续创建的新表的默认的父目录。

1)语法

--修改dbproperties

ALTER DATABASE database_name SET DBPROPERTIES (property_name=property_value, ...);

--修改location

ALTER DATABASE database_name SET LOCATION hdfs_path;

--修改owner user

ALTER DATABASE database_name SET OWNER USER user_name;

2)案例

(1)修改dbproperties

hive> ALTER DATABASE db_hive3 SET DBPROPERTIES ('create_date'='2022-11-20');

3.1.4 删除数据库

1)语法

DROP DATABASE [IF EXISTS] database_name [RESTRICT|CASCADE];

注:RESTRICT:严格模式,若数据库不为空,则会删除失败,默认为该模式。

CASCADE:级联模式,若数据库不为空,则会将库中的表一并删除。

2)案例

(1)删除空数据库

hive> drop database db_hive2;

(2)删除非空数据库

hive> drop database db_hive3 cascade;

3.1.5 切换当前数据库

1)语法

USE database_name;

3.2 表(table)

3.2.1 创建表

1)普通建表

完整语法

语法

CREATE [TEMPORARY] [EXTERNAL] TABLE [IF NOT EXISTS] [db_name.]table_name

[(col_name data_type [COMMENT col_comment], ...)]

[COMMENT table_comment]

[PARTITIONED BY (col_name data_type [COMMENT col_comment], ...)]

[CLUSTERED BY (col_name, col_name, ...)

[SORTED BY (col_name [ASC|DESC], ...)] INTO num_buckets BUCKETS]

[ROW FORMAT row_format]

[STORED AS file_format]

[LOCATION hdfs_path]

[TBLPROPERTIES (property_name=property_value, ...)]

关键字说明:

- TEMPORARY

临时表,该表只在当前会话可见,会话结束,表会被删除。 - EXTERNAL(重点)

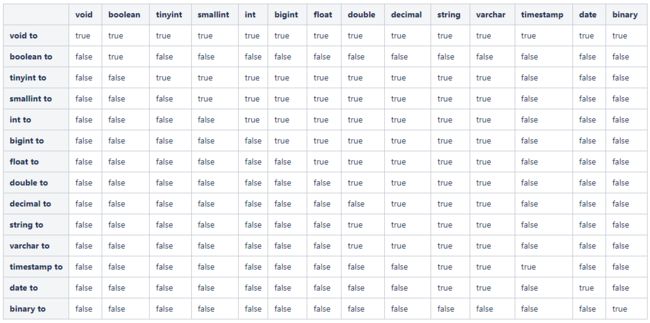

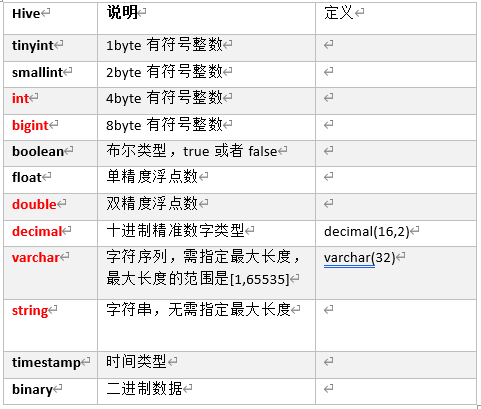

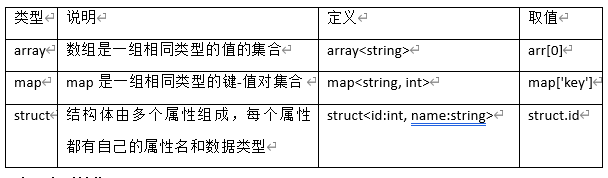

外部表,与之相对应的是内部表(管理表)。管理表意味着Hive会完全接管该表,包括元数据和HDFS中的数据。而外部表则意味着Hive只接管元数据,而不完全接管HDFS中的数据。 - data_type(重点)

Hive中的字段类型可分为基本数据类型和复杂数据类型。

基本数据类型如下:

复杂数据类型如下:

注:类型转换

Hive的基本数据类型可以做类型转换,转换的方式包括隐式转换以及显示转换。

方式一:隐式转换

具体规则如下:

a. 任何整数类型都可以隐式地转换为一个范围更广的类型,如tinyint可以转换成int,int可以转换成bigint。

b.所有整数类型、float和string类型都可以隐式地转换成double。

c. tinyint、smallint、int都可以转换为float。

d. boolean类型不可以转换为任何其它的类型。

详情可参考Hive官方说明:Allowed Implicit Conversions

https://cwiki.apache.org/confluence/display/hive/languagemanual+types#LanguageManualTypes-AllowedImplicitConversions

方式二:显示转换

可以借助cast函数完成显示的类型转换

a.语法

cast(expr as <type>)

b.案例

hive (default)> select '1' + 2, cast('1' as int) + 2;

_c0 _c1

3.0 3

- PARTITIONED BY(重点)

创建分区表 - CLUSTERED BY … SORTED BY…INTO … BUCKETS(重点)

创建分桶表 - ROW FORMAT(重点)

指定SERDE,SERDE是Serializer and Deserializer的简写。Hive使用SERDE序列化和反序列化每行数据。

详情可参考 Hive-Serde。

https://cwiki.apache.org/confluence/display/Hive/DeveloperGuide#DeveloperGuide-HiveSerDe

表的读写流程

HDFS files --> InputFileFormat --> , value> --> Deserializer --> Row object

Row object --> Serializer --> , value> --> OutputFileFormat --> HDFS files

语法说明如下:

语法一:DELIMITED关键字表示对文件中的每个字段按照特定分割符进行分割,其会使用默认的SERDE对每行数据进行序列化和反序列化。

ROW FORAMT DELIMITED

[FIELDS TERMINATED BY char]

[COLLECTION ITEMS TERMINATED BY char]

[MAP KEYS TERMINATED BY char]

[LINES TERMINATED BY char]

[NULL DEFINED AS char]

注:

fields terminated by :列分隔符

collection items terminated by : map、struct和array中每个元素之间的分隔符

map keys terminated by :map中的key与value的分隔符

lines terminated by :行分隔符

语法二:SERDE关键字可用于指定其他内置的SERDE或者用户自定义的SERDE。例如JSON SERDE,可用于处理JSON字符串。

ROW FORMAT SERDE serde_name [WITH SERDEPROPERTIES

(property_name=property_value,property_name=property_value, ...)]

- STORED AS(重点)

指定文件格式,常用的文件格式有,textfile(默认值),sequence file,orc file、parquet file等等。 - LOCATION

指定表所对应的HDFS路径,若不指定路径,其默认值为

${hive.metastore.warehouse.dir}/db_name.db/table_name - TBLPROPERTIES

用于配置表的一些KV键值对参数

2)Create Table As Select(CTAS)建表

该语法允许用户利用select查询语句返回的结果,直接建表,表的结构和查询语句的结构保持一致,且保证包含select查询语句放回的内容。

CREATE [TEMPORARY] TABLE [IF NOT EXISTS] table_name

[COMMENT table_comment]

[ROW FORMAT row_format]

[STORED AS file_format]

[LOCATION hdfs_path]

[TBLPROPERTIES (property_name=property_value, ...)]

[AS select_statement]

3)Create Table Like语法

该语法允许用户复刻一张已经存在的表结构,与上述的CTAS语法不同,该语法创建出来的表中不包含数据。

CREATE [TEMPORARY] [EXTERNAL] TABLE [IF NOT EXISTS] [db_name.]table_name

[LIKE exist_table_name]

[ROW FORMAT row_format]

[STORED AS file_format]

[LOCATION hdfs_path]

[TBLPROPERTIES (property_name=property_value, ...)]

3.2.2 内部表与外部表

(1)内部表

Hive中默认创建的表都是的内部表,有时也被称为管理表。对于内部表,Hive会完全管理表的元数据和数据文件。

创建内部表如下:

create table if not exists student(

id int,

name string

)

row format delimited fields terminated by '\t'

location '/user/hive/warehouse/student';

准备其需要的文件如下,注意字段之间的分隔符。

[atguigu@hadoop102 datas]$ vim /opt/module/datas/student.txt

1001 student1

1002 student2

1003 student3

1004 student4

1005 student5

1006 student6

1007 student7

1008 student8

1009 student9

1010 student10

1011 student11

1012 student12

1013 student13

1014 student14

1015 student15

1016 student16

上传文件到Hive表指定的路径

[atguigu@hadoop102 datas]$ hadoop fs -put student.txt /user/hive/warehouse/student

删除表,观察数据HDFS中的数据文件是否还在

hive (default)> drop table student;

(2)外部表

外部表通常可用于处理其他工具上传的数据文件,对于外部表,Hive只负责管理元数据,不负责管理HDFS中的数据文件。

创建外部表如下:

create external table if not exists student(

id int,

name string

)

row format delimited fields terminated by '\t'

location '/user/hive/warehouse/student';

上传文件到Hive表指定的路径

[atguigu@hadoop102 datas]$ hadoop fs -put student.txt /user/hive/warehouse/student

删除表,观察数据HDFS中的数据文件是否还在

hive (default)> drop table student;

3.2.3 SERDE和复杂数据类型

本案例重点练习SERDE和复杂数据类型的使用。

若现有如下格式的JSON文件需要由Hive进行分析处理,请考虑如何设计表?

注:以下内容为格式化之后的结果,文件中每行数据为一个完整的JSON字符串。

{

"name": "dasongsong",

"friends": [

"bingbing",

"lili"

],

"students": {

"xiaohaihai": 18,

"xiaoyangyang": 16

},

"address": {

"street": "hui long guan",

"city": "beijing",

"postal_code": 10010

}

}

我们可以考虑使用专门负责JSON文件的JSON Serde,设计表字段时,表的字段与JSON字符串中的一级字段保持一致,对于具有嵌套结构的JSON字符串,考虑使用合适复杂数据类型保存其内容。最终设计出的表结构如下:

create table teacher

(

name string,

friends array,

students map,int>,

address struct,street:string,postal_code:int>

)

row format serde 'org.apache.hadoop.hive.serde2.JsonSerDe'

location '/user/hive/warehouse/teacher';

创建该表,并准备以下文件。注意,需要确保文件中每行数据都是一个完整的JSON字符串,JSON SERDE才能正确的处理。

[atguigu@hadoop102 datas]$ vim /opt/module/datas/teacher.txt

{"name":"dasongsong","friends":["bingbing","lili"],"students":{"xiaohaihai":18,"xiaoyangyang":16},"address":{"street":"hui long guan","city":"beijing","postal_code":10010}}

上传文件到Hive表指定的路径

[atguigu@hadoop102 datas]$ hadoop fs -put teacher.txt /user/hive/warehouse/teacher

尝试从复杂数据类型的字段中取值

select friends[0], students['xiaohaihai'], address.city from teacher;

3.2.4 create table as select和create table like

(1)create table as select

create table teacher1 as select * from teacher;

(2)create table like

create table teacher2 like teacher;

3.2.5 查看表

1)展示所有表

(1)语法

SHOW TABLES [IN database_name] LIKE ['identifier_with_wildcards'];

注:like通配表达式说明:*表示任意个任意字符,|表示或的关系。

(2)案例

show tables like 'stu*';

2)查看表信息

(1)语法

DESCRIBE [EXTENDED | FORMATTED] [db_name.]table_name

注:EXTENDED:展示详细信息

FORMATTED:对详细信息进行格式化的展示

(2)案例

查看基本信息

desc stu;

查看更多信息

desc formatted stu;

3.2.6 修改表

1)重命名表

(1)语法

ALTER TABLE table_name RENAME TO new_table_name

(2)案例

alter table stu rename to stu1;

2)修改列信息

(1)语法

○1增加列

该语句允许用户增加新的列,新增列的位置位于末尾。

ALTER TABLE table_name ADD COLUMNS (col_name data_type [COMMENT col_comment], ...)

○2更新列

该语句允许用户修改指定列的列名、数据类型、注释信息以及在表中的位置。

ALTER TABLE table_name CHANGE [COLUMN] col_old_name col_new_name column_type [COMMENT col_comment] [FIRST|AFTER column_name]

○3替换列

该语句允许用户用新的列集替换表中原有的全部列。

ALTER TABLE table_name REPLACE COLUMNS (col_name data_type [COMMENT col_comment], ...)

2)案例

(1)查询表结构

desc stu;

(2)添加列

alter table stu add columns(age int);

(3)查询表结构

desc stu;

(4)更新列

alter table stu change column age ages double;

(6)替换列

alter table stu replace columns(id int, name string);

3.2.7 删除表

1)语法

DROP TABLE [IF EXISTS] table_name;

2)案例

drop table stu;

3.2.8 清空表

1)语法

TRUNCATE [TABLE] table_name

注意:truncate只能清空管理表,不能删除外部表中数据。

2)案例

truncate table student;

4、DML 数据操作

4.1 Load

Load语句可将文件导入到Hive表中。

1)语法

LOAD DATA [LOCAL] INPATH 'filepath' [OVERWRITE] INTO TABLE tablename [PARTITION (partcol1=val1, partcol2=val2 ...)];

关键字说明:

(1)local:表示从本地加载数据到Hive表;否则从HDFS加载数据到Hive表。

(2)overwrite:表示覆盖表中已有数据,否则表示追加。

(3)partition:表示上传到指定分区,若目标是分区表,需指定分区。

2)实操案例

(0)创建一张表

create table student(

id int,

name string

)

row format delimited fields terminated by '\t';

(1)加载本地文件到hive

load data local inpath '/opt/module/datas/student.txt' overwrite into table student;

(2)加载HDFS文件到hive中

①上传文件到HDFS

hadoop fs -put /opt/module/datas/student.txt /user/atguigu

②加载HDFS上数据,导入完成后去HDFS上查看文件是否还存在

load data inpath '/user/atguigu/student.txt' into table student;

(3)加载数据覆盖表中已有的数据

①上传文件到HDFS

hive (default)> dfs -put /opt/module/datas/student.txt /user/atguigu;

②加载数据覆盖表中已有的数据

hive (default)>

load data inpath '/user/atguigu/student.txt' overwrite into table student;

4.2 Insert

4.2.1 将查询结果插入表中

语法:

INSERT (INTO | OVERWRITE) TABLE tablename [PARTITION (partcol1=val1, partcol2=val2 ...)] select_statement;

关键字说明:

INTO:将结果追加到目标表

OVERWRITE:用结果覆盖原有数据

案例:

-- 新建一张表

create table student1(

id int,

name string

)

row format delimited fields terminated by '\t';

-- 根据查询结果插入数据

insert overwrite table student1

select * from student;

4.2.2 将给定values插入表中

语法

INSERT (INTO | OVERWRITE) TABLE tablename [PARTITION (partcol1[=val1], partcol2[=val2] ...)]

VALUES values_row [, values_row ...]

案例

insert into table student1 values(55,'zhangsan'),(66,'lisi');

4.2.3 将查询结果写入目标路径

语法

INSERT OVERWRITE [LOCAL] DIRECTORY directory

[ROW FORMAT row_format] [STORED AS file_format] select_statement;

案例

只能overwrite

insert overwrite local directory '/opt/module/datas/student'

row format serde 'org.apache.hadoop.hive.serde2.JsonSerDe'

select * from stu;

4.3 Export&Import

Export导出语句可将表的数据和元数据信息一并到处的HDFS路径,Import可将Export导出的内容导入Hive,表的数据和元数据信息都会恢复。Export和Import可用于两个Hive实例之间的数据迁移。

语法

--导出

EXPORT TABLE tablename TO 'export_target_path'

--导入

IMPORT [EXTERNAL] TABLE new_or_original_tablename FROM 'source_path' [LOCATION 'import_target_path']

案例

--导出

export table default.student to '/user/hive/warehouse/export/student';

--导入

import table student2 from '/user/hive/warehouse/export/student';

5、查询

5.1 基础语法

SELECT [ALL | DISTINCT] select_expr, select_expr, ...

FROM table_reference -- 从什么表查

[WHERE where_condition] -- 过滤

[GROUP BY col_list] -- 分组查询

[HAVING col_list] -- 分组后过滤

[ORDER BY col_list] -- 排序

[CLUSTER BY col_list

| [DISTRIBUTE BY col_list] [SORT BY col_list]

]

[LIMIT number] -- 限制输出的行数

5.2 基本查询

5.2.1 数据准备

①在/opt/module/datas/路径上创建dept.txt文件,并赋值如下内容:

部门编号 部门名称 部门位置id

[atguigu@hadoop102 datas]$ vim dept.txt

10 行政部 1700

20 财务部 1800

30 教学部 1900

40 销售部 1700

②在/opt/module/datas/路径上创建emp.txt文件,并赋值如下内容:

员工编号 姓名 岗位 薪资 部门

[atguigu@hadoop102 datas]$ vim emp.txt

7369 张三 研发 800.00 30

7499 李四 财务 1600.00 20

7521 王五 行政 1250.00 10

7566 赵六 销售 2975.00 40

7654 侯七 研发 1250.00 30

7698 马八 研发 2850.00 30

7782 金九 \N 2450.0 30

7788 银十 行政 3000.00 10

7839 小芳 销售 5000.00 40

7844 小明 销售 1500.00 40

7876 小李 行政 1100.00 10

7900 小元 讲师 950.00 30

7902 小海 行政 3000.00 10

7934 小红明 讲师 1300.00 30

(1)创建部门表

create table if not exists dept(

deptno int, -- 部门编号

dname string, -- 部门名称

loc int -- 部门位置

)

row format delimited fields terminated by '\t';

(2)创建员工表

create table if not exists emp(

empno int, -- 员工编号

ename string, -- 员工姓名

job string, -- 员工岗位(大数据工程师、前端工程师、java工程师)

sal double, -- 员工薪资

deptno int -- 部门编号

)

row format delimited fields terminated by '\t';

(3)导入数据

load data local inpath '/opt/module/datas/dept.txt' into table dept;

load data local inpath '/opt/module/datas/emp.txt' into table emp;

5.2.2 全表和特定列查询

全表和特定列查询

1)全表查询

hive (default)> select * from emp;

2)选择特定列查询

hive (default)> select empno, ename from emp;

注意:

(1)SQL 语言大小写不敏感。

(2)SQL 可以写在一行或者多行。

(3)关键字不能被缩写也不能分行。

(4)各子句一般要分行写。

(5)使用缩进提高语句的可读性。

5.2.3 列别名

1)重命名一个列

2)便于计算

3)紧跟列名,也可以在列名和别名之间加入关键字‘AS’

4)案例实操

查询名称和部门。

select

ename AS name,

deptno dn

from emp;

5.2.4 Limit语句

典型的查询会返回多行数据。limit子句用于限制返回的行数。

hive (default)> select * from emp limit 5;

hive (default)> select * from emp limit 2,3; -- 表示从第2行开始,向下抓取3行

5.2.5 Where语句

1)使用where子句,将不满足条件的行过滤掉

2)where子句紧随from子句

3)案例实操

查询出薪水大于1000的所有员工。

hive (default)> select * from emp where sal > 1000;

注意:where子句中不能使用字段别名。

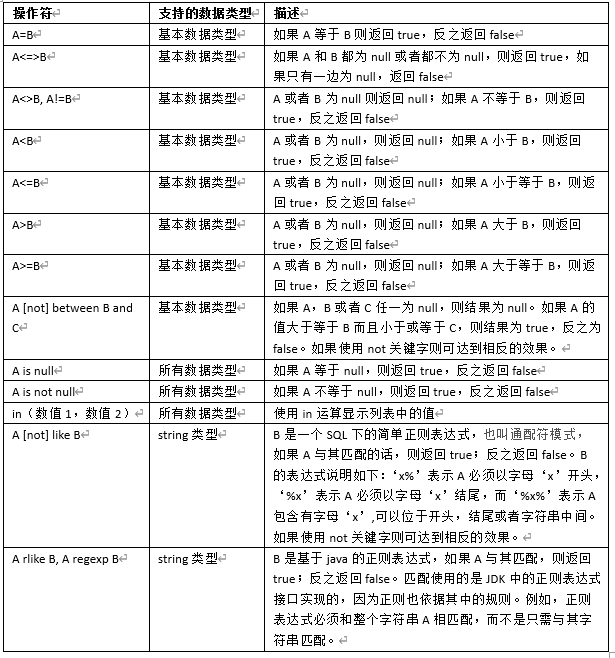

5.2.6 关系运算函数

1)基本语法

如下操作符主要用于where和having语句中。

5.2.7 逻辑运算函数

2)案例实操

(1)查询薪水大于1000,部门是30

hive (default)>

select

*

from emp

where sal > 1000 and deptno = 30;

(2)查询薪水大于1000,或者部门是30

hive (default)>

select

*

from emp

where sal>1000 or deptno=30;

(3)查询除了20部门和30部门以外的员工信息

hive (default)>

select

*

from emp

where deptno not in(30, 20);

5.2.8 聚合函数

语法

count(*),表示统计所有行数,包含null值;

count(某列),表示该列一共有多少行,不包含null值;

max(),求最大值,不包含null,除非所有值都是null;

min(),求最小值,不包含null,除非所有值都是null;

sum(),求和,不包含null。

avg(),求平均值,不包含null。

5.3 分组

5.3.1 Group By

Group By语句通常会和聚合函数一起使用,按照一个或者多个列队结果进行分组,然后对每个组执行聚合操作。

-- 计算emp表每个部门的平均工资

select

t.deptno,

avg(t.sal) avg_sal

from emp t

group by t.deptno;

-- 计算emp每个部门中每个岗位的最高薪水。

select

t.deptno,

t.job,

max(t.sal) max_sal

from emp t

group by t.deptno, t.job;

5.3.2 Having

-- 求每个部门的平均薪水大于2000的部门

select deptno,avg_sal from (

select

t.deptno,

avg(t.sal) avg_sal

from emp t

group by deptno

)t1

where avg_sal>2000;

select

t.deptno,

avg(t.sal) avg_sal

from emp t

group by deptno

having avg_sal>2000;

5.4 Join

5.4.1 等值join

Hive支持通常的sql join语句,但是只支持等值连接,不支持非等值连接。

1)案例实操

(1)根据员工表和部门表中的部门编号相等,查询员工编号、员工名称和部门名称。

select

e.empno,

e.ename,

d.dname

from emp e

join dept d

on e.deptno = d.deptno;

5.4.2 表的别名

1)好处

(1)使用别名可以简化查询。

(2)区分字段的来源。

2)案例实操

合并员工表和部门表。

select

e.*,

d.*

from emp e

join dept d

on e.deptno = d.deptno;

5.4.3 内连接

内连接:只有进行连接的两个表中都存在与连接条件相匹配的数据才会被保留下来。

select

e.empno,

e.ename,

d.deptno

from emp e

inner join dept d

on e.deptno = d.deptno;

5.4.4 左外连接

左外连接

左外连接:join操作符左边表中符合where子句的所有记录将会被返回。

select

e.empno,

e.ename,

d.deptno

from emp e

left join dept d

on e.deptno = d.deptno;

5.4.5 右外连接

右外连接:join操作符右边表中符合where子句的所有记录将会被返回。

select

e.empno,

e.ename,

d.deptno

from emp e

right join dept d

on e.deptno = d.deptno;

5.4.6 满外连接

满外连接:将会返回所有表中符合where语句条件的所有记录。如果任一表的指定字段没有符合条件的值的话,那么就使用null值替代。

select

e.empno,

e.ename,

d.deptno

from emp e

full join dept d

on e.deptno = d.deptno;

5.4.7 多表连接

注意:连接n个表,至少需要n-1个连接条件。例如:连接三个表,至少需要两个连接条件。

数据准备,在/opt/module/hive/datas/下:vim location.txt

部门位置id 部门位置

[atguigu@hadoop102 datas]$ vim location.txt

1700 北京

1800 上海

1900 深圳

1)创建位置表

create table if not exists location(

loc int, -- 部门位置id

loc_name string -- 部门位置

)

row format delimited fields terminated by '\t';

2)导入数据

hive (default)> load data local inpath '/opt/module/datas/location.txt' into table location;

3)多表连接查询

select

e.ename,

d.dname,

l.loc_name

from emp e

join dept d

on d.deptno = e.deptno

join location l

on d.loc = l.loc;

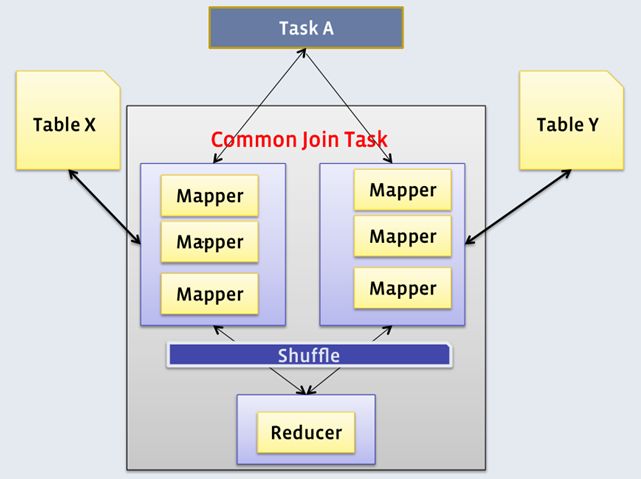

大多数情况下,Hive会对每对join连接对象启动一个MapReduce任务。本例中会首先启动一个MapReduce job对表e和表d进行连接操作,然后会再启动一个MapReduce job将第一个MapReduce job的输出和表l进行连接操作。

注意:为什么不是表d和表l先进行连接操作呢?这是因为Hive总是按照从左到右的顺序执行的。

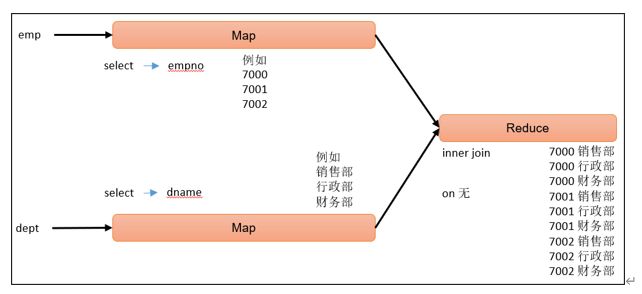

5.4.8 笛卡尔集

1)笛卡尔集会在下面条件下产生

(1)省略连接条件

(2)连接条件无效

(3)所有表中的所有行互相连接

2)案例实操

select

empno,

dname

from emp, dept;

hive sql执行过程:

5.4.9 联合(union & union all)

1)union&union all上下拼接

union和union all都是上下拼接sql的结果,这点是和join有区别的,join是左右关联,union和union all是上下拼接。union去重,union all不去重。

union和union all在上下拼接sql结果时有两个要求:

(1)两个sql的结果,列的个数必须相同

(2)两个sql的结果,上下所对应列的类型必须一致

2)案例实操

将员工表30部门的员工信息和40部门的员工信息,利用union进行拼接显示。

select

*

from emp

where deptno=30

union

select

*

from emp

where deptno=40;

5.5 排序

5.5.1 全局排序(Order By)

Order By:全局排序,只有一个Reduce。

1)使用Order By子句排序

asc(ascend):升序(默认)

desc(descend):降序

2)Order By子句在select语句的结尾

3)基础案例实操

(1)查询员工信息按工资升序排列

select

*

from emp

order by sal;

(2)查询员工信息按工资降序排列

select

*

from emp

order by sal desc;

4)按照别名排序案例实操

按照员工薪水的2倍排序。

select

ename,

sal * 2 twosal

from emp

order by twosal;

5)多个列排序案例实操

按照部门和工资升序排序。

select

ename,

deptno,

sal

from emp

order by deptno, sal;

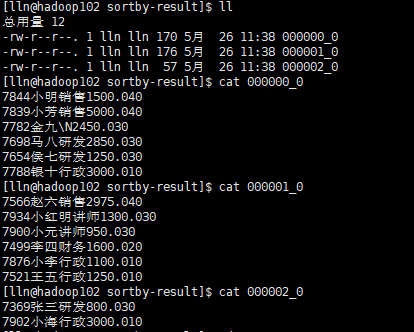

5.5.2 每个Reduce内部排序(Sort By)

Sort By:对于大规模的数据集order by的效率非常低。在很多情况下,并不需要全局排序,此时可以使用Sort by。

Sort by为每个reduce产生一个排序文件。每个Reduce内部进行排序,对全局结果集来说不是排序。

1)设置reduce个数

hive (default)> set mapreduce.job.reduces=3;

2)查看设置reduce个数

hive (default)> set mapreduce.job.reduces;

3)根据部门编号降序查看员工信息

hive (default)>

select

*

from emp

sort by deptno desc;

4)将查询结果导入到文件中(按照部门编号降序排序)

hive (default)> insert overwrite local directory '/opt/module/datas/sortby-result'

select * from emp sort by deptno desc;

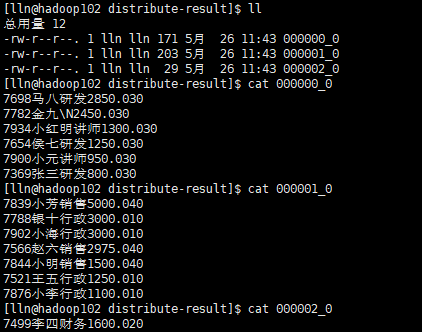

5.5.3 分区(Distribute By)

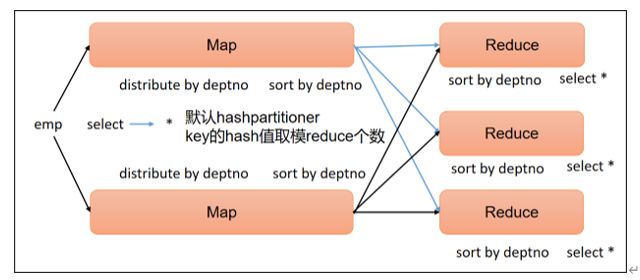

Distribute By:在有些情况下,我们需要控制某个特定行应该到哪个Reducer,通常是为了进行后续的聚集操作。distribute by子句可以做这件事。distribute by类似MapReduce中partition(自定义分区),进行分区,结合sort by使用。

对于distribute by进行测试,一定要分配多reduce进行处理,否则无法看到distribute by的效果。

1)案例实操:

(1)先按照部门编号分区,再按照员工编号薪资排序

hive (default)> set mapreduce.job.reduces=3;

hive (default)>

insert overwrite local directory

'/opt/module/datas/distribute-result'

select

*

from emp

distribute by deptno

sort by sal desc;

注意:

distribute by的分区规则是根据分区字段的hash码与reduce的个数进行相除后,余数相同的分到一个区。

Hive要求distribute by语句要写在sort by语句之前。

演示完以后mapreduce.job.reduces的值要设置回-1,否则下面分区or分桶表load跑MapReduce的时候会报错。

5.5.4 分区排序(Cluster By)

当distribute by和sort by字段相同时,可以使用cluster by方式。

cluster by除了具有distribute by的功能外还兼具sort by的功能。但是排序只能是升序排序,不能指定排序规则为asc或者desc。

以下两种写法等价

hive (default)>

select

*

from emp

cluster by deptno;

hive (default)>

select

*

from emp

distribute by deptno

sort by deptno;

注意:按照部门编号分区,不一定就是固定死的数值,可以是20号和30号部门分到一个分区里面去。

hive sql执行过程:

6、函数

6.1 函数简介

Hive会将常用的逻辑封装成函数给用户进行使用,类似于Java中的函数。

好处:避免用户反复写逻辑,可以直接拿来使用。

重点:用户需要知道函数叫什么,能做什么。

Hive提供了大量的内置函数,按照其特点可大致分为如下几类:单行函数、聚合函数、炸裂函数、窗口函数。

以下命令可用于查询所有内置函数的相关信息。

1)查看系统内置函数

hive> show functions;

2)查看内置函数用法

hive> desc function upper;

3)查看内置函数详细信息

hive> desc function extended upper;

6.2 单行函数

单行函数的特点是一进一出,即输入一行,输出一行。

单行函数按照功能可分为如下几类: 日期函数、字符串函数、集合函数、数学函数、流程控制函数等。

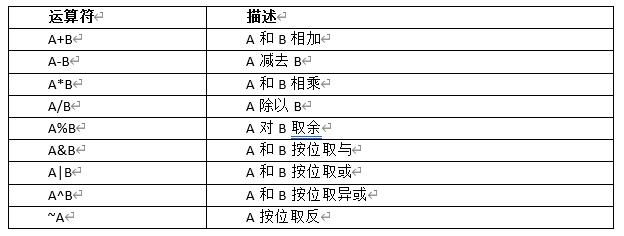

6.2.1 算术运算函数

案例实操:查询出所有员工的薪水后加1显示。

hive (default)> select sal + 1 from emp;

6.2.2 数值函数

1)round:四舍五入

hive> select round(3.3); 3

select round(1.123456,2); 1.12

select round(-1.5); -2

2)ceil:向上取整

hive> select ceil(3.1) ; 4

3)floor:向下取整

hive> select floor(4.8); 4

6.2.3 字符串函数

1)substring:截取字符串

语法一:substring(string A, int start)

返回值:string

说明:返回字符串A从start位置到结尾的字符串

语法二:substring(string A, int start, int len)

返回值:string

说明:返回字符串A从start位置开始,长度为len的字符串

案例实操:

(1)获取第二个字符以后的所有字符

hive> select substring("atguigu",2);

输出:

tguigu

(2)获取倒数第三个字符以后的所有字符

hive> select substring("atguigu",-3);

输出:

igu

(3)从第3个字符开始,向后获取2个字符

hive> select substring("atguigu",3,2);

输出:

gu

2)replace :替换

语法:replace(string A, string B, string C)

返回值:string

说明:将字符串A中的子字符串B替换为C。

hive> select replace('atguigu', 'a', 'A')

输出:

hive> Atguigu

3)regexp_replace:正则替换

语法:regexp_replace(string A, string B, string C)

返回值:string

说明:将字符串A中的符合java正则表达式B的部分替换为C。注意,在有些情况下要使用转义字符。

案例实操:

hive> select regexp_replace('100-200', '(\\d+)', 'num')

输出:

hive> num-num

正则表达式可视化

https://www.wangwl.net/static/projects/visualRegex#

4)regexp:正则匹配

语法:字符串 regexp 正则表达式

返回值:boolean

说明:若字符串符合正则表达式,则返回true,否则返回false。

(1)正则匹配成功,输出true

hive> select 'dfsaaaa' regexp 'dfsa+'

输出:

hive> true

(2)正则匹配失败,输出false

hive> select 'dfsaaaa' regexp 'dfsb+';

输出:

hive> false

5)repeat:重复字符串

语法:repeat(string A, int n)

返回值:string

说明:将字符串A重复n遍。

hive> select repeat('123', 3);

输出:

hive> 123123123

6)split :字符串切割

语法:split(string str, string pat)

返回值:array

说明:按照正则表达式pat匹配到的内容分割str,分割后的字符串,以数组的形式返回。

hive> select split('a-b-c-d','-');

输出:

hive> ["a","b","c","d"]

7)nvl :替换null值

语法:nvl(A,B)

说明:若A的值不为null,则返回A,否则返回B。

hive> select nvl(null,1);

输出:

hive> 1

8)concat :拼接字符串

语法:concat(string A, string B, string C, ……)

返回:string

说明:将A,B,C……等字符拼接为一个字符串

hive> select concat('beijing','-','shanghai','-','shenzhen');

输出:

hive> beijing-shanghai-shenzhen

9)concat_ws:以指定分隔符拼接字符串或者字符串数组

语法:concat_ws(string A, string…| array(string))

返回值:string

说明:使用分隔符A拼接多个字符串,或者一个数组的所有元素。

hive>select concat_ws('-','beijing','shanghai','shenzhen');

输出:

hive> beijing-shanghai-shenzhen

hive> select concat_ws('-',array('beijing','shenzhen','shanghai'));

输出:

hive> beijing-shanghai-shenzhen

10)get_json_object:解析json字符串

语法:get_json_object(string json_string, string path)

返回值:string

说明:解析json的字符串json_string,返回path指定的内容。如果输入的json字符串无效,那么返回NULL。

案例实操:

(1)获取json数组里面的json具体数据

hive> select get_json_object('[{"name":"大海海","sex":"男","age":"25"},{"name":"小宋宋","sex":"男","age":"47"}]','$.[0].name');

输出:

hive> 大海海

(2)获取json数组里面的数据

hive> select get_json_object('[{"name":"大海海","sex":"男","age":"25"},{"name":"小宋宋","sex":"男","age":"47"}]','$.[0]');

输出:

hive> {"name":"大海海","sex":"男","age":"25"}

6.2.4 日期函数

1)unix_timestamp:返回当前或指定时间的时间戳

语法:unix_timestamp()

返回值:bigint

案例实操:

hive> select unix_timestamp('2022/08/08 08-08-08','yyyy/MM/dd HH-mm-ss');

输出:

1659946088

说明:-前面是日期后面是指,日期传进来的具体格式

2)from_unixtime:转化UNIX时间戳(从 1970-01-01 00:00:00 UTC 到指定时间的秒数)到当前时区的时间格式

语法:from_unixtime(bigint unixtime[, string format])

返回值:string

案例实操:

hive> select from_unixtime(1659946088);

输出:

2022-08-08 08:08:08

--将0时区的时间戳转成东八区的时间

select from_utc_timestamp(1685088087*1000L,'GMT+8');

select from_utc_timestamp(cast(1685088087 as bigint)*1000,'GMT+8');

select date_format(from_utc_timestamp(cast(1685088087 as bigint)*1000,'GMT+8'),'yyyy-MM-dd HH:mm:ss');

3)current_date:当前日期

hive> select current_date();

输出:

2022-07-11

4)current_timestamp:当前的日期加时间,并且精确的毫秒

hive> select current_timestamp;

输出:

2023-05-26 16:08:43.394000000

5)month:获取日期中的月

语法:month (string date)

返回值:int

案例实操:

hive> select month('2022-08-08 08:08:08');

输出:

8

6)day:获取日期中的日

语法:day (string date)

返回值:int

案例实操:

hive> select day('2022-08-08 08:08:08')

输出:

8

7)hour:获取日期中的小时

语法:hour (string date)

返回值:int

案例实操:

hive> select hour('2022-08-08 08:08:08');

输出:

8

8)datediff:两个日期相差的天数(结束日期减去开始日期的天数)

语法:datediff(string enddate, string startdate)

返回值:int

案例实操:

hive> select datediff('2021-08-08','2022-10-09');

输出:

-427

9)date_add:日期加天数

语法:date_add(string startdate, int days)

返回值:string

说明:返回开始日期 startdate 增加 days 天后的日期

案例实操:

hive> select date_add('2022-08-08',2);

输出:

2022-08-10

10)date_sub:日期减天数

语法:date_sub (string startdate, int days)

返回值:string

说明:返回开始日期startdate减少days天后的日期。

案例实操:

hive> select date_sub('2022-08-08',2);

输出:

2022-08-06

11)date_format:将标准日期解析成指定格式字符串

hive> select date_format('2022-08-08','yyyy年-MM月-dd日')

输出:

2022年-08月-08日

6.2.5 流程控制函数

1)case when:条件判断函数

语法一:case when a then b [when c then d]* [else e] end

返回值:T

说明:如果a为true,则返回b;如果c为true,则返回d;否则返回 e

hive> select case when 1=2 then 'tom' when 2=2 then 'mary' else 'tim' end from tabl eName;

mary

语法二: case a when b then c [when d then e]* [else f] end

返回值: T

说明:如果a等于b,那么返回c;如果a等于d,那么返回e;否则返回f

hive> select case 100 when 50 then 'tom' when 100 then 'mary' else 'tim' end from t ableName;

mary

2)if: 条件判断,类似于Java中三元运算符

语法:if(boolean testCondition, T valueTrue, T valueFalseOrNull)

返回值:T

说明:当条件testCondition为true时,返回valueTrue;否则返回valueFalseOrNull

(1)条件满足,输出正确

hive> select if(10 > 5,'正确','错误');

输出:正确

(2)条件满足,输出错误

hive> select if(10 < 5,'正确','错误');

输出:错误

6.2.6 集合函数

1)size:集合中元素的个数

hive> select size(friends) from test; --2/2 每一行数据中的friends集合里的个数

2)map:创建map集合

语法:map (key1, value1, key2, value2, …)

说明:根据输入的key和value对构建map类型

案例实操:

hive> select map('xiaohai',1,'dahai',2);

输出:

hive> {"xiaohai":1,"dahai":2}

3)map_keys: 返回map中的key

hive> select map_keys(map('xiaohai',1,'dahai',2));

输出:

hive>["xiaohai","dahai"]

4)map_values: 返回map中的value

hive> select map_values(map('xiaohai',1,'dahai',2));

输出:

hive>[1,2]

5)array 声明array集合

语法:array(val1, val2, …)

说明:根据输入的参数构建数组array类

案例实操:

hive> select array('1','2','3','4');

输出:

hive>["1","2","3","4"]

6)array_contains: 判断array中是否包含某个元素

hive> select array_contains(array('a','b','c','d'),'a');

输出:

hive> true

7)sort_array:将array中的元素排序

hive> select sort_array(array('a','d','c'));

输出:

hive> ["a","c","d"]

8)struct声明struct中的各属性

语法:struct(val1, val2, val3, …)

说明:根据输入的参数构建结构体struct类

案例实操:

hive> select struct('name','age','weight');

输出:

hive> {"col1":"name","col2":"age","col3":"weight"}

9)named_struct声明struct的属性和值

hive> select named_struct('name','xiaosong','age',18,'weight',80);

输出:

hive> {"name":"xiaosong","age":18,"weight":80}

6.3 高级聚合函数

多进一出 (多行传入,一个行输出)。

1)普通聚合 count/sum

2)collect_list 收集并形成list集合,结果不去重

select

sex,

collect_list(job)

from

employee

group by

sex

结果:

女 ["行政","研发","行政","前台"]

男 ["销售","研发","销售","前台"]

3)collect_set 收集并形成set集合,结果去重

select

sex,

collect_set(job)

from

employee

group by

sex

结果:

女 ["行政","研发","前台"]

男 ["销售","研发","前台"]

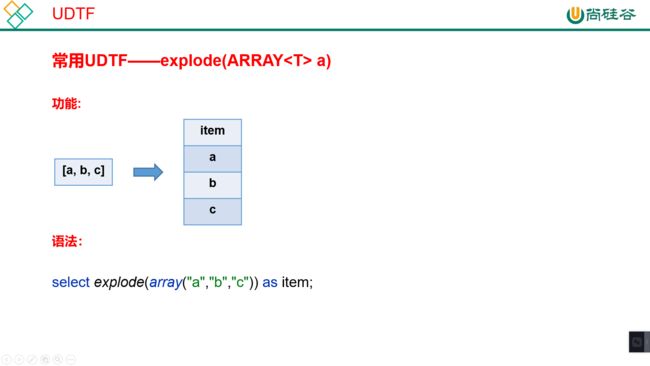

6.4 炸裂函数

案例演示

1.数据准备

1)表结构

| movie | category |

|---|---|

| 《疑犯追踪》 | 悬疑,动作,科幻,剧情 |

| 《Lie to me》 | 悬疑,警匪,动作,心理,剧情 |

| 《战狼2》 | 战争,动作,灾难 |

2)建表语句

create table movie_info(

movie string, --电影名称

category string --电影分类

)

row format delimited fields terminated by "\t";

3)装载语句

insert overwrite table movie_info

values ("《疑犯追踪》", "悬疑,动作,科幻,剧情"),

("《Lie to me》", "悬疑,警匪,动作,心理,剧情"),

("《战狼2》", "战争,动作,灾难");

- 需求

1)需求说明

根据上述电影信息表,统计各分类的电影数量,期望结果如下:

剧情 2

动作 3

心理 1

悬疑 2

战争 1

灾难 1

科幻 1

警匪 1

2)答案

select

cate,

count(*)

from

(

select

movie,

cate

from

(

select

movie,

split(category,',') cates

from movie_info

)t1 lateral view explode(cates) tmp as cate

)t2

group by cate;

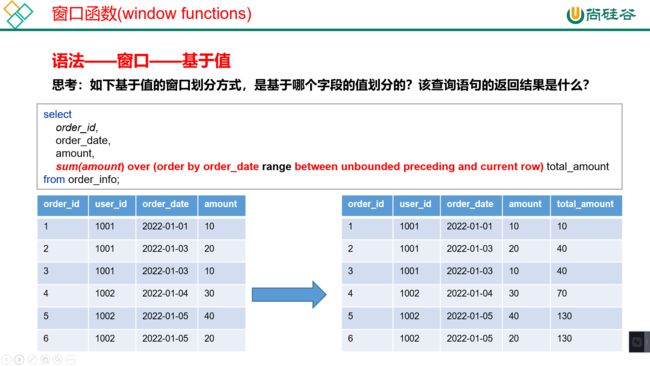

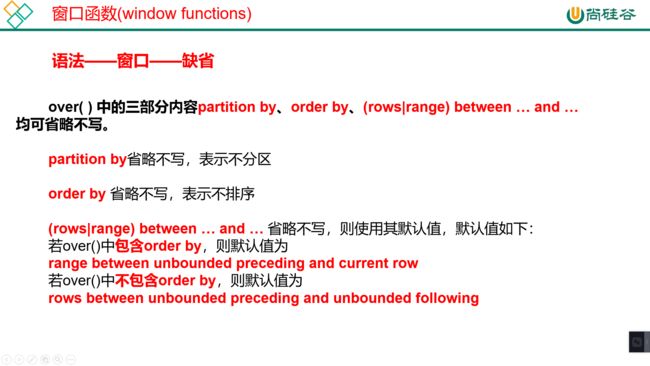

6.5 窗口函数

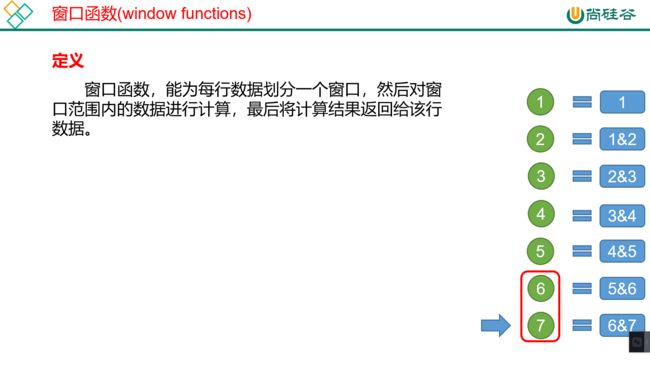

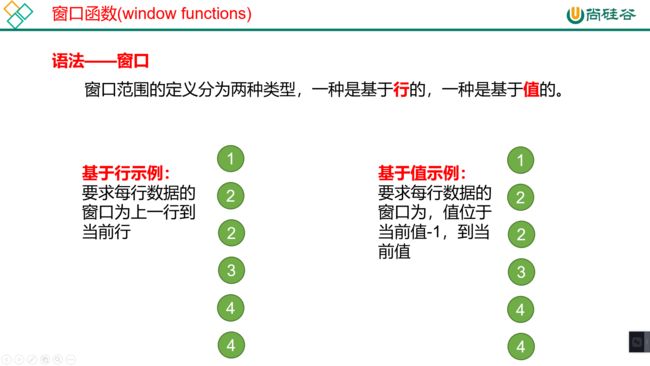

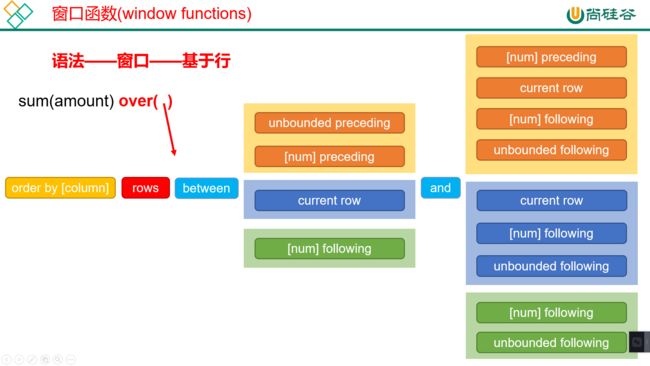

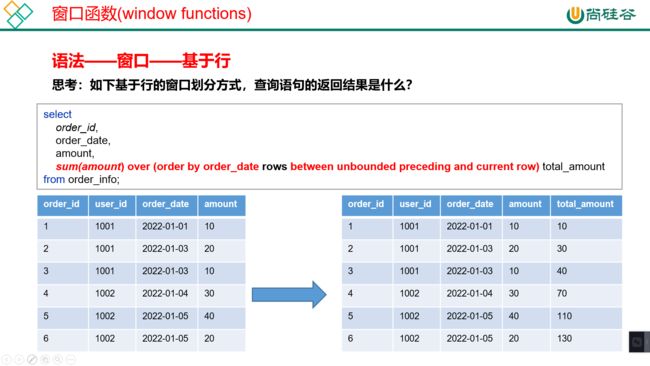

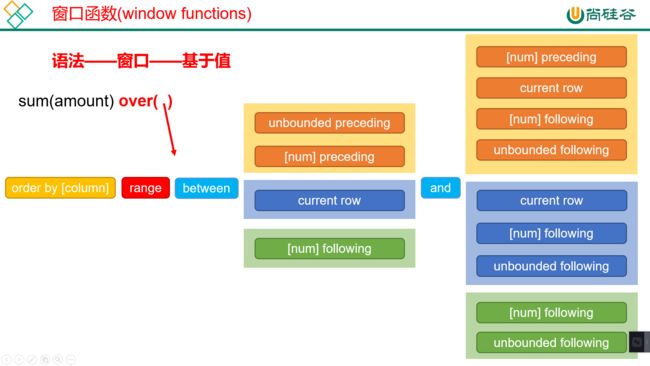

6.5.1 概述

6.5.2 常用窗口函数

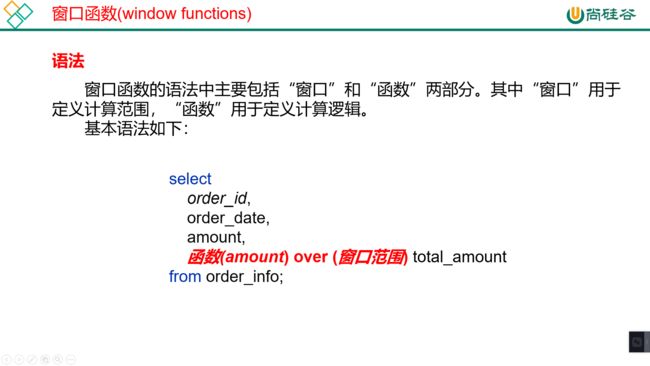

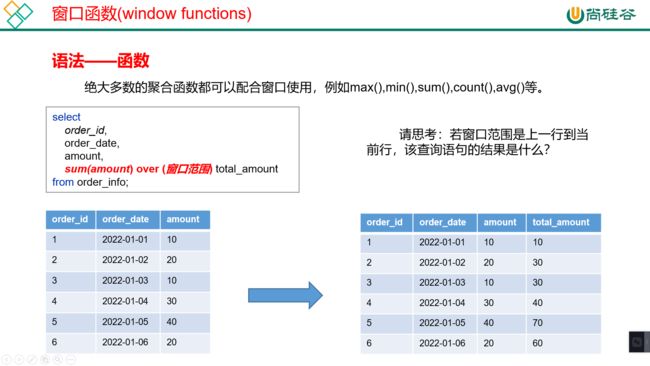

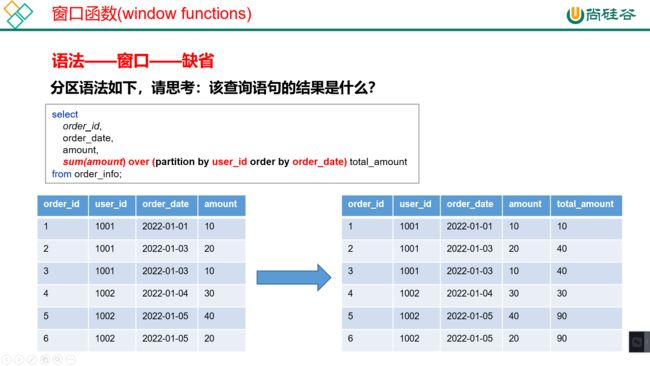

按照功能,常用窗口可划分为如下几类:聚合函数、跨行取值函数、排名函数。

1)聚合函数

max:最大值。

min:最小值。

sum:求和。

avg:平均值。

count:计数。

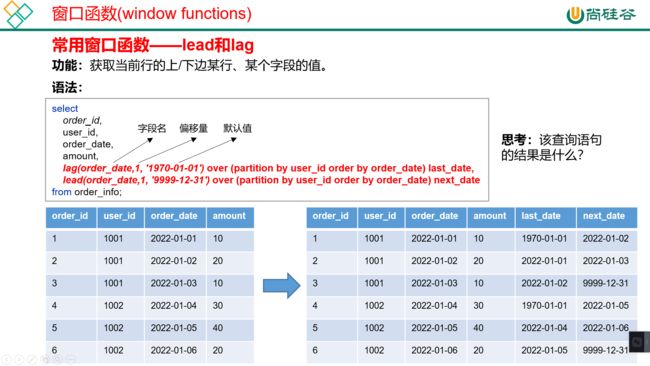

2)跨行取值函数

(1)lead和lag

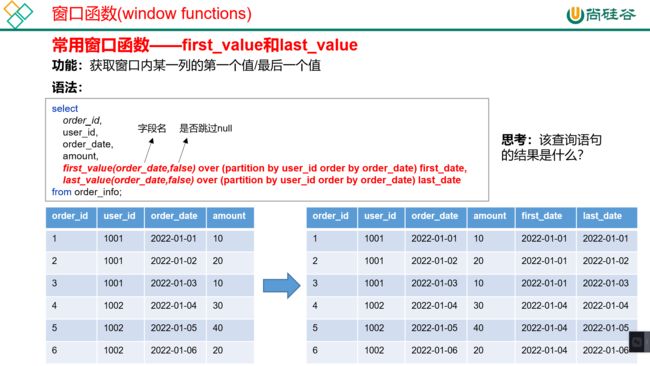

(2)first_value和last_value

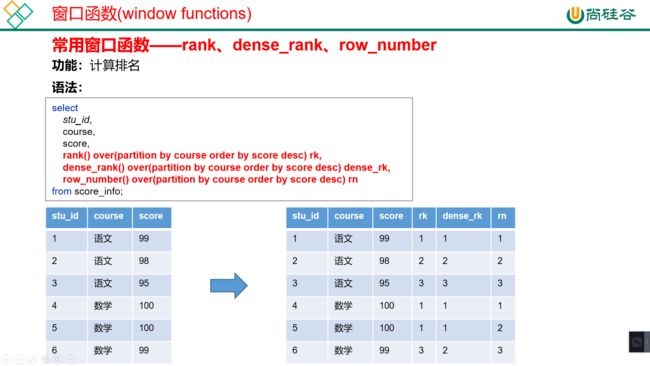

3)排名函数

注:rank 、dense_rank、row_number不支持自定义窗口。

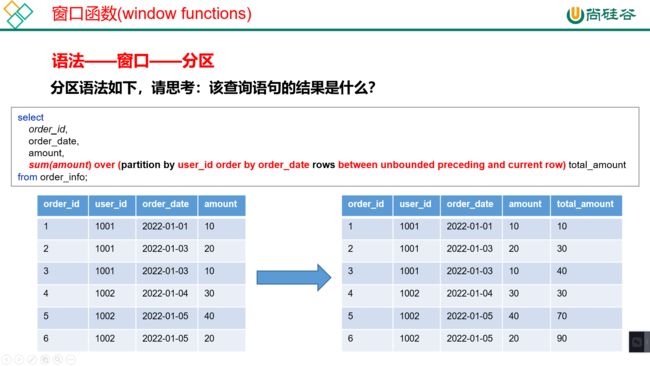

6.5.3 案例练习

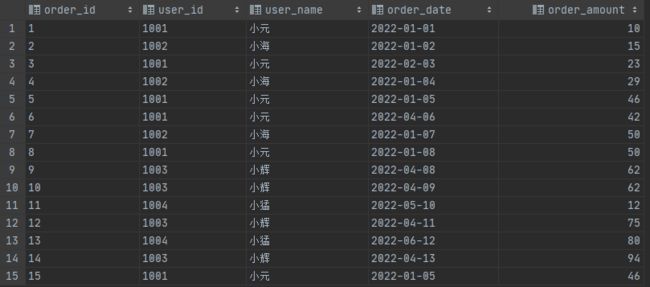

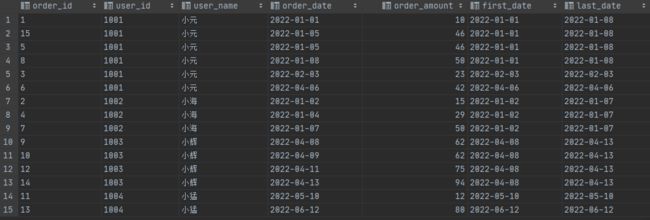

1.数据准备

create table order_info

(

order_id string, --订单id

user_id string, -- 用户id

user_name string, -- 用户姓名

order_date string, -- 下单日期

order_amount int -- 订单金额

);

insert overwrite table order_info

values ('1', '1001', '小元', '2022-01-01', '10'),

('2', '1002', '小海', '2022-01-02', '15'),

('3', '1001', '小元', '2022-02-03', '23'),

('4', '1002', '小海', '2022-01-04', '29'),

('5', '1001', '小元', '2022-01-05', '46'),

('6', '1001', '小元', '2022-04-06', '42'),

('7', '1002', '小海', '2022-01-07', '50'),

('8', '1001', '小元', '2022-01-08', '50'),

('9', '1003', '小辉', '2022-04-08', '62'),

('10', '1003', '小辉', '2022-04-09', '62'),

('11', '1004', '小猛', '2022-05-10', '12'),

('12', '1003', '小辉', '2022-04-11', '75'),

('13', '1004', '小猛', '2022-06-12', '80'),

('14', '1003', '小辉', '2022-04-13', '94'),

('15', '1001', '小元', '2022-01-05', '46');

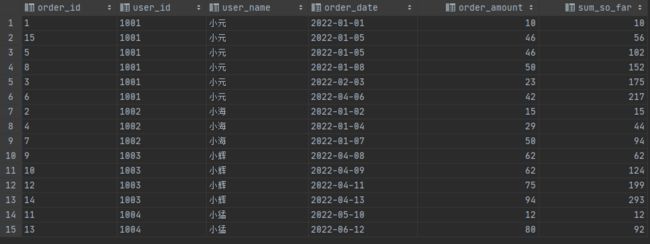

-- 统计每个用户截至每次下单的累积下单总额

select

order_id,

user_id,

user_name,

order_date,

order_amount,

sum(order_amount) over (partition by user_id order by order_date

rows between unbounded preceding and current row) sum_so_far

from order_info;

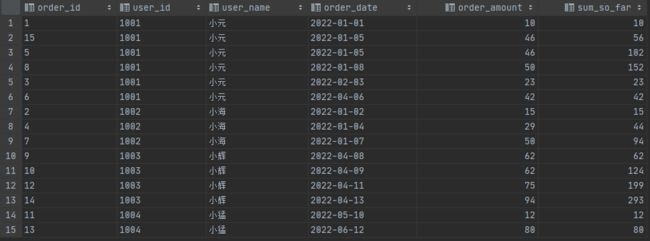

-- 统计每个用户截至每次下单的当月累积下单总额

select

order_id,

user_id,

user_name,

order_date,

order_amount,

sum(order_amount) over (partition by user_id,substring(order_date,1,7) order by order_date

rows between unbounded preceding and current row) sum_so_far

from order_info;

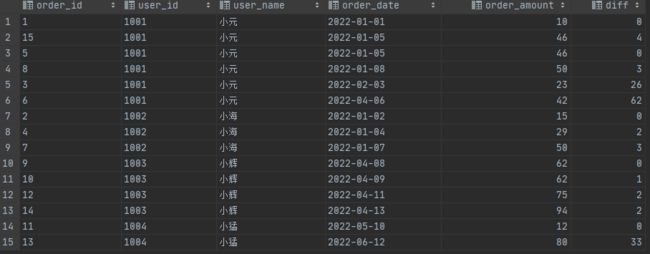

-- 统计每个用户每次下单距离上次下单相隔的天数(首次下单按0天算)

select

order_id,

user_id,

user_name,

order_date,

order_amount,

datediff(order_date,lag(order_date,1,order_date) over(partition by user_id order by order_date)) diff

from order_info;

-- 查询所有下单记录以及每个用户的每个下单记录所在月份的首/末次下单日期

select

order_id,

user_id,

user_name,

order_date,

order_amount,

first_value(order_date,false) over (partition by user_id,substring(order_date,1,7) order by order_date) first_date,

last_value(order_date,false) over (partition by user_id,substring(order_date,1,7) order by order_date

rows between unbounded preceding and unbounded following) last_date

from order_info;

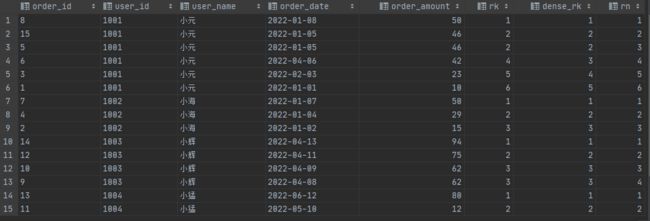

-- 为每个用户的所有下单记录按照订单金额进行排名

select

order_id,

user_id,

user_name,

order_date,

order_amount,

rank() over (partition by user_id order by order_amount desc ) rk,

dense_rank() over (partition by user_id order by order_amount desc) dense_rk,

row_number() over (partition by user_id order by order_amount desc) rn

from order_info;

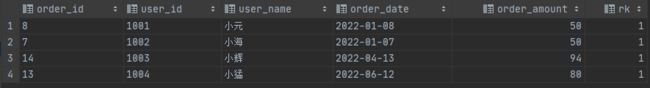

-- 分组topN(求每个用户的最大一笔消费)

select * from (

select

order_id,

user_id,

user_name,

order_date,

order_amount,

rank() over (partition by user_id order by order_amount desc ) rk

from order_info

)t1

where rk=1;

6.6 自定义函数

1)Hive自带了一些函数,比如:max/min等,但是数量有限,自己可以通过自定义UDF来方便的扩展。

2)当Hive提供的内置函数无法满足你的业务处理需要时,此时就可以考虑使用用户自定义函数(UDF:user-defined function)。

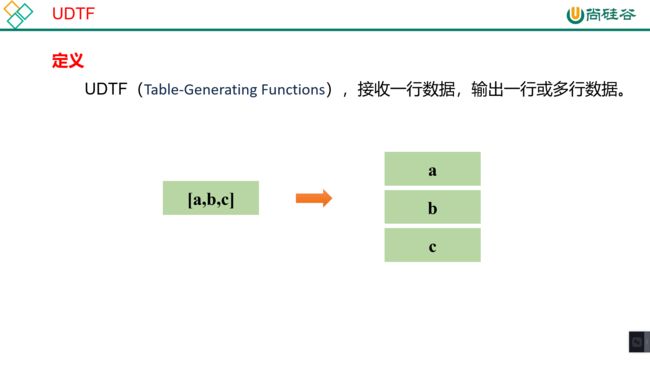

3)根据用户自定义函数类别分为以下三种:

(1)UDF(User-Defined-Function)

一进一出。

(2)UDAF(User-Defined Aggregation Function)

用户自定义聚合函数,多进一出。

类似于:count/max/min

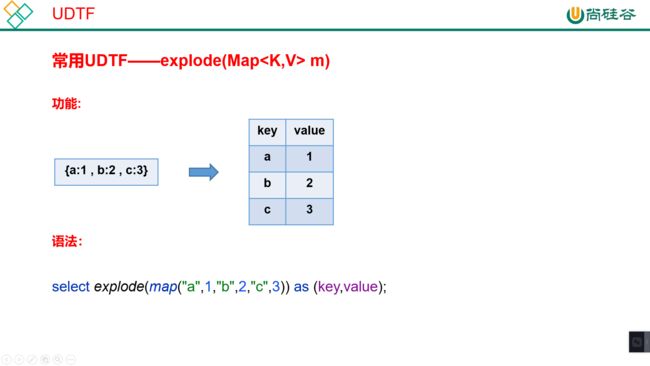

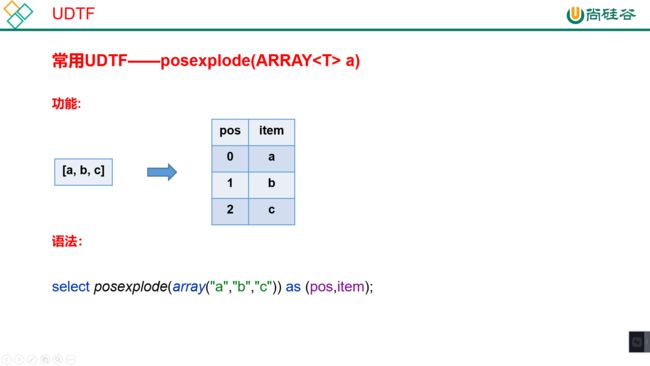

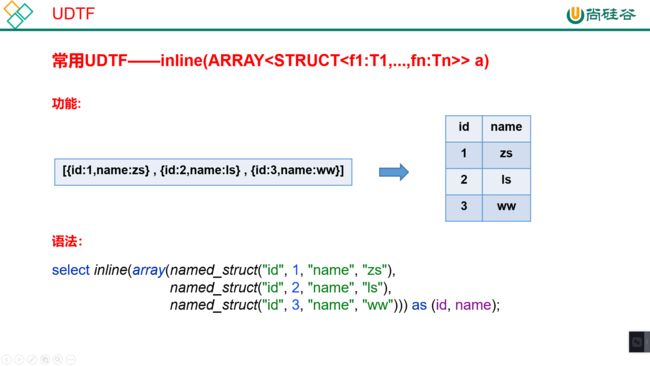

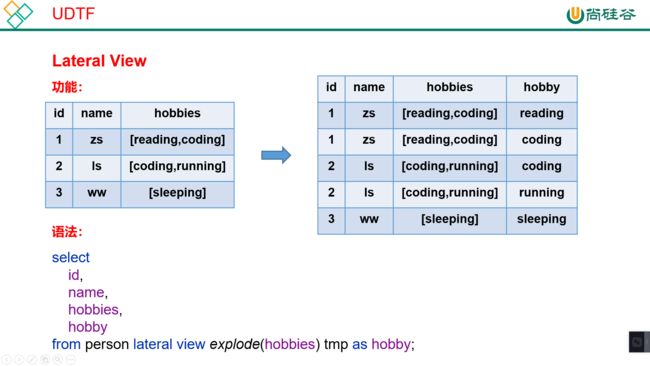

(3)UDTF(User-Defined Table-Generating Functions)

用户自定义表生成函数,一进多出。

如lateral view explode()

4)官方文档地址

https://cwiki.apache.org/confluence/display/Hive/HivePlugins

5)编程步骤

(1)继承Hive提供的类

org.apache.hadoop.hive.ql.udf.generic.GenericUDF

org.apache.hadoop.hive.ql.udf.generic.GenericUDTF;

(2)实现类中的抽象方法

(3)在hive的命令行窗口创建函数

添加jar。

add jar linux_jar_path

创建function。

create [temporary] function [dbname.]function_name AS class_name;

(4)在hive的命令行窗口删除函数

drop [temporary] function [if exists] [dbname.]function_name;

6.7 自定义UDF函数

- 需求

自定义一个UDF实现计算给定基本数据类型的长度,例如:

hive(default)> select my_len("abcd");

4

- 创建一个Maven工程

- 导入依赖

<dependencies>

<dependency>

<groupId>org.apache.hive</groupId>

<artifactId>hive-exec</artifactId>

<version>3.1.3</version>

</dependency>

</dependencies>

- 创建一个类

package com.xxxx.lln.hive.udf;

import org.apache.hadoop.hive.ql.exec.UDFArgumentException;

import org.apache.hadoop.hive.ql.metadata.HiveException;

import org.apache.hadoop.hive.ql.udf.generic.GenericUDF;

import org.apache.hadoop.hive.serde2.objectinspector.ObjectInspector;

import org.apache.hadoop.hive.serde2.objectinspector.PrimitiveObjectInspector;

import org.apache.hadoop.hive.serde2.objectinspector.primitive.PrimitiveObjectInspectorFactory;

public class myLength extends GenericUDF {

/**

* 判断传进来的参数类型和长度

* 约定返回的数据类型

* @param objectInspectors

* @return

* @throws UDFArgumentException

*/

@Override

public ObjectInspector initialize(ObjectInspector[] objectInspectors) throws UDFArgumentException {

if(objectInspectors.length != 1){

throw new UDFArgumentException("只接受一个参数");

}

ObjectInspector argument = objectInspectors[0];

if(!argument.getCategory().equals(ObjectInspector.Category.PRIMITIVE)){

throw new UDFArgumentException("只接受基本数据类型");

}

PrimitiveObjectInspector primitiveObjectInspector = (PrimitiveObjectInspector) argument;

if(!primitiveObjectInspector.getPrimitiveCategory().equals(PrimitiveObjectInspector.PrimitiveCategory.STRING)){

throw new UDFArgumentException("只接受String类型");

}

return PrimitiveObjectInspectorFactory.javaIntObjectInspector;

}

/**

* 解决具体逻辑

* @param deferredObjects

* @return

* @throws HiveException

*/

@Override

public Object evaluate(DeferredObject[] deferredObjects) throws HiveException {

DeferredObject argument = deferredObjects[0];

Object o = argument.get();

if(o==null)

{

return 0;

}

return o.toString().length();

}

/**

* 用于获取解释的字符串

* @param strings

* @return

*/

@Override

public String getDisplayString(String[] strings) {

return null;

}

}

- 创建临时函数

(1)打成jar包上传到服务器/opt/module/datas/hiveTest-1.0-SNAPSHOT.jar

(2)将jar包添加到hive的classpath,临时生效

hive> add jar /opt/module/datas/hiveTest-1.0-SNAPSHOT.jar

(3)创建临时函数与开发好的java class关联

hive> create temporary function my_len as "com.xxxx.lln.hive.udf.myLength";

(4)即可在hql中使用自定义的临时函数

hive> select my_len(1);

FAILED: SemanticException [Error 10014]: Line 1:7 Wrong arguments '1': 只接受String类型

hive> select my_len(1,2);

FAILED: SemanticException [Error 10014]: Line 1:7 Wrong arguments '2': 只接受一个参数

hive> select my_len("aaa");

OK

3

Time taken: 2.37 seconds, Fetched: 1 row(s)

(5)删除临时函数

hive> drop temporary function my_len;

OK

Time taken: 0.048 seconds

hive> select my_len("aaa");

FAILED: SemanticException [Error 10011]: Invalid function my_len

注意:临时函数只跟会话有关系,跟库没有关系。只要创建临时函数的会话不断,在当前会话下,任意一个库都可以使用,其他会话全都不能使用。

- 创建永久函数

1)创建永久函数

注意:因为add jar本身也是临时生效,所以在创建永久函数的时候,需要制定路径(并且因为元数据的原因,这个路径还得是HDFS上的路径)。

create function my_len

as "com.xxxx.lln.hive.udf.myLength"

using jar "hdfs://hadoop102:8020/udf/hiveTest-1.0-SNAPSHOT.jar";

(2)即可在hql中使用自定义的永久函数

select middle.my_len("123")

(3)删除永久函数

drop function my_len;

注意:永久函数跟会话没有关系,创建函数的会话断了以后,其他会话也可以使用。

永久函数创建的时候,在函数名之前需要自己加上库名,如果不指定库名的话,会默认把当前库的库名给加上。

永久函数使用的时候,需要在指定的库里面操作,或者在其他库里面使用的话加上,库名.函数名。

7、分区表

7.1 概述

Hive中的分区就是把一张大表的数据按照业务需要分散的存储到多个目录,每个目录就称为该表的一个分区。在查询时通过where子句中的表达式选择查询所需要的分区,这样的查询效率会提高很多。

7.2 分区表基本语法

7.2.1 创建分区表

create table dept_partition

(

deptno int, --部门编号

dname string, --部门名称

loc string --部门位置

)

partitioned by (day string)

row format delimited fields terminated by '\t';

7.2.2 分区表读写数据

7.2.2.1 写数据

-

load

○数据准备

在/opt/module/datas/路径上创建文件dept_20220401.log,并输入如下内容。[atguigu@hadoop102 datas]$ vim dept_20220401.log 10 行政部 1700 20 财务部 1800○装载语句

load data local inpath '/opt/module/datas/dept_20220401.log' into table dept_partition partition(day='20220401'); -

insert

将day='20220401’分区的数据插入到day='20220402’分区,可执行如下装载语句insert overwrite table dept_partition partition (day = '20220402') select deptno, dname, loc from dept_partition where day = '20220401';

7.2.2.2 读数据

查询分区表数据时,可以将分区字段看作表的伪列,可像使用其他字段一样使用分区字段。

select deptno, dname, loc ,day

from dept_partition

where day = '2020-04-01';

7.3 分区表基本操作

7.3.1 查看所有分区信息

show partitions dept_partition;

7.3.2 增加分区

(1)创建单个分区

alter table dept_partition

add partition(day='20220403');

(2)同时创建多个分区(分区之间不能有逗号)

alter table dept_partition

add partition(day='20220404') partition(day='20220405');

7.3.3 删除分区

(1)删除单个分区

alter table dept_partition

drop partition (day='20220403');

(2)同时删除多个分区(分区之间必须有逗号)

alter table dept_partition

drop partition (day='20220404'), partition(day='20220405');

7.3.4 修复分区

Hive将分区表的所有分区信息都保存在了元数据中,只有元数据与HDFS上的分区路径一致时,分区表才能正常读写数据。若用户手动创建/删除分区路径,Hive都是感知不到的,这样就会导致Hive的元数据和HDFS的分区路径不一致。再比如,若分区表为外部表,用户执行drop partition命令后,分区元数据会被删除,而HDFS的分区路径不会被删除,同样会导致Hive的元数据和HDFS的分区路径不一致。

若出现元数据和HDFS路径不一致的情况,可通过如下几种手段进行修复。

(1)add partition

若手动创建HDFS的分区路径,Hive无法识别,可通过add partition命令增加分区元数据信息,从而使元数据和分区路径保持一致。

(2)drop partition

若手动删除HDFS的分区路径,Hive无法识别,可通过drop partition命令删除分区元数据信息,从而使元数据和分区路径保持一致。

(3)msck

若分区元数据和HDFS的分区路径不一致,还可使用msck命令进行修复,以下是该命令的用法说明。

msck repair table table_name [add/drop/sync partitions];

说明:

msck repair table table_name add partitions:该命令会增加HDFS路径存在但元数据缺失的分区信息。

msck repair table table_name drop partitions:该命令会删除HDFS路径已经删除但元数据仍然存在的分区信息。

msck repair table table_name sync partitions:该命令会同步HDFS路径和元数据分区信息,相当于同时执行上述的两个命令。

msck repair table table_name:等价于msck repair table table_name add partitions命令。

7.4 二级分区表

思考:如果一天内的日志数据量也很大,如何再将数据拆分?答案是二级分区表,例如可以在按天分区的基础上,再对每天的数据按小时进行分区。

7.4.1 二级分区表建表语句

create table dept_partition2(

deptno int, -- 部门编号

dname string, -- 部门名称

loc string -- 部门位置

)

partitioned by (day string, hour string)

row format delimited fields terminated by '\t';

7.4.2 数据装载语句

load data local inpath '/opt/module/hive/datas/dept_20220401.log'

into table dept_partition2

partition(day='20220401', hour='12');

7.4.3 查询分区数据

select

*

from dept_partition2

where day='20220401' and hour='12';

7.5 动态分区

动态分区是指向分区表insert数据时,被写往的分区不由用户指定,而是由每行数据的最后一个字段的值来动态的决定。使用动态分区,可只用一个insert语句将数据写入多个分区。

7.5.1 动态分区相关参数

(1)动态分区功能总开关(默认true,开启)

set hive.exec.dynamic.partition=true

(2)严格模式和非严格模式

动态分区的模式,默认strict(严格模式),要求必须指定至少一个分区为静态分区,nonstrict(非严格模式)允许所有的分区字段都使用动态分区。

set hive.exec.dynamic.partition.mode=nonstrict

(3)一条insert语句可同时创建的最大的分区个数,默认为1000。

set hive.exec.max.dynamic.partitions=1000

(4)单个Mapper或者Reducer可同时创建的最大的分区个数,默认为100。

set hive.exec.max.dynamic.partitions.pernode=100

(5)一条insert语句可以创建的最大的文件个数,默认100000。

hive.exec.max.created.files=100000

(6)当查询结果为空时且进行动态分区时,是否抛出异常,默认false。

hive.error.on.empty.partition=false

7.5.2 案例实操

需求:将dept表中的数据按照地区(loc字段),插入到目标表dept_partition_dynamic的相应分区中。

(1)创建目标分区表

create table dept_partition_dynamic(

id int,

name string

)

partitioned by (loc int)

row format delimited fields terminated by '\t';

(2)设置动态分区

set hive.exec.dynamic.partition.mode = nonstrict;

insert into table dept_partition_dynamic

partition(loc)

select

deptno,

dname,

loc

from dept;

(3)查看目标分区表的分区情况

how partitions dept_partition_dynamic;

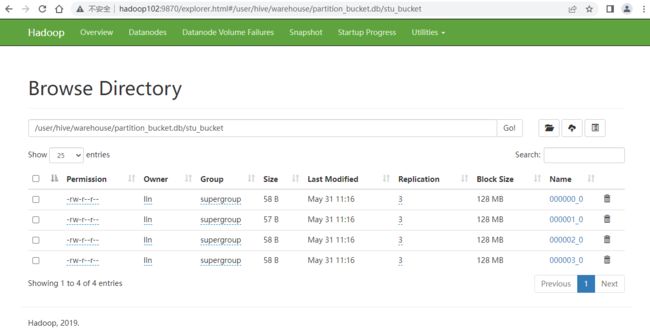

8、分桶表

8.1 概述

分区提供一个隔离数据和优化查询的便利方式。不过,并非所有的数据集都可形成合理的分区。对于一张表或者分区,Hive 可以进一步组织成桶,也就是更为细粒度的数据范围划分,分区针对的是数据的存储路径,分桶针对的是数据文件。

分桶表的基本原理是,首先为每行数据计算一个指定字段的数据的hash值,然后模以一个指定的分桶数,最后将取模运算结果相同的行,写入同一个文件中,这个文件就称为一个分桶(bucket)。

8.2 分桶表基本语法

8.2.1 建表语句

create table stu_bucket(

id int,

name string

)

clustered by(id)

into 4 buckets

row format delimited fields terminated by '\t';

8.2.2 数据装载

(1)数据准备

在/opt/module/datas/路径上创建student.txt文件,并输入如下内容。

1001 student1

1002 student2

1003 student3

1004 student4

1005 student5

1006 student6

1007 student7

1008 student8

1009 student9

1010 student10

1011 student11

1012 student12

1013 student13

1014 student14

1015 student15

1016 student16

(2)导入数据到分桶表中

说明:Hive新版本load数据可以直接跑MapReduce,老版的Hive需要将数据传到一张表里,再通过查询的方式导入到分桶表里面。

load data local inpath '/opt/module/datas/student.txt'

into table stu_bucket;

(4)观察每个分桶中的数据

-- File information - 000000_0

1016 student16

1012 student12

1008 student8

1004 student4

-- File information - 000001_0

1009 student9

1005 student5

1001 student1

1013 student13

-- File information - 000002_0

1010 student10

1002 student2

1006 student6

1014 student14

-- File information - 000003_0

1003 student3

1011 student11

1007 student7

1015 student15

8.3 分桶排序表

8.3.1 建表语句

create table stu_bucket_sort(

id int,

name string

)

clustered by(id) sorted by(id)

into 4 buckets

row format delimited fields terminated by '\t';

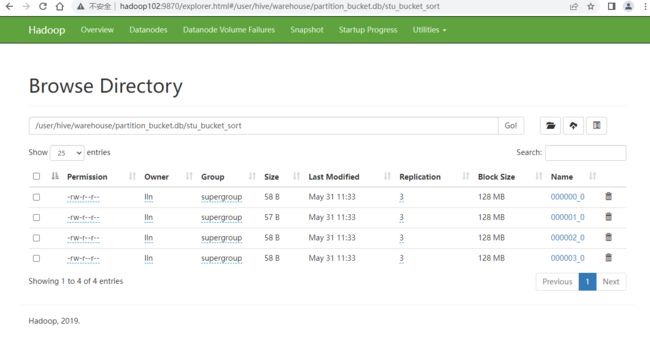

8.3.2 数据装载

(1)导入数据到分桶表中

load data local inpath '/opt/module/datas/student.txt'

into table stu_bucket_sort;

(2)查看创建的分桶表中是否分成4个桶

-- File information - 000000_0

1004 student4

1008 student8

1012 student12

1016 student16

-- File information - 000001_0

1001 student1

1005 student5

1009 student9

1013 student13

-- File information - 000002_0

1002 student2

1006 student6

1010 student10

1014 student14

-- File information - 000003_0

1003 student3

1007 student7

1011 student11

1015 student15

9 、文件格式和压缩

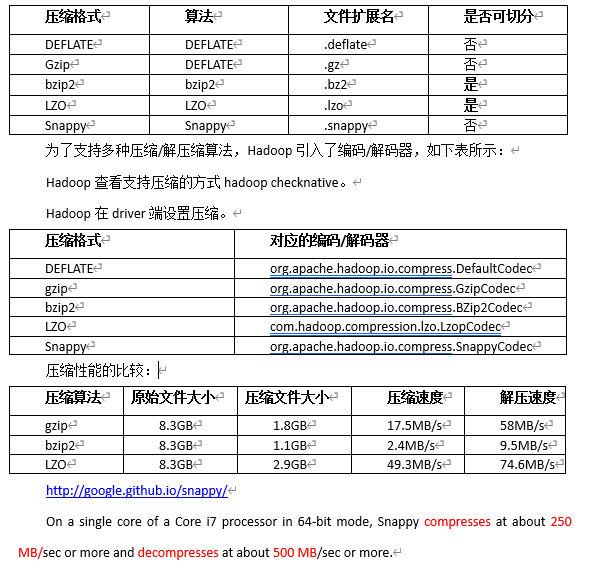

9.1 Hadoop压缩概述

9.2 Hive文件格式

为Hive表中的数据选择一个合适的文件格式,对提高查询性能的提高是十分有益的。Hive表数据的存储格式,可以选择text file、orc、parquet、sequence file等。

9.2.1 Text File

文本文件是Hive默认使用的文件格式,文本文件中的一行内容,就对应Hive表中的一行记录。

可通过以下建表语句指定文件格式为文本文件:

create table textfile_table

(column_specs)

stored as textfile;

9.2.2 ORC

- 文本格式

ORC(Optimized Row Columnar)file format是Hive 0.11版里引入的一种列式存储的文件格式。ORC文件能够提高Hive读写数据和处理数据的性能。

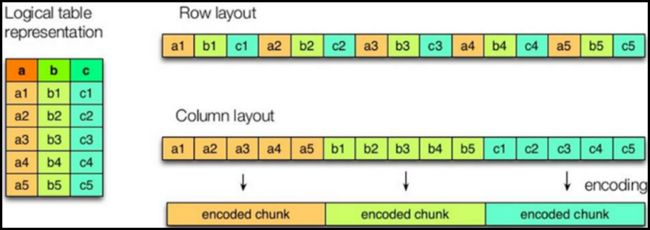

与列式存储相对的是行式存储,下图是两者的对比:

如图所示左边为逻辑表,右边第一个为行式存储,第二个为列式存储。

(1)行存储的特点

查询满足条件的一整行数据的时候,列存储则需要去每个聚集的字段找到对应的每个列的值,行存储只需要找到其中一个值,其余的值都在相邻地方,所以此时行存储查询的速度更快。

(2)列存储的特点

因为每个字段的数据聚集存储,在查询只需要少数几个字段的时候,能大大减少读取的数据量;每个字段的数据类型一定是相同的,列式存储可以针对性的设计更好的设计压缩算法。

前文提到的text file和sequence file都是基于行存储的,orc和parquet是基于列式存储的。

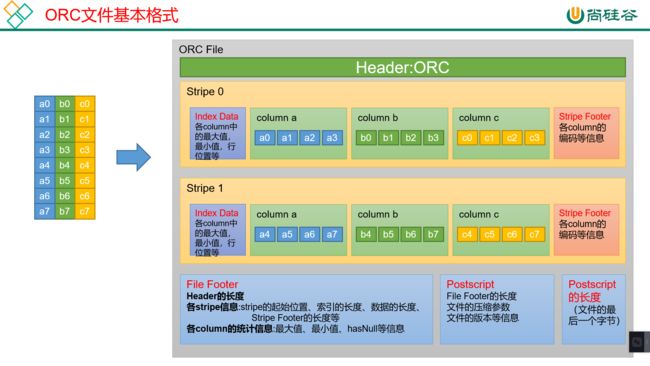

orc文件的具体结构如下图所示:

每个Orc文件由Header、Body和Tail三部分组成。

其中Header内容为ORC,用于表示文件类型。

Body由1个或多个stripe组成,每个stripe一般为HDFS的块大小,每一个stripe包含多条记录,这些记录按照列进行独立存储,每个stripe里有三部分组成,分别是Index Data,Row Data,Stripe Footer。

Index Data:一个轻量级的index,默认是为各列每隔1W行做一个索引。每个索引会记录第n万行的位置,和最近一万行的最大值和最小值等信息。

Row Data:存的是具体的数据,按列进行存储,并对每个列进行编码,分成多个Stream来存储。

Stripe Footer:存放的是各个Stream的位置以及各column的编码信息。

Tail由File Footer和PostScript组成。File Footer中保存了各Stripe的其实位置、索引长度、数据长度等信息,各Column的统计信息等;PostScript记录了整个文件的压缩类型以及File Footer的长度信息等。

在读取ORC文件时,会先从最后一个字节读取PostScript长度,进而读取到PostScript,从里面解析到File Footer长度,进而读取FileFooter,从中解析到各个Stripe信息,再读各个Stripe,即从后往前读。

- 建表语句

create table orc_table

(column_specs)

stored as orc

tblproperties (property_name=property_value, ...);

9.2.3 Parquet

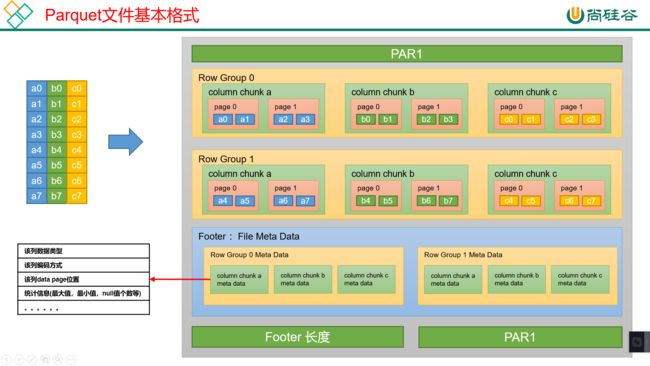

Parquet文件是Hadoop生态中的一个通用的文件格式,它也是一个列式存储的文件格式。

Parquet文件的格式如下图所示:

上图展示了一个Parquet文件的基本结构,文件的首尾都是该文件的Magic Code,用于校验它是否是一个Parquet文件。

首尾中间由若干个Row Group和一个Footer(File Meta Data)组成。

每个Row Group包含多个Column Chunk,每个Column Chunk包含多个Page。

以下是Row Group、Column Chunk和Page三个概念的说明:

行组(Row Group):一个行组对应逻辑表中的若干行。

列块(Column Chunk):一个行组中的一列保存在一个列块中。

页(Page):一个列块的数据会划分为若干个页。

Footer(File Meta Data)中存储了每个行组(Row Group)中的每个列快(Column Chunk)的元数据信息,元数据信息包含了该列的数据类型、该列的编码方式、该类的Data Page位置等信息。

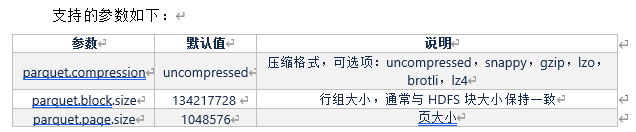

建表语句

Create table parquet_table

(column_specs)

stored as parquet

tblproperties (property_name=property_value, ...);

9.3 压缩

在Hive表中和计算过程中,保持数据的压缩,对磁盘空间的有效利用和提高查询性能都是十分有益的。

9.3.1 Hive表数据进行压缩

在Hive中,不同文件类型的表,声明数据压缩的方式是不同的。

1)TextFile

若一张表的文件类型为TextFile,若需要对该表中的数据进行压缩,多数情况下,无需在建表语句做出声明。直接将压缩后的文件导入到该表即可,Hive在查询表中数据时,可自动识别其压缩格式,进行解压。

需要注意的是,在执行往表中导入数据的SQL语句时,用户需设置以下参数,来保证写入表中的数据是被压缩的。

--SQL语句的最终输出结果是否压缩

set hive.exec.compress.output=true;

--输出结果的压缩格式(以下示例为snappy)

set mapreduce.output.fileoutputformat.compress.codec =org.apache.hadoop.io.compress.SnappyCodec;

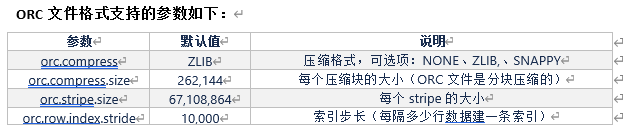

2)ORC

若一张表的文件类型为ORC,若需要对该表数据进行压缩,需在建表语句中声明压缩格式如下:

create table orc_table

(column_specs)

stored as orc

tblproperties ("orc.compress"="snappy");

3)Parquet

若一张表的文件类型为Parquet,若需要对该表数据进行压缩,需在建表语句中声明压缩格式如下:

create table orc_table

(column_specs)

stored as parquet

tblproperties ("parquet.compression"="snappy");

9.3.2 计算过程中使用压缩

1)单个MR的中间结果进行压缩

单个MR的中间结果是指Mapper输出的数据,对其进行压缩可降低shuffle阶段的网络IO,可通过以下参数进行配置:

--开启MapReduce中间数据压缩功能

set mapreduce.map.output.compress=true;

--设置MapReduce中间数据数据的压缩方式(以下示例为snappy)

set mapreduce.map.output.compress.codec=org.apache.hadoop.io.compress.SnappyCodec;

2)单条SQL语句的中间结果进行压缩

单条SQL语句的中间结果是指,两个MR(一条SQL语句可能需要通过MR进行计算)之间的临时数据,可通过以下参数进行配置:

--是否对两个MR之间的临时数据进行压缩

set hive.exec.compress.intermediate=true;

--压缩格式(以下示例为snappy)

set hive.intermediate.compression.codec= org.apache.hadoop.io.compress.SnappyCodec;

10、企业级调优

10.1 计算资源配置

本教程的计算环境为Hive on MR。计算资源的调整主要包括Yarn和MR。

10.1.1 Yarn资源配置

1)Yarn配置说明

需要调整的Yarn参数均与CPU、内存等资源有关,核心配置参数如下

(1)yarn.nodemanager.resource.memory-mb

该参数的含义是,一个NodeManager节点分配给Container使用的内存。该参数的配置,取决于NodeManager所在节点的总内存容量和该节点运行的其他服务的数量。

考虑上述因素,此处可将该参数设置为64G,如下:

<property>

<name>yarn.nodemanager.resource.memory-mbname>

<value>65536value>

property>

(2)yarn.nodemanager.resource.cpu-vcores

该参数的含义是,一个NodeManager节点分配给Container使用的CPU核数。该参数的配置,同样取决于NodeManager所在节点的总CPU核数和该节点运行的其他服务。

考虑上述因素,此处可将该参数设置为16。

<property>

<name>yarn.nodemanager.resource.cpu-vcoresname>

<value>16value>

property>

(3)yarn.scheduler.maximum-allocation-mb

该参数的含义是,单个Container能够使用的最大内存。推荐配置如下:

<property>

<name>yarn.scheduler.maximum-allocation-mbname>

<value>16384value>

property>

(4)yarn.scheduler.minimum-allocation-mb

该参数的含义是,单个Container能够使用的最小内存,推荐配置如下:

<property>

<name>yarn.scheduler.minimum-allocation-mbname>

<value>512value>

property>

2)Yarn配置实操

(1)修改$HADOOP_HOME/etc/hadoop/yarn-site.xml文件

(2)修改如下参数

<property>

<name>yarn.nodemanager.resource.memory-mbname>

<value>65536value>

property>

<property>

<name>yarn.nodemanager.resource.cpu-vcoresname>

<value>16value>

property>

<property>

<name>yarn.scheduler.maximum-allocation-mbname>

<value>16384value>

property>

<property>

<name>yarn.scheduler.minimum-allocation-mbname>

<value>512value>

property>

(3)分发该配置文件

(4)重启Yarn。

10.1.2 MapReduce资源配置

MapReduce资源配置主要包括Map Task的内存和CPU核数,以及Reduce Task的内存和CPU核数。

核心配置参数如下:

1)mapreduce.map.memory.mb

该参数的含义是,单个Map Task申请的container容器内存大小,其默认值为1024。

该值不能超出yarn.scheduler.maximum-allocation-mb和yarn.scheduler.minimum-allocation-mb规定的范围。

该参数需要根据不同的计算任务单独进行配置,在hive中,可直接使用如下方式为每个SQL语句单独进行配置:

set mapreduce.map.memory.mb=2048;

2)mapreduce.map.cpu.vcores

该参数的含义是,单个Map Task申请的container容器cpu核数,其默认值为1。该值一般无需调整。

3)mapreduce.reduce.memory.mb

该参数的含义是,单个Reduce Task申请的container容器内存大小,其默认值为1024。

该值同样不能超出yarn.scheduler.maximum-allocation-mb和yarn.scheduler.minimum-allocation-mb规定的范围。

该参数需要根据不同的计算任务单独进行配置,在hive中,可直接使用如下方式为每个SQL语句单独进行配置:

set mapreduce.reduce.memory.mb=2048;

4)mapreduce.reduce.cpu.vcores

该参数的含义是,单个Reduce Task申请的container容器cpu核数,其默认值为1。该值一般无需调整。

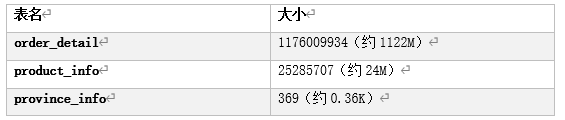

10.2 测试用表

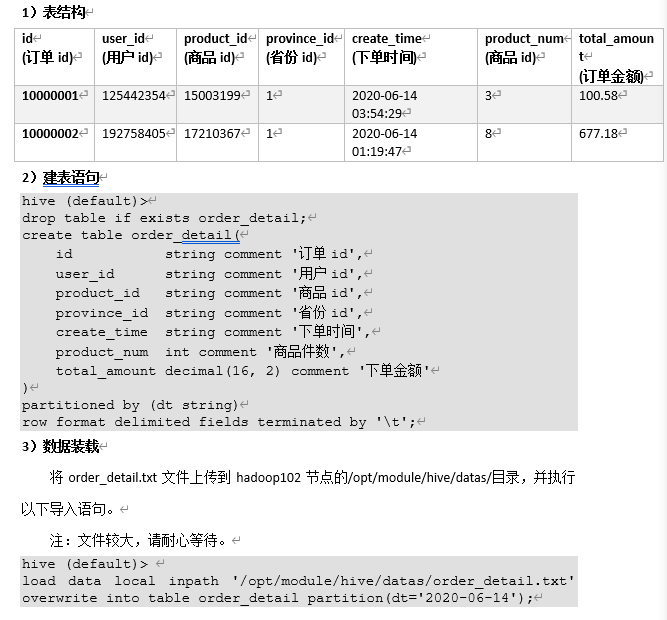

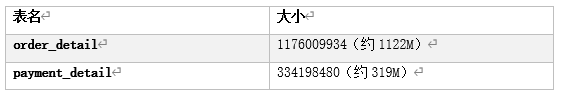

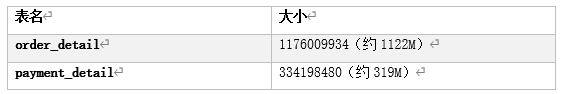

10.2.1 订单表(2000w条数据)

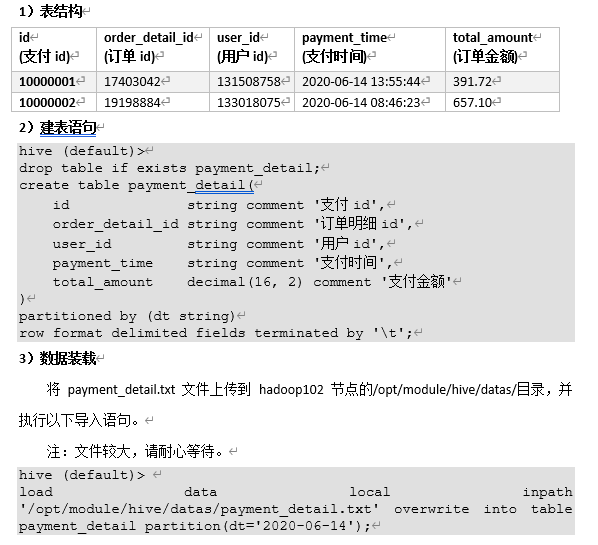

10.2.2 支付表(600w条数据)

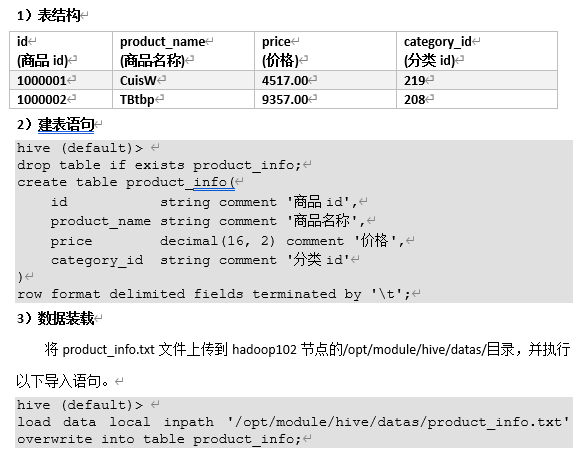

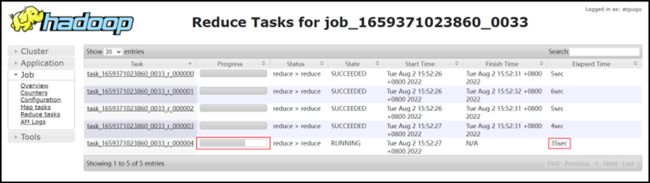

10.2.3 商品信息表(100w条数据)

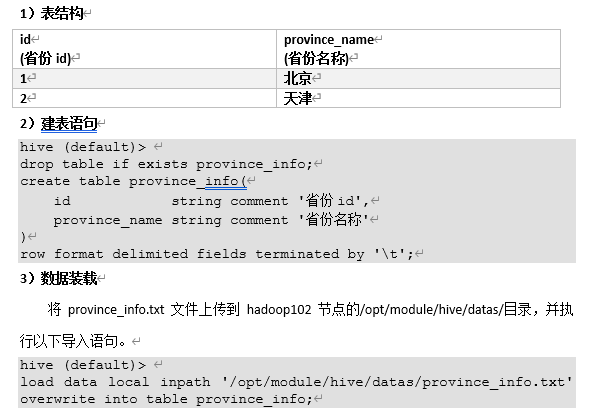

10.2.4 省份信息表(34条数据)

10.3 Explain查看执行计划(重点)

10.3.1 Explain执行计划概述

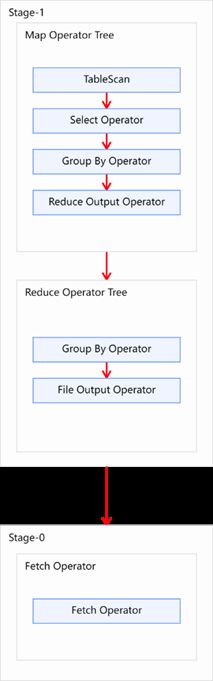

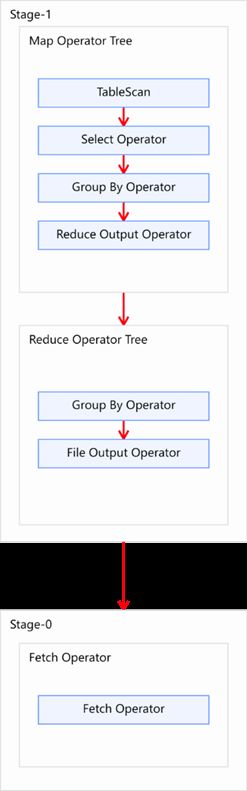

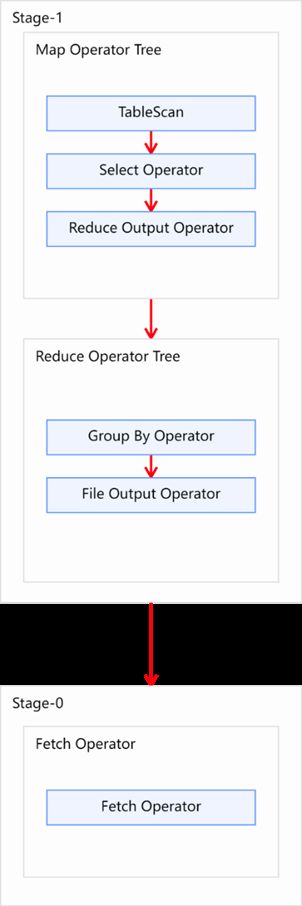

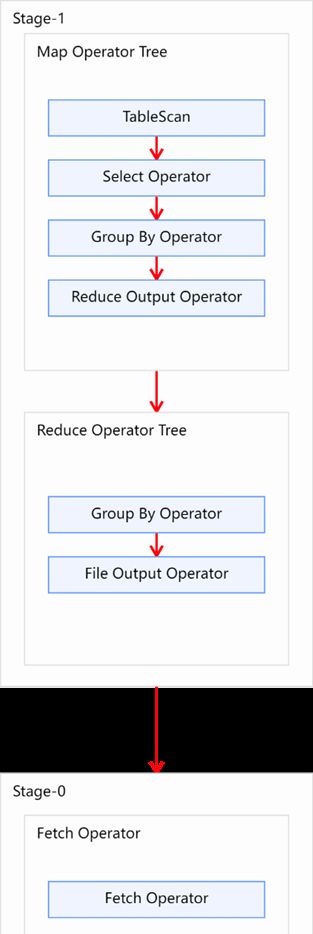

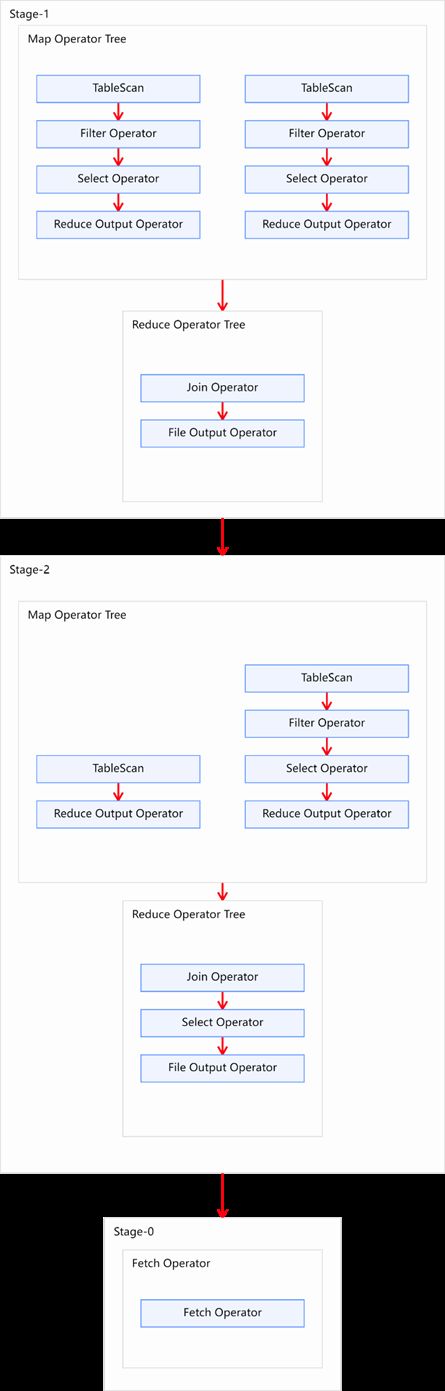

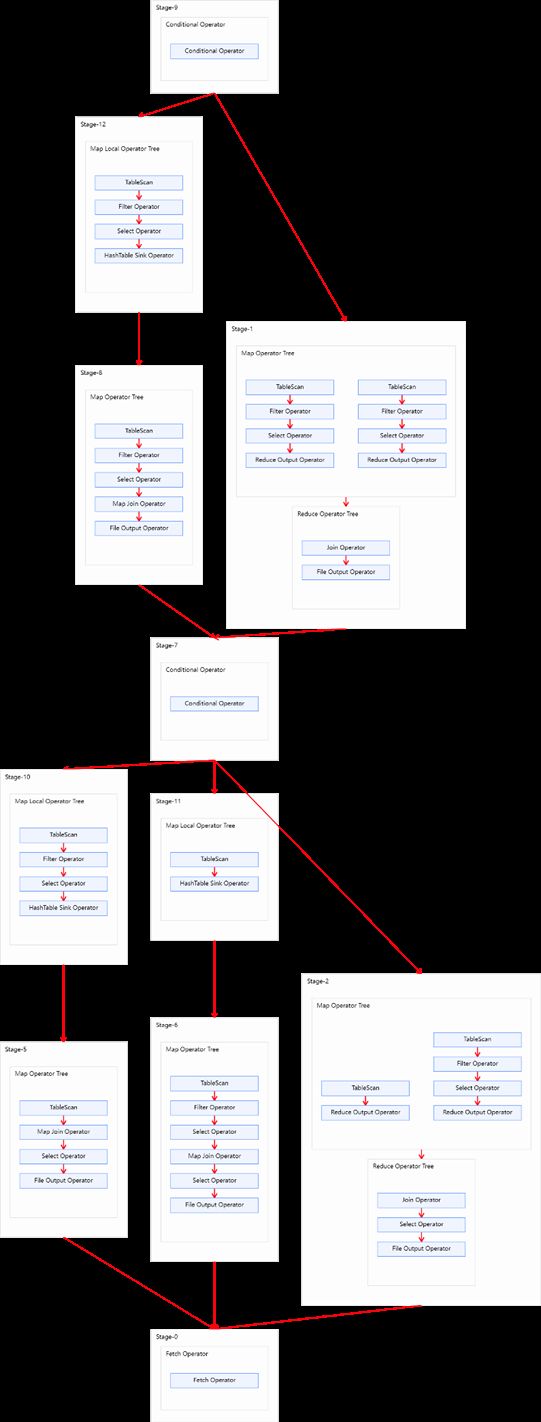

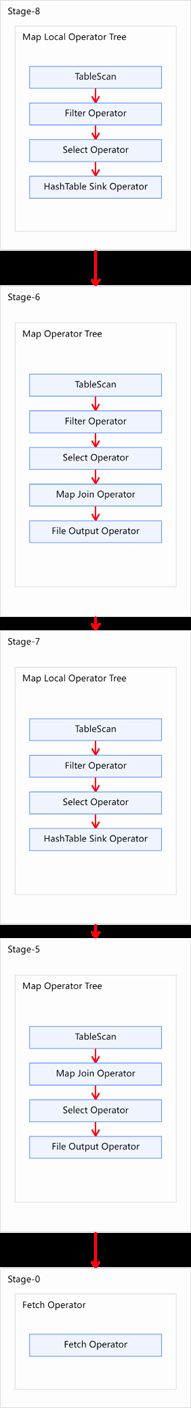

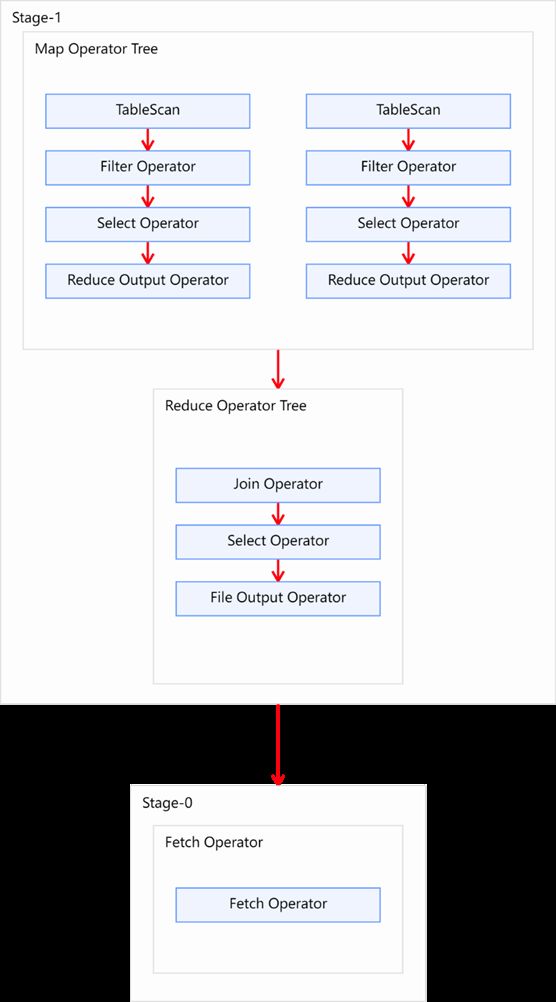

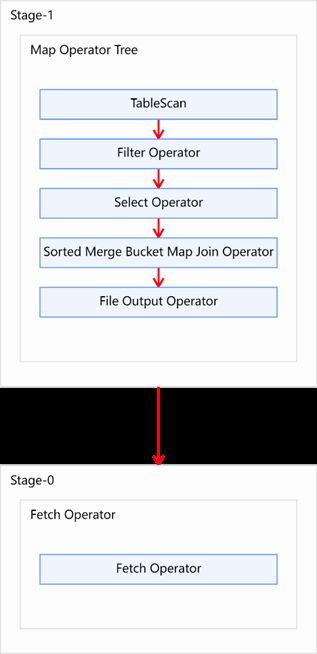

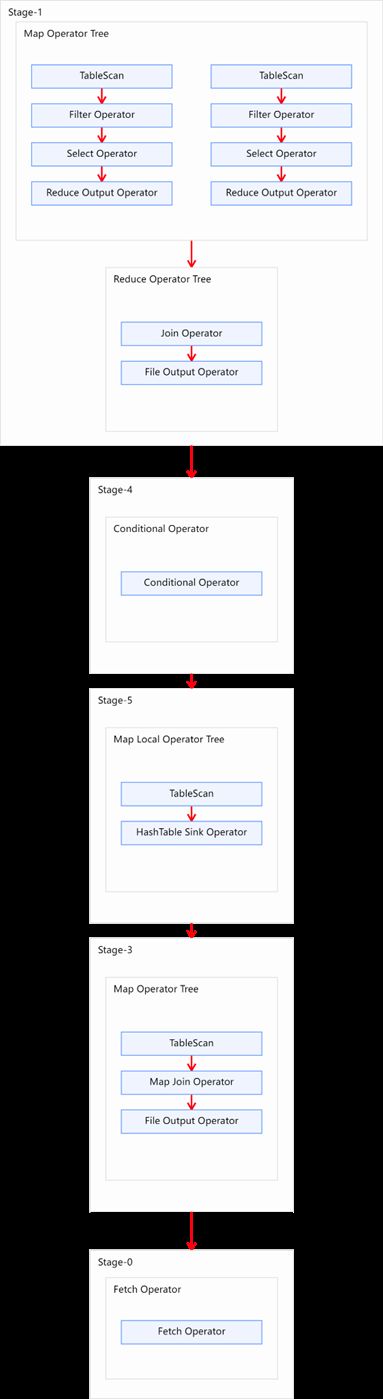

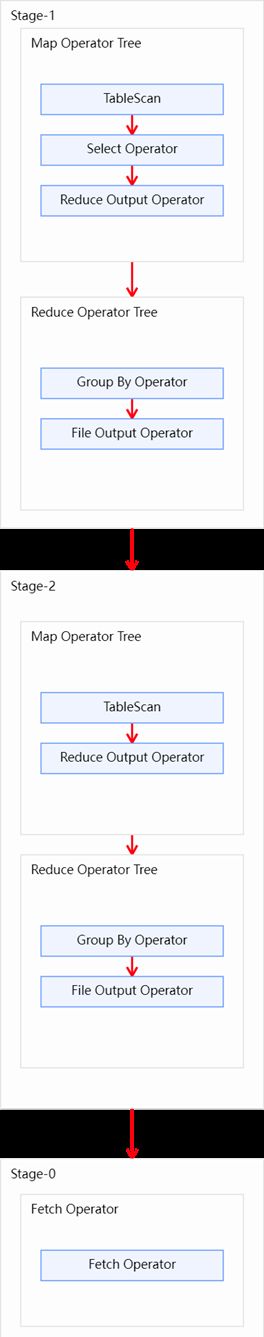

Explain呈现的执行计划,由一系列Stage组成,这一系列Stage具有依赖关系,每个Stage对应一个MapReduce Job,或者一个文件系统操作等。

若某个Stage对应的一个MapReduce Job,其Map端和Reduce端的计算逻辑分别由Map Operator Tree和Reduce Operator Tree进行描述,Operator Tree由一系列的Operator组成,一个Operator代表在Map或Reduce阶段的一个单一的逻辑操作,例如TableScan Operator,Select Operator,Join Operator等。

下图是由一个执行计划绘制而成:

常见的Operator及其作用如下:

TableScan:表扫描操作,通常map端第一个操作肯定是表扫描操作

Select Operator:选取操作

Group By Operator:分组聚合操作

Reduce Output Operator:输出到 reduce 操作

Filter Operator:过滤操作

Join Operator:join 操作

File Output Operator:文件输出操作

Fetch Operator 客户端获取数据操作

10.3.2 基本语法

EXPLAIN [FORMATTED | EXTENDED | DEPENDENCY] query-sql

FORMATTED、EXTENDED、DEPENDENCY关键字为可选项,各自作用如下。

FORMATTED:将执行计划以JSON字符串的形式输出

EXTENDED:输出执行计划中的额外信息,通常是读写的文件名等信息

DEPENDENCY:输出执行计划读取的表及分区

10.3.3 案例实操

1)查看下面这条语句的执行计划

explain

select

user_id,

count(*)

from order_detail

group by user_id;

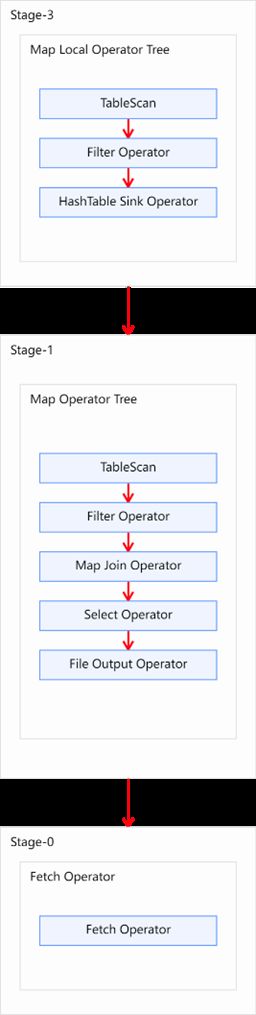

2)执行计划如下图

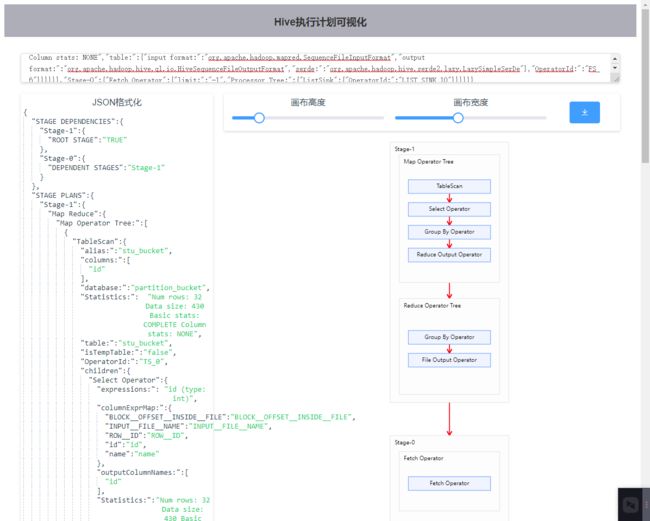

10.3.4 可视化工具

explain formatted

select

id,

count(*)

from stu_bucket

group by id;

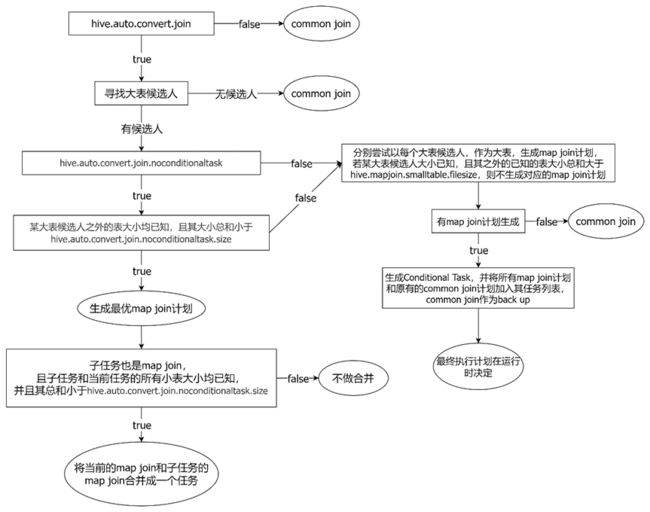

得到 json