Sqoop ---- Sqoop一些常用命令及参数

Sqoop ---- Sqoop一些常用命令及参数

- 1. 常用命令列举

- 2. 命令&参数详解

-

- 1. 公用参数:数据库连接

- 2. 公用参数:import

- 3. 公用参数:export

- 4. 公用参数:hive

- 5. 命令&参数:import

- 6. 命令&参数:export

- 7. 命令&参数:codegen

- 8. 命令&参数:create-hive-table

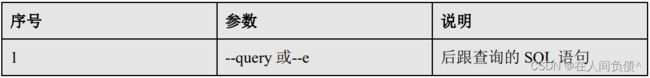

- 9. 命令&参数:eval

- 10. 命令&参数:import-all-tables

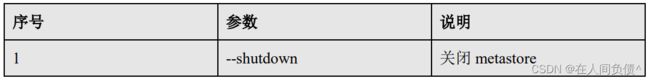

- 11. 命令&参数:job

- 12. 命令&参数:list-databases

- 13. 命令&参数:list-tables

- 14. 命令&参数:merge

- 15. 命令&参数:metastore

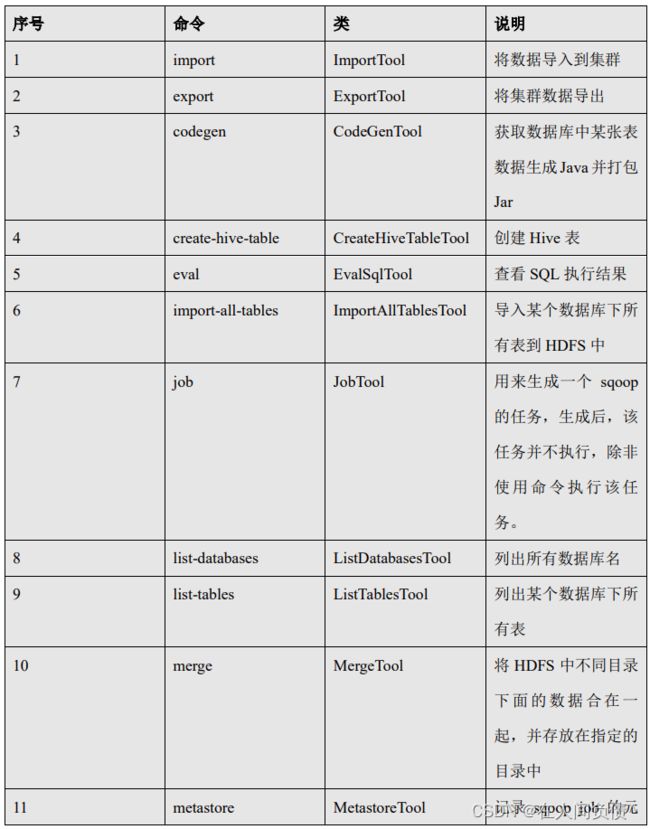

1. 常用命令列举

这里给大家列出来了一部分Sqoop操作时的常用参数,以供参考,需要深入学习的可以参看对应类的源代码。

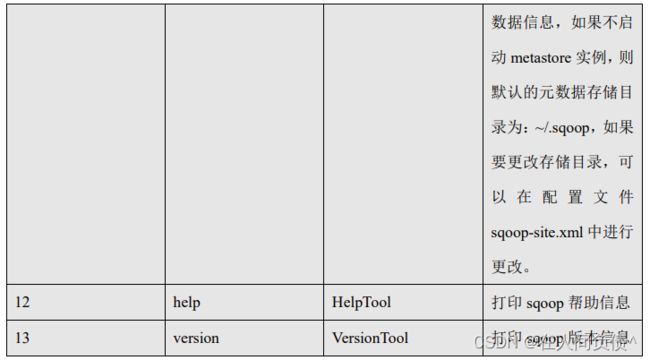

2. 命令&参数详解

刚才列举了一些 Sqoop 的常用命令,对于不同的命令,有不同的参数,让我们来一一列举说明。

首先来我们来介绍一下公用的参数,所谓公用参数,就是大多数命令都支持的参数。

1. 公用参数:数据库连接

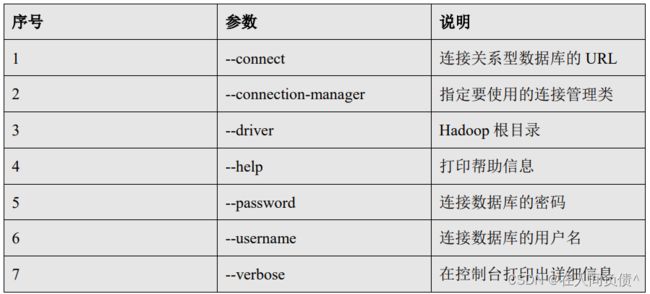

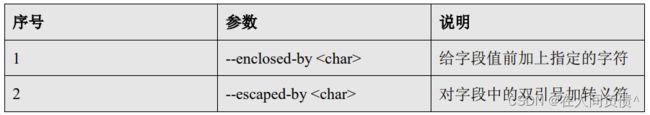

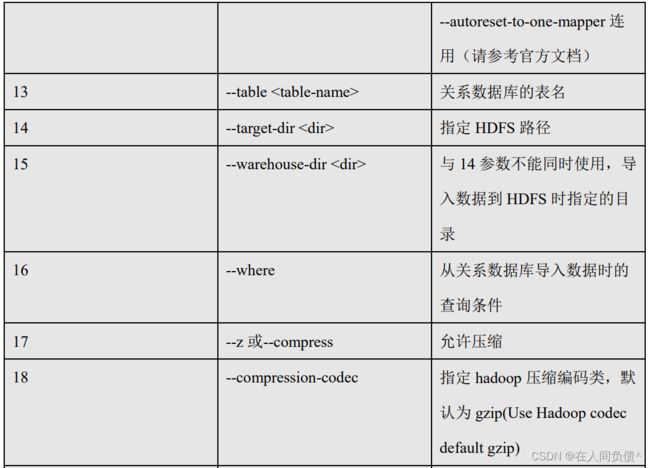

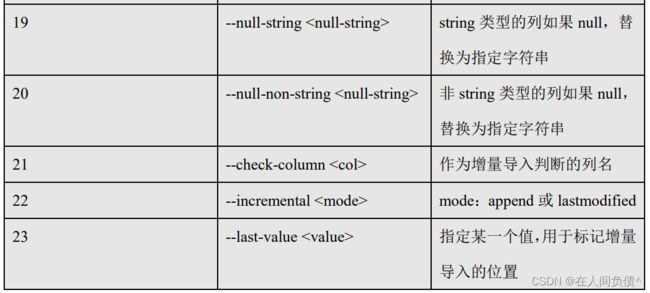

2. 公用参数:import

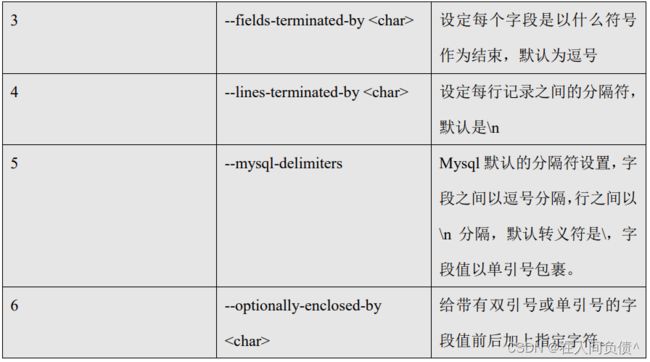

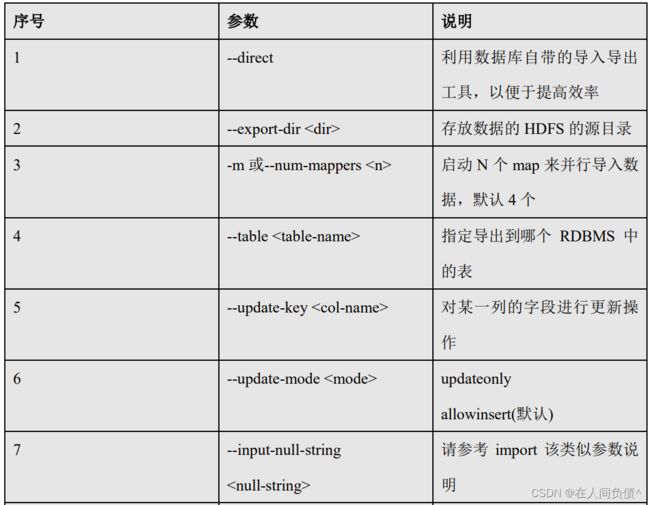

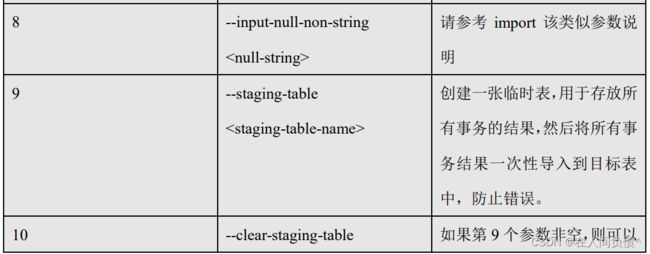

3. 公用参数:export

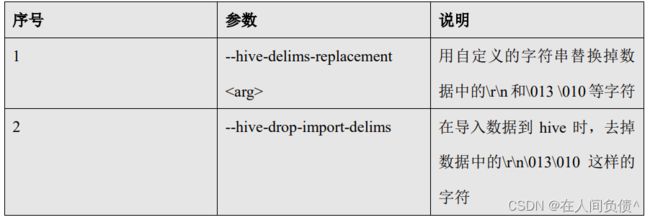

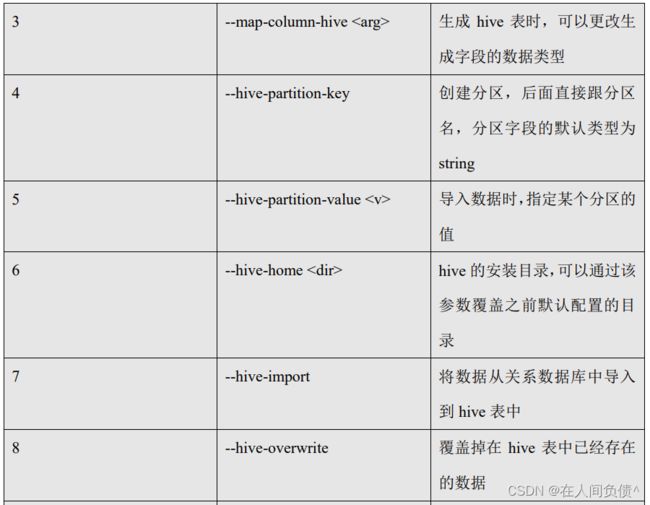

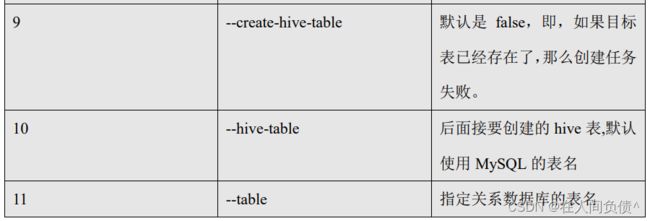

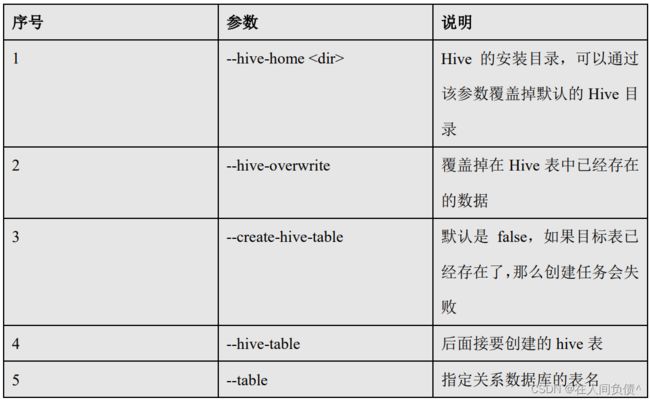

4. 公用参数:hive

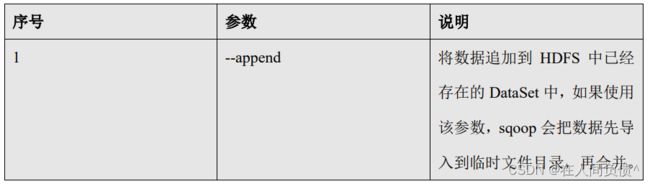

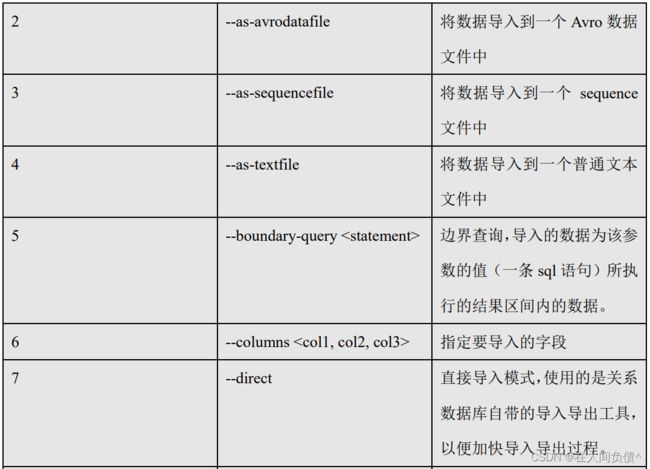

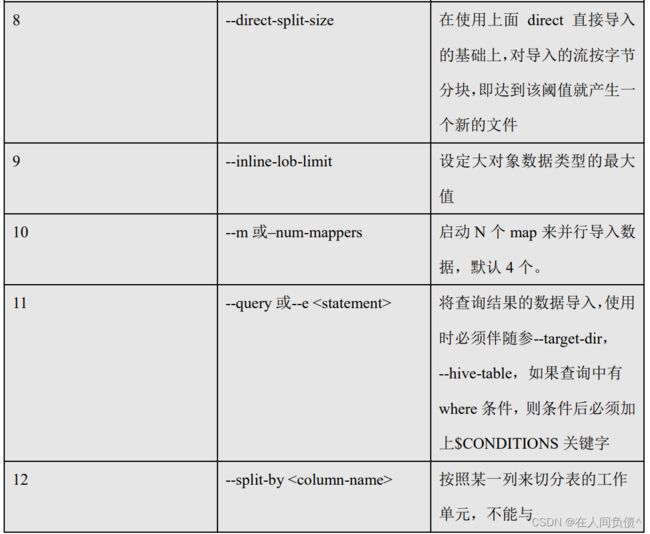

5. 命令&参数:import

将关系型数据库中的数据导入到 HDFS(包括 Hive,HBase)中,如果导入的是 Hive,那么当 Hive 中没有对应表时,则自动创建。

1) 命令:

如:导入数据到 hive 中

$ bin/sqoop import \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--table staff \

--hive-import

如:增量导入数据到 hive 中,mode=append

append 导入:

$ bin/sqoop import \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--table staff \

--num-mappers 1 \

--fields-terminated-by "\t" \

--target-dir /user/hive/warehouse/staff_hive \

--check-column id \

--incremental append \

--last-value 3

尖叫提示:append 不能与–hive-等参数同时使用(Append mode for hive imports is not yet supported. Please remove the parameter --append-mode)

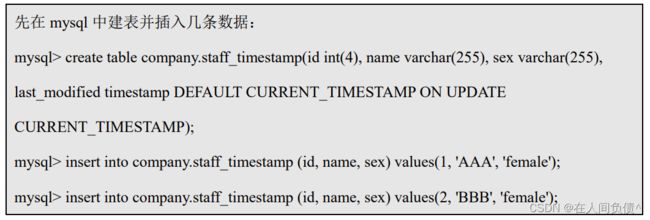

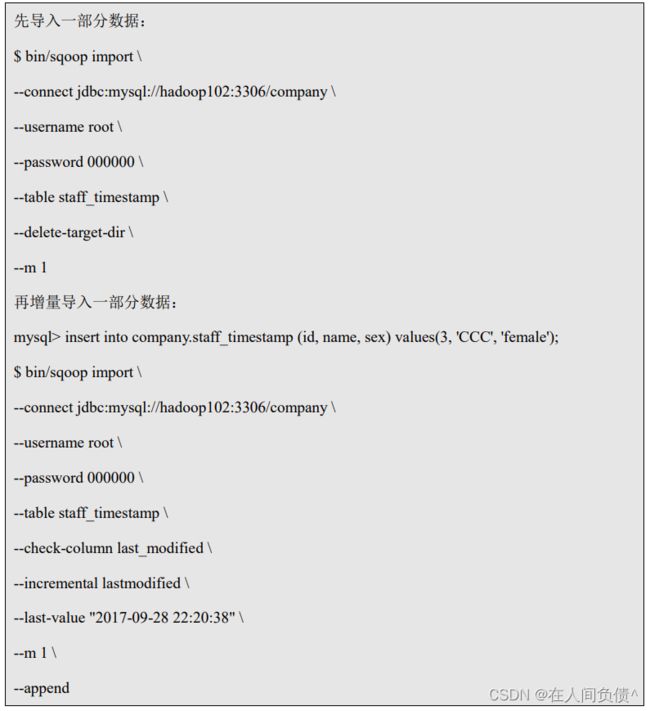

如:增量导入数据到 hdfs 中,mode=lastmodified

尖叫提示:使用 lastmodified 方式导入数据要指定增量数据是要–append(追加)还是要

–merge-key(合并)

尖叫提示:last-value 指定的值是会包含于增量导入的数据中

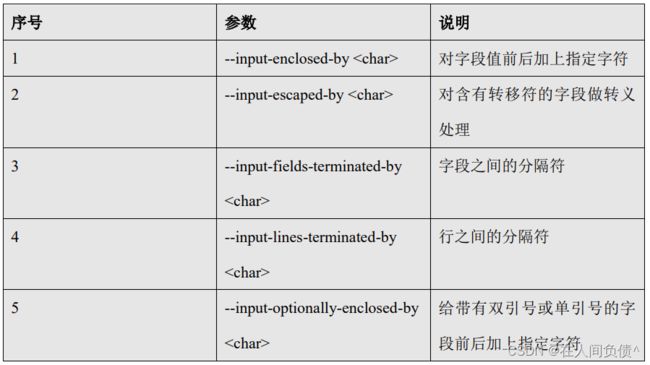

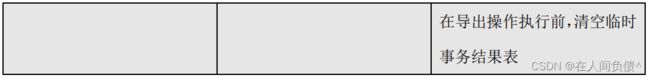

6. 命令&参数:export

从 HDFS(包括 Hive 和 HBase)中奖数据导出到关系型数据库中。

1) 命令:

$ bin/sqoop export \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--table staff \

--export-dir /user/company \

--input-fields-terminated-by "\t" \

--num-mappers 1

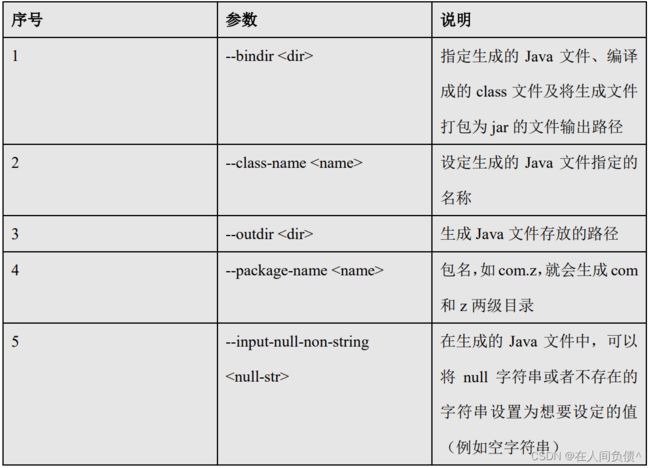

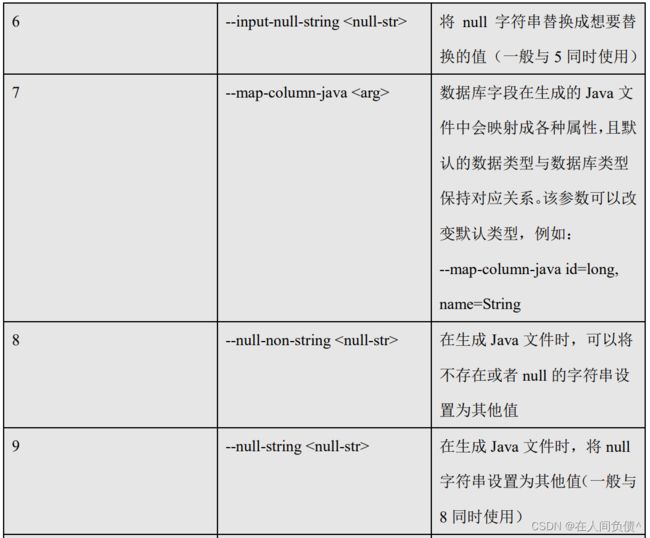

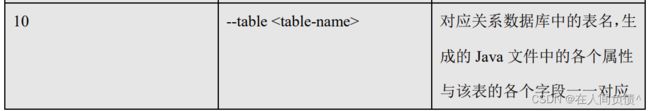

7. 命令&参数:codegen

将关系型数据库中的表映射为一个 Java 类,在该类中有各列对应的各个字段。

$ bin/sqoop codegen \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--table staff \

--bindir /home/admin/Desktop/staff \

--class-name Staff \

--fields-terminated-by "\t"

8. 命令&参数:create-hive-table

生成与关系数据库表结构对应的 hive 表结构。

命令:

$ bin/sqoop create-hive-table \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--table staff \

--hive-table hive_staff

9. 命令&参数:eval

可以快速的使用 SQL 语句对关系型数据库进行操作,经常用于在 import 数据之前,了解一

下 SQL 语句是否正确,数据是否正常,并可以将结果显示在控制台。

命令:

$ bin/sqoop eval \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--query "SELECT * FROM staff"

10. 命令&参数:import-all-tables

可以将 RDBMS 中的所有表导入到 HDFS 中,每一个表都对应一个 HDFS 目录

命令:

$ bin/sqoop import-all-tables \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--warehouse-dir /all_tables

11. 命令&参数:job

用来生成一个 sqoop 任务,生成后不会立即执行,需要手动执行。

命令:

$ bin/sqoop job \

--create myjob -- import-all-tables \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000

$ bin/sqoop job \

--list

$ bin/sqoop job \

--exec myjob

**尖叫提示:**注意 import-all-tables 和它左边的–之间有一个空格

**尖叫提示:**如果需要连接 metastore,则–meta-connect jdbc:hsqldb:hsql://linux01:16000/sqoop

**尖叫提示:**在执行一个 job 时,如果需要手动输入数据库密码,可以做如下优化

<property>

<name>sqoop.metastore.client.record.passwordname>

<value>truevalue>

<description>If true, allow saved passwords in the metastore.description>

property>

12. 命令&参数:list-databases

命令:

$ bin/sqoop list-databases \

--connect jdbc:mysql://hadoop102:3306/ \

--username root \

--password 000000

**参数:**与公用参数一样

13. 命令&参数:list-tables

命令:

$ bin/sqoop list-tables \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000

**参数:**与公用参数一样

14. 命令&参数:merge

将 HDFS 中不同目录下面的数据合并在一起并放入指定目录中

命令:

创建 JavaBean:

$ bin/sqoop codegen \

--connect jdbc:mysql://hadoop102:3306/company \

--username root \

--password 000000 \

--table staff \

--bindir /home/admin/Desktop/staff \

--class-name Staff \

--fields-terminated-by "\t"

开始合并:

$ bin/sqoop merge \

--new-data /test/new/ \

--onto /test/old/ \

--target-dir /test/merged \

--jar-file /home/admin/Desktop/staff/Staff.jar \

--class-name Staff \

--merge-key id

15. 命令&参数:metastore

记录了 Sqoop job 的元数据信息,如果不启动该服务,那么默认 job 元数据的存储目录为~/.sqoop,可在 sqoop-site.xml 中修改。

命令:

如:启动 sqoop 的 metastore 服务

$ bin/sqoop metastore