【Adversarial Attack in Object Detection】物理对抗攻击和防御

目录

-

- 安全监控

- **有无意义**

-

- 无意义的补丁

- 有意义的补丁

- 光学对抗攻击

-

- 对抗灯

- 干扰相机成像

- 攻击方法

-

- White-box attacks

-

- Gradient-based attacks

- == Optimization-based attacks ==

- Black-box attacks

-

- Query-based attacks

-

- Evolution algorithm

- OUTLOOK

在计算机视觉中,根据实现领域,对抗性攻击可以分为数字攻击和物理攻击。数字攻击是指在摄像头成像之后对数字像素进行攻击,物理攻击是指在摄像头成像之前对物理对象进行攻击。虽然数字攻击(如 PGD [ madry2017towards ]、 MI-FGSM [ dong2018boosting ]、 C&W [ carlini2017towards ]和 Deepfool [ moosavi2016deepfool ]等)对 DNN 模型表现良好,但它们很难在现实世界中实施。因为数字扰动通常是全局的和不显眼的,很难被相机清晰地捕捉到。这些缺点促使研究人员研究物理世界中更实用的攻击方式。为此,在自动驾驶中报道了许多物理对抗攻击[ brown2017adversarial , evtimov2017robust , lu2017adversarial , song2018physical , chen2018shapeshifter , kong2020physgan , bai2021inconspicuous , zhang2019camou , duan2020adversarial ,xue2021naturalae , wang2021dual ],人脸识别[ sharif2016accessorize,lu2017adversarial,pautov2019adversarial,singh2021brightness,sharif2019general,xiao2021improving ],安全监控[ thys2019fooling,wu2020making,xu 2020adversarial , huang2020universal , hu2022adversarial , wiyatno2019physical , ding2021towards , wang2019advpattern , hu2021naturalistic ]. 这些工作对安全关键任务提出了巨大挑战,因此研究 CV 系统对物理攻击的鲁棒性以及相应的防御策略至关重要。

[ chakraborty2018adversarial ]总结了针对不同机器学习模型的数字攻击和防御,但不涉及物理攻击和防御。阿赫塔尔等人。[ akhtar2018 威胁]回顾2018年之前计算机视觉中的对抗性攻击和防御,“Attacks in the real world”部分仅包含一些早期的物理攻击方法。后来,邱等人。[ qiu2019review ]在 2019 年将物理对抗性攻击作为对抗性攻击的应用场景进行介绍。然后,在 2020 年,Huang 等人。[ huang2020survey ]总结该领域的研究分为五个部分:验证、测试、对抗性攻击和防御以及可解释性。之后,[ akhtar2021advances ]系统地回顾了对抗性攻击和防御,但物理攻击仍然不是重点。我们可以看到,上述工作主要集中在数字领域引入对抗性攻击和防御,而对物理部分不做任何处理。最近,魏等人。[ wei2022physical ]发布了一项有关计算机视觉中的物理对抗性攻击的调查。他们分别从有效性、隐蔽性和鲁棒性方面讨论了当前的物理攻击。

与数字攻击相比,物理攻击面临的几个关键挑战如下:

(1)物理对抗样本应抵抗相机成像的影响,相机成像的影响主要受光学镜头和图像传感器处理器的影响。

(2)物理对抗示例需要对不同的变换保持鲁棒性,例如拍摄距离变化、角度变化和插图变化。

(3) 物理对抗样本应该是隐蔽的。数字图像以像素级进行修改,很难被感知。然而,物理攻击要实现不显眼是一个挑战。

验证、测试、对抗性攻击和防御以及可解释性

[ akhtar2018 威胁]回顾2018年之前计算机视觉中的对抗性攻击和防御,“Attacks in the real world”部分仅包含一些早期的物理攻击方法。后来,邱等人。[ qiu2019review ]在 2019 年将物理对抗性攻击作为对抗性攻击的应用场景进行介绍。然后,在 2020 年,Huang 等人。[ huang2020survey ]总结该领域的研究分为五个部分:验证、测试、对抗性攻击和防御以及可解释性。之后,[ akhtar2021advances ]系统地回顾了对抗性攻击和防御,但物理攻击仍然不是重点。我们可以看到,上述工作主要集中在数字领域引入对抗性攻击和防御,而对物理部分不做任何处理。最近,魏等人。[ wei2022physical ]发布了一项有关计算机视觉中的物理对抗性攻击的调查。他们分别从有效性、隐蔽性和鲁棒性方面讨论了当前的物理攻击。

`

| 子任务 | 方法 | 设置 | 物理形态 | 来源 |

|---|---|---|---|---|

| 人员检测 | 黄等。[黄2020通用] | 白色的 | 无意义补丁(衣服) | CVPR 2020 |

| 吴等。[吴2020制作] | 黑色的 | 无意义补丁(衣服) | ECCV 2020 | |

| 许等。[xu2020对抗] | 黑色的 | 无意义的补丁(T恤) | ECCV 2020 | |

| 胡等。[hu2021自然主义] | 黑色的 | 有意义的补丁(衣服) | ICCV 2021 | |

| 朱等。[zhu2021愚弄] | 黑色的 | 对抗性光 | 美国汽车工业协会 2021 | |

| 胡等人。[hu2022对抗性] | 黑色的 | 无意义补丁(衣服) | CVPR 2022 | |

| 朱等。[zhu2022红外线] | 黑色的 | 无意义贴片(红外线隐形衣) | CVPR 2022 | |

| 人重识别 | 王等。[wang2019advpattern] | 白色的 | 无意义补丁(衣服) | ICCV 2019 |

| 人物追踪 | PAT [wiyatno2019physical] | 白色的 | 无意义的补丁(海报) | ICCV 2019 |

| 丁等。[ding2021towards] | 白色的 | 无意义补丁(衣服) | 美国汽车工业协会 2021 | |

| 动作识别 | 小马等。[pony2021over] | 白色的 | 对抗光 | CVPR 2021 |

| ` |

安全监控

为提高社会治安,智能安防监控广泛应用于犯罪追踪、违法行为识别等场景。物理对抗样本可以被犯罪分子用来逃避安全监控,从而造成潜在的安全威胁。

人员检测人员检测是安全监控的一项基本任务,例如流量监控、犯罪追踪等。犯罪分子可能会利用针对人员检测系统的对抗性攻击来逃避安全检查。行人检测主要可分为基于可见光图像的方法和用于补偿夜间和光照条件差的红外图像识别方法。

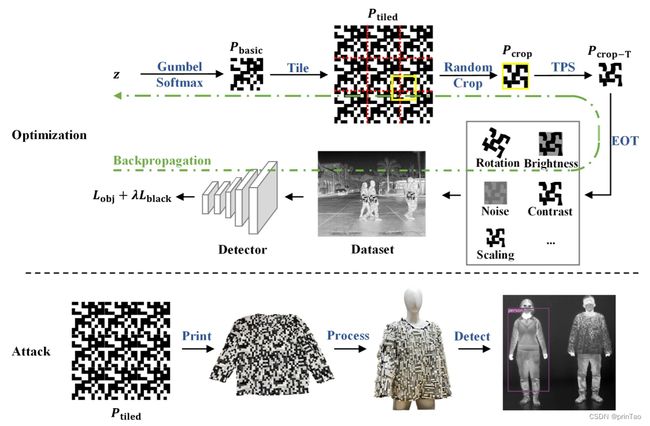

在可见光人体检测中,Thys [ thys2019fooling ]等人。是第一个对单级检测器 (YOLOv2 [ redmon2017yolo9000 ] ) 使用白盒攻击的人,他们将对抗模式打印到一块纸板上,并将其握在手中以逃避行人检测。为了控制物理实验中的环境变量,Huang [ huang2020universal ]等人。在虚拟环境中创建一个名为AttackScene的标准评估数据集。大多数研究人员还研究了可迁移性以验证他们的跨模型能力[ wu2020making、xu2020adversarial、hu2021naturalistic , hu2022adversarial , zhu2021fooling , zhu2022infrared ] ,在主流单阶段(YOLO 系列[ redmon2016you , redmon2017yolo9000 ] …)和两阶段检测器(Faster-RCNN [ ren2015faster ] )上进行评估。为了使对抗样本对服装变形具有鲁棒性,Wu 等人。[ wu2020making ]和 Xu 等人。[ xu2020adversarial ]在衣服上生成补丁之前考虑非刚体的变形。他们使用 Thin Plate Spline (TPS) 投射对抗模式[进行中]映射。最近,胡等人。[ hu2022adversarial ]提出 TC-EGA(基于环形裁剪的可扩展生成攻击)来生成具有重复模式的对抗纹理,该纹理可以适应相机的不同视点。为了产生自然的对抗模式,Hu 等人。[ hu2021naturalistic ]训练 BigGAN [ brock2018large ]来控制特定类别的生成。

在红外人体检测中,Zhu 等人。[ zhu2021fooling ]制作一个灯泡板来干扰红外人员检测。他们通过优化小灯泡阵列的参数间接调整光源的二维高斯分布,相比像素级计算可以大大降低计算成本。最近,朱等人。[ zhu2022infrared ]制作红外隐形衣(图5),由保温材料(TIM)和普通织物制成。在热像仪成像下,TIM覆盖的区域是暗的,其余的区域是亮的。因此,对手可以利用这一点生成黑白对抗模式,看起来像“二维码”。

人员重新识别 人员重新识别(re-ID)可用于安全监控。它是图像检索的子问题,旨在匹配不同摄像机视图中感兴趣的人。由于拍摄视角和距离的不同、着装的变化以及环境条件的不同,攻击re-ID模型已经成为一个具有挑战性的问题。王等。[ wang2019advpattern ]提出了第一个针对re-ID模型的物理攻击。他们实施针对身份不匹配的逃避攻击和针对目标人物冒充的冒充攻击。在物理实验中,他们制作对抗性的衣服并选择不同的拍摄角度和距离。结果显示,躲避攻击下匹配精度下降60%,冒充攻击下mAP下降67.9%。

人员跟踪 与人员检测不同,人员跟踪需要对移动的人员做出快速响应,并且通常将其建模为相似性匹配问题[ bertinetto2016ively,li2018high ]。以往的单目标跟踪攻击大多在数字领域实施[ chen2020one、yan2020hijacking、wu2019sta ],在物理环境中的转移效果不佳。Wiyatno 和 Xu [ wiyatno2019physical ]提出了一种生成对抗性纹理的方法,该纹理显示在屏幕或海报上。然而,它需要覆盖背景的大面积扰动,这对于在户外攻击跟踪器是不切实际的。由于原始图像中的空间纹理静止[ gatys2016image,kurakin2016adversarial ],Ding 等人。[ ding2021towards ]提出最大纹理差异(MTD),用于最大化模板图像和搜索图像之间的差异。在物理攻击中,他们对最先进的跟踪器(SiamRPN++ [ li2019siamrpn++ ],SiamMask [ wang2019fast ] )进行了实验) 并达到 40% 以上的 ASR。

动作识别动作 识别模型以时间序列图像作为输入。因此攻击者需要更新每一帧中的对抗样本,但是物理对抗样本很难立即改变,比如对抗补丁。小马等。[ pony2021over ]提出了一种通过控制 LED 灯来误导动作识别的可实现方法。他们不是计算每个像素的扰动,而是为每个帧添加一个具有相同值的 RGB 偏移量。

遥感

遥感与公共安全和国家安全密切相关。遥感图像由无人机或卫星拍摄,图像质量受到大气条件和相机与物体之间距离的挑战。Czaja 等人。[ czaja2018adversarial ]攻击航空图像分类器并提到大气的潜在影响。霍兰德等人。[ den2020adversarial ]试图伪装大型军事资产,例如飞机和军舰。但是,他们不会在现实世界中进行物理攻击。杜等人。[ du2022物理]首先对航拍图像进行物理攻击,他们不仅会在车辆顶部生成补丁,还会在离场的汽车上生成补丁。此外,他们考虑了天气和季节的影响,但消融研究表明,混合不同的天气并不能改善 ASR。

其他的

具身智能体随着多模态技术和虚拟环境的发展,具身智能体被用来模拟与人类及其周围环境的真实交互。利用体现问答(EQA)[ das2018embodied,das2018neural ]和体现视觉识别(EVR)[ yang2019embodied ]来实现语音和视觉交互。刘等人。[ liu2020时空]提出一种针对实体主体的新型时空攻击。智能体从不同的房间找到棋盘来回答问题。同时,攻击者在目标 3D 对象中生成扰动来欺骗代理(这些局部扰动可以在物理世界中制作为补丁)。结果表明,他们的方法导致问答(平均 40% 到 5%)和视觉识别(89.91% 到 18.32%)的准确率急剧下降。

2.2攻击形式

在实施物理攻击之前,需要适当地制造对抗性示例。攻击者通常关注一种方法在真实环境中是否可行,包括如何抵抗不利的环境影响、促进制造以及防止对抗模式被人眼检测到。本节介绍的攻击形式主要来自对抗性补丁、光学对抗性攻击和3D打印对抗性物体。

对抗性补丁

对抗性补丁是物理攻击中最流行的方法。数字攻击会在整个图像中产生扰动,这对于在现实世界中实施对抗性攻击是不切实际的,而补丁仅修改局部像素。它可以轻松打印并直接粘贴到目标上。掩模通常用于控制扰动区域的形状。在数字领域优化对抗性补丁后,将制作对抗性补丁并将其放置在物体的表面上。对抗补丁可以定义为:

有无意义

无意义的补丁

从人类观察的角度来看,无意义的斑块并不对应于现实世界中的物体。为了生成无意义的补丁,攻击者需要计算每个像素的扰动值。对于白盒攻击,补丁上的模式通常通过基于梯度的方法进行优化,如迭代 FGSM [ komkov2021advhat、pautov2019adversarial、nguyen2020adversarial ]等和 C&W [ evtimov2017robust、song2018physical、sitavarin2018rogue、chen2018shapeshifter、yang20 20beyond ]等黑色-框设置,粒子群优化(PSO)[sharif2016accessorize ]、强化学习(RL) [ wei2021generateing ]等用于优化。

为了使对抗性补丁看起来更平滑,攻击者最小化电视损失[ strong2003edge ]以减少相邻像素之间的变化。电视损耗可以表示为:

。[ komkov2021advhat , pautov2019adversarial ]遵循 Adv-Glass 的[ sharif2016accessorize ]设置并将 TV 损失添加到目标函数中。在Adv-Hat [ komkov2021advhat ]中,NPS不会对他们的实验产生影响。保托夫等人。[ pautov2019adversarial ]将RGB图像改为灰度,巧妙地避免了增加NPS损失。阮等。[ nguyen2020adversarial ]将RGB更改为LAB空间,以消除投影图案的像差。

对抗性补丁贴在 3D 物体的表面,例如人脸、汽车和衣服。这些曲面可能会破坏对抗模式的有效性,因此攻击者有必要对变形进行建模。对于人脸,Pautov 等人。[ pautov2019adversarial ]训练网格生成器来模拟非线性变换,然后将对抗模式投影到网格上。科姆科夫等人。[ komkov2021advhat ]使用 STL(空间转换层)将扰动投射到帽子上。STL包括两个步骤:离面弯曲和俯仰旋转。为了实现可穿戴的对抗性例子,Wu 等人。[ wu2020making ]和 Xu 等人。[ xu2020adversarial ]通过 TPS 对非刚性变形进行建模[ inproceedings ]。[ xu2020adversarial ]表明,对变形进行建模可以显着提高 ASR,相对于 YOLOv2 可以显着提高 ASR 48%-74%,相对于 Faster-RCNN [ ren2015faster ]可以显着提高 34%-61% 。胡等。[ hu2022adversarial ]介绍环形裁剪(TC)技术,该技术可以将二维平面上的点通过两次折叠投影到环面上。通过在循环补丁平面的交界处随机裁剪来搜索最佳纹理。

有意义的补丁

人类可以识别为真实物体的补丁是有意义的。大多数现有的有意义的补丁[ sharif2019general,hu2021naturalistic,xiao2021improving,yin2021adv ]都是由 GAN 生成的。对手通常训练生成器来生成真实或自然风格的对抗补丁[ xue2021naturalae , duan2020adversarial , heng2022physical ]。

脸贴每天都很常见,在节日或大型活动中都可以看到。最近,魏等人。[ wei2022adversarial ]优化卡通贴纸的位置和旋转角度,以达到对抗人脸识别系统的高成功率。他们不需要计算对抗模式的每个像素值。因此他们的方法更容易实施,也更具威胁性。

受自然阴影的启发,Zhong 等人。[ zhong2022shadows ]在现实世界中产生对抗性阴影,并达到 95% 的成功率。他们构建了一个三角形区域,并使用 PSO 策略通过优化三个顶点坐标来搜索最佳位置。为了调整阴影的亮度,他们根据SBU阴影数据集[ vicente2016large ]操纵LAB空间的L通道,统计LAB三通道像素值的平均比率来模拟真实阴影的设置。

然而,DAS [ wang2021dual ]结合了有意义的补丁和无意义的补丁。如图6 (b)所示,DAS生成的patch由两部分组成:笑脸的轮廓和难以辨认的图案纹理。神经网络在提取特征时更喜欢纹理信息,因此使用对抗纹理来欺骗DNN的注意力。同时,使用有意义的轮廓来分散人的注意力,使对抗性纹理不显眼。

光学对抗攻击

CV系统必须有光学感知模块,这会为物理对抗攻击留下“漏洞”。攻击者可以利用摄像头的成像原理和图像传感器处理器的特性进行攻击。基于现有研究,我们将光学对抗攻击分为对抗光和干扰相机成像。

对抗灯

通过光投影实现了一种将对抗补丁从可打印图片扩展到可见光的简单方法。阮等。[ nguyen2020adversarial ]提出通过将光投射到人脸上对 FRS 进行可行的实时物理攻击。他们首先在被攻击的场景上校准相机和投影仪的设置,然后在数字世界中生成对抗模式并将其投射到面部以欺骗 FRS。有两个关键的校准步骤(位置和颜色校准)来确保攻击的有效性。此外,他们还分析了一些导致失败案例的原因,例如环境光强、面部姿势糟糕、投影仪失焦等。洛维索托等人。[洛维索托2021slap ]通过在停车标志上投射 RGB 光来制作短期对抗性扰动 (SLAP)。为了适应光照变化,他们通过合成静态图像进行帧插值,这给了传感器响应时间,从而消除了相机在非明亮条件下的细微噪声。SLAP 在 SentiNet [ chou2020sentinet ]上显示出较高的 ASR ,这是针对对抗性补丁的最先进的防御方法。Gnanasambandam 等人。[ gnanasambandam2021光学]通过人工设计的照明分布实施对抗性攻击。他们没有对图像添加扰动,而是对从投影仪到相机的图像转换进行建模,通过梯度方法优化结构光的参数。其流程如图7所示。

为了实现不可察觉,Sayles 等人。[ sayles2021invisible ]利用商用相机中的卷帘快门效应 (RSE) 在物体上创建条纹图案,这既可以欺骗分类器,又可以被人眼看不见。他们采用 RSE 的可微表示,通过基于端到端梯度的方法计算扰动模式。实际上,RGB LED 以高于人类感知的频率产生调制照明。激光笔作为教学工具或宠物玩具等,在我们的日常生活中很常见。段等。[ duan2021adversarial ]提出了一种优化激光参数的方法,利用激光笔轻松实施攻击。

周等。[ zhou2018invisible ]利用消费级红外 LED 在面部产生对抗性光点。首先,他们计算聚光灯的最佳参数(位置、亮度和大小)。其次,他们在棒球帽的帽檐上发射硬件,以便于悄悄地照亮脸部。朱等。[ zhu2021愚弄]制造一个灯泡矩阵来欺骗热红外行人探测器。选择灯泡作为光源是因为它的亮度很好地反映了热特性。单个灯泡的温度和像素近似服从高斯分布。如果将许多灯泡放在纸板上满足二维高斯分布。需要优化的参数比像素级补丁少数千倍。

干扰相机成像

相机镜头和图像传感器处理器(ISP)对最终图像质量起着重要作用,因此可以将它们用作实施物理攻击的后门。扰乱相机成像专门利用光学成像原理,而不是扰乱硬件的功能和结构。

根据图像形成原理,ISP将行图像转换为RGB图像。潘等人。[ phan2021adversarial ]开发一种欺骗相机 ISP 的方法。他们为 ISP 设计了一个近似神经网络,并通过解决多任务优化问题来计算扰动。可以通过在目标函数中加入约束项来实现对特定相机的攻击。由于消费级相机采用了多个主流ISP,并且不同的ISP包含一些相同的流程(例如去马赛克),因此该方法对于针对其他黑盒光学成像系统的ISP转移攻击是有效的。

李等。[ li2019对抗]将精心设计的半透明贴纸(TS)贴在相机镜头上以对抗分类器。由于半透明贴纸上的图案失焦,相机镜头上的一个小不透明点会在最终图像中产生模糊的半透明图案。他们对这种效应进行建模,并在数字领域综合对抗性扰动。然而,在实践中,大多数参数化无法在物理世界中实现。或者,他们使用结构相似性(SSIM)来测量干净图像和点图像之间的相似性。具体来说,首先,对50种印刷颜色进行线性变换,以从实际RGB映射到数字RGB。贪婪搜索算法找到实现最高损失的最佳位置和颜色。最后,通过梯度下降微调位置。在现实世界的攻击中,十个点-TS 相对于 ResNet-50 实现了近 50% 的 ASR。后来,佐尔菲等人。[ zolfi2021translucent ]展开相机贴纸来攻击探测器。如图8所示,模型未能检测到停车标志,但正确识别了其他物体。在真实的自动驾驶环境中,他们攻击特斯拉 Model X 上的 ADAS(高级驾驶辅助系统)感知,成功地欺骗系统将红灯识别为绿灯。

攻击方法

根据现有研究的主要目的和设置,我们将攻击方法分为白盒攻击和黑盒攻击。在现实世界中,很难收集目标模型的知识,因此黑盒攻击更具实用性。

White-box attacks

Gradient-based attacks

Most white-box attacks generate perturbations based on the gradient information of the target model. Goodfellow et al. [kurakin2016adversarial] improve FGSM and propose a basic iterative method (BIM) used in the first physical attack. Furthermore, they suggest using the label of the least-likely class to implement the targeted attack. Wiyatno et al. [wiyatno2019physical] generate the physical adversarial texture (like colourful art) by FGSM, which controls the gradient direction. The Projected Gradient Descent (PGD) [madry2017towards] is another widely used powerful method that projects the gradient to a ball. Madry et al. [madry2017towards] prove the PGD is the bounded I-FGSM. Later, improvements of I-FGSM appeared, Momentum iterative [dong2018boosting] is used against local optimum, and applying image transformations [xie2019improving] for enhancing input diversity.

In most physical cases, parameters can be optimized directly with gradient descent in the white-box setting. Singh et al. [singh2021brightness] propose to generate robust adversarial examples against light changes by exploiting nonlinear brightness transformation and PGD attack. However, sometimes attackers must establish differentiable models themselves so that the gradient propagates in the framework of producing adversarial examples [gnanasambandam2021optical, suryanto2022dta, phan2021adversarial, sayles2021invisible]. The gradient-based method can achieve a high success rate in white-box settings, but their performances usually drop when transferred to other black-box models.

== Optimization-based attacks ==

Some works show that gradient-based methods are noneffective on models with defence mechanisms, such as adversarial training [madry2017towards] and knowledge distillation [papernot2016distillation]. In such a case, the optimization-based attacks are available.

Carlini & Wagner [carlini2017towards] regard solving the adversarial example as a box-constrained optimization problem:

is a hyperparameter that balance terms. Results show that C&W attack can break the KD defense, even some other defensive methods.

Due to its good performance, many attack methods follow the C&W-like objective function. To fool the traffic sign classified model, Eykholt et al. [evtimov2017robust] add EOT and NPS on basic C&W. Yang et al. [yang2020beyond] use C&W attack against outputs of the SSD model with constrains of colours and brightness, the objective function calculates the logits distance between the original class and the target class. Pony et al. [pony2021over] propose the modified C&W loss function. Considering the quadratic loss term smoothing the gradients and momentum of the optimizer, they define the loss function as non-negative and take the minimum between the linear item and the quadratic term as the value of the loss function. In order to achieve imperceptibility, two regularization terms are introduced to constrain the first and second-order temporal derivatives: the first controls temporal changes of the perturbation, and the second penalizes rapid trend changes. Tsai et al. [tsai2020robust] generate adversarial point clouds and real print objects. They adopt the basic C&W loss function with a small modification. Unlike the image, the perturbation of point clouds is represented by a vector, which includes the direction and the magnitude of shift points. The Chamfer distance [fan2017point] is used as an alternative way to measure the distance between the original point and the shifted point. Although the C&W attack is effective against various visual task models, the adversarial example still lacks the transferability and inconspicuousness.

Black-box attacks

Query-based attacks

model are unknown but allow the attacker to obtain the output of the target model, such as probability or class.

Evolution algorithm

比较有意思,等会儿看看怎么写的

OUTLOOK

(1) Transferable Physically Adversarial Attacks

For real-world attack applications such as face recognition, autonomous driving, and security monitoring, white-box attacks are difficult to implement, and commercial systems do not support querying. Therefore, only transfer-based attacks can be utilized. However, the current transfer-based adversarial attacks in the physical environment are still relatively weak. It is worthy of an in-depth study.

(2) Robust Physically Adversarial Attacks

Physically adversarial examples must maintain effectiveness in different shooting angles, distances and lighting conditions and adapt to the camera’s various processing. How to remain the effectiveness in these changing circumstances is a challenge, and is worthy of an in-depth study.

(3) Stealthy Physically Adversarial Attacks

Physical attacks tend to produce conspicuous perturbations for sensing devices to capture adversarial patterns effectively, which brings a big problem in realising stealthiness. Constructing device-perceptible while human-imperceptible physical attacks is a challenge, and is worthy of an in-depth study.

(4) Natural Physically Adversarial Attacks

Existing works concentrate on constructing artificially adversarial examples. However, there are many naturally formed adversarial examples in real life, such as images captured in the clouds, rain, fog or captured at a specific viewpoint. These phenomena have threat to the autonomous driving system. Thus, how to find these adversarial examples is challenging.

(5) Universal Physically Adversarial Defenses

Existing physical defenses are primarily designed against adversarial patches, but various forms of attacks also exist. It is impossible to design the specific defense method for each attack form, so finding a mechanism to construct an universal physical defence is necessary.

(6) Efficient Physically Adversarial Defenses

No matter pre-processing, adversarial training or post-processing defense methods, all of them bring additional computation, so it is challenging to design an efficient defense without eatra computation cost. For example, designing the new network’s architecture.

(7) Trade-off Physically Adversarial Defenses

Similar to digital defenses, physical defenses will also face the trade-off problem between accuracy and robustness. According to characteristics of the physical attack, it is challenging to eliminate this trade-off, and is worthy of an in-depth study.