论文浅尝 | KGNLI: 知识图谱增强的自然语言推理模型

笔记整理 | 韩振峰,天津大学硕士

链接:https://aclanthology.org/2020.coling-main.571.pdf

动机

自然语言推理 (NLI) 是自然语言处理中的一项重要任务,它旨在识别两个句子之间的逻辑关系。现有的大多数方法都是基于训练语料库来获得语义知识从而进行推理的,很少采用背景知识或者限制与少量特定类型的知识。本文提出了一种新颖的知识图谱增强的NLI模型(KGNLI),以利用知识图谱中的背景知识。KGNLI 模型由三个模块组成:知识关系表示模块、语义关系表示模块和标签预测模块。与以前的方法不同,本文提出的 KGNLI 模型中可以灵活地组合各种背景知识。在四个数据集(SNLI、MultiNLI、SciTail和BNLI)上的实验验证了模型的有效性。

亮点

KGNLI的亮点主要包括:

1.提出使用句子中的主语、谓语和宾语来构建知识图谱子图,从而获取句子的知识关系表示。2.使用BiLSTM获取句子的语义关系表示,并将其与知识关系表示进行融合。3.模型在四个数据集上都取得了很多好的效果。

概念及模型

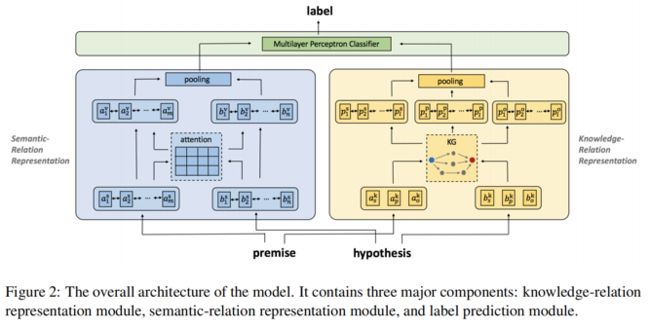

KGNLI模型由知识关系表示、语义关系表示和标签预测三个模块组成,模型整体框架如下:

•知识关系表示

本文假设句子对 p 和 h 之间的关系由它们的主语、宾语和谓语之间的关系决定。

背景关系子图:给本文将句子对 p 和 h 中的主语对、谓语对和宾语对分别表示为(p_s, h_s)、(p_p, h_p)和(p_o, h_o)。对于每一个句子对,通过在知识图谱KG上进行随机游走获取实体之间的路径,从而提取出背景关系子图中的主语对(p_s, h_s)。谓语对和宾语对以同样的方式提取。本文使用句子的句法依存树来提取主语、谓语和宾语。

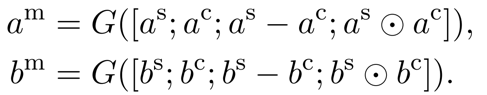

知识嵌入:本文基于子图来学习句子对的知识关系表示。首先,使用TransE来初始化 p 和 h 的知识嵌入向量{a_s^k, a_p^k, a_o^k}和{b_s^k, b_p^k, b_o^k}:

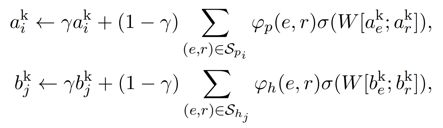

然后使用图神经网络更新嵌入向量。对于每一个实体,检索子图上它的所有邻居节点,使用如下规则利用邻居节点的信息:

其中S_pi代表p_i的所有(e,r)对的集合,e是p_i的邻居,r 是p_i和e之间的关系。对于p,\phi_p(e, r)为:

对于h,\phi_h(e, r)为:

关系表示:基于子图中路径的表示来获取关系表示。将主语对(p_s, h_s)之间的第个i路径表示为:

r_j和e_j表示路径上的第j个关系和实体。谓语和宾语的路径l_i^P和l_i^O以相同的方式定义。使用BiLSTM编码路径序列:

知识融合:使用下列融合层来融合主语对、谓语对和宾语对的关系:

•语义关系表示

为下文将p和h表示为p=[p_1, ..., p_m]和 h=[h_1,...h_m]。

语义嵌入:首先使用GloVe初始化单词向量,然后使用双向LSTM编码p和h,p和h的语义嵌入为:

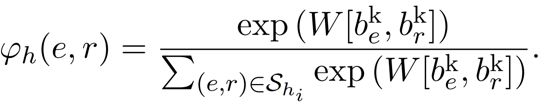

局部推理:首先使用一个软对齐层来计算单词之间的相似度:

然后根据联合注意力E来计算局部相关信息:

最后使用下列公式增强局部推理信息:

语义融合:融合层在句子层面上学习局部推理关系的类型,使用BiLSTM获取融合的向量:

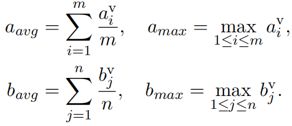

然后使用池化层计算句子的平均池化和最大池化:

最后得到p和h的语义关系为:

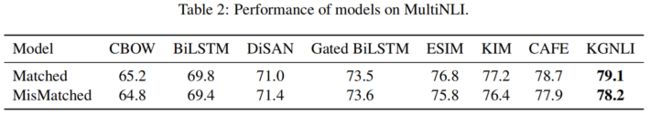

•标签预测 使用句子对的全局关系来预测最终的标签,这里使用MLP:

实验

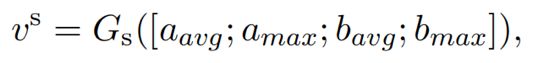

本文采用了4个数据集进行实验,分别是SNLI, MultiNLI, SciTail, and BNLI,在每个数据集上的实验结果如下:

从以上各表可以看出,本文提出的模型KGNLI在各个数据集上均取得了很好的效果。

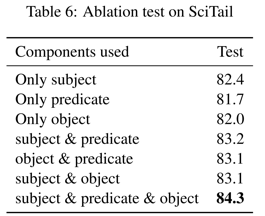

消融实验

为了验证主语、谓语和宾语对实验结果的影响,本文设计了如下表所示的消融实验,可以看出主语、谓语和宾语对模型的影响。

总结

本文提出了一种基于知识图谱的知识增强的自然语言推理模型(KGNLI),将背景知识引入NLI模型中。对于句子对,KGNLI模型学习到了基于知识图谱路径的知识关系表示和基于句子对的语义关系表示。这两个表示通过前馈神经网络融合以预测关系标签。实验结果验证了KGNLI模型的有效性。在未来的工作中,将致力于探索如何确定句子对中决定句子关系的关键字。

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站。