CTR预估 论文精读(十七)--ESMM: Entire Space Multi-Task Model

ESMM: Entire Space Multi-Task Model: An Effective Approach for Estimating Post-Click Conversion Rate 论文总结

本文介绍 阿里妈妈团队 发表在 SIGIR’2018 的论文《Entire Space Multi-Task Model: An Effective Approach for Estimating Post-Click Conversion Rate》。文章基于 Multi-Task Learning 的思路,提出一种新的CVR预估模型——ESMM,有效解决了真实场景中CVR预估面临的数据稀疏以及样本选择偏差这两个关键问题。 实践出真知,论文一点也不花里胡哨,只有4页,据传被 SIGIR’2018 高分录用。

1. 摘要

Estimating post-click conversion rate (CVR) accurately is crucial for ranking systems in industrial applications such as recommendation and advertising. Conventional CVR modeling applies popular deep learning methods and achieves state-of-the-art performance. However it encounters several task-specific problems in practice, making CVR modeling challenging. For example, conventional CVR models are trained with samples of clicked impressions while utilized to make inference on the entire space with samples of all impressions. This causes a sample selection bias problem. Besides, there exists an extreme data sparsity problem, making the model fitting rather difficult. In this paper, we model CVR in a brand-new perspective by making good use of sequential pattern of user actions, i.e., impression → \rightarrow → click → \rightarrow → conversion. The proposed Entire Space Multi-task Model (ESMM) can eliminate the two problems simultaneously by i) modeling CVR directly over the entire space, ii) employing a feature representation transfer learning strategy. Experiments on dataset gathered from traffic logs of Taobao’s recommender system demonstrate that ESMM significantly outperforms competitive methods. We also release a sampling version of this dataset to enable future research. To the best of our knowledge, this is the first public dataset which contains samples with sequential dependence of click and conversion labels for CVR modeling.

1. 主要工作

最重要的创新点在于通过建模 pCTR (pCTR = click samples / expo samples ),pCTCVR (pCTCVR = click & conversion samples / expo samples) 间接得到 pCVR (pCVR = conversion samples / click samples),这样做的好处是 pCTR, pCTCVR 均是从曝光样本开始建模,前者建模曝光 - 点击,后者建模曝光 - 点击 - 转化,两者均是可以使用曝光全量样本,从而避免了直接建模 pCVR(点击 - 转化)存在的 样本选择性偏差 和 数据稀疏性 问题,换言之,pCTR, pCTCVR 都是在全样本空间建模。

- 因此,通过 pCTR, pCTCVR 而间接得到的 pCVR 也是应用在全样本空间中,消除了样本选择偏差问题;

- 其次,CVR 网络与 CTR 网络共享底层特征,进一步缓解了 CVR 样本稀疏性问题;

2. Motivation

不同于CTR预估问题,CVR预估面临两个关键问题:

- Sample Selection Bias (SSB) 转化是在点击之后才“有可能”发生的动作,传统CVR模型通常以点击数据为训练集,其中点击未转化为负例,点击并转化为正例。但是训练好的模型实际使用时,则是对整个空间的样本进行预估,而非只对点击样本进行预估。即是说,训练数据与实际要预测的数据来自不同分布,这个偏差对模型的泛化能力构成了很大挑战。

- Data Sparsity (DS) 作为CVR训练数据的点击样本远小于CTR预估训练使用的曝光样本。

一些策略可以缓解这两个问题,例如从曝光集中对 unclicked 样本抽样做负例缓解 SSB,对转化样本过采样缓解 DS 等。但无论哪种方法,都没有很 elegant 地从实质上解决上面任一个问题。

可以看到:点击—>转化,本身是两个强相关的连续行为,作者希望在模型结构中显示考虑这种“行为链关系”,从而可以在整个空间上进行训练及预测。这涉及到 CTR 与 CVR 两个任务,因此使用多任务学习(MTL)是一个自然的选择,论文的关键亮点正在于“如何搭建”这个MTL。

除此之外,对于 CVR 建模也存在 delayed feedback 问题,只是该论文没有进一步研究这点;

3. Model

介绍ESMM之前,我们还是先来思考一个问题——“CVR预估到底要预估什么”,论文虽未明确提及,但理解这个问题才能真正理解CVR预估困境的本质。想象一个场景,一个item,由于某些原因,例如在feeds中的展示头图很丑,它被某个user点击的概率很低,但这个item内容本身完美符合这个user的偏好,若user点击进去,那么此item被user转化的概率极高。CVR预估模型,预估的正是这个转化概率,它与CTR没有绝对的关系,很多人有一个先入为主的认知,即若user对某item的点击概率很低,则user对这个item的转化概率也肯定低,这是不成立的。

更准确的说,CVR预估模型的本质,不是预测“item被点击,然后被转化”的概率(CTCVR),而是“假设item被点击,那么它被转化”的概率(CVR)。这就是不能直接使用全部样本训练CVR模型的原因,因为咱们压根不知道这个信息:那些unclicked的item,假设他们被user点击了,它们是否会被转化。如果直接使用0作为它们的label,会很大程度上误导CVR模型的学习。

impression - click(pCTR), click - converison(pCVR), impression - click - conversion(pCTCVR) 是三个不同的任务后,我们再来看三者的关联:

p ( z & y = 1 ∣ x ) ⏟ p C T C V R = p ( z = 1 ∣ y = 1 , x ) ⏟ p C V R p ( y = 1 ∣ x ) ⏟ p C T R \underbrace{p(z \& y=1 \mid \boldsymbol{x})}_{p C T C V R}=\underbrace{p(z=1 \mid y=1, \boldsymbol{x})}_{p C V R} \underbrace{p(y=1 \mid \boldsymbol{x})}_{p C T R} pCTCVR p(z&y=1∣x)=pCVR p(z=1∣y=1,x)pCTR p(y=1∣x)

其中 z , y z, y z,y 分别表示 conversion 和 click。注意到,在全部样本空间中,CTR对应的label为click,而CTCVR对应的label为 click & conversion,这两个任务是可以使用全部样本的。**那为啥不绕个弯,通过这学习两个任务,再根据上式隐式地学习CVR任务呢?**ESMM正是这么做的,具体结构如下:

Figure 1: Architecture overview of ESMM for CVR modeling. In ESMM, two auxiliary tasks of CTR and CTCVR are introduced which: i) help to model CVR over entire input space, ii) provide feature representation transfer learning. ESMM mainly consists of two sub-networks: CVR network illustrated in the left part of this figure and CTR network in the right part. Embedding parameters of CTR and CVR network are shared. CTCVR takes the product of outputs from CTR and CVR network as the output.

Figure 1: Architecture overview of ESMM for CVR modeling. In ESMM, two auxiliary tasks of CTR and CTCVR are introduced which: i) help to model CVR over entire input space, ii) provide feature representation transfer learning. ESMM mainly consists of two sub-networks: CVR network illustrated in the left part of this figure and CTR network in the right part. Embedding parameters of CTR and CVR network are shared. CTCVR takes the product of outputs from CTR and CVR network as the output.

仔细观察上图,留意以下几点:

1)共享Embedding

CVR-task和CTR-task使用相同的特征和特征embedding,即两者从 Concatenate 之后才学习各自部分独享的参数;

2)隐式学习pCVR

这里 pCVR(粉色节点)仅是网络中的一个 variable,没有显示的监督信号。

具体地,反映在目标函数中:

L ( θ c v r , θ c t r ) = ∑ i = 1 N l ( y i , f ( x i ; θ c t r ) ) + ∑ i = 1 N l ( y i & z i , f ( x i ; θ c t r ) ∗ f ( x i ; θ c v r ) ) L\left(\theta_{c v r}, \theta_{c t r}\right)=\sum_{i=1}^{N} l\left(y_{i}, f\left(\boldsymbol{x}_{i} ; \theta_{c t r}\right)\right)+\sum_{i=1}^{N} l\left(y_{i} \& z_{i}, f\left(\boldsymbol{x}_{i} ; \theta_{c t r}\right) * f\left(\boldsymbol{x}_{i} ; \theta_{c v r}\right)\right) L(θcvr,θctr)=i=1∑Nl(yi,f(xi;θctr))+i=1∑Nl(yi&zi,f(xi;θctr)∗f(xi;θcvr))

即利用CTCVR和CTR的监督信息来训练网络,隐式地学习 CVR,这正是 ESMM 的精华所在,至于这么做的必要性以及合理性,本节开头已经充分论述了。

再思考下,ESMM的结构是基于“乘”的关系设计—— p C T C V R = p C V R ∗ p C T R pCTCVR = pCVR * pCTR pCTCVR=pCVR∗pCTR,是不是也可以通过“除”的关系得到pCVR,即 pCVR = pCTCVR / pCTR ?例如分别训练一个CTCVR和CTR模型,然后相除得到pCVR,其实也是可以的,但这有个明显的缺点:真实场景预测出来的pCTR、pCTCVR值都比较小,“除”的方式容易造成数值上的不稳定。作者在实验中对比了这种方法。

4. Experiment

数据集

目前还没用同时包含点击、转化信息的公开数据集,作者从淘宝日志中抽取整理了一个数据集 Product,并开源了从 Product 中随机抽样 1% 构造的数据集 Public(约38G)。

实验设置

- 对比方法:BASE——图1左部所示的CVR结构,训练集为点击集;AMAN——从unclicked样本中随机抽样作为负例加入点击集合;OVERSAMPLING——对点击集中的正例(转化样本)过采样;UNBIAS——使用rejection sampling;DIVISION——分别训练CTR和CVCTR,相除得到pCVR;ESMM-NS——ESMM结构中 CVR 与 CTR 部分不 share embedding。

- 上述方法/策略都使用NN结构,relu激活函数,嵌入维度为18,MLP结构为36020080 * 2,adam 优化器 with β 1 = 0.9 , β 2 = 0.999 , ϵ = 1 0 − 8 \beta_{1}=0.9, \beta_{2}=0.999, \epsilon=10^{-8} β1=0.9,β2=0.999,ϵ=10−8 。

- 按时间分割,1/2数据训练,其余测试

衡量指标 在点击样本上,计算 CVR 任务的 AUC;同时,单独训练一个和 BASE 一样结构的 CTR 模型,除了ESMM类模型,其他对比方法均以 pCTR * pCVR 计算 pCTCVR,在全部样本上计算 CTCVR 任务的 AUC。

实验结果

如表1所示,ESMM显示了最优的效果。这里有趣的一点可以提下,ESMM是使用全部样本训练的,而CVR任务只在点击样本上测试性能,因此这个指标对ESMM来说是在biased samples上计算的,但ESMM性能还是很牛啊,说明其有很好的泛化能力。

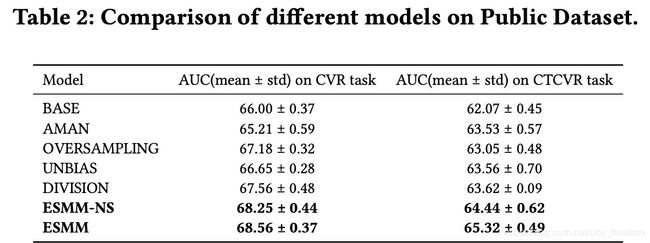

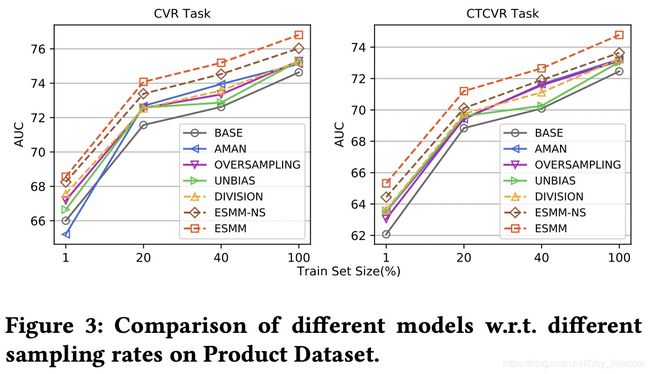

表2. 在Public上的实验结果,AUC以%为单位在Product数据集上,各模型在不同抽样率上的AUC曲线如图2所示,ESMM显示的稳定的优越性,曲线走势也说明了Data Sparsity的影响还是挺大的。

图3. 在Product上,各模型在不同抽样率上的AUC曲线5. Discussion

-

ESMM 根据用户行为序列,显示引入CTR和CTCVR作为辅助任务,“迂回” 学习CVR,从而在完整样本空间下进行模型的训练和预测,解决了CVR预估中的2个难题。

-

可以把 ESMM 看成一个新颖的 MTL 框架,其中子任务的网络结构是可替换的,当中有很大的想象空间。至于这个框架的意义,这里引用论文作者之一@朱小强的描述:

据我所知这个工作在这个领域是最早的一批,但不唯一。今天很多团队都吸收了MTL的思路来进行建模优化,不过大部分都集中在传统的MTL体系,如研究怎么对参数进行共享、多个Loss之间怎么加权或者自动学习、哪些Task可以用来联合学习等等。ESMM模型的特别之处在于我们额外**关注了任务的Label域信息,通过展现>点击>购买所构成的行为链,巧妙地构建了multi-target概率连乘通路。**传统MTL中多个task大都是隐式地共享信息、任务本身独立建模,ESMM细腻地捕捉了契合领域问题的任务间显式关系,从feature到label全面利用起来。这个角度对互联网行为建模是一个较有效的模式,后续我们还会有进一步工作。

参考文献

[1] Entire Space Multi-Task Model: An Effective Approach for Estimating Post-Click Conversion Rate

[1] 阿里CVR预估模型之 ESMM