- 智慧水库信息化系统建设产品需求文档V2.0

小赖同学啊

testTechnologyPrecious物联网

智慧水库信息化系统建设产品需求文档1.引言1.1文档目的本文档旨在明确智慧水库信息化系统的建设需求,为系统设计、开发和实施提供全面依据,确保系统功能满足水库管理业务需求,提升水库管理的智能化水平和决策效率。1.2背景介绍传统水库管理面临数据采集不及时、分析手段有限、决策依赖经验等问题,难以应对复杂多变的水文情势和日益增长的管理需求。随着物联网、大数据、人工智能等技术的发展,智慧水库建设成为必然趋势

- 黄仁勋链博会演讲实录:脱掉皮衣,穿上唐装,中文开场

黄仁勋一度尝试用中文开场,他说,“我在美国长大,学到了很多汉语。”他表示,像DeepSeek、阿里巴巴、MiniMax、百度,他们开发的产品都是世界级的,推动了全球人工智能的发展。中国的开源AI是全球进步的催化剂,以至于全世界各个行业都有机会加入到AI革命当中。7月16日,黄仁勋身着唐装出席了第三届链博会,在此之前,他身着标志性皮衣出席多个场合活动。在此之前,英伟达官宣获得H20芯片对华的出口许可

- OpenCV学习(二)-二维、三维识别

香蕉可乐荷包蛋

#OpenCVopencv学习人工智能

OpenCV是一个功能强大的计算机视觉库,可以用于识别和处理二维图像和三维图像。以下是关于二维图像和三维图像识别的基础知识和示例代码。1.二维图像识别二维图像识别通常包括图像分类、对象检测、特征提取等任务。以下是一些常见的操作:1.1图像分类使用预训练模型对图像进行分类,例如使用深度学习模型(如ResNet、MobileNet等)。importcv2#加载预训练的深度学习模型net=cv2.dnn

- 【AI 赋能:Python 人工智能应用实战】5. 梯度下降家族:SGD/Adam优化器对比实验与选择策略

AI_DL_CODE

人工智能python梯度下降优化器SGDAdamPyTorch

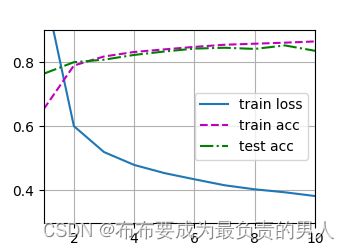

摘要:本文系统解析梯度下降优化器的核心原理与演进脉络,构建从理论到实战的完整知识体系。理论部分梳理优化器发展里程碑,从1951年的SGD到2018年的AdamW,揭示技术迭代逻辑;通过数学公式对比SGD、Momentum、Adam等核心算法的更新机制,解析动量加速、自适应学习率的创新点。结合损失曲面分析,阐释Momentum如何逃离鞍点、Adam如何处理悬崖梯度。实战模块基于PyTorch在MNI

- 【人工智能之深度学习】6. 卷积核工作原理:从边缘检测到特征抽象的逐层演进(附可视化工具与行业实战代码)

AI_DL_CODE

人工智能深度学习卷积核特征提取卷积神经网络边缘检测特征可视化

摘要:卷积核是卷积神经网络(CNN)的核心组件,其通过局部感受野与参数共享机制实现高效特征提取。本文从数学本质出发,揭示卷积操作的空域-频域对偶性:空域卷积等价于频域乘积(F{f∗g}=F{f}⋅F{g}F\{f*g\}=F\{f\}⋅F\{g\}F{f∗g}=F{f}⋅F{g}),解释边缘检测核(Sobel、Laplacian)的频域响应特性。通过特征可视化实验表明,CNN特征呈现逐层抽象规律:

- 颠覆未来:创新代码引领人工智能与量子计算深度融合

金枝玉叶9

程序员知识储备1程序员知识储备2程序员知识储备3人工智能量子计算

摘要在信息时代飞速演进的背景下,人工智能与量子计算正以前所未有的速度互相融合,推动着科技边界的不断拓展。本文回顾了经典算法的智慧,展示了前沿深度学习模型的构建,并通过量子电路设计探讨了创新代码的可能性,为探索未来科技变革提供了全新视角。1.引言当前,科技创新正处于高速迭代的关键阶段,传统计算方法与新型技术的交汇处正成为研究热点。人工智能的发展已渗透到各行各业,而量子计算的崛起则为解决复杂计算问题提

- 【大模型】结构化提示词:让AI高效完成复杂任务的“编程语言”

JosieBook

AI/大数据/云计算人工智能

文章目录前言:提示词一、不同提示词写作方法对比进阶技巧对比表实战组合策略二、三板斧:精准撰写提示词的黄金法则角色设定:为AI精准定位任务描述:明确行动指南输出要求:规范成果呈现三、魔法棒:零基础也能用的“AI需求翻译机”四、结构化:把提示词写成“可插拔的乐高”五、分治法:把“庞然大物”拆成可并行的小任务前言:提示词在人工智能时代,提示词(Prompt)已成为连接人类意图与AI能力的核心媒介。优质的

- 使用UV管理PyTorch项目

PyTorch是深度学习研究和开发的流行选择。可以使用uv管理PyTorch项目,包括不同Python版本依赖、管理环境、甚至加速器选择等。安装Pytorch从打包角度来看,PyTorch有几个不常见的特点:许多PyTorchwheel托管在专门的索引上,而非Python包索引(PyPI)。因此,安装PyTorch通常需要配置项目使用PyTorch专属索引。PyTorch为每种加速器生成不同的构建

- 人工智能视频分析系统人员离岗报警设计方案

liuhu21

人工智能云计算运维

一、方案概述近几年安防监控技术不断的进步,特别是在人工智能推出之后。安防监控系统结合人工智能算法做到了许多以前无法做到的事情。就比如我们今天要说的离岗检测报警监控系统。以前我们只能通过人工值守监控室的方式,通过人的判断去观看现场人员在岗情况。如今有了离岗检测监控系统,系统可以自动监测现场人员是否在岗、离岗时间以及离岗人数等等。这样,大大减少了监控室值班人员的工作量,同时相较人工监管提升了工作效率。

- AI新纪元:2025年深度学习技术突破与行业应用全景

像素笔记

杂谈人工智能深度学习ai自动驾驶工业数字化转型未来趋势技术创新

2025年,人工智能技术迎来爆发式增长,大模型、生成式AI和多模态技术持续突破,人形机器人量产元年正式开启,自动驾驶商业化进程加速,工业数字化转型全面铺开。这些进展不仅重塑了技术边界,更在多个行业创造了实际价值,推动AI从实验室走向产业化。本文将深入剖析2025年深度学习与AI领域的核心技术突破、行业应用案例及未来发展趋势,为技术从业者提供全面视角。一、深度学习核心技术突破:大模型、生成式AI与多

- 模型移植实战:从PyTorch到ONNX完整指南

慕婉0307

神经网络pytorch人工智能python

一、认识ONNXONNX(OpenNeuralNetworkExchange)是一种开放的模型表示格式,由微软和Facebook(现Meta)在2017年共同推出,旨在解决深度学习模型在不同框架之间的互操作性问题。ONNX的主要优势包括:跨框架兼容性:支持主流深度学习框架间的模型转换,包括PyTorch、TensorFlow、MXNet、CNTK等例如,可以将PyTorch训练的ResNet模型导

- 三篇AAAI顶级论文带你一键搞懂多模态!

关注gongzhonghao【计算机sci论文精选】!拿捏更多顶会顶刊发文资讯随着人工智能技术的飞速发展,多模态学习逐渐成为研究热点。多模态技术能够整合文本、图像、语音等多种模态的信息,为人工智能的应用带来了更丰富的语义理解和更强大的交互能力。此外,多模态技术在视频和语言任务中的应用也取得了显著进展。这些技术不仅提升了模型的性能,还为人工智能在更多领域的应用提供了新的可能性。今天小图给大家精选3篇

- TensorFlow GPU 2.10.1 for Python 3.9快速安装指南

疑样

本文还有配套的精品资源,点击获取简介:TensorFlowGPU2.10.1是专为Windowsx64和Python3.9设计的TensorFlow版本,它集成了GPU支持以加快深度学习模型的训练。本指南提供了该版本的概述、安装步骤及注意事项,旨在帮助开发者利用其性能优势提升机器学习项目的效率。1.TensorFlowGPU介绍1.1TensorFlow的起源与功能TensorFlow是由Goog

- 进阶向:基于Python的智能客服系统设计与实现

智能客服系统开发指南系统概述智能客服系统是人工智能领域的重要应用,它通过自然语言处理(NLP)和机器学习技术自动化处理用户查询,显著提升客户服务效率和响应速度。基于Python的实现方案因其丰富的生态系统(如NLTK、spaCy、Transformers等库)、跨平台兼容性以及易于集成的特点,成为开发智能客服系统的首选。系统架构系统核心包括两个主要功能模块:1.API集成模块负责连接各类外部服务,

- 计算机视觉产品推荐,个性化推荐:人工智能中的计算机视觉、NLP自然语言处理和个性化推荐系统哪个前景更好一些?...

这个问题直接回答的话可能还是有着很强的个人观点,所以不如先向你介绍一些这几个领域目前的研究现状和应用情况(不再具体介绍其中原理)你自己可以斟酌一下哪方面更适合自己个性化推荐。一.所谓计算机视觉,是指使用计算机及相关设备对生物视觉的一种模拟个性化推荐。它的主要任务就是通过对采集的图片或视频进行处理以获得相应场景的三维信息,就像人类和许多其他类生物每天所做的那样[1]。现在人工智能的计算机视觉主要研究

- 机器学习专栏(62):手把手实现工业级ResNet-34及调优全攻略

目录一、ResNet革命性突破解析1.1残差学习核心思想1.2ResNet-34结构详解二、工业级Keras实现详解2.1数据预处理流水线2.2完整模型实现三、模型训练调优策略3.1学习率动态调整3.2混合精度训练四、性能优化技巧4.1分布式训练配置4.2TensorRT推理加速五、实战应用案例5.1医疗影像分类5.2工业质检系统六、模型可视化分析6.1特征热力图6.2参数量分析七、常见问题解决方

- AI如何塑造下一代网络安全防御体系

weishi122

web安全人工智能网络人工智能网络安全威胁检测行为分析漏洞挖掘

AI如何塑造下一代网络安全防御体系随着网络威胁日益复杂化,传统安全措施已难以应对。人工智能(AI)正通过创新解决方案重塑网络安全格局。本文将探讨AI如何推动网络安全革命,并分析实施过程中的关键挑战。日益严峻的威胁形势到2025年,网络犯罪预计将造成全球10.5万亿美元损失。传统防御手段已无法应对快速演变的威胁,这正是AI发挥关键作用的领域。人工智能:新一代数字卫士AI能实时分析海量数据,在威胁发生

- 模式识别与机器学习课程笔记(1):数学基础

Ro Jace

学习笔记机器学习笔记人工智能

模式识别与机器学习课程笔记(1):数学基础特征矢量和特征空间随机矢量的描述随机矢量的分布函数随机矢量的数字特征随机变量、随机矢量间的统计关系随机矢量的变换正态分布正态分布的定义正态分布随机矢量的性质离散随机矢量及其分布信息论矩阵微分法基本知识矢量或矩阵对于数量变量的微分二、数量函数对于矢量的微分三、矢量函数对于矢量的微分特征矢量和特征空间特征量的类型:物理量、次序量、名义量物理量:直接反映特征的实

- 深度学习方法生成抓取位姿与6D姿态估计的完整实现

ZPC8210

ROS深度学习人工智能

如何将GraspNet等深度学习模型与6D姿态估计集成到ROS2和MoveIt中,实现高精度的机器人抓取系统。1.系统架构text[RGB-D传感器]→[物体检测与6D姿态估计]→[GraspNet抓取位姿生成]→[MoveIt运动规划]→[执行抓取]2.环境配置2.1安装依赖bash#安装PyTorch(根据CUDA版本选择)pip3installtorchtorchvisiontorchaud

- 基于深度学习的目标检测:从基础到实践

Blossom.118

机器学习与人工智能深度学习目标检测人工智能音视频语音识别计算机视觉机器学习

前言目标检测(ObjectDetection)是计算机视觉领域中的一个核心任务,其目标是在图像中定位和识别多个对象的类别和位置。近年来,深度学习技术,尤其是卷积神经网络(CNN),在目标检测任务中取得了显著进展。本文将详细介绍如何使用深度学习技术构建目标检测模型,从理论基础到代码实现,带你一步步掌握目标检测的完整流程。一、目标检测的基本概念(一)目标检测的定义目标检测是指在图像中识别和定位多个对象

- 6+,基于免疫原性细胞死亡的非肿瘤分型文章,投稿到接收仅一个多月,肿瘤的热点已经传导至非肿瘤生信文章中!

生信小课堂

影响因子:6.147本文从投稿到接收仅一个多月关于非肿瘤生信,我们也解读过很多,主要有以下类型1单个疾病WGCNA+PPI分析筛选hub基因。2单个疾病结合免疫浸润,热点基因集,机器学习,分子分型等。3两种相关疾病联合分析,包括非肿瘤结合非肿瘤,非肿瘤结合肿瘤或者非肿瘤结合泛癌分析目前非肿瘤生信发文的门槛较低,有需要的朋友欢迎交流!研究概述:脑卒中是世界上死亡和残疾的主要原因之一,缺血性中风占80

- 【国内超大型智能算力中心建设白皮书 2024】

AI大模型 lose and dream

人工智能开源git开源软件githubgitlab开放原子

文末有福利!智算中心建设通过领先的体系架构设计,以算力基建化为主体、以算法基建化为引领、以服务智件化为依托,以设施绿色化为支撑,从基建、硬件、软件、算法、服务等全环节开展关键技术落地与应用。一、体系架构(一)总体架构图8智算中心总体架构智能算力中心建设白皮书,重点围绕基础、支撑、功能和目标四大部分,创新性地提出了智算中心总体架构。其中,基础部分是支撑智算中心建设与应用的先进人工智能理论和计算架构;

- 高并发解决方案:SpringBoot+Redis分布式缓存实战

fanxbl957

Web缓存springbootredis

博主介绍:Java、Python、js全栈开发“多面手”,精通多种编程语言和技术,痴迷于人工智能领域。秉持着对技术的热爱与执着,持续探索创新,愿在此分享交流和学习,与大家共进步。DeepSeek-行业融合之万象视界(附实战案例详解100+)全栈开发环境搭建运行攻略:多语言一站式指南(环境搭建+运行+调试+发布+保姆级详解)感兴趣的可以先收藏起来,希望帮助更多的人高并发解决方案:SpringBoot

- SpringBoot缓存技术全解析:Redis+Caffeine二级缓存架构

fanxbl957

Web缓存springbootredis

博主介绍:Java、Python、js全栈开发“多面手”,精通多种编程语言和技术,痴迷于人工智能领域。秉持着对技术的热爱与执着,持续探索创新,愿在此分享交流和学习,与大家共进步。DeepSeek-行业融合之万象视界(附实战案例详解100+)全栈开发环境搭建运行攻略:多语言一站式指南(环境搭建+运行+调试+发布+保姆级详解)感兴趣的可以先收藏起来,希望帮助更多的人SpringBoot缓存技术全解析:

- 米信使股票群诈骗真相!郑洪盛国浩盟国一带一路项目就是资金盘不要被骗了!

不成功不收费

讲述:郑洪盛国浩盟国慈善投票被骗无法出金真相!套路太深教你该如何避!!骗子引诱人上当方式很简单:先给你一点甜头尝尝,一开始入金能正常提现,也能赚一点,但当投入更多钱时,你发现你的运气开始变差了。所以,荐股类骗局最大的迷惑性是:给受害人一种假象,你是投资亏损的,而不是被骗的!广大市民对此要提高警惕,如果是还没有投资,千万不要抱有侥幸心理,一定要及时远离!一定不要打草惊蛇低碳项目数字体育,人工智能ai

- 实现大语言模型与应用的无缝对接

meslog

技术分享语言模型microsoft人工智能

在当今人工智能快速发展的时代,大语言模型(LLMs)已经成为众多应用的核心驱动力。然而,如何让这些强大的模型与各种数据源和工具进行有效集成,仍然是一个挑战。ModelContextProtocol(MCP)正是为解决这一问题而设计的开放协议,它标准化了应用程序如何向大语言模型提供上下文信息。本文将介绍MCP的基本概念,并通过C#SDK展示如何实现客户端和服务器端的交互。什么是MCP?ModelCo

- VSCode使用Jupyter完整指南配置机器学习环境

z日火

校招学习日记vscodejupyter机器学习

接下来开始机器学习部分第一步配置环境:VSCode使用Jupyter完整指南1.安装必要的扩展打开VSCode,按Ctrl+Shift+X打开扩展市场,搜索并安装以下扩展:必装扩展:Python(Microsoft官方)-Python语言支持Jupyter(Microsoft官方)-Jupyternotebook支持Pylance(Microsoft官方)-Python智能提示和语法检查推荐扩展:

- 养老院管理系统基于SpringBoot的养老院管理系统系统设计与实现(源码+论文+部署讲解等)

博主介绍:✌全网粉丝60W+,csdn特邀作者、Java领域优质创作者、csdn/掘金/哔哩哔哩/知乎/道客/小红书等平台优质作者,计算机毕设实战导师,目前专注于大学生项目实战开发,讲解,毕业答疑辅导,欢迎高校老师/同行前辈交流合作✌技术栈范围:SpringBoot、Vue、SSM、Jsp、HLMT、Nodejs、Python、爬虫、数据可视化、小程序、安卓app、大数据、物联网、机器学习、单片机

- 解决引入TransXNet模块后显存爆炸问题的全面指南

pk_xz123456

算法大数据python机器人数据挖掘深度学习

解决引入TransXNet模块后显存爆炸问题的全面指南前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站。1.问题背景与现状分析1.1MF-PSN和TransXNet项目概述MF-PSN(Multi-FeaturePyramidStereoNetwork)是一个基于金字塔特征的多特征立体匹配网络,它通过构建多层次的特征金字塔来处理不同尺度的立体匹配问题

- AI产品经理成长记《零号列车》第一集 邂逅0XAI列车

黑客思维者

AI产品经理养成人工智能AI产品经理大模型智能体

《零号列车》绝非传统意义上的AI产品经理教程——它是我沉淀二十多年跨行业数字化转型与工业4.0实战经验后,首创的100集大型小说体培养指南。那些曾在千行百业验证过的知识与经验,不再是枯燥的文字堆砌,而是化作一场沉浸式的学习旅程。这里没有生硬的理论灌输,而是用跌宕起伏的故事情节,串联起AI技术的底层逻辑。你会跟着角色的脚步推进剧情,在不知不觉中吃透机器学习、大模型应用等专业概念;更有深入浅出的技术拆

- 312个免费高速HTTP代理IP(能隐藏自己真实IP地址)

yangshangchuan

高速免费superwordHTTP代理

124.88.67.20:843

190.36.223.93:8080

117.147.221.38:8123

122.228.92.103:3128

183.247.211.159:8123

124.88.67.35:81

112.18.51.167:8123

218.28.96.39:3128

49.94.160.198:3128

183.20

- pull解析和json编码

百合不是茶

androidpull解析json

n.json文件:

[{name:java,lan:c++,age:17},{name:android,lan:java,age:8}]

pull.xml文件

<?xml version="1.0" encoding="utf-8"?>

<stu>

<name>java

- [能源与矿产]石油与地球生态系统

comsci

能源

按照苏联的科学界的说法,石油并非是远古的生物残骸的演变产物,而是一种可以由某些特殊地质结构和物理条件生产出来的东西,也就是说,石油是可以自增长的....

那么我们做一个猜想: 石油好像是地球的体液,我们地球具有自动产生石油的某种机制,只要我们不过量开采石油,并保护好

- 类与对象浅谈

沐刃青蛟

java基础

类,字面理解,便是同一种事物的总称,比如人类,是对世界上所有人的一个总称。而对象,便是类的具体化,实例化,是一个具体事物,比如张飞这个人,就是人类的一个对象。但要注意的是:张飞这个人是对象,而不是张飞,张飞只是他这个人的名字,是他的属性而已。而一个类中包含了属性和方法这两兄弟,他们分别用来描述对象的行为和性质(感觉应该是

- 新站开始被收录后,我们应该做什么?

IT独行者

PHPseo

新站开始被收录后,我们应该做什么?

百度终于开始收录自己的网站了,作为站长,你是不是觉得那一刻很有成就感呢,同时,你是不是又很茫然,不知道下一步该做什么了?至少我当初就是这样,在这里和大家一份分享一下新站收录后,我们要做哪些工作。

至于如何让百度快速收录自己的网站,可以参考我之前的帖子《新站让百

- oracle 连接碰到的问题

文强chu

oracle

Unable to find a java Virtual Machine--安装64位版Oracle11gR2后无法启动SQLDeveloper的解决方案

作者:草根IT网 来源:未知 人气:813标签:

导读:安装64位版Oracle11gR2后发现启动SQLDeveloper时弹出配置java.exe的路径,找到Oracle自带java.exe后产生的路径“C:\app\用户名\prod

- Swing中按ctrl键同时移动鼠标拖动组件(类中多借口共享同一数据)

小桔子

java继承swing接口监听

都知道java中类只能单继承,但可以实现多个接口,但我发现实现多个接口之后,多个接口却不能共享同一个数据,应用开发中想实现:当用户按着ctrl键时,可以用鼠标点击拖动组件,比如说文本框。

编写一个监听实现KeyListener,NouseListener,MouseMotionListener三个接口,重写方法。定义一个全局变量boolea

- linux常用的命令

aichenglong

linux常用命令

1 startx切换到图形化界面

2 man命令:查看帮助信息

man 需要查看的命令,man命令提供了大量的帮助信息,一般可以分成4个部分

name:对命令的简单说明

synopsis:命令的使用格式说明

description:命令的详细说明信息

options:命令的各项说明

3 date:显示时间

语法:date [OPTION]... [+FORMAT]

- eclipse内存优化

AILIKES

javaeclipsejvmjdk

一 基本说明 在JVM中,总体上分2块内存区,默认空余堆内存小于 40%时,JVM就会增大堆直到-Xmx的最大限制;空余堆内存大于70%时,JVM会减少堆直到-Xms的最小限制。 1)堆内存(Heap memory):堆是运行时数据区域,所有类实例和数组的内存均从此处分配,是Java代码可及的内存,是留给开发人

- 关键字的使用探讨

百合不是茶

关键字

//关键字的使用探讨/*访问关键词private 只能在本类中访问public 只能在本工程中访问protected 只能在包中和子类中访问默认的 只能在包中访问*//*final 类 方法 变量 final 类 不能被继承 final 方法 不能被子类覆盖,但可以继承 final 变量 只能有一次赋值,赋值后不能改变 final 不能用来修饰构造方法*///this()

- JS中定义对象的几种方式

bijian1013

js

1. 基于已有对象扩充其对象和方法(只适合于临时的生成一个对象):

<html>

<head>

<title>基于已有对象扩充其对象和方法(只适合于临时的生成一个对象)</title>

</head>

<script>

var obj = new Object();

- 表驱动法实例

bijian1013

java表驱动法TDD

获得月的天数是典型的直接访问驱动表方式的实例,下面我们来展示一下:

MonthDaysTest.java

package com.study.test;

import org.junit.Assert;

import org.junit.Test;

import com.study.MonthDays;

public class MonthDaysTest {

@T

- LInux启停重启常用服务器的脚本

bit1129

linux

启动,停止和重启常用服务器的Bash脚本,对于每个服务器,需要根据实际的安装路径做相应的修改

#! /bin/bash

Servers=(Apache2, Nginx, Resin, Tomcat, Couchbase, SVN, ActiveMQ, Mongo);

Ops=(Start, Stop, Restart);

currentDir=$(pwd);

echo

- 【HBase六】REST操作HBase

bit1129

hbase

HBase提供了REST风格的服务方便查看HBase集群的信息,以及执行增删改查操作

1. 启动和停止HBase REST 服务 1.1 启动REST服务

前台启动(默认端口号8080)

[hadoop@hadoop bin]$ ./hbase rest start

后台启动

hbase-daemon.sh start rest

启动时指定

- 大话zabbix 3.0设计假设

ronin47

What’s new in Zabbix 2.0?

去年开始使用Zabbix的时候,是1.8.X的版本,今年Zabbix已经跨入了2.0的时代。看了2.0的release notes,和performance相关的有下面几个:

:: Performance improvements::Trigger related da

- http错误码大全

byalias

http协议javaweb

响应码由三位十进制数字组成,它们出现在由HTTP服务器发送的响应的第一行。

响应码分五种类型,由它们的第一位数字表示:

1)1xx:信息,请求收到,继续处理

2)2xx:成功,行为被成功地接受、理解和采纳

3)3xx:重定向,为了完成请求,必须进一步执行的动作

4)4xx:客户端错误,请求包含语法错误或者请求无法实现

5)5xx:服务器错误,服务器不能实现一种明显无效的请求

- J2EE设计模式-Intercepting Filter

bylijinnan

java设计模式数据结构

Intercepting Filter类似于职责链模式

有两种实现

其中一种是Filter之间没有联系,全部Filter都存放在FilterChain中,由FilterChain来有序或无序地把把所有Filter调用一遍。没有用到链表这种数据结构。示例如下:

package com.ljn.filter.custom;

import java.util.ArrayList;

- 修改jboss端口

chicony

jboss

修改jboss端口

%JBOSS_HOME%\server\{服务实例名}\conf\bindingservice.beans\META-INF\bindings-jboss-beans.xml

中找到

<!-- The ports-default bindings are obtained by taking the base bindin

- c++ 用类模版实现数组类

CrazyMizzz

C++

最近c++学到数组类,写了代码将他实现,基本具有vector类的功能

#include<iostream>

#include<string>

#include<cassert>

using namespace std;

template<class T>

class Array

{

public:

//构造函数

- hadoop dfs.datanode.du.reserved 预留空间配置方法

daizj

hadoop预留空间

对于datanode配置预留空间的方法 为:在hdfs-site.xml添加如下配置

<property>

<name>dfs.datanode.du.reserved</name>

<value>10737418240</value>

- mysql远程访问的设置

dcj3sjt126com

mysql防火墙

第一步: 激活网络设置 你需要编辑mysql配置文件my.cnf. 通常状况,my.cnf放置于在以下目录: /etc/mysql/my.cnf (Debian linux) /etc/my.cnf (Red Hat Linux/Fedora Linux) /var/db/mysql/my.cnf (FreeBSD) 然后用vi编辑my.cnf,修改内容从以下行: [mysqld] 你所需要: 1

- ios 使用特定的popToViewController返回到相应的Controller

dcj3sjt126com

controller

1、取navigationCtroller中的Controllers

NSArray * ctrlArray = self.navigationController.viewControllers;

2、取出后,执行,

[self.navigationController popToViewController:[ctrlArray objectAtIndex:0] animated:YES

- Linux正则表达式和通配符的区别

eksliang

正则表达式通配符和正则表达式的区别通配符

转载请出自出处:http://eksliang.iteye.com/blog/1976579

首先得明白二者是截然不同的

通配符只能用在shell命令中,用来处理字符串的的匹配。

判断一个命令是否为bash shell(linux 默认的shell)的内置命令

type -t commad

返回结果含义

file 表示为外部命令

alias 表示该

- Ubuntu Mysql Install and CONF

gengzg

Install

http://www.navicat.com.cn/download/navicat-for-mysql

Step1: 下载Navicat ,网址:http://www.navicat.com/en/download/download.html

Step2:进入下载目录,解压压缩包:tar -zxvf navicat11_mysql_en.tar.gz

- 批处理,删除文件bat

huqiji

windowsdos

@echo off

::演示:删除指定路径下指定天数之前(以文件名中包含的日期字符串为准)的文件。

::如果演示结果无误,把del前面的echo去掉,即可实现真正删除。

::本例假设文件名中包含的日期字符串(比如:bak-2009-12-25.log)

rem 指定待删除文件的存放路径

set SrcDir=C:/Test/BatHome

rem 指定天数

set DaysAgo=1

- 跨浏览器兼容的HTML5视频音频播放器

天梯梦

html5

HTML5的video和audio标签是用来在网页中加入视频和音频的标签,在支持html5的浏览器中不需要预先加载Adobe Flash浏览器插件就能轻松快速的播放视频和音频文件。而html5media.js可以在不支持html5的浏览器上使video和audio标签生效。 How to enable <video> and <audio> tags in

- Bundle自定义数据传递

hm4123660

androidSerializable自定义数据传递BundleParcelable

我们都知道Bundle可能过put****()方法添加各种基本类型的数据,Intent也可以通过putExtras(Bundle)将数据添加进去,然后通过startActivity()跳到下一下Activity的时候就把数据也传到下一个Activity了。如传递一个字符串到下一个Activity

把数据放到Intent

- C#:异步编程和线程的使用(.NET 4.5 )

powertoolsteam

.net线程C#异步编程

异步编程和线程处理是并发或并行编程非常重要的功能特征。为了实现异步编程,可使用线程也可以不用。将异步与线程同时讲,将有助于我们更好的理解它们的特征。

本文中涉及关键知识点

1. 异步编程

2. 线程的使用

3. 基于任务的异步模式

4. 并行编程

5. 总结

异步编程

什么是异步操作?异步操作是指某些操作能够独立运行,不依赖主流程或主其他处理流程。通常情况下,C#程序

- spark 查看 job history 日志

Stark_Summer

日志sparkhistoryjob

SPARK_HOME/conf 下:

spark-defaults.conf 增加如下内容

spark.eventLog.enabled true spark.eventLog.dir hdfs://master:8020/var/log/spark spark.eventLog.compress true

spark-env.sh 增加如下内容

export SP

- SSH框架搭建

wangxiukai2015eye

springHibernatestruts

MyEclipse搭建SSH框架 Struts Spring Hibernate

1、new一个web project。

2、右键项目,为项目添加Struts支持。

选择Struts2 Core Libraries -<MyEclipes-Library>

点击Finish。src目录下多了struts