张量分解--CP、Tucker分解

目录

符号和准备工作

张量

实例

Fiber

Slice

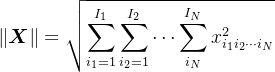

norm

张量内积

(超)对称与(超)对角

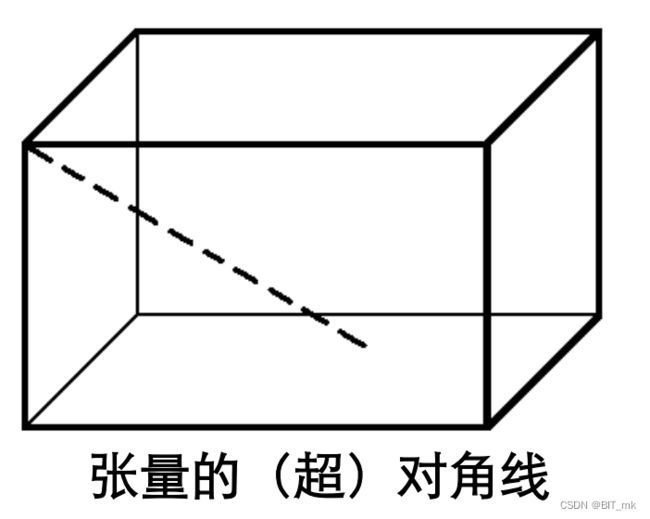

秩一张量

对角张量

张量的矩阵化与向量化

Kolda水平展开

具体例子

mode-n product

矩阵的Kronecker乘积-(张量积)

矩阵的Khatri-Rao乘积

矩阵的Hadamard乘积

CP分解

张量CP分解的定义

向量的内积与外积

CP秩

张量CP分解的理解

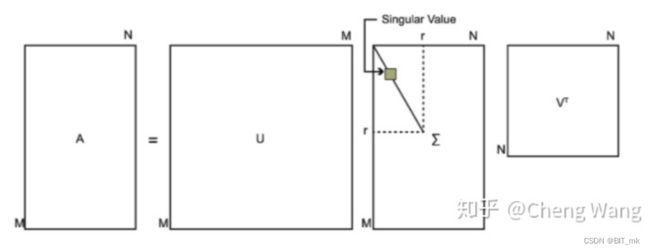

Tucker分解

线性变化改变向量维度例子

这两种张量分解算法可以被看做是张量奇异值分解的高阶扩展:CP分解将张量分解为秩一张量之和,Tucker分解是主成成分分析(PCA)的高阶形式。

符号和准备工作

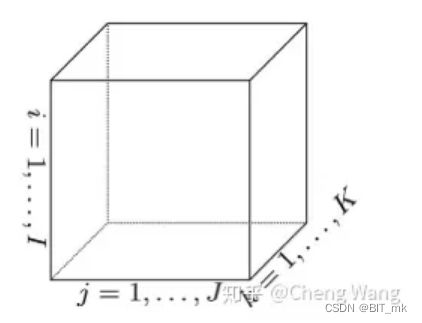

张量

张量可以理解为高阶矩阵。

实例

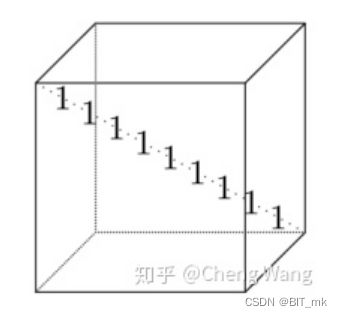

在网络测量领域,如果我们想要测量 n 个网络设备之间的延迟,那么,很自然地,在具体的某一时刻,我们会将这 n 个网络设备两两之间通信的延迟表示为一个 n×n 矩阵。接下来,如果我们收集了许多不同时刻的数据,比方说 n3 个时刻,我们将这些数据排列起来,这样就构成了一个 n×n×n3 张量,如下图所示

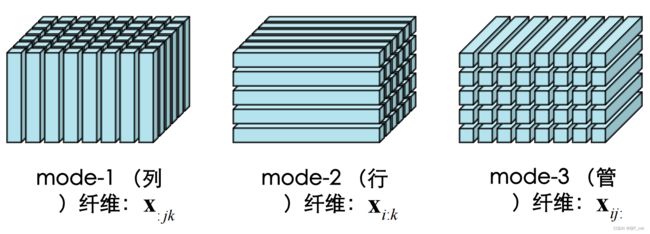

Fiber

Fiber在张量分解中指的是张量的一维切片。在三维张量中,Fiber可以是沿着某一特定方向的线段,类似于矩阵的行或列。它是张量结构的一个重要组成部分。

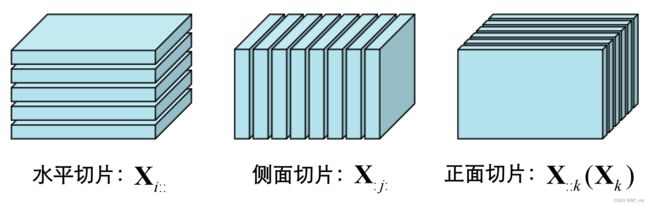

Slice

在张量分解中,"slice"指的是张量的二维切片。对于三维张量,一个slice可以看作是沿着特定方向的一个平面切片,就像三维立方体的一面。每个slice都是一个矩阵,张量可以看作是这些矩阵的堆叠。

正面切片也就对应这上文提到的网络延迟的样子。

我们可以对比一下Fiber以及切片的符号表示,可以看出来,Fiber是固定三阶张量的两个维度,切片是固定三阶张量的一个维度。如果扩展到更 n 阶的张量,那么Fiber是固定张量的 n−1 个维度,切片是固定张量的 n−2 个维度

norm

norm"是一个数学术语,用于衡量向量或矩阵的大小。对于向量,norm通常表示向量的长度,对于矩阵,norm可以表示矩阵的某种“大小”或“长度”。

常见的norm包括:

- L1范数:向量元素的绝对值之和。

- L2范数:向量元素的平方和的平方根,也称为欧几里得范数。

- 无穷范数:向量元素的最大绝对值。

- Frobenius范数:矩阵元素的平方和的平方根。

假设现在有张量 ![]() ,张量的范数定义为张量的各个元素

,张量的范数定义为张量的各个元素![]() 的平方和开根号,用公式表示如下:

的平方和开根号,用公式表示如下:

张量内积

向量的内积就是两个向量对应元素乘积之和,结果是个标量,两个向量外积结果是一个矩阵,三个向量外积是一个三阶张量。

此处张量内积的定义和向量内积是类似的,即张量对应元素乘积之和:

![]()

(超)对称与(超)对角

- 立方张量:各个mode的长度相等

秩一张量的定义是:如果一个张量可以被表示为一组向量的外积,那么这个张量就被称为秩一张量。具体来说,如果张量 ![]() 可以被写成

可以被写成 ![]() 个向量的外积,即

个向量的外积,即![]() ,那么我们就说张量

,那么我们就说张量![]() 是秩一的。这里的

是秩一的。这里的 ![]() 表示外积运算。

表示外积运算。

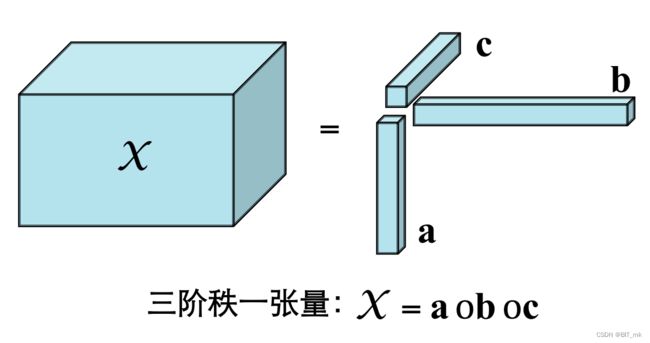

回顾一下SVD分解

一个矩阵可以分解为左右奇异向量矩阵以及一个奇异值矩阵的乘积形式。我们现在不妨以另外一种角度来看待矩阵的SVD分解:

我们如果拿出第一个左奇异向量以及第一个右奇异向量,这两个向量做外积,我们就可以得到一个矩阵,同时这两个奇异向量对应同一个奇异值,我们尝试将奇异值理解为这两个向量外积得到的这个矩阵的在原始矩阵中所占的权重,以此类推我们就可以得到所有奇异值对应的左右奇异向量外积的结果矩阵,然后将这些矩阵加起来就得到了原始矩阵。

矩阵SVD分解就是将矩阵分解为许多因子矩阵之和

1.奇异值分解(SVD): 给定一个矩阵![]() ,SVD分解将其分解为三个部分:左奇异向量(U)、奇异值对角矩阵(Σ)和右奇异向量的转置

,SVD分解将其分解为三个部分:左奇异向量(U)、奇异值对角矩阵(Σ)和右奇异向量的转置![]() 。数学上表示为:

。数学上表示为:

![]()

2. 左右奇异向量的外积: 左奇异向量和右奇异向量可以看作矩阵空间的一组基。外积所得的矩阵可以看作这些基的线性组合。

3. 带有权重的因子矩阵: 奇异值对角矩阵Σ包含了矩阵的奇异值,这些值可以看作权重。将权重与左右奇异向量的外积相乘,得到的就是所谓的因子矩阵。

4. 因子矩阵之和: 将所有的因子矩阵相加,就可以重构原始矩阵。这就是说,原始矩阵可以看作许多因子矩阵之和。

矩阵做SVD分解以后,奇异值矩阵中第一个奇异值为1,剩下的奇异值都为0。因此,奇异值为1对应的左右奇异向量的外积所得到的矩阵就是原始矩阵。

对角张量

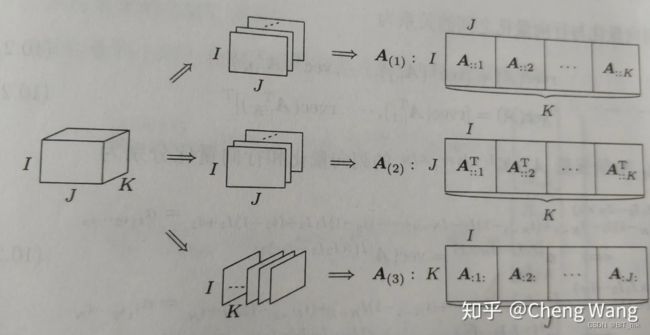

张量的矩阵化与向量化

在张量的分析与计算中,经常希望用一个矩阵代表一个三阶张量。此时,就需要有一种运算,能够将一个三阶张量(三路阵列)经过重新组织或者排列,变成一个矩阵(二路阵列)。将一个三路或N路阵列重新组织成一个矩阵形式的变换称为张量的矩阵化。张量的矩阵化有时也称张量的展开或张量的扁平化。

将N阶张量![]() 沿mode-n展开成一个矩阵

沿mode-n展开成一个矩阵 ![]()

除了高阶张量的唯一矩阵表示外,一个高阶张量的唯一向量表示也是很多场合感兴趣的。高阶向量的向量化是一种将张量排列成唯一一个向量的变换。

在张量的矩阵化过程中,首先可以分为水平展开与纵向展开,然后可以进一步细分为Kiers展开、LMV展开、Kolda展开。在此,我们仅介绍Kolda水平展开。

Kolda水平展开

Kolda于2006年提出该方法,将 ![]() 阶张量元素

阶张量元素![]() 映射为模式-n矩阵

映射为模式-n矩阵 ![]() 的元素

的元素 ![]() ,其中

,其中

具体例子

![]() 、

、 ![]() 代表张量

代表张量 ![]() 的两个正面切片矩阵。该张量的模式-n展开如下所示:

的两个正面切片矩阵。该张量的模式-n展开如下所示:

对于该张量的向量化形式,因为很好理解,因此直接给出该例的向量化结果:

mode-n product

mode-n product(模式n乘积)是张量与矩阵之间的一种特殊乘积操作。给定一个张量![]() 和一个矩阵

和一个矩阵 ![]() ,mode-n product表示在张量的第n个模式(或维度)上与矩阵相乘。

,mode-n product表示在张量的第n个模式(或维度)上与矩阵相乘。

数学上,mode-n product可以表示为:

![]()

其中![]() 是新的张量,

是新的张量,![]() 是原始张量,

是原始张量,![]() 是与张量的第n个模式相乘的矩阵。

是与张量的第n个模式相乘的矩阵。

这个定义可以写成沿mode-n展开的形式

![]()

性质:

一个张量 ![]() 和一个向量

和一个向量 ![]() 的

的 ![]() 乘积

乘积

![]() ,

,

其元素定义为 ![]()

性质:

假设有一个三维张量,可以想象成一个立方体,由许多小立方体组成。每个方向(长度、宽度、高度)都是一个模式。

现在,你想在其中一个方向(例如高度)上与一个矩阵相乘。你可以将立方体切成许多层(每一层都是一个矩阵),然后用给定的矩阵与每一层相乘。

- 如果你在第一个模式(长度方向)上乘以矩阵,就像将每一行压缩或拉伸。

- 如果在第二个模式(宽度方向)上乘以矩阵,就像将每一列压缩或拉伸。

- 如果在第三个模式(高度方向)上乘以矩阵,就像将每一层压缩或拉伸。

这个操作改变了张量的形状,并且可以用于提取信息、降维或其他数学任务。

考虑三阶张量与矩阵的乘积,由于该方法是Tucker定义的,现在常称为Tucker积。

三阶张量的Tucker积: 考虑三阶张量 ![]() 和矩阵

和矩阵 ![]() ,

,![]() ,

, ![]() 的乘积。三阶张量的Tucker模式-1积

的乘积。三阶张量的Tucker模式-1积 ![]() ,模式-2积

,模式-2积 ![]() ,模式-3积

,模式-3积 ![]() 分别定义为:

分别定义为:

我们先将 ![]() 进行模式-1展开,所得矩阵的维度为

进行模式-1展开,所得矩阵的维度为 ![]() 。

。

我们将张量展开成了一个矩阵,那么模式-n乘积也就变成了两个矩阵相乘,这个大家肯定都不陌生。这两个矩阵的维度分别是 ![]() 以及

以及 ![]() ,因此,很明显的一点是,如果按照原来的顺序,这两个矩阵是无法直接相乘的,因此我们需要把

,因此,很明显的一点是,如果按照原来的顺序,这两个矩阵是无法直接相乘的,因此我们需要把 ![]() 放到张量展开矩阵的左边。所得结果是一个

放到张量展开矩阵的左边。所得结果是一个 ![]() 的矩阵,注意,此处我们还需要将这个矩阵还原成张量,所以最终的结果是一个

的矩阵,注意,此处我们还需要将这个矩阵还原成张量,所以最终的结果是一个 ![]() 的张量。

的张量。

矩阵的Kronecker乘积-(张量积)

![]() , 则

, 则

矩阵的Khatri-Rao乘积

![]() , 则

, 则

性质: ![]()

矩阵的Hadamard乘积

![]() 则

则

性质:

CP分解

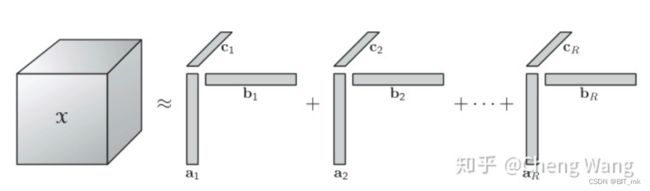

CP分解是将张量分解为一系列的秩一张量之和。

张量CP分解的定义

对于一个 ![]() ,其CP分解公式如下:

,其CP分解公式如下:

![]()

注意 ![]() 的维度分别是

的维度分别是 ![]() ,

,![]() 就是我们所说的 CP秩。更直观的理解看下图:

就是我们所说的 CP秩。更直观的理解看下图:

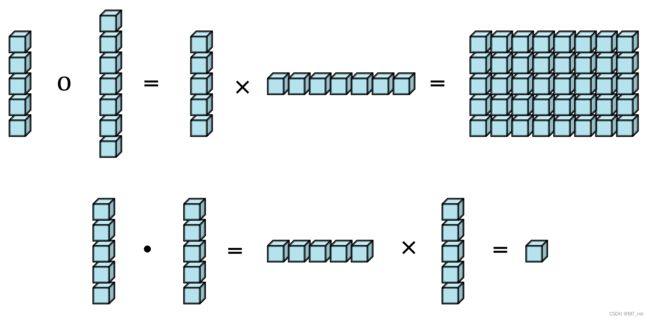

向量的内积与外积

若向量 ![]() ,则两个向量的外积

,则两个向量的外积![]()

生成一个矩阵。其中符号 “。”表示外积运算。因此两个向量的外积运算从一维向量变为二维矩 阵,增加了一个维度

举例说明,若

![]() ,

,

![]()

则

![]()

若向量 ![]() ,则三个向量的外积

,则三个向量的外积

![]()

是一个三阶张量。这里的 “![]() ” 运算为

” 运算为 ![]() 中第一个元素与矩阵

中第一个元素与矩阵![]() 相乘生成张量的第一 个frontal slice,其中最后一个元素与矩阵

相乘生成张量的第一 个frontal slice,其中最后一个元素与矩阵![]() 相乘生成张量的最后一个frontal slice。三个向量的外积的 3 维的张量,因此每做一次外积运算维度都增加1。

相乘生成张量的最后一个frontal slice。三个向量的外积的 3 维的张量,因此每做一次外积运算维度都增加1。

CP秩

对于一个给定的张量,其CP秩是能够精确表示该张量的最小秩一张量的数量。

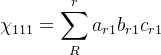

张量CP分解的理解

![]() 元素就是张量左上角的元素,我们知道,这个元素一定是各个因子张量左上角的元素之和组 成的。我们不妨来考虑一下上图的第一个因子张量。

元素就是张量左上角的元素,我们知道,这个元素一定是各个因子张量左上角的元素之和组 成的。我们不妨来考虑一下上图的第一个因子张量。

在此之前,我们先定义一些新的符号,在上图中 ![]() 代表三个向量,现在定义

代表三个向量,现在定义![]() 代表这三个向量中不同位置的标量值。为了书写方便,我们将第一个下标1去掉,现 在就变成了

代表这三个向量中不同位置的标量值。为了书写方便,我们将第一个下标1去掉,现 在就变成了 ![]() 。假设

。假设 ![]() ,那么

,那么 ![]() 如下图所示:

如下图所示:

![]() 为一个张量

为一个张量

设张量的第一个正面切片为:

张量的第二个正面切片为:

张量的第三个正面切片为:

也就是说,第一个因子张量的左上角位置元素为 ![]() ,第二个因子张量左上角位置元素为

,第二个因子张量左上角位置元素为 ![]() ,以此类推,我们就可以知道

,以此类推,我们就可以知道  ,张量

,张量 ![]() 其他位置的元素也可 以用同样的方法推导。

其他位置的元素也可 以用同样的方法推导。

![]()

我们将CP分解中最小的单元看作了不同的向量,向量的外积组成了不同的张量,因子张量之和就是原始张量。

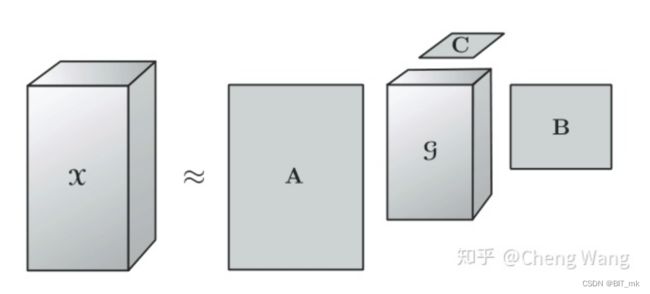

Tucker分解

通常我们认为,CP分解是张量Tucker分解的一种特殊情况。

通俗来讲,PCA的目的就是用 k 个主分量概括表达统计相关的 n 个特征,因此PCA算法是一种降维方法。那么,我们之前说Tucker分解是PCA的高阶形式,我们应该也可以尝试用这种降维的思想去理解Tucker分解。

首先,我们需要确立一种思维,我们知道一个矩阵可以理解为一种线性变换,那么对于 ![]() , 我们可以理解为在矩阵

, 我们可以理解为在矩阵![]() 上施加一种线性变换,如果同时考虑矩阵维数变化的话,

上施加一种线性变换,如果同时考虑矩阵维数变化的话, ![]() ,那么

,那么 ![]() ,我们尝试这样去理解:

,我们尝试这样去理解: ![]() 相当 于沿着矩阵的第二个维度施加了线性变化,使得第二个维度由

相当 于沿着矩阵的第二个维度施加了线性变化,使得第二个维度由 ![]() 变成了

变成了![]() 。

。

线性变化改变向量维度例子

线性变换 ![]() 可以将一个

可以将一个 ![]() -维向量空间

-维向量空间![]() 映射到一个

映射到一个 ![]() -维向量空间

-维向量空间![]() 。

。

这种类型的线性变换通常用![]() 矩阵

矩阵 ![]() 来表示。给定一个

来表示。给定一个![]() -维向量

-维向量 ![]() ,应用线性变换后,我们得到一个

,应用线性变换后,我们得到一个 ![]() -维向量

-维向量 ![]() ,即:

,即:

![]()

例如,考虑以下 ![]() 矩阵

矩阵 ![]() :

:

这个矩阵可以将一个 2-维向量 ![]() 映射到一个 3-维向量

映射到一个 3-维向量![]() ,即:

,即:

这样,我们就通过线性变换将一个 2-维向量映射到了一个 3-维向量。

我们现在来考虑![]() ,其中张量

,其中张量 ![]() ,矩阵

,矩阵 ![]() ,我们知道这个模式- 1 积的结果是一个

,我们知道这个模式- 1 积的结果是一个 ![]() 的张量,那么我们不妨认为 模式-1积是沿着张量

的张量,那么我们不妨认为 模式-1积是沿着张量 ![]() 的第一个维度施加了线性变换,使得第一个维度从

的第一个维度施加了线性变换,使得第一个维度从 ![]() 变化到了

变化到了 ![]() 。如果

。如果 ![]() 的话,就相当于沿着张量的第一维度进行了一种降维操作。

的话,就相当于沿着张量的第一维度进行了一种降维操作。

现在,我们给出Tucker分解的定义,对于张量 ![]() ,其Tucker分解形式如下:

,其Tucker分解形式如下:

其中, ![]() 是Tucker分解得到的因子矩阵,

是Tucker分解得到的因子矩阵,

![]()

代表核心张量,它的元素代表不同因子矩阵之间相互作用的水平。Tucker分解示意图如下:

参考链接

http://深入理解 | CP、Tucker分解 - 达布牛学习笔记的文章 - 知乎 https://zhuanlan.zhihu.com/p/302453223

githup项目

![$\operatorname{vec}(\boldsymbol{X})=\left[\begin{array}{c}1 \\ 2 \\ \vdots \\ 24\end{array}\right]$](http://img.e-com-net.com/image/info8/90e62f2977cb4e69adec986f343bcd2f.png)