Hive3第一章:环境安装

系列文章目录

Hive3第一章:环境准备

文章目录

- 系列文章目录

- 前言

- 一、hive3安装

-

- 1.上传文件

- 2.配置环境变量

- 3.修复日志错误(可忽略)

- 4.初始化元数据库

- 二、启动hive

-

- 1.启动Hadoop

- 2.启动hive

- 三、安装mysql

-

- 1.解压tar包并安装

- 3.初始化数据库

- 四、Hive 元数据配置到 MySQL

-

- 1.拷贝jdbc

- 2.编辑hive-site.xml

- 创建hive数据库

- 总结

前言

此专栏是在学习完Hadoop专栏的情况下继续学习。

hive简介(copy)

hive是基于Hadoop的一个数据仓库工具,用来进行数据提取、转化、加载,这是一种可以存储、查询和分析存储在Hadoop中的大规模数据的机制。hive数据仓库工具能将结构化的数据文件映射为一张数据库表,并提供SQL查询功能,能将SQL语句转变成MapReduce任务来执行。Hive的优点是学习成本低,可以通过类似SQL语句实现快速MapReduce统计,使MapReduce变得更加简单,而不必开发专门的MapReduce应用程序。

一、hive3安装

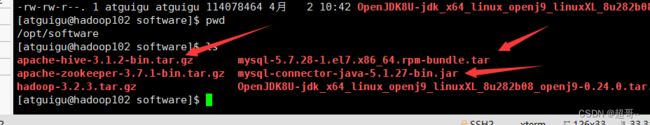

1.上传文件

直接去官网下载一个hive3即可。

附上下载连接。我没有再国内源找到。

hive3

顺便把其他需要的连接也附上

https://pan.baidu.com/s/1Y76xSBscsB9_qQa1gwXLVA

lqi4

将三个文件上传到/opt/software

将其解压到 /opt/module,并且重命名

tar -xvf apache-hive-3.1.2-bin.tar.gz -C /opt/module/

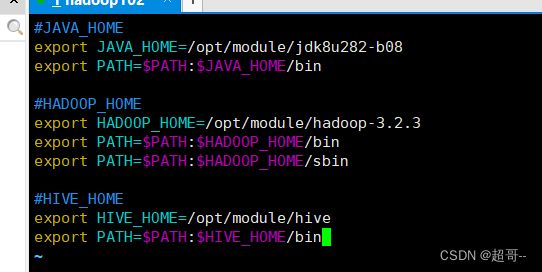

2.配置环境变量

继续在自定义的文件里追加以下内容

vim /etc/profile.d/my_env.sh

#HIVE_HOME

export HIVE_HOME=/opt/module/hive

export PATH=$PATH:$HIVE_HOME/bin

最后刷新环境

source /etc/profile.d/my_env.sh

3.修复日志错误(可忽略)

mv /opt/module/hive/lib/log4j-slf4j-impl-2.10.0.jar /opt/module/hive/lib/log4j-slf4j-impl-2.10.0..bak

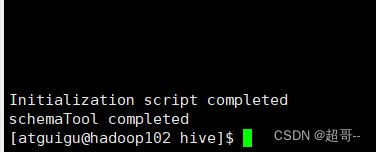

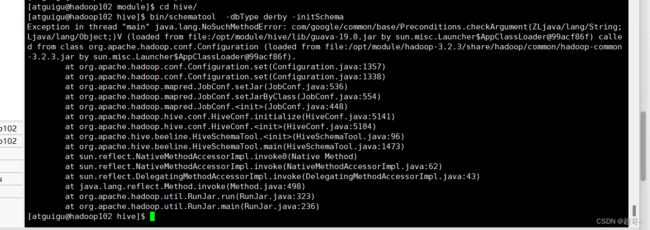

4.初始化元数据库

bin/schematool -dbType derby -initSchema

我这里出现了以下错误,后经查询是guava包不兼容导致的。

我们只需要把低版本删了,然后用高版本替换就行。

rm -rf ./hive/lib/guava-19.0.jar

mv ./hadoop-3.2.3/share/hadoop/common/lib/guava-27.0-jre.jar ./hive/lib/

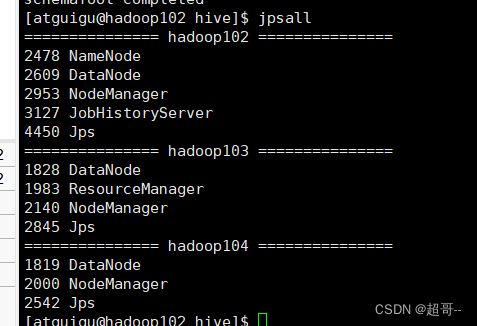

二、启动hive

1.启动Hadoop

因为hive是基于hadoop完成,所以在使用hive前需要启动Hadoop。

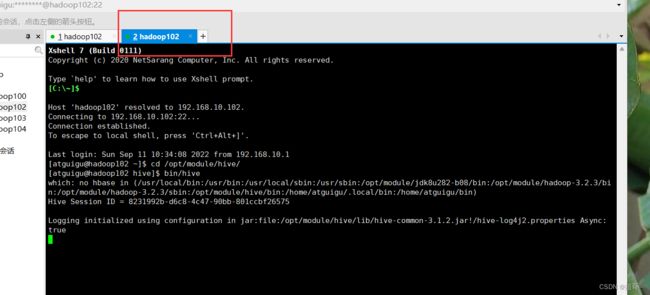

2.启动hive

bin/hive

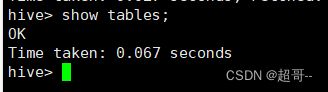

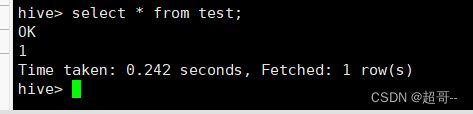

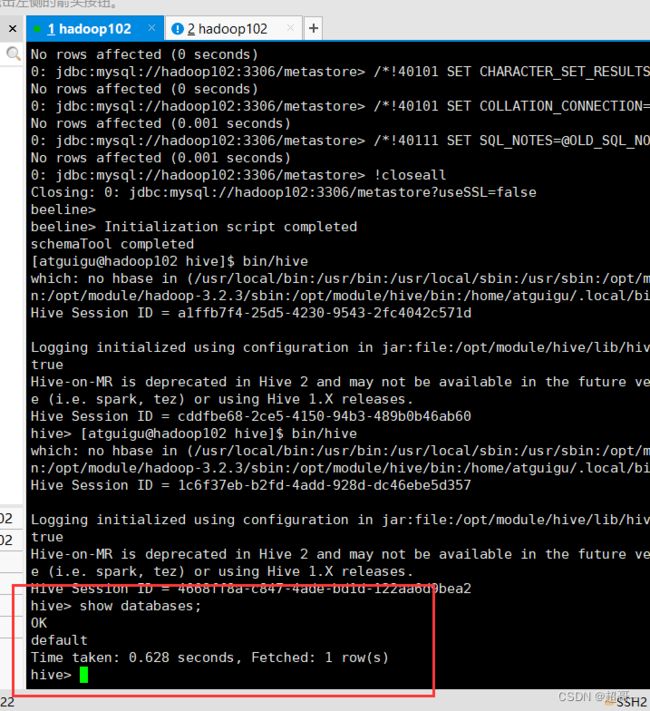

- show databases;

- show tables;

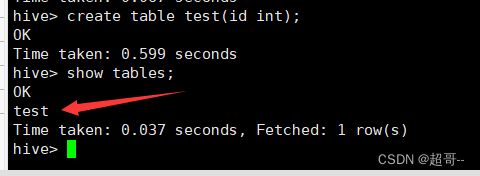

- create table test(id int);

- insert into test values(1);

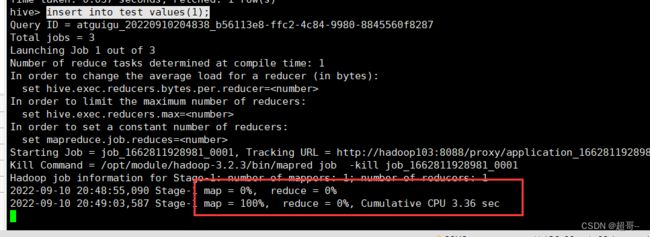

因为hive是将hql转换成MR进行,所以可以看到明显的map,reduce的过程。 - select * from test;

现在我们新开一个窗口,再次登陆hive

会发现它卡住了,这时因为hive默认的数据库是单用户模式。

三、安装mysql

Hive 默认使用的元数据库为 derby,开启 Hive 之后就会占用元数据库,且不与其他客户端共享数据,所以我们需要将 Hive 的元数据地址改为 MySQL。

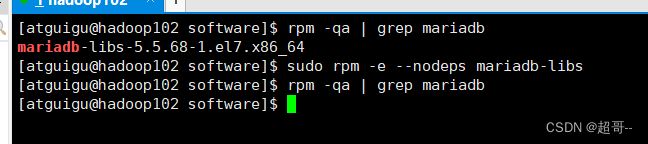

1.解压tar包并安装

tar -xvf mysql-5.7.28-1.el7.x86_64.rpm-bundle.tar

安装

sudo rpm -ivh mysql-community-common-5.7.28-1.el7.x86_64.rpm

sudo rpm -ivh mysql-community-libs-5.7.28-1.el7.x86_64.rpm

sudo rpm -ivh mysql-community-libs-compat-5.7.28-1.el7.x86_64.rpm

sudo rpm -ivh mysql-community-client-5.7.28-1.el7.x86_64.rpm

sudo rpm -ivh mysql-community-server-5.7.28-1.el7.x86_64.rpm

建议一行一行复制,不然可能会报错

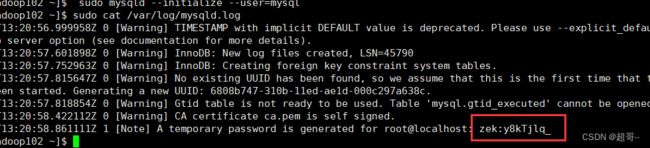

3.初始化数据库

sudo mysqld --initialize --user=mysql

查看临时密码

sudo cat /var/log/mysqld.log

sudo systemctl start mysqld

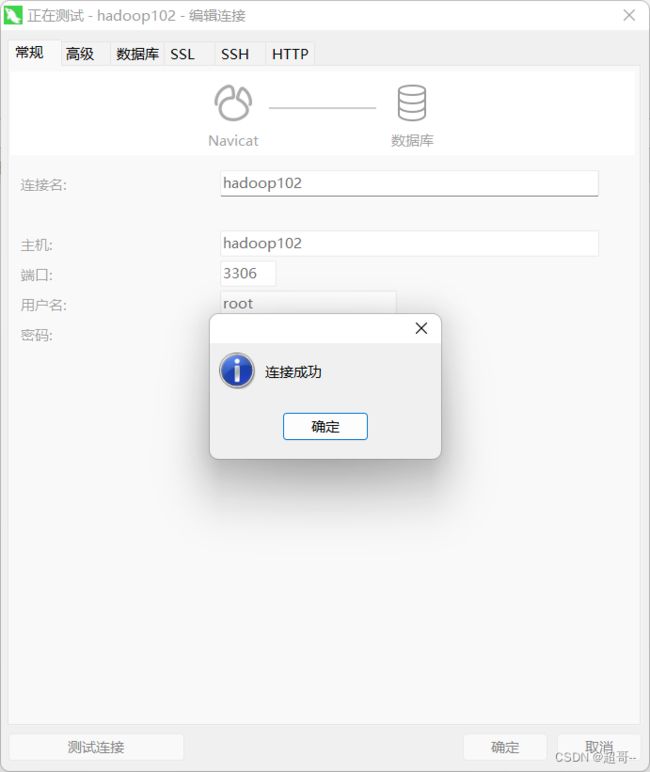

mysql -uroot -pzek:y8kTjlq_

修改密码并添加访问权限

set password = password("000000");

update mysql.user set host='%' where user='root';

flush privileges;

四、Hive 元数据配置到 MySQL

1.拷贝jdbc

cp /opt/software/mysql-connector-java-5.1.27-bin.jar /opt/module/hive/lib/

2.编辑hive-site.xml

vim /opt/module/hive/conf/hive-site.xml

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- jdbc 连接的 URL -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://hadoop102:3306/metastore?useSSL=false</value>

</property>

<!-- jdbc 连接的 Driver-->

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<!-- jdbc 连接的 username-->

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<!-- jdbc 连接的 password -->

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>000000</value>

</property>

<!-- Hive 元数据存储版本的验证 -->

<property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

</property>

<!--元数据存储授权-->

<property>

<name>hive.metastore.event.db.notification.api.auth</name>

<value>false</value>

</property>

<!-- Hive 默认在 HDFS 的工作目录 -->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive/warehouse</value>

</property>

</configuration>

创建hive数据库

create database metastore;

名称需要和刚刚配置文件的url信息一致。

再次初始化源数据库,但这次使用mysql数据库

schematool -initSchema -dbType mysql -verbose

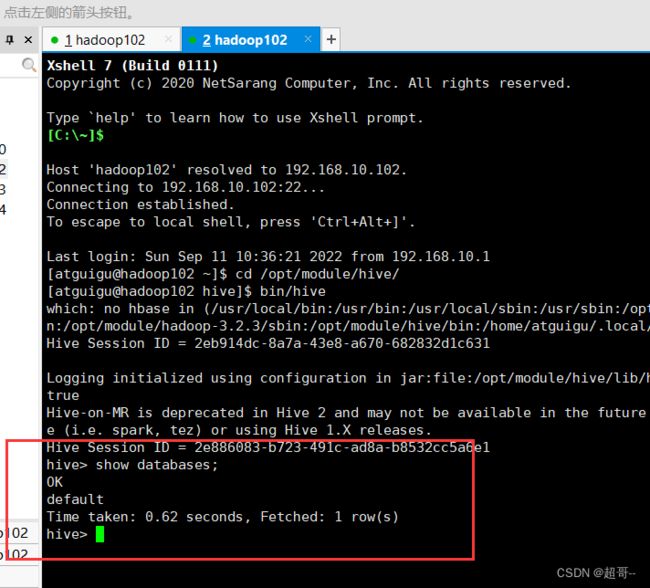

分别用两个客户端登陆hive并查表。

现在hive就可以多用户访问了。

总结

hive第一章的内容就到此结束,下次再继续写。