tensorboard快速上手教程

参考 tensorboard快速上手教程 - 云+社区 - 腾讯云

Tensorboard 是 Tensorflow提供的一个可视化工具,关于它的作用本文不想多言。

本文只是为了解决在Ubuntu 16.04系统下,由Anaconda搭建的Pycharm下的Tensorflow环境启用Tensorboard失败的问题。

在多篇相关博客中

https://blog.csdn.net/yeler082/article/details/78423628

http://www.cnblogs.com/lliuye/p/9449190.html

均提到,通过找到所安装的tensorflow路径下tensorborad.py直接启动Tensorboard.

本来应该是件按图索骥就解决的事儿,然而我这里出现了一些幺蛾子。

因此列出我的步骤如下:

1)按博客使用pip3 show tensorflow-gpu命令查询tensorflow的安装路径,然而败北,我的系统不知道为什么没有给出路径结果;

2)OK,可能是因为我是按照anaconda内安装环境的方式安装tensorflow的,所以我寻着路径去找了,最终找到路径为

/home/××××/anaconda3/envs/tensorflow/lib/python3.5/site-packages/tensorfw/tensorboard/tensorboard.py,列出路径的原因是为了让跟我一样问题的同学能找到类似的路径;

3)同时确认tensorboard生成的log文件所在的路径,最终确认为

/home/××××/PycharmProjects/firsttry/log/mnist_with_summaries/

4)在terminal中激活tensorflow: source activate tensorflow ——这一步很重要,其他博客里都没提到,我不知道是不是因为我这边比较特殊,还是说各位大神默认不需要明说此事;

5)在terminal中输入指令:python3 /home/××××/anaconda3/envs/tensorflow/lib/python3.5/site-packages/tensorfw/tensorboard/tensorboard.py --logdir=/home/××××/PycharmProjects/firsttry/log/mnist_with_summaries/

6)按照给出的地址用chrome打开tensorboard.

这里写图片描述

** 之所以把2和3两步单独拎出来是告诉大家务必要确认这两个路径是正确的,因为我之前以为自己是正确的,后来发现中间有小错误,直接导致失败。

tensorboard可对网络和各种参数进行可视化,可以方便的进行网络结构调整和调参,尤其是应对复杂网路,下面用一个例子介绍tensorboard在Linux中的使用方法。

配置开发环境并启动jupyter的方法详见博主的之前的博客:基于Ubuntu + anaconda + tensorflow+jupyter的python深度学习开发环境配置

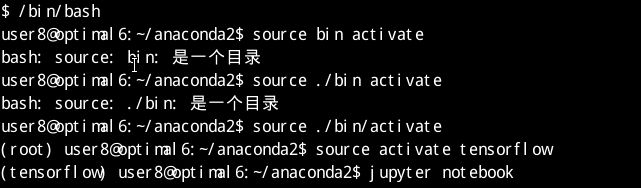

输入一下命令

/bin/bash

source ./bin/activate

source activate tensorflow

jupter notebook启动jupter notebook

示例代码为简单的MNIST手写数字分类:

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

from tensorflow.contrib.tensorboard.plugins import projector

#载入数据集

mnist = input_data.read_data_sets("MNIST_data/",one_hot=True)

#运行次数

max_steps = 1001

#图片数量

image_num = 3000

#文件路径

DIR = "/home/user8/anaconda2/CNN/"

#定义会话

sess = tf.Session()

#载入图片

embedding = tf.Variable(tf.stack(mnist.test.images[:image_num]), trainable=False, name='embedding')

#参数概要

def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.scalar('mean', mean)#平均值

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var - mean)))

tf.summary.scalar('stddev', stddev)#标准差

tf.summary.scalar('max', tf.reduce_max(var))#最大值

tf.summary.scalar('min', tf.reduce_min(var))#最小值

tf.summary.histogram('histogram', var)#直方图

#命名空间

with tf.name_scope('input'):

#这里的none表示第一个维度可以是任意的长度

x = tf.placeholder(tf.float32,[None,784],name='x-input')

#正确的标签

y = tf.placeholder(tf.float32,[None,10],name='y-input')

#显示图片

with tf.name_scope('input_reshape'):

image_shaped_input = tf.reshape(x, [-1, 28, 28, 1])

tf.summary.image('input', image_shaped_input, 10)

with tf.name_scope('layer'):

#创建一个简单神经网络

with tf.name_scope('weights'):

W = tf.Variable(tf.zeros([784,10]),name='W')

variable_summaries(W)

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]),name='b')

variable_summaries(b)

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,W) + b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

with tf.name_scope('loss'):

#交叉熵代价函数

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y,logits=prediction))

tf.summary.scalar('loss',loss)

with tf.name_scope('train'):

#使用梯度下降法

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(loss)

#初始化变量

sess.run(tf.global_variables_initializer())

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

#结果存放在一个布尔型列表中

correct_pre

diction = tf.equal(tf.argmax(y,1),tf.argmax(prediction,1))#argmax返回一维张量中最大的值所在的位置

with tf.name_scope('accuracy'):

#求准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))#把correct_prediction变为float32类型

tf.summary.scalar('accuracy',accuracy)

#产生metadata文件,此文件用于保存tensorboard的信息

if tf.gfile.Exists(DIR + 'metadata.tsv'):

tf.gfile.DeleteRecursively(DIR + 'metadata.tsv')

with open(DIR + 'metadata.tsv', 'w') as f:

labels = sess.run(tf.argmax(mnist.test.labels[:],1))

for i in range(image_num):

f.write(str(labels[i]) + '\n')

#合并所有的summary

merged = tf.summary.merge_all()

//下面的代码根据tensorflow官网修改,网址为

//https://tensorflow.google.cn/guide/summaries_and_tensorboard

//作用是向metadata.tsv中导入网络、参数、训练过程的信息,用于在tensoeboard中可视化

projector_writer = tf.summary.FileWriter(DIR,sess.graph)

saver = tf.train.Saver()

config = projector.ProjectorConfig()

embed = config.embeddings.add()

embed.tensor_name = embedding.name

embed.metadata_path = DIR + 'metadata.tsv'

embed.sprite.image_path = DIR + 'mnist_10k_sprite.png'

embed.sprite.single_image_dim.extend([28,28])

projector.visualize_embeddings(projector_writer,config)

for i in range(max_steps):

#每个批次100个样本

batch_xs,batch_ys = mnist.train.next_batch(100)

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

run_metadata = tf.RunMetadata()

summary,_ = sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys},options=run_options,run_metadata=run_metadata)

projector_writer.add_run_metadata(run_metadata, 'step%03d' % i)

projector_writer.add_summary(summary, i)

if i%100 == 0:

acc = sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

print ("Iter " + str(i) + ", Testing Accuracy= " + str(acc))

saver.save(sess, DIR + 'a_model.ckpt', global_step=max_steps)

projector_writer.close()

sess.close()

DIR = "/home/user8/anaconda2/CNN/"里面存放数据源。等训练结束后自动生成文件metadata.tsv,用于保存网络结构、参数和训练过程的信息。

之后打开终端,重新进入虚拟环境,输入命令:

tensorboard --lodir= /home/user8/anaconda2/CNN地址为metadata.tsv文件的路径。执行此命令可已生成一个网址,将网址复制到浏览器中打开即可,注意经常会遇到端口占用问题,博主最后找到一个有效的方法是自己指定,一般换几次就好了。

进入tensorflow后详细教程请参见tensorflow官网:开始使用 TensorBoard | TensorFlow

也可参考博客:https://blog.csdn.net/weixin_36670529/article/details/84580917

参考网址:Ubuntu 16.04 Anaconda + Pycharm + Tensorflow 启用Tensorboard的要点_耳东小白的小笔记本儿-CSDN博客